训练一个简单的卷积神经网络(CNN)来对CIFAR图像进行分类

如何训练一个简单的卷积神经网络(CNN)来对CIFAR图像进行分类

# 本教程演示如何训练一个简单的卷积神经网络(CNN)来对CIFAR图像进行分类。

# 因为本教程使用Keras顺序API,所以创建和训练我们的模型只需要几行代码。

import tensorflow as tf

from tensorflow.keras import datasets, layers, models

import matplotlib.pyplot as plt # Matplotlib 是一个 Python 的 2D绘图库

# 下载并准备CIFAR10数据集

# CIFAR10数据集包含10个类中的60000个彩色图像,每个类中有6000个图像。

# 数据集分为50000个训练图像和10000个测试图像。这些类是互斥的,它们之间没有重叠。

(train_images, train_labels), (test_images, test_labels) = datasets.cifar10.load_data()

# Normalize pixel values to be between 0 and 1 将像素值规格化为介于0和1之间

train_images, test_images = train_images / 255.0, test_images / 255.0

运行一下:

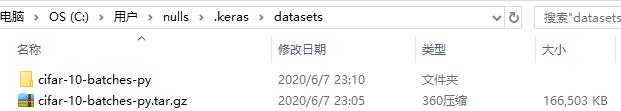

需要下载数据集,特别慢,复制下面链接去迅雷下载,很快

http://www.cs.toronto.edu/~kriz/cifar-10-python.tar.gz

下载下来的文件放到~/.keras/datasets/ 目录下,然后将文件名改名为cifar-10-batches-py.tar.gz

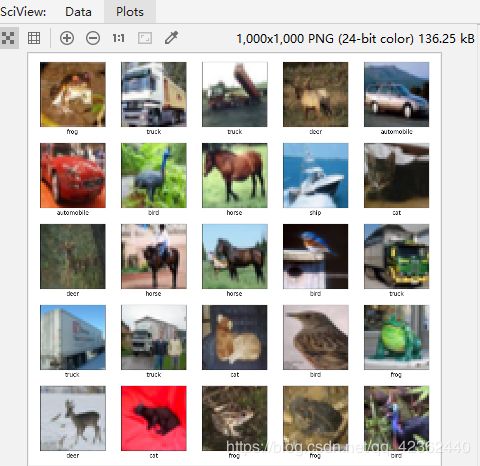

# 验证数据

# 为了验证数据集看起来是否正确,让我们绘制训练集中的前25个图像,并在每个图像下面显示类名。

class_names = ['airplane', 'automobile', 'bird', 'cat', 'deer',

'dog', 'frog', 'horse', 'ship', 'truck']

plt.figure(figsize=(10,10))

for i in range(25):

plt.subplot(5,5,i+1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

plt.imshow(train_images[i], cmap=plt.cm.binary)

# The CIFAR labels happen to be arrays, CIFAR标签碰巧是数组,

# which is why you need the extra index 所以你需要额外的索引

plt.xlabel(class_names[train_labels[i][0]])

plt.show()

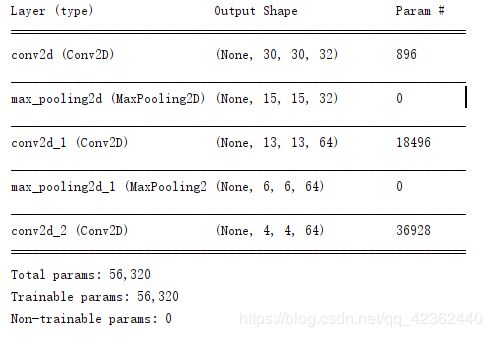

# 创建卷积基

# 下面的6行代码使用一个通用模式定义卷积基:Conv2D和MaxPooling2D层的堆栈作为输入,

# CNN采用形状张量(图像高度、图像宽度、颜色通道),忽略批大小。

# 如果您不熟悉这些维度,则颜色通道指(R、G、B)。

# 在本例中,您将配置我们的CNN来处理shape(32、32、3)的输入,

# 这是CIFAR图像的格式。可以通过将参数input_shape传递到第一层来完成此操作。

model = models.Sequential()

model.add(layers.Conv2D(32, (3, 3), activation='relu', input_shape=(32, 32, 3)))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(64, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(64, (3, 3), activation='relu'))

# Let's display the architecture of our model so far.

model.summary()

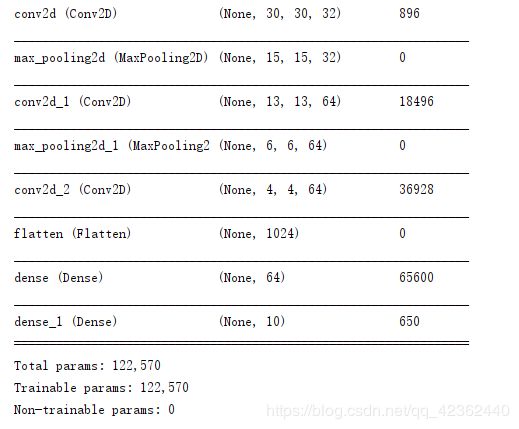

上面,您可以看到每个Conv2D和MaxPooling2D层的输出都是一个三维形状张量(高度、宽度、通道)。随着网络的深入,宽度和高度维度往往会缩小。每个Conv2D层的输出信道的数量由第一个参数控制(例如,32或64)。通常,随着宽度和高度的缩小,您可以(通过计算)在每个Conv2D层中添加更多的输出通道。

在顶部添加密集层

为了完成我们的模型,您将把最后一个输出张量从卷积基(形状(4,4,64))馈入一个或多个密集层以执行分类。密集层以矢量作为输入(一维),而当前输出是三维张量。首先,将三维输出展平(或展开)为1D,然后在顶部添加一个或多个密集层。CIFAR有10个输出类,因此使用最后一个密集层,其中有10个输出和一个softmax激活。

model.add(layers.Flatten())

model.add(layers.Dense(64, activation='relu'))

model.add(layers.Dense(10))

# 这是我们模型的完整架构。

model.summary()

如您所见,我们的(4,4,64)输出在经过两个密集层之前被展平成形状向量(1024)。

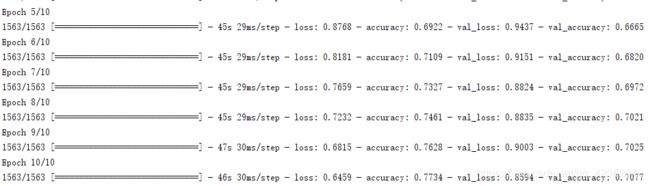

编译和训练模型

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

metrics=['accuracy'])

history = model.fit(train_images, train_labels, epochs=10,

validation_data=(test_images, test_labels))

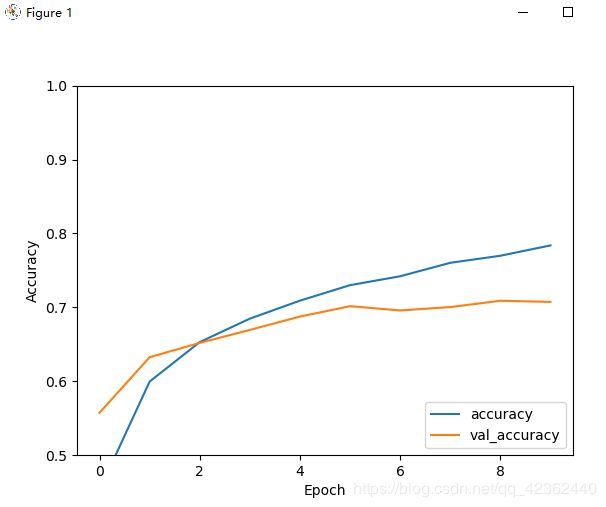

Evaluate the model评估模型

plt.plot(history.history['accuracy'], label='accuracy')

plt.plot(history.history['val_accuracy'], label = 'val_accuracy')

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.ylim([0.5, 1])

plt.legend(loc='lower right')

test_loss, test_acc = model.evaluate(test_images, test_labels, verbose=2)

print(test_acc)