上周人工智能信息摘要。中国的 AI 史普尼克危机;DeepMind 新研究,如何避免公地悲剧;AI 神经进化论小览;机器人跳水;蒙特利尔,AI安全方面240万美元捐款;Facebook, 对抗性小黄人;Deepmind,神经科学与AI的融合;AI安全,人类干预开关;定制AI加速芯片的黎明...

紧接着 AlphaGo 带来的史普尼克危机,中国推出国家AI计划(我们要开启认真模式咯哦):

史普尼克危机 (Sputnik Moment): 1957年10月4日,苏联成功发射史普尼克一号。之前,美国一直以为自己在导弹和航空领域立于不败之地。也尝试发射了两枚人造卫星,均告以失败。此次史普尼克1号的成功,无疑是当场啪啪啪打脸,立刻吓尿,开启阿波罗计划,此后太空竞赛开始。这次事件成为冷战的转折点,也被称为 Sputnik Moment. 之后也被用来比喻,类似学霸天天不学习,突然猛然发现被学渣超越,立刻重新奋起直追的事件。

... AlphaGo 成为了中国的史普尼克危机。Google DeepMind 在围棋,这个在东方国家(尤其是中国)有着巨大文化意义的游戏中,展示了自己强大的算法实力。这无疑,帮组推动了,中国政府刚刚公布的国家AI战略。这一战略将会促使中国国家、地方政府还有私人公司各方面显著增加对AI的投资,因为他们力求在2030年前,把中国变成AI方面的世界领导。

而与此同时,美国却在不断削减自己的科研经费(特朗普的锅),只启动了少数大型科学项目。这将会带来美国拱手将自己某些领域的技术优势,让给那些对增加科研经费有很大兴趣的国家的风险。

“纽约时报”或“中国日报”阅读更多。

国务院关于印发新一代人工智能发展规划的通知全文

来自DeepMind的多代理 (agent) 研究,如何避免公地悲剧(这是我的,这也是我的,反正世界都是我的):

... 公地悲剧是一个通俗的术语,指的是想要最大程度获取共同资源,以满足自己利益的人性倾向。但是,在某种程度上人们还是能够在此基础上进行合作的。于是一些AI研究人员就想要试图找出,如何在虚拟机器人中对这些协作属性进行编码,来让他们定期发生一些无私的合作。

... DeepMind 的一篇新的研究论文,试图通过创建一个系统来解决这个问题,这个系统分为两个部分:一个是世界模拟器,另一个是具有原始感知能力的虚拟机器人们。机器人的目标是收集分散在世界各地的苹果,但是苹果只在彼此周围才会高频率出现,所以自私的过度采集将会导致较低的总得分。每个机器人都配备了一个技能“暂停光波”,对其他机器人发射就可以使目标暂停20个回合。使用光线攻击不会产生任何奖励或惩罚,但是会因为攻击进犯者而减慢了自己的采集速度。于是进犯者会从中吸取教训,因为它僵硬的时候是不能收集苹果的。

...微型社会的三个阶段:

...在测试中,研究人员注意到多机器人模拟中,大概会出现三个不同阶段。第一个阶段,他们称之天真阶段,机器人随机散开,各自收集苹果。之后,就是被研究人员称之为悲剧的第二阶段,机器人学会了如何最大化自己的利益,苹果立刻遭到了过度采集。然后进入第三阶段,称之为“成熟”阶段,时不时会有相当巧妙的合作行为出现。

...关于更多的细节,包括出现的各种合作与竞争模式的细节,请阅读论文。 A multi-agent reinforcement learning model of common-poolresource appropriation.

AI神经进化论小览 (我才是新世界的神!):

肯尼·斯坦利 (Ken Stanley),他的NEAT和HyperNEAT算法被研究人员广泛应用于不断发展的AI神经进化领域中。最近他为O'Reilly撰写了一篇非常棒的关于该领域的回顾,全篇各种八卦。 (他还将该领域与其他相关进展联系起来,比如Google的进化神经网络架构和OpenAI关于进化策略的工作。)

点击

机器人的跳水身亡(伦家不要工作了):

... 上周,一台 Knightscope 机器人横尸喷泉内的图片洗刷了各大网络。

... Bisnow 对图片背后的故事做了一些报道。详细信息:该机器人是最近才就职于在乔治城,一个叫做“华盛顿港”综合设施内的。工作的第一天,该机器人(Knightscope的“K5”系列安全机器人第42号)就不幸溺水身亡。这到底是道德的沦丧还是人性的扭曲。

... 顺便提一下,这些机器人现在讨生活还是很难的,因为处理各种复杂真实场景是非常困难的。 Bisnow说:“没有人把史蒂夫(死者)推入水中,但是有某些东西使得他从规划好的路线转向了喷泉,结果失足落入水中。”

蒙特利尔的AI安全捐款240万美元 (为了人类的未来,这点钱算什么)

... 公开慈善项目向蒙特利尔学习算法学院(MILA)提供了为期4年240万美元的赠款。这笔钱旨在资助人工智能安全方面的研究 - 这是AI中的最近快速增长(但仍然很小)的一个领域。...如果人工智能安全如此重要,为什么只有这么点钱(相对来说)呢?因为这是 Bengio (蒙特利尔大学), 和 Pineau 和 Precup 认为实际上可以有效地花费的钱。

... 这让我想起了盖茨的一句话,说慈善事业不仅仅是往缺钱的地方砸钱就能完成的。你需要根据捐款领域的大小决定你的捐款规模,有些是不能光靠投钱就能人为扩张的。

...赠款更多 细节。

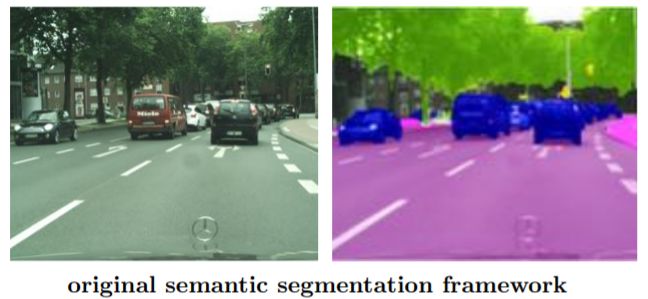

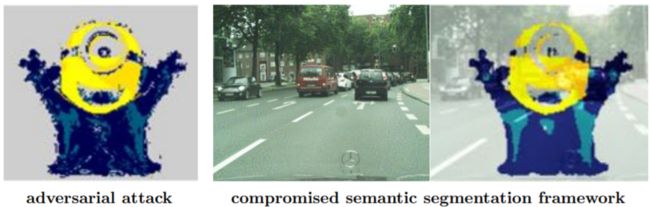

Facebook 捣鼓出了对抗性小黄人 (Muak Muak Muak):

... Facebok AI Research 最近宣布了,一种用于在多个领域自动创建对抗样本的系统 Houdini 的消息。

... 对抗样本是一种破坏机器学习系统的方法。他们通过巧妙地扰乱输入数据,使分类器对其进行误分类。这其实暗示很多很可怕的事情:自动驾驶车会把停止标牌误认为加速标牌,一下加速到高速公路的速度,或者是机器人看不见门直接撞墙上等等。

...在这项研究中,Facebook 由组合不可分 (combinatorial and non-decomposable) 数据生成了对抗性示例,展示了各种分割模型,音频输入和人类姿态分类系统中的漏洞。他们的方法中彩蛋是,创造出一个对抗性输入,来导致分割模型不会完整地分割出一个场景中的汽车,街道和人行道,反而将场景分解成了一个单一的卡通人物“小黄人” (你们这蹭热点意图也太明显了)。

...更多 Houdini: Fooling Deep Structured Prediction Models.

神经科学与AI的融合 :

...来自Cell中的一篇 DeepMind 的文章(包括作为 CEO 和神经科学老司机的 Demis Hassabis), 文章包括了关于深度学习和强化学习模型,很全面并且可读性很强的历史调查,之后扩展讨论目前已知的大脑拥有的功能模块,以及AI研究人员在构建这些系统时,如何从脑神经科学研究中受益。

...下一代 AI 的未知或未充分探索的领域包括:能够持续学习的系统;能够像我们脑中海马体一样,兼顾短期记忆(也称为工作记忆),以及长期记忆功能的系统。

... 未来其他需要探索领域包括:我们人类是如何发展出了高效的迁移学习系统,我们又是如何直觉性地从物理世界中学习抽象概念(比如关系),还有我们如何在脑中预演行动步骤以使我们成功达成目标。

... 这篇论文的一个缺点是,大多数参考文献都指向DeepMind自己的论文。然而,看到一个更全面的研究领域概况,将是一件非常棒的事情,因为还要无数的人在各种领域也都发表了自己的文章。

...更多: Neuroscience-inspired artificial intelligence。

AI安全:人类干预开关 (一二三,木头人):

... 牛津大学和斯坦福大学的最新研究,提出了一种让 AI 系统安全工作的方法。那就是让人类监督者来遏制灾难性的行动的发生 - 比如一次错误行动导致的次优结果的产生。(在没有人类监督的强化学习AI机器人,会在每场比赛中作出近万次灾难性的决定,研究人员写道。)

... 该系统通过人来识别可能导致灾难性决策的游戏或环境的部分,然后训练 AI 机器人根据人类的输入来避开这些地方。

...这种被称为HIRL(人类干预强化学习)的技术,对于正在部署的特定类型的 RL 算法是不用知道的。因此在一个环境中对一个机器人进行训练产生的阻止策略,可以迁移到同一环境中的其他机器人,亦或通过迁移学习(尚未解决)迁移到新的环境中去。

...该系统允许人类训练算法来避免某些动作,例如在乒乓球游戏中,不将拍子拉到球桌底端(如果对手把球打到顶端,这样会很难接住);或在太空侵略者游戏中训练其,不要把它与外星侵略者之间的屏障打掉。

...人类时间:

随着这种人类介入的人工智能系统的流行,一个有趣的调查是,看看对于一个特定的系统需要多少人类的介入时间。在这项研究中,人类监督员花了4.5个小时来看强化学习机器人玩游戏 ,之后再介入指明要阻止发生的行为。

... 研究人员在三种不同的 Atari 游戏中测试了他们的方法 - 乒乓球,太空侵略者和 Road Runner (走鹃)。希望能够看到这项技术能够得到提高,采样变得更有效率,还有就是能够应用到更多的不同场景去。

...更多: Trial without Error: Towards Safe Reinforcement Learningvia Human Intervention

芯片新创公司Graphcore背后的名人录 (我们都挺你):

... Graphcore 是一家开发用于准确AI应用芯片的半导体公司,这次由 Atomico 公司领导的一轮投资中,筹集了3000万美元。

这次B轮中,有着来自各方面尖端AI开发人员的天使投资,其中包括 Greg Brockman,Ilya Sutskever和Scott Gray(OpenAI),Pieter Abbeel(OpenAI / UC Berkeley),Demis Hassabis(DeepMind),和 Zoubin Ghahramani(剑桥大学/ Uber首席科学家)。

... “计算能力是AI的命脉,”Ilya Sutskever告诉彭博社。

定制AI加速芯片的黎明 (明天劳资就去手机上跑深度网络):

... 随着摩尔定律逐步失效,各大公司在寻求通过将智能定制处理器嵌入设备中的方式,来继续加倍在人工智能方面的努力。加速芯片的推理能力,使设备无需连接回有足球场大的数据中心去,就能处理。

... 最新:微软周日宣布计划在其 Hololens VR眼镜中嵌入新的定制处理器。目前知道的细节还很少,但彭博社报道,该芯片将用于加速设备上的音视频处理。

... 而微软并不是唯一一家,Google的TPU芯片也能被同时用于训练和推理。该公司目前正在开发一个TPU系列,将可以缩小一定尺寸并将它们嵌入到设备中去。 与此同时,苹果公司已经报告说正在为下一个iPhone开发神经芯片。

... 想看到的:Raspberry Pi上的推理芯片 - 一个面向大家的便宜,而又开放的AI加速器基板。

中国引领了 ImageNet 2017竞赛 (我要占据各种头条!):

... 中国队在最终的 ImageNet 比赛中赢得了三大项目中的两项冠军,这是该国进行大量 AI 战略投资的又一表现。

... 高得分:2.25%。此次 ImageNet 中 2b 分类任务的错误率。如果你密切关注了长期以来错误率的变化。 就可以看出自2012年以来,我们已经走了很长的路了(从大概15%的错误率开始)。

...技术:

它使用 Squeeze and Excitation Block 作为基础组件,再加上被广泛使用的架构,比如 Residual nets 和 Inception-style networks。

...“所有模型都由我们设计的分布式深度学习训练系统 ROCS 训练得出。我们对其 GPU 内存还有 GPU 服务器上信息传播进行了大量优化。受益于此,我们的系统用同步SGD在64位Nvidia Pascal Titan X GPU上连续训练20个小时,批大小为2048的SE-ResNet152时,都无需预热。“ 他们写道。

... 中国在今年比赛中的表现是值得关注的,这也是该国日趋复杂和规模化的AI生态系统又一表现。但需要注意的是:许多组织并不会参与ImageNet比赛,可能只会在自己能够明显从比赛中获益的情况下才会参与(比如,2013年的获奖者是Clarifai,一家纽约的新兴创业公司,希望通过媒体给他们打广告;而2015年,获奖者微软,想要传播他们的Residual Networks (一个很重要的新技术,之后在许多其他领域被广泛使用).

...更多:这里查看完整的结果和团队信息

...未来:这是ImageNet竞赛的最后一年了。可能的后续数据集可以是VQA(视觉问答系统)或者其他了。

深度学习到底是什么 (你问我?我也不知道。):

...“一连串的简单,连续的几何变换,从一个向量空间映射到另一个向量空间”,Keras创始人Francois Chollet在一篇博文中写道。 “到目前为止,深度学习的唯一真正的成功就是,给予其大量的人为注释的数据,可以利用连续的几何变换将空间X映射到空间Y的能力。虽然这对于每一个行业都是巨大冲击,但是他还说,离真正的人脑级别AI还有很长的路要走。

...更多,the limitations of deep learning'

香港AI创业公司获得“有史以来最大”一轮AI投资:

...面部识别专家商汤科技筹集了4.1亿美元的风险投资(!!!)。

... 商汤科技为中国最大一些组织的提供着AI服务,从中国移动到科大讯飞,再到华为和FaceU激萌. 可以查看它的“核心技术“人脸识别页面,比如里面的真人检测,检测出来把你照片打印出来希望骗过检测系统的骗子们。

...这轮投资更多信息。

...其他值得一提的AI投资:2014年11月的Sentient为1亿美元,2014年春季的AGI初创公司Vicarious为4千万美元,加拿大的新创公司Element AI为1亿200万美元。

伯克利人工智能研究(BAIR)博客文章:

...为什么AI的未来应该是元学习:我们如何创建能够学习解决任务并提取通用技能的多功能且能够自适应的算法呢? 这就是元学习提出的关键问题之一,最近还有很多关于这方面激动人心的新研究(包括来自伯克利分校的论文)。

...更多:Learning to Learn