机器学习的主要研究领域、基本概念和相关术语的解释

1.主要研究领域:

1.1机器学习的两大学派:

机器学习:人工智能的重要分支

构造具有学习能力的智能系统

知识、推理、学习

手段:统计,逻辑,代数……

统计机器学习

从大量样本出发,运用统计方法,发现统计规律

有监督学习、无监督学习、半监督学习

问题:分类,聚类,回归

1.2主要研究领域:

1.2.1符号机器学习:Eg. 决策树,ID3,…

1.2.2计算学习理论(统计学习理论):PAC,SVM

1.2.3监督学习,非监督学习,半监督学习

1.2.4集群机器学习:Ensemble Learning, Boosting

1.2.5流行(Manifold)学习

1.2.6强化学习

1.2.7Ranking学习

1.2.8聚类学习…

前最主要的应用领域有:专家系统、认知模拟、规划和问题求解、数据挖掘、网络信息服务、图象识别、故障诊断、自然语言理解、机器人和博弈等领域。

目前大部分的应用研究领域基本上集中于以下两个范畴:分类和问题求解。

(1)分类任务要求系统依据已知的分类知识对输入的未知模式作分析,以确定输入模式的类属。相应的学习目标就是学习用于分类的准则(如分类规则)。

(2)问题求解任务要求对于给定的目标状态,寻找一个将当前状态转换为目标状态的动作序列;机器学习在这一领域的研究工作大部分集中于通过学习来获取能提高问题求解效率的知识(如搜索控制知识,启发式知识等)。

3.机器学习基本概念:

3.1回归:

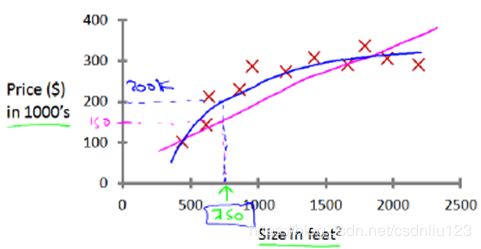

经过算法预测的结果是一个连续的值,我们称这样的问题为回归问题。

从数学上看,回归的本质是数据拟合。

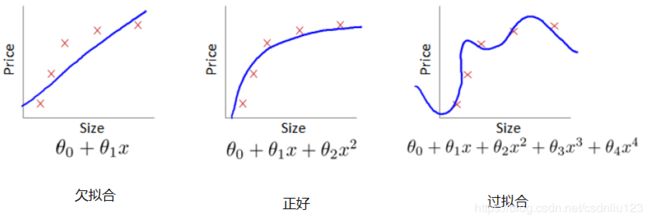

3.2 低拟合与过拟合:

第一个模型是一个线性模型,低度拟合,不能很好地适应训练集;第三个模型是一个四次方的模型,过度拟合,虽然能非常好地适应我们的训练集,但在新输入变量进行预测时可能会效果不好;中间的模型似乎最合适

3.2.2:低拟合与过拟合的解决办法:

随着特征个数的增多,训练集的误差逐渐减小。交叉验证集的误差是先减小后增大。

根据上面图表,我们知道:训练集误差和交叉集误差近似时:低拟合,交叉验证集误差远大于训练集误差时:过拟合

因此,我们在完善模型的过程中,若需要解决过拟合,可以尝试减少特征的数量。若需要解决低拟合,可以尝试增加特征的数量。

3.3分类:

算法能够学会如何将数据分类到不同的类里,我们称这样的问题为分类问题。

3.4聚类:

聚类(clustering)就是将具体或抽象对象的集合分组成由相似对象组成的为多个类或簇的过程。由聚类生成的簇是一组数据对象的集合,簇必须同时满足以下两个条件:每个簇至少包含一个数据对象;每个数据对象必须属于且唯一地属于一个簇。

聚类分析是指用数学的方法来研究与处理给定对象的分类,主要是从数据集中寻找数据间的相似性,并以此对数据进行分类,使得同一个簇中的数据对象尽可能相似,不同簇中的数据对象尽可能相异,从而发现数据中隐含的、有用的信息。

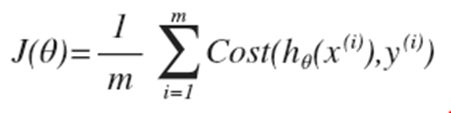

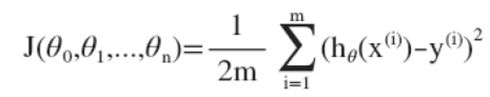

3.5代价函数:

损失函数(loss function)或代价函数(cost function)是将随机事件或其有关随机变量的取值映射为非负实数以表示该随机事件的“风险”或“损失”的函数。在应用中,损失函数通常作为学习准则与优化问题相联系,即通过最小化损失函数求解和评估模型。例如在统计学和机器学习中被用于模型的参数估计。

机器学习中,给定独立同分布(independent and identically distributed,iid)的学习样本 ,和模型 ,损失函数是模型输出和观测结果间概率分布差异的量化。

学习的目的便是选择出使代价函数最小的模型参数θ

例 城市交通问题。设有5个城市,它们之间的交通线路如左图所示,图中的数字表示两个城市之间的交通费用,即代价。用代价树的广度优先搜索,求从A市出发到E市,费用最小的交通路线。

解:代价树如右图所示。其中,红线为最优解,其代价为8

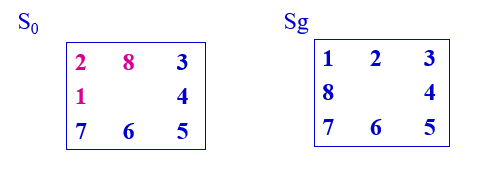

例 八数码难题。设问题的初始状态S0和目标状态Sg如图所示。请用全局择优搜索解决该问题。

解:该问题的全局择优搜索树如下图所示。在该图中,每个节点旁边的数字是该节点的代价函数值。

例如,对节点S2,其估价函数值的计算为:f(S2)=d(S2)+W(S2) =1+3=4

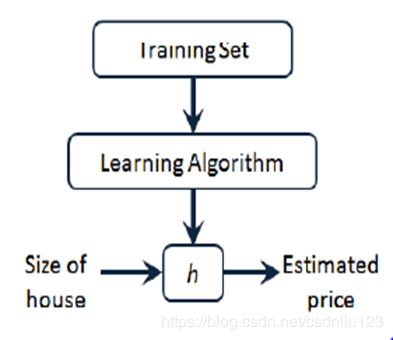

3.6假设模型:

h代表学习算法的解决方案或函数,也称假设。

例如,我们要解决房价预测问题,我们实际上是要将训练集“喂”给我们的学习算法,进而学习得一个假设h,然后将我们要预测的房屋的尺寸作为输入变量输入给h,预测出该房屋的交易价格作为输出变量输出的结果,θ是影响h的参数。

3.7模型选择:

模型选择的方法为(训练集60%,交叉验证集20%,测试集20%):

1.使用训练集训练出若干个模型

2.用这些模型分别对交叉验证集计算得出交叉验证误差(交叉验证集用来对刚训练出的模型进行预报,以得出最佳的模型)

3.选取代价函数值最小的模型

4.用步骤3中选出的模型对测试机计算得出推广误差

3.8有监督学习:

有监督的学习方法

在样本标签已知的情况下,可以统计出各类训练样本不同的描述量,如其概率分布,或在特征空间分布的区域等,利用这些参数进行分类器设计,称为有监督的学习方法。

3.9无监督学习:

无监督学习

然而在实际应用中,不少情况下无法预先知道样本的标签,也就是说没有训练样本

因而只能从原先没有样本标签的样本集开始进行分类器设计,这就是通常说的无监督学习方法。

对一个具体问题来说有监督与无监督的作法是不相同的

4.0评估假设:

对假设的精度进行评估是机器学习中的基本问题;

一方面,可以用于了解是否可用该假设。如:从一个长度有限的数据库中学习以了解不同医疗手段的效果,有必要尽可能准确知道学习结果的正确性;

另一方面,对假设的评估是许多学习方法的重要组成部分。如:在决策树学习中,为了避免过度拟合必须进行后修剪,必须评估每一步修剪对树的精度产生的影响,了解已经修剪和未被修剪树的精度估计中固有的可能误差。

已知一个假设在有限数据样本上观察到的精度,怎样估计它在其他实例的精度?

若一个假设在某些数据样本上好于另一个,那么该假设是否更准确?

当数据有限,怎样高效利用数据,通过它们学习假设与估计精度?

数据样本包含n=40个样例,并且假设h在这些数据上产生了r=12个错误,这样样本错误率为:

error(h)=12/40=0.3

如果没有更多的信息,对真实错误率的最好的估计即为0.3

但是,如果另外收集40个随机抽取的样例S’,样本错误率error’(h)将与原来的error(h)存在一些差别,如果不断重复这一实验,每次抽取一个包含40样例的样本将会发现约95%的实验中计算所得的区间包含真实错误率。

将上面的区间称为真实错误率的95%置信区间估计。

评估假设主要采用统计的方法,结合有关数据基准分布的假定,使我们可以用有限数据样本上的观察精度来逼近整个数据分布上的真实精度。