论文阅读(二):LSTD: A Low-Shot Transfer Detector for Object Detection

论文链接:https://arxiv.org/abs/1803.01529

有问题的地方请指出~

摘要

近期,基于大规模数据集,目标检测由了飞速的发展。但是完整标记的数据集并非易得,因此,文章提出了一种新的方法:low-shot transfer detector (LSTD),能够利用源域中充足的知识来构建只有少量训练样本的目标域上的有效检测器。文中的主要贡献有:

1. 提出了灵活的LSTD深度架构,该框架整合了SSD和Faster RCNN的优点,将它们统一到一个深度框架中,该框架能够缓解小样本带来的迁移问题。

2. 引入全新的小样本检测正则化迁移学习框架,使用了迁移知识(transfer knowledge, TK)和背景抑制(background depression, BD)作为正则项,使得充分得利用源域和目标域中的知识。

引入

过去的几年里,许多基于深度学习的目标检测方法取得了瞩目的成就,但是这些方法很大程度上依赖于完整标记的大规模的数据,然而在实际实践中,完整标记的数据集是很有限的。(这里值得注意的是,在目标检测问题中,完整标记是指既有类别标签,又有对应类别的物体所在位置的边界框标签)。

对于这一问题,一个普遍的方法是收集额外的容易标注的数据集,但是训练图像缺乏充分的监督,该方法的效果依然较受限制。另一个方法是进行迁移学习。鉴于迁移学习在图像分类问题上的成功范例,考虑将它应用到目标检测问题中,对比与增加简单标注的解决方法,迁移学习不需要额外的数据集,这一点的占优的。更重要的是,源域中的知识将是生成目标域的检测器过程中的有效监督。虽然想法很好,但是基于小样本目标检测的迁移学习依旧是很困难的,原因如下:

1. 将普遍的迁移学习方法应用到目标检测中是不合适的。这是因为在很小目标数据集上进行微调,很难消除检测问题和分类问题之间的不同点。

2. 事实证明,相比于分类问题,在目标检测问题上进行迁移学习,会更容易发生过拟合。这可能是因为目标检测需要学习的知识更多(位置信息和类别信息)。

3. 微调可能会降低可移植性。因为它很可能会忽略源域和目标域中的重要信息。

为了解决以上问题,文章提出了LSTD。文中提出了新型的LSTD深度框架,通过结合SSD和Faster RCNN的优点,提高小样本检测能力,该框架可以灵活地在模型的不同位置执行边界回归和物体分类。此外,文章提出新型正则化迁移学习框架,正则化表示由迁移知识(TK)和背景抑制(BD)组成。TK将源域中样本标签知识迁移到目标域的候选区中,使得在目标域中能生成小样本学习。BD将目标域图像的边界回归信息作为额外的监督,使得LSTD可以抑制背景信息的干扰,在迁移过程中专注于物体本身。

Low-Shot Transfer Detector (LSTD)

- LSTD的基本深度框架

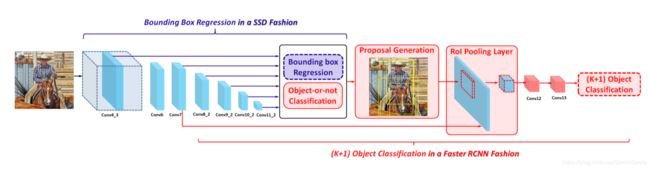

图1为LSTD的深度框架。首先,使用SSD的风格来设计边界回归。对于卷积网络中的每一层,都存在大量的候选框和一个真实的物体边界,使用回归损失(L1)来计算预测值和真实值之间的差距。这种SSD型多层卷积特征的设计非常适合于不同尺寸的物体定位,而这对于训练样本少的小样本目标检测是很重要的。

其次,使用Faster RCNN风格来设计目标分类。特别地,对于每个默认框,使用二分类策略,检测该框中是否存在物体。然后根据分类值,选择候选框。其次,应用RoI池化层,对每个候选框生成固定大小的特征矩阵。最后,使用两次卷积进行K+1个物体分类。作者提到,这样从粗糙到细致的分类能更有效得环节迁移学习过程中遇到的问题,这是因为,不管是在源域还是目标域,物体之间存在相同的特性,因此,通过使用二分类器转移这些相同的特性信息。

图1 LSTD基本深度框架

- 正则化迁移学习LSTD

有了LSTD网络模型之后,就要考虑训练问题。文章引入基于小样本的端到端正则化迁移训练框架,训练流程如图2所示。

图2 LSTD正则化迁移训练

首先,我们在源域中,使用源域中大样本数据训练图1的LSTD模型。其次,将该模型在目标域中进行小样本训练数据微调,使用正则化公式。有一点必须有注意,因为源域和目标域的物体种类是相关但不是完全相同的,因此,在小样本目标检测中,K+1分类参数必须全部重新初始化,而边界回归和二分类则可以使用源域LSTD训练得到的值作为初始值。

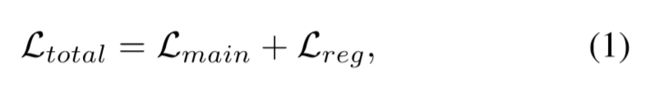

微调的整体损失可以被写为:

main loss 指的是LSTD中多层边界回归和两层分类的全部损失。仅仅使用main loss在微调中很可能会出现过拟合,为了进一步提升目标域中的小样本目标检测,添加正则项reg loss:

背景抑制正则化(background depression, BD)

在LSTD中,SSD风格的多尺度卷积层边界回归设计可以降低不同大小物体的训练难度,但是复杂的背景依旧会干扰小样本场景中的定位表现,因此提出背景抑制正则项。背景抑制正则项使用目标域中的物体知识,给定一张目标域中的训练图片,将其输入到卷积网络中,然后从某一中间卷积层取出,得到特征图。然后将将原图像中真实的边界框覆盖到特征图上,就能得到该特征图上的背景区域,记作FBD,然后求它的L2范式。

有了BD正则项,LSTD可以抑制背景区域的影响,同时更加关注于物体本身,这在小样本训练中是相当重要的。如图3展示了BD正则项的作用,可以减小背景的干扰。

图3 背景抑制(background depression, BD)正则化的效果

迁移知识正则化(Transfer Knowledge, TK)

LSTD中由粗糙到细致的分类设计可以缓解分类问题中的问题,因为在目标域中使用已经预训练过二分类器。但是K+1分类器却是重新随机生成的(原因是上面提到的源域和目标域中的类别差异),在这种情况下,单纯的用目标域中的数据进行微调并不能充分利用源域中的知识信息。由图4可知,目标域中的“牛”和源域中的“熊”、目标域中的“飞机”和源域中的“风筝”,都表现了强相关性。因此,文中提出了新型迁移知识正则化,使得源域神经网络中的物体标签预测信息可以作为源域知识来正则小样本目标域的训练。

(1)源域知识

将目标域的候选区输入到源域的RoI池化层,最终在源域的目标分类器中生成知识矩阵。

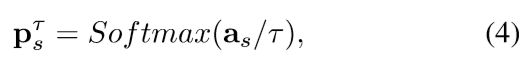

as是每个候选区softmax激活前的向量,t是温度参数(?)

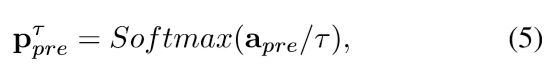

(2)目标域在源域分类上的预测

在目标域的尾部加上一个源目标分类器,对于每个目标候选框,分类器提出了源目标上的预测值

(3)TK正则化

对上述4,5的结果计算交叉熵,就得到了TK正则项

lstd算法

1. 在源域大规模数据集上进行预训练。在源域上用大规模数据集训练源域LSTD

2. 初始化目标域小样本模型。K+1分类层随机初始化参数,目标域LSTD的其他部分直接使用源域LSTD进行初始化

3. 在目标域小样本上进行微调。基于小样本,使用BD和TK正则项对目标域LSTD进行微调。

!! 原文禁止转载 !!