- 遗传算法(Genetic Algorithm,GA)-基于MATLAB环境实现

朱佩棋(代码版)

启发式算法启发式算法算法matlab

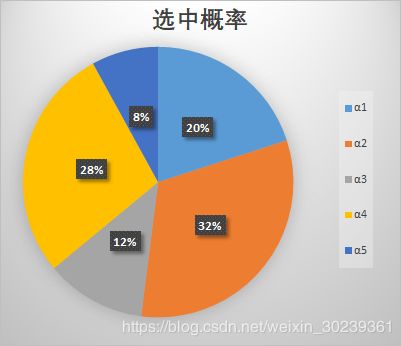

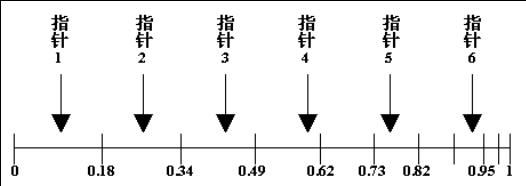

1.GA简介geneticalgorithm,美国Holland教授创立,基于达尔文进化论和孟德尔的遗传学说。遗传算法类比了生物界中自然选择、交叉、变异等自然进化方式,利用数码串类比染色体,通过选择、交叉、变异等遗传算子模拟生物的进化过程。1.1遗传算法的流程1.编码伪代码:2.产生初始群体Chooseinitialpopulation3.计算适应度Evaluatethefitnessofeach

- 备战2024数学建模国赛(模型三十):遗传算法 优秀案例(三) 变循环发动机部件法建模及优化

2024年数学建模国赛

备战2024数学建模国赛2024数学建模(不代写论文请勿盲目订阅)数学建模2024年数学建模国赛备战数学建模国赛算法遗传算法2024

专栏内容(赛前预售价99,比赛期间299):2024数学建模国赛期间会发布思路、代码和优秀论文。(本专栏达不到国一的水平,适用于有一点点基础冲击省奖的同学,近两年有二十几个国二,但是达不到国一,普遍获得省奖,请勿盲目订阅)python全套教程(一百篇博客):从新手到掌握使用python,可以对数学建模问题进行建模分析。35套模型算法(优秀论文示例):马尔科夫模型、遗传算法、逻辑回归、逐步回归、蚁群

- Matlab实现BP-NSGA-II多目标预测优化方法

含老司开挖掘机

本文还有配套的精品资源,点击获取简介:本文涉及将遗传算法优化的BP神经网络与NSGA-II相结合,应用于多目标预测问题的解决。主要内容包括BP神经网络的学习原理、适应度函数的设计与应用、NSGA-II在多目标优化中的作用、多目标预测的策略以及Matlab工具在算法实现中的使用。本文旨在通过这些技术,帮助读者构建出能在多个相互冲突的目标间取得平衡的优化解决方案,并提供完整的Matlab代码实现,以供

- 深度学习与遗传算法的碰撞——利用遗传算法优化深度学习网络结构(详解与实现)

2401_84003733

程序员深度学习人工智能

self.model.add(layers.Dense(10,activation=‘relu’))self.model.build(input_shape=(4,28*28))self.model.summary()self.model.compile(optimizer=optimizers.Adam(lr=0.01),loss=losses.CategoricalCrossentropy(f

- 备战2024数学建模国赛(模型十五):模糊综合评价 优秀案例(一)确定汽车装配顺序问题的算法

2024年数学建模国赛

备战2024数学建模国赛2024数学建模(持续更新耐心等待)数学建模汽车算法2024数学建模国赛备战2024数学建模国赛模糊综合评价模型

专栏内容(赛前预售价99,比赛期间299):2024数学建模国赛期间会发布思路、代码和优秀论文。(本专栏达不到国一的水平,适用于有一点点基础冲击省奖的同学,近两年有二十几个国二,但是达不到国一,普遍获得省奖,请勿盲目订阅)python全套教程(一百篇博客):从新手到掌握使用python,可以对数学建模问题进行建模分析。35套模型算法(优秀论文示例):马尔科夫模型、遗传算法、逻辑回归、逐步回归、蚁群

- 遗传算法,第三部分:繁殖

大龙10

书名:代码本色:用编程模拟自然系统作者:DanielShiffman译者:周晗彬ISBN:978-7-115-36947-5第9章目录9.6遗传算法,第三部分:繁殖1、繁殖现在我们已经有了选择父代的策略,下面就开始讨论繁殖下一代的方法,这一步的关键在于达尔文的遗传法则——子代能继承父代的特性。繁殖的实现方式也有很多种。无性繁殖就是一种合理(并容易实现)的策略,该策略用单个父本复制出子代个体。但遗传

- 备战2024数学建模国赛(模型十九):排队论 优秀案例(一)火车票购票网站优化

2024年数学建模国赛

备战2024数学建模国赛备战2024数学建模数学建模2024年数学建模国赛2024数学建模国赛马尔科夫模型排队论

专栏内容(赛前预售价99,比赛期间299):2024数学建模国赛期间会发布思路、代码和优秀论文。(本专栏达不到国一的水平,适用于有一点点基础冲击省奖的同学,近两年有二十几个国二,但是达不到国一,普遍获得省奖,请勿盲目订阅)python全套教程(一百篇博客):从新手到掌握使用python,可以对数学建模问题进行建模分析。35套模型算法(优秀论文示例):马尔科夫模型、遗传算法、逻辑回归、逐步回归、蚁群

- 备战2024数学建模国赛(模型二十五):微分方程 优秀案例(一)基于非稳态导热的高温作业专用服装设计

2024年数学建模国赛

备战2024数学建模国赛备战2024数学建模数学建模人工智能备战2024数学建模国赛深度学习数学建模国赛2024

专栏内容(赛前预售价99,比赛期间299):2024数学建模国赛期间会发布思路、代码和优秀论文。(本专栏达不到国一的水平,适用于有一点点基础冲击省奖的同学,近两年有二十几个国二,但是达不到国一,普遍获得省奖,请勿盲目订阅)python全套教程(一百篇博客):从新手到掌握使用python,可以对数学建模问题进行建模分析。35套模型算法(优秀论文示例):马尔科夫模型、遗传算法、逻辑回归、逐步回归、蚁群

- 备战2024数学建模国赛(模型四):动态规划优秀案例(一)基于蒙特卡洛模拟的眼科病床安排排队模型

2024年数学建模国赛

备战2024数学建模国赛备战2024数学建模数学建模动态规划算法20242024年数学建模国赛备战数学建模竞赛matlab

专栏内容(赛前预售价99,比赛期间299):2024数学建模国赛期间会发布思路、代码和优秀论文。(本专栏达不到国一的水平,适用于有一点点基础冲击省奖的同学,近两年有二十几个国二,但是达不到国一,普遍获得省奖,请勿盲目订阅)python全套教程(一百篇博客):从新手到掌握使用python,可以对数学建模问题进行建模分析。35套模型算法(优秀论文示例):马尔科夫模型、遗传算法、逻辑回归、逐步回归、蚁群

- 遥感之智能优化算法大纲介绍

遥感-GIS

遥感之智能优化算法图像处理arcgis启发式算法

介绍近年来在遥感及人工智能领域研究比较火热的智能优化算法,其中被广泛使用的比如粒子群算法和遗传算法等,在遥感领域,比如高光谱特征选择,机器学习超参数优化等方向有众多的应用,除了提到了两个算法之外,还有众多其他算法,本专栏基于《智能优化算法与涌现计算》及其相关资料,对智能优化算法做些详细的整理和总结,以期给遥感或其他领域提供有价值的参考。书籍大纲为:第一篇仿人智能优化算法描述模拟人脑思维、人体系统、

- 备战2024数学建模国赛(模型十八):拟合模型 优秀案例(二)高温作业服设计

2024年数学建模国赛

备战2024数学建模国赛备战2024数学建模数学建模2024年数学建模国赛数学建模国赛算法拟合模型

专栏内容(赛前预售价99,比赛期间299):2024数学建模国赛期间会发布思路、代码和优秀论文。(本专栏达不到国一的水平,适用于有一点点基础冲击省奖的同学,近两年有二十几个国二,但是达不到国一,普遍获得省奖,请勿盲目订阅)python全套教程(一百篇博客):从新手到掌握使用python,可以对数学建模问题进行建模分析。35套模型算法(优秀论文示例):马尔科夫模型、遗传算法、逻辑回归、逐步回归、蚁群

- 备战2024数学建模国赛(模型六):多元回归 优秀案例(一)颜色与物质浓度的辨识问题

2024年数学建模国赛

备战2024数学建模国赛备战2024数学建模数学建模多元回归2024数学建模国赛2024matlab备战数学建模国赛国赛思路代码

专栏内容(赛前预售价99,比赛期间299):2024数学建模国赛期间会发布思路、代码和优秀论文。(本专栏达不到国一的水平,适用于有一点点基础冲击省奖的同学,近两年有二十几个国二,但是达不到国一,普遍获得省奖,请勿盲目订阅)python全套教程(一百篇博客):从新手到掌握使用python,可以对数学建模问题进行建模分析。35套模型算法(优秀论文示例):马尔科夫模型、遗传算法、逻辑回归、逐步回归、蚁群

- 遗传算法:启发自真实现象

大龙10

书名:代码本色:用编程模拟自然系统作者:DanielShiffman译者:周晗彬ISBN:978-7-115-36947-5第9章目录9.1遗传算法:启发自真实现象1、目标我们的目标不是深入研究遗传和进化的科学原理,我们不会研究旁氏表、核苷酸、蛋白质合成、RNA和其他生物进化相关的话题。相反,我们只讨论达尔文进化论背后的核心原理,并根据这个原理开发出一套算法。我们并不在乎进化模拟是否精确,只关心进

- 手机信令数据分析&移动对象轨迹数据分析--论文摘要合集

doublexiao79

数据分析与挖掘数据分析数据挖掘智能手机

1、《基于电信位置数据的人群流量预测》卢光跃,李四维,赵宇翔,王天赐西安邮电大学学报摘要:将遗传算法和支持向量回归法结合起来,给出一种基于电信位置数据的人群流量预测方法。提取出电信位置数据中的人群流量时间序列,综合考虑其不同时间点值的关联性,用支持向量回归方法对其进行预测,并使用遗传算法对支持向量回归方法的参数进行优化。综合考虑人群流量变化的横向和纵向趋势,同时考虑使用遗传算法对SVR算法的参数进

- MATLAB智能优化算法-学习笔记(1)——遗传算法求解0-1背包问题【过程+代码】

郭十六弟

算法matlab学习智能优化算法算法思想遗传算法求解0-1背包问题

一、问题描述(1)数学模型(2)模型总结目标函数:最大化背包中的总价值Z。约束条件:确保背包中的物品总重量不超过容量W。决策变量:每个物品是否放入背包,用0或1表示。这个数学模型是一个典型的0-1整数线性规划问题。由于其NP完全性,当问题规模较大时,求解此问题通常需要使用启发式算法(如遗传算法、动态规划、分支定界法等)来找到近似最优解。(3)实例讲解:0-1背包问题模型手动求解过程在0-1背包问题

- 【LSTM回归预测】遗传算法优化注意力机制的长短时记忆神经网络GA-attention-LSTM数据回归预测【含Matlab源码 3738期】

Matlab领域

matlab

⛄一、遗传算法优化注意力机制的长短时记忆神经网络GA-attention-LSTM数据回归预测风力发电是一种清洁能源,越来越受到人们的关注和重视。然而,由于风力发电的不稳定性和不可控性,风电预测成为了一个至关重要的问题。为了更精准地预测风电发电量,许多研究者开始尝试利用深度学习技术来进行风电预测。在本文中,我们将介绍一种基于遗传优化注意力机制的长短时记忆神经网络(GA-attention-LSTM

- 遗传算法(Genetic Algorithm, GA)附代码案例

Cooku Black

机器学习python高级用法遗传算法启发式算法python

遗传算法(GeneticAlgorithm,GA)简介遗传算法(GeneticAlgorithm,GA)是一种模拟自然选择和遗传学原理的搜索算法,属于进化计算的一种。它是由约翰·霍兰德(JohnHolland)在20世纪70年代提出的,用于解决优化问题,是一种启发式算法。遗传算法的基本思想是通过模拟生物进化过程中的遗传和变异机制来优化问题的解。算法流程初始化:随机生成一组染色体(解的编码),构成初

- 智能优化算法——遗传算法(Python&Matlab实现)[2]

2401_84009974

程序员python算法matlab

初始化种群initPopulation(POP,N)进化过程==foritinrange(iter_N):#遍历每一代a,b=selection(N)#随机选择两个个体ifnp.random.random()<0.65:#以0.65的概率进行交叉结合child1,child2=crossover(POP[a],POP[b])new=sorted([POP[a],POP[b],child1,chil

- 遗传算法与深度学习实战(1)——进化深度学习

盼小辉丶

遗传算法与深度学习实战深度学习人工智能遗传算法

遗传算法与深度学习实战(1)——进化深度学习0.前言1.进化深度学习1.1进化深度学习简介1.2进化计算简介2.进化深度学习应用场景3.深度学习优化3.1优化网络体系结构4.通过自动机器学习进行优化4.1自动机器学习简介4.2AutoML工具5.进化深度学习应用5.1模型选择:权重搜索5.2模型架构:架构优化5.3超参数调整/优化5.4验证和损失函数优化5.5增强拓扑的神经进化小结系列链接0.前言

- 遗传算法与深度学习实战(6)——DEAP框架初体验

盼小辉丶

遗传算法与深度学习实战深度学习DEAP遗传算法

遗传算法与深度学习实战(6)——DEAP框架初体验0.前言1.OneMax问题介绍2.遗传算法要素定义3.使用DEAP解决OneMax问题3.1遗传算法要素配置3.2遗传算法解的进化3.3运行结果3.4eaSimple函数小结系列链接0.前言我们已经了解了DEAP库中的重要数据结构和工具,为了快速掌握DEAP,本节中,我们将介绍DEAP框架下的遗传算法构建流程,并使用DEAP解决简单的OneMax

- 遗传算法与深度学习实战(7)——使用遗传算法解决N皇后问题

盼小辉丶

遗传算法与深度学习实战深度学习DEAP遗传算法

遗传算法与深度学习实战(7)——使用遗传算法解决N皇后问题0.前言1.N皇后问题2.解的表示3.遗传算法解决N皇后问题小结系列链接0.前言进化算法(EvolutionaryAlgorithm,EA)和遗传算法(GeneticAlgorithms,GA)已成功解决了许多复杂的设计和布局问题,部分原因是它们采用了受控随机元素的搜索。这通常使得使用EA或GA设计的系统能够超越我们的理解进行创新。在本节中

- MATLAB|【免费】概率神经网络的分类预测--基于PNN的变压器故障诊断

电力程序小学童

机器预测matlab神经网络分类预测

目录主要内容部分代码结果一览下载链接主要内容《MATLAB神经网络43个案例分析》共有43章,内容涵盖常见的神经网络(BP、RBF、SOM、Hopfield、Elman、LVQ、Kohonen、GRNN、NARX等)以及相关智能算法(SVM、决策树、随机森林、极限学习机等)。同时,部分章节也涉及了常见的优化算法(遗传算法、蚁群算法等)与神经网络的结合问题。此外,《MATLAB神经网络43个案例分析

- 达尔文的自然选择

大龙10

书名:代码本色:用编程模拟自然系统作者:DanielShiffman译者:周晗彬ISBN:978-7-115-36947-5第9章目录9.3达尔文的自然选择 在研究遗传算法之前,我们要先学习达尔文进化学说中的3个基本法则。如果要正确地模拟自然选择,我们必须同时实现这3个要素。1、遗传子代必须以某种方式继承父代的特性。如果生物存活的时间足够长,繁殖的概率也足够大,那么它们的特征将会传递给下一代。2

- GA-kmedoid 遗传算法优化K-medoids聚类

2301_78492934

机器学习支持向量机人工智能matlab聚类

遗传算法优化K-medoids聚类是一种结合了遗传算法和K-medoids聚类算法的优化方法。遗传算法是一种基于自然选择和遗传机制的随机优化算法,它通过模拟生物进化过程中的遗传、交叉、变异等操作来寻找问题的最优解。而K-medoids聚类算法是一种基于划分的聚类方法,它通过选择K个数据点作为簇中心,将数据点分配到最近的簇中心,以最小化每个数据点到其所属簇中心的距离之和。K-medoids聚类算法是

- MATLAB遗传算法求解车间调度问题——模型建立和实例设计(画甘特图)

麦哥MATLAB

matlab甘特图

1.基本概念车间调度是指根据产品制造的合理需求分配加工车间顺序,从而达到合理利用产品制造资源、提高企业经济效益的目的。车间调度问题从数学上可以描述为有n个待加工的零件要在m台机器上加工。问题需要满足的条件包括每个零件的各道工序使用每台机器不多于1次,每个零件都按照一定的顺序进行加工。车间调度问题实例:现共有6个工件,在10台机器上加工,每个工件都要经过6道加工工序,每个工序可选择机器序号如表一所列

- 遗传算法解释

大吉大利都吃鸡

算法python开发语言人工智能

遗传算法是一种基于自然遗传和进化规律的人工智能算法。它通过模拟生物进化的过程,来解决各种复杂问题。遗传算法的基本流程如下:初始化:随机生成一些解作为初始种群;评估:评估每个解的适应度,根据适应度的高低决定哪些解具有更好的进化前景;交叉:选择适应度较高的两个解,并将它们的特征结合到一起形成一个新的解;变异:对新的解进行随机的突变,以增加它的多样性;替代:在每一代的结束,用新的解替换适应度较低的解。这

- Evolutionary algorithm (遗传算法)介绍

Longlongaaago

机器学习算法数据挖掘人工智能

Evolutionaryalgorithm(遗传算法)介绍Evolutionaryalgorithm遗传算法,实际上也是机器学习里面一个很重要的分支。为什么呢,因为他在之前几十年也是和深度学习一样非常火热流行。现在也有很多人在利用遗传算法做相关研究,还是比较流行的算法之一。Evolutionaryalgorithm算法是受到自然界的一些启发,通过种群优化去解决一些相关的任务,比如做数独,解决一些实

- 使用遗传算法求解一个简单的极值问题,最小化一个具有多个变量的目标函数。

依然风yrlf

算法matlab

下面是一个更详细的MATLAB示例,演示如何使用遗传算法求解一个简单的极值问题。在这个例子中,我们将尝试最小化一个具有多个变量的目标函数。%定义目标函数fitnessFunction=@(x)sum(x.^2);%Rosenbrock函数%定义遗传算法参数options=optimoptions('ga',...'MaxGenerations',100,...%最大迭代次数'PopulationS

- 遗传算法实现

qq_51497433

matlab开发语言算法

遗传算法(GeneticAlgorithm,GA)是一种模拟自然选择和遗传学原理的搜索启发式算法,它是由约翰·霍兰德(JohnHolland)在20世纪70年代提出的。遗传算法在解决优化和搜索问题时非常有效,特别是在解空间大且复杂时。该算法使用了生物进化中的选择、交叉(杂交)和变异等概念。遗传算法通常包括以下步骤:初始化:随机生成一个初始种群。种群由一定数量的个体组成,每个个体代表一个解。评估:计

- 【MATLAB】GA_BP神经网络回归预测算法

Lwcah

MATLAB回归预测算法算法matlab神经网络

有意向获取代码,请转文末观看代码获取方式~也可转原文链接获取~1基本定义GA_BP神经网络回归预测算法结合了遗传算法(GeneticAlgorithm,GA)和BP神经网络(BackpropagationNeuralNetwork,BPNN),用于解决回归预测问题。下面将详细介绍该算法的原理:BP神经网络回归模型:BP神经网络是一种前向人工神经网络,具有输入层、隐藏层和输出层。每个神经元都与下一层

- ASM系列六 利用TreeApi 添加和移除类成员

lijingyao8206

jvm动态代理ASM字节码技术TreeAPI

同生成的做法一样,添加和移除类成员只要去修改fields和methods中的元素即可。这里我们拿一个简单的类做例子,下面这个Task类,我们来移除isNeedRemove方法,并且添加一个int 类型的addedField属性。

package asm.core;

/**

* Created by yunshen.ljy on 2015/6/

- Springmvc-权限设计

bee1314

springWebjsp

万丈高楼平地起。

权限管理对于管理系统而言已经是标配中的标配了吧,对于我等俗人更是不能免俗。同时就目前的项目状况而言,我们还不需要那么高大上的开源的解决方案,如Spring Security,Shiro。小伙伴一致决定我们还是从基本的功能迭代起来吧。

目标:

1.实现权限的管理(CRUD)

2.实现部门管理 (CRUD)

3.实现人员的管理 (CRUD)

4.实现部门和权限

- 算法竞赛入门经典(第二版)第2章习题

CrazyMizzz

c算法

2.4.1 输出技巧

#include <stdio.h>

int

main()

{

int i, n;

scanf("%d", &n);

for (i = 1; i <= n; i++)

printf("%d\n", i);

return 0;

}

习题2-2 水仙花数(daffodil

- struts2中jsp自动跳转到Action

麦田的设计者

jspwebxmlstruts2自动跳转

1、在struts2的开发中,经常需要用户点击网页后就直接跳转到一个Action,执行Action里面的方法,利用mvc分层思想执行相应操作在界面上得到动态数据。毕竟用户不可能在地址栏里输入一个Action(不是专业人士)

2、<jsp:forward page="xxx.action" /> ,这个标签可以实现跳转,page的路径是相对地址,不同与jsp和j

- php 操作webservice实例

IT独行者

PHPwebservice

首先大家要简单了解了何谓webservice,接下来就做两个非常简单的例子,webservice还是逃不开server端与client端。我测试的环境为:apache2.2.11 php5.2.10做这个测试之前,要确认你的php配置文件中已经将soap扩展打开,即extension=php_soap.dll;

OK 现在我们来体验webservice

//server端 serve

- Windows下使用Vagrant安装linux系统

_wy_

windowsvagrant

准备工作:

下载安装 VirtualBox :https://www.virtualbox.org/

下载安装 Vagrant :http://www.vagrantup.com/

下载需要使用的 box :

官方提供的范例:http://files.vagrantup.com/precise32.box

还可以在 http://www.vagrantbox.es/

- 更改linux的文件拥有者及用户组(chown和chgrp)

无量

clinuxchgrpchown

本文(转)

http://blog.163.com/yanenshun@126/blog/static/128388169201203011157308/

http://ydlmlh.iteye.com/blog/1435157

一、基本使用:

使用chown命令可以修改文件或目录所属的用户:

命令

- linux下抓包工具

矮蛋蛋

linux

原文地址:

http://blog.chinaunix.net/uid-23670869-id-2610683.html

tcpdump -nn -vv -X udp port 8888

上面命令是抓取udp包、端口为8888

netstat -tln 命令是用来查看linux的端口使用情况

13 . 列出所有的网络连接

lsof -i

14. 列出所有tcp 网络连接信息

l

- 我觉得mybatis是垃圾!:“每一个用mybatis的男纸,你伤不起”

alafqq

mybatis

最近看了

每一个用mybatis的男纸,你伤不起

原文地址 :http://www.iteye.com/topic/1073938

发表一下个人看法。欢迎大神拍砖;

个人一直使用的是Ibatis框架,公司对其进行过小小的改良;

最近换了公司,要使用新的框架。听说mybatis不错;就对其进行了部分的研究;

发现多了一个mapper层;个人感觉就是个dao;

- 解决java数据交换之谜

百合不是茶

数据交换

交换两个数字的方法有以下三种 ,其中第一种最常用

/*

输出最小的一个数

*/

public class jiaohuan1 {

public static void main(String[] args) {

int a =4;

int b = 3;

if(a<b){

// 第一种交换方式

int tmep =

- 渐变显示

bijian1013

JavaScript

<style type="text/css">

#wxf {

FILTER: progid:DXImageTransform.Microsoft.Gradient(GradientType=0, StartColorStr=#ffffff, EndColorStr=#97FF98);

height: 25px;

}

</style>

- 探索JUnit4扩展:断言语法assertThat

bijian1013

java单元测试assertThat

一.概述

JUnit 设计的目的就是有效地抓住编程人员写代码的意图,然后快速检查他们的代码是否与他们的意图相匹配。 JUnit 发展至今,版本不停的翻新,但是所有版本都一致致力于解决一个问题,那就是如何发现编程人员的代码意图,并且如何使得编程人员更加容易地表达他们的代码意图。JUnit 4.4 也是为了如何能够

- 【Gson三】Gson解析{"data":{"IM":["MSN","QQ","Gtalk"]}}

bit1129

gson

如何把如下简单的JSON字符串反序列化为Java的POJO对象?

{"data":{"IM":["MSN","QQ","Gtalk"]}}

下面的POJO类Model无法完成正确的解析:

import com.google.gson.Gson;

- 【Kafka九】Kafka High Level API vs. Low Level API

bit1129

kafka

1. Kafka提供了两种Consumer API

High Level Consumer API

Low Level Consumer API(Kafka诡异的称之为Simple Consumer API,实际上非常复杂)

在选用哪种Consumer API时,首先要弄清楚这两种API的工作原理,能做什么不能做什么,能做的话怎么做的以及用的时候,有哪些可能的问题

- 在nginx中集成lua脚本:添加自定义Http头,封IP等

ronin47

nginx lua

Lua是一个可以嵌入到Nginx配置文件中的动态脚本语言,从而可以在Nginx请求处理的任何阶段执行各种Lua代码。刚开始我们只是用Lua 把请求路由到后端服务器,但是它对我们架构的作用超出了我们的预期。下面就讲讲我们所做的工作。 强制搜索引擎只索引mixlr.com

Google把子域名当作完全独立的网站,我们不希望爬虫抓取子域名的页面,降低我们的Page rank。

location /{

- java-归并排序

bylijinnan

java

import java.util.Arrays;

public class MergeSort {

public static void main(String[] args) {

int[] a={20,1,3,8,5,9,4,25};

mergeSort(a,0,a.length-1);

System.out.println(Arrays.to

- Netty源码学习-CompositeChannelBuffer

bylijinnan

javanetty

CompositeChannelBuffer体现了Netty的“Transparent Zero Copy”

查看API(

http://docs.jboss.org/netty/3.2/api/org/jboss/netty/buffer/package-summary.html#package_description)

可以看到,所谓“Transparent Zero Copy”是通

- Android中给Activity添加返回键

hotsunshine

Activity

// this need android:minSdkVersion="11"

getActionBar().setDisplayHomeAsUpEnabled(true);

@Override

public boolean onOptionsItemSelected(MenuItem item) {

- 静态页面传参

ctrain

静态

$(document).ready(function () {

var request = {

QueryString :

function (val) {

var uri = window.location.search;

var re = new RegExp("" + val + "=([^&?]*)", &

- Windows中查找某个目录下的所有文件中包含某个字符串的命令

daizj

windows查找某个目录下的所有文件包含某个字符串

findstr可以完成这个工作。

[html]

view plain

copy

>findstr /s /i "string" *.*

上面的命令表示,当前目录以及当前目录的所有子目录下的所有文件中查找"string&qu

- 改善程序代码质量的一些技巧

dcj3sjt126com

编程PHP重构

有很多理由都能说明为什么我们应该写出清晰、可读性好的程序。最重要的一点,程序你只写一次,但以后会无数次的阅读。当你第二天回头来看你的代码 时,你就要开始阅读它了。当你把代码拿给其他人看时,他必须阅读你的代码。因此,在编写时多花一点时间,你会在阅读它时节省大量的时间。让我们看一些基本的编程技巧: 尽量保持方法简短 尽管很多人都遵

- SharedPreferences对数据的存储

dcj3sjt126com

SharedPreferences简介: &nbs

- linux复习笔记之bash shell (2) bash基础

eksliang

bashbash shell

转载请出自出处:

http://eksliang.iteye.com/blog/2104329

1.影响显示结果的语系变量(locale)

1.1locale这个命令就是查看当前系统支持多少种语系,命令使用如下:

[root@localhost shell]# locale

LANG=en_US.UTF-8

LC_CTYPE="en_US.UTF-8"

- Android零碎知识总结

gqdy365

android

1、CopyOnWriteArrayList add(E) 和remove(int index)都是对新的数组进行修改和新增。所以在多线程操作时不会出现java.util.ConcurrentModificationException错误。

所以最后得出结论:CopyOnWriteArrayList适合使用在读操作远远大于写操作的场景里,比如缓存。发生修改时候做copy,新老版本分离,保证读的高

- HoverTree.Model.ArticleSelect类的作用

hvt

Web.netC#hovertreeasp.net

ArticleSelect类在命名空间HoverTree.Model中可以认为是文章查询条件类,用于存放查询文章时的条件,例如HvtId就是文章的id。HvtIsShow就是文章的显示属性,当为-1是,该条件不产生作用,当为0时,查询不公开显示的文章,当为1时查询公开显示的文章。HvtIsHome则为是否在首页显示。HoverTree系统源码完全开放,开发环境为Visual Studio 2013

- PHP 判断是否使用代理 PHP Proxy Detector

天梯梦

proxy

1. php 类

I found this class looking for something else actually but I remembered I needed some while ago something similar and I never found one. I'm sure it will help a lot of developers who try to

- apache的math库中的回归——regression(翻译)

lvdccyb

Mathapache

这个Math库,虽然不向weka那样专业的ML库,但是用户友好,易用。

多元线性回归,协方差和相关性(皮尔逊和斯皮尔曼),分布测试(假设检验,t,卡方,G),统计。

数学库中还包含,Cholesky,LU,SVD,QR,特征根分解,真不错。

基本覆盖了:线代,统计,矩阵,

最优化理论

曲线拟合

常微分方程

遗传算法(GA),

还有3维的运算。。。

- 基础数据结构和算法十三:Undirected Graphs (2)

sunwinner

Algorithm

Design pattern for graph processing.

Since we consider a large number of graph-processing algorithms, our initial design goal is to decouple our implementations from the graph representation

- 云计算平台最重要的五项技术

sumapp

云计算云平台智城云

云计算平台最重要的五项技术

1、云服务器

云服务器提供简单高效,处理能力可弹性伸缩的计算服务,支持国内领先的云计算技术和大规模分布存储技术,使您的系统更稳定、数据更安全、传输更快速、部署更灵活。

特性

机型丰富

通过高性能服务器虚拟化为云服务器,提供丰富配置类型虚拟机,极大简化数据存储、数据库搭建、web服务器搭建等工作;

仅需要几分钟,根据CP

- 《京东技术解密》有奖试读获奖名单公布

ITeye管理员

活动

ITeye携手博文视点举办的12月技术图书有奖试读活动已圆满结束,非常感谢广大用户对本次活动的关注与参与。

12月试读活动回顾:

http://webmaster.iteye.com/blog/2164754

本次技术图书试读活动获奖名单及相应作品如下:

一等奖(两名)

Microhardest:http://microhardest.ite