目标检测/视频跟踪数据集指标分析

OTB

跟踪过程

首先,对于一种视频跟踪方法,有两种跟踪过程的选择:

[No Restart]

例如OPE全称为One-Pass Evaluation,或者SRE。只给定第一帧的目标区域,运行跟踪算法期间,不会进行第二次初始化,直至视频跟踪结束。

[With Restart]

例如OPER全称为One-Pass Evaluation with Restart,或者SRER。在给定第一帧的目标区域后,算法开始跟踪物体,当网络输出的bounding box与groundtruth的交并比(IoU,如下图所示)为0时,认定跟踪失败,这时会重新进行初始化,给定跟踪失败帧的groundtruth,让网络重新跟踪,之后如果再次出现这种情况,以同样的方式解决。

精准度指标

[ARE]

全称为Average Pixel Error。计算每一帧groundtruth的中心点与算法输出bounding box的中心点的欧氏距离作为每一帧的中心点误差,之后对所有帧的中心点误差取平均值得到ARE。

[AOR]

全称为Average Overlap Rate。计算每一帧groundtruth和算法输出bounding box的IoU,然后对所有帧取平均值作为AOR。例如下图所示,A为算法预测的bounding box,B为groundtruth,则: I o U = A ∩ B A ∪ B IoU=\frac{A \cap B}{A \cup B} IoU=A∪BA∩B

鲁棒性指标

[TRE]

全称为Temporal Robustness Evaluation,评价时间鲁棒性。第一次,将第一帧作为初始帧,送入跟踪算法直至视频结束,计算精准度指标。之后将第十帧作为初始帧,送入跟踪算法直至视频结束,计算精准度指标。之后,第二十帧作为初始帧,第三十帧作为初始帧…。所有的跟踪完成后,计算所有精准度的平均值,得到TRE。

[SRE]

全称为Spatial Robustness Evaluation,评价空间鲁棒性。将初始帧的groundtruth做变化,例如,向多个方向(好像是8个方向)平移物体的10%,或者是按中心点缩小或扩大到物体的80%,90%,110%,120%。这样会计算得到12个视频跟踪精准度指标结果,计算所有的平均值,得到SRE。

可视化曲线

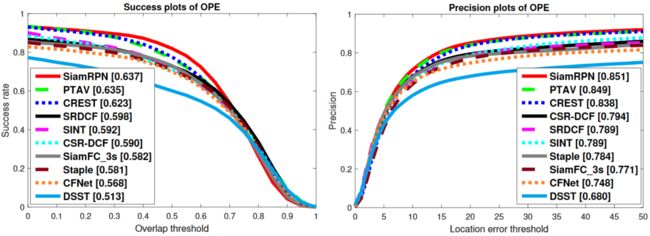

[Precision Plot]

算法输出bounding box的中心点与groundtruth的中心点小于规定阈值的帧数占总帧数的百分比,当规定阈值从0到某个最大距离时,画出的曲线为Precision Plot。如下图右边所示,其特点就是曲线会随着规定阈值的增大不断上升。

[Success Plot]

算法输出bounding box与groundtruth的IoU大于规定阈值的帧数占总帧数的百分比,当规定阈值从0到1时,画出的曲线为Success Plot。如下图左边所示,其特点就是曲线会随着规定阈值的增大不断下降。

VOT

精准度指标

[Center Error]

与OTB的ARE相同,缺点是无法评估框的尺度。

[Region Overlap]

与OTB的AOR相同。

[Accuracy]

首先,跟踪算法会对一个视频循环跟踪多次,计算所有帧IoU的平均值,如果跟踪算法在某些帧上未生成bounding box,则这些帧不会记录在内。求多次跟踪所有帧的IoU平均值,得到Accuracy。所以,Accuracy越大,精准度越高。

[EAO]

全称Expected Average Overlap。与Accuracy多次运行跟踪算法不同,这里EAO只会运行一次

鲁棒性指标

[Tracking Length]

在跟踪的过程中,当Center Error下降到一个阈值时结束,所跟踪的帧数。

[Robustness]

同样的,跟踪算法会在视频上跟踪多次,记录跟踪失败的次数,即bounding box与grountruth的IoU为0时,之后会在5帧之后,重新对跟踪算法进行初始化。Robustness就等于总的失败次数与所有帧数的比值。所以Robustness越大,鲁棒性就越差。

速度指标

[EFO]

全称Equivalent Filter Operations。为了减小不同网络的编程语言和硬件配置对跟踪速度的影响,事先在600×600的图像上进行30×30的滤波运算,这个时间定义为一个单位,然后运行跟踪算法,用这个单位来表示,得到EFO。

可视化曲线

[AR Plot]

AR就是Accuracy、Robustness的合称。AR Plot的横坐标是鲁棒性指标,纵坐标是Accuracy。在求出跟踪算法的Accuracy、Robustness后,计算: R S = e − S × R o b u s t n e s s R_{S}=e^{-S×Robustness} RS=e−S×Robustness这样就是横坐标的值。其中, S S S是人为给定的值,在每个曲线都会标注,如下图所示。

万能指标

精准度指标

[AUC]

bounding box与groundtruth之间计算IoU,当大于某个阈值时,认定跟踪成功。如果阈值从0到1不断变化,就能画出每个阈值下跟踪成功率,计算曲线的与x,y轴的面积,得到AUC。

速度指标

[FPS]

每秒跟踪算法能够跟踪多少帧。

传送门

[视频跟踪]

[视频跟踪数据集指标分析]

[SiamFC:利用全卷积孪生网络进行视频跟踪]

[SiamRPN:利用区域建议孪生网络进行视频跟踪]

[DaSiamRPN:用于视觉跟踪的干扰意识的孪生网络]

[SiamRPN++: 基于深度网络的孪生视觉跟踪的进化]

[SiamMask: 快速在线目标跟踪与分割的统一方法]