MV-YOLO: Motion Vector-aided Tracking by Semantic Object Detection论文解读

论文题目:MV-YOLO: Motion Vector-aided Tracking by Semantic Object Detection

论文发布时间:CVPR 2018.6

论文下载地址:https://arxiv.org/abs/1805.00107

摘要——目标跟踪是许多视觉分析系统的基石。虽然最近几年在该领域已经取得了相当大进展,但要想实现现实视频中目标的鲁棒,高效和高精度的跟踪仍是个挑战。本文我们提出了一种混合跟踪器,它利用了压缩视频流中的运动信息以及一种通用语义分割目标检测器,将该混合跟踪器作用于解码得到的帧图像中来构建快速和高效的跟踪引擎。本文提出的方法与近些年在OTB跟踪数据集上的跟踪器做过对比,结果表明本文方法在速度和精度上有优势。该方法的其他可取的特性是它的简单性和部署效率,这是因为它重用了因其他原因存在于系统中的资源和信息。

索引——目标跟踪,语义分割,运动矢量,感兴趣区域

I. INTRODUCTION

现有跟踪方法可通过多种方式进行分类。对于本研究而言,根据输入数据域来划分是有用的:像素域,压缩域,以及两者混合。像素域的跟踪器是当下研究较广和较好的。许多成功的跟踪方法是基于像素域的,例如基于相关滤波correlation filters的(例如:[1] M. Danelljan, G. Hger, F. S. Khan, and M. Felsberg, “Discriminative scale space tracking,” IEEE Trans. Pattern Anal. Mach. Intell., vol. 39, no. 8, pp. 1561–1575, Aug 2017),基于学习的深度特征(例如:[2] S. Hong, T. You, S. Kwak, and B. Han, “Online tracking by learning discriminative saliency map with convolutional neural network,” in Proc.ICML’15, 2015, pp. 597–606.;[3] D. Gordon, A. Farhadi, and D. Fox, “Re3: Real-time recurrent regression networks for visual tracking of generic objects,” IEEE Robotics and Automation Letters, vol. 3, no. 2, pp. 788–795, April 2018.)这类方法的优势是它们具有高精确度的潜力且它们视频编解码时实现方式未知。

第二类跟踪器作用于压缩域数据,只对视频流进行部分解码。在很多应用领域证明压缩域的数据携带有价值的信息,例如人脸检测(例如:[4] S. R. Alvar, H. Choi, and I. V. Bajic, “Can you tell a face from a HEVC ´bitstream?,” in Proc. IEEE MIPR’18, Apr. 2018.)和定位(例如:[5] S. R. Alvar, H. Choi, and I. V. Bajic, “Can you find a face in a HEVC ´bitstream?,” in Proc. IEEE ICASSP’18, Apr. 2018.),运动分割(例如:[6] Y. M. Chen, I. V. Bajic, and P. Saeedi, “Moving region segmentation from compressed video using global motion estimation and Markov random fields,” IEEE Trans. Multimedia, vol. 13, pp. 421–431, 2011.

),以及目标分割和跟踪(例如:[7] S. H. Khatoonabadi and I. V. Bajic, “Video object tracking in the compressed domain using spatio-temporal Markov random fields,” IEEE Trans. Image Processing, vol. 22, no. 1, pp. 300–313, Jan. 2013. [8] L. Zhao, Z. He, W. Cao, and D. Zhao, “Real-time moving object segmentation and classification from HEVC compressed surveillance video,” IEEE Trans. Circuits Syst. Video Technol., 2018, to appear)。文章([6] Y. M. Chen, I. V. Bajic, and P. Saeedi, “Moving region segmentation from compressed video using global motion estimation and Markov random fields,” IEEE Trans. Multimedia, vol. 13, pp. 421–431, 2011. [7] S. H. Khatoonabadi and I. V. Bajic, “Video object tracking in the compressed domain using spatio-temporal Markov random fields,” IEEE Trans. Image Processing, vol. 22, no. 1, pp. 300–313, Jan. 2013. [8] L. Zhao, Z. He, W. Cao, and D. Zhao, “Real-time moving object segmentation and classification from HEVC compressed surveillance video,” IEEE Trans. Circuits Syst. Video Technol., 2018, to appear.)研究得出的关键信息是:运动矢量(MVs)和相关编码语法元素是场景中目标运动很好的指示器。 由于这些信息在视频流中已经存在,因此利用这些信息来做跟踪显得很自然。压缩域跟踪器的优点包括效率和速度,因为该方法避开了大多数的视频解码,像素值存储和处理,并且通常对较少的输入数据做处理。但该方法的缺点是依赖于视频编码方法(该编码方法用于压缩视频),以及潜在的低的精度,受限于低精度的运动采样网格:通常,一个MV(运动矢量)分配在一个大小为4x4或更大的块/单元中。

第三类跟踪器属于混合类方法,结合了压缩域和像素域数据。这种方法的一个例子是([9] S. Gl, J. T. Meyer, C. Hellge, T. Schierl, and W. Samek, “Hybrid video object tracking in H.265/HEVC video streams,” in Proc. IEEE MMSP’16, Sept 2016, pp. 1–5. ),它通过结合从高效视频编码(HEVC)位流中提取的MVs(运动矢量)和boloc coding modes(块编码模式)混合作为跟踪器,并从内部帧中获取的颜色信息。

本文提出的也属于混合类方法,将解码的MVs与在完全解码的帧上做语义目标检测操作相结合。基本想法是,MVs已经存在于压缩视频流中,它足够好来指示目标对象的近似位置。语义目标检测器通过在解码的帧上提供像素精度的边界框来改进目标的位置。这种two-stage跟踪(先近似后改进精度)思路已经在最近的两项研究中提出过,分别是并行跟踪与验证(PTAV)和ROLO([10] H. Fan and H. Ling, “Parallel tracking and verifying: A framework for real-time and high accuracy visual tracking,” in Proc. IEEE ICCV’17, Oct 2017, pp. 5487–5495. [11] G. Ning, Z. Zhang, C. Huang, X. Ren, H. Wang, C. Cai, and Z. He, “Spatially supervised recurrent convolutional neural networks for visual object tracking,” in Proc. ISCAS’17, May 2017, pp. 1–4. ),但是这两项工作都是基于像素域的跟踪器,而我们的是首个混合类的方法。其中PTAV第一阶段用快速但精度较小的像素域跟踪器,第二阶段用基于VGGNet的Sizmese network(孪生网络); 其中ROLO的第一阶段的近似是用YOLO目标检测器,而第二阶段的修正是用LSTM网络。([12] K. Simonyan and A. Zisserman, “Very deep convolutional networks for large-scale image recognition,” arXiv preprint arXiv:1409.1556, 2014. [13] J. Redmon, S. Divvala, R. Girshick, and A. Farhadi, “You only look once: Unified, real-time object detection,” in Proc. IEEE CVPR’16, Jun. 2016, pp. 779–788. )

II. PROPOSED METHOD

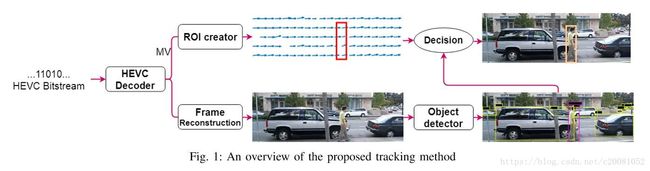

本文提出的跟踪框架见Fig.1.我们称其为MV-aided YOLO(运动矢量辅助的YOLO),简称为MV-YOLO。初始,目标近似位置是基于当前帧间编码帧上的MVs和之前帧上目标位置而构造的。(个人解读初始的操作就是将前一帧获得的目标位置和当前帧上的目标会形成运动矢量,类似光流)。将初始构造的近似位置作为ROI区域(图一上红框)。同时,解码的当前帧也会通过一个语义目标检测器(文中用的是YOLO),该检测器会检测帧中多种目标的位置。ROI会作为多种目标位置中选取目标对象的参考位置。

A. ROI creation

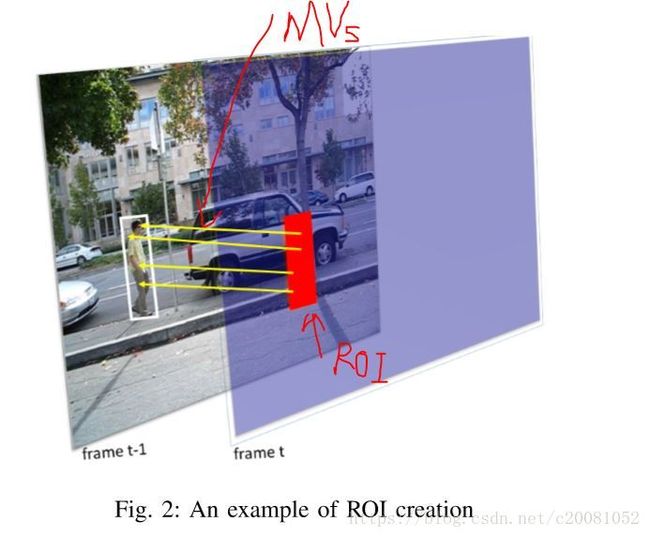

基于给定前一帧t-1上目标位置,ROI 构造器会利用HEVC位流产生的MVs来构造当前帧t上目标的近似位置。这个过程相对较简单。在帧解码期间,从HEVC位流中读取帧t上的MVs。与MV相关联的PU一同分配给所有像素。然后,若MV指代为帧t-1上目标位置的话,将其所在的像素标记为ROI-像素。最后,选取包含所有ROI-像素的矩形框作为ROI,这个框需要与x,y轴平行(就是说没有倾斜的)。这一过程可见Fig.2.,其中帧t上的ROI用红色显示,帧t到帧t-1上产生的MVs以黄色显示。

虽然ROI构造的基本思路非常直观,但是这过程中一些技术难点仍需解决。技术难点包括没有MVs的PUs(例如SKIP和intra-coded PUs),MVs不指向t-1帧,以及部分精确的MVs。这些挑战中,SKIP PUs最易解决。由于跳帧模式(SKIP mode)表明相应的PU几乎与之前帧中对应公共定位区域几乎完全相同,因此将零运动矢量(zero MV)分配给每个SKIP PU。

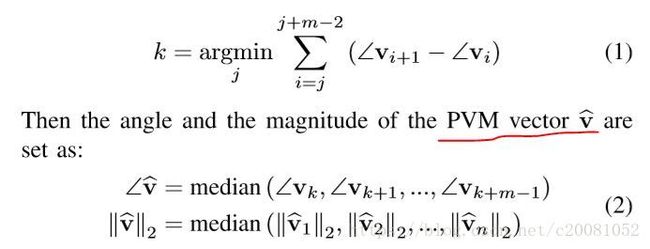

将有意义的运动分配到内部编码PUs中相对有些复杂,因为编码器选择的内部模式表明潜在的运动太过复杂而无法被传统的运动补偿所利用。对于这样的PUs,我们在同个Coding Tree Unit(CTU)中收集所有相邻近内部编码PUs的MVs,然后用Polar Vector Median(PVM)(我理解为极向量媒介)来为这样的PUs提供合适的MV。特别地,令 ![]() 为PUs邻近的MVs列表,按照矢量与水平轴夹角大小来排序。然后,选取一个来自V的连续向量子列表

为PUs邻近的MVs列表,按照矢量与水平轴夹角大小来排序。然后,选取一个来自V的连续向量子列表 ![]() 来最小化向量角度差只和。选取的组为

来最小化向量角度差只和。选取的组为![]()

![]() ,其中的k为:

,其中的k为:

PVM向量的角度和幅值设置见公式(2)。最后,帧t中的指向非t-1帧的MVs会按比例缩小(假设连续运动),这样他们缩放后指向了帧t-1,与文章[7]相似。部分精度 MVs的一些成分被四舍五入到最近整数。

B. Object detection

语义目标检测指在图像中寻找目标位置,并根据他们的类型对目标进行分类,例如,人,车,狗……任一目标检测器都可用在我们图1的框架中。然而根据经验,我们选择三个较流行的YOLO检测器:YOLO v3, YOLO v2, Tiny YOLO(其较YOLO v2来说更精简与快速,尽管精度有所下降)。[[14] J. Redmon and A. Farhadi, “YOLOv3: An incremental improvement,” arXiv preprint arXiv:1804.02767, 2018. [15] J. Redmon and A. Farhadi, “YOLO9000: better, faster, stronger,” in IEEE CVPR, July 2017, pp. 6517–6525. ]。

待跟踪目标的初始位置已经在视频序列的第一帧中已经指明。然后我们的跟踪器试着推断目标类别,这步是在视频序列前5帧中通过目标检测器来进行的。每帧图像,目标检测器会输出很多带有高置信度的目标类别的框。每帧中,检测到的框拥有与真实目标最大的IOU,同时记录下框选目标的类别。在这些对象类中出现最频繁类即是我们所要跟踪的对象。(个人理解是前几帧,每帧推断结果可能有出入,因此选取出现频次较高的作为真实预测类别)。

当目标的类别推断出后,时刻t的帧图像送进目标检测器,会输出N个Boxes , B = {B1,...,BN} ,这些框带有目标位置,目标类别,以及置信度得分。从这N个框中,我们删除那些与我们跟踪目标类别不符的框。之后会得到M个框,重新标记为, B_hat = {B1_hat,...,BM_hat}, 在最后决策阶段会用到这M个框。

本文提出的跟踪框架依赖于语义(目标类别)来消除帧中一些不相关的目标/框。原则上,语义信息应当在目标遮挡或多目标跟踪等较难情况下提供帮助。然而,即使非语义检测器(不输出目标类别)也能运用在我们的框架中,但是由于出现大量的不相关的框(即不同类别)和最后阶段出现决策错误的潜在可能性,这将影响精度。(作者的意思建议使用带目标类别预测的检测器)。

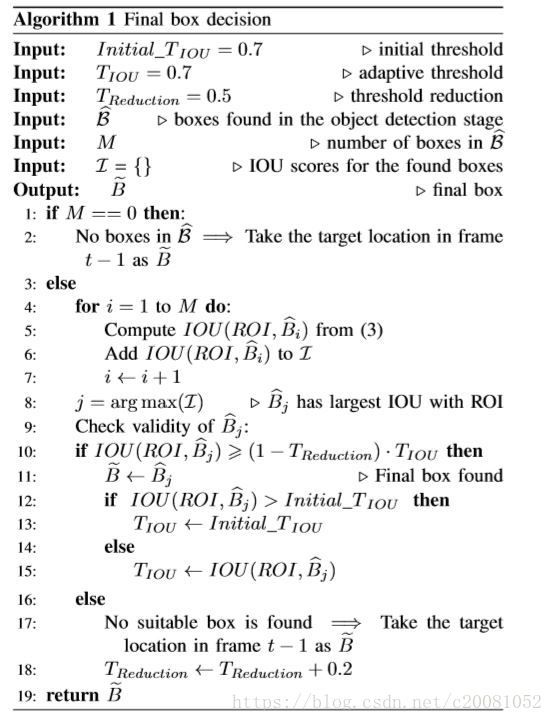

C. Final box decision(算法重点思想,个人觉得可借鉴)

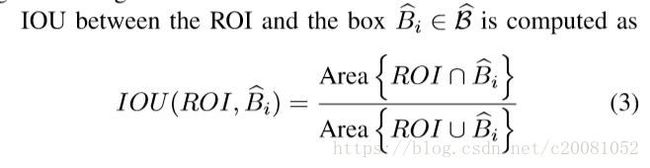

当目标检测器输出一系列的框![]() ,与目标相对应的框必须被识别。这步是通过利用第一阶段找到的ROI来进行的。在

,与目标相对应的框必须被识别。这步是通过利用第一阶段找到的ROI来进行的。在![]() 的框中,与ROI有最大IOU的作为较好的候选目标框。然而,即使是最高IOU也可能重合度非常小。因此,我们将最高的IOU与自适应阈值做比较来得到最终的决策。具体的细节见算法1.

的框中,与ROI有最大IOU的作为较好的候选目标框。然而,即使是最高IOU也可能重合度非常小。因此,我们将最高的IOU与自适应阈值做比较来得到最终的决策。具体的细节见算法1.

IOU计算公式如下:

算法1中的自适应阈值TIOU 会根据之前帧中IOU的值做更改。算法1中第10-18行为自适应阈值调整,设计来帮助解决这种情形:目标检测器在检测目标物时出现失败,但自适应阈值可用来检测周围的目标(个人理解就是YOLO检测的时候不可能每帧都能正确检测出,本人实际验证过,可利用历史信息来推断周边目标存在情况),当然该自适应阈值调整也能用在遮挡情形。这种情况下,目标检测器提供的boxes与之前帧中的目标的IOU出现不匹配情况,因此我们不会选取检测器的box,我们会将之前帧目标位置作为当前帧最终的box ![]() 位置(见算法1中第17行)。但是,若不匹配情况继续出现,那么IOU接受度阈值将减小(这是由于算法1中第18行,TReduction增大)。最终,由于较低的IOU接受度阈值(算法1中第10行)会使得检测到的框能够被接受作为最终的

位置(见算法1中第17行)。但是,若不匹配情况继续出现,那么IOU接受度阈值将减小(这是由于算法1中第18行,TReduction增大)。最终,由于较低的IOU接受度阈值(算法1中第10行)会使得检测到的框能够被接受作为最终的![]() 位置。(俗话些讲就是,长期达不到设置的IOU阈值的框,我就给IOU阈值调整的小些,算法会怀疑我之前的位置信息可信任度变低,因为误差总会累积的)。

位置。(俗话些讲就是,长期达不到设置的IOU阈值的框,我就给IOU阈值调整的小些,算法会怀疑我之前的位置信息可信任度变低,因为误差总会累积的)。

D. Summary

总结下提出的跟踪框架的关键特性。

与许多对象检测器兼容:我们的跟踪框架的一个优势是不依赖于任何特定的目标检测器。虽然作者使用了三种版本的YOLO,但其他诸如R-CNN,Fast R-CNN, Faster R-CNN,SSD都可以。

资源共享:目标检测器也可用于其他使用。例如,如果检测器防在云端,其他云服务可用它做其他事,如对用户提供的照片做目标检测,即单个深的模型能服务于许多应用。

数据重使用:本文利用MVs来解决跟踪中的运动问题,运动矢量存在于视频流中,对现成视频流数据的使用可加速处理,更具工程意义。

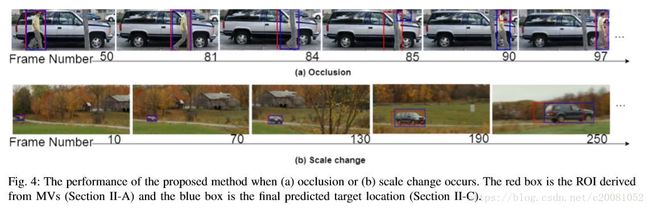

鲁棒性:跟踪的一个难点是外观和尺度变化。许多跟踪器试图明确地对其建模。我们的框架利用基于图像的目标检测器来解决,不受前一帧目标外观储存内容压力的影响。本文跟踪器对外观变化相当鲁棒,举例见图4(b)。

III EXPERIMENTAL RESULTS

A. Experimental setting

从OTB100的100个视频序列中选取30个视频序列用于测试。这些视频序列都包含目标类别,测试视频见表1,用HEVC参考软件HM16.15进行编码,配置参数见 encoder_lowdelay_P_main.cfg ,它的量化参数QP设置为32。然后运动矢量从压缩的HEVC视频流中提取。

提出的跟踪框架与DSST(VOT 2014挑战赛冠军),CNN-SVM,Re3比较,后两种是基于深层神经网络当前具有代表性的跟踪器。在我们的框架中,使用三个版本的YOLO检测器:YOLO v3,YOLO v2和Tiny YOLO(YOLO v2的简化版)。产生的跟踪器分别为MV-YOLO v3, MV-YOLO v2,和MV-Tiny YOLO。检测的阈值分别为:0.1,0.1,0.03。

B. Results

本文用one-pass评估跟踪器。