- LLaMA 学习笔记

AI算法网奇

深度学习基础人工智能深度学习

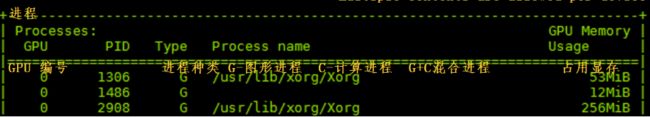

目录LLaMA模型结构:模型微调手册:推理示例:指定位置加载模型测试ok:模型下载:llama-stack下载modelscope下载LLaMA优化技术RMSNormSwiGLU激活函数旋转位置编码(RoPE)LLaMA模型结构:llama3结构详解-CSDN博客模型微调手册:大模型微调LLaMA详细指南(准备环境、数据、配置微调参数+微调过程)_llama微调-CSDN博客显存占用:FP16/B

- YOLO11 目标检测从安装到实战

前言YOLO(YouOnlyLookOnce)系列是目标检测领域的经典算法,凭借速度快、精度高的特点被广泛应用。最新的YOLO11在模型结构和性能上进一步优化,本文将从环境搭建到实战应用,详细讲解YOLO11的使用方法,适合新手快速上手。一、环境准备1.系统要求操作系统:Windows10/11、Ubuntu20.04+、欧拉系统等硬件:CPU可运行,GPU(NVIDIA)可加速(推荐,需支持CU

- rdkafka线程过多_我是如何处理大并发量订单处理的 KafKa部署总结

weixin_39574928

rdkafka线程过多

今天要介绍的是消息中间件KafKa,应该说是一个很牛的中间件吧,背靠Apache与很多有名的中间件搭配起来用效果更好哦,为什么不用RabbitMQ,因为公司需要它。网上已经有很多怎么用和用到哪的内容,但结果很多人都倒在了入门第一步环境都搭不起来,可谓是从了解到放弃,所以在此特记录如何在linux环境搭建,windows中配置一样,只是启动运行bat文件。想要用它就先必须了解它能做什么及能做到什么程

- ARMv7单核CPU上SWI(软件中断)验证

liuluyang530

FPGA验证软件中断armcpu异常处理

在ARMv7单核CPU上验证SWI(软件中断)功能需结合硬件初始化、异常向量表配置、处理函数实现及调试手段,以下是详细验证方案:一、验证环境搭建1.硬件准备开发板:搭载ARMv7单核CPU(如Cortex-A7/A8/A9)的嵌入式板(如树莓派、BeagleBone或自定义板)。调试工具:JTAG/SWD调试器(如J-Link、ST-Link)用于单步调试和寄存器查看。串口工具(如UART转USB

- 分库分表之实战-sharding-JDBC水平分库+分表后:查询与删除操作实战

大家好,我是工藤学编程一个正在努力学习的小博主,期待你的关注实战代码系列最新文章C++实现图书管理系统(QtC++GUI界面版)SpringBoot实战系列【SpringBoot实战系列】Sharding-Jdbc实现分库分表到分布式ID生成器Snowflake自定义wrokId实战环境搭建大集合环境搭建大集合(持续更新)分库分表分库分表之实战-sharding-JDBC绑定表配置实战前情摘要:1

- C语言的一课一得

awanj

c语言java开发语言

第一课:C语言基础环境搭建与第一个程序收获知识:了解了C语言的发展历程和广泛应用领域,知晓其在系统软件、嵌入式开发等多方面的重要性。掌握了C语言开发环境的搭建,如安装VisualStudioCode并配置MinGW编译器,或使用其他常见的集成开发环境(IDE),如Dev-C++等,为后续代码编写奠定基础。学会编写并成功运行第一个C语言程序“Hello,World!”,理解了main函数作为程序入口

- Java编程从入门到精通:全栈学习路径与实战案例指南

AI编程员

001AI传统&编程语言002AI编程工具汇总003AI编程作品汇总人工智能深度学习AI编程知识图谱需求分析

Java编程从入门到精通:全栈学习路径与实战案例指南一、入门基础:环境搭建与核心语法1.1开发环境配置(2025最新版)JDK17LTS:长期支持版本,提供模块化系统(JPMS)和文本块等新特性开发工具:IntelliJIDEA(智能代码补全)或VSCode+Java扩展包环境验证:java-version#输出:openjdk17.0.101.2基础语法精要数据类型与运算符://文本块(Java

- SpringBoot+WebSocket实战:即时通讯系统开发指南

fanxbl957

Webspringbootwebsocket后端

博主介绍:Java、Python、js全栈开发“多面手”,精通多种编程语言和技术,痴迷于人工智能领域。秉持着对技术的热爱与执着,持续探索创新,愿在此分享交流和学习,与大家共进步。全栈开发环境搭建运行攻略:多语言一站式指南(环境搭建+运行+调试+发布+保姆级详解)感兴趣的可以先收藏起来,希望帮助更多的人SpringBoot+WebSocket实战:即时通讯系统开发指南一、引言在当今数字化时代,即时通

- Spring AI 本地 RAG 实战:用Redis、Chroma搭建离线知识问答系统

勤奋的知更鸟

JavaAI大模型AI工具spring人工智能RAG

本文将用Ollama+Qwen-7B搭建离线知识问答系统(含Redis/Chroma向量库)目录前言环境搭建项目结构设计Maven依赖pom.xmlapplication.yml配置(Redis+Ollama)Redis向量库实战OllamaConfig.javaRagService.javaRagController.javaRagApplication.java测试样例RAG增强Maven依赖

- 分库分表之实战-sharding-JDBC绑定表配置实战

大家好,我是工藤学编程一个正在努力学习的小博主,期待你的关注实战代码系列最新文章C++实现图书管理系统(QtC++GUI界面版)SpringBoot实战系列【SpringBoot实战系列】Sharding-Jdbc实现分库分表到分布式ID生成器Snowflake自定义wrokId实战环境搭建大集合环境搭建大集合(持续更新)分库分表分库分表之实战-sharding-JDBC水平分库+水平分表配置实战

- TypeScript

两年半.倸枸

前端typescriptjavascript开发语言

一、简介1、TS是什么?以JS为基础构建的语言,一个JS的超集。可以在任何支持JS的平台中执行;TS扩展了JS,并添加了类型;TS不能被JS解析器直接执行,需要将TS编译为JS;2、TS增加了什么增加了类型、支持ES新特性、添加了ES不具备的新特性、配置选项。二、环境搭建1、安装Node.js2、安装TS:npmi-gtypescript3、创建一个TS文件4、使用TSC对TS文件进行编译:tsc

- 最实用的selenium使用指南

selenium使用一环境搭建下载seleniumpipinstallselenium下载浏览器驱动(以Edge为例)在设置中找到当前Edge版本号,在[MicrosoftEdgeWebDriver-MicrosoftEdgeDeveloper](https://developer.microsoft.com/en-us/microsoft-edge/tools/webdriver/)中下载对应版

- 前端自动化测试最佳实践:Jest与Cypress详解

目录前言自动化测试概述Jest详解Jest基础配置单元测试实践组件测试Mock与Stub快照测试Cypress详解Cypress环境搭建端到端测试实践页面交互测试API模拟测试策略与最佳实践测试金字塔测试覆盖率持续集成常见问题与解决方案总结前言随着前端应用的复杂度不断提高,确保代码质量和稳定性变得越来越重要。自动化测试作为保障代码质量的重要手段,已成为现代前端开发流程中不可或缺的一环。本文将详细介

- 新手向:实现验证码程序

nightunderblackcat

Java新手开发语言javamavenspringintellij-ideaspringbootspringcloud

本文将从零开始,通过一个简单的验证码程序。即使你没有任何编程基础,也能跟着这篇文章一步步学习。第一章:Java开发环境搭建1.1安装JDK要开始Java编程,首先需要安装Java开发工具包(JDK)。JDK是Java开发的核心,包含了运行Java程序所需的工具和库。访问Oracle官网下载适合你操作系统的JDK运行安装程序,按照提示完成安装配置环境变量(这一步很重要,确保你可以在任何目录下运行Ja

- Python 爬虫实战:京东商品数据采集(登录态验证 + 价格监控系统)

Python核芯

Python爬虫实战项目python爬虫开发语言

一、引言在电商飞速发展的当下,京东作为国内头部电商平台之一,拥有海量商品数据。对于商家而言,精准掌握这些数据能助力优化定价策略、洞察市场动态;对消费者来说,追踪商品价格走势有助于把握最佳购买时机。本文将深入剖析如何借助Python爬虫技术实现京东商品数据采集,包括突破登录态验证以及搭建价格监控系统,为读者呈上一份实用的电商数据挖掘指南。二、环境搭建安装Python库:执行以下命令安装所需的库:pi

- 2022全国职业技能大赛-网络系统管理-Debian模块:Linux初始化环境搭建

你可知这世上再难遇我

2022全国职业技能大赛网络系统管理-Debianlinuxdebian

网络系统管理;debian目录前言一、竞赛简介二、初始化环境1.默认账号及密码2.操作系统配置前言网络系统管理-deban初始化网络环境一、竞赛简介1.请认真阅读以下指引!2.当比赛结束时,离开时请不要关机您的虚拟机。3.如果没有明确要求,请使用“Chinaskill21”作为默认密码。4.本模块所有的系统为已经安装的最基本的系统状态

- python网络仿真模拟_复杂网络仿真工具networkX的环境搭建(Windows环境)

写这篇文章的目的是希望没有编程经验的小白也能够跟着文章的指示搭建自己的networkx环境,所以写得很初步很详细,会编程的人也不妨一看,可以避开一些我已经绕过的弯路我的PC环境是windows764位操作系统1.安装python,networkX属于python的一个模块,所以要先安装python;python可以去官网下载(官网上有不同版本的python,根据自己的PC环境下载)我下载的是文件p

- Python PyDub详解:音频处理从未如此简单

detayun

Pythonpython音视频开发语言

引言在Python生态中,PyDub以其简洁的设计和强大的功能,成为音频处理领域的后起之秀。这个由罗伯特·约翰逊主导开发的开源库,通过封装FFmpeg/Libav底层能力,为开发者提供了"不愚蠢"的音频处理方式。本文将带您系统掌握PyDub的核心用法,从环境搭建到高级应用,解锁音频处理的无限可能。安装与配置快速安装pipinstallpydub依赖管理FFmpeg安装指南:Windows:通过FF

- Rust之从零开始构建分布式事务数据库

莲华君

rust分布式数据库

目录第一部分:Rust基础与数据库基础Rust语言基础Rust的特点与优势Rust的内存安全与并发模型Rust工具链与开发环境搭建数据库基本原理关系型数据库与非关系型数据库数据库的事务管理原理ACID与BASE理论分布式系统与数据库的挑战第二部分:分布式数据库核心架构分布式数据库的设计原则CAP理论与BASE理论数据分片与复制数据一致性与可用性的权衡数据持久化与恢复策略分布式事务的基础事务的ACI

- D2-ROS2入门文档

陈纬度啊

AutoCar学习

ROS2基础入门学习指南目录ROS2简介与概述开发环境搭建ROS2核心概念开发第一个ROS2程序ROS2消息机制详解5.1Topic通信5.2Service通信5.3Action通信5.4Parameter参数自定义消息与接口ROS2包管理与工作空间Launch文件与系统启动ROS2工具与调试技巧ROS2组件与生命周期管理ROS2多线程与执行器ROS2QoS与性能优化ROS2安全机制ROS2仿真与

- OpenRocket 开发环境搭建指南

邓朝昌Estra

OpenRocket开发环境搭建指南openrocketModel-rocketryaerodynamicsandtrajectorysimulationsoftware项目地址:https://gitcode.com/gh_mirrors/op/openrocket前言OpenRocket是一款开源的火箭设计与仿真软件,采用Java语言开发。本文将详细介绍如何搭建OpenRocket的开发环境,

- 大同小异——服务器环境搭建

sohoAPI

【工具】服务器mysqllinuxflask

干货满满,带你玩转不同服务器配置,以Linux操作系统为例,这里使用云服务,像阿里云云服务购买成功,查看到之后只是一个界面信息,如果想要使用它,则需要远程连接java环境主要配置三个:jdk—java应用程序开发或者运行必须得有Java环境MysQL----如果我们要去开发一个项目,那么项目中的数据必须放到数据库中持久化存储tomcat–专门用来部署Java应用程序的一款软件配置jdk安装包地址将

- 微信小程序开发全解析:流程、交互、框架对比与避坑实战

北辰alk

微信小程序微信小程序交互小程序

文章目录一、微信小程序开发全景认知1.1技术架构解析1.2开发模式选择二、原生开发全流程详解2.1环境搭建2.2项目结构规范2.3核心API实战三、主流框架开发实践3.1Taro(React技术栈)3.1.1项目初始化3.1.2跨平台编译3.2Uni-app(Vue技术栈)3.2.1条件编译示例四、原生开发vs框架开发深度对比4.1开发效率对比4.2性能对比(数据实测)4.3跨平台能力4.4调试复

- 【后端开发】Flask学习教程

大雨淅淅

后端开发flask学习python后端

目录一、Flask是什么?二、环境搭建,准备启航2.1安装Python2.2安装Flask库三、第一个Flask程序,初窥门径3.1导入Flask类3.2创建应用实例3.3定义路由和视图函数3.4运行应用四、深入理解Flask核心概念4.1路由系统详解4.2请求与响应处理4.3模板引擎Jinja2五、Flask扩展,增强战斗力5.1Flask-SQLAlchemy:数据库操作的得力助手5.2Fla

- RabbitMQ在SpringBoot中的使用详解

z小天才b

RabbitMQrabbitmqspringboot

目录RabbitMQ基础概念什么是RabbitMQ?核心概念详解1.队列(Queue)2.交换机(Exchange)3.绑定(Binding)️环境搭建1.安装RabbitMQWindows安装Docker安装(推荐)2.访问管理界面SpringBoot集成RabbitMQ1.添加依赖2.配置文件⚙️基础配置1.RabbitMQ配置类简单队列模式1.队列配置2.生产者3.消费者工作队列模式1.配置

- Python 爬虫实战:Selenium 爬取豆瓣相册(图片分类 + 标签提取)

西攻城狮北

python爬虫selenium

一、引言豆瓣作为国内知名的社区平台,其相册功能允许用户上传和分享各类图片,涵盖电影海报、音乐专辑、生活记录等多个领域。这些图片数据对于了解用户兴趣、进行内容推荐和市场调研具有重要价值。然而,豆瓣对直接的数据访问设定了诸多限制,因此,本文将介绍如何通过Python爬虫技术结合Selenium自动化工具,合法高效地爬取豆瓣相册图片,并运用深度学习技术实现图片分类和标签提取。二、开发环境搭建(一)编程语

- Vue--2、Vue2 项目配置与组件化开发

Python智慧行囊

vue.js前端javascript

一、Vue2项目环境搭建1.环境准备安装Node.js:推荐使用nvm管理多版本Node#安装Node16.20.2nvminstall16.20.2#切换至指定版本nvmuse16.20.2#验证安装node-v&&npm-v安装VueCLI脚手架:#国内镜像源安装npminstall--registry=https://registry.npmmirror.com@vue/cli-g#验证安装

- Sa-Token完全学习指南

目录1.Sa-Token简介1.1什么是Sa-Token?1.2Sa-Token架构图1.3Sa-Tokenvs其他框架1.4适用场景2.环境搭建与快速开始2.1Maven依赖SpringBoot环境WebFlux环境2.2基础配置application.yml配置2.3创建启动类2.4第一个登录接口2.5统一响应类2.6全局异常处理3.核心API详解3.1StpUtil核心方法登录相关APITo

- SpringBoot多数据源动态切换方案:AbstractRoutingDataSource详解

fanxbl957

Webspringboot后端java

博主介绍:Java、Python、js全栈开发“多面手”,精通多种编程语言和技术,痴迷于人工智能领域。秉持着对技术的热爱与执着,持续探索创新,愿在此分享交流和学习,与大家共进步。DeepSeek-行业融合之万象视界(附实战案例详解100+)全栈开发环境搭建运行攻略:多语言一站式指南(环境搭建+运行+调试+发布+保姆级详解)感兴趣的可以先收藏起来,希望帮助更多的人SpringBoot多数据源动态切换

- AI初学者如何对大模型进行微调?——零基础保姆级实战指南

仅需8GB显存,三步完成个人专属大模型训练四步实战:从环境配置到模型发布步骤1:云端环境搭建(10分钟)推荐使用阿里魔塔ModelScope免费GPU资源:#注册后执行环境初始化pip3install--upgradepippip3installbitsandbytes>=0.39.0gitclone--depth1https://github.com/hiyouga/LLaMA-Factory.

- java数字签名三种方式

知了ing

javajdk

以下3钟数字签名都是基于jdk7的

1,RSA

String password="test";

// 1.初始化密钥

KeyPairGenerator keyPairGenerator = KeyPairGenerator.getInstance("RSA");

keyPairGenerator.initialize(51

- Hibernate学习笔记

caoyong

Hibernate

1>、Hibernate是数据访问层框架,是一个ORM(Object Relation Mapping)框架,作者为:Gavin King

2>、搭建Hibernate的开发环境

a>、添加jar包:

aa>、hibernatte开发包中/lib/required/所

- 设计模式之装饰器模式Decorator(结构型)

漂泊一剑客

Decorator

1. 概述

若你从事过面向对象开发,实现给一个类或对象增加行为,使用继承机制,这是所有面向对象语言的一个基本特性。如果已经存在的一个类缺少某些方法,或者须要给方法添加更多的功能(魅力),你也许会仅仅继承这个类来产生一个新类—这建立在额外的代码上。

- 读取磁盘文件txt,并输入String

一炮送你回车库

String

public static void main(String[] args) throws IOException {

String fileContent = readFileContent("d:/aaa.txt");

System.out.println(fileContent);

- js三级联动下拉框

3213213333332132

三级联动

//三级联动

省/直辖市<select id="province"></select>

市/省直辖<select id="city"></select>

县/区 <select id="area"></select>

- erlang之parse_transform编译选项的应用

616050468

parse_transform游戏服务器属性同步abstract_code

最近使用erlang重构了游戏服务器的所有代码,之前看过C++/lua写的服务器引擎代码,引擎实现了玩家属性自动同步给前端和增量更新玩家数据到数据库的功能,这也是现在很多游戏服务器的优化方向,在引擎层面去解决数据同步和数据持久化,数据发生变化了业务层不需要关心怎么去同步给前端。由于游戏过程中玩家每个业务中玩家数据更改的量其实是很少

- JAVA JSON的解析

darkranger

java

// {

// “Total”:“条数”,

// Code: 1,

//

// “PaymentItems”:[

// {

// “PaymentItemID”:”支款单ID”,

// “PaymentCode”:”支款单编号”,

// “PaymentTime”:”支款日期”,

// ”ContractNo”:”合同号”,

//

- POJ-1273-Drainage Ditches

aijuans

ACM_POJ

POJ-1273-Drainage Ditches

http://poj.org/problem?id=1273

基本的最大流,按LRJ的白书写的

#include<iostream>

#include<cstring>

#include<queue>

using namespace std;

#define INF 0x7fffffff

int ma

- 工作流Activiti5表的命名及含义

atongyeye

工作流Activiti

activiti5 - http://activiti.org/designer/update在线插件安装

activiti5一共23张表

Activiti的表都以ACT_开头。 第二部分是表示表的用途的两个字母标识。 用途也和服务的API对应。

ACT_RE_*: 'RE'表示repository。 这个前缀的表包含了流程定义和流程静态资源 (图片,规则,等等)。

A

- android的广播机制和广播的简单使用

百合不是茶

android广播机制广播的注册

Android广播机制简介 在Android中,有一些操作完成以后,会发送广播,比如说发出一条短信,或打出一个电话,如果某个程序接收了这个广播,就会做相应的处理。这个广播跟我们传统意义中的电台广播有些相似之处。之所以叫做广播,就是因为它只负责“说”而不管你“听不听”,也就是不管你接收方如何处理。另外,广播可以被不只一个应用程序所接收,当然也可能不被任何应

- Spring事务传播行为详解

bijian1013

javaspring事务传播行为

在service类前加上@Transactional,声明这个service所有方法需要事务管理。每一个业务方法开始时都会打开一个事务。

Spring默认情况下会对运行期例外(RunTimeException)进行事务回滚。这

- eidtplus operate

征客丶

eidtplus

开启列模式: Alt+C 鼠标选择 OR Alt+鼠标左键拖动

列模式替换或复制内容(多行):

右键-->格式-->填充所选内容-->选择相应操作

OR

Ctrl+Shift+V(复制多行数据,必须行数一致)

-------------------------------------------------------

- 【Kafka一】Kafka入门

bit1129

kafka

这篇文章来自Spark集成Kafka(http://bit1129.iteye.com/blog/2174765),这里把它单独取出来,作为Kafka的入门吧

下载Kafka

http://mirror.bit.edu.cn/apache/kafka/0.8.1.1/kafka_2.10-0.8.1.1.tgz

2.10表示Scala的版本,而0.8.1.1表示Kafka

- Spring 事务实现机制

BlueSkator

spring代理事务

Spring是以代理的方式实现对事务的管理。我们在Action中所使用的Service对象,其实是代理对象的实例,并不是我们所写的Service对象实例。既然是两个不同的对象,那为什么我们在Action中可以象使用Service对象一样的使用代理对象呢?为了说明问题,假设有个Service类叫AService,它的Spring事务代理类为AProxyService,AService实现了一个接口

- bootstrap源码学习与示例:bootstrap-dropdown(转帖)

BreakingBad

bootstrapdropdown

bootstrap-dropdown组件是个烂东西,我读后的整体感觉。

一个下拉开菜单的设计:

<ul class="nav pull-right">

<li id="fat-menu" class="dropdown">

- 读《研磨设计模式》-代码笔记-中介者模式-Mediator

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

/*

* 中介者模式(Mediator):用一个中介对象来封装一系列的对象交互。

* 中介者使各对象不需要显式地相互引用,从而使其耦合松散,而且可以独立地改变它们之间的交互。

*

* 在我看来,Mediator模式是把多个对象(

- 常用代码记录

chenjunt3

UIExcelJ#

1、单据设置某行或某字段不能修改

//i是行号,"cash"是字段名称

getBillCardPanelWrapper().getBillCardPanel().getBillModel().setCellEditable(i, "cash", false);

//取得单据表体所有项用以上语句做循环就能设置整行了

getBillC

- 搜索引擎与工作流引擎

comsci

算法工作搜索引擎网络应用

最近在公司做和搜索有关的工作,(只是简单的应用开源工具集成到自己的产品中)工作流系统的进一步设计暂时放在一边了,偶然看到谷歌的研究员吴军写的数学之美系列中的搜索引擎与图论这篇文章中的介绍,我发现这样一个关系(仅仅是猜想)

-----搜索引擎和流程引擎的基础--都是图论,至少像在我在JWFD中引擎算法中用到的是自定义的广度优先

- oracle Health Monitor

daizj

oracleHealth Monitor

About Health Monitor

Beginning with Release 11g, Oracle Database includes a framework called Health Monitor for running diagnostic checks on the database.

About Health Monitor Checks

Health M

- JSON字符串转换为对象

dieslrae

javajson

作为前言,首先是要吐槽一下公司的脑残编译部署方式,web和core分开部署本来没什么问题,但是这丫居然不把json的包作为基础包而作为web的包,导致了core端不能使用,而且我们的core是可以当web来用的(不要在意这些细节),所以在core中处理json串就是个问题.没办法,跟编译那帮人也扯不清楚,只有自己写json的解析了.

- C语言学习八结构体,综合应用,学生管理系统

dcj3sjt126com

C语言

实现功能的代码:

# include <stdio.h>

# include <malloc.h>

struct Student

{

int age;

float score;

char name[100];

};

int main(void)

{

int len;

struct Student * pArr;

int i,

- vagrant学习笔记

dcj3sjt126com

vagrant

想了解多主机是如何定义和使用的, 所以又学习了一遍vagrant

1. vagrant virtualbox 下载安装

https://www.vagrantup.com/downloads.html

https://www.virtualbox.org/wiki/Downloads

查看安装在命令行输入vagrant

2.

- 14.性能优化-优化-软件配置优化

frank1234

软件配置性能优化

1.Tomcat线程池

修改tomcat的server.xml文件:

<Connector port="8080" protocol="HTTP/1.1" connectionTimeout="20000" redirectPort="8443" maxThreads="1200" m

- 一个不错的shell 脚本教程 入门级

HarborChung

linuxshell

一个不错的shell 脚本教程 入门级

建立一个脚本 Linux中有好多中不同的shell,但是通常我们使用bash (bourne again shell) 进行shell编程,因为bash是免费的并且很容易使用。所以在本文中笔者所提供的脚本都是使用bash(但是在大多数情况下,这些脚本同样可以在 bash的大姐,bourne shell中运行)。 如同其他语言一样

- Spring4新特性——核心容器的其他改进

jinnianshilongnian

spring动态代理spring4依赖注入

Spring4新特性——泛型限定式依赖注入

Spring4新特性——核心容器的其他改进

Spring4新特性——Web开发的增强

Spring4新特性——集成Bean Validation 1.1(JSR-349)到SpringMVC

Spring4新特性——Groovy Bean定义DSL

Spring4新特性——更好的Java泛型操作API

Spring4新

- Linux设置tomcat开机启动

liuxingguome

tomcatlinux开机自启动

执行命令sudo gedit /etc/init.d/tomcat6

然后把以下英文部分复制过去。(注意第一句#!/bin/sh如果不写,就不是一个shell文件。然后将对应的jdk和tomcat换成你自己的目录就行了。

#!/bin/bash

#

# /etc/rc.d/init.d/tomcat

# init script for tomcat precesses

- 第13章 Ajax进阶(下)

onestopweb

Ajax

index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/

- Troubleshooting Crystal Reports off BW

blueoxygen

BO

http://wiki.sdn.sap.com/wiki/display/BOBJ/Troubleshooting+Crystal+Reports+off+BW#TroubleshootingCrystalReportsoffBW-TracingBOE

Quite useful, especially this part:

SAP BW connectivity

For t

- Java开发熟手该当心的11个错误

tomcat_oracle

javajvm多线程单元测试

#1、不在属性文件或XML文件中外化配置属性。比如,没有把批处理使用的线程数设置成可在属性文件中配置。你的批处理程序无论在DEV环境中,还是UAT(用户验收

测试)环境中,都可以顺畅无阻地运行,但是一旦部署在PROD 上,把它作为多线程程序处理更大的数据集时,就会抛出IOException,原因可能是JDBC驱动版本不同,也可能是#2中讨论的问题。如果线程数目 可以在属性文件中配置,那么使它成为

- 正则表达式大全

yang852220741

html编程正则表达式

今天向大家分享正则表达式大全,它可以大提高你的工作效率

正则表达式也可以被当作是一门语言,当你学习一门新的编程语言的时候,他们是一个小的子语言。初看时觉得它没有任何的意义,但是很多时候,你不得不阅读一些教程,或文章来理解这些简单的描述模式。

一、校验数字的表达式

数字:^[0-9]*$

n位的数字:^\d{n}$

至少n位的数字:^\d{n,}$

m-n位的数字:^\d{m,n}$