前面进行了hdfs原理的学习,下面进行hdfs的shell操作和api操作。

1、hdfs命令

hadoop的shell分两种,一种是集群的启动命令在sbin下。一种是操作命令是在bin之下。常用的有启动hadoop服务,start-dfs.sh start/stop ;start-yarn start/stop;mr-jobhistory-daemon.sh start/stop ;

hdfs的命令如下:

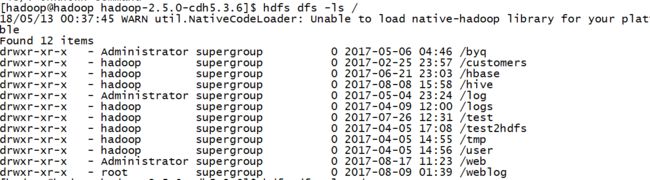

(1)hdfs dfs -ls/ 查看目录,如果是-lsr,则为递归展示

(2)hdfs dfs -mkdir -p /potti/test 创建文件夹

(3)-put -copyFromLocal -moveFromLocal 文件上传,move移动。

(4)-get -copyToLocal -moveToLocal 文件下载,跟put相反 。

(5)-cat -text 都是查看文件,不同的是cat是copy文件内容显示。text是通过hadoop解析实现文件查看,cat适合一半文件,text是适合全部文件查看。

(6)-rm -rmdir rm是可以删除任何文件,但是rmdir只是删除空文件。

(7)-fsck 查看文件是否有丢失备份异常情况。hdfs fsck /xxx

(8) -report 报告集群情况,hdfs dfsadmin -report 查看磁盘大小,丢失情况等。

(9)-namenode 节点格式化,回滚,升级等操作,查看hdfs namenode -h

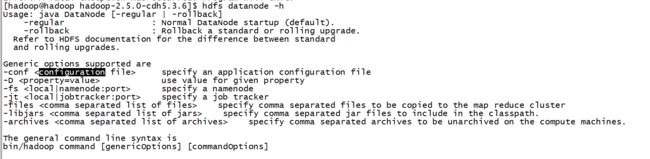

(10)-datanode 节点的启动、升级、节点回滚操作等。hdsf -datanode -h

(11)hadoop 命令,有hadoop job 、version、distcp

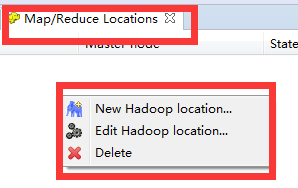

2、eclipse的环境搭建。

将插件移动到eclipse的plugins下,重启eclipse,切换到mapreduce试图下,配置相关信息,进行api的开发测试。

--测试api代码。

'''

package com.potti.hdfs.hadoop;

import java.io.BufferedReader;

import java.io.BufferedWriter;

import java.io.FileOutputStream;

import java.io.InputStream;

import java.io.InputStreamReader;

import java.io.OutputStream;

import java.io.OutputStreamWriter;

import java.net.URI;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.BlockLocation;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.LocatedFileStatus;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.fs.RemoteIterator;

import org.apache.hadoop.io.IOUtils;

import com.potti.ftp2hdfs.util.HdfsUtil;

/**

-

hdfs的API测试

*/

public class HdfsTest {public static void main(String[] args) {

// test(); // createNewFile(); // appTest(); // openTest(); // mkdirTest(); copyFromLocalTest(); // deleteTest(); //getFileStatusTest(); //这个方法得到的既有文件也有文件夹。 //lisTest(); //文件}

/**

递归展示文件夹下的文件,迭代只是取数据的展示方式。

@throws Exception

-

*/

private static void lisTest() {

try {

FileSystem fs = HdfsUtil.getFileSystem();

RemoteIteratorlistfile= fs.listFiles(new Path("/"), true);

while(listfile.hasNext()){

LocatedFileStatus filestatus=listfile.next();

System.out.println(filestatus.getAccessTime());

System.out.println(filestatus.getBlockSize());

System.out.println(filestatus.getGroup());

System.out.println(filestatus.getLen());

System.out.println(filestatus.getModificationTime());

System.out.println(filestatus.getPermission());

System.out.println(filestatus.getReplication());

System.out.println(filestatus.getOwner());//可以查阅文件在块在datanode的信息 BlockLocation[] blocklocation= filestatus.getBlockLocations(); for (BlockLocation blockLocation2 : blocklocation) { //块的信息 System.out.println("总长:"+blockLocation2.getLength()+" 结束位置:"+blockLocation2.getOffset()); String[] strname=blockLocation2.getNames(); //ip地址 for (String string1 : strname) { System.out.println("名称--》"+string1); } String[] strhost=blockLocation2.getHosts(); for (String string2 : strhost) { System.out.println("datanode-->"+string2); } System.out.println("-----------华丽丽的分割线----------"); } }} catch (Exception e) {

// TODO Auto-generated catch block

e.printStackTrace();

}

}

/***

* 1.创建文件测试 create()参数比较多

***/

public static void test() {

try {

Configuration conf = new Configuration(); // 配置文件读取

conf.set("fs.defaultFS", "hdfs://192.168.0.127:9000"); // 读取hdfs的文件地址

FileSystem fs = FileSystem.get(conf);

FSDataOutputStream fsout = fs.create(new Path("/test/test1.txt"), (short) 2);

BufferedWriter bw = new BufferedWriter(new OutputStreamWriter(fsout));

bw.write("we are word");

bw.newLine();

bw.write("测试完毕!!!");

bw.close();

fsout.close();

fs.close();

System.out.println("文件写入成功!!");

} catch (Exception e) {

e.printStackTrace();

System.out.println("文件写入失败!!");

}

}

/**

* 创建一个新得空文件 createNewFile()

**/

public static void createNewFile() {

try {

Configuration conf = new Configuration(); // 配置文件读取

conf.set("fs.defaultFS", "hdfs://192.168.20.102:8020"); // 读取hdfs的文件地址

FileSystem fs = FileSystem.get(conf);

// 这是绝对路径创建方法

// boolean isCreate =fs.createNewFile(new

// Path("/create/newfile.txt"));

// 相对路径,程序会自动创建用户文件夹,进行创建文件。

boolean isCreate = fs.createNewFile(new Path("newfile.txt"));

if (isCreate) {

System.out.println("创建成功!!");

} else {

System.out.println("创建失败!!");

}

fs.close();

} catch (Exception e) {

e.printStackTrace();

System.out.println("文件创建失败!!");

}

}

/**

* append往文件中写数据

*/

public static void appTest() {

try {

Configuration cf = new Configuration();

cf.set("fs.defaultFS", "hdfs://192.168.20.102:8020");

FileSystem fs = FileSystem.get(cf);

// 创建 文件地址

Path pa = new Path("/create/newfile.txt"); // 绝对地址

Path pat = new Path("newfile.txt"); // 相对路径

FSDataOutputStream fsd = fs.append(pat);// 数据添加

fsd.write("这是添加内容的精神科的急死啦打死了大山里的解散了".getBytes());

fsd.close();

fs.close();

System.out.println("数据追加成功!!");

} catch (Exception e) {

e.printStackTrace();

System.out.println("数据追加失败!!");

}

}

/**

* open方法测试 (读取是文本模式)

**/

/**

*

*/

public static void openTest() {

try {

FileSystem fs = HdfsUtil.getFileSystem(); // 得到默认配置

InputStream in = fs.open(new Path("/create/newfile.txt"));

BufferedReader red = new BufferedReader(new InputStreamReader(in));

String line = null;

while ((line = red.readLine()) != null) {

System.out.println(line);

}

red.close();

in.close();

fs.close();

} catch (Exception e) {

e.printStackTrace();

}

}

/**

* mkdirs 创建文件夹的方法

***/

public static void mkdirTest() {

try {

FileSystem fs = HdfsUtil.getFileSystem();

boolean bl = fs.mkdirs(new Path("/web/click/weblog"));

fs.close();

if (bl) {

System.out.println("创建文件夹成功!");

} else {

System.out.println("创建文件夹失败!!!!");

}

} catch (Exception e) {

e.printStackTrace();

System.out.println("创建文件夹失败!!");

}

}

/***

* 上传和下载 copyfromlocal 本地上传到目标 ,copytolocal 目标下载到本地

*

**/

public static void copyFromLocalTest() {

try {

FileSystem fs =HdfsUtil.getFileSystem();

// 文件上传

fs.copyFromLocalFile(new Path("E:\\temp\\access.log.fensi"), new

Path("/web/click/weblog/access.log")); //从一个地址上传到另一个地址

System.out.println("文件上传完成!!");

// 文件下载

// fs.moveFromLocalFile(new

// Path("/log/output/20170228/access/access.txt-r-00000"), new

// Path("d:\\copytoTest.txt"));

// String dest = "hdfs://192.168.0.10:8020/byq/output/part-r-00000";

// String local = "d:/temp/byqhdfs.txt";

// FileSystem fsm = FileSystem.get(URI.create(dest), HdfsUtil.getConfiguration());

// FSDataInputStream fsdi = fsm.open(new Path(dest));

// OutputStream output = new FileOutputStream(local);

// IOUtils.copyBytes(fsdi, output, 4096, true);

// System.out.println("文件下载完成!!");

//fsm.close();

fs.close();

} catch (Exception e) {

e.printStackTrace();

System.out.println("文件操作失败!!");

}

}

/**

* 文件删除方法 delete

**/

public static void deleteTest() {

try {

FileSystem fs = HdfsUtil.getFileSystem();

boolean isdelete = fs.delete(new Path("/2.txt"), true); // 此方法类似于立马执行

// boolean isdelete=fs.deleteOnExit(new Path("/create/test"));

// //此方法类似于程序执行完毕之后,开始执行

if (isdelete) {

System.out.println("文件删除成功!!");

} else {

System.out.println("文件删除失败!!");

}

fs.close();

} catch (Exception e) {

e.printStackTrace();

}

}

/***

* getFileStatus 查看文件属性

*/

public static void getFileStatusTest() {

try {

FileSystem fs = HdfsUtil.getFileSystem();

FileStatus[] status = fs.listStatus(new Path("/"));

for (int i = 0; i < status.length; i++) {

status[i].isFile(); //如果是文件夹,其中文件需要自己进行递归。

System.out.println("文件大小:" + status[i].getLen());

System.out.println("文件块大小:" + status[i].getBlockSize());

System.out.println("文件所有者:" + status[i].getOwner());

System.out.println("文件备份数:" + status[i].getReplication());

System.out.println("文件路径:" + status[i].getPath());

System.out.println("文件权限:" + status[i].getPermission());

}

fs.close();

} catch (Exception e) {

e.printStackTrace();

}

}

}

'''

完毕。