Python计算机视觉-KNN、D-SIFT、手势识别

K近邻分类法(KNN)

KNN是分类方法中最简单且常用的一种,它的思想是假如一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也应该属于这个类别,其中K通常是不大于20的整数。KNN算法中,所选择的邻居都是已经正确分类的对象。该方法在定类决策上只依据最邻近的一个或者几个样本的类别来决定待分样本所属的类别。

如图,对类别未知的绿色圆点进行类别划分,那它应该属于红色三角形还是蓝色正方形?如果K=3,由于红色三角形所占比例为2/3,绿色圆将被赋予红色三角形那个类,如果K=5,由于蓝色四方形比例为3/5,绿色圆被赋予蓝色四方形类。可以看出K的取值很大程度影响算法结果。

课本上给出了一个简单二维点分类的示例,创建两个不同的二维点集,用Pickle模块保存:

创建并保存点集:

# -*- coding: utf-8 -*-

from numpy.random import randn

import pickle

from pylab import *

# create sample data of 2D points

n = 200

# two normal distributions

class_1 = 0.6 * randn(n,2)

class_2 = 1.2 * randn(n,2) + array([5,1])

labels = hstack((ones(n),-ones(n)))

# save with Pickle

#with open('points_normal.pkl', 'w') as f:

with open('points_normal_test.pkl', 'wb') as f:

pickle.dump(class_1,f)

pickle.dump(class_2,f)

pickle.dump(labels,f)

# normal distribution and ring around it

print ("save OK!")

class_1 = 0.6 * randn(n,2)

r = 0.8 * randn(n,1) + 5

angle = 2*pi * randn(n,1)

class_2 = hstack((r*cos(angle),r*sin(angle)))

labels = hstack((ones(n),-ones(n)))

# save with Pickle

#with open('points_ring.pkl', 'w') as f:

with open('points_ring_test.pkl', 'wb') as f:

pickle.dump(class_1,f)

pickle.dump(class_2,f)

pickle.dump(labels,f)

print ("save OK!")

载入点集与测试分类可视化:

# -*- coding: utf-8 -*-

import pickle

from pylab import *

from PCV.classifiers import knn

from PCV.tools import imtools

pklist=['points_normal.pkl','points_ring.pkl']

figure()

# load 2D points using Pickle

for i, pklfile in enumerate(pklist):

with open(pklfile, 'rb') as f:

class_1 = pickle.load(f)

class_2 = pickle.load(f)

labels = pickle.load(f)

# load test data using Pickle

with open(pklfile[:-4]+'_test.pkl', 'rb') as f:

class_1 = pickle.load(f)

class_2 = pickle.load(f)

labels = pickle.load(f)

model = knn.KnnClassifier(labels,vstack((class_1,class_2)))

# test on the first point

print (model.classify(class_1[0]))

#define function for plotting

def classify(x,y,model=model):

return array([model.classify([xx,yy]) for (xx,yy) in zip(x,y)])

# lot the classification boundary

subplot(1,2,i+1)

imtools.plot_2D_boundary([-6,6,-6,6],[class_1,class_2],classify,[1,-1])

titlename=pklfile[:-4]

title(titlename)

show()

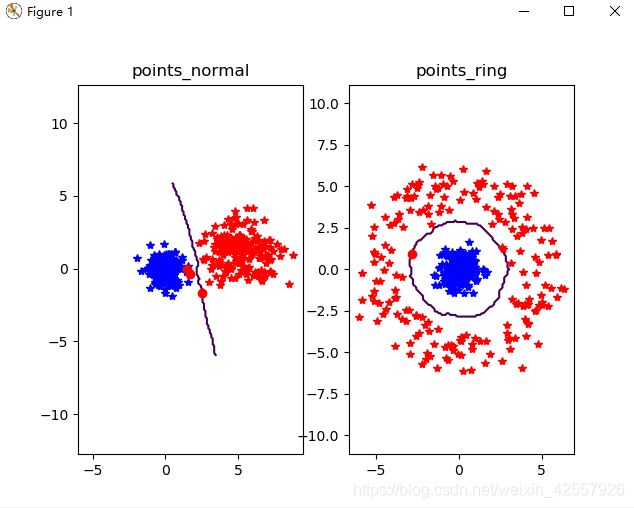

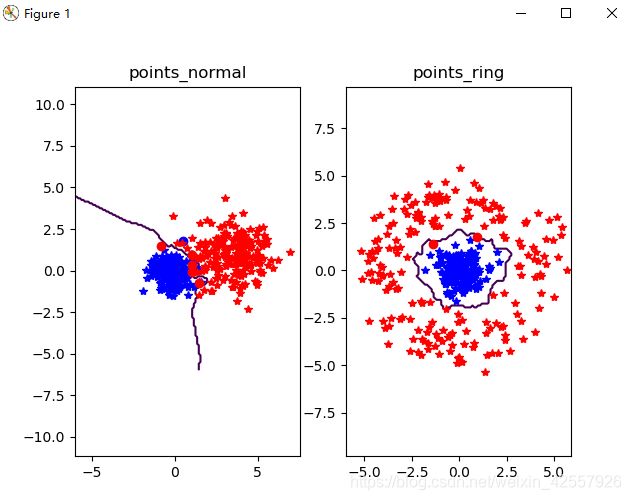

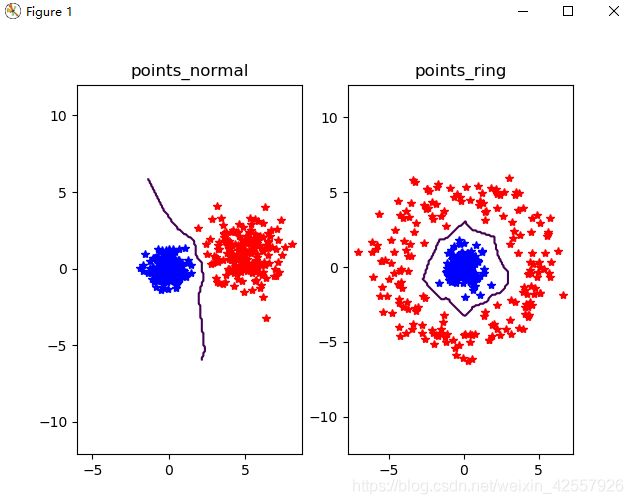

原数据基础上调整knn分类器k的取值进行分类,错分的点以圆点表示,结果如下:

k = 3

k = 10

k = 20

从图上可以看出,即便大幅度地增加k值,对于类间距离大的数据集来说只会影响极个别边界点

那么接下来尝试尽可能缩小类间距离,看一看是否还能有以上分类效果:

k = 3

k = 10

k = 20

结果证明,因为KNN算法核心思想就是以最邻近点的距离划分类别,这决定了不论k如何取值它都会对类边缘点有很高的敏感度,而针对不同类间距离的数据集,调整k值可以提高分类的准确度,K值较小,容易发生过拟合,估计误差会增大,k值较大可以减少学习的估计误差,但是学习的近似误差会增大,与输入实例较远的训练实例也会对预测起作用,使预测发生错误。但实际上除了更改k值,更有效的方式是采用合适的距离度量策略,例如加入权重系数。

就以上两种类型的数据而言,因为两个类别之间存在一条准确的分割线,因此k取很小的值(如1,2)会有绝佳的分类性能:

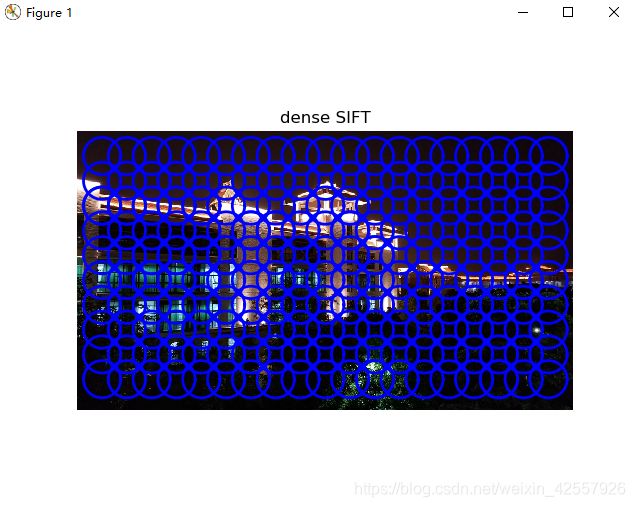

Dense SIFT

在图像的一个小图像块上以一定步长step滑动,这个图像块就是描述子采样区域,图像块尺寸是4bins * 4bins,bin size可以自己指定,图中的bounding box是sift特征点的范围:

在整幅图像上用规则网格应用SIFT,可视化显示特征位置:

原图:

d-sift:

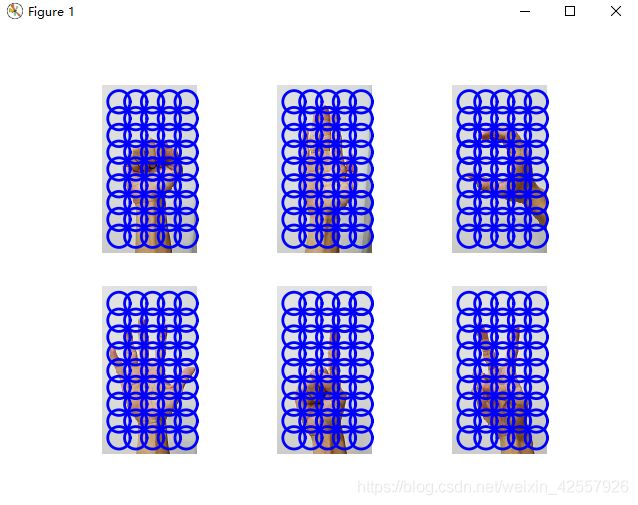

KNN手势识别

原书在此使用静态手势数据库中的图像演示,用D-SIFT来处理手势图像,得到所有静态图像的特征向量,每一幅图像特征文件后缀名为 dsift,从文件中读取稠密sift描述子:

# -*- coding: utf-8 -*-

import os

from PCV.localdescriptors import sift, dsift

from pylab import *

from PIL import Image

imlist=['gesture/train/C-uniform02.ppm','gesture/train/B-uniform01.ppm',

'gesture/train/A-uniform01.ppm','gesture/train/Five-uniform01.ppm',

'gesture/train/Point-uniform01.ppm','gesture/train/V-uniform01.ppm']

figure()

for i, im in enumerate(imlist):

print (im)

dsift.process_image_dsift(im,im[:-3]+'dsift',10,5,True)

l,d = sift.read_features_from_file(im[:-3]+'dsift')

dirpath, filename=os.path.split(im)

im = array(Image.open(im))

#显示手势含义title

titlename=filename[:-14]

subplot(2,3,i+1)

sift.plot_features(im,l,True)

title(titlename)

show()

效果如下:

自己拍摄手势的效果(需要更改函数 process_image_dsift 的网格密度参数以适应不同规格图像):

定义辅助函数 read_gesture_features_labels 从文件中读取d-sift描述子,然后我们可以用脚本读取训练集和测试集特征、标记信息,用训练数据及标记作为输入创建分类器,遍历测试集进行分类,最后计算分类正确率,print_confusion 函数用于打印标记和混淆矩阵,混淆矩阵显示每个类别被分到的样本数,以此得出容易错分的类别:

# -*- coding: utf-8 -*-

from PCV.localdescriptors import dsift

import os

from PCV.localdescriptors import sift

from pylab import *

from PCV.classifiers import knn

def get_imagelist(path):

""" Returns a list of filenames for

all jpg images in a directory. """

return [os.path.join(path,f) for f in os.listdir(path) if f.endswith('.ppm')]

def read_gesture_features_labels(path):

# create list of all files ending in .dsift

featlist = [os.path.join(path,f) for f in os.listdir(path) if f.endswith('.dsift')]

# read the features

features = []

for featfile in featlist:

l,d = sift.read_features_from_file(featfile)

features.append(d.flatten())

features = array(features)

# create labels

labels = [featfile.split('/')[-1][0] for featfile in featlist]

return features,array(labels)

def print_confusion(res,labels,classnames):

n = len(classnames)

# confusion matrix

class_ind = dict([(classnames[i],i) for i in range(n)])

confuse = zeros((n,n))

for i in range(len(test_labels)):

confuse[class_ind[res[i]],class_ind[test_labels[i]]] += 1

print ('Confusion matrix for')

print (classnames)

print (confuse)

filelist_train = get_imagelist('gesture/train')

filelist_test = get_imagelist('gesture/test')

imlist=filelist_train+filelist_test

# process images at fixed size (50,50)

for filename in imlist:

featfile = filename[:-3]+'dsift'

dsift.process_image_dsift(filename,featfile,10,5,resize=(50,50))

features,labels = read_gesture_features_labels('gesture/train/')

test_features,test_labels = read_gesture_features_labels('gesture/test/')

classnames = unique(labels)

# test kNN

k = 1

knn_classifier = knn.KnnClassifier(labels,features)

res = array([knn_classifier.classify(test_features[i],k) for i in

range(len(test_labels))])

# accuracy

acc = sum(1.0*(res==test_labels)) / len(test_labels)

print ('Accuracy:', acc)

print_confusion(res,test_labels,classnames)

课本数据集结果:

结果表明P和V两个手势容易错分;

以下是自己拍摄的训练集和测试集两个易混淆手势各十张图像:

分辨率都缩小至112 × 200 :

分类测试结果:

虽然准确率达到了95%,应该是分辨率在特征提取时对结果导向具有关键性的作用,数据集图像分辨率越高越能够提高手势分类的准确率,但因为数据集的规模太小,可以再尝试数据量更大的分类情况。