神经网络算法推演-------前馈神经网络(feedforward neural network )

前馈神经网络(feedforward neural network )

学习神经网络的公式推导时,看到一篇很好的文章,所以就搬到了自己的博客,重新编辑了下,也算是自我学习并分享给大家,查看原文请点击===>>>>>

1.1概述

以监督学习为例,假设我们有训练样本集 (x(i),y(i)) ( x ( i ) , y ( i ) ) ,那么神经网络算法能够提供一种复杂且非线性的假设模型 hW,b(x) h W , b ( x ) ,它具有参数 W W ,可以以此参数来拟合我们的数据。

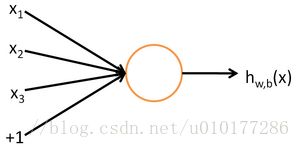

为了描述神经网络,我们先从最简单的神经网络讲起,这个神经网络仅由一个“神经元”构成,以下即是这个“神经元”的图示:

这个“神经元”是一个以 x1,x2,x3 x 1 , x 2 , x 3 及截距 +1 + 1 为输入值的运算单元,其输出为

可以看出,这个单一“神经元”的输入-输出映射关系其实就是一个逻辑回归(logistic regression)。

虽然本系列教程采用sigmoid函数,但你也可以选择双曲正切函数(tanh):

tanh(z) tanh ( z ) 函数是sigmoid函数的一种变体,它的取值范围为 [−1,1] [ − 1 , 1 ] ,而不是sigmoid函数的 [0,1] [ 0 , 1 ] 。

最后要说明的是,有一个等式我们以后会经常用到:

- 如果选择 f(z)=1/(1+exp(−z)) f ( z ) = 1 / ( 1 + exp ( − z ) ) ,也就是sigmoid函数,那么它的导数就是 f′(z)=f(z)(1−f(z)) f ′ ( z ) = f ( z ) ( 1 − f ( z ) )

- 如果选择tanh函数,那它的导数就是 f′(z)=1−(f(z))2 f ′ ( z ) = 1 − ( f ( z ) ) 2 ,你可以根据sigmoid(或tanh)函数的定义自行推导这个等式。

1.2 神经网络模型

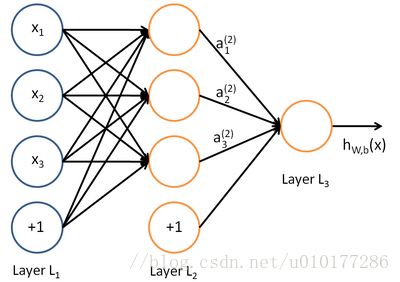

所谓神经网络就是将许多个单一“神经元”联结在一起,这样,一个“神经元”的输出就可以是另一个“神经元”的输入。例如,下图就是一个简单的神经网络:

我们使用圆圈来表示神经网络的输入,标上“ +1 + 1 ”的圆圈被称为”’偏置节点”’,也就是截距项。神经网络最左边的一层叫做”‘输入层”’,最右的一层叫做”‘输出层’”(本例中,输出层只有一个节点)。中间所有节点组成的一层叫做”’隐藏层”’,因为我们不能在训练样本集中观测到它们的值。同时可以看到,以上神经网络的例子中有3个”’输入单元”’(偏置单元不计在内),3个”’隐藏单元”’及一个”’输出单元”’。

我们用 nl n l 来表示网络的层数,本例中 nl=3 n l = 3 ,我们将第 l l 层记为 Ll L l ,于是 L1 L 1 是输入层,输出层是 Lnl L n l 。本例神经网络有参数 (W,b)=(W(1),b(1),W(2),b(2)) ( W , b ) = ( W ( 1 ) , b ( 1 ) , W ( 2 ) , b ( 2 ) ) ,其中 W(l)ij W i j ( l ) (下面的式子中用到)是第 l l 层第 j j 单元与第 l+1 l + 1 层第 i i 单元之间的联接参数(其实就是连接线上的权重,注意标号顺序), b(l)i b i ( l ) 是第 l+1 l + 1 层第 i i 单元的偏置项。因此在本例中, W(1)∈R3×3 W ( 1 ) ∈ ℜ 3 × 3 , W(2)∈R1×3 W ( 2 ) ∈ ℜ 1 × 3 。注意,没有其他单元连向偏置单元(即偏置单元没有输入),因为它们总是输出 +1 + 1 。同时,我们用 sl s l 表示第 l l 层的节点数(偏置单元不计在内)。

我们用 a(l)i a i ( l ) 表示第 l l 层第 i i 单元的”’激活值”’(输出值)。当 l=1 l = 1 时, a(1)i=xi a i ( 1 ) = x i ,也就是第 i i 个输入值(输入值的第 i i 个特征)。对于给定参数集合 W,b W , b ,我们的神经网络就可以按照函数 hW,b(x) h W , b ( x ) 来计算输出结果。本例神经网络的计算步骤如下:

我们用 z(l)i z i ( l ) 表示第 l l 层第 i i 单元输入加权和(包括偏置单元),比如, z(2)i=∑nj=1W(1)ijxj+b(1)i z i ( 2 ) = ∑ j = 1 n W i j ( 1 ) x j + b i ( 1 ) ,则 a(l)i=f(z(l)i) a i ( l ) = f ( z i ( l ) ) 。

这样我们就可以得到一种更简洁的表示法。这里我们将激活函数 f(⋅) f ( ⋅ ) 扩展为用向量(分量的形式)来表示,即 f([z1,z2,z3])=[f(z1),f(z2),f(z3)] f ( [ z 1 , z 2 , z 3 ] ) = [ f ( z 1 ) , f ( z 2 ) , f ( z 3 ) ] ,那么,上面的等式可以更简洁地表示为:

我们将上面的计算步骤叫作”’前向传播”’。回想一下,之前我们用 a(1)=x a ( 1 ) = x 表示输入层的激活值,那么给定第 l l 层的激活值 a(l) a ( l ) 后,第 l+1 l + 1 层的激活值 a(l+1) a ( l + 1 ) 就可以按照下面步骤计算得到:

将参数矩阵化,使用矩阵-向量运算方式,我们就可以利用线性代数的优势对神经网络进行快速求解。

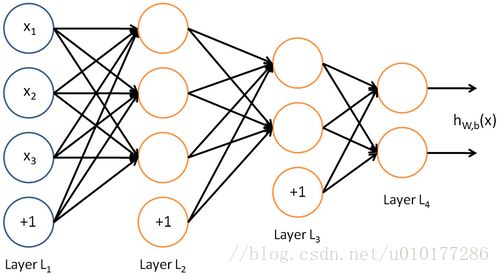

目前为止,我们讨论了一种神经网络,我们也可以构建另一种”’结构”’的神经网络(这里结构指的是神经元之间的联接模式),也就是包含多个隐藏层的神经网络。最常见的一个例子是 nl n l 层的神经网络,第 1 1 层是输入层,第 nl n l 层是输出层,中间的每个层 l l 与层 l+1 l + 1 紧密相联。这种模式下,要计算神经网络的输出结果,我们可以按照之前描述的等式,按部就班,进行前向传播,逐一计算第 L2 L 2 层的所有激活值,然后是第 L3 L 3 层的激活值,以此类推,直到第 Lnl L n l 层。这是一个”’前馈”’神经网络的例子,因为这种联接图没有闭环或回路。

神经网络也可以有多个输出单元。比如,下面的神经网络有两层隐藏层: L2 L 2 及 L3 L 3 ,输出层 L4 L 4 有两个输出单元。

要求解这样的神经网络,需要样本集 (x(i),y(i)) ( x ( i ) , y ( i ) ) ,其中 y(i)∈R2 y ( i ) ∈ ℜ 2 。如果你想预测的输出是多个的,那这种神经网络很适用。(比如,在医疗诊断应用中,患者的体征指标就可以作为向量的输入值,而不同的输出值 yi y i 可以表示不同的疾病存在与否。)

1.3.参考文献

- https://www.cnblogs.com/csucat/p/5142595.html

- feedforward neural network 前馈神经网络

- 反向传播算法 Backpropagation Algorithm

- 反向传播算法推导及相关问题

- 神经网络手动计算例证

- https://www.cnblogs.com/csucat/p/5142595.html