深度学习 tesorflow2.0版本 入门第二章-基本概念

TensorFlow 基本概念与常见函数

Tensor

TensorFlow 中,Tensor 表示张量,是多维数组、多维列表. 用阶表示张量的维数。

0 阶张量叫做标量,表示的是一个单独的数,如 123。

1 阶张量叫作向量,表示的是一个一维数组如[1,2,3]。

2 阶张量叫作矩阵,表示的是一个二维数组,它可以有 i 行 j 列个元素,每个元素用它的行号和列号共同索引到,如在

[[1,2,3],[4,5,6],[7,8,9]]中,数值2 的索引即为第 0 行第 1 列。

小tips:

张量的阶数与方括号的数

量相同,0 个方括号即为 0 阶张量,1 个方括号即为 1 阶张量。故张量可以表示

0 阶到 n 阶的数组。也可通过 reshape 的方式得到更高维度数组,

np.arange(24) 表示生成从0到23的一维数组。

.reshape(2,4,3)表示生成 2x4x3的 数组。是三维数组。

TensorFlow 的数据类型

32 位整型(tf.int32)

32 位浮点(tf.float32)

64 位浮点(tf.float64)

布尔型(tf.bool)

字符串型(tf.string)

创建张量tensor

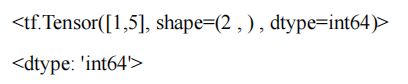

tf.constant(张量内容,dtype=数据类型(可选))

import tensorflow as tf

a=tf.constant([1,5],dtype=tf.int64)

print(a)

print(a.dtype)

print(a.shape)

张量内容、形状 与 数据类型

shape 中数字为 2,表示一维张量里有 2个元素

通过numpy创建数组,然后传入到tensor中去。

将 numpy 格式的 a 转换成了 Tensor 格式的 b。

import tensorflow as tf

import numpy as np

a = np.arange(0, 5)

b = tf.convert_to_tensor( a, dtype=tf.int64 )

print(a)

print(b)

用不同函数创建不同值的张量

tf. zeros(维度)创建全为 0 的张量。

tf.ones(维度)创建全为 1 的张量。

tf. fill(维度,指定值)创建全为指定值的张量。

tf. random.normal (维度,mean=均值,stddev=标准差) 生成正态分布的随机数,默认均值为 0,标准差为 1。

tf. random.truncated_normal (维度,mean=均值,stddev=标准差)生成截断式正态分布的随机数,能使生成的这些随机数更集中一些,如果随机生成数据的取值在 (µ - 2σ,u + 2σ ) 之外则重新进行生成,保证了生成值在均值附近。

tf. random. uniform(维度,minval=最小值,maxval=最大值) 生成指定维度的均匀分布随机数

minval 给定随机数的最小值, maxval 给定随机数的最大值。

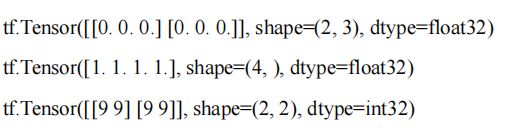

tf.zeros([2,3])创建了一个二维张量,第一个维度有两个元素,第二个维度有三个元素,元素的内容全是 0。

tf.ones(4)创建了一个一维张量,里边有 4 个元素,内容全是 1。

tf.fill([2,2],9)创建了一个两行两列的二维张量,第一个维度有两个元素,第二个维度也有两个元素,内容都是 9。

a = tf.zeros([2, 3])

b = tf.ones(4)

c = tf.fill([2, 2], 9)

print(a)

print(b)

print(c)

d = tf.random.normal ([2, 2], mean=0.5, stddev=1)

e = tf.random.truncated_normal ([2, 2], mean=0.5, stddev=1)

f = tf.random.uniform([2, 2], minval=0, maxval=1)

常用函数

tf.cast (张量名,dtype=数据类型)

强制将 Tensor 转换为该数据类型

tf.reduce_min (张量名)

计算张量维度上元素的最小值

tf.reduce_max (张量名)

计算张量维度上元素的最大值

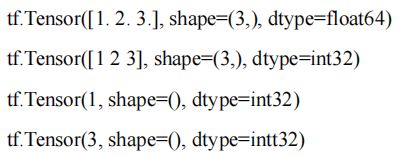

x1 = tf.constant ([1., 2., 3.], dtype=tf.float64)

x2 = tf.cast (x1, tf.int32)

print (tf.reduce_min(x2), tf.reduce_max(x2))

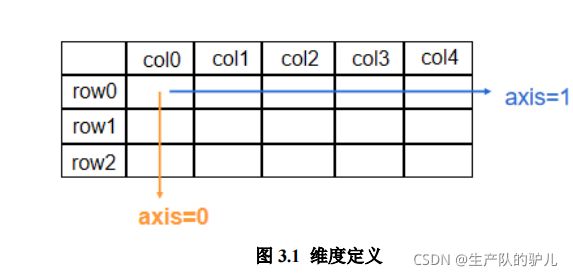

tf.reduce_mean (张量名,axis=操作轴)

计算张量沿着指定维度的平均值

tf.reduce_sum (张量名,axis=操作轴)

计算张量沿着指定维度的和

以上两个,如果不指定 axis,则表示对所有元素进行操作。

x=tf.constant( [ [ 1, 2,3],[2, 2, 3] ] )

print(x)

print(tf.reduce_mean( x ))

print(tf.reduce_sum( x, axis=1 ))

tf.Variable(initial_value,trainable,validate_shape,name)

将 变量 标记为“可训练”的,被它标记了的变量,会在反向传播中记录自己的梯度信息。

各个参数的含义:

initial_value 默认为 None,可以搭配 tensorflow 随机生成函数来初始化参数。

trainable 默认为 True,表示可以后期被算法优化的,如果不想该变量被优化,即改为 False。

validate_shape 默认为 True,形状不接受更改,如果需要更改,validate_shape=False。

name 默认为 None,给变量确定名称。

w = tf.Variable(tf.random.normal([2, 2], mean=0, stddev=1))

首先随机生成正态分布随机数,再给生成的随机数标记为可训练,这样在反向传播中就可以通过梯度下降更新参数 w了。

tensorflow中的张量的四则运算

tf.add (张量 1,张量2)

两个张量的对应元素相加。

tf.subtract (张量 1,张量 2)

两个张量的对应元素相减。

tf.multiply (张量 1,张量 2)

两个张量的对应元素相乘。

注意:注:只有维度相同的张量才可以做四则运算。

a = tf.ones([1, 3])

b = tf.fill([1, 3], 3.)

print(tf.add(a,b))

print(tf.subtract(a,b))

print(tf.multiply(a,b))

print(tf.divide(b,a))

tf.square (张量名)

计算某个张量的平方。

tf.pow (张量名,n 次方数)

计算某个张量的 n 次方。

tf.sqrt (张量名)

计算某个张量的开方。

a = tf.fill([1, 2], 3.)

print(tf.pow(a, 3))

print(tf.square(a))

print(tf.sqrt(a))

tf.matmul(矩阵 1,矩阵 2)

矩阵相乘

a = tf.ones([3, 2])

b = tf.fill([2, 3], 3.)

print(tf.matmul(a, b))

a为一个 3 行 2 列的全 1 矩阵,b 为 2 行 3 列的全 3 矩阵,二者进行矩阵相乘。

tf.data.Dataset.from_tensor_slices((输入特征, 标签))