Qt 通过ffmpeg获取视频预览图(windows下)

文章目录

- 一、 搭建ffmpeg开发环境

-

- 1. 下载ffmpeg shared库

- 2. 设置环境变量

- 二、qtCreator 集成ffmpeg

- 三、实现视频预览,完整demo如下

-

- 在线地址和本地文件均可

- 刚开始报错 FFmpeg: avcodec_send_packet() -1094995529

一、 搭建ffmpeg开发环境

1. 下载ffmpeg shared库

很早之前用过一段时间的ffmpeg,主要参考的雷神的博客,现在回过头搭建下开发环境,发现都不一样了,这里记录下环境搭建过程。

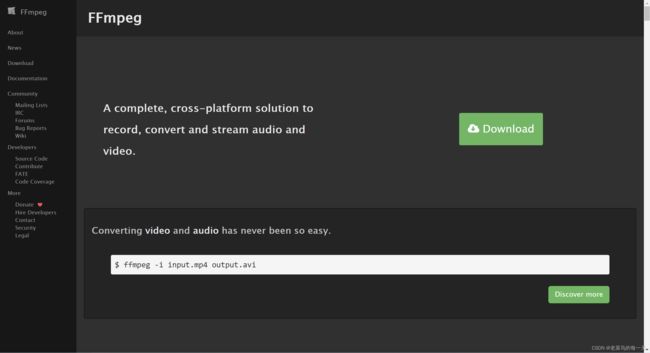

官网:https://www.ffmpeg.org/

github地址:https://github.com/FFmpeg/FFmpeg

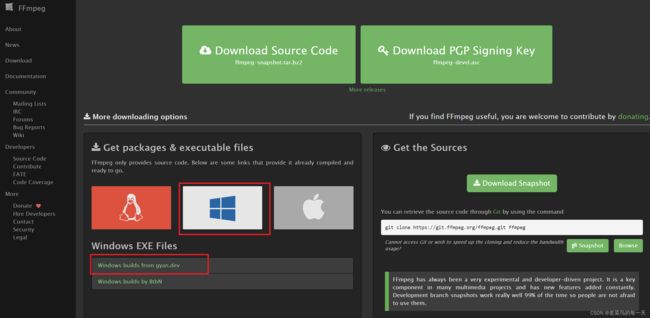

打开官网:

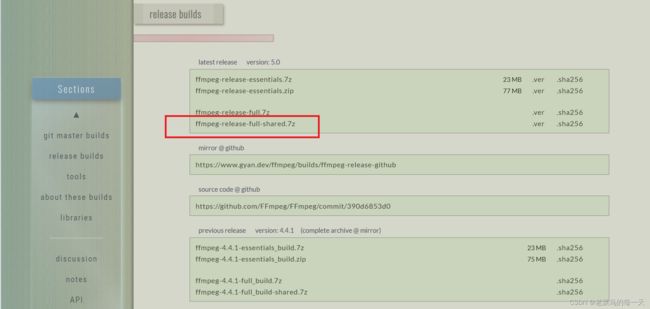

点击Download,本文选择windows下的 Windows builds from gyan.dev

然后选择release builds下面的 ffmpeg-release-full-shared.7z下载

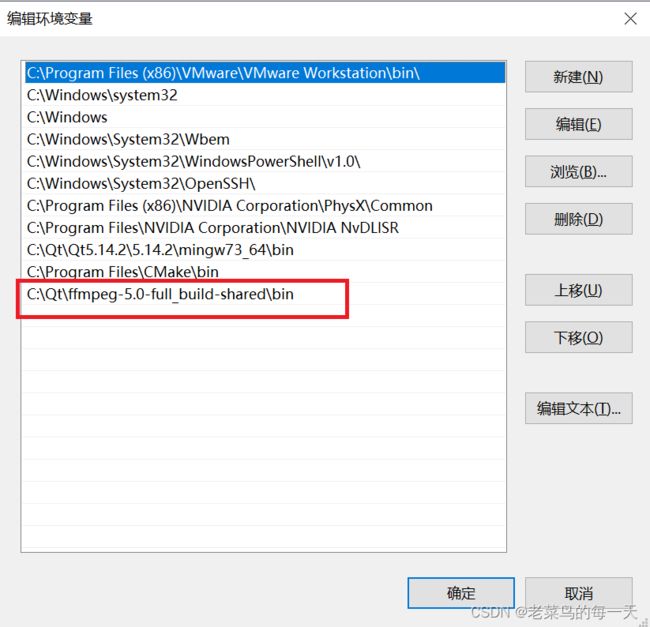

2. 设置环境变量

二、qtCreator 集成ffmpeg

新建工程,在pro文件中加入:

QT += core gui

greaterThan(QT_MAJOR_VERSION, 4): QT += widgets

CONFIG += c++11

DEFINES += QT_DEPRECATED_WARNINGS

SOURCES += \

main.cpp \

mainwindow.cpp

HEADERS += \

mainwindow.h

FORMS += \

mainwindow.ui

qnx: target.path = /tmp/$${TARGET}/bin

else: unix:!android: target.path = /opt/$${TARGET}/bin

!isEmpty(target.path): INSTALLS += target

INCLUDEPATH += "C:/Qt/ffmpeg-5.0-full_build-shared/include"

LIBS += -LC:/Qt/ffmpeg-5.0-full_build-shared/lib -lavutil -lavformat -lavcodec -lavfilter -lswscale -lswresample

注意自己的库路径

代码中加入

extern "C" {

#include 三、实现视频预览,完整demo如下

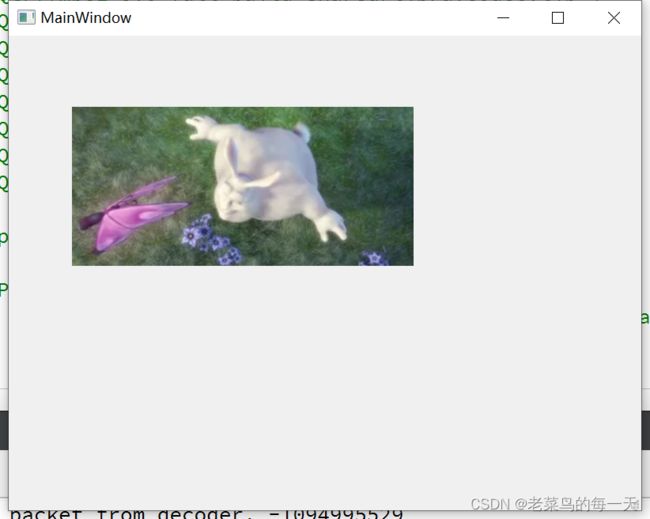

在线地址和本地文件均可

附上在线测试地址:http://www.w3school.com.cn/example/html5/mov_bbb.mp4

main.cpp

#include "mainwindow.h"

#include MainWindow.h

#ifndef MAINWINDOW_H

#define MAINWINDOW_H

#include mainwindow.cpp

#include "mainwindow.h"

#include "ui_mainwindow.h"

#include 刚开始报错 FFmpeg: avcodec_send_packet() -1094995529

解决方法

调用 int av_read_frame(AVFormatContext *s, AVPacket *pkt) 函数 时,将会读取一帧数据并填充到AVPacket里面,但是读取的这帧数据可能是视频也可能是音频,也可能是字幕,具体是什么类型可以通过 AVPacket对象的 stream_index 属性来判断,因此在读取完一帧数据后,调用 avcodec_send_packet(inputCodecCtx, inputPacket) 函数将这帧数据发送到解码队列之前,一定要确保这帧数据(AVPacket)的类型与 解码器上下文的类型保持一致!

也就是说你AVPacket中的stream_index对应的是音频流数据,那你在调用avcodec_send_packet()函数时,第二个参数传入的必须是一个音频解码器上下文,只有这样send packet才有可能成功。