opencv及图像基本处理

图像处理

学习目标

- 了解图像的起源

- 知道数字图像的表示

1 图像的起源

1.1 图像是什么

图像是人类视觉的基础,是自然景物的客观反映,是人类认识世界和人类本身的重要源泉。“图”是物体反射或透射光的分布,“像“是人的视觉系统所接受的图在人脑中所形版的印象或认识,照片、绘画、剪贴画、地图、书法作品、手写汉学、传真、卫星云图、影视画面、X光片、脑电图、心电图等都是图像

1.2 模拟图像和数字图像

图像起源于1826年前后法国科学家Joseph Nicéphore Niépce发明的第一张可永久保存的照片,属于模拟图像。模拟图像又称连续图像,它通过某种物理量(如光、电等)的强弱变化来记录图像亮度信息,所以是连续变换的。模拟信号的特点是容易受干扰,如今已经基本全面被数字图像替代。

在第一次世界大战后,1921年美国科学家发明了Bartlane System,并从伦敦传到纽约传输了第一幅数字图像,其亮度用离散数值表示,将图片编码成5个灰度级,如下图所示,通过海底电缆进行传输。在发送端图片被编码并使用打孔带记录,通过系统传输后在接收方使用特殊的打印机恢复成图像。

1950年左右,计算机被发明,数字图像处理学科正式诞生。

模拟图像和数字图像的对比,我们可以看一下:

2 数字图像的表示

2.1 位数

计算机采用0/1编码的系统,数字图像也是利用0/1来记录信息,我们平常接触的图像都是8位数图像,包含0~255灰度,其中0,代表最黑,1,表示最白。

人眼对灰度更敏感一些,在16位到32位之间。

2.2 图像的分类

二值图像:

一幅二值图像的二维矩阵仅由0、1两个值构成,“0”代表黑色,“1”代白色。由于每一像素(矩阵中每一元素)取值仅有0、1两种可能,所以计算机中二值图像的数据类型通常为1个二进制位。二值图像通常用于文字、线条图的扫描识别(OCR)和掩膜图像的存储。

灰度图:

每个像素只有一个采样颜色的图像,这类图像通常显示为从最暗黑色到最亮的白色的灰度,尽管理论上这个采样可以任何颜色的不同深浅,甚至可以是不同亮度上的不同颜色。灰度图像与黑白图像不同,在计算机图像领域中黑白图像只有黑色与白色两种颜色;但是,灰度图像在黑色与白色之间还有许多级的颜色深度。灰度图像经常是在单个电磁波频谱如可见光内测量每个像素的亮度得到的,用于显示的灰度图像通常用每个采样像素8位的非线性尺度来保存,这样可以有256级灰度(如果用16位,则有65536级)。

彩色图:

每个像素通常是由红(R)、绿(G)、蓝(B)三个分量来表示的,分量介于(0,255)。RGB图像与索引图像一样都可以用来表示彩色图像。与索引图像一样,它分别用红(R)、绿(G)、蓝(B)三原色的组合来表示每个像素的颜色。但与索引图像不同的是,RGB图像每一个像素的颜色值(由RGB三原色表示)直接存放在图像矩阵中,由于每一像素的颜色需由R、G、B三个分量来表示,M、N分别表示图像的行列数,三个M x N的二维矩阵分别表示各个像素的R、G、B三个颜色分量。RGB图像的数据类型一般为8位无符号整形,通常用于表示和存放真彩色图像。

OpenCV简介

学习目标

-

了解OpenCV是什么

-

能够独立安装OpenCV

1 什么是OpenCV

1.1 OpenCV简介

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-5JvWY6hG-1644207820561)(assets/Snipaste_2019-09-23_16-41-04.png)]

OpenCV是一款由Intel公司俄罗斯团队发起并参与和维护的一个计算机视觉处理开源软件库,支持与计算机视觉和机器学习相关的众多算法,并且正在日益扩展。

OpenCV的优势:

-

编程语言

OpenCV基于C++实现,同时提供python, Ruby, Matlab等语言的接口。OpenCV-Python是OpenCV的Python API,结合了OpenCV C++ API和Python语言的最佳特性。

-

跨平台

可以在不同的系统平台上使用,包括Windows,Linux,OS X,Android和iOS。基于CUDA和OpenCL的高速GPU操作接口也在积极开发中

-

活跃的开发团队

-

丰富的API

完善的传统计算机视觉算法,涵盖主流的机器学习算法,同时添加了对深度学习的支持。

1.2 OpenCV-Python

OpenCV-Python是一个Python绑定库,旨在解决计算机视觉问题。

Python是一种由Guido van Rossum开发的通用编程语言,它很快就变得非常流行,主要是因为它的简单性和代码可读性。它使程序员能够用更少的代码行表达思想,而不会降低可读性。

与C / C++等语言相比,Python速度较慢。也就是说,Python可以使用C / C++轻松扩展,这使我们可以在C / C++中编写计算密集型代码,并创建可用作Python模块的Python包装器。这给我们带来了两个好处:首先,代码与原始C / C++代码一样快(因为它是在后台工作的实际C++代码),其次,在Python中编写代码比使用C / C++更容易。OpenCV-Python是原始OpenCV C++实现的Python包装器。

OpenCV-Python使用Numpy,这是一个高度优化的数据库操作库,具有MATLAB风格的语法。所有OpenCV数组结构都转换为Numpy数组。这也使得与使用Numpy的其他库(如SciPy和Matplotlib)集成更容易。

2 OpenCV部署方法

安装OpenCV之前需要先安装numpy, matplotlib。

创建Python虚拟环境cv, 在cv中安装即可。

先安装OpenCV-Python, 由于一些经典的算法被申请了版权,新版本有很大的限制,所以选用3.4.3以下的版本

pip install opencv-python==3.4.2.17

OpenCV的模块

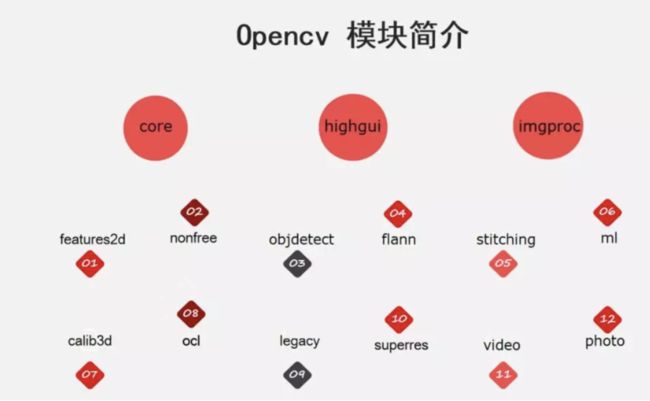

1 OpenCV的模块

下图列出了OpenCV中包含的各个模块:

其中core、highgui、imgproc是最基础的模块,该课程主要是围绕这几个模块展开的,分别介绍如下:

- core模块实现了最核心的数据结构及其基本运算,如绘图函数、数组操作相关函数等。

- highgui模块实现了视频与图像的读取、显示、存储等接口。

- imgproc模块实现了图像处理的基础方法,包括图像滤波、图像的几何变换、平滑、阈值分割、形态学处理、边缘检测、目标检测、运动分析和对象跟踪等。

对于图像处理其他更高层次的方向及应用,OpenCV也有相关的模块实现

- features2d模块用于提取图像特征以及特征匹配,nonfree模块实现了一些专利算法,如sift特征。

- objdetect模块实现了一些目标检测的功能,经典的基于Haar、LBP特征的人脸检测,基于HOG的行人、汽车等目标检测,分类器使用Cascade Classification(级联分类)和Latent SVM等。

- stitching模块实现了图像拼接功能。

- FLANN模块(Fast Library for Approximate Nearest Neighbors),包含快速近似最近邻搜索FLANN

和聚类Clustering算法。 - ml模块机器学习模块(SVM,决策树,Boosting等等)。

- photo模块包含图像修复和图像去噪两部分。

- video模块针对视频处理,如背景分离,前景检测、对象跟踪等。

- calib3d模块即Calibration(校准)3D,这个模块主要是相机校准和三维重建相关的内容。包含了基本的多视角几何算法,单个立体摄像头标定,物体姿态估计,立体相似性算法,3D信息的重建等等。

- G-API模块包含超高效的图像处理pipeline引擎

图像的基础操作

学习目标

-

掌握图像的读取和保存方法

-

能够使用OpenCV在图像上绘制几何图形

-

能够访问图像的像素

-

能够获取图像的属性,并进行通道的分离和合并

-

能够实现颜色空间的变换

1 图像的IO操作

这里我们会给大家介绍如何读取图像,如何显示图像和如何保存图像。

1.1 读取图像

- API

import cv2 as cv

cv.imread()

参数:

-

要读取的图像

-

读取方式的标志

-

cv.IMREAD*COLOR:以彩色模式加载图像,任何图像的透明度都将被忽略。这是默认参数。

-

cv.IMREAD*GRAYSCALE:以灰度模式加载图像

-

cv.IMREAD_UNCHANGED:包括alpha通道的加载图像模式。

可以使用1、0或者-1来替代上面三个标志

-

-

参考代码

import numpy as np import cv2 as cv # 以灰度图的形式读取图像 img = cv.imread('messi5.jpg',0)

注意:如果加载的路径有错误,不会报错,会返回一个None值

1.2显示图像

1 . API

cv.imshow()

参数:

- 显示图像的窗口名称,以字符串类型表示

- 要加载的图像

注意:在调用显示图像的API后,要调用cv.waitKey()给图像绘制留下时间,否则窗口会出现无响应情况,并且图像无法显示出来。

另外我们也可使用matplotlib对图像进行展示。

-

参考代码

# opencv中显示 cv.imshow('image',img) cv.waitKey(0) # matplotlib中展示 plt.imshow(img[:,:,::-1])

1.3 保存图像

-

API

cv.imwrite()参数:

- 文件名,要保存在哪里

- 要保存的图像

-

参考代码

cv.imwrite('messigray.png',img)1.4 总结

我们通过加载灰度图像,显示图像,如果按’s’并退出则保存图像,或者按ESC键直接退出而不保存。

import cv2 # 1 读取图像 0是灰度, 1是彩色 img = cv2.imread("test3.jpg", 1) # 2 显示图像 cv2.imshow("dili",img) cv2.waitKey(0) cv2.destroyAllWindows() # # 3 图像保存 cv2.imwrite('zhangrtianai.png',img)

2 绘制几何图形

2.1 绘制直线

cv.line(img,start,end,color,thickness)

参数:

- img:要绘制直线的图像

- Start,end: 直线的起点和终点

- color: 线条的颜色

- Thickness: 线条宽度

2.2 绘制圆形

cv.circle(img,centerpoint, r, color, thickness)

参数:

- img:要绘制圆形的图像

- Centerpoint, r: 圆心和半径

- color: 线条的颜色

- Thickness: 线条宽度,为-1时生成闭合图案并填充颜色

2.3 绘制矩形

cv.rectangle(img,leftupper,rightdown,color,thickness)

参数:

- img:要绘制矩形的图像

- Leftupper, rightdown: 矩形的左上角和右下角坐标

- color: 线条的颜色

- Thickness: 线条宽度

2.4 向图像中添加文字

cv.putText(img,text,station, font, fontsize,color,thickness,cv.LINE_AA)

参数:

- img: 图像

- text:要写入的文本数据

- station:文本的放置位置

- font:字体

- Fontsize :字体大小

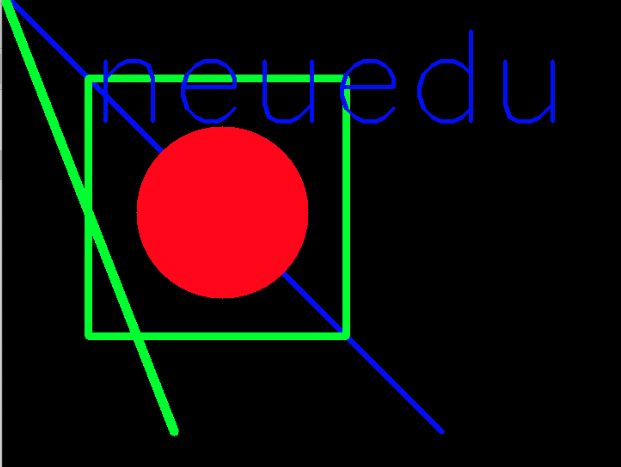

2.5 效果展示

我们生成一个全黑的图像,然后在里面绘制图像并添加文字

import numpy as np

import cv2

img = np.zeros((1511, 1511, 3), np.uint8)

# 绘制直线 bgr

cv2.line(img, (0, 0), (511, 511), (255, 0, 0), 5)

cv2.line(img, (0, 0), (200, 511), (0, 255, 0), 10)

# 绘制圆形

cv2.circle(img, (256, 256), 100, (0, 0, 255), -1)

# 绘制矩形

cv2.rectangle(img, (100, 100), (400, 400),(0, 255, 0), 8 )

# 绘制文字

cv2.putText(img, "neuedu", (100, 150), cv2.FONT_HERSHEY_SIMPLEX,5,(255, 0, 0), 3 )

cv2.putText

cv2.imshow('huizhi', img)

cv2.waitKey(0)

cv2.destroyAllWindows()

3 获取并修改图像中的像素点

我们可以通过行和列的坐标值获取该像素点的像素值。对于BGR图像,它返回一个蓝,绿,红值的数组。对于灰度图像,仅返回相应的强度值。使用相同的方法对像素值进行修改。

import numpy as np

import cv2 as cv

img = cv.imread('messi5.jpg')

# 获取某个像素点的值

px = img[100,100]

# 仅获取蓝色通道的强度值

blue = img[100,100,0]

# 修改某个位置的像素值

img[100,100] = [255,255,255]

4 获取图像的属性

图像属性包括行数,列数和通道数,图像数据类型,像素数等。

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-N1FASObH-1644206481490)(assets/image-20191016151042764.png)]

5 图像通道的拆分与合并

有时需要在B,G,R通道图像上单独工作。在这种情况下,需要将BGR图像分割为单个通道。或者在其他情况下,可能需要将这些单独的通道合并到BGR图像。你可以通过以下方式完成。

# 通道拆分

b,g,r = cv.split(img)

# 通道合并

img = cv.merge((b,g,r))

6 色彩空间的改变

OpenCV中有150多种颜色空间转换方法。最广泛使用的转换方法有两种,BGR↔Gray和BGR↔HSV。

API:

cv.cvtColor(input_image,flag)

参数:

- input_image: 进行颜色空间转换的图像

- flag: 转换类型

- cv.COLOR_BGR2GRAY : BGR↔Gray

- cv.COLOR_BGR2HSV: BGR→HSV

算数操作

学习目标

- 了解图像的加法、混合操作

1.图像的加法

你可以使用OpenCV的cv.add()函数把两幅图像相加,或者可以简单地通过numpy操作添加两个图像,如res = img1 + img2。两个图像应该具有相同的大小和类型,或者第二个图像可以是标量值。

注意:OpenCV加法和Numpy加法之间存在差异。OpenCV的加法是饱和操作,而Numpy添加是模运算。

参考以下代码:

>>> x = np.uint8([250])

>>> y = np.uint8([10])

>>> print( cv.add(x,y) ) # 250+10 = 260 => 255

[[255]]

>>> print( x+y ) # 250+10 = 260 % 256 = 4

[4]

这种差别在你对两幅图像进行加法时会更加明显。OpenCV 的结果会更好一点。所以我们尽量使用 OpenCV 中的函数。

我们将下面两幅图像:

代码:

import numpy as np

import cv2 as cv

import matplotlib.pyplot as plt

# 1 读取图像

img1 = cv.imread("view.jpg")

img2 = cv.imread("rain.jpg")

# 2 加法操作

img3 = cv.add(img1,img2) # cv中的加法

img4 = img1+img2 # 直接相加

# 3 图像显示

fig,axes=plt.subplots(nrows=1,ncols=2,figsize=(10,8),dpi=100)

axes[0].imshow(img3[:,:,::-1])

axes[0].set_title("cv中的加法")

axes[1].imshow(img4[:,:,::-1])

axes[1].set_title("直接相加")

plt.show()

结果如下所示:

2.图像的混合

这其实也是加法,但是不同的是两幅图像的权重不同,这就会给人一种混合或者透明的感觉。图像混合的计算公式如下:

g(x) = (1−α)f0(x) + αf1(x)

通过修改 α 的值(0 → 1),可以实现非常炫酷的混合。

现在我们把两幅图混合在一起。第一幅图的权重是0.7,第二幅图的权重是0.3。函数cv2.addWeighted()可以按下面的公式对图片进行混合操作。

dst = α⋅img1 + β⋅img2 + γ

这里γ取为零。

参考以下代码:

import numpy as np

import cv2 as cv

import matplotlib.pyplot as plt

# 1 读取图像

img1 = cv.imread("view.jpg")

img2 = cv.imread("rain.jpg")

# 2 图像混合

img3 = cv.addWeighted(img1,0.7,img2,0.3,0)

# 3 图像显示

plt.figure(figsize=(8,8))

plt.imshow(img3[:,:,::-1])

plt.show()

窗口将如下图显示:

视频读写

1 从文件中读取视频并播放

在OpenCV中我们要获取一个视频,需要创建一个VideoCapture对象,指定你要读取的视频文件:

-

创建读取视频的对象

cap = cv.VideoCapture(filepath)参数:

- filepath: 视频文件路径

-

视频的属性信息

2.1. 获取视频的某些属性,

retval = cap.get(propId)参数:

-

propId: 从0到18的数字,每个数字表示视频的属性

常用属性有:

2.2 修改视频的属性信息

-

cap.set(propId,value)

参数:

- proid: 属性的索引,与上面的表格相对应

- value: 修改后的属性值

3. 判断图像是否读取成功

```python

isornot = cap.isOpened()

- 若读取成功则返回true,否则返回False

-

获取视频的一帧图像

ret, frame = cap.read()参数:

- ret: 若获取成功返回True,获取失败,返回False

- Frame: 获取到的某一帧的图像

-

调用cv.imshow()显示图像,在显示图像时使用cv.waitkey()设置适当的持续时间,如果太低视频会播放的非常快,如果太高就会播放的非常慢,通常情况下我们设置25ms就可以了。

-

最后,调用cap.realease()将视频释放掉

示例:

import numpy as np

import cv2 as cv

# 1.获取视频对象

cap = cv.VideoCapture('DOG.wmv')

# 2.判断是否读取成功

while(cap.isOpened()):

# 3.获取每一帧图像

ret, frame = cap.read()

# 4. 获取成功显示图像

if ret == True:

cv.imshow('frame',frame)

# 5.每一帧间隔为25ms

if cv.waitKey(25) & 0xFF == ord('q'):

break

# 6.释放视频对象

cap.release()

cv.destoryAllwindows()

2 保存视频

在OpenCV中我们保存视频使用的是VedioWriter对象,在其中指定输出文件的名称,如下所示:

- 创建视频写入的对象

out = cv2.VideoWriter(filename,fourcc, fps, frameSize)

参数:

- filename:视频保存的位置

- fourcc:指定视频编解码器的4字节代码

- fps:帧率

- frameSize:帧大小

-

设置视频的编解码器,如下所示,

retval = cv2.VideoWriter_fourcc( c1, c2, c3, c4 )参数:

-

c1,c2,c3,c4: 是视频编解码器的4字节代码,在fourcc.org中找到可用代码列表,与平台紧密相关,常用的有:

在Windows中:DIVX(.avi)

在OS中:MJPG(.mp4),DIVX(.avi),X264(.mkv)。

-

-

利用cap.read()获取视频中的每一帧图像,并使用out.write()将某一帧图像写入视频中。

-

使用cap.release()和out.release()释放资源。

示例:

import cv2 as cv

import numpy as np

# 1. 读取视频

cap = cv.VideoCapture("DOG.wmv")

# 2. 获取图像的属性(宽和高,),并将其转换为整数

frame_width = int(cap.get(3))

frame_height = int(cap.get(4))

# 3. 创建保存视频的对象,设置编码格式,帧率,图像的宽高等

out = cv.VideoWriter('outpy.avi',cv.VideoWriter_fourcc('M','J','P','G'), 10, (frame_width,frame_height))

while(True):

# 4.获取视频中的每一帧图像

ret, frame = cap.read()

if ret == True:

# 5.将每一帧图像写入到输出文件中

out.write(frame)

else:

break

# 6.释放资源

cap.release()

out.release()

cv.destroyAllWindows()

案例:人脸案例

1 基础

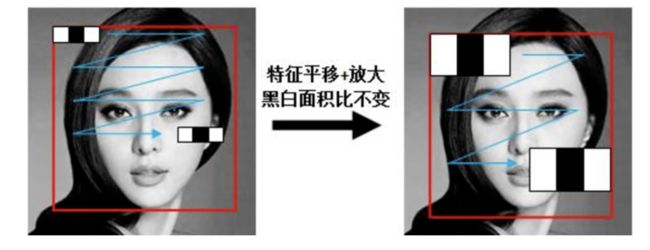

我们使用机器学习的方法完成人脸检测,首先需要大量的正样本图像(面部图像)和负样本图像(不含面部的图像)来训练分类器。我们需要从其中提取特征。下图中的 Haar 特征会被使用,就像我们的卷积核,每一个特征是一 个值,这个值等于黑色矩形中的像素值之后减去白色矩形中的像素值之和。

Haar特征值反映了图像的灰度变化情况。例如:脸部的一些特征能由矩形特征简单的描述,眼睛要比脸颊颜色要深,鼻梁两侧比鼻梁颜色要深,嘴巴比周围颜色要深等。

Haar特征可用于于图像任意位置,大小也可以任意改变,所以矩形特征值是矩形模版类别、矩形位置和矩形大小这三个因素的函数。故类别、大小和位置的变化,使得很小的检测窗口含有非常多的矩形特征。

在这里插入图片描述

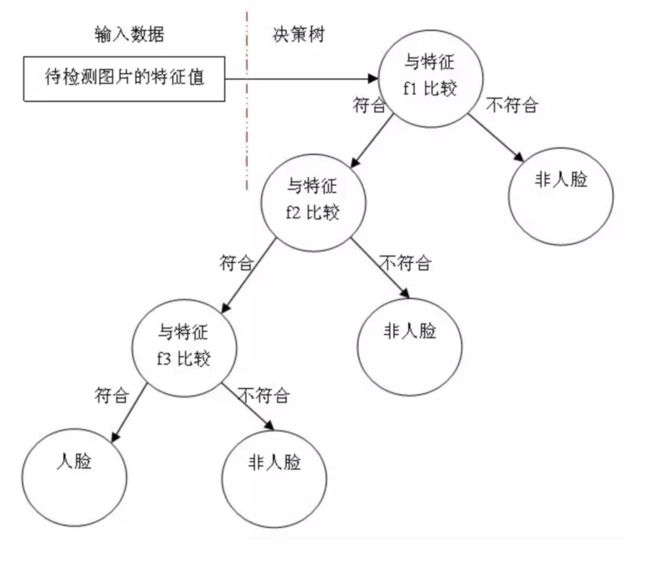

得到图像的特征后,训练一个决策树构建的adaboost级联决策器来识别是否为人脸。

2.实现

OpenCV中自带已训练好的检测器,包括面部,眼睛,猫脸等,都保存在XML文件中,我们可以通过以下程序找到他们:

import cv2 as cv

print(cv.__file__)

找到的文件如下所示:

那我们就利用这些文件来识别人脸,眼睛等。检测流程如下:

-

读取图片,并转换成灰度图

-

实例化人脸和眼睛检测的分类器对象

# 实例化级联分类器 classifier =cv.CascadeClassifier( "haarcascade_frontalface_default.xml" ) # 加载分类器 classifier.load('haarcascade_frontalface_default.xml') -

进行人脸和眼睛的检测

rect = classifier.detectMultiScale(gray, scaleFactor, minNeighbors, minSize,maxsize)参数:

- Gray: 要进行检测的人脸图像

- scaleFactor: 前后两次扫描中,搜索窗口的比例系数

- minneighbors:目标至少被检测到minNeighbors次才会被认为是目标

- minsize和maxsize: 目标的最小尺寸和最大尺寸

-

将检测结果绘制出来就可以了。

主程序如下所示:

import cv2 as cv

import matplotlib.pyplot as plt

# 1.以灰度图的形式读取图片

img = cv.imread("16.jpg")

gray = cv.cvtColor(img,cv.COLOR_BGR2GRAY)

# 2.实例化OpenCV人脸和眼睛识别的分类器

face_cas = cv.CascadeClassifier( "haarcascade_frontalface_default.xml" )

face_cas.load('haarcascade_frontalface_default.xml')

eyes_cas = cv.CascadeClassifier("haarcascade_eye.xml")

eyes_cas.load("haarcascade_eye.xml")

# 3.调用识别人脸

faceRects = face_cas.detectMultiScale( gray, scaleFactor=1.2, minNeighbors=3, minSize=(32, 32))

for faceRect in faceRects:

x, y, w, h = faceRect

# 框出人脸

cv.rectangle(img, (x, y), (x + h, y + w),(0,255,0), 3)

# 4.在识别出的人脸中进行眼睛的检测

roi_color = img[y:y+h, x:x+w]

roi_gray = gray[y:y+h, x:x+w]

eyes = eyes_cas.detectMultiScale(roi_gray)

for (ex,ey,ew,eh) in eyes:

cv.rectangle(roi_color,(ex,ey),(ex+ew,ey+eh),(0,255,0),2)

# 5. 检测结果的绘制

plt.figure(figsize=(8,6),dpi=100)

plt.imshow(img[:,:,::-1]),plt.title('检测结果')

plt.xticks([]), plt.yticks([])

plt.show()

结果:

我们也可在视频中对人脸进行检测:

import cv2 as cv

import matplotlib.pyplot as plt

# 1.读取视频

cap = cv.VideoCapture("movie.mp4")

# 2.在每一帧数据中进行人脸识别

while(cap.isOpened()):

ret, frame = cap.read()

if ret==True:

gray = cv.cvtColor(frame, cv.COLOR_BGR2GRAY)

# 3.实例化OpenCV人脸识别的分类器

face_cas = cv.CascadeClassifier( "haarcascade_frontalface_default.xml" )

face_cas.load('haarcascade_frontalface_default.xml')

# 4.调用识别人脸

faceRects = face_cas.detectMultiScale(gray, scaleFactor=1.2, minNeighbors=3, minSize=(32, 32))

for faceRect in faceRects:

x, y, w, h = faceRect

# 框出人脸

cv.rectangle(frame, (x, y), (x + h, y + w),(0,255,0), 3)

cv.imshow("frame",frame)

if cv.waitKey(1) & 0xFF == ord('q'):

break

# 5. 释放资源

cap.release()

cv.destroyAllWindows()