睿智的目标检测61——Keras搭建YoloV7目标检测平台

睿智的目标检测61——Keras搭建YoloV7目标检测平台

- 学习前言

- 源码下载

- YoloV7改进的部分(不完全)

- YoloV7实现思路

-

- 一、整体结构解析

- 二、网络结构解析

-

- 1、主干网络Backbone介绍

- 2、构建FPN特征金字塔进行加强特征提取

- 3、利用Yolo Head获得预测结果

- 三、预测结果的解码

-

- 1、获得预测框与得分

- 2、得分筛选与非极大抑制

- 四、训练部分

-

- 1、计算loss所需内容

- 2、正样本的匹配过程

-

- a、匹配先验框与特征点

- b、SimOTA自适应匹配

- 3、计算Loss

- 训练自己的YoloV7模型

-

- 一、数据集的准备

- 二、数据集的处理

- 三、开始网络训练

- 四、训练结果预测

学习前言

Keras也复现一下,SimOTA的复现太痛苦的。

![]()

源码下载

https://github.com/bubbliiiing/yolov7-keras

喜欢的可以点个star噢。

YoloV7改进的部分(不完全)

1、主干部分:使用了创新的多分支堆叠结构进行特征提取,相比以前的Yolo,模型的跳连接结构更加的密集。使用了创新的下采样结构,使用Maxpooling和步长为2x2的特征并行进行提取与压缩。

2、加强特征提取部分:同主干部分,加强特征提取部分也使用了多输入堆叠结构进行特征提取,使用Maxpooling和步长为2x2的特征并行进行下采样。

3、特殊的SPP结构:使用了具有CSP机构的SPP扩大感受野,在SPP结构中引入了CSP结构,该模块具有一个大的残差边辅助优化与特征提取。

4、自适应多正样本匹配:在YoloV5之前的Yolo系列里面,在训练时每一个真实框对应一个正样本,即在训练时,每一个真实框仅由一个先验框负责预测。YoloV7中为了加快模型的训练效率,增加了正样本的数量,在训练时,每一个真实框可以由多个先验框负责预测。除此之外,对于每个真实框,还会根据先验框调整后的预测框进行iou与种类的计算,获得cost,进而找到最适合该真实框的先验框。

5、借鉴了RepVGG的结构,在网络的特定部分引入RepConv,fuse后在保证网络x减少网络的参数量

6、使用了辅助分支辅助收敛,但是在模型较小的YoloV7和YoloV7-X中并没有使用。

以上并非全部的改进部分,还存在一些其它的改进,这里只列出来了一些我比较感兴趣,而且非常有效的改进。

YoloV7实现思路

一、整体结构解析

![]()

在学习YoloV7之前,我们需要对YoloV7所作的工作有一定的了解,这有助于我们后面去了解网络的细节,YoloV7在预测方式上与之前的Yolo并没有多大的差别,依然分为三个部分。

分别是Backbone,FPN以及Yolo Head。

Backbone是YoloV7的主干特征提取网络,输入的图片首先会在主干网络里面进行特征提取,提取到的特征可以被称作特征层,是输入图片的特征集合。在主干部分,我们获取了三个特征层进行下一步网络的构建,这三个特征层我称它为有效特征层。

FPN是YoloV7的加强特征提取网络,在主干部分获得的三个有效特征层会在这一部分进行特征融合,特征融合的目的是结合不同尺度的特征信息。在FPN部分,已经获得的有效特征层被用于继续提取特征。在YoloV7里依然使用到了Panet的结构,我们不仅会对特征进行上采样实现特征融合,还会对特征再次进行下采样实现特征融合。

Yolo Head是YoloV7的分类器与回归器,通过Backbone和FPN,我们已经可以获得三个加强过的有效特征层。每一个特征层都有宽、高和通道数,此时我们可以将特征图看作一个又一个特征点的集合,每个特征点上有三个先验框,每一个先验框都有通道数个特征。Yolo Head实际上所做的工作就是对特征点进行判断,判断特征点上的先验框是否有物体与其对应。与以前版本的Yolo一样,YoloV7所用的解耦头是一起的,也就是分类和回归在一个1X1卷积里实现。

因此,整个YoloV7网络所作的工作就是 特征提取-特征加强-预测先验框对应的物体情况。

二、网络结构解析

1、主干网络Backbone介绍

![]()

YoloV7所使用的主干特征提取网络具有两个重要特点:

1、使用了多分支堆叠模块,这个模块其实论文里没有命名,但是我在分析源码后认为这个名字非常合适,在本博文中,多分支堆叠模块如图所示。

看了这幅图大家应该明白为什么我把这个模块称为多分支堆叠模块,因为在该模块中,最终堆叠模块的输入包含多个分支,左一为一个卷积标准化激活函数,左二为一个卷积标准化激活函数,右二为三个卷积标准化激活函数,右一为五个卷积标准化激活函数。

四个特征层在堆叠后会再次进行一个卷积标准化激活函数来特征整合。

![]()

def Multi_Concat_Block(x, c2, c3, n=4, e=1, ids=[0], name = ""):

c_ = int(c2 * e)

x_1 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv1')(x)

x_2 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv2')(x)

x_all = [x_1, x_2]

for i in range(n):

x_2 = DarknetConv2D_BN_SiLU(c2, (3, 3), name = name + '.cv3.' + str(i))(x_2)

x_all.append(x_2)

y = Concatenate(axis=-1)([x_all[id] for id in ids])

y = DarknetConv2D_BN_SiLU(c3, (1, 1), name = name + '.cv4')(y)

return y

如此多的堆叠其实也对应了更密集的残差结构,残差网络的特点是容易优化,并且能够通过增加相当的深度来提高准确率。其内部的残差块使用了跳跃连接,缓解了在深度神经网络中增加深度带来的梯度消失问题。

2、使用创新的过渡模块Transition_Block来进行下采样,在卷积神经网络中,常见的用于下采样的过渡模块是一个卷积核大小为3x3、步长为2x2的卷积或者一个步长为2x2的最大池化。在YoloV7中,作者将两种过渡模块进行了集合,一个过渡模块存在两个分支,如图所示。左分支是一个步长为2x2的最大池化+一个1x1卷积,右分支是一个1x1卷积+一个卷积核大小为3x3、步长为2x2的卷积,两个分支的结果在输出时会进行堆叠。

![]()

def Transition_Block(x, c2, name = ""):

#----------------------------------------------------------------#

# 利用ZeroPadding2D和一个步长为2x2的卷积块进行高和宽的压缩

#----------------------------------------------------------------#

x_1 = MaxPooling2D((2, 2), strides=(2, 2))(x)

x_1 = DarknetConv2D_BN_SiLU(c2, (1, 1), name = name + '.cv1')(x_1)

x_2 = DarknetConv2D_BN_SiLU(c2, (1, 1), name = name + '.cv2')(x)

x_2 = ZeroPadding2D(((1, 1),(1, 1)))(x_2)

x_2 = DarknetConv2D_BN_SiLU(c2, (3, 3), strides=(2, 2), name = name + '.cv3')(x_2)

y = Concatenate(axis=-1)([x_2, x_1])

return y

整个主干实现代码为:

from functools import wraps

from keras import backend as K

from keras.initializers import random_normal

from keras.layers import (BatchNormalization, Concatenate, Conv2D, Layer,

MaxPooling2D, ZeroPadding2D)

from utils.utils import compose

class SiLU(Layer):

def __init__(self, **kwargs):

super(SiLU, self).__init__(**kwargs)

self.supports_masking = True

def call(self, inputs):

return inputs * K.sigmoid(inputs)

def get_config(self):

config = super(SiLU, self).get_config()

return config

def compute_output_shape(self, input_shape):

return input_shape

#------------------------------------------------------#

# 单次卷积DarknetConv2D

# 如果步长为2则自己设定padding方式。

#------------------------------------------------------#

@wraps(Conv2D)

def DarknetConv2D(*args, **kwargs):

darknet_conv_kwargs = {'kernel_initializer' : random_normal(stddev=0.02)}

darknet_conv_kwargs['padding'] = 'valid' if kwargs.get('strides')==(2, 2) else 'same'

darknet_conv_kwargs.update(kwargs)

return Conv2D(*args, **darknet_conv_kwargs)

#---------------------------------------------------#

# 卷积块 -> 卷积 + 标准化 + 激活函数

# DarknetConv2D + BatchNormalization + SiLU

#---------------------------------------------------#

def DarknetConv2D_BN_SiLU(*args, **kwargs):

no_bias_kwargs = {'use_bias': False}

no_bias_kwargs.update(kwargs)

if "name" in kwargs.keys():

no_bias_kwargs['name'] = kwargs['name'] + '.conv'

return compose(

DarknetConv2D(*args, **no_bias_kwargs),

BatchNormalization(momentum = 0.97, epsilon = 0.001, name = kwargs['name'] + '.bn'),

SiLU())

def Transition_Block(x, c2, name = ""):

#----------------------------------------------------------------#

# 利用ZeroPadding2D和一个步长为2x2的卷积块进行高和宽的压缩

#----------------------------------------------------------------#

x_1 = MaxPooling2D((2, 2), strides=(2, 2))(x)

x_1 = DarknetConv2D_BN_SiLU(c2, (1, 1), name = name + '.cv1')(x_1)

x_2 = DarknetConv2D_BN_SiLU(c2, (1, 1), name = name + '.cv2')(x)

x_2 = ZeroPadding2D(((1, 1),(1, 1)))(x_2)

x_2 = DarknetConv2D_BN_SiLU(c2, (3, 3), strides=(2, 2), name = name + '.cv3')(x_2)

y = Concatenate(axis=-1)([x_2, x_1])

return y

def Multi_Concat_Block(x, c2, c3, n=4, e=1, ids=[0], name = ""):

c_ = int(c2 * e)

x_1 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv1')(x)

x_2 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv2')(x)

x_all = [x_1, x_2]

for i in range(n):

x_2 = DarknetConv2D_BN_SiLU(c2, (3, 3), name = name + '.cv3.' + str(i))(x_2)

x_all.append(x_2)

y = Concatenate(axis=-1)([x_all[id] for id in ids])

y = DarknetConv2D_BN_SiLU(c3, (1, 1), name = name + '.cv4')(y)

return y

#---------------------------------------------------#

# CSPdarknet的主体部分

# 输入为一张640x640x3的图片

# 输出为三个有效特征层

#---------------------------------------------------#

def darknet_body(x, transition_channels, block_channels, n, phi):

#-----------------------------------------------#

# 输入图片是640, 640, 3

#-----------------------------------------------#

ids = {

'l' : [-1, -3, -5, -6],

'x' : [-1, -3, -5, -7, -8],

}[phi]

#---------------------------------------------------#

# base_channels 默认值为64

#---------------------------------------------------#

# 320, 320, 3 => 320, 320, 64

x = DarknetConv2D_BN_SiLU(transition_channels, (3, 3), strides = (1, 1), name = 'backbone.stem.0')(x)

x = ZeroPadding2D(((1, 1),(1, 1)))(x)

x = DarknetConv2D_BN_SiLU(transition_channels * 2, (3, 3), strides = (2, 2), name = 'backbone.stem.1')(x)

x = DarknetConv2D_BN_SiLU(transition_channels * 2, (3, 3), strides = (1, 1), name = 'backbone.stem.2')(x)

# 320, 320, 64 => 160, 160, 128

x = ZeroPadding2D(((1, 1),(1, 1)))(x)

x = DarknetConv2D_BN_SiLU(transition_channels * 4, (3, 3), strides = (2, 2), name = 'backbone.dark2.0')(x)

x = Multi_Concat_Block(x, block_channels * 2, transition_channels * 8, n=n, ids=ids, name = 'backbone.dark2.1')

# 160, 160, 128 => 80, 80, 256

x = Transition_Block(x, transition_channels * 4, name = 'backbone.dark3.0')

x = Multi_Concat_Block(x, block_channels * 4, transition_channels * 16, n=n, ids=ids, name = 'backbone.dark3.1')

feat1 = x

# 80, 80, 256 => 40, 40, 512

x = Transition_Block(x, transition_channels * 8, name = 'backbone.dark4.0')

x = Multi_Concat_Block(x, block_channels * 8, transition_channels * 32, n=n, ids=ids, name = 'backbone.dark4.1')

feat2 = x

# 40, 40, 512 => 20, 20, 1024

x = Transition_Block(x, transition_channels * 16, name = 'backbone.dark5.0')

x = Multi_Concat_Block(x, block_channels * 8, transition_channels * 32, n=n, ids=ids, name = 'backbone.dark5.1')

feat3 = x

return feat1, feat2, feat3

2、构建FPN特征金字塔进行加强特征提取

![]()

在特征利用部分,YoloV7提取多特征层进行目标检测,一共提取三个特征层。

三个特征层位于主干部分的不同位置,分别位于中间层,中下层,底层,当输入为(640,640,3)的时候,三个特征层的shape分别为feat1=(80,80,256)、feat2=(40,40,512)、feat3=(20,20,1024)。

在获得三个有效特征层后,我们利用这三个有效特征层进行FPN层的构建,构建方式为(在本博文中,将SPPCSPC结构归于FPN中):

- feat3=(20,20,1024)的特征层首先利用SPPCSPC进行特征提取,该结构可以提高YoloV7的感受野,获得P5。

- 对P5先进行1次1X1卷积调整通道,然后进行上采样UmSampling2d后与feat2=(40,40,512)进行一次卷积后的特征层进行结合,然后使用Multi_Concat_Block进行特征提取获得P4,此时获得的特征层为(40,40,512)。

- 对P4先进行1次1X1卷积调整通道,然后进行上采样UmSampling2d后与feat1=(80,80,256)进行一次卷积后的特征层进行结合,然后使用Multi_Concat_Block进行特征提取获得P3_out,此时获得的特征层为(80,80,256)。

- P3_out=(80,80,256)的特征层进行一次Transition_Block卷积进行下采样,下采样后与P4堆叠,然后使用Multi_Concat_Block进行特征提取P4_out,此时获得的特征层为(40,40,512)。

- P4_out=(40,40,512)的特征层进行一次Transition_Block卷积进行下采样,下采样后与P5堆叠,然后使用Multi_Concat_Block进行特征提取P5_out,此时获得的特征层为(20,20,1024)。

特征金字塔可以将不同shape的特征层进行特征融合,有利于提取出更好的特征。

#---------------------------------------------------#

# Panet网络的构建,并且获得预测结果

#---------------------------------------------------#

def yolo_body(input_shape, anchors_mask, num_classes, phi, mode="train"):

#-----------------------------------------------#

# 定义了不同yolov7版本的参数

#-----------------------------------------------#

transition_channels = {'l' : 32, 'x' : 40}[phi]

block_channels = 32

panet_channels = {'l' : 32, 'x' : 64}[phi]

e = {'l' : 2, 'x' : 1}[phi]

n = {'l' : 4, 'x' : 6}[phi]

ids = {'l' : [-1, -2, -3, -4, -5, -6], 'x' : [-1, -3, -5, -7, -8]}[phi]

inputs = Input(input_shape)

#---------------------------------------------------#

# 生成主干模型,获得三个有效特征层,他们的shape分别是:

# 80, 80, 256

# 40, 40, 1024

# 20, 20, 1024

#---------------------------------------------------#

feat1, feat2, feat3 = darknet_body(inputs, transition_channels, block_channels, n, phi)

# 20, 20, 1024 -> 20, 20, 512

P5 = SPPCSPC(feat3, transition_channels * 16, name="sppcspc")

P5_conv = DarknetConv2D_BN_SiLU(transition_channels * 8, (1, 1), name="conv_for_P5")(P5)

P5_upsample = UpSampling2D()(P5_conv)

P4 = Concatenate(axis=-1)([DarknetConv2D_BN_SiLU(transition_channels * 8, (1, 1), name="conv_for_feat2")(feat2), P5_upsample])

P4 = Multi_Concat_Block(P4, panet_channels * 4, transition_channels * 8, e=e, n=n, ids=ids, name="conv3_for_upsample1")

P4_conv = DarknetConv2D_BN_SiLU(transition_channels * 4, (1, 1), name="conv_for_P4")(P4)

P4_upsample = UpSampling2D()(P4_conv)

P3 = Concatenate(axis=-1)([DarknetConv2D_BN_SiLU(transition_channels * 4, (1, 1), name="conv_for_feat1")(feat1), P4_upsample])

P3 = Multi_Concat_Block(P3, panet_channels * 2, transition_channels * 4, e=e, n=n, ids=ids, name="conv3_for_upsample2")

P3_downsample = Transition_Block(P3, transition_channels * 4, name="down_sample1")

P4 = Concatenate(axis=-1)([P3_downsample, P4])

P4 = Multi_Concat_Block(P4, panet_channels * 4, transition_channels * 8, e=e, n=n, ids=ids, name="conv3_for_downsample1")

P4_downsample = Transition_Block(P4, transition_channels * 8, name="down_sample2")

P5 = Concatenate(axis=-1)([P4_downsample, P5])

P5 = Multi_Concat_Block(P5, panet_channels * 8, transition_channels * 16, e=e, n=n, ids=ids, name="conv3_for_downsample2")

if phi == "l":

P3 = RepConv(P3, transition_channels * 8, mode, name="rep_conv_1")

P4 = RepConv(P4, transition_channels * 16, mode, name="rep_conv_2")

P5 = RepConv(P5, transition_channels * 32, mode, name="rep_conv_3")

else:

P3 = DarknetConv2D_BN_SiLU(transition_channels * 8, (3, 3), strides=(1, 1), name="rep_conv_1")(P3)

P4 = DarknetConv2D_BN_SiLU(transition_channels * 16, (3, 3), strides=(1, 1), name="rep_conv_2")(P4)

P5 = DarknetConv2D_BN_SiLU(transition_channels * 32, (3, 3), strides=(1, 1), name="rep_conv_3")(P5)

# len(anchors_mask[2]) = 3

# 5 + num_classes -> 4 + 1 + num_classes

# 4是先验框的回归系数,1是sigmoid将值固定到0-1,num_classes用于判断先验框是什么类别的物体

# bs, 20, 20, 3 * (4 + 1 + num_classes)

out2 = DarknetConv2D(len(anchors_mask[2]) * (5 + num_classes), (1, 1), strides = (1, 1), name = 'yolo_head_P3')(P3)

out1 = DarknetConv2D(len(anchors_mask[1]) * (5 + num_classes), (1, 1), strides = (1, 1), name = 'yolo_head_P4')(P4)

out0 = DarknetConv2D(len(anchors_mask[0]) * (5 + num_classes), (1, 1), strides = (1, 1), name = 'yolo_head_P5')(P5)

return Model(inputs, [out0, out1, out2])

3、利用Yolo Head获得预测结果

![]()

利用FPN特征金字塔,我们可以获得三个加强特征,这三个加强特征的shape分别为(20,20,1024)、(40,40,512)、(80,80,256),然后我们利用这三个shape的特征层传入Yolo Head获得预测结果。

与之前Yolo系列不同的是,YoloV7在Yolo Head前使用了一个RepConv的结构,这个RepConv的思想取自于RepVGG,基本思想就是在训练的时候引入特殊的残差结构辅助训练,这个残差结构是经过独特设计的,在实际预测的时候,可以将复杂的残差结构等效于一个普通的3x3卷积,这个时候网络的复杂度就下降了,但网络的预测性能却没有下降。

而对于每一个特征层,我们可以获得利用一个卷积调整通道数,最终的通道数和需要区分的种类个数相关,在YoloV7里,每一个特征层上每一个特征点存在3个先验框。

如果使用的是voc训练集,类则为20种,最后的维度应该为75 = 3x25,三个特征层的shape为(20,20,75),(40,40,75),(80,80,75)。

最后的75可以拆分成3个25,对应3个先验框的25个参数,25可以拆分成4+1+20。

前4个参数用于判断每一个特征点的回归参数,回归参数调整后可以获得预测框;

第5个参数用于判断每一个特征点是否包含物体;

最后20个参数用于判断每一个特征点所包含的物体种类。

如果使用的是coco训练集,类则为80种,最后的维度应该为255 = 3x85,三个特征层的shape为(20,20,255),(40,40,255),(80,80,255)

最后的255可以拆分成3个85,对应3个先验框的85个参数,85可以拆分成4+1+80。

前4个参数用于判断每一个特征点的回归参数,回归参数调整后可以获得预测框;

第5个参数用于判断每一个特征点是否包含物体;

最后80个参数用于判断每一个特征点所包含的物体种类。

实现代码如下:

def SPPCSPC(x, c2, n=1, shortcut=False, g=1, e=0.5, k=(5, 9, 13), name=""):

c_ = int(2 * c2 * e) # hidden channels

x1 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv1')(x)

x1 = DarknetConv2D_BN_SiLU(c_, (3, 3), name = name + '.cv3')(x1)

x1 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv4')(x1)

y1 = Concatenate(axis=-1)([x1] + [MaxPooling2D(pool_size=(m, m), strides=(1, 1), padding='same')(x1) for m in k])

y1 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv5')(y1)

y1 = DarknetConv2D_BN_SiLU(c_, (3, 3), name = name + '.cv6')(y1)

y2 = DarknetConv2D_BN_SiLU(c_, (1, 1), name = name + '.cv2')(x)

out = Concatenate(axis=-1)([y1, y2])

out = DarknetConv2D_BN_SiLU(c2, (1, 1), name = name + '.cv7')(out)

return out

def fusion_rep_vgg(fuse_layers, trained_model, infer_model):

for layer_name, use_bias, use_bn in fuse_layers:

conv_kxk_weights = trained_model.get_layer(layer_name + '.rbr_dense.0').get_weights()[0]

conv_1x1_weights = trained_model.get_layer(layer_name + '.rbr_1x1.0').get_weights()[0]

if use_bias:

conv_kxk_bias = trained_model.get_layer(layer_name + '.rbr_dense.0').get_weights()[1]

conv_1x1_bias = trained_model.get_layer(layer_name + '.rbr_1x1.0').get_weights()[1]

else:

conv_kxk_bias = np.zeros((conv_kxk_weights.shape[-1],))

conv_1x1_bias = np.zeros((conv_1x1_weights.shape[-1],))

if use_bn:

gammas_kxk, betas_kxk, means_kxk, var_kxk = trained_model.get_layer(layer_name + '.rbr_dense.1').get_weights()

gammas_1x1, betas_1x1, means_1x1, var_1x1 = trained_model.get_layer(layer_name + '.rbr_1x1.1').get_weights()

else:

gammas_1x1, betas_1x1, means_1x1, var_1x1 = [np.ones((conv_1x1_weights.shape[-1],)),

np.zeros((conv_1x1_weights.shape[-1],)),

np.zeros((conv_1x1_weights.shape[-1],)),

np.ones((conv_1x1_weights.shape[-1],))]

gammas_kxk, betas_kxk, means_kxk, var_kxk = [np.ones((conv_kxk_weights.shape[-1],)),

np.zeros((conv_kxk_weights.shape[-1],)),

np.zeros((conv_kxk_weights.shape[-1],)),

np.ones((conv_kxk_weights.shape[-1],))]

gammas_res, betas_res, means_res, var_res = [np.ones((conv_1x1_weights.shape[-1],)),

np.zeros((conv_1x1_weights.shape[-1],)),

np.zeros((conv_1x1_weights.shape[-1],)),

np.ones((conv_1x1_weights.shape[-1],))]

w_kxk = (gammas_kxk / np.sqrt(np.add(var_kxk, 1e-3))) * conv_kxk_weights

b_kxk = (((conv_kxk_bias - means_kxk) * gammas_kxk) / np.sqrt(np.add(var_kxk, 1e-3))) + betas_kxk

kernel_size = w_kxk.shape[0]

w_1x1 = np.zeros_like(w_kxk)

w_1x1[kernel_size // 2, kernel_size // 2, :, :] = (gammas_1x1 / np.sqrt(np.add(var_1x1, 1e-3))) * conv_1x1_weights

b_1x1 = (((conv_1x1_bias - means_1x1) * gammas_1x1) / np.sqrt(np.add(var_1x1, 1e-3))) + betas_1x1

w_res = np.zeros_like(w_kxk)

b_res = np.zeros_like(b_kxk)

weight = [w_res, w_1x1, w_kxk]

bias = [b_res, b_1x1, b_kxk]

infer_model.get_layer(layer_name).set_weights([np.array(weight).sum(axis=0), np.array(bias).sum(axis=0)])

def RepConv(x, c2, mode="train", name=""):

if mode == "predict":

out = Conv2D(c2, (3, 3), name = name, use_bias=True, padding='same')(x)

out = SiLU()(out)

elif mode == "train":

x1 = Conv2D(c2, (3, 3), name = name + '.rbr_dense.0', use_bias=False, padding='same')(x)

x1 = BatchNormalization(momentum = 0.97, epsilon = 0.001, name = name + '.rbr_dense.1')(x1)

x2 = Conv2D(c2, (1, 1), name = name + '.rbr_1x1.0', use_bias=False, padding='same')(x)

x2 = BatchNormalization(momentum = 0.97, epsilon = 0.001, name = name + '.rbr_1x1.1')(x2)

out = Add()([x1, x2])

out = SiLU()(out)

return out

#---------------------------------------------------#

# Panet网络的构建,并且获得预测结果

#---------------------------------------------------#

def yolo_body(input_shape, anchors_mask, num_classes, phi, mode="train"):

#-----------------------------------------------#

# 定义了不同yolov7版本的参数

#-----------------------------------------------#

transition_channels = {'l' : 32, 'x' : 40}[phi]

block_channels = 32

panet_channels = {'l' : 32, 'x' : 64}[phi]

e = {'l' : 2, 'x' : 1}[phi]

n = {'l' : 4, 'x' : 6}[phi]

ids = {'l' : [-1, -2, -3, -4, -5, -6], 'x' : [-1, -3, -5, -7, -8]}[phi]

inputs = Input(input_shape)

#---------------------------------------------------#

# 生成主干模型,获得三个有效特征层,他们的shape分别是:

# 80, 80, 256

# 40, 40, 1024

# 20, 20, 1024

#---------------------------------------------------#

feat1, feat2, feat3 = darknet_body(inputs, transition_channels, block_channels, n, phi)

# 20, 20, 1024 -> 20, 20, 512

P5 = SPPCSPC(feat3, transition_channels * 16, name="sppcspc")

P5_conv = DarknetConv2D_BN_SiLU(transition_channels * 8, (1, 1), name="conv_for_P5")(P5)

P5_upsample = UpSampling2D()(P5_conv)

P4 = Concatenate(axis=-1)([DarknetConv2D_BN_SiLU(transition_channels * 8, (1, 1), name="conv_for_feat2")(feat2), P5_upsample])

P4 = Multi_Concat_Block(P4, panet_channels * 4, transition_channels * 8, e=e, n=n, ids=ids, name="conv3_for_upsample1")

P4_conv = DarknetConv2D_BN_SiLU(transition_channels * 4, (1, 1), name="conv_for_P4")(P4)

P4_upsample = UpSampling2D()(P4_conv)

P3 = Concatenate(axis=-1)([DarknetConv2D_BN_SiLU(transition_channels * 4, (1, 1), name="conv_for_feat1")(feat1), P4_upsample])

P3 = Multi_Concat_Block(P3, panet_channels * 2, transition_channels * 4, e=e, n=n, ids=ids, name="conv3_for_upsample2")

P3_downsample = Transition_Block(P3, transition_channels * 4, name="down_sample1")

P4 = Concatenate(axis=-1)([P3_downsample, P4])

P4 = Multi_Concat_Block(P4, panet_channels * 4, transition_channels * 8, e=e, n=n, ids=ids, name="conv3_for_downsample1")

P4_downsample = Transition_Block(P4, transition_channels * 8, name="down_sample2")

P5 = Concatenate(axis=-1)([P4_downsample, P5])

P5 = Multi_Concat_Block(P5, panet_channels * 8, transition_channels * 16, e=e, n=n, ids=ids, name="conv3_for_downsample2")

if phi == "l":

P3 = RepConv(P3, transition_channels * 8, mode, name="rep_conv_1")

P4 = RepConv(P4, transition_channels * 16, mode, name="rep_conv_2")

P5 = RepConv(P5, transition_channels * 32, mode, name="rep_conv_3")

else:

P3 = DarknetConv2D_BN_SiLU(transition_channels * 8, (3, 3), strides=(1, 1), name="rep_conv_1")(P3)

P4 = DarknetConv2D_BN_SiLU(transition_channels * 16, (3, 3), strides=(1, 1), name="rep_conv_2")(P4)

P5 = DarknetConv2D_BN_SiLU(transition_channels * 32, (3, 3), strides=(1, 1), name="rep_conv_3")(P5)

# len(anchors_mask[2]) = 3

# 5 + num_classes -> 4 + 1 + num_classes

# 4是先验框的回归系数,1是sigmoid将值固定到0-1,num_classes用于判断先验框是什么类别的物体

# bs, 20, 20, 3 * (4 + 1 + num_classes)

out2 = DarknetConv2D(len(anchors_mask[2]) * (5 + num_classes), (1, 1), strides = (1, 1), name = 'yolo_head_P3')(P3)

out1 = DarknetConv2D(len(anchors_mask[1]) * (5 + num_classes), (1, 1), strides = (1, 1), name = 'yolo_head_P4')(P4)

out0 = DarknetConv2D(len(anchors_mask[0]) * (5 + num_classes), (1, 1), strides = (1, 1), name = 'yolo_head_P5')(P5)

return Model(inputs, [out0, out1, out2])

三、预测结果的解码

1、获得预测框与得分

由第二步我们可以获得三个特征层的预测结果,shape分别为(N,20,20,255),(N,40,40,255),(N,80,80,255)的数据。

但是这个预测结果并不对应着最终的预测框在图片上的位置,还需要解码才可以完成。在YoloV5里,每一个特征层上每一个特征点存在3个先验框。

每个特征层最后的255可以拆分成3个85,对应3个先验框的85个参数,我们先将其reshape一下,其结果为(N,20,20,3,85),(N,40.40,3,85),(N,80,80,3,85)。

其中的85可以拆分成4+1+80。

前4个参数用于判断每一个特征点的回归参数,回归参数调整后可以获得预测框;

第5个参数用于判断每一个特征点是否包含物体;

最后80个参数用于判断每一个特征点所包含的物体种类。

以(N,20,20,3,85)这个特征层为例,该特征层相当于将图像划分成20x20个特征点,如果某个特征点落在物体的对应框内,就用于预测该物体。

如图所示,蓝色的点为20x20的特征点,此时我们对左图黑色点的三个先验框进行解码操作演示:

1、进行中心预测点的计算,利用Regression预测结果前两个序号的内容对特征点的三个先验框中心坐标进行偏移,偏移后是右图红色的三个点;

2、进行预测框宽高的计算,利用Regression预测结果后两个序号的内容求指数后获得预测框的宽高;

3、此时获得的预测框就可以绘制在图片上了。

![]()

除去这样的解码操作,还有非极大抑制的操作需要进行,防止同一种类的框的堆积。

#---------------------------------------------------#

# 对box进行调整,使其符合真实图片的样子

#---------------------------------------------------#

def yolo_correct_boxes(box_xy, box_wh, input_shape, image_shape, letterbox_image):

#-----------------------------------------------------------------#

# 把y轴放前面是因为方便预测框和图像的宽高进行相乘

#-----------------------------------------------------------------#

box_yx = box_xy[..., ::-1]

box_hw = box_wh[..., ::-1]

input_shape = K.cast(input_shape, K.dtype(box_yx))

image_shape = K.cast(image_shape, K.dtype(box_yx))

if letterbox_image:

#-----------------------------------------------------------------#

# 这里求出来的offset是图像有效区域相对于图像左上角的偏移情况

# new_shape指的是宽高缩放情况

#-----------------------------------------------------------------#

new_shape = K.round(image_shape * K.min(input_shape/image_shape))

offset = (input_shape - new_shape)/2./input_shape

scale = input_shape/new_shape

box_yx = (box_yx - offset) * scale

box_hw *= scale

box_mins = box_yx - (box_hw / 2.)

box_maxes = box_yx + (box_hw / 2.)

boxes = K.concatenate([box_mins[..., 0:1], box_mins[..., 1:2], box_maxes[..., 0:1], box_maxes[..., 1:2]])

boxes *= K.concatenate([image_shape, image_shape])

return boxes

#---------------------------------------------------#

# 将预测值的每个特征层调成真实值

#---------------------------------------------------#

def get_anchors_and_decode(feats, anchors, num_classes, input_shape, calc_loss=False):

#---------------------------------------------------#

# 计算先验框的数量,num_anchors = 3

#---------------------------------------------------#

num_anchors = len(anchors)

#------------------------------------------#

# grid_shape指的是特征层的高和宽

#------------------------------------------#

grid_shape = K.shape(feats)[1:3]

#--------------------------------------------------------------------#

# 获得各个特征点的坐标信息。生成的shape为(20, 20, num_anchors, 2)

#--------------------------------------------------------------------#

grid_x = K.tile(K.reshape(K.arange(0, stop=grid_shape[1]), [1, -1, 1, 1]), [grid_shape[0], 1, num_anchors, 1])

grid_y = K.tile(K.reshape(K.arange(0, stop=grid_shape[0]), [-1, 1, 1, 1]), [1, grid_shape[1], num_anchors, 1])

grid = K.cast(K.concatenate([grid_x, grid_y]), K.dtype(feats))

#---------------------------------------------------------------#

# 将先验框进行拓展,生成的shape为(20, 20, num_anchors, 2)

#---------------------------------------------------------------#

anchors_tensor = K.reshape(K.constant(anchors), [1, 1, num_anchors, 2])

anchors_tensor = K.tile(anchors_tensor, [grid_shape[0], grid_shape[1], 1, 1])

#---------------------------------------------------#

# 将预测结果调整成(batch_size, 20, 20, 3, 85)

# 85可拆分成4 + 1 + 80

# 4代表的是中心宽高的调整参数

# 1代表的是框的置信度

# 80代表的是种类的置信度

# batch_size, 20, 20, 3, 5 + num_classes

#---------------------------------------------------#

feats = K.reshape(feats, [-1, grid_shape[0], grid_shape[1], num_anchors, num_classes + 5])

#------------------------------------------#

# 对先验框进行解码,并进行归一化

#------------------------------------------#

box_xy = (K.sigmoid(feats[..., :2]) * 2 - 0.5 + grid) / K.cast(grid_shape[::-1], K.dtype(feats))

box_wh = (K.sigmoid(feats[..., 2:4]) * 2) ** 2 * anchors_tensor / K.cast(input_shape[::-1], K.dtype(feats))

#------------------------------------------#

# 获得预测框的置信度

#------------------------------------------#

box_confidence = K.sigmoid(feats[..., 4:5])

box_class_probs = K.sigmoid(feats[..., 5:])

#---------------------------------------------------------------------#

# 在计算loss的时候返回grid, feats, box_xy, box_wh

# 在预测的时候返回box_xy, box_wh, box_confidence, box_class_probs

#---------------------------------------------------------------------#

if calc_loss == True:

return grid, feats, box_xy, box_wh

return box_xy, box_wh, box_confidence, box_class_probs

2、得分筛选与非极大抑制

得到最终的预测结果后还要进行得分排序与非极大抑制筛选。

得分筛选就是筛选出得分满足confidence置信度的预测框。

非极大抑制就是筛选出一定区域内属于同一种类得分最大的框。

得分筛选与非极大抑制的过程可以概括如下:

1、找出该图片中得分大于门限函数的框。在进行重合框筛选前就进行得分的筛选可以大幅度减少框的数量。

2、对种类进行循环,非极大抑制的作用是筛选出一定区域内属于同一种类得分最大的框,对种类进行循环可以帮助我们对每一个类分别进行非极大抑制。

3、根据得分对该种类进行从大到小排序。

4、每次取出得分最大的框,计算其与其它所有预测框的重合程度,重合程度过大的则剔除。

得分筛选与非极大抑制后的结果就可以用于绘制预测框了。

下图是经过非极大抑制的。

下图是未经过非极大抑制的。

实现代码为:

#---------------------------------------------------#

# 图片预测

#---------------------------------------------------#

def DecodeBox(outputs,

anchors,

num_classes,

image_shape,

input_shape,

#-----------------------------------------------------------#

# 13x13的特征层对应的anchor是[116,90],[156,198],[373,326]

# 26x26的特征层对应的anchor是[30,61],[62,45],[59,119]

# 52x52的特征层对应的anchor是[10,13],[16,30],[33,23]

#-----------------------------------------------------------#

anchor_mask = [[6, 7, 8], [3, 4, 5], [0, 1, 2]],

max_boxes = 100,

confidence = 0.5,

nms_iou = 0.3,

letterbox_image = True):

box_xy = []

box_wh = []

box_confidence = []

box_class_probs = []

for i in range(len(outputs)):

sub_box_xy, sub_box_wh, sub_box_confidence, sub_box_class_probs = \

get_anchors_and_decode(outputs[i], anchors[anchor_mask[i]], num_classes, input_shape)

box_xy.append(K.reshape(sub_box_xy, [-1, 2]))

box_wh.append(K.reshape(sub_box_wh, [-1, 2]))

box_confidence.append(K.reshape(sub_box_confidence, [-1, 1]))

box_class_probs.append(K.reshape(sub_box_class_probs, [-1, num_classes]))

box_xy = K.concatenate(box_xy, axis = 0)

box_wh = K.concatenate(box_wh, axis = 0)

box_confidence = K.concatenate(box_confidence, axis = 0)

box_class_probs = K.concatenate(box_class_probs, axis = 0)

#------------------------------------------------------------------------------------------------------------#

# 在图像传入网络预测前会进行letterbox_image给图像周围添加灰条,因此生成的box_xy, box_wh是相对于有灰条的图像的

# 我们需要对其进行修改,去除灰条的部分。 将box_xy、和box_wh调节成y_min,y_max,xmin,xmax

# 如果没有使用letterbox_image也需要将归一化后的box_xy, box_wh调整成相对于原图大小的

#------------------------------------------------------------------------------------------------------------#

boxes = yolo_correct_boxes(box_xy, box_wh, input_shape, image_shape, letterbox_image)

box_scores = box_confidence * box_class_probs

#-----------------------------------------------------------#

# 判断得分是否大于score_threshold

#-----------------------------------------------------------#

mask = box_scores >= confidence

max_boxes_tensor = K.constant(max_boxes, dtype='int32')

boxes_out = []

scores_out = []

classes_out = []

#-----------------------------------------------------------#

# 筛选出一定区域内属于同一种类得分最大的框

#-----------------------------------------------------------#

for c in range(num_classes):

#-----------------------------------------------------------#

# 取出所有box_scores >= score_threshold的框,和成绩

#-----------------------------------------------------------#

class_boxes = tf.boolean_mask(boxes, mask[:, c])

class_box_scores = tf.boolean_mask(box_scores[:, c], mask[:, c])

#-----------------------------------------------------------#

# 非极大抑制

# 保留一定区域内得分最大的框

#-----------------------------------------------------------#

nms_index = tf.image.non_max_suppression(class_boxes, class_box_scores, max_boxes_tensor, iou_threshold=nms_iou)

#-----------------------------------------------------------#

# 获取非极大抑制后的结果

# 下列三个分别是:框的位置,得分与种类

#-----------------------------------------------------------#

class_boxes = K.gather(class_boxes, nms_index)

class_box_scores = K.gather(class_box_scores, nms_index)

classes = K.ones_like(class_box_scores, 'int32') * c

boxes_out.append(class_boxes)

scores_out.append(class_box_scores)

classes_out.append(classes)

boxes_out = K.concatenate(boxes_out, axis=0)

scores_out = K.concatenate(scores_out, axis=0)

classes_out = K.concatenate(classes_out, axis=0)

return boxes_out, scores_out, classes_out

四、训练部分

1、计算loss所需内容

计算loss实际上是网络的预测结果和网络的真实结果的对比。

和网络的预测结果一样,网络的损失也由三个部分组成,分别是Reg部分、Obj部分、Cls部分。Reg部分是特征点的回归参数判断、Obj部分是特征点是否包含物体判断、Cls部分是特征点包含的物体的种类。

2、正样本的匹配过程

在YoloV7中,训练时正样本的匹配过程可以分为两部分。

a、对每个真实框通过坐标与宽高粗略匹配先验框与特征点。

b、使用SimOTA自适应精确选取每个真实框对应多少个先验框。

所谓正样本匹配,就是寻找哪些先验框被认为有对应的真实框,并且负责这个真实框的预测。

a、匹配先验框与特征点

在该部分中,YoloV7会对每个真实框进行粗匹配。找到哪些特征点上的哪些先验框可以负责该真实框的预测。

首先进行先验框的匹配,在YoloV7网络中,一共设计了9个不同大小的先验框。每个输出的特征层对应3个先验框。

对于任何一个真实框gt,YoloV7不再使用iou进行正样本的匹配,而是直接采用高宽比进行匹配,即使用真实框和9个不同大小的先验框计算宽高比。

如果真实框与某个先验框的宽高比例大于设定阈值,则说明该真实框和该先验框匹配度不够,将该先验框认为是负样本。

比如此时有一个真实框,它的宽高为[200, 200],是一个正方形。YoloV7默认设置的9个先验框为[12, 16], [19, 36], [40, 28], [36, 75], [76, 55], [72, 146], [142, 110], [192, 243], [459, 401]。设定阈值门限为4。

此时我们需要计算该真实框和9个先验框的宽高比例。比较宽高时存在两个情况,一个是真实框的宽高比先验框大,一个是先验框的宽高比真实框大。因此我们需要同时计算:真实框的宽高/先验框的宽高;先验框的宽高/真实框的宽高。然后在这其中选取最大值。

下个列表就是比较结果,这是一个shape为[9, 4]的矩阵,9代表9个先验框,4代表真实框的宽高/先验框的宽高;先验框的宽高/真实框的宽高。

[[16.66666667 12.5 0.06 0.08 ]

[10.52631579 5.55555556 0.095 0.18 ]

[ 5. 7.14285714 0.2 0.14 ]

[ 5.55555556 2.66666667 0.18 0.375 ]

[ 2.63157895 3.63636364 0.38 0.275 ]

[ 2.77777778 1.36986301 0.36 0.73 ]

[ 1.4084507 1.81818182 0.71 0.55 ]

[ 1.04166667 0.82304527 0.96 1.215 ]

[ 0.43572985 0.49875312 2.295 2.005 ]]

然后对每个先验框的比较结果取最大值。获得下述矩阵:

[16.66666667 10.52631579 7.14285714 5.55555556 3.63636364 2.77777778

1.81818182 1.215 2.295 ]

之后我们判断,哪些先验框的比较结果的值小于门限。可以知道[76, 55], [72, 146], [142, 110], [192, 243], [459, 401]五个先验框均满足需求。

[142, 110], [192, 243], [459, 401]属于20,20的特征层。

[76, 55], [72, 146]属于40,40的特征层。

此时我们已经可以判断哪些大小的先验框可用于该真实框的预测。

在YoloV5过去的Yolo中,每个真实框由其中心点所在的网格内的左上角特征点来负责预测。

在YoloV7中,同YoloV5,对于被选中的特征层,首先计算真实框落在哪个网格内,此时该网格左上角特征点便是一个负责预测的特征点。

同时利用四舍五入规则,找出最近的两个网格,将这三个网格都认为是负责预测该真实框的。

![]()

红色点表示该真实框的中心,除了当前所处的网格外,其2个最近的邻域网格也被选中。从这里就可以发现预测框的XY轴偏移部分的取值范围不再是0-1,而是0.5-1.5。

找到对应特征点后,对应特征点在满足宽高比的先验框负责该真实框的预测。

但这一步仅仅是粗略的筛选,后面我们会通过simOTA来精确筛选。

def preprocess_true_boxes(self, true_boxes, input_shape, anchors, num_classes):

assert (true_boxes[..., 4]<num_classes).all(), 'class id must be less than num_classes'

#-----------------------------------------------------------#

# 获得框的坐标和图片的大小

# [640, 640]

#-----------------------------------------------------------#

true_boxes = np.array(true_boxes, dtype='float32')

input_shape = np.array(input_shape, dtype='int32')

#-----------------------------------------------------------#

# 一共有三个特征层数

#-----------------------------------------------------------#

num_layers = len(self.anchors_mask)

#-----------------------------------------------------------#

# m为图片数量,grid_shapes为网格的shape

# 20, 20 640/32 = 20

# 40, 40

# 80, 80

#-----------------------------------------------------------#

m = true_boxes.shape[0]

grid_shapes = [input_shape // {0:32, 1:16, 2:8}[l] for l in range(num_layers)]

#-----------------------------------------------------------#

# y_true的格式为

# m,20,20,3,5+num_classses

# m,40,40,3,5+num_classses

# m,80,80,3,5+num_classses

#-----------------------------------------------------------#

y_true = [np.zeros((m, grid_shapes[l][0], grid_shapes[l][1], len(self.anchors_mask[l]), 2),

dtype='float32') for l in range(num_layers)]

#-----------------------------------------------------#

# 用于帮助先验框找到最对应的真实框

#-----------------------------------------------------#

box_best_ratios = [np.zeros((m, grid_shapes[l][0], grid_shapes[l][1], len(self.anchors_mask[l])),

dtype='float32') for l in range(num_layers)]

#-----------------------------------------------------------#

# 通过计算获得真实框的中心和宽高

# 中心点(m,n,2) 宽高(m,n,2)

#-----------------------------------------------------------#

boxes_xy = (true_boxes[..., 0:2] + true_boxes[..., 2:4]) // 2

boxes_wh = true_boxes[..., 2:4] - true_boxes[..., 0:2]

#-----------------------------------------------------------#

# 将真实框归一化到小数形式

#-----------------------------------------------------------#

true_boxes[..., 0:2] = boxes_xy / input_shape[::-1]

true_boxes[..., 2:4] = boxes_wh / input_shape[::-1]

#-----------------------------------------------------------#

# [9,2] -> [9,2]

#-----------------------------------------------------------#

anchors = np.array(anchors, np.float32)

#-----------------------------------------------------------#

# 长宽要大于0才有效

#-----------------------------------------------------------#

valid_mask = boxes_wh[..., 0]>0

for b in range(m):

#-----------------------------------------------------------#

# 对每一张图进行处理

#-----------------------------------------------------------#

wh = boxes_wh[b, valid_mask[b]]

if len(wh) == 0:

continue

#-------------------------------------------------------#

# wh : num_true_box, 2

# np.expand_dims(wh, 1) : num_true_box, 1, 2

# anchors : 9, 2

# np.expand_dims(anchors, 0) : 1, 9, 2

#

# ratios_of_gt_anchors代表每一个真实框和每一个先验框的宽高的比值

# ratios_of_gt_anchors : num_true_box, 9, 2

# ratios_of_anchors_gt代表每一个先验框和每一个真实框的宽高的比值

# ratios_of_anchors_gt : num_true_box, 9, 2

#

# ratios : num_true_box, 9, 4

# max_ratios代表每一个真实框和每一个先验框的宽高的比值的最大值

# max_ratios : num_true_box, 9

#-------------------------------------------------------#

ratios_of_gt_anchors = np.expand_dims(wh, 1) / np.expand_dims(anchors, 0)

ratios_of_anchors_gt = np.expand_dims(anchors, 0) / np.expand_dims(wh, 1)

ratios = np.concatenate([ratios_of_gt_anchors, ratios_of_anchors_gt], axis = -1)

max_ratios = np.max(ratios, axis = -1)

for t, ratio in enumerate(max_ratios):

#-------------------------------------------------------#

# ratio : 9

#-------------------------------------------------------#

over_threshold = ratio < self.threshold

over_threshold[np.argmin(ratio)] = True

#-----------------------------------------------------------#

# 找到每个真实框所属的特征层

#-----------------------------------------------------------#

for l in range(num_layers):

for k, n in enumerate(self.anchors_mask[l]):

if not over_threshold[n]:

continue

#-----------------------------------------------------------#

# floor用于向下取整,找到真实框所属的特征层对应的x、y轴坐标

#-----------------------------------------------------------#

i = np.floor(true_boxes[b,t,0] * grid_shapes[l][1]).astype('int32')

j = np.floor(true_boxes[b,t,1] * grid_shapes[l][0]).astype('int32')

offsets = self.get_near_points(true_boxes[b,t,0] * grid_shapes[l][1], true_boxes[b,t,1] * grid_shapes[l][0], i, j)

for offset in offsets:

local_i = i + offset[0]

local_j = j + offset[1]

if local_i >= grid_shapes[l][1] or local_i < 0 or local_j >= grid_shapes[l][0] or local_j < 0:

continue

if box_best_ratios[l][b, local_j, local_i, k] != 0:

if box_best_ratios[l][b, local_j, local_i, k] > ratio[n]:

y_true[l][b, local_j, local_i, k, :] = 0

else:

continue

#-----------------------------------------------------------#

# y_true的shape为(m,20,20,3,85)(m,40,40,3,85)(m,80,80,3,85)

# 最后的85可以拆分成4+1+80,4代表的是框的中心与宽高、

# 1代表的是置信度、80代表的是种类

#-----------------------------------------------------------#

y_true[l][b, local_j, local_i, k, 0] = 1

y_true[l][b, local_j, local_i, k, 1] = t + 1

box_best_ratios[l][b, local_j, local_i, k] = ratio[n]

return y_true

b、SimOTA自适应匹配

在YoloV7中,我们会计算一个Cost代价矩阵,代表每个真实框和每个特征点之间的代价关系,Cost代价矩阵由三个部分组成:

1、每个真实框和当前特征点预测框的重合程度;

2、每个真实框和当前特征点预测框的种类预测准确度;

每个真实框和当前特征点预测框的重合程度越高,代表这个特征点已经尝试去拟合该真实框了,因此它的Cost代价就会越小。

每个真实框和当前特征点预测框的种类预测准确度越高,也代表这个特征点已经尝试去拟合该真实框了,因此它的Cost代价就会越小。

Cost代价矩阵的目的是自适应的找到当前特征点应该去拟合的真实框,重合度越高越需要拟合,分类越准越需要拟合,在一定半径内越需要拟合。

在SimOTA中,不同目标设定不同的正样本数量(dynamick),以旷视科技官方回答中的蚂蚁和西瓜为例子,传统的正样本分配方案常常为同一场景下的西瓜和蚂蚁分配同样的正样本数,那要么蚂蚁有很多低质量的正样本,要么西瓜仅仅只有一两个正样本。对于哪个分配方式都是不合适的。

动态的正样本设置的关键在于如何确定k,SimOTA具体的做法是首先计算每个目标Cost最低的10特征点,然后把这十个特征点对应的预测框与真实框的IOU加起来求得最终的k。

因此,SimOTA的过程总结如下:

1、计算每个真实框和当前特征点预测框的重合程度。

2、计算将重合度最高的二十个预测框与真实框的IOU加起来求得每个真实框的k,也就代表每个真实框有k个特征点与之对应。

3、计算每个真实框和当前特征点预测框的种类预测准确度。

4、计算Cost代价矩阵。

5、将Cost最低的k个点作为该真实框的正样本。

#---------------------------------------------------#

# loss值计算

#---------------------------------------------------#

def yolo_loss(

args,

input_shape,

anchors,

anchors_mask,

num_classes,

balance = [0.4, 1.0, 4],

label_smoothing = 0.01,

box_ratio = 0.05,

obj_ratio = 1,

cls_ratio = 0.5

):

num_layers = len(anchors_mask)

#---------------------------------------------------------------------------------------------------#

# 将预测结果和实际ground truth分开,args是[*model_body.output, *y_true]

# y_true是一个列表,包含三个特征层,shape分别为:

# (m,20,20,3,85)

# (m,40,40,3,85)

# (m,80,80,3,85)

# yolo_outputs是一个列表,包含三个特征层,shape分别为:

# (m,20,20,3,85)

# (m,40,40,3,85)

# (m,80,80,3,85)

#---------------------------------------------------------------------------------------------------#

labels = args[-1]

y_true = args[num_layers:-1]

yolo_outputs = args[:num_layers]

#-----------------------------------------------------------#

# 得到input_shpae为640,640

#-----------------------------------------------------------#

input_shape = K.cast(input_shape, K.dtype(y_true[0]))

loss = 0

outputs = []

layer_id = []

fg_masks = []

is_in_boxes_and_centers = []

#---------------------------------------------------------------------------------------------------#

# y_true是一个列表,包含三个特征层,shape分别为(m,20,20,3,85),(m,40,40,3,85),(m,80,80,3,85)。

# yolo_outputs是一个列表,包含三个特征层,shape分别为(m,20,20,3,85),(m,40,40,3,85),(m,80,80,3,85)。

#---------------------------------------------------------------------------------------------------#

for l in range(num_layers):

#-----------------------------------------------------------#

# 将yolo_outputs的特征层输出进行处理、获得四个返回值

# 其中:

# grid (20,20,1,2) 网格坐标

# raw_pred (m,20,20,3,85) 尚未处理的预测结果

# pred_xy (m,20,20,3,2) 解码后的中心坐标

# pred_wh (m,20,20,3,2) 解码后的宽高坐标

#-----------------------------------------------------------#

grid, raw_pred, pred_xy, pred_wh = get_anchors_and_decode(yolo_outputs[l],

anchors[anchors_mask[l]], num_classes, input_shape, calc_loss=True)

#-----------------------------------------------------------#

# pred_box是解码后的预测的box的位置

# (m,20,20,3,4)

#-----------------------------------------------------------#

pred_box = K.concatenate([pred_xy, pred_wh])

m = tf.shape(pred_box)[0]

scale = tf.cast([[[input_shape[1], input_shape[0], input_shape[1], input_shape[0]]]], tf.float32)

outputs.append(tf.concat([tf.reshape(pred_box, [m, -1, 4]) * scale, tf.reshape(raw_pred[..., 4:], [m, -1, num_classes + 1])], -1))

layer_id.append(tf.ones_like(outputs[-1][:, :, 0]) * l)

fg_masks.append(tf.reshape(y_true[l][..., 0:1], [m, -1]))

is_in_boxes_and_centers.append(tf.reshape(y_true[l][..., 1:2], [m, -1]))

outputs = tf.concat(outputs, 1)

layer_id = tf.concat(layer_id, 1)

fg_masks = tf.concat(fg_masks, 1)

is_in_boxes_and_centers = tf.concat(is_in_boxes_and_centers, 1)

#-----------------------------------------------#

# [batch, n_anchors_all, 4] 预测框的坐标

# [batch, n_anchors_all, 1] 特征点是否有对应的物体

# [batch, n_anchors_all, n_cls] 特征点对应物体的种类

#-----------------------------------------------#

bbox_preds = outputs[:, :, :4]

obj_preds = outputs[:, :, 4:5]

cls_preds = outputs[:, :, 5:]

#------------------------------------------------------------#

# labels [batch, max_boxes, 5]

# tf.reduce_sum(labels, -1) [batch, max_boxes]

# nlabel [batch]

#------------------------------------------------------------#

nlabel = tf.reduce_sum(tf.cast(tf.reduce_sum(labels, -1) > 0, K.dtype(outputs)), -1)

total_num_anchors = tf.shape(outputs)[1]

num_fg = 0.0

loss_obj = 0.0

loss_cls = 0.0

loss_iou = 0.0

def loop_body(b, num_fg, loss_iou, loss_obj, loss_cls):

# num_gt 单张图片的真实框的数量

num_gt = tf.cast(nlabel[b], tf.int32)

#-----------------------------------------------#

# gt_bboxes_per_image [num_gt, 4]

# gt_classes [num_gt]

# bboxes_preds_per_image [n_anchors_all, 4]

# obj_preds_per_image [n_anchors_all, 1]

# cls_preds_per_image [n_anchors_all, num_classes]

#-----------------------------------------------#

gt_bboxes_per_image = labels[b][:num_gt, :4]

gt_classes = labels[b][:num_gt, 4]

bboxes_preds_per_image = bbox_preds[b]

obj_preds_per_image = obj_preds[b]

cls_preds_per_image = cls_preds[b]

def f1():

num_fg_img = tf.cast(tf.constant(0), K.dtype(outputs))

cls_target = tf.cast(tf.zeros((0, num_classes)), K.dtype(outputs))

reg_target = tf.cast(tf.zeros((0, 4)), K.dtype(outputs))

obj_target = tf.cast(tf.zeros((total_num_anchors, 1)), K.dtype(outputs))

fg_mask = tf.cast(tf.zeros(total_num_anchors), tf.bool)

return num_fg_img, cls_target, reg_target, obj_target, fg_mask

def f2():

fg_mask = tf.cast(fg_masks[b], tf.bool)

gt_matched_classes, fg_mask, pred_ious_this_matching, matched_gt_inds, num_fg_img = get_assignments(

fg_mask, gt_bboxes_per_image, gt_classes, bboxes_preds_per_image, obj_preds_per_image, cls_preds_per_image, num_classes, num_gt,

)

reg_target = tf.cast(tf.gather_nd(gt_bboxes_per_image, tf.reshape(matched_gt_inds, [-1, 1])), K.dtype(outputs))

cls_target = tf.cast(tf.one_hot(tf.cast(gt_matched_classes, tf.int32), num_classes) * tf.expand_dims(pred_ious_this_matching, -1), K.dtype(outputs))

obj_target = tf.cast(tf.expand_dims(fg_mask, -1), K.dtype(outputs))

return num_fg_img, cls_target, reg_target, obj_target, fg_mask

num_fg_img, cls_target, reg_target, obj_target, fg_mask = tf.cond(tf.equal(num_gt, 0), f1, f2)

num_fg += num_fg_img

# reg_target = tf.Print(reg_target, [num_fg_img, reg_target, tf.boolean_mask(bboxes_preds_per_image, fg_mask)], summarize=1000)

_loss_iou = 1 - box_ciou(reg_target, tf.boolean_mask(bboxes_preds_per_image, fg_mask))

_loss_obj = K.binary_crossentropy(_smooth_labels(obj_target, label_smoothing), obj_preds_per_image, from_logits=True)

_loss_cls = K.binary_crossentropy(cls_target, tf.boolean_mask(cls_preds_per_image, fg_mask), from_logits=True)

for layer in range(len(balance)):

num_pos = tf.maximum(K.sum(tf.cast(tf.logical_and(tf.equal(layer_id[b], layer), fg_mask), tf.float32)), 1)

loss_iou += K.sum(tf.boolean_mask(_loss_iou, tf.boolean_mask(tf.logical_and(tf.equal(layer_id[b], layer), fg_mask), fg_mask))) * box_ratio / num_pos

loss_obj += K.mean(tf.boolean_mask(_loss_obj, tf.equal(layer_id[b], layer)) * balance[layer]) * obj_ratio

loss_cls += K.sum(tf.boolean_mask(_loss_cls, tf.boolean_mask(tf.logical_and(tf.equal(layer_id[b], layer), fg_mask), fg_mask))) * cls_ratio / num_pos / num_classes

return b + 1, num_fg, loss_iou, loss_obj, loss_cls

#-----------------------------------------------------------#

# 在这个地方进行一个循环、循环是对每一张图片进行的

#-----------------------------------------------------------#

_, num_fg, loss_iou, loss_obj, loss_cls = tf.while_loop(lambda b,*args: b < tf.cast(tf.shape(outputs)[0], tf.int32), loop_body, [0, num_fg, loss_iou, loss_obj, loss_cls])

num_fg = tf.cast(tf.maximum(num_fg, 1), K.dtype(outputs))

loss = (loss_iou + loss_cls + loss_obj) / tf.cast(tf.shape(outputs)[0], tf.float32)

# loss = tf.Print(loss, [num_fg, loss_iou / tf.cast(tf.shape(outputs)[0], tf.float32), loss_obj / tf.cast(tf.shape(outputs)[0], tf.float32), loss_cls / tf.cast(tf.shape(outputs)[0], tf.float32) ])

return loss

def get_assignments(fg_mask, gt_bboxes_per_image, gt_classes, bboxes_preds_per_image, obj_preds_per_image, cls_preds_per_image, num_classes, num_gt):

#-------------------------------------------------------#

# 获得在真实框内部的特征点的预测结果

# fg_mask [n_anchors_all]

# bboxes_preds_per_image [fg_mask, 4]

# cls_preds_ [fg_mask, num_classes]

# obj_preds_ [fg_mask, 1]

#-------------------------------------------------------#

bboxes_preds_per_image = tf.boolean_mask(bboxes_preds_per_image, fg_mask, axis = 0)

obj_preds_ = tf.boolean_mask(obj_preds_per_image, fg_mask, axis = 0)

cls_preds_ = tf.boolean_mask(cls_preds_per_image, fg_mask, axis = 0)

num_in_boxes_anchor = tf.shape(bboxes_preds_per_image)[0]

#-------------------------------------------------------#

# 计算真实框和预测框的重合程度

# pair_wise_ious [num_gt, fg_mask]

#-------------------------------------------------------#

# gt_bboxes_per_image = tf.Print(gt_bboxes_per_image, [gt_bboxes_per_image, bboxes_preds_per_image], summarize=1000)

pair_wise_ious = box_iou(gt_bboxes_per_image, bboxes_preds_per_image)

pair_wise_ious_loss = -tf.log(pair_wise_ious + 1e-8)

#-------------------------------------------------------#

# 计算真实框和预测框种类置信度的交叉熵

# cls_preds_ [num_gt, fg_mask, num_classes]

# gt_cls_per_image [num_gt, fg_mask, num_classes]

# pair_wise_cls_loss [num_gt, fg_mask]

#-------------------------------------------------------#

gt_cls_per_image = tf.tile(tf.expand_dims(tf.one_hot(tf.cast(gt_classes, tf.int32), num_classes), 1), (1, num_in_boxes_anchor, 1))

cls_preds_ = K.sigmoid(tf.tile(tf.expand_dims(cls_preds_, 0), (num_gt, 1, 1))) *\

K.sigmoid(tf.tile(tf.expand_dims(obj_preds_, 0), (num_gt, 1, 1)))

pair_wise_cls_loss = tf.reduce_sum(K.binary_crossentropy(gt_cls_per_image, tf.sqrt(cls_preds_)), -1)

#-------------------------------------------------------#

# 种类比较接近的情况瞎,交叉熵较低

# 真实框和预测框重合度较高的时候,cost较低

# 这个特征点是要有对应的真实框的,cost才会低

#-------------------------------------------------------#

cost = pair_wise_cls_loss + 3.0 * pair_wise_ious_loss

gt_matched_classes, fg_mask, pred_ious_this_matching, matched_gt_inds, num_fg = dynamic_k_matching(cost, pair_wise_ious, fg_mask, gt_classes, num_gt)

return gt_matched_classes, fg_mask, pred_ious_this_matching, matched_gt_inds, num_fg

def dynamic_k_matching(cost, pair_wise_ious, fg_mask, gt_classes, num_gt):

#-------------------------------------------------------#

# matching_matrix [num_gt, fg_mask]

# cost [num_gt, fg_mask]

# pair_wise_ious [num_gt, fg_mask] 每一个真实框和预测框的重合情况

# gt_classes [num_gt]

# fg_mask [n_anchors_all]

#-------------------------------------------------------#

matching_matrix = tf.zeros_like(cost)

#------------------------------------------------------------#

# 选取iou最大的n_candidate_k个点

# 获得当前真实框重合度最大的十个预测框的值

# 重合度的值域是[0, 1],dynamic_ks的值就是[0, 10]

# 然后求和,判断应该有多少点用于该框预测

# topk_ious [num_gt, n_candidate_k]

# dynamic_ks [num_gt]

# matching_matrix [num_gt, fg_mask]

#------------------------------------------------------------#

n_candidate_k = tf.minimum(20, tf.shape(pair_wise_ious)[1])

topk_ious, _ = tf.nn.top_k(pair_wise_ious, n_candidate_k)

dynamic_ks = tf.maximum(tf.reduce_sum(topk_ious, 1), 1)

# dynamic_ks = tf.Print(dynamic_ks, [topk_ious, dynamic_ks], summarize = 100)

def loop_body_1(b, matching_matrix):

#------------------------------------------------------------#

# 给每个真实框选取最小的动态k个点

#------------------------------------------------------------#

_, pos_idx = tf.nn.top_k(-cost[b], k=tf.cast(dynamic_ks[b], tf.int32))

matching_matrix = tf.concat(

[matching_matrix[:b], tf.expand_dims(tf.reduce_max(tf.one_hot(pos_idx, tf.shape(cost)[1]), 0), 0), matching_matrix[b+1:]], axis = 0

)

# matching_matrix = matching_matrix.write(b, K.cast(tf.reduce_max(tf.one_hot(pos_idx, tf.shape(cost)[1]), 0), K.dtype(cost)))

return b + 1, matching_matrix

#-----------------------------------------------------------#

# 在这个地方进行一个循环、循环是对每一张图片进行的

#-----------------------------------------------------------#

_, matching_matrix = tf.while_loop(lambda b,*args: b < tf.cast(num_gt, tf.int32), loop_body_1, [0, matching_matrix])

#------------------------------------------------------------#

# anchor_matching_gt [fg_mask]

#------------------------------------------------------------#

anchor_matching_gt = tf.reduce_sum(matching_matrix, 0)

#------------------------------------------------------------#

# 当某一个特征点指向多个真实框的时候

# 选取cost最小的真实框。

#------------------------------------------------------------#

biger_one_indice = tf.reshape(tf.where(anchor_matching_gt > 1), [-1])

def loop_body_2(b, matching_matrix):

indice_anchor = tf.cast(biger_one_indice[b], tf.int32)

indice_gt = tf.math.argmin(cost[:, indice_anchor])

matching_matrix = tf.concat(

[

matching_matrix[:, :indice_anchor],

tf.expand_dims(tf.one_hot(indice_gt, tf.cast(num_gt, tf.int32)), 1),

matching_matrix[:, indice_anchor+1:]

], axis = -1

)

return b + 1, matching_matrix

#-----------------------------------------------------------#

# 在这个地方进行一个循环、循环是对每一张图片进行的

#-----------------------------------------------------------#

_, matching_matrix = tf.while_loop(lambda b,*args: b < tf.cast(tf.shape(biger_one_indice)[0], tf.int32), loop_body_2, [0, matching_matrix])

#------------------------------------------------------------#

# fg_mask_inboxes [fg_mask]

# num_fg为正样本的特征点个数

#------------------------------------------------------------#

fg_mask_inboxes = tf.reduce_sum(matching_matrix, 0) > 0.0

num_fg = tf.reduce_sum(tf.cast(fg_mask_inboxes, K.dtype(cost)))

fg_mask_indices = tf.reshape(tf.where(fg_mask), [-1])

fg_mask_inboxes_indices = tf.reshape(tf.where(fg_mask_inboxes), [-1, 1])

fg_mask_select_indices = tf.gather_nd(fg_mask_indices, fg_mask_inboxes_indices)

fg_mask = tf.cast(tf.reduce_max(tf.one_hot(fg_mask_select_indices, tf.shape(fg_mask)[0]), 0), K.dtype(fg_mask))

#------------------------------------------------------------#

# 获得特征点对应的物品种类

#------------------------------------------------------------#

matched_gt_inds = tf.math.argmax(tf.boolean_mask(matching_matrix, fg_mask_inboxes, axis = 1), 0)

gt_matched_classes = tf.gather_nd(gt_classes, tf.reshape(matched_gt_inds, [-1, 1]))

pred_ious_this_matching = tf.boolean_mask(tf.reduce_sum(matching_matrix * pair_wise_ious, 0), fg_mask_inboxes)

return gt_matched_classes, fg_mask, pred_ious_this_matching, matched_gt_inds, num_fg

3、计算Loss

由第一部分可知,YoloV7的损失由三个部分组成:

1、Reg部分,由第2部分可知道每个真实框对应的先验框,获取到每个框对应的先验框后,取出该先验框对应的预测框,利用真实框和预测框计算CIOU损失,作为Reg部分的Loss组成。

2、Obj部分,由第2部分可知道每个真实框对应的先验框,所有真实框对应的先验框都是正样本,剩余的先验框均为负样本,根据正负样本和特征点的是否包含物体的预测结果计算交叉熵损失,作为Obj部分的Loss组成。

3、Cls部分,由第三部分可知道每个真实框对应的先验框,获取到每个框对应的先验框后,取出该先验框的种类预测结果,根据真实框的种类和先验框的种类预测结果计算交叉熵损失,作为Cls部分的Loss组成。

_loss_iou = 1 - box_ciou(reg_target, tf.boolean_mask(bboxes_preds_per_image, fg_mask))

_loss_obj = K.binary_crossentropy(_smooth_labels(obj_target, label_smoothing), obj_preds_per_image, from_logits=True)

_loss_cls = K.binary_crossentropy(cls_target, tf.boolean_mask(cls_preds_per_image, fg_mask), from_logits=True)

for layer in range(len(balance)):

num_pos = tf.maximum(K.sum(tf.cast(tf.logical_and(tf.equal(layer_id[b], layer), fg_mask), tf.float32)), 1)

loss_iou += K.sum(tf.boolean_mask(_loss_iou, tf.boolean_mask(tf.logical_and(tf.equal(layer_id[b], layer), fg_mask), fg_mask))) * box_ratio / num_pos

loss_obj += K.mean(tf.boolean_mask(_loss_obj, tf.equal(layer_id[b], layer)) * balance[layer]) * obj_ratio

loss_cls += K.sum(tf.boolean_mask(_loss_cls, tf.boolean_mask(tf.logical_and(tf.equal(layer_id[b], layer), fg_mask), fg_mask))) * cls_ratio / num_pos / num_classes

训练自己的YoloV7模型

首先前往Github下载对应的仓库,下载完后利用解压软件解压,之后用编程软件打开文件夹。

注意打开的根目录必须正确,否则相对目录不正确的情况下,代码将无法运行。

一定要注意打开后的根目录是文件存放的目录。

一、数据集的准备

本文使用VOC格式进行训练,训练前需要自己制作好数据集,如果没有自己的数据集,可以通过Github连接下载VOC12+07的数据集尝试下。

训练前将标签文件放在VOCdevkit文件夹下的VOC2007文件夹下的Annotation中。

![]()

训练前将图片文件放在VOCdevkit文件夹下的VOC2007文件夹下的JPEGImages中。

![]()

此时数据集的摆放已经结束。

二、数据集的处理

在完成数据集的摆放之后,我们需要对数据集进行下一步的处理,目的是获得训练用的2007_train.txt以及2007_val.txt,需要用到根目录下的voc_annotation.py。

voc_annotation.py里面有一些参数需要设置。

分别是annotation_mode、classes_path、trainval_percent、train_percent、VOCdevkit_path,第一次训练可以仅修改classes_path

'''

annotation_mode用于指定该文件运行时计算的内容

annotation_mode为0代表整个标签处理过程,包括获得VOCdevkit/VOC2007/ImageSets里面的txt以及训练用的2007_train.txt、2007_val.txt

annotation_mode为1代表获得VOCdevkit/VOC2007/ImageSets里面的txt

annotation_mode为2代表获得训练用的2007_train.txt、2007_val.txt

'''

annotation_mode = 0

'''

必须要修改,用于生成2007_train.txt、2007_val.txt的目标信息

与训练和预测所用的classes_path一致即可

如果生成的2007_train.txt里面没有目标信息

那么就是因为classes没有设定正确

仅在annotation_mode为0和2的时候有效

'''

classes_path = 'model_data/voc_classes.txt'

'''

trainval_percent用于指定(训练集+验证集)与测试集的比例,默认情况下 (训练集+验证集):测试集 = 9:1

train_percent用于指定(训练集+验证集)中训练集与验证集的比例,默认情况下 训练集:验证集 = 9:1

仅在annotation_mode为0和1的时候有效

'''

trainval_percent = 0.9

train_percent = 0.9

'''

指向VOC数据集所在的文件夹

默认指向根目录下的VOC数据集

'''

VOCdevkit_path = 'VOCdevkit'

classes_path用于指向检测类别所对应的txt,以voc数据集为例,我们用的txt为:

训练自己的数据集时,可以自己建立一个cls_classes.txt,里面写自己所需要区分的类别。

三、开始网络训练

通过voc_annotation.py我们已经生成了2007_train.txt以及2007_val.txt,此时我们可以开始训练了。

训练的参数较多,大家可以在下载库后仔细看注释,其中最重要的部分依然是train.py里的classes_path。

classes_path用于指向检测类别所对应的txt,这个txt和voc_annotation.py里面的txt一样!训练自己的数据集必须要修改!

修改完classes_path后就可以运行train.py开始训练了,在训练多个epoch后,权值会生成在logs文件夹中。

其它参数的作用如下:

#---------------------------------------------------------------------#

# train_gpu 训练用到的GPU

# 默认为第一张卡、双卡为[0, 1]、三卡为[0, 1, 2]

# 在使用多GPU时,每个卡上的batch为总batch除以卡的数量。

#---------------------------------------------------------------------#

train_gpu = [0,]

#---------------------------------------------------------------------#

# classes_path 指向model_data下的txt,与自己训练的数据集相关

# 训练前一定要修改classes_path,使其对应自己的数据集

#---------------------------------------------------------------------#

classes_path = 'model_data/voc_classes.txt'

#---------------------------------------------------------------------#

# anchors_path 代表先验框对应的txt文件,一般不修改。

# anchors_mask 用于帮助代码找到对应的先验框,一般不修改。

#---------------------------------------------------------------------#

anchors_path = 'model_data/yolo_anchors.txt'

anchors_mask = [[6, 7, 8], [3, 4, 5], [0, 1, 2]]

#----------------------------------------------------------------------------------------------------------------------------#

# 权值文件的下载请看README,可以通过网盘下载。模型的 预训练权重 对不同数据集是通用的,因为特征是通用的。

# 模型的 预训练权重 比较重要的部分是 主干特征提取网络的权值部分,用于进行特征提取。

# 预训练权重对于99%的情况都必须要用,不用的话主干部分的权值太过随机,特征提取效果不明显,网络训练的结果也不会好

#

# 如果训练过程中存在中断训练的操作,可以将model_path设置成logs文件夹下的权值文件,将已经训练了一部分的权值再次载入。

# 同时修改下方的 冻结阶段 或者 解冻阶段 的参数,来保证模型epoch的连续性。

#

# 当model_path = ''的时候不加载整个模型的权值。

#

# 此处使用的是整个模型的权重,因此是在train.py进行加载的。

# 如果想要让模型从0开始训练,则设置model_path = '',下面的Freeze_Train = Fasle,此时从0开始训练,且没有冻结主干的过程。

#

# 一般来讲,网络从0开始的训练效果会很差,因为权值太过随机,特征提取效果不明显,因此非常、非常、非常不建议大家从0开始训练!

# 从0开始训练有两个方案:

# 1、得益于Mosaic数据增强方法强大的数据增强能力,将UnFreeze_Epoch设置的较大(300及以上)、batch较大(16及以上)、数据较多(万以上)的情况下,

# 可以设置mosaic=True,直接随机初始化参数开始训练,但得到的效果仍然不如有预训练的情况。(像COCO这样的大数据集可以这样做)

# 2、了解imagenet数据集,首先训练分类模型,获得网络的主干部分权值,分类模型的 主干部分 和该模型通用,基于此进行训练。

#----------------------------------------------------------------------------------------------------------------------------#

model_path = 'model_data/yolov7_weights.h5'

#------------------------------------------------------#

# input_shape 输入的shape大小,一定要是32的倍数

#------------------------------------------------------#

input_shape = [640, 640]

#------------------------------------------------------#

# phi 所使用的YoloV7的版本。l、x

#------------------------------------------------------#

phi = 'l'

#------------------------------------------------------------------#

# mosaic 马赛克数据增强。

# mosaic_prob 每个step有多少概率使用mosaic数据增强,默认50%。

#

# mixup 是否使用mixup数据增强,仅在mosaic=True时有效。

# 只会对mosaic增强后的图片进行mixup的处理。

# mixup_prob 有多少概率在mosaic后使用mixup数据增强,默认50%。

# 总的mixup概率为mosaic_prob * mixup_prob。

#

# special_aug_ratio 参考YoloX,由于Mosaic生成的训练图片,远远脱离自然图片的真实分布。

# 当mosaic=True时,本代码会在special_aug_ratio范围内开启mosaic。

# 默认为前70%个epoch,100个世代会开启70个世代。

#------------------------------------------------------------------#

mosaic = True

mosaic_prob = 0.5

mixup = True

mixup_prob = 0.5

special_aug_ratio = 0.7

#------------------------------------------------------------------#

# label_smoothing 标签平滑。一般0.01以下。如0.01、0.005。

#------------------------------------------------------------------#

label_smoothing = 0

#----------------------------------------------------------------------------------------------------------------------------#

# 训练分为两个阶段,分别是冻结阶段和解冻阶段。设置冻结阶段是为了满足机器性能不足的同学的训练需求。

# 冻结训练需要的显存较小,显卡非常差的情况下,可设置Freeze_Epoch等于UnFreeze_Epoch,Freeze_Train = True,此时仅仅进行冻结训练。

#

# 在此提供若干参数设置建议,各位训练者根据自己的需求进行灵活调整:

# (一)从整个模型的预训练权重开始训练:

# Adam:

# Init_Epoch = 0,Freeze_Epoch = 50,UnFreeze_Epoch = 100,Freeze_Train = True,optimizer_type = 'adam',Init_lr = 1e-3,weight_decay = 0。(冻结)

# Init_Epoch = 0,UnFreeze_Epoch = 100,Freeze_Train = False,optimizer_type = 'adam',Init_lr = 1e-3,weight_decay = 0。(不冻结)

# SGD:

# Init_Epoch = 0,Freeze_Epoch = 50,UnFreeze_Epoch = 300,Freeze_Train = True,optimizer_type = 'sgd',Init_lr = 1e-2,weight_decay = 5e-4。(冻结)

# Init_Epoch = 0,UnFreeze_Epoch = 300,Freeze_Train = False,optimizer_type = 'sgd',Init_lr = 1e-2,weight_decay = 5e-4。(不冻结)

# 其中:UnFreeze_Epoch可以在100-300之间调整。

# (二)从0开始训练:

# Init_Epoch = 0,UnFreeze_Epoch >= 300,Unfreeze_batch_size >= 16,Freeze_Train = False(不冻结训练)

# 其中:UnFreeze_Epoch尽量不小于300。optimizer_type = 'sgd',Init_lr = 1e-2,mosaic = True。

# (三)batch_size的设置:

# 在显卡能够接受的范围内,以大为好。显存不足与数据集大小无关,提示显存不足(OOM或者CUDA out of memory)请调小batch_size。

# 受到BatchNorm层影响,batch_size最小为2,不能为1。

# 正常情况下Freeze_batch_size建议为Unfreeze_batch_size的1-2倍。不建议设置的差距过大,因为关系到学习率的自动调整。

#----------------------------------------------------------------------------------------------------------------------------#

#------------------------------------------------------------------#

# 冻结阶段训练参数

# 此时模型的主干被冻结了,特征提取网络不发生改变

# 占用的显存较小,仅对网络进行微调

# Init_Epoch 模型当前开始的训练世代,其值可以大于Freeze_Epoch,如设置:

# Init_Epoch = 60、Freeze_Epoch = 50、UnFreeze_Epoch = 100

# 会跳过冻结阶段,直接从60代开始,并调整对应的学习率。

# (断点续练时使用)

# Freeze_Epoch 模型冻结训练的Freeze_Epoch

# (当Freeze_Train=False时失效)

# Freeze_batch_size 模型冻结训练的batch_size

# (当Freeze_Train=False时失效)

#------------------------------------------------------------------#

Init_Epoch = 0

Freeze_Epoch = 50

Freeze_batch_size = 8

#------------------------------------------------------------------#

# 解冻阶段训练参数

# 此时模型的主干不被冻结了,特征提取网络会发生改变

# 占用的显存较大,网络所有的参数都会发生改变

# UnFreeze_Epoch 模型总共训练的epoch

# SGD需要更长的时间收敛,因此设置较大的UnFreeze_Epoch

# Adam可以使用相对较小的UnFreeze_Epoch

# Unfreeze_batch_size 模型在解冻后的batch_size

#------------------------------------------------------------------#

UnFreeze_Epoch = 300

Unfreeze_batch_size = 4

#------------------------------------------------------------------#

# Freeze_Train 是否进行冻结训练

# 默认先冻结主干训练后解冻训练。

#------------------------------------------------------------------#

Freeze_Train = True

#------------------------------------------------------------------#

# 其它训练参数:学习率、优化器、学习率下降有关

#------------------------------------------------------------------#

#------------------------------------------------------------------#

# Init_lr 模型的最大学习率

# 当使用Adam优化器时建议设置 Init_lr=1e-3

# 当使用SGD优化器时建议设置 Init_lr=1e-2

# Min_lr 模型的最小学习率,默认为最大学习率的0.01

#------------------------------------------------------------------#

Init_lr = 1e-2

Min_lr = Init_lr * 0.01

#------------------------------------------------------------------#

# optimizer_type 使用到的优化器种类,可选的有adam、sgd

# 当使用Adam优化器时建议设置 Init_lr=1e-3

# 当使用SGD优化器时建议设置 Init_lr=1e-2

# momentum 优化器内部使用到的momentum参数

# weight_decay 权值衰减,可防止过拟合

# adam会导致weight_decay错误,使用adam时建议设置为0。

#------------------------------------------------------------------#

optimizer_type = "sgd"

momentum = 0.937

weight_decay = 5e-4

#------------------------------------------------------------------#

# lr_decay_type 使用到的学习率下降方式,可选的有'step'、'cos'

#------------------------------------------------------------------#

lr_decay_type = 'cos'

#------------------------------------------------------------------#

# save_period 多少个epoch保存一次权值

#------------------------------------------------------------------#

save_period = 10

#------------------------------------------------------------------#

# save_dir 权值与日志文件保存的文件夹

#------------------------------------------------------------------#

save_dir = 'logs'

#------------------------------------------------------------------#

# eval_flag 是否在训练时进行评估,评估对象为验证集

# 安装pycocotools库后,评估体验更佳。

# eval_period 代表多少个epoch评估一次,不建议频繁的评估

# 评估需要消耗较多的时间,频繁评估会导致训练非常慢

# 此处获得的mAP会与get_map.py获得的会有所不同,原因有二:

# (一)此处获得的mAP为验证集的mAP。

# (二)此处设置评估参数较为保守,目的是加快评估速度。

#------------------------------------------------------------------#

eval_flag = True

eval_period = 10

#------------------------------------------------------------------#

# num_workers 用于设置是否使用多线程读取数据,1代表关闭多线程

# 开启后会加快数据读取速度,但是会占用更多内存

# keras里开启多线程有些时候速度反而慢了许多

# 在IO为瓶颈的时候再开启多线程,即GPU运算速度远大于读取图片的速度。

#------------------------------------------------------------------#

num_workers = 1

#------------------------------------------------------#

# train_annotation_path 训练图片路径和标签

# val_annotation_path 验证图片路径和标签

#------------------------------------------------------#

train_annotation_path = '2007_train.txt'

val_annotation_path = '2007_val.txt'

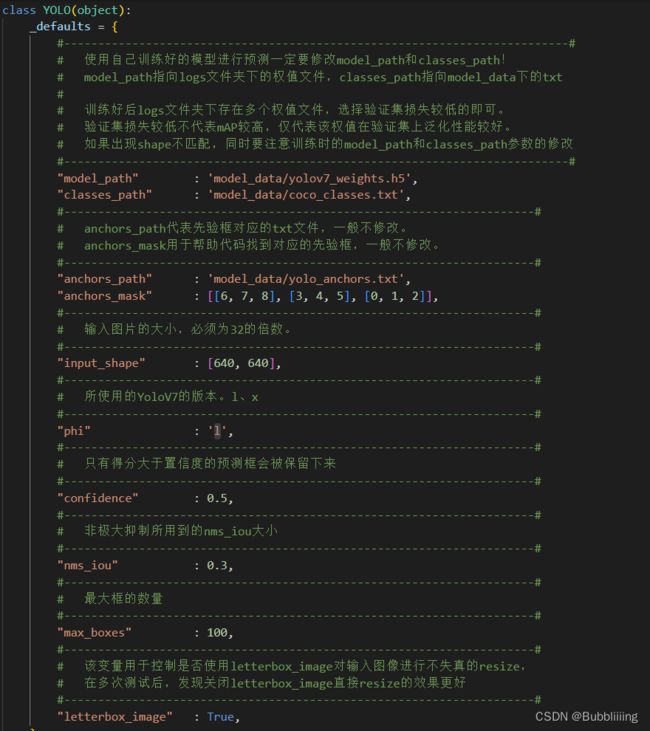

四、训练结果预测

训练结果预测需要用到两个文件,分别是yolo.py和predict.py。

我们首先需要去yolo.py里面修改model_path以及classes_path,这两个参数必须要修改。

model_path指向训练好的权值文件,在logs文件夹里。

classes_path指向检测类别所对应的txt。

完成修改后就可以运行predict.py进行检测了。运行后输入图片路径即可检测。