Games101-课程19笔记

目录

相机内部发生了什么?

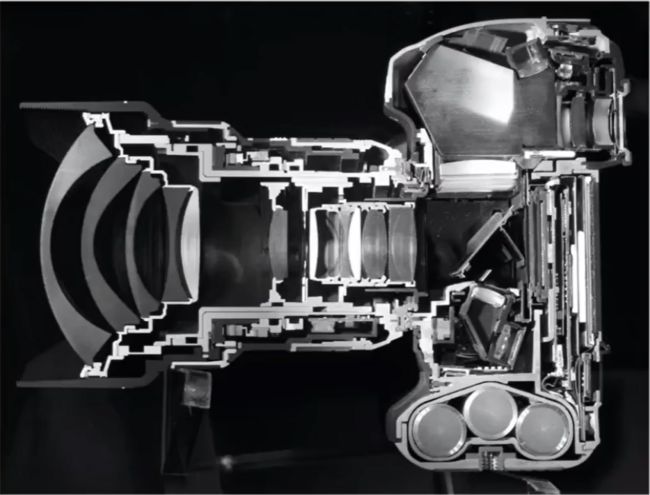

传感器上图像的针孔和镜头

下面为摄像机的组成部件

① 快门曝光传感器

② 传感器在曝光期间记录累积的辐照度

为什么不使用没有镜头的传感器?

针孔成像

视场(FOV)

焦距与视野

在较小的传感器上保持 FOV

曝光摄影中的曝光控制

光圈大小

快门速度

机械快门

滚动快门

高速摄影

ISO 增益 (感光度)类似于后期处理

ISO(增益)

F-Number (F-Stop): 曝光级别

曝光:光圈、快门、增益(ISO),它们数值大小的区别

薄透镜近似

薄透镜公式

推导过程

散焦模糊

计算COC (弥散圆大小C)

F -number(又名 F-Stop)

F-Stop计算示例

光线追踪理想薄透镜

散焦模糊的光线追踪(薄镜头)

渲染过程

景深

景深的COC

景深的推导

光场

光场的逐步完善

光场相机

最重要的功能

理解

总结

如何从光场照片中获得“常规”照片?

光场相机有问题吗?

第十九节课: 相机、镜头和光场

图片 = 合成+捕捉

相机内部发生了什么?

传感器上图像的针孔和镜头

下面为摄像机的组成部件:

① 快门曝光传感器以获得精确的持续时间

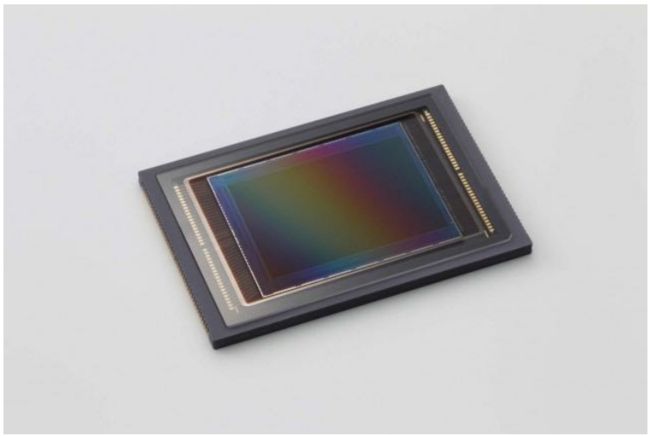

② 传感器在曝光期间记录累积的辐照度irradiance

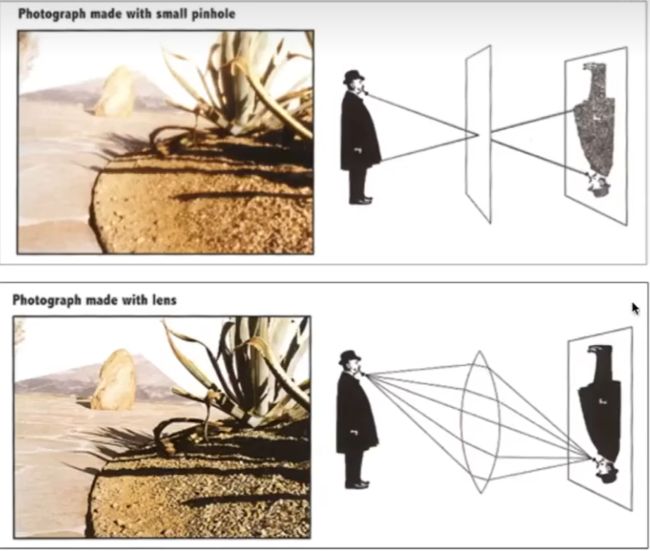

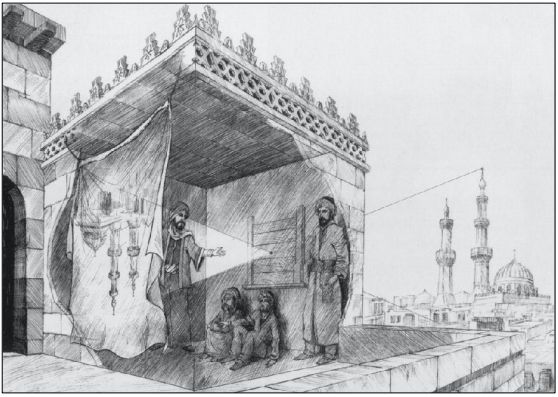

为什么不使用没有镜头的传感器?

每个传感器点将整合来自所有点的光对象,因此所有像素值都相似, 即传感器记录辐照度

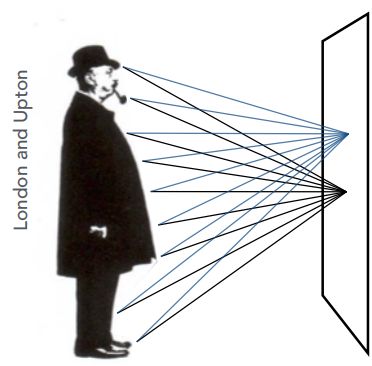

针孔成像

针孔相机(Pinhole Camera):

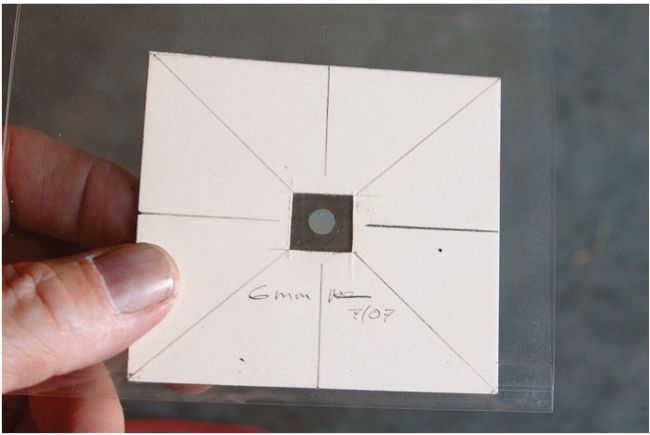

用下面这个针孔去拍

得到针孔照片(锐利,无虚化)

光线追踪就是针孔摄像机原理

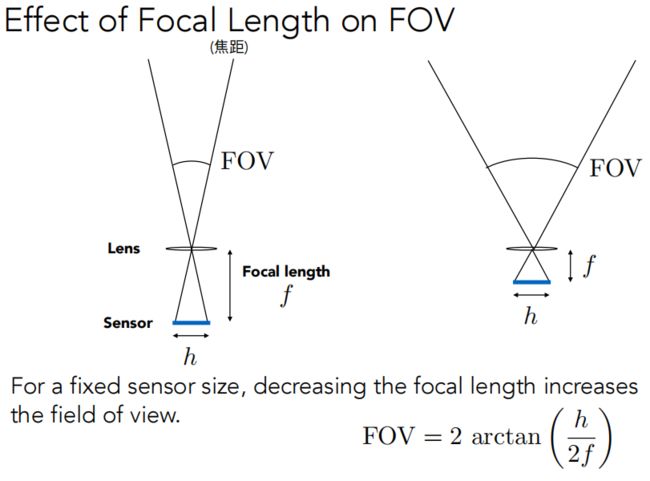

视场(Field of View (FOV))

对于固定的传感器尺寸,减小焦距会增加视野

传感器高度Sensor: h 焦距Focal length: f

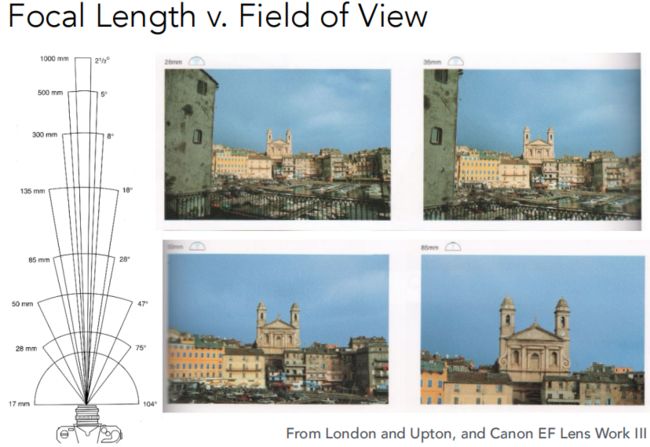

焦距与视野

• 由于历史原因,通常指镜头焦距的视场角用于 35mm 格式胶片 (36 x 24mm)

• 35mm 格式的焦距示例:

• 17mm 为广角 104°

• 50mm 是“普通”镜头 47°

• 200mm 为长焦镜头 12°

• 小心! 当我们说现在的手机有约 28 毫米“等效”焦距长度,这是使用了上面的约定

焦距f越大, 能看的距离越远, 视场越小

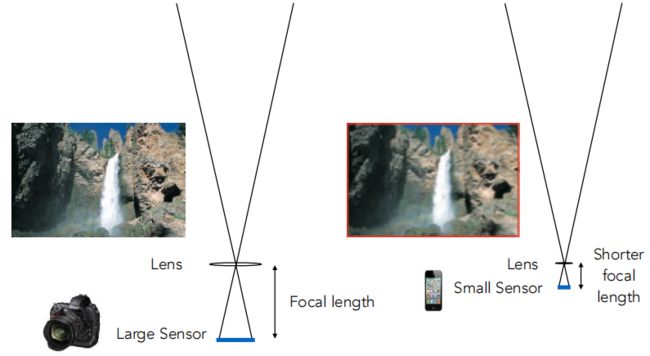

传感器大小也影响视场大小, 高度h越小, 则视场越小,反之相反.

所以相机越大, 镜头越长, 就越好

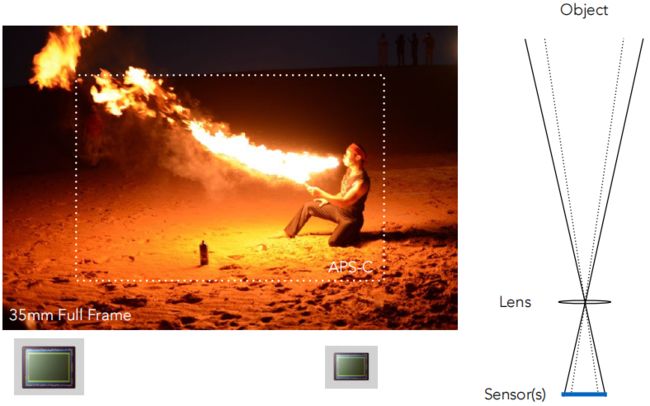

在较小的传感器上保持 FOV?

根据传感器的宽度/高度减少镜头焦距, 从而使手机保持和相机相同的FOV

曝光(Exposure)摄影中的曝光控制

H = T x E

• 曝光 = 时间 x 辐照度

• 曝光时间 (T)

- 由快门控制

• 辐照度 (E)

- 落在传感器单位面积上的光功率

- 由镜头光圈和焦距控制

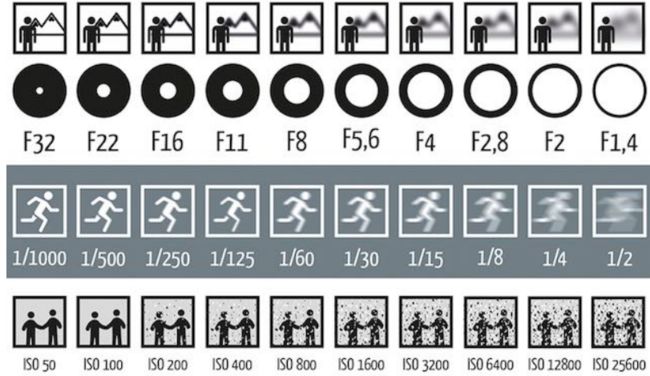

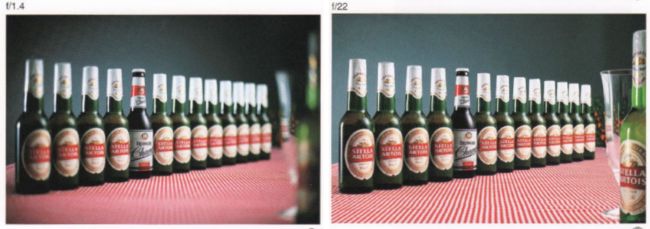

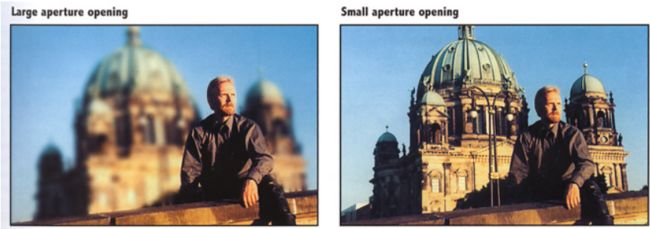

光圈大小

• 通过打开/关闭f-stop来更改光圈(如果相机有光圈控制)

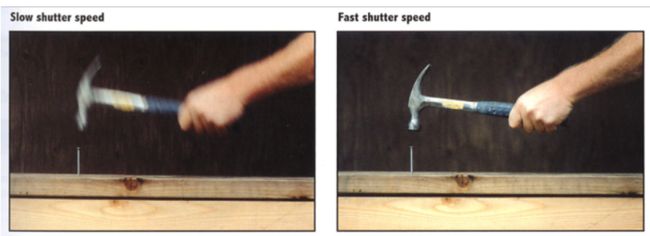

快门速度

• 更改传感器像素整合光线的持续时间

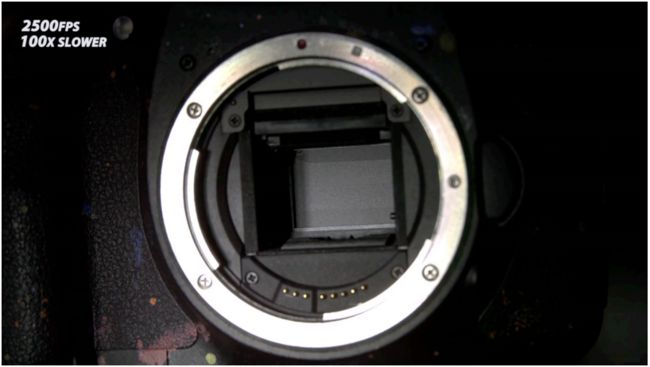

机械快门(Physical Shutter)

快门速度的副作用

运动模糊:握手、主体移动(前一帧和后一帧的位置不同)

加倍快门时间使运动模糊加倍

快门速度的副作用

注意:运动模糊并不总是坏事!

提示:考虑抗锯齿(反走样)

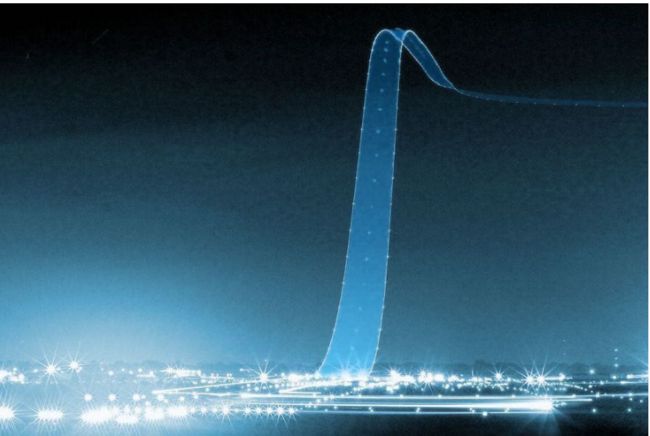

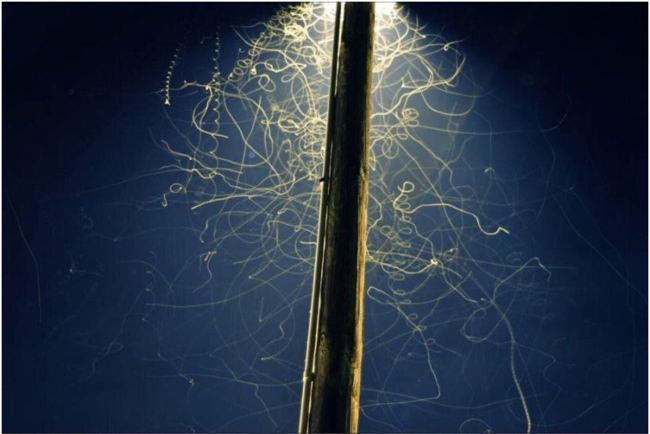

滚动快门(Rolling shutter): 在不同时间拍摄的照片的不同部分(下图的螺旋桨是弯的)

恒定曝光:F-Stop 与快门速度

• 摄影师必须权衡移动主体的景深和运动模糊

示例:以上光圈和快门速度(上下成对)可提供等效曝光

如果曝光太亮/太暗,可能需要调整 f-stop 或 快门。

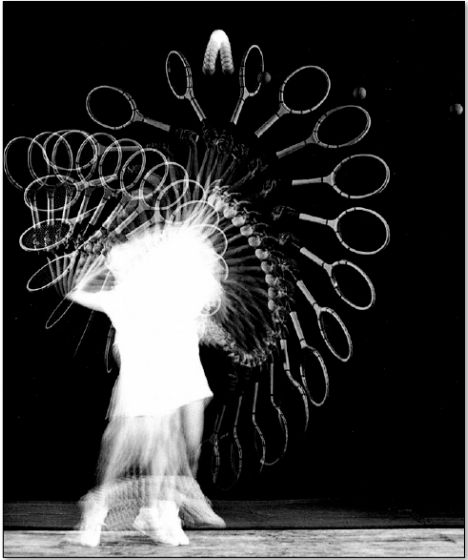

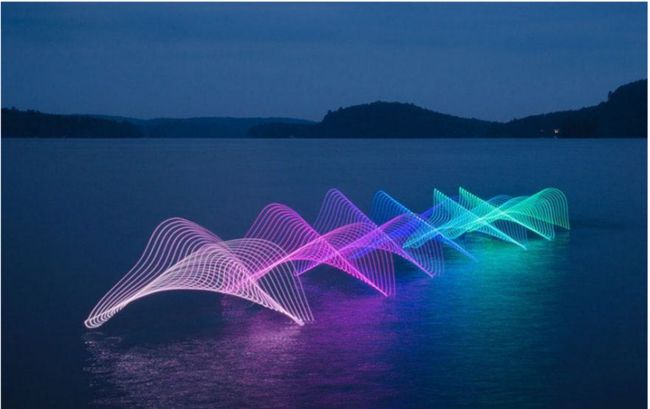

高速摄影

正常曝光 = 极快的快门速度 x(大光圈和/或高 ISO)

高速摄影效果图:

延迟摄影效果图: (非常慢的快门速度)

ISO 增益 (感光度)类似于后期处理

• 更改放大(模拟和/或数字)之间的传感器值和数字图像值

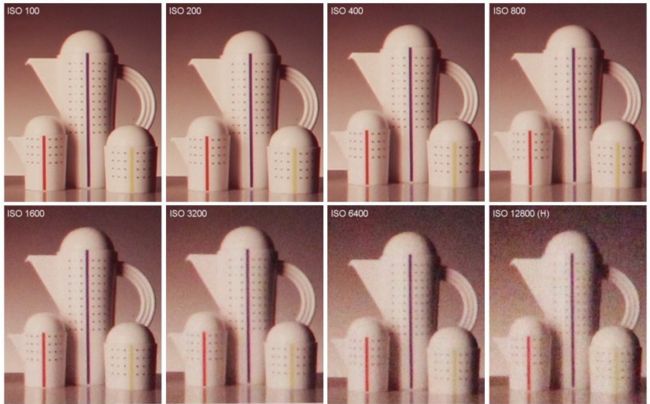

ISO(增益)

曝光的第三个变量

薄膜:颗粒的交易感光度 数字:用感光度换取噪音

• 模数转换前乘法信号

• 线性效果(ISO 200 是 ISO 100 两倍的光线)

效果图:(ISO太大不好)

F-Number (F-Stop): 曝光级别

写作 FN 或 F/N, N 是 所需要求的f 数.

非正式理解:1/圆孔的直径

曝光:光圈、快门、增益(ISO),它们数值大小的区别

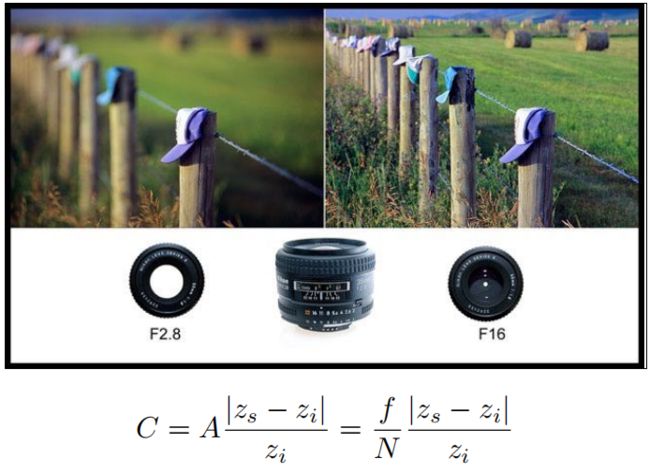

光圈越小, 部分区域越虚化

快门速度越慢, 图片越虚化

ISO只能在小范围调节, 一旦大了肯定有噪音

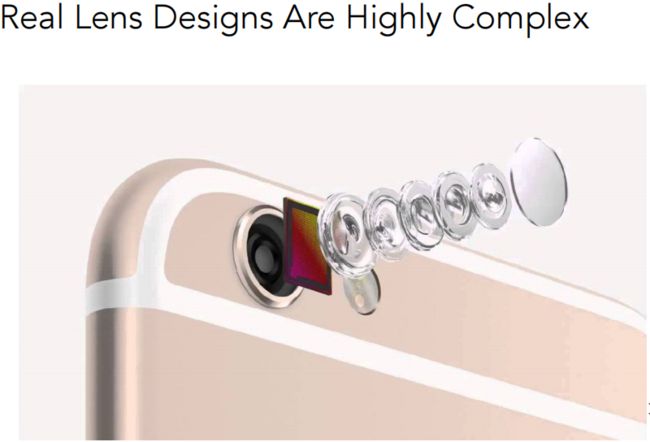

薄透镜近似(Thin Lens Approximation)

现在手机的薄透镜设计都非常复杂, 选择使用多个薄透镜组合, 方便控制焦距

真实的透镜元素并不理想——像差

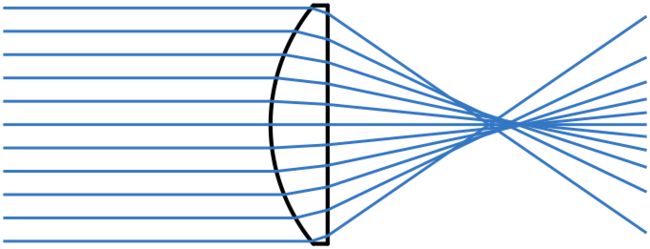

下图为真正的平凸薄透镜(球面形状), 镜头不会将光线会聚到任何地方

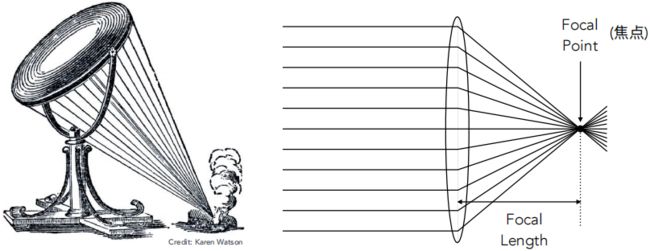

理想的薄透镜——焦点

(1) 进入透镜的所有平行光线都通过其焦点。

(2) 通过一个焦点的所有光线在通过透镜后将是平行的。

(3) 焦距可以任意改变(实际上,是的!)通过多个透镜组合

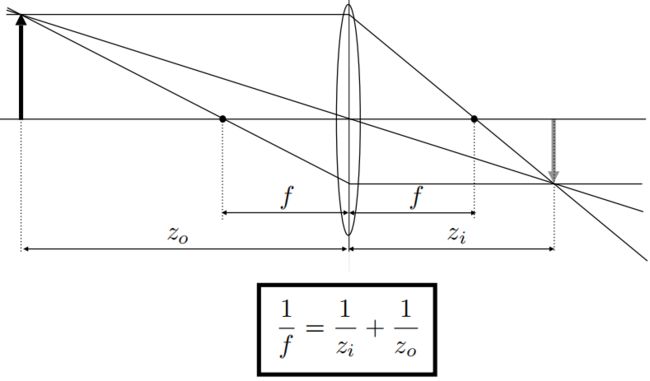

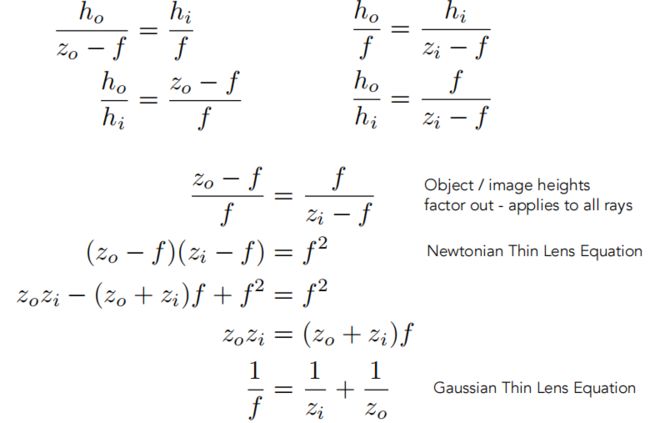

薄透镜公式:

1/焦距 = 1/物距 + 1/像距

z0 : 物距 zi : 像距 f : 焦距

(穿过焦点的光方向不变)

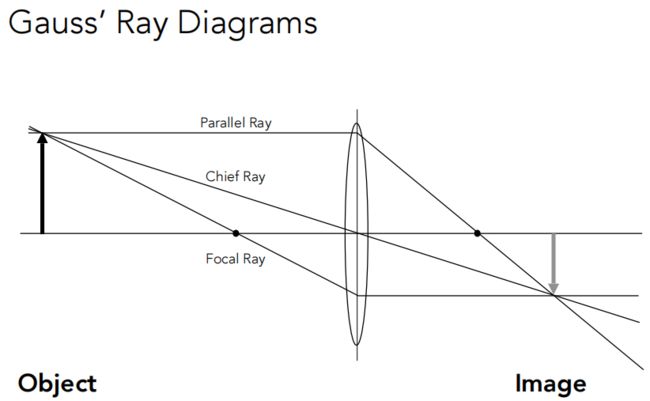

Parallel Ray: 平行光线过透镜变成焦点光线

Focal Ray: 焦点光线过透镜变成平行光线

物距z0和像距zi的关系推导:

![]()

推导过程:

散焦模糊(Defocus Blur)

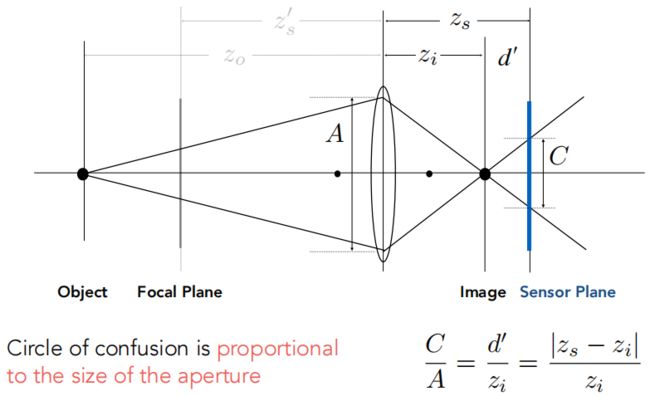

计算COC (弥散圆大小C):

COC(下图中C的范围大小)与光圈大小(A)成正比

所以, 光圈越大越不模糊, 反之则越模糊

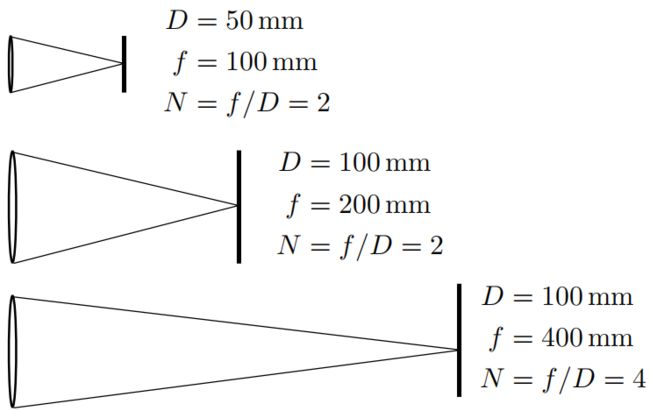

F -number(又名 F-Stop)

• 正式定义:镜头的 f 值定义为:

焦距除以光圈直径 f/A =N(f值)

• 真实透镜上的常见 f-stop:

1.4、2、2.8、4.0、5.6、8、11、16、22、32

• 光圈值为2有时写为 f/2,这反映了

焦距 ( f ) ➗ 绝对光圈直径 (A) = 相对光圈 (N) , 称f值

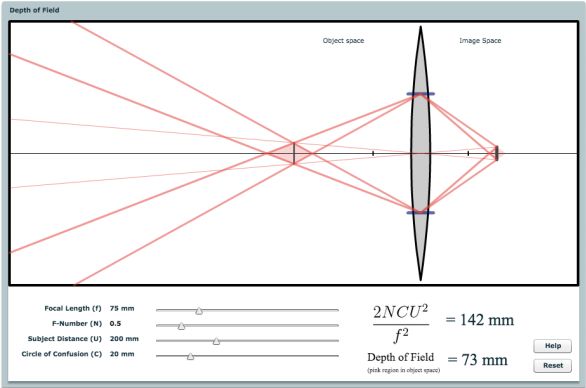

F-Stop计算示例

CoC 的大小与 F-Stop 成反比

光线追踪理想薄透镜

使用镜头对焦的渲染示例

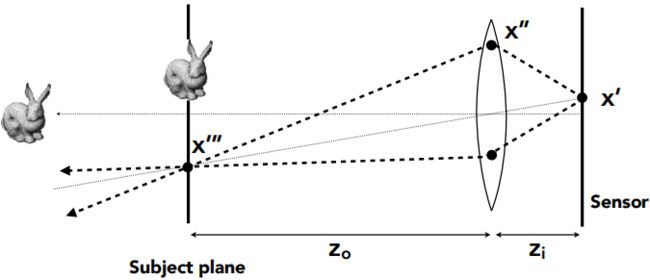

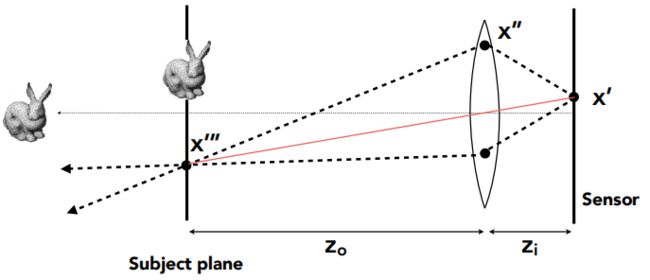

散焦模糊的光线追踪(薄镜头)

(一种可能)设置:

• 选择传感器尺寸、透镜焦距和光圈尺寸

• 选择感兴趣被摄物体的深度 zo

• 根据薄透镜方程计算传感器 zi 的对应深度

渲染过程:

① 遍历传感器上的 x’(实际上是film(胶片)的每个像素)

② 在透镜平面上采样随机点 x''

③ 穿过透镜的光线会射到 x'''(因为 x''' 在焦点上,考虑虚拟光线(x',透镜中心))

④ 估计射线 x'' -> x''' 的辐射度

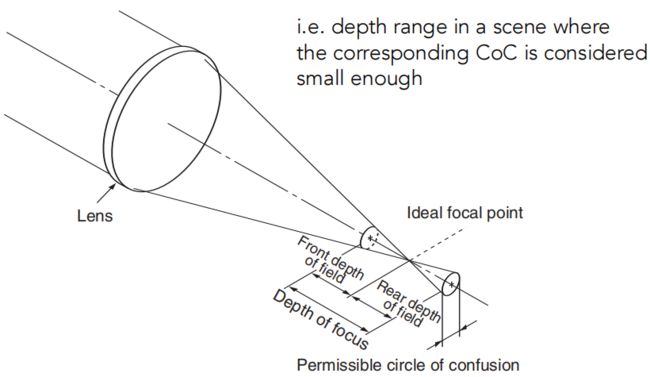

景深 (Depth of Field)

将弥散圈设置为图像平面上允许的最大模糊点,在最终查看条件下会显得清晰

景深的COC

即相应CoC被认为足够小的场景中的深度范围

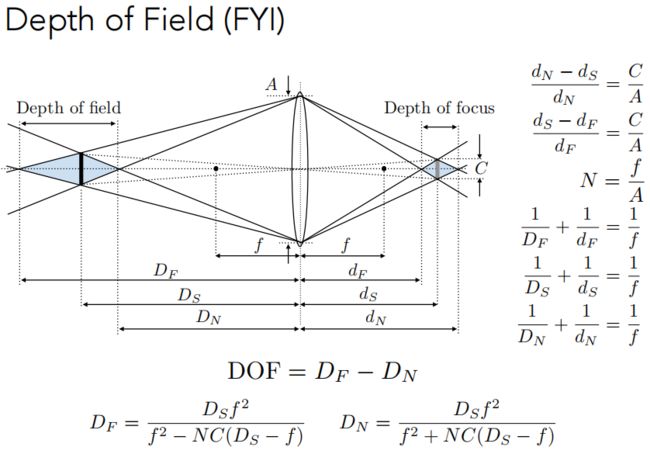

景深的推导:

Depth of Field(景深) Depth of focus(焦深)

景深越大, 成像清晰区域越多, 反之则模糊多

景深和COC, 光圈大小, 焦距和被摄体距离有关

COC越大,被摄体距离越近,光圈越小,焦距越小, 成像清晰区域越多

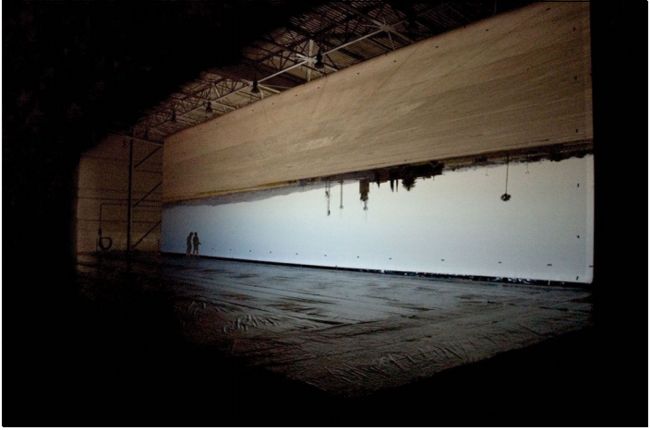

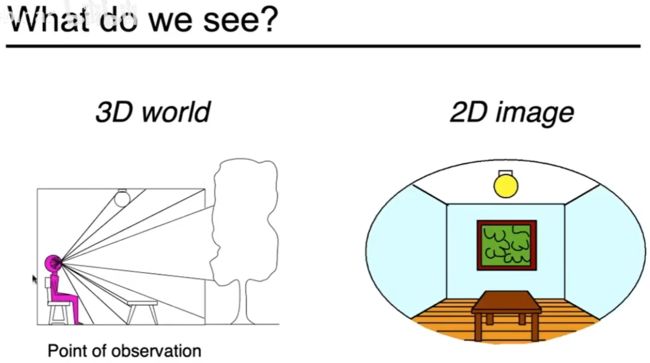

光场(Light Field)

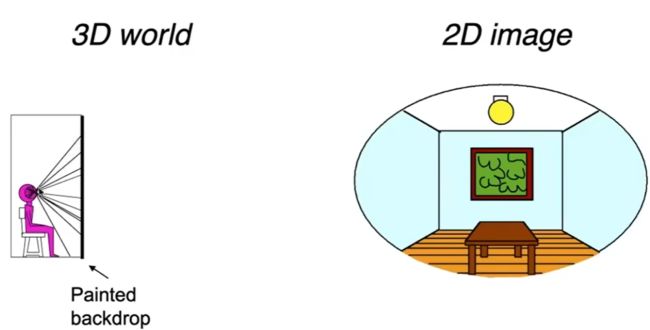

用一个平面记录人眼在3D中看到的(虚拟现实的原理)

光场的逐步完善

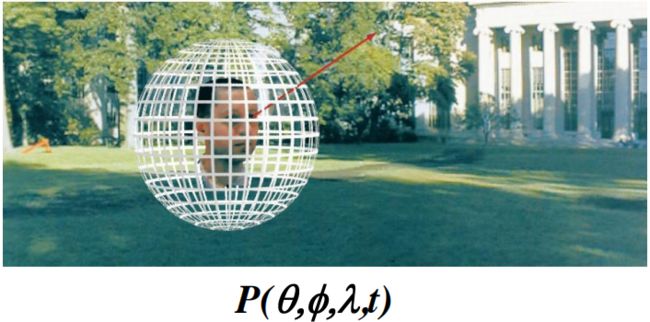

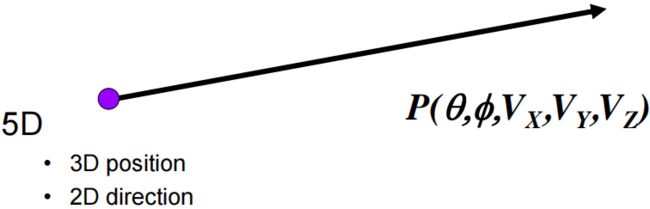

① 全光函数

Q:我们可以看到的所有事物的集合是什么?

A: 全光函数 (Adelson & Bergen)

让我们从一个静止的人开始并尝试参数化他能看到的一切

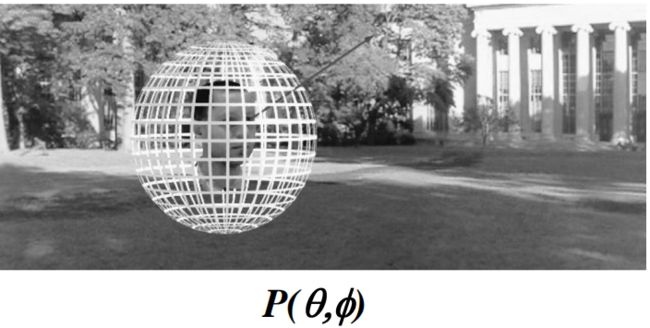

② 灰度快照

是光的强度

• 从单一视点看

• 一次

• 对可见光谱的波长进行"平均"

(也可以做 P(x,y),但球坐标更好)

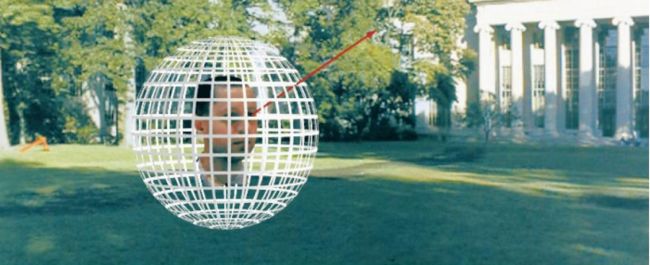

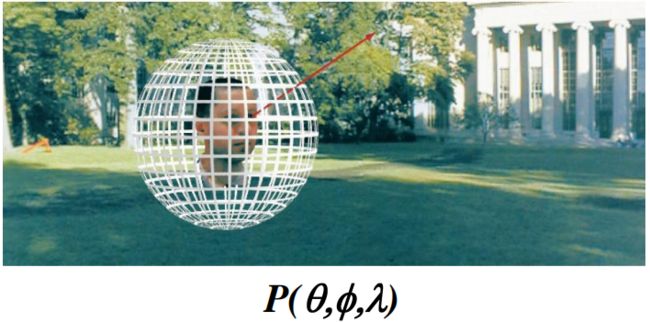

③ 彩色快照

是光的强度

• 从单一视点看

• 一次

• 作为波长的函数

④ 一部电影

是光的强度

• 从单一视点看

• 随着时间的推移

• 作为波长的函数

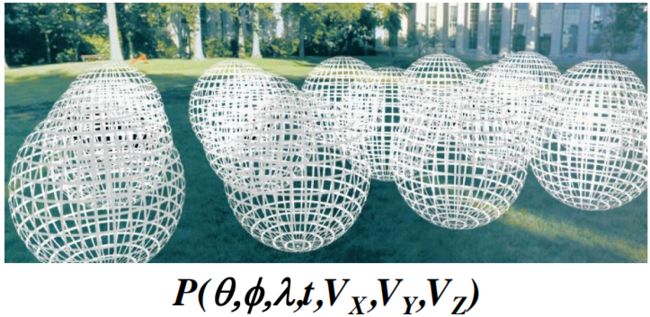

⑤ 全息电影

是光的强度

• 从任何角度看

• 随着时间的推移

• 作为波长的函数

⑥ 全光函数

可以重建每个可能的视图,在每个时刻,从每个位置,在每个波长¸包含每张照片,每部电影,任何人见过的一切!

它完全捕捉我们的视觉现实!作为函数很好.

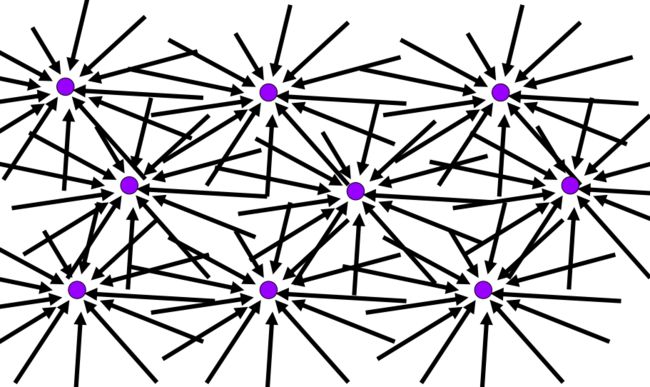

采样全光功能(顶视图)

只需查找——Quicktime VR

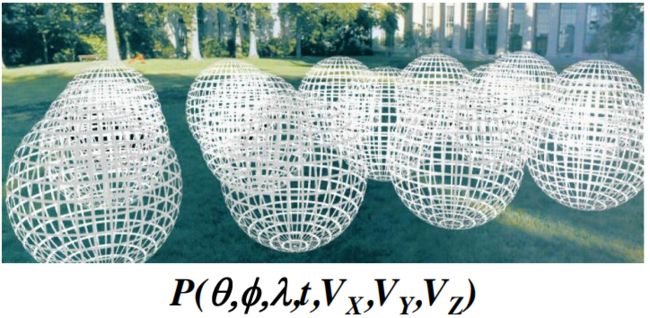

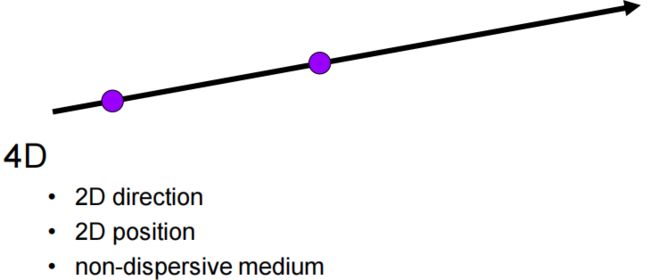

射线

让我们不用担心时间和颜色:

射线重用

无限线

• 假设光是恒定的(真空)

只需要全光面

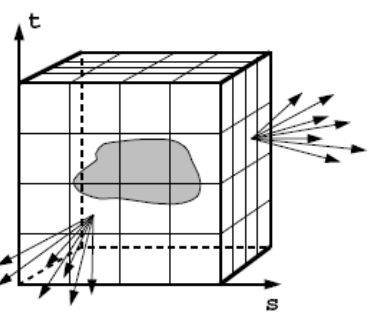

立方体的表面由于封闭的物体而保存了所有的辐射信息

注意看: 右边图的坐标(字母标志)

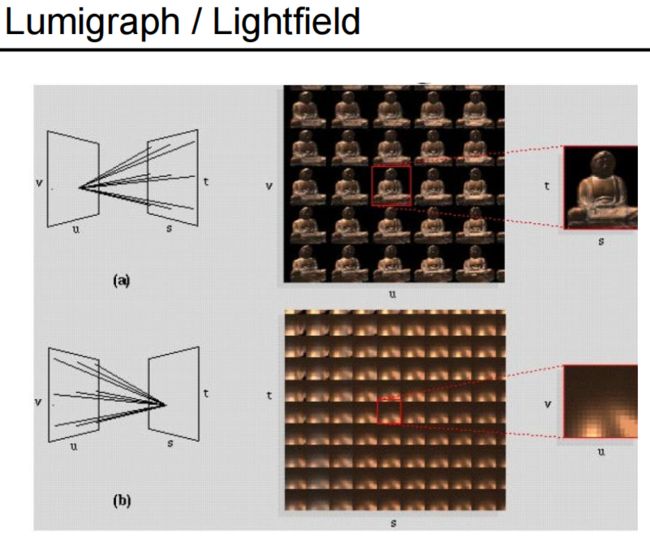

图a: 一个摄像头拍下三维世界所看到的图, 从不同的(u,v)坐标拍三维世界, 能拍到不同方向所呈现的图.

图b: 一个像素点的辐照度irradiance可以分成各个方向的入射辐射度radiance, 可以看到不同方向光打到像素点的radiance是什么. 形成右下的图, 把所有的图合起来就是光场.

把所有radiance分成不同方向的radiance.

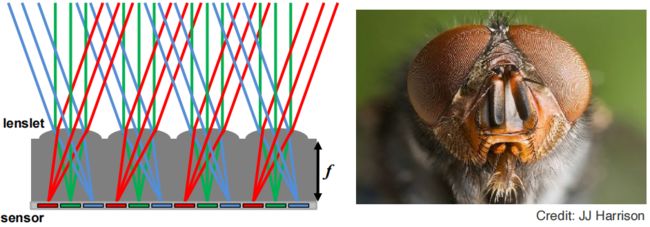

使用小透镜的空间复用光场捕获:

在空间分辨率和角度分辨率之间进行固定权衡

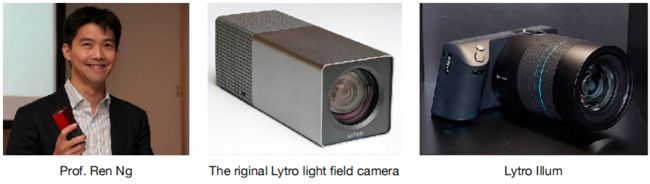

光场相机

Lytro 光场相机

Lytro:由 Ren Ng 教授(加州大学伯克利分校)创立

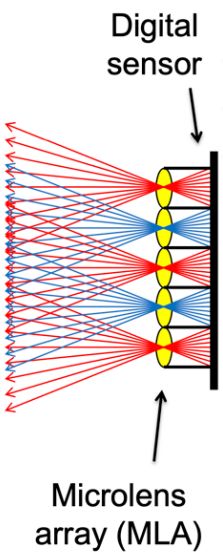

微透镜设计

最重要的功能

• 计算重新聚焦(实际上改变焦距和光圈拍照后尺寸等)

理解

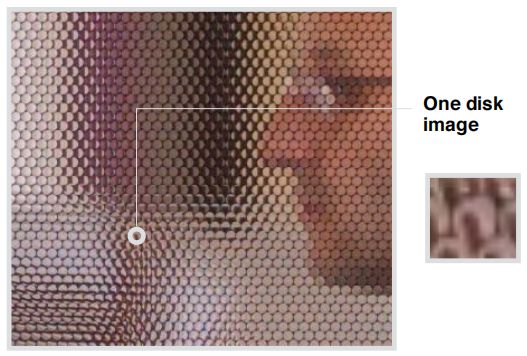

• 每个像素(辐照度)现在存储为一个像素块(辐照度)

• 拍摄照片的特写视图

左图: 为光场照相机所拍摄的, 一个像素块是圆形的, 将像素块平均起来就是原本照相机所拍摄的像素.

总结: 就是将一个像素的irradiance分成多个radiance.

digital sensor: 数字传感器

microlens array(MLA): 微透镜阵列

如何从光场照片中获得“常规”照片?

① 一个简单的例子——总是选择每个块底部的像素(对应仰视拍摄物体)

② 然后是中心的(正面拍摄)和顶部(俯视拍摄)的

③ 本质上是“移动相机”

计算/数字重新聚焦

• 相同的想法:视觉上改变焦距,相应地选择重新聚焦的光线方向

总之,所有这些功能都可用

因为

• 光场包含一切

光场相机有问题吗?

• 空间分辨率不足(用于空间和方向信息的同一胶片)

因为原本只记录一个像素的irradiance, 现在要记录各个方向的radiance.

• 高成本(复杂的微透镜)

• 计算机图形学是关于权衡的(取舍)