【Python实战】使用YOLOV5的一套完整流程

配置环境

目录

配置环境

下载完整yolov5代码

下载官方模型(这就是权重文件)

配套的库

检测环境是否配置成功

训练自己的数据集

在yolov5-master同级目录构建first_data文件夹

区分数据集和验证集

将xml格式的标签文件转换成txt格式Yolov5使用的标签文件

配置yaml文件

修改模型配置文件

进行训练

最终结果

下载完整yolov5代码

提供两种方式 GitHub官网:GitHub - ultralytics/yolov5: YOLOv5 in PyTorch > ONNX > CoreML > TFLite

百度网盘链接:

链接: 百度网盘 请输入提取码 密码: d9db

下载官方模型(这就是权重文件)

GitHub官网:Releases · ultralytics/yolov5 · GitHub (往下翻)

在yolov5-master下创建一个weights文件,将权重文件放进去

配套的库

利用终端完整 cd命令 切至requirement.txt 在Yolov5源码中可以找到

# 在cmd/终端下输入下面的命令

pip install -U -r requirements.txt # Windows环境

pip3 install -U -r requirements.txt # Mac环境

# 如果报错,那就手动安装吧

检测环境是否配置成功

# cmd/终端下输入

# 先进入到yolov5-master文件中,利用cd命令

python3 detect.py --source 0 # 一般是0,但我的电脑是1 -> 打开自带摄像头检测

训练自己的数据集

在yolov5-master同级目录构建first_data文件夹

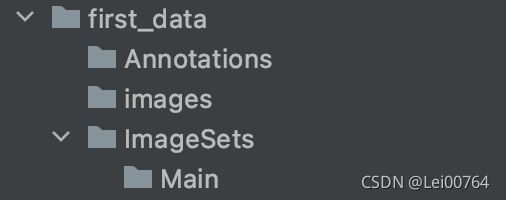

文件名可以任意选择 创建几个新文件夹,如下

文件名一定不要错!!!

最开始需要将图像和对应的xml文件防盗images和Annotations文件夹中

images用于存放图像 Annotations用于存放图像对应的xml文件 ImageSets中的Main文件用来存放test.txt、train.txt、trainval.txt、val.txt

区分数据集和验证集

将下面的代码添加到一个新py文件中,命名为split_train_val.py

# coding:utf-8

import os

import random

import argparse

parser = argparse.ArgumentParser()

# xml文件的地址,根据自己的数据进行修改 xml一般存放在Annotations下

parser.add_argument('--xml_path', default='Annotations', type=str, help='input xml label path')

# 数据集的划分,地址选择自己数据下的ImageSets/Main

parser.add_argument('--txt_path', default='ImageSets/Main', type=str, help='output txt label path')

opt = parser.parse_args()

trainval_percent = 1.0

train_percent = 0.9

xmlfilepath = opt.xml_path

txtsavepath = opt.txt_path

total_xml = os.listdir(xmlfilepath)

if not os.path.exists(txtsavepath):

os.makedirs(txtsavepath)

num = len(total_xml)

list_index = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list_index, tv)

train = random.sample(trainval, tr)

file_trainval = open(txtsavepath + '/trainval.txt', 'w')

file_test = open(txtsavepath + '/test.txt', 'w')

file_train = open(txtsavepath + '/train.txt', 'w')

file_val = open(txtsavepath + '/val.txt', 'w')

for i in list_index:

name = total_xml[i][:-4] + '\\n'

if i in trainval:

file_trainval.write(name)

if i in train:

file_train.write(name)

else:

file_val.write(name)

else:

file_test.write(name)

file_trainval.close()

file_train.close()

file_val.close()

file_test.close()

运行完这个代码后,会在ImageSets/Main文件下生成test.txt、train.txt、trainval.txt、val.txt四个文件,存放的是一系列数字(与图片名字相关),test.txt文件可能为空

将xml格式的标签文件转换成txt格式Yolov5使用的标签文件

# -*- coding: utf-8 -*-

import xml.etree.ElementTree as ET

import os

from os import getcwd

sets = ['train', 'val', 'test']

classes = ["math"] # 改成自己的类别

abs_path = os.getcwd()

print(abs_path)

def convert(size, box):

dw = 1. / (size[0])

dh = 1. / (size[1])

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(image_id):

in_file = open('/Users/doit/Desktop/yolov5/first_data/Annotations/%s.xml' % (image_id), encoding='UTF-8')

out_file = open('/Users/doit/Desktop/yolov5/first_data/labels/%s.txt' % (image_id), 'w')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

# difficult = obj.find('Difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

b1, b2, b3, b4 = b

# 标注越界修正

if b2 > w:

b2 = w

if b4 > h:

b4 = h

b = (b1, b2, b3, b4)

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\\n')

wd = getcwd()

for image_set in sets:

if not os.path.exists('/Users/doit/Desktop/yolov5/first_data/labels/'):

os.makedirs('/Users/doit/Desktop/yolov5/first_data/labels/')

image_ids = open('/Users/doit/Desktop/yolov5/first_data/ImageSets/Main/%s.txt' % (image_set)).read().strip().split()

list_file = open('/Users/doit/Desktop/yolov5/first_data/%s.txt' % (image_set), 'w')

for image_id in image_ids:

list_file.write(abs_path + '/first_data/images/%s.jpg\\n' % (image_id))

convert_annotation(image_id)

list_file.close()

运行完这个代码后

first_data/lables下会生成对应的txt文件,每一个txt文件会有一行或多行数字,每一行数字有五个数组成,代表打标签时画的一个框;

first_data下会生成三个文件,text.txt、train.txt、val.txt,里面存放的是对应图片的路径

配置yaml文件

在first_data文件下新建first.yaml,存放下面的代码 下面的路径要自己修改,nc值,还有class值

train: /Users/doit/Desktop/yolov5/first_data/train.txt

val: /Users/doit/Desktop/yolov5/first_data/val.txt

# number of classes

nc: 1

# class name

names: ['math']

修改模型配置文件

在first_data文件下新建first_yolov5s.yaml,存放下面的代码 这里我使用的是最小的那个模型,也可以选择其他模型,在yolov5-master/models下 ,复制过来即可 注意修改nc值

# YOLOv5 by Ultralytics, GPL-3.0 license

# Parameters

nc: 1 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.50 # layer channel multiple

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# YOLOv5 v6.0 backbone

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [64, 6, 2, 2]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, C3, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 6, C3, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 9, C3, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 3, C3, [1024]],

[-1, 1, SPPF, [1024, 5]], # 9

]

# YOLOv5 v6.0 head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 17 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 20 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 23 (P5/32-large)

[[17, 20, 23], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

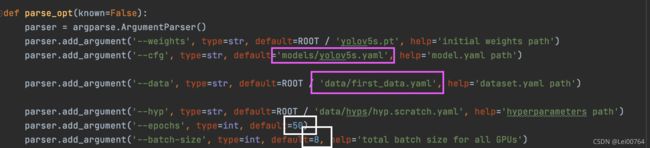

进行训练

主要就是修改两个粉色框框里面的内容

第一个粉色框框指向“修改模型配置文件”的路径 第二个粉色框框指向“配置yaml文件”

白色框框里面的数据根据自己电脑的性能来调节 epochs:训练过程中整个数据集将被迭代的次数 batch-size:一次看完多少张图片才进行权重更新