论文阅读:Gradient-Induced Co-Saliency Detection(ECCV2020)

ECCV 2020 paper

github代码![]() https://github.com/zzhanghub/gicd论文主要工作:

https://github.com/zzhanghub/gicd论文主要工作:

针对协同显著性检测问题,提交检测精度。

方法:首先,我们对一组图像在高维嵌入空间中抽象出其一致特征表示,一旦获得一致表示,我们提出了梯度诱导模块(Gradient Inducing Module, GIM)来模仿人类行为,将特定场景与一致描述进行比较,以反馈匹配信息。

为了更好地评价Co-SOD方法在多个前景中发现共同显著目标的能力,在一个评价数据集中,除共同显著目标外,大多数图像都应该包含至少一个不相关的显著前景。从图3可以看出,目前的CoSOD数据集忽略了这一点[2,11,45,51]。为了缓解这个问题,我们精心构造了一个更具挑战性的数据集,名为公共类别聚合(Common Category Aggregation, CoCA)。

在GIM中,可以首先度量单图表示和一致表示之间的相似性。高层卷积层的卷积核代表不同的语义,我们可以找出与图像组公共特征比较相关的卷积核,对其进行增强,从而检测出共同显著目标。 by partially back-propagating ,我们计算相对于顶层卷积层的相似度梯度作为反馈信息。高梯度值均值对应的核对相似度结果有正向影响;因此,通过给这些核赋予更多的权重,模型将被诱导关注于共同显著的相关特征。

此外,为了更好地区分自顶向下解码器各层的共同显著对象,我们提出了一个注意保留模块(ARM)来连接我们的模型中相应的编码器和解码器对。我们将这种包含GIM和ARM的两阶段框架称为梯度诱导共显著性检测(Gradient-Induced Co-saliency Detection, GICD)网络。

综上所述,我们的主要贡献如下:

我们提出了一个用于Co-SOD的梯度诱导共显著性检测(GICD)网络。具体而言,我们提出了一个梯度诱导模块(GIM)来关注判别共同显著性特征,以及一个注意保持模块(ARM)来保持自顶向下解码过程中的注意。

我们提出了一种拼图策略,在普通SOD数据集上训练Co-SOD模型,而不需要额外的像素级注释,以缓解缺乏Co-SOD训练数据的问题。

我们构建了一个具有挑战性的具有细致注释的CoCA数据集,提供了实际的场景来更好地评估Co-SOD方法。

在CoSal2015[51]和我们的CoCA数据集上的实验表明,我们的GICD优于以前的Co-SOD方法。广泛的消融研究证实了我们的贡献的有效性。

(1)Learning Consensus Representation

用vgg网络学习一个公共表示。

(2)Gradient Inducing Module

获得公共特征表示后,我们的重点是如何找到与公共特征表示相匹配的判别式特征。High-level convolutional layers naturally possess semantic-specific spatial information

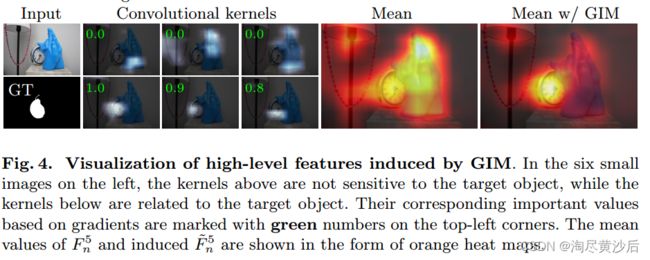

在图4中,我们展示了encoder 的最后一个卷积层F5的特征图。输入图像(第1列)包含怀表和蓝色手套,卷积核聚焦于不同的区域(第2至第4列)。如果对这些与共同显著目标密切相关的核赋予更多的重要性,则模型将倾向于通过对诱导特征的解码来分割共同显著目标(怀表)。

(Grad-CAM论文)中指出,神经网络中特征的可分辨性可以通过优化目标得到的梯度来衡量。因此,我们提出了一个梯度诱导模块(GIM),通过探索反馈的梯度信息(feedback gradient information)来增强识别特征。

对于提取的第n幅图像表示en,其与一致表示![]() 的相似度cn可以用内积来定义:

的相似度cn可以用内积来定义:

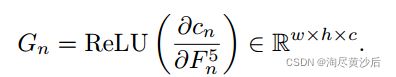

之后我们把正向梯度![]() 回流到最后一层卷积层

回流到最后一层卷积层![]() 中用以选择

中用以选择![]() 中的判别式特征:

中的判别式特征:

在该有偏向的反向传播中,正梯度Gn反映了对应位置对最终相似度得分的敏感性;也就是说,用更大的梯度增加激活值,会使特定表示更符合共识表示。因此,卷积核对于特定对象的重要性可以通过其特征梯度的平均值来衡量。具体来说,通道的重要值可以通过全局平均池(GAP)来计算。

一旦获得权重,我们可以通过给每个核赋予重要值来诱导高级特征:

如图4所示,如果没有我们的GIM模块,核将平均关注这两个对象。可以看到,与共同显著性类别越相关的核具有越高的梯度权重(用绿色数字标记),梯度诱导后,网络的注意力转移到共同显著性对象上。

(3)注意保留模块 Attention Retaining Module

在GIM中,梯度诱导了高阶特征。而自顶向下解码器是建立在自底向上的主干上的,诱导的高层特征在传递到底层时会逐渐耗损。为此,我们提出了一个注意保持模块(ARM)来连接我们的GICD网络中相应的编码器-解码器对。

如图2所示,对于每个ARM,用于跳接的编码器的特征都是由更高层次的 prediction 来引导的。通过自顶向下的迭代提醒,在不受其他无关物体干扰的情况下,网络将重点放在协同显著区域的细节恢复上。

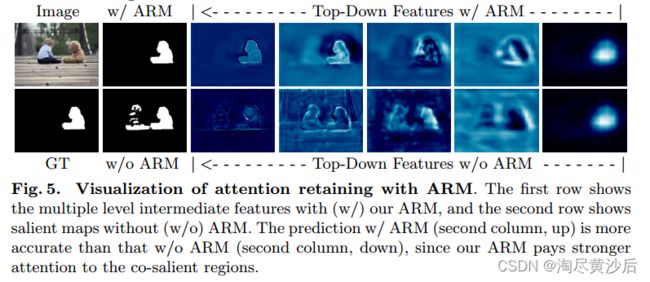

为了验证我们的ARM的有效性,在图5中,我们展示了有ARM(第一行)和没有ARM(第二行)的解码器在不同级别上的中间特性。我们观察到,通过GIM都能成功定位共同显著目标(Teddy bear),而我们的无ARM的GICD在上采样过程中会逐渐受到其他显著目标的干扰,产生不准确的检测结果。这些结果表明,我们的ARM能够有效地将注意力保持在相关图像的共同显著目标上

训练策略与数据集Jigsaw Training Strategy

我们设计了一种拼图策略,将SOD数据集转换为适合Co-SOD模型的训练数据:步骤1:我们使用分类器[31]对每个SOD数据集进行分类,因为它没有类别信息。第二步,我们将一个类别的样本与其他类别的样本进行拼接,形成一个新的拼图,如图6所示。这一步是为了确保输入图像不仅包含一个共同突出的前景,而且还包含无关的前景对象。