CP-net第三部分解读

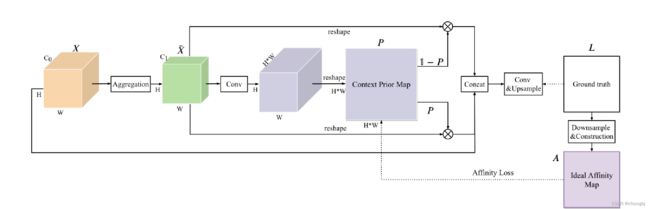

1.首先介绍一下网络结构

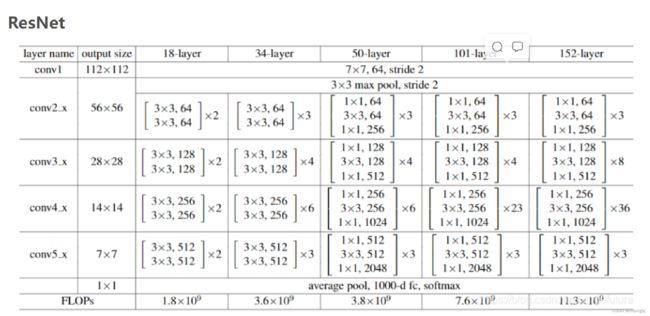

上下文先验网络(CPNet)是一个完全卷积的网络,由主干网和上下文先验层组成,主干网是一个现成的卷积网络,例如ResNet,具有扩展策略。

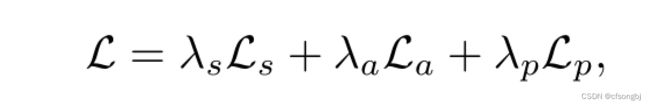

2.介绍一下损失函数

三部分组成:亲和力损失,分割监督(交叉熵损失函数)。我们在主干网络的第4阶段采用了辅助损耗,这也是一种交叉熵损耗。最终损失函数如下所示:

其中,Ls、La和Lp分别代表主要的分割损失、辅助损失和亲和力损失函数。此外,λs、λa和λp分别是平衡分割损失、辅助损失和亲和力损失的权重。根据经验,我们将权重设置为:λs=1和λp=1。与类似,我们设置了权重:λa=0.4。

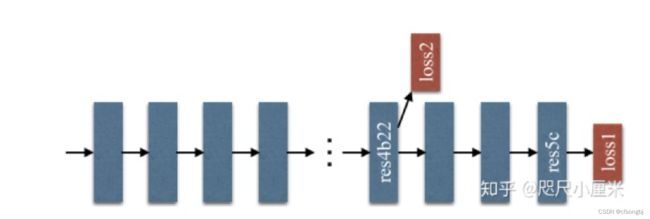

3.介绍一下主干网结构resnet的改进

上图显示了ResNet101模型的训练示例。除了使用softmax损失来训练final分类器的主分支外(loss1),在第四阶段之后还应用了另一个分类器,即res4b22。与将反向辅助损耗阻止到几个浅层的中继反向传播不同,我们让两个损耗函数通过所有先前的层。两个loss一起传播,使用不同的权重,共同优化参数。后续的实验证明这样做有利于快速收敛, loss2有助于优化学习过程,而loss1决定最终分类。loss2进行了权值平衡。

在第四阶段之后还应用了另一个分类器,即res4b22,我们可以从resnet代码中清晰的看到,调用了损失函数,即辅助损失。

4.介绍一下实验的实施细节

主要从四个方面来介绍:

1.网络:我们采用ResNet作为我们的预训练模型,并采用了扩张策略。然后采用双线性插值对预测进行八次上采样,计算分割损失。

2.数据扩充。在训练阶段,我们对输入图像应用均值减法、随机水平翻转和随机尺度,其中包含{0.5,0.75,1.0,1.5,1.75,2.0},以避免过度拟合。最后,我们随机裁剪大图像或将小图像填充到固定大小以进行训练(ADE20K为480×480,PASCAL上下文为512×512,城市景观为768×768)。

3.优化。我们使用随机梯度下降(SGD)算法微调CPNet模型,“poly”学习率策略:,其中Niter和Ntotal代表当前迭代次数和总迭代次数,p=0.9。

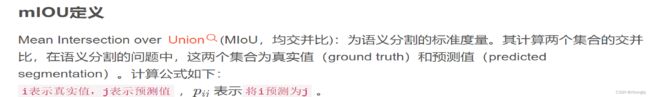

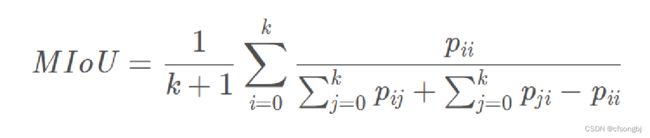

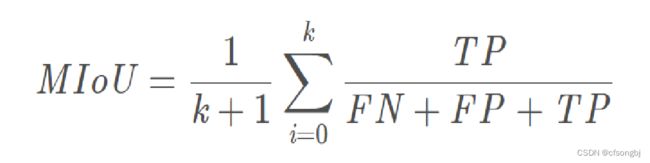

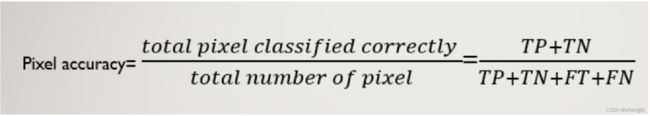

4.我们采用像素精度(pixAcc)和联合平均交集(mIoU)作为评估指标。

5.介绍两个评估指标

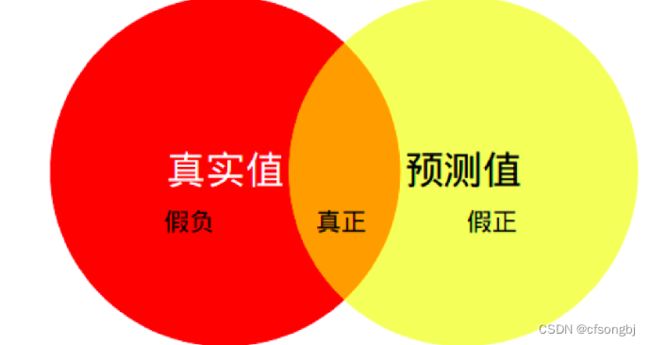

分类任务,预测的结果往往就是四种情况:

true positive(TP)TP(真正): 预测正确, 预测结果 = 真实 = 正类 ;

false positive(FP)FP(假正): 预测错误, 预测结果 = 正类 ≠ 真实 = 负类;

true negative(TN)FN(假负): 预测错误, 预测结果 = 负类 ≠ 真实 = 正类;

false negative(FN)TN(真负): 预测正确, 预测结果 = 负类 = 真实 = 负类;

也等价于: