动手学深度学习(二十二)——GoogLeNet:CNN经典模型(五)

文章目录

-

- 1. 含并行连结的网络(GoogLeNet)

-

- 1.1 Inception块

- 1.2 GoogLeNet模型

- 2. 动手实现简化的GoogLeNet模型

-

- 2.1 实现Inception块

- 2.2 构建GoogleNet模型

- 2.3 验证网络架构

- 2.4 训练网络

- 2.5 绘图查看效果

- 3. 总结

1. 含并行连结的网络(GoogLeNet)

在2014年的ImageNet图像识别挑战赛中,一个名叫GoogLeNet Szegedy.Liu.Jia.ea.2015 的网络结构大放异彩。GoogLeNet吸收了NiN中串联网络的思想,并在此基础上做了改进。

这篇论文的一个重点是解决了什么样大小的卷积核最合适的问题。毕竟,以前流行的网络使用小到 1 × 1 1 \times 1 1×1 ,大到 11 × 11 11 \times 11 11×11 的卷积核。本文的一个观点是,有时使用不同大小的卷积核组合是有利的。

在本节中,我们将介绍一个稍微简化的GoogLeNet版本:我们省略了一些为稳定训练而添加的特殊特性,但是现在有了更好的训练算法,这些特性不是必要的。

1.1 Inception块

在GoogLeNet中,基本的卷积块被称为Inception块(Inception block)。这很可能得名于电影《盗梦空间》(Inception),因为电影中的一句话“我们需要走得更深”(“We need to go deeper”)。

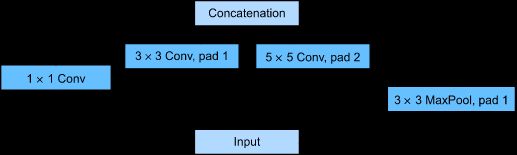

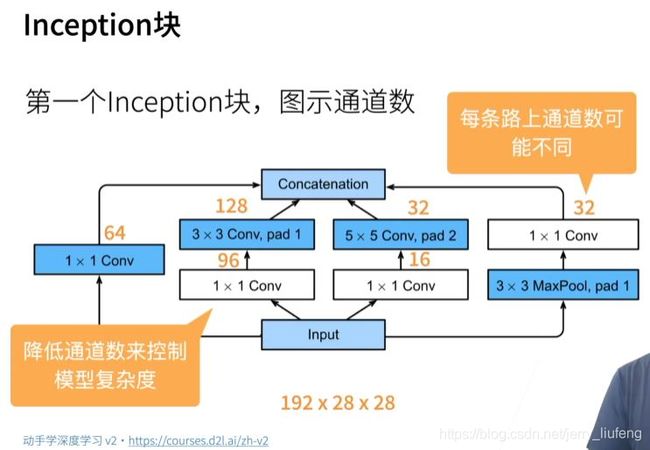

如上图所示,Inception块由四条并行路径组成。前三条路径使用窗口大小为 1 × 1 1\times 1 1×1、 3 × 3 3\times 3 3×3 和 5 × 5 5\times 5 5×5 的卷积层,从不同空间大小中提取信息。中间的两条路径在输入上执行 1 × 1 1\times 1 1×1 卷积,以减少通道数,从而降低模型的复杂性。第四条路径使用 3 × 3 3\times 3 3×3 最大池化层,然后使用 1 × 1 1\times 1 1×1 卷积层来改变通道数。这四条路径都使用合适的填充来使输入与输出的高和宽一致,最后我们将每条线路的输出在通道维度上连结,并构成Inception块的输出。在Inception块中,通常调整的超参数是每层输出通道的数量。

【为什么使用inception块?】

跟 3 × 3 3 \times 3 3×3 和 5 × 5 5 \times 5 5×5的卷积层比起来,inception块有更少的参数个数和计算复杂度

1.2 GoogLeNet模型

GoogLeNet 一共使用 9 个Inception块和全局平均池化层的堆叠来生成其估计值。Inception块之间的最大池化层可降低维度。第一个模块类似于 AlexNet 和 LeNet,Inception块的栈从VGG继承,全局平均池化层避免了在最后使用全连接层。

2. 动手实现简化的GoogLeNet模型

2.1 实现Inception块

import torch

from torch import nn

from torch.nn import functional as F

from d2l import torch as d2l

class Inception(nn.Module):

def __init__(self,in_channels,c1,c2,c3,c4,**kwargs):

super(Inception,self).__init__(**kwargs)

# 线路1,单1 x 1卷积层

self.p1_1 = nn.Conv2d(in_channels, c1, kernel_size=1)

# 线路2,1 x 1卷积层后接3 x 3卷积层

self.p2_1 = nn.Conv2d(in_channels, c2[0], kernel_size=1)

self.p2_2 = nn.Conv2d(c2[0], c2[1], kernel_size=3, padding=1)

# 线路3,1 x 1卷积层后接5 x 5卷积层

self.p3_1 = nn.Conv2d(in_channels, c3[0], kernel_size=1)

self.p3_2 = nn.Conv2d(c3[0], c3[1], kernel_size=5, padding=2)

# 线路4,3 x 3最大池化层后接1 x 1卷积层

self.p4_1 = nn.MaxPool2d(kernel_size=3, stride=1, padding=1)

self.p4_2 = nn.Conv2d(in_channels, c4, kernel_size=1)

def forward(self,x):

p1 = F.relu(self.p1_1(x))

p2 = F.relu(self.p2_2(F.relu(self.p2_1(x))))

p3 = F.relu(self.p3_2(F.relu(self.p3_1(x))))

p4 = F.relu(self.p4_2(self.p4_1(x)))

# 在通道维度上连结输出

return torch.cat((p1, p2, p3, p4), dim=1)

2.2 构建GoogleNet模型

(1)第一个模块使用

64 个通道、 7 × 7 7\times 7 7×7 卷积层。

b1 = nn.Sequential(nn.Conv2d(1, 64, kernel_size=7, stride=2, padding=3),

nn.ReLU(), nn.MaxPool2d(kernel_size=3, stride=2,

padding=1))

(2)第二个模块使用两个卷积层:

第一个卷积层是 64个通道、 1 × 1 1\times 1 1×1 卷积层;第二个卷积层使用将通道数量增加三倍的 3 × 3 3\times 3 3×3 卷积层。这对应于 Inception 块中的第二条路径。

b2 = nn.Sequential(nn.Conv2d(64, 64, kernel_size=1), nn.ReLU(),

nn.Conv2d(64, 192, kernel_size=3, padding=1),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1))

(3)第三个模块串联两个完整的Inception块。

第一个 Inception 块的输出通道数为 64 + 128 + 32 + 32 = 256 64+128+32+32=256 64+128+32+32=256,四个路径之间的输出通道数量比为 64 : 128 : 32 : 32 = 2 : 4 : 1 : 1 64:128:32:32=2:4:1:1 64:128:32:32=2:4:1:1。

第二个和第三个路径首先将输入通道的数量分别减少到 96 / 192 = 1 / 2 96/192=1/2 96/192=1/2 和 16 / 192 = 1 / 12 16/192=1/12 16/192=1/12,然后连接第二个卷积层。第二个 Inception 块的输出通道数增加到 128 + 192 + 96 + 64 = 480 128+192+96+64=480 128+192+96+64=480,四个路径之间的输出通道数量比为 128 : 192 : 96 : 64 = 4 : 6 : 3 : 2 128:192:96:64 = 4:6:3:2 128:192:96:64=4:6:3:2。

第二条和第三条路径首先将输入通道的数量分别减少到 128 / 256 = 1 / 2 128/256=1/2 128/256=1/2 和 32 / 256 = 1 / 8 32/256=1/8 32/256=1/8。

b3 = nn.Sequential(Inception(192, 64, (96, 128), (16, 32), 32),

Inception(256, 128, (128, 192), (32, 96), 64),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1))

(4)第四模块更加复杂,它串联了5个Inception块

其输出通道数分别是 192 + 208 + 48 + 64 = 512 192+208+48+64=512 192+208+48+64=512 、 160 + 224 + 64 + 64 = 512 160+224+64+64=512 160+224+64+64=512 、 128 + 256 + 64 + 64 = 512 128+256+64+64=512 128+256+64+64=512 、 112 + 288 + 64 + 64 = 528 112+288+64+64=528 112+288+64+64=528 和 256 + 320 + 128 + 128 = 832 256+320+128+128=832 256+320+128+128=832 。

这些路径的通道数分配和第三模块中的类似,首先是含 3 × 3 3×3 3×3 卷积层的第二条路径输出最多通道,其次是仅含 1 × 1 1×1 1×1 卷积层的第一条路径,之后是含 5 × 5 5×5 5×5 卷积层的第三条路径和含 3 × 3 3×3 3×3 最大池化层的第四条路径。

其中第二、第三条路径都会先按比例减小通道数。

这些比例在各个 Inception 块中都略有不同。

b4 = nn.Sequential(Inception(480, 192, (96, 208), (16, 48), 64),

Inception(512, 160, (112, 224), (24, 64), 64),

Inception(512, 128, (128, 256), (24, 64), 64),

Inception(512, 112, (144, 288), (32, 64), 64),

Inception(528, 256, (160, 320), (32, 128), 128),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1))

(5)第五模块

包含输出通道数为 256 + 320 + 128 + 128 = 832 256+320+128+128=832 256+320+128+128=832 和 384 + 384 + 128 + 128 = 1024 384+384+128+128=1024 384+384+128+128=1024 的两个Inception块。

其中每条路径通道数的分配思路和第三、第四模块中的一致,只是在具体数值上有所不同。

需要注意的是,第五模块的后面紧跟输出层,该模块同 NiN 一样使用全局平均池化层,将每个通道的高和宽变成1。

最后我们将输出变成二维数组,再接上一个输出个数为标签类别数的全连接层。

b5 = nn.Sequential(Inception(832, 256, (160, 320), (32, 128), 128),

Inception(832, 384, (192, 384), (48, 128), 128),

nn.AdaptiveAvgPool2d((1, 1)), nn.Flatten())

net = nn.Sequential(b1, b2, b3, b4, b5, nn.Linear(1024, 10))

2.3 验证网络架构

GoogLeNet 模型的计算复杂,而且不如 VGG 那样便于修改通道数。

[为了使Fashion-MNIST上的训练短小精悍,我们将输入的高和宽从224降到96],这简化了计算。下面演示各个模块输出的形状变化。

X = torch.rand(size=(1, 1, 96, 96))

for layer in net:

X = layer(X)

print(layer.__class__.__name__, 'output shape:\t', X.shape)

Sequential output shape: torch.Size([1, 64, 24, 24])

Sequential output shape: torch.Size([1, 192, 12, 12])

Sequential output shape: torch.Size([1, 480, 6, 6])

Sequential output shape: torch.Size([1, 832, 3, 3])

Sequential output shape: torch.Size([1, 1024])

Linear output shape: torch.Size([1, 10])

2.4 训练网络

# 读取数据

from torchvision import transforms

import torchvision

from torch.utils import data

batch_size = 256

def get_dataloader_workers():

"""使用四个进程读取数据"""

return 4

def load_data_fashion_mnist(batch_size,resize=None):

"""下载Fashion-MNIST数据集,并将其保存至内存中"""

trans = [transforms.ToTensor()]

if resize:

trans.insert(0,transforms.Resize(resize)) # transforms.Resize将图片最小的一条边缩放到指定大小,另一边缩放对应比例

trans = transforms.Compose(trans) # compose用于串联多个操作

mnist_train = torchvision.datasets.FashionMNIST(root="./data",

train=True,

transform=trans,

download=True)

mnist_test = torchvision.datasets.FashionMNIST(root="./data",

train=False,

transform=trans,

download=True)

return (data.DataLoader(mnist_train,batch_size,shuffle=True,

num_workers=get_dataloader_workers()),

data.DataLoader(mnist_test,batch_size,shuffle=True,

num_workers = get_dataloader_workers()))

def evaluate_accuracy_gpu(net, data_iter, device=None): #@save

"""使用GPU计算模型在数据集上的精度。"""

if isinstance(net, torch.nn.Module):

net.eval() # 设置为评估模式

if not device:

device = next(iter(net.parameters())).device

# 正确预测的数量,总预测的数量

metric = d2l.Accumulator(2)

for X, y in data_iter:

if isinstance(X, list):

# BERT微调所需的(之后将介绍)

X = [x.to(device) for x in X]

else:

X = X.to(device)

y = y.to(device)

metric.add(d2l.accuracy(net(X), y), y.numel())

return metric[0] / metric[1]

#@save

def train(net, train_iter, test_iter, num_epochs, lr, device):

"""用GPU训练模型"""

def init_weights(m):

if type(m) == nn.Linear or type(m) == nn.Conv2d:

nn.init.xavier_uniform_(m.weight)

net.apply(init_weights)

print('training on', device)

net.to(device) # 将网络挪到gpu上

optimizer = torch.optim.SGD(net.parameters(), lr=lr)

loss = nn.CrossEntropyLoss()

animator = d2l.Animator(xlabel='epoch', xlim=[1, num_epochs],

legend=['train loss', 'train acc', 'test acc'])

timer, num_batches = d2l.Timer(), len(train_iter)

for epoch in range(num_epochs):

# 训练损失之和,训练准确率之和,范例数

metric = d2l.Accumulator(3)

net.train()

for i, (X, y) in enumerate(train_iter):

timer.start()

optimizer.zero_grad()

X, y = X.to(device), y.to(device)

y_hat = net(X)

l = loss(y_hat, y)

l.backward()

optimizer.step()

with torch.no_grad():

metric.add(l * X.shape[0], d2l.accuracy(y_hat, y), X.shape[0])

timer.stop()

train_l = metric[0] / metric[2]

train_acc = metric[1] / metric[2]

if (i + 1) % (num_batches // 5) == 0 or i == num_batches - 1:

animator.add(epoch + (i + 1) / num_batches,

(train_l, train_acc, None))

test_acc = evaluate_accuracy_gpu(net, test_iter)

animator.add(epoch + 1, (None, None, test_acc))

print(f'loss {train_l:.3f}, train acc {train_acc:.3f}, '

f'test acc {test_acc:.3f}')

print(f'{metric[2] * num_epochs / timer.sum():.1f} examples/sec '

f'on {str(device)}')

lr, num_epochs, batch_size = 0.1, 10, 128

train_iter, test_iter = load_data_fashion_mnist(batch_size, resize=96)

train(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

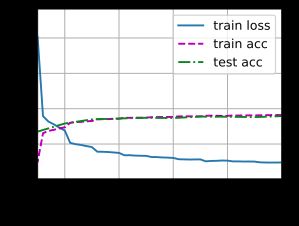

loss 0.239, train acc 0.909, test acc 0.895

655.4 examples/sec on cuda:0

2.5 绘图查看效果

import matplotlib.pyplot as plt

# 验证数据

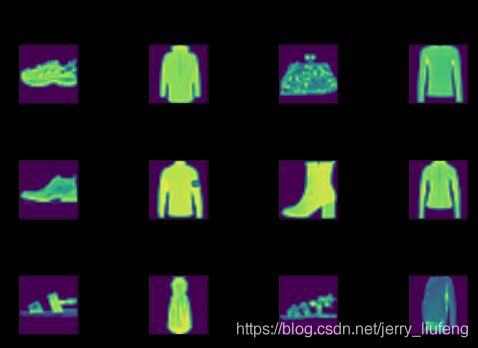

def predict(net, test_iter, n=6): #@save

"""预测标签"""

for X, y in test_iter:

break

trues = d2l.get_fashion_mnist_labels(y)

device = torch.device('cuda:0')

X_gpu = X.to(device)

preds = d2l.get_fashion_mnist_labels(net(X_gpu).argmax(axis=1))

titles = [true + '\n' + pred for true, pred in zip(trues, preds)]

# 绘图

fig, ax = plt.subplots(

nrows=3,

ncols=4,

sharex=True,

sharey=True,

)

ax = ax.flatten()

for i in range(12):

# 只查看了前面12张图片

img = X[i].reshape(96,96)

ax[i].imshow(img)

ax[i].set(title=titles[i])

ax[0].set_xticks([])

ax[0].set_yticks([])

plt.tight_layout()

plt.show()

predict(net, test_iter)

3. 总结

- Inception 块相当于一个有4条路径的子网络。它通过不同窗口形状的卷积层和最大池化层来并行抽取信息,并使用 1 × 1 1×1 1×1 卷积层减少每像素级别上的通道维数从而降低模型复杂度。(多种卷积融合,抽取特征的同时减小了模型的复杂度)

- GoogLeNet将多个设计精细的Inception块与其他层(卷积层、全连接层)串联起来。其中Inception块的通道数分配之比是在 ImageNet 数据集上通过大量的实验得来的。(正式开启炼丹师的进阶之路)

- GoogLeNet 和它的后继者们一度是 ImageNet 上最有效的模型之一:它以较低的计算复杂度提供了类似的测试精度。

- 可以看见GoogLeNet在

Fashion-MNIST上的测试精度达到了89%,这个精度是没有VGG网络模型高的,其运行速度相类似。GoogLeNet是第一个深度(并非值存粹的深度)超过100层的网络。

相关链接

[1] 《pytorch学习(二十一)——NiN:CNN经典模型(四)》

[2] 《pytorch学习(二十)——VGG:(2014年ILSVRC竞赛第二名模型)》

[3] 《pytorch学习(十九)——AlexNet:CNN经典网络(二)更深+更大》

[4] 《pytorch学习(十八)——LeNet:CNN经典网络(一)》