【动手学深度学习】反向传播+神经网络基础

学习资料:

[5分钟深度学习] #02 反向传播算法_哔哩哔哩_bilibili

4.7. 前向传播、反向传播和计算图 — 动手学深度学习 2.0.0 documentation (d2l.ai)

[5分钟深度学习] #01 梯度下降算法_哔哩哔哩_bilibili 加深了对梯度下降和随机梯度下降的理解

24-梯度消失和梯度爆炸-Xavier初始化详解-pytorch-2021_哔哩哔哩_bilibili

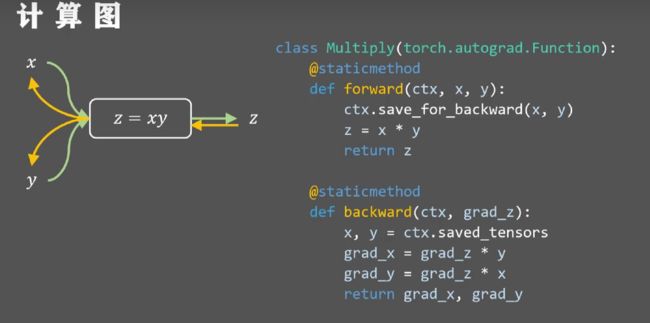

一、 前向传播 反向传播 计算图

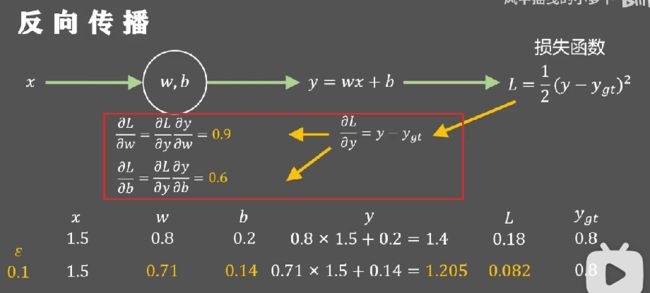

在训练神经网络时,在初始化模型参数后, 我们交替使用前向传播和反向传播,利用反向传播给出的梯度来更新模型参数。 注意,反向传播重复利用前向传播中存储的中间值,以避免重复计算。 带来的影响之一是我们需要保留中间值,直到反向传播完成。 这也是训练比单纯的预测需要更多的内存(显存)的原因之一。 此外,这些中间值的大小与网络层的数量和批量的大小大致成正比。 因此,使用更大的批量来训练更深层次的网络更容易导致内存不足(out of memory)错误

小结

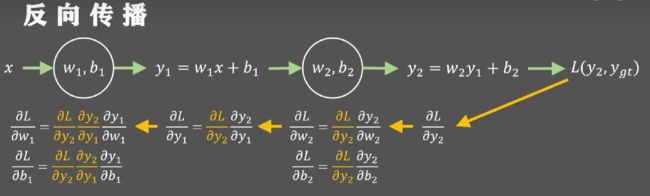

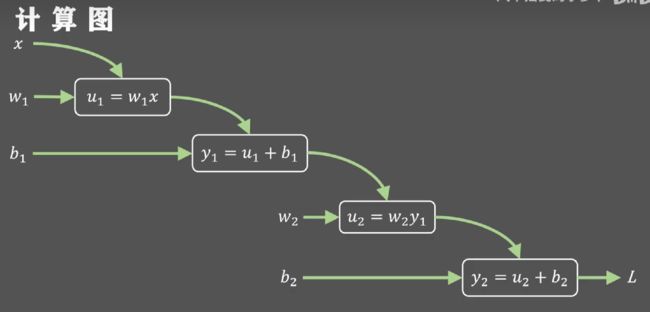

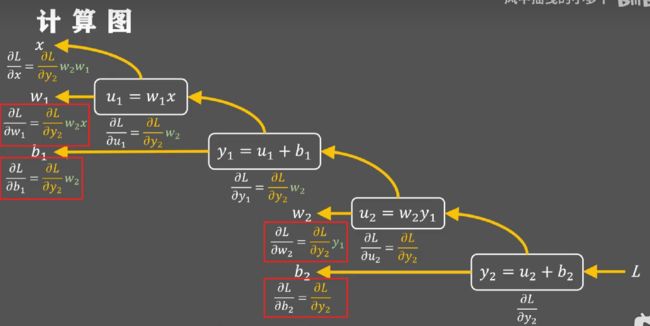

前向传播在神经网络定义的计算图中按顺序计算和存储中间变量,它的顺序是从输入层到输出层。

反向传播按相反的顺序(从输出层到输入层)计算和存储神经网络的中间变量和参数的梯度。

在训练深度学习模型时,前向传播和反向传播是相互依赖的。

训练比预测需要更多的内存。

二、神经网络基础

1 模型构造 (层和块)

我们的目的是自定义一个神经网络

nn.Sequential()是个特殊的module,它的输入可以是任何一个nn.module的子类

import torch

from torch import nn

from torch.nn import functional as F# functional中定义了一些(没有包括参数的)函数

net = nn.Sequential(nn.Linear(20, 256), nn.ReLU(), nn.Linear(256, 10))

#构造单层神经网络

X = torch.rand(2, 20) # 生成一个随机的input

# 2是批量大小 20是输入的维度

net(X)

# 输出的是2*10的形式的张量1.1 自定义块

任何一个层或神经网络都是nn.module的子类

所有的module有两个重要的函数:

__init__(self)

forward(self,X)

在里面定义我们需要的类和参数

class MLP(nn.Module): #任何一个层或神经网络都是module的子类 #MLP继承module

# 用模型参数声明层。这里,我们声明两个全连接的层

def __init__(self):

# 调用MLP的父类Module的构造函数来执行必要的初始化。

# 这样,在类实例化时也可以指定其他函数参数,例如模型参数params(稍后将介绍)

super().__init__() # 调用MLP的父类Module的构造函数来执行必要的初始化。

#接下来定义两个全连接层

self.hidden = nn.Linear(20, 256) # 隐藏层

self.out = nn.Linear(256, 10) # 输出层

# 定义模型的前向传播,即如何根据输入X返回所需的模型输出

def forward(self, X):

# 注意,这里我们使用ReLU的函数版本,其在nn.functional模块中定义。

return self.out(F.relu(self.hidden(X)))实例化多层感知机的层,然后在每次调用正向传播函数时调用这些层

net = MLP()

net(X)1.2 顺序块

*args

class MySequential(nn.Module):

def __init__(self, *args): #*args=list of input arguements

super().__init__()#调用父类的初始化函数

for idx, module in enumerate(args):

# 这里,module是Module子类的一个实例。我们把它保存在'Module'类的成员

# 变量_modules中。_module的类型是OrderedDict

self._modules[str(idx)] = module

# self._modules是一个存放层的容器

def forward(self, X):

# OrderedDict保证了按照成员添加的顺序遍历它们

for block in self._modules.values(): #self._modules.values()即放进去的层

X = block(X) #按顺序把input放入,得到output

return Xnet = MySequential(nn.Linear(20, 256), nn.ReLU(), nn.Linear(256, 10))

net(X)1.3 在前向传播函数中执行代码

通过继承nn.module这个方法可以比调用Sequential能够更灵活地定义参数和做前向计算,需要注意的有两点:

在__init__(self)中定义好有哪些层

在forward(self,X)中定义好前向运算怎么计算

以下是一个样例

(反向计算是不需要定义的 都是自动求导即可)

class FixedHiddenMLP(nn.Module):

def __init__(self):

super().__init__()

# 不计算梯度的随机权重参数。因此其在训练期间保持不变

self.rand_weight = torch.rand((20, 20), requires_grad=False)

# 这个随机的weight不参加训练,因为他不会计算梯度

self.linear = nn.Linear(20, 20)

def forward(self, X):

X = self.linear(X)

# 使用创建的常量参数以及relu和mm函数

X = F.relu(torch.mm(X, self.rand_weight) + 1) #调用激活函数

#torch.mm()表示做矩阵乘法,+1表示增加偏移

X = self.linear(X) # 复用全连接层。这相当于两个全连接层共享参数

# 控制流

while X.abs().sum() > 1:

X /= 2

return X.sum()#返回一个标量net = FixedHiddenMLP()

net(X)我们也可以混合搭配各种组合块的方法

class NestMLP(nn.Module):#这里定义一个嵌套的MLP(Sequential和Linear的嵌套)

def __init__(self):

super().__init__()

self.net = nn.Sequential(nn.Linear(20, 64), nn.ReLU(),

nn.Linear(64, 32), nn.ReLU())

#定义一个Sequential类net

self.linear = nn.Linear(32, 16)#定义一个线性类

def forward(self, X):

return self.linear(self.net(X))

chimera = nn.Sequential(NestMLP(), nn.Linear(16, 20), FixedHiddenMLP())

chimera(X)上面这个案例有点花,不是很理解 标记一下之后再回来看看

2 参数管理

import torch

from torch import nn

net = nn.Sequential(nn.Linear(4, 8), nn.ReLU(), nn.Linear(8, 1))

X = torch.rand(size=(2, 4))

net(X)2.1 参数访问

全连接层有两个参数:weight和bias

我们的目的是把每一层里面的权重拿出来

print(net[2].state_dict())

#Sequential可以理解为一个list,net[2]拿到的就是最后的这个输出层nn.Linear(8, 1)

# 调用state_dict(),这里描述了最后一层的参数weight和bias(类型是OrderedDict)OrderedDict([('weight',tensor([[0.3016,-0.1901,-0.1991,-0.1220,0.1121,-0.1424,-0.3060,0.3400]])),('bias',tensor([-0.0291]))])

2.1.1 目标参数

我们可以直接访问某一个具体的参数

print(type(net[2].bias)) #bias是一个parameter

print(net[2].bias)

print(net[2].bias.data) #.data返回的是参数的本身,.grad返回梯度Parameter containing:

tensor([-0.0291], requires_grad=True)

tensor([-0.0291])

net[2].weight.grad == None #因为我们还没有做计算,所以也没有反向计算,所以grad==NoneTrue

2.1.2 一次性访问所有参数

named_parameters()

可以把所有网络的参数全部拿出来

print(*[(name, param.shape) for name, param in net[0].named_parameters()])# net[0]表示取出第一层的参数

print(*[(name, param.shape) for name, param in net.named_parameters()])

# net表示取出所有全连接层的参数,net[1]是ReLU,没有参数('weight',torch.Size([8,4]))('bias',torch.Size([8]))

('0.weight',torch.Size([8,4]))('0.bias',torch.Size([8]))('2.weight',torch.Size([1,8]))('2.bias',torch.Size([1]))

也可以通过名字访问

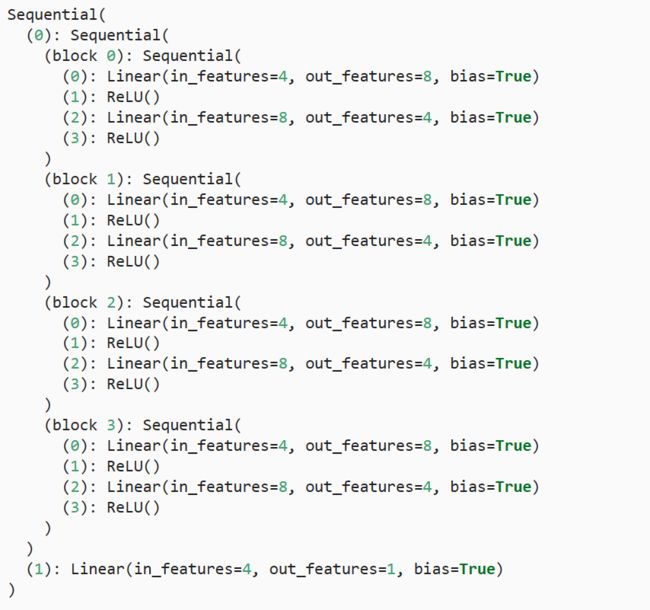

net.state_dict()['2.bias'].data # 表示访问最后一层的偏移2.1.3从嵌套块收集参数

add_module('自定义字符串的名字', )

def block1():

return nn.Sequential(nn.Linear(4, 8), nn.ReLU(),

nn.Linear(8, 4), nn.ReLU())

def block2():

net = nn.Sequential()

for i in range(4):

# 在这里嵌套

net.add_module(f'block {i}', block1())

# 在block2中嵌套4个block1

return net

rgnet = nn.Sequential(block2(), nn.Linear(4, 1))

rgnet(X)print(rgnet) #会用字符串的形式把整个网络的框架打印出来rgnet[0][1][0].bias.data2.2 参数初始化

现在我们的目的是修改初始参数

2.2.1 内置初始化

net.apply()

遍历整个神经网络做相同的修改

def init_normal(m):

if type(m) == nn.Linear: #判断传入的module是否为全连接层

nn.init.normal_(m.weight, mean=0, std=0.01)

#语法补充:后置的下划线表示替换

nn.init.zeros_(m.bias)

net.apply(init_normal)# 对net中所有的module调用这个函数,然后再把这个module作为参数传入进去

net[0].weight.data[0], net[0].bias.data[0]def init_constant(m):

if type(m) == nn.Linear:

nn.init.constant_(m.weight, 1) # 把weight init为一个为1的常数值

nn.init.zeros_(m.bias)

net.apply(init_constant)

net[0].weight.data[0], net[0].bias.data[0]通过apply,我们也可以对某些块应用不同的初始化方法。例如,下面我们使用Xavier初始化方法初始化第一个神经网络层, 然后将第三个神经网络层初始化为常量值42

xavier()

nn.init.xavier_uniform()

xavier_mumul()????可能耳误

def init_xavier(m):

if type(m) == nn.Linear:

nn.init.xavier_uniform_(m.weight)

def init_42(m):

if type(m) == nn.Linear:

nn.init.constant_(m.weight, 42)

net[0].apply(init_xavier) #第一个全连接层用init_xavier初始化

net[2].apply(init_42) #第二个全连接层用init_42初始化

print(net[0].weight.data[0])

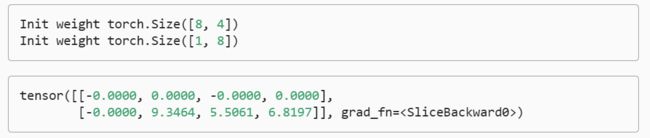

print(net[2].weight.data)2.2.2自定义初始化*

以下是一个无厘头的例子,目的是展示一种自定义初始化的可能性

def my_init(m):

if type(m) == nn.Linear:

print("Init", *[(name, param.shape)

for name, param in m.named_parameters()][0])

nn.init.uniform_(m.weight, -10, 10)

m.weight.data *= m.weight.data.abs() >= 5

net.apply(my_init)

net[0].weight[:2]当然 我们也可以简单粗暴地直接索引给参数赋值

net[0].weight.data[:] += 1

net[0].weight.data[0, 0] = 42

net[0].weight.data[0]2.3 参数绑定(一个小应用)

如果我们想要在一些层之间share parameter,我们可以使用参数绑定的方法

# 我们需要给共享层一个名称,以便可以引用它的参数

shared = nn.Linear(8, 8) #构造一个命名为share的层

net = nn.Sequential(nn.Linear(4, 8), nn.ReLU(),

shared, nn.ReLU(),

shared, nn.ReLU(),

nn.Linear(8, 1))

net(X)

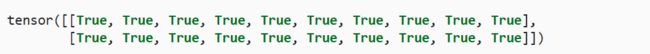

# 检查两个共享层的参数是否相同

print(net[2].weight.data[0] == net[4].weight.data[0])

net[2].weight.data[0, 0] = 100

# 确保它们实际上是同一个对象,而不只是有相同的值

print(net[2].weight.data[0] == net[4].weight.data[0])3 延后初始化

4 自定义层

如何自定义一个层?

自定义一个层和自定义网络其实没什么区别 因为两者都是nn.module的子类

4.1 不带参数的层

import torch

import torch.nn.functional as F

from torch import nn

class CenteredLayer(nn.Module):

def __init__(self):

super().__init__() #调用父类初始化函数

def forward(self, X):

return X - X.mean() #这个层的作用是使传入的数据均值变为0layer = CenteredLayer() #实例化一个层

layer(torch.FloatTensor([1, 2, 3, 4, 5])) #传入的数据均值变为0我们可以将这个层作为组件合并到构建更复杂的模型中

net = nn.Sequential(nn.Linear(8, 128), CenteredLayer())

Y = net(torch.rand(4, 8))

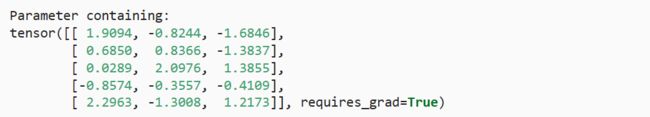

Y.mean()4.2 带参数的层

如何实现一个带有参数的层?

class MyLinear(nn.Module): #我们定义一个自己的线性层

def __init__(self, in_units, units): # in_units表示输入的维度,units表示输出的维度

super().__init__()

self.weight = nn.Parameter(torch.randn(in_units, units))

# 自定义weight,将生成的tensor传入Parameter可正规化weight的属性和身份 以及加上了梯度

self.bias = nn.Parameter(torch.randn(units,))

# 这里同上

def forward(self, X):

linear = torch.matmul(X, self.weight.data) + self.bias.data

return F.relu(linear)linear = MyLinear(5, 3)

linear.weight将linear 的输入替换成另一个tensor

linear(torch.rand(2, 5))我们刚刚自定义的层也可以加入到模型构建中

net = nn.Sequential(MyLinear(64, 8), MyLinear(8, 1))

net(torch.rand(2, 64))5 读写文件

5.1 加载和保存张量

torch.save()

torch.load()

import torch

from torch import nn

from torch.nn import functional as F

x = torch.arange(4)

torch.save(x, 'x-file') #将向量x存在文件x-file中x2 = torch.load('x-file')

x2现在我们存储一个张量列表,然后把它们读回内存

y = torch.zeros(4)

torch.save([x, y],'x-files')

x2, y2 = torch.load('x-files')

(x2, y2)也可以写入或读入从字符串映射到张量的字典

mydict = {'x': x, 'y': y}

torch.save(mydict, 'mydict')

mydict2 = torch.load('mydict')

mydict25.2加载和保存模型参数

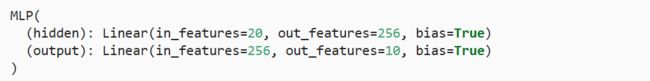

class MLP(nn.Module):

def __init__(self):

super().__init__()

self.hidden = nn.Linear(20, 256)

self.output = nn.Linear(256, 10)

def forward(self, x):

return self.output(F.relu(self.hidden(x)))

net = MLP()

X = torch.randn(size=(2, 20))

Y = net(X)将模型的所有参数存储为一个叫作mlp.params的文件

torch.save(net.state_dict(), 'mlp.params').load_state_dict()

.eval()

.eval()使模型从train模式调整为test模式,不再进行训练修改梯度

clone = MLP() #在加载已保存的参数之前需要重新声明一次原来的模型(此时的模型中的参数是被随机初始化了的)

clone.load_state_dict(torch.load('mlp.params'))

#用.load_state_dict()函数将已保存的参数载入模型中

clone.eval()#从train模式调整为test模式,不再进行训练修改梯度Y_clone = clone(X)

Y_clone == Y2023/1/20

今天的内容都很好理解 感觉是逐渐入门了

去成为你想要成为的人吧