Openmmlab AI实战营 Day3

今天是AI实战训练营第三节课的笔记,这节课主要讲了如何使用Openmmlab的框架,以及如何使用超算平台。

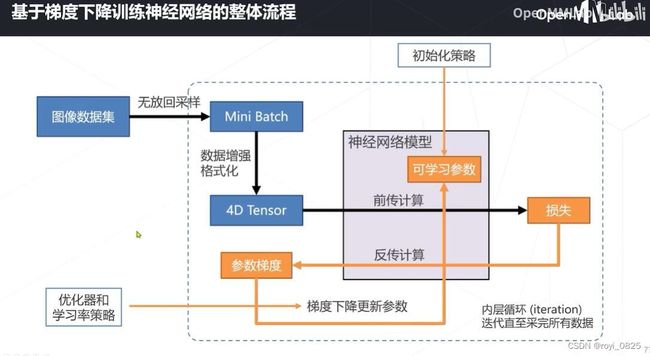

依旧是上节课的这样的一个图,这节课学的东西很多都来自这张图片。

我发现这个csdn的注释P用没有,根本展示不出来

老师首先是从Pytorch给的代码开始讲述的。

transform=ToTensor(),就是数据预处理,数据增强

DataLoader(training_data, batch_size=batch_size) 这里是做了一个采样

import torch

from torch import nn

from torch.utils.data import DataLoader

from torchvision import datasets

from torchvision.transforms import ToTensor

training_data = datasets.FashionMNIST(

root="data",

train=True,

download=True,

transform=ToTensor(),#数据预处理,数据增强

)

# Download test data from open datasets.

test_data = datasets.FashionMNIST(

root="data",

train=False,

download=True,

transform=ToTensor(),

)

batch_size = 64

# Create data loaders.实现采样的过程

train_dataloader = DataLoader(training_data, batch_size=batch_size)

test_dataloader = DataLoader(test_data, batch_size=batch_size)

for X, y in test_dataloader:

print(f"Shape of X [N, C, H, W]: {X.shape}")

print(f"Shape of y: {y.shape} {y.dtype}")

break

# Get cpu or gpu device for training.

device = "cuda" if torch.cuda.is_available() else "cpu"

print(f"Using {device} device")

# Define model

class NeuralNetwork(nn.Module):#继承nn.module

def __init__(self):

super(NeuralNetwork, self).__init__()

self.flatten = nn.Flatten()

self.linear_relu_stack = nn.Sequential(

nn.Linear(28*28, 512),

nn.ReLU(),

nn.Linear(512, 512),

nn.ReLU(),

nn.Linear(512, 10)

)

def forward(self, x):#定义前传计算图

x = self.flatten(x)

logits = self.linear_relu_stack(x)

return logits

model = NeuralNetwork().to(device)

print(model)

loss_fn = nn.CrossEntropyLoss()#损失函数

optimizer = torch.optim.SGD(model.parameters(), lr=1e-3)#优化器,优化的是模型的参数

def train(dataloader, model, loss_fn, optimizer):

size = len(dataloader.dataset)

model.train()

for batch, (X, y) in enumerate(dataloader):#写一个循环,

X, y = X.to(device), y.to(device)

# Compute prediction error

pred = model(X)#先前传

loss = loss_fn(pred, y)

# Backpropagation

optimizer.zero_grad()#因为有梯度累加机制,所以需要先清零,才能把梯度正确的算出来

loss.backward()#反向传播

optimizer.step()#走一步梯度下降的事情(帮忙算好)

if batch % 100 == 0:

loss, current = loss.item(), batch * len(X)

print(f"loss: {loss:>7f} [{current:>5d}/{size:>5d}]")

##############################################################################

# We also check the model's performance against the test dataset to ensure it is learning.

def test(dataloader, model, loss_fn):

size = len(dataloader.dataset)

num_batches = len(dataloader)

model.eval()

test_loss, correct = 0, 0

with torch.no_grad():

for X, y in dataloader:

X, y = X.to(device), y.to(device)

pred = model(X)

test_loss += loss_fn(pred, y).item()

correct += (pred.argmax(1) == y).type(torch.float).sum().item()

test_loss /= num_batches

correct /= size

print(f"Test Error: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

epochs = 5

for t in range(epochs):#外层的循环

print(f"Epoch {t+1}\n-------------------------------")

train(train_dataloader, model, loss_fn, optimizer)

test(test_dataloader, model, loss_fn)

print("Done!")

torch.save(model.state_dict(), "model.pth")

print("Saved PyTorch Model State to model.pth")

#部署

model = NeuralNetwork()#实例化

model.load_state_dict(torch.load("model.pth"))#加载进来

classes = [

"T-shirt/top",

"Trouser",

"Pullover",

"Dress",

"Coat",

"Sandal",

"Shirt",

"Sneaker",

"Bag",

"Ankle boot",

]

model.eval()#先调整到eval模式

x, y = test_data[0][0], test_data[0][1]

with torch.no_grad():#测试,不需要计算梯度

pred = model(x)

predicted, actual = classes[pred[0].argmax(0)], classes[y]

print(f'Predicted: "{predicted}", Actual: "{actual}"')

接着就是使用一个新的工具的一些操作讲解,王老师讲的方法和作业手册上的方法是不一样的,是利用mim工具安装mmcls之后把某一个模型给下载下来。作业手册上的方法是直接把mmclassification给直接git clone下来,为了做这一步,我昨天晚上整ssh还整了半天。

然后是模型讲解上面,王老师讲的是mobilenet模型,作业上给的是resnet网络。因此这次作业可能对小白来讲还是有一点难度的(尤其是对我这种没怎么上手做过深度学习实验的人来讲。

此外利用sbatch进行提交作业命令这个事情也是我第一次见,因为我是第一次使用超算平台,武汉大学的同学跟我说他们也是这样,这就是我没考上的学校吗,呜呜

刚才写了很多东西,不知道为什么被吞了。

下面是一个我在进行了数据处理后得到的数据集:

此外更多的东西或许我需要在今天做完全部实验之后才能给出图像记录(就像一个实验报告一样),希望今天能够把整个作业做出来,提交上去,这样明天一天可以去学现代信号处理。