一种快速生成边界交通场景数据的新方法

西安交通大学人工智能与机器人研究所刘跃虎教授研究组最新研究成果,通过操纵真实道路场景中采集的激光点云,与彩色图像生成边界驾驶场景的多传感数据,经实验验证,数据可以用于丰富无人驾驶现有感知智能算法可靠性测试的测试用例。该论文被IEEE ICUS 2019国际会议接收,并获优秀论文奖。

本文作者刘钰,系西安交通大学人工智能与机器人研究所硕士研究生

包含诸如危险驾驶行为的边界交通场景,往往蕴含着影响无人驾驶环境感知智能算法的不利因素,是无人驾驶离线测试中考察算法正确性和环境适应性的有力测试数据,其样本数据量的增加将大大缩短无人驾驶测试评估周期[1]。但边界交通场景数据往往难以直接采集获取,样本量稀少。本文旨在探究生成边界交通场景多传感数据所需的极简3D操纵空间表示方法,通过对多模态传感数据的操纵,实现边界交通场景数据的生成。

边界交通场景对无人驾驶离线测试的重要性

无人驾驶环境感知算法的离线测试需要大量、多样、典型交通场景数据以尽可能覆盖无人车行驶可能遇到的交通状况,特别是边界交通场景多传感数据。本文主要关注包含危险驾驶行为的边界交通场景,如逆向行驶、右侧超车等。

边界交通场景是考察无人驾驶环境感知能力的有力区分点。由于其出现概率小、持续过程短暂,导致现场采集数据困难。如何从已有传感数据生成边界交通场景数据的问题,其本质是在3D空间对场景内容的改变。

化繁为简,场景数据复用为快速边界交通场景生成提供可能

已有成熟软件一般遵循真实数据获取→场景3D重建→场景操纵→新数据生成的流程。从真实道路场景数据中获取道路几何形状属性,构建交通场景模型,再利用仿真传感器模型生成变化后的交通场景传感数据。所生成交通场景传感数据的真实感与建模的精细程度正相关。而同一时刻同一位置所采集的多种传感数据是同样的交通场景,其场景内容具有语义一致性,如改变场景点云数据的同时,其图像数据的语义信息也发生相同的变化。因此,相较于道路几何与语义功能的精细建模,对点云与图像数据中的路面及道路边界的大致估计即可构成对车辆运动的有效约束。此外,原始场景数据包含大量形状信息及外观信息,能够满足新场景数据生成的需要。

巧借方向包围盒“移花接木”,实现4D操纵

通过对原始场景多传感数据中的形状信息及外观信息复用,实现真实数据®基于OBB(方向包围盒)表征的3D空间操纵®数据合成,操纵道路场景点云与图像数据生成新的边界交通场景数据。

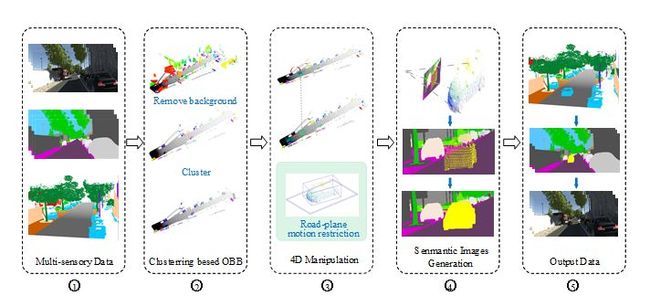

图1是4D(1D时-3D空)多传感数据操纵的实现流程示意。

1输入场景RGB-D多传感数据及其语义标注;

2聚类生成实例级别的交通参与者的OBB表示;

3根据构建边界交通场景的需求,在OBB表示空间对交通参与者进行交互时-空操纵;

4利用空间变换关系将点云内容的改变作用到语义图像内容的改变;

5利用图像翻译网络生成与输入多传感数据相同分布不同内容的边界交通场景点云和图像数据。

图1. 4D多传感数据操纵实现流程

边界交通场景数据生成方法与实现

1、基于聚类的OBB表示生成

激光点云为无人驾驶常用的传感数据,虽然包含丰富的三维信息,但对三维几何的连续性描述不足。本文引入OBB,提出OBB表征的操纵空间实现4D操纵。通过基于欧氏距离的聚类方法对现有点云数据进行实例级聚类,确定每一个交通参与者的OBB。

2、4D操纵

车辆完整点云的构建

给定点云数据一般是不完整的,在视野可见区域有丰富的点云信息,而不可见区域的点云信息缺失,如车辆往往在视野中只能看到其前后左右中的两个面,对于背侧的另两个面,点云信息稀少甚至没有。对交通元素进行操纵时,如改变其姿态并设定运动模型时,将会面临这个问题。借助OBB得到车辆尺度,根据相近形状车辆及其对称性先验,进行点云拼接融合,完成车辆完整点云信息构建。

车辆时-空运动的交互设定

假设道路为水平面,在Unity引擎中利用线框模型表征场景,为所操纵的交通元素交互设置新的时-空运动,获得初始运动数据。

引入道路几何约束,提出局部路面的渐进式OBB构建方法:每一时刻以运动车辆重心的2D位置为中心,选取适当尺寸的局部路面点云构建OBB。基于局部路面OBB与车辆OBB,交互设定车辆运动的道路几何约束。

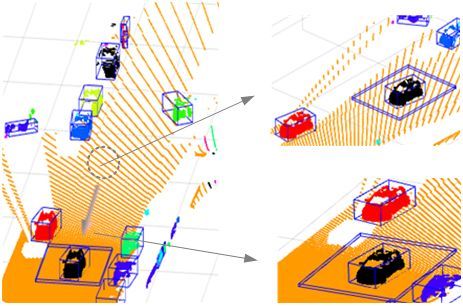

图2. 局部路面的渐进式OBB构建

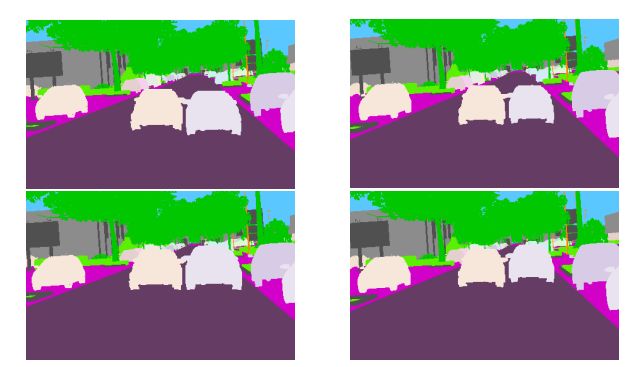

3、新语义图像序列生成

借助相机成像模型将操纵车辆点云数据投影到对应语义图像,并采用图像处理方法填补投影的不连续几何外观。

4、图像翻译

将由语义图像到具有交通场景纹理图像的产生过程形式化为图像翻译问题,并借助NVIDIA的pix2pixHD图像翻译网络[2]进行实现。

实验验证与测试

基于vKITTI数据集[3]对所提出的方法进行了验证。

(1) 引入道路几何约束的效果

图3. 上:引入道路几何约束前,下:引入道路几何约束后

根据点云数据,此场景中道路右侧高于道路左侧。从上图可以看出在引入道路几何约束前,道路中间的新加入车辆出现陷入路面的情况,而引入道路几何约束后,避免了此问题,改善了视觉效果。

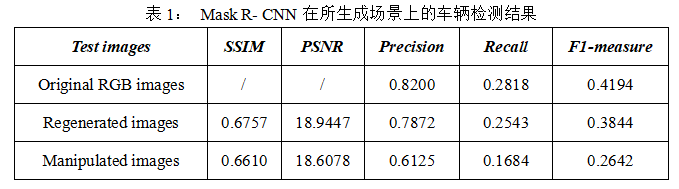

(2) 对车辆检测算法的性能影响

为了测试所生成的边界交通场景数据对无人车环境感知算法性能的影响,使用Mask R-CNN[4]在生成图像上进行车辆检测,结果如表1。其中,Regenerated images指直接利用原始语义图像输入图像翻译网络所生成的交通场景图像;Manipulated images指对交通元素进行操纵后所生成的包含危险驾驶行为语义的边界交通场景图像。

车辆检测算法性能变差可能是由于边界交通场景或图像生成质量导致。从SSIM和PSNR指标,可以看出图像质量的退化主要由图像翻译网络引起。而对比Regenerated images与Manipulated images的测试结果,两者图像质量相近,但在Manipulated images的测试,车辆检测算法性能下降明显。这表明所产生的边界交通场景数据对算法性能有影响,是测试算法对不同交通场景的适应性的有效测试用例。

综上,本文所讨论方法的目的是通过对交通场景内容进行4D操纵产生新的边界交通场景数据。为使操纵更为便捷准确,提出OBB表征的操纵空间完成4D操纵。为了改善视觉效果,提出局部路面的渐进式OBB构建方法引入道路几何约束。实验结果表明,道路环境感知算法对所生成的边界交通场景数据表现敏感,可以用于丰富无人驾驶现有感知智能算法可靠性测试的测试用例。

[1] C. Zhang, Y. Liu, Q. Zhang and L. Wang, "A Graded Offline Evaluation Framework for Intelligent Vehicle’s Cognitive Ability," 2018 IEEE Intelligent Vehicles Symposium (IV), pp. 320-325, 2018.

[2] T. C. Wang, M. Liu, J. Zhu, A. J. Tao, J. Kautz and B. Catanzaro, "High-Resolution Image Synthesis and Semantic Manipulation with Conditional GANs," 2017 IEEE Conference on Computer Vision and Pattern Recognition, pp.8798-8807, 2017.

[3] A. Gaidon, Q. Wang, Y. Cabon and E.Vig, "Virtual Worlds as Proxy for Multi-Object Tracking Analysis," 2016 IEEE Conference on Computer Vision and Pattern Recognition, pp.4340-4349, 2016.

[4]K. He, G. Gkioxari, P. Dollar and R. B. Girshick, "Mask R-CNN." 2017 IEEE Conference on International Conference on Computer Vision, PP.2980-2988, 2017.