- 探索OpenAI和LangChain的适配器集成:轻松切换模型提供商

nseejrukjhad

langchaineasyui前端python

#探索OpenAI和LangChain的适配器集成:轻松切换模型提供商##引言在人工智能和自然语言处理的世界中,OpenAI的模型提供了强大的能力。然而,随着技术的发展,许多人开始探索其他模型以满足特定需求。LangChain作为一个强大的工具,集成了多种模型提供商,通过提供适配器,简化了不同模型之间的转换。本篇文章将介绍如何使用LangChain的适配器与OpenAI集成,以便轻松切换模型提供商

- 炒币好还是挖矿好?

区块链大社会

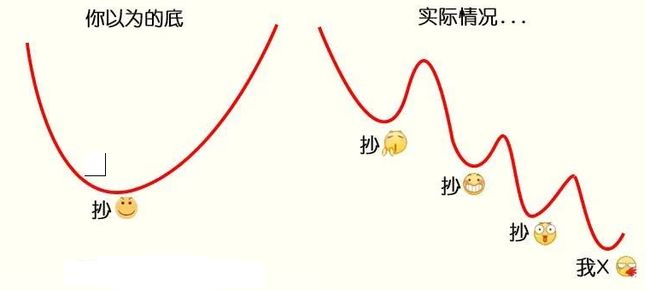

炒币好还是挖矿好?相信这个问题对于很多初入行的朋友来说是个不小的问题,小编也经常会被问到类似问题。为此,本文专门针对这个问题做一下分析,供各位朋友们参考。在比特币世界里,有些非常有意思的比喻,像挖金子一样“挖”比特币叫做“挖矿”,挖比特币的人被称为“矿工”,而用于“挖”比特币的电脑被称为“矿机”。而“炒币”就像炒股,直接在交易平台购买数字货币进行交易,不需要“挖”,只要将法币兑换成某种数字货币,再

- 深度 Qlearning:在直播推荐系统中的应用

AGI通用人工智能之禅

程序员提升自我硅基计算碳基计算认知计算生物计算深度学习神经网络大数据AIGCAGILLMJavaPython架构设计Agent程序员实现财富自由

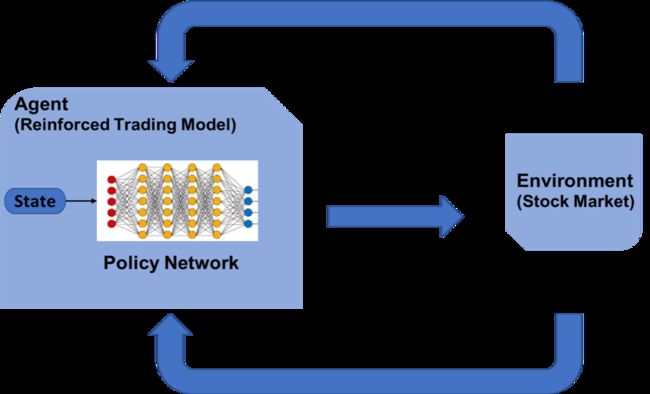

深度Q-learning:在直播推荐系统中的应用关键词:深度Q-learning,强化学习,直播推荐系统,个性化推荐1.背景介绍1.1问题的由来随着互联网技术的飞速发展,直播平台如雨后春笋般涌现。面对海量的直播内容,用户很难快速找到自己感兴趣的内容。因此,个性化推荐系统在直播平台中扮演着越来越重要的角色。1.2研究现状目前,主流的个性化推荐算法包括协同过滤、基于内容的推荐等。这些方法在一定程度上缓

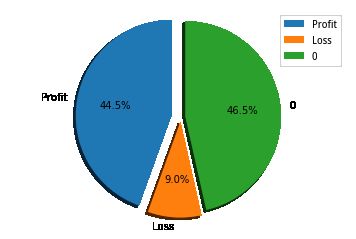

- 股票公众号怎么赚钱的?炒股公众号靠什么赚钱?

氧惠评测

股票公众号赚钱的方式主要有以下几种:别指望别人对你好,你没有价值,别人怎么可能会对你好,要知道:人生都是相互的,你要让自己有价值,只要你有价值了,水到自然渠成了。氧惠APP是与以往完全不同的抖客+淘客app!2024全新模式,我的直推也会放到你下面。主打:带货高补贴,深受各位带货团队长喜爱(训练营导师每天出单带货几万单)。注册即可享受高补贴+0撸+捡漏等带货新体验。送万元推广大礼包,教你如何1年做

- 基于TRIZ的救援机器人轻量化设计

天行健王春城老师

TRIZ机器人

在救援机器人设计中,轻量化是一个至关重要的目标,它直接关系到机器人的便携性、运输效率以及在复杂环境中的作业能力。TRIZ理论为我们提供了一套系统化的工具和方法,用于解决设计过程中遇到的各种挑战,特别是在实现轻量化目标时,TRIZ能够帮助我们识别并消除设计中的冗余与低效部分,同时保留或增强其关键功能。具体如深圳天行健企业管理咨询公司下文所述:1.功能分析与矛盾识别TRIZ理论强调对系统功能的深入分析

- Python和MATLAB及C++信噪比导图(算法模型)

亚图跨际

算法交叉知识Python视频图像修复模数转换信号链噪音频谱计算量化周期性视觉刺激高斯噪声的矩形脉冲心率失常检测算法

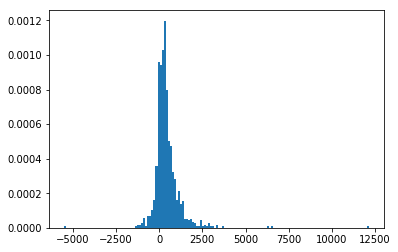

要点视频图像修复模数转换中混合信号链噪音测量频谱计算和量化周期性视觉刺激脑电图高斯噪声的矩形脉冲总谐波失真周期图功率谱密度各种心率失常检测算法胶体悬浮液跟踪检测计算交通监控摄像头图像噪音计算Python信噪比信噪比是科学和工程中使用的一种测量方法,用于比较所需信号水平与背景噪声水平。信噪比定义为信号功率与噪声功率之比,通常以分贝表示。高于1:1(大于0dB)的比率表示信号大于噪声。信噪比是影响处理

- Python(PyTorch)和MATLAB及Rust和C++结构相似度指数测量导图

亚图跨际

Python交叉知识算法量化检查图像压缩质量低分辨率多光谱峰值信噪比端到端优化图像压缩手术机器人三维实景实时可微分渲染重建三维可视化

要点量化检查图像压缩质量低分辨率多光谱和高分辨率图像实现超分辨率分析图像质量图像索引/多尺度结构相似度指数和光谱角映射器及视觉信息保真度多种指标峰值信噪比和结构相似度指数测量结构相似性图像分类PNG和JPEG图像相似性近似算法图像压缩,视频压缩、端到端优化图像压缩、神经图像压缩、GPU变速图像压缩手术机器人深度估计算法重建三维可视化推理图像超分辨率算法模型三维实景实时可微分渲染算法MATLAB结构

- tushare库获取金融股票数据

罔闻_spider

python进阶python

定义:Tushare是一个为金融量化分析师和数据爱好者设计的开源工具,提供从数据采集、清洗加工到数据存储的全流程服务。它能够实时抓取沪深两市的股票和期货市场数据,包括交易价格、成交量、市值、市盈率等关键指标,同时也提供历史数据的采集。Tushare的数据采集功能是其核心优势之一,它支持多种数据类型,包括日K线数据和分钟级数据,满足不同分析需求。Tushare的数据清洗与加工功能提供了强大的工具集,

- 如何使用并提高批判性思考能力?

颍水书生

学会一个技能的最好办法就是不断的使用,学英语如此、学游泳如此、学吉他也是如此。作人类最核心的技能,学会思考的最重要的方法不是学,而是不断的对心智的积极运用。如何使用心智,则是一个相对不容易的事情,因为思考结果的没有明显的反馈,不像游泳,换气、泳姿、游的速度这些都是可以量化,水平的高低,很容易考评,甚至一眼就能看出来。不过不容易也未必是无章可循,就像我们在读书时那样,可以先来个摸底考试,看看自己水平

- OpenAI o1 的价值意义及“强化学习的Scaling Law” & Kimi创始人杨植麟最新分享:关于OpenAI o1新范式的深度思考

光剑书架上的书

ChatGPT大数据AI人工智能计算人工智能算法机器学习

OpenAIo1的价值意义及“强化学习的ScalingLaw”蹭下热度谈谈OpenAIo1的价值意义及RL的Scalinglaw。一、OpenAIo1是大模型的巨大进步我觉得OpenAIo1是自GPT4发布以来,基座大模型最大的进展,逻辑推理能力提升的效果和方法比预想的要好,GPT4o和o1是发展大模型不同的方向,但是o1这个方向更根本,重要性也比GPT4o这种方向要重要得多,原因下面会分析。为什

- Chat GPT带来的几点思考

淡定的胡萝卜

OpenAI公司推出的ChatGPT引起了广泛关注,网上出现各类专家开始预测随着ChatGDP的普及,将会有哪些行业的人面临失业,引发人们的焦虑。不可否认它会给我们的教育行业、媒体行业、学术界等众多行业产生影响,面对这些影响,我们该如何看待呢?近期我阅读了不少相关文章,引发的几点思考,想与大家分享。ChatGPT将会倒逼传统教育的改革。中国传统教育是教师对知识点的传授、学生对知识点的掌握,不仅量多

- CV、NLP、数据控掘推荐、量化

海的那边-

AI算法自然语言处理人工智能

下面是对CV(计算机视觉)、NLP(自然语言处理)、数据挖掘推荐和量化的简要概述及其应用领域的介绍:1.CV(计算机视觉,ComputerVision)定义:计算机视觉是一门让计算机能够从图像或视频中提取有用信息,并做出决策的学科。它通过模拟人类的视觉系统来识别、处理和理解视觉信息。主要任务:图像分类:识别图像中的物体并分类,比如猫、狗、车等。目标检测:在图像或视频中定位并识别多个对象,如人脸检测

- 使用LangChain和OpenAI实现高效文本标注

aehrutktrjk

langchainpython

使用LangChain和OpenAI实现高效文本标注引言在自然语言处理(NLP)领域,文本标注是一项重要且常见的任务。它涉及为文本分配标签,如情感、语言、风格等。本文将介绍如何使用LangChain和OpenAI的API来实现高效的文本标注系统。我们将探讨如何设置环境、定义标注模式,以及如何使用OpenAI的模型来执行标注任务。环境准备首先,我们需要安装必要的库并设置API密钥:%pipinsta

- 不要再学习巴菲特和马云了

李影_8de2

很多时候,我们普通人我感觉学习的榜样对标错了。我们往往对标的是这个社会上谁是最优秀的,数一数二的那些人,潜意识里就觉得他有一个大招,学会了他这一个大招就能够世界第一。炒股言必称巴菲特,做电商言必称马云。是的,他们取得至高的成就这一点无可置疑,但是我们普通人真的应该学习他们吗?学习顶尖的人对我们来讲是最好的途径吗?我看未必。有一句话说,一屋不扫何以扫天下?很多时候我们太多的时候关注到名人身上那些带着

- 探索未来,大规模分布式深度强化学习——深入解析IMPALA架构

汤萌妮Margaret

探索未来,大规模分布式深度强化学习——深入解析IMPALA架构scalable_agent项目地址:https://gitcode.com/gh_mirrors/sc/scalable_agent在当今的人工智能研究前沿,深度强化学习(DRL)因其在复杂任务中的卓越表现而备受瞩目。本文要介绍的是一个开源于GitHub的重量级项目:“ScalableDistributedDeep-RLwithImp

- 深度学习-13-小语言模型之SmolLM的使用

皮皮冰燃

深度学习深度学习

文章附录1SmolLM概述1.1SmolLM简介1.2下载模型2运行2.1在CPU/GPU/多GPU上运行模型2.2使用torch.bfloat162.3通过位和字节的量化版本3应用示例4问题及解决4.1attention_mask和pad_token_id报错4.2max_new_tokens=205参考附录1SmolLM概述1.1SmolLM简介SmolLM是一系列尖端小型语言模型,提供三种规

- 【数据分析】利用Python+AI+工作流实现自动化数据分析-全流程讲解

z千鑫

AI领域FLASK基础Python基础人工智能数据分析pythonAI编程AI工作流ai自动化

文章目录一、为什么要用AI进行自动化分析?二、AI自动化分析场景三、编写Python脚本示例1、用flask实现让AI分析数据内容使用说明:示例2、用定时任务的方式,定时处理AI数据代码说明四、把AI分析的数据,放到AI工作流中做展示五、openAI的key结尾在信息爆炸的时代,如何快速获取有价值的洞察力成为了各行各业的迫切需求。传统的内容分析方法往往又耗时又费力,并且难以满足快速变化的市场需求。

- 欺诈文本分类检测(十四):GPTQ量化模型

沉下心来学鲁班

微调分类人工智能语言模型微调

1.引言量化的本质:通过将模型参数从高精度(例如32位)降低到低精度(例如8位),来缩小模型体积。本文将采用一种训练后量化方法GPTQ,对前文已经训练并合并过的模型文件进行量化,通过比较模型量化前后的评测指标,来测试量化对模型性能的影响。GPTQ的核心思想在于:将所有权重压缩到8位或4位量化中,通过最小化与原始权重的均方误差来实现。在推理过程中,它将动态地将权重解量化为float16,以提高性能,

- Docker 安装配置和基本命令详解以及案例示范

J老熊

docker容器运维面试linux

1.引言容器化技术的快速发展给软件开发和运维带来了革命性的变化,Docker作为这一领域的领军者,已经成为软件开发和部署流程中的重要工具。Docker的轻量化、快速启动和高效资源利用让开发者能够在不同的环境中实现一致的开发体验。本篇文章将详细讲解如何在CentOS系统中安装Docker,如何配置阿里云镜像加速,Docker的基本命令和语法,以及通过实际的电商交易系统案例来演示如何在Docker环境

- 2020-04-09奋进的周四

深山含笑空凝峡谷

从小就特别希望和别人不一样。瞪着一双很乖的眼睛目不转睛看老师,嘴上不说心里没放下过独特眼光和taste也是从幼年就形成了。要视角不同,创新,玩点别的花样和审美有些概念让自己想起来就会有点兴奋比如life-hacker/量化自我/digitalnormad/自由编舞师/读书社群leader/coach/创作者自我的形成/个体的觉醒/作为创作者,一定要有信心——我做的创作的,即使有人做过类似的了,我做

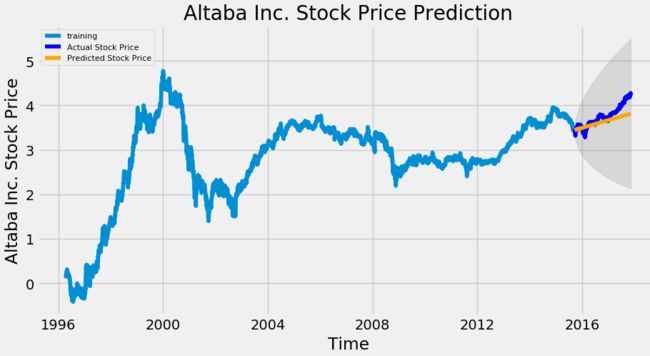

- Python最全的股票数据API接口

w_traveler

python开发语言大数据

python最全的股票数据API接口使用python是一种有效的方式来获取高频股票数据,以便进行股票行情数据分析和量化交易。python是一种广泛应用于金融数据领域的编程语言,可用于与股票数据API接口进行交互。通过调用股票数据API接口,我们可以获取实时的股票数据,包括tick数据和k线历史数据。tick数据提供了每次交易的详细信息,而k线历史数据则提供了一段时间内港股、美股、A股、沪深行情数据

- 2023-01-16 如何找到属于自己的锚定点呢

黄高

之前在网上看到了王健林一天的行程安排,4:55起来健身,然后到公司开会,再去两个城市出差,回到家已经凌晨,非常繁忙且充实。确实,一看上去非常值得尊敬,4:55大多数人都没办法达到,可是对于他来说已经10年如一日,当然最终做的事业也非常的大。昨天我和共读会一会小伙伴也在交流,她说了一个让我印象极深的概念,就是每天精进一点点,可这一点点我们怎样来进行量化呢,自己好好想想,好像我真的没有办法办到,也讲了

- 如何有效的学习AI大模型?

Python程序员罗宾

学习人工智能语言模型自然语言处理架构

学习AI大模型是一个系统性的过程,涉及到多个学科的知识。以下是一些建议,帮助你更有效地学习AI大模型:基础知识储备:数学基础:学习线性代数、概率论、统计学和微积分等,这些是理解机器学习算法的数学基础。编程技能:掌握至少一种编程语言,如Python,因为大多数AI模型都是用Python实现的。理论学习:机器学习基础:了解监督学习、非监督学习、强化学习等基本概念。深度学习:学习神经网络的基本结构,如卷

- [AI资讯·0605] GLM-4系列开源模型,OpenAI安全疑云,ARM推出终端计算子系统,猿辅导大模型备案……

老牛同学

AI人工智能ai大模型AI资讯

AI资讯1毛钱1百万token,写2遍红楼梦!国产大模型下一步还想卷什么?AI「末日」突然来临,公司同事集体变蠢!只因四大聊天机器人同时宕机OpenAI员工们开始反抗了!AI手机PC大爆发,Arm从软硬件到生态发力,打造行业AI百宝箱GLM-4开源版本:超越Llama3,多模态比肩GPT4V,MaaS平台也大升级猿辅导竟然是一家AI公司?大模型全家桶曝光|甲子光年FineChatBI,帆软在AI方

- 使用中专API实现AI模型调用与部署

llzwxh888

人工智能easyui前端python

在AI技术领域,如何调用和部署大语言模型(LLM)是一个常见的需求。本文将详细介绍如何通过中专API地址http://api.wlai.vip,实现对OpenAI大模型的调用与部署,并提供一个详细的demo代码示例。引言随着人工智能技术的飞速发展,大语言模型在自然语言处理任务中的表现尤为突出。然而,由于国内访问海外API存在一定限制,本文将使用中专API地址来解决这一问题,并展示如何在本地环境中配

- 大模型框架:vLLM

m0_37559973

大模型大模型通义千问Qwen

目录一、vLLM介绍二、安装vLLM2.1使用GPU进行安装2.2使用CPU进行安装2.3相关配置三、使用vLLM3.1离线推理3.2适配OpenAI-API的API服务一、vLLM介绍vLLM是伯克利大学LMSYS组织开源的大语言模型高速推理框架。它利用了全新的注意力算法「PagedAttention」,提供易用、快速、便宜的LLM服务。二、安装vLLM2.1使用GPU进行安装vLLM是一个Py

- 反思的魔力:用语言的力量强化AI智能体

步子哥

人工智能机器学习

在浩瀚的代码海洋中,AI智能体就像初出茅庐的航海家,渴望探索未知的宝藏。然而,面对复杂的编程任务,他们常常迷失方向。今天,就让我们跟随“反思”的灯塔,见证AI智能体如何通过语言的力量,点亮智慧的明灯,成为代码世界的征服者!智能体的困境近年来,大型语言模型(LLM)在与外部环境(如游戏、编译器、API)交互的领域中大放异彩,化身为目标驱动的智能体。然而,传统的强化学习方法如同一位严苛的训练师,需要大

- 从零开始!Jupyter Notebook的安装教程

109702008

人工智能编程#pythonjupyter人工智能

GPT-4o(OpenAI)安装JupyterNotebook是一个相对简单的过程,特别是在大多数现代操作系统(如Windows、macOS和Linux)上。以下是详细的步骤指南,从安装Python开始,到JupyterNotebook的使用。步骤1:安装PythonJupyterNotebook需要Python环境。你可以从[Python官网](https://www.python.org/do

- 从MVC到DDD的架构演进

洛蕾

计算机mvc架构

Python微信订餐小程序课程视频https://edu.csdn.net/course/detail/36074Python实战量化交易理财系统https://edu.csdn.net/course/detail/35475DDD这几年越来越火,资料也很多,大部分的资料都偏向于理论介绍,有给出的代码与传统MVC的三层架构差异较大,再加上大量的新概念很容易让初学者望而却步。本文从MVC架构角度来讲

- AWS Nitro架构简介

河马虚拟化

计算机架构虚拟化aws虚拟机架构

AWS(AmazonWebServices)Nitro架构为Amazon的云服务提供了底层的支持。Nitro架构的总体设计思想是:轻量化的hypervisor配合定制化的硬件,让用户无法区分出运行在虚拟机内和运行在裸金属上操作系统的性能差异。为了实现定制化的硬件(ASIC),Amazon和以色列的一家芯片公司——Annapurna实验室合作,并在后面将其收购,其芯片的logo就是Annapurna

- web报表工具FineReport常见的数据集报错错误代码和解释

老A不折腾

web报表finereport代码可视化工具

在使用finereport制作报表,若预览发生错误,很多朋友便手忙脚乱不知所措了,其实没什么,只要看懂报错代码和含义,可以很快的排除错误,这里我就分享一下finereport的数据集报错错误代码和解释,如果有说的不准确的地方,也请各位小伙伴纠正一下。

NS-war-remote=错误代码\:1117 压缩部署不支持远程设计

NS_LayerReport_MultiDs=错误代码

- Java的WeakReference与WeakHashMap

bylijinnan

java弱引用

首先看看 WeakReference

wiki 上 Weak reference 的一个例子:

public class ReferenceTest {

public static void main(String[] args) throws InterruptedException {

WeakReference r = new Wea

- Linux——(hostname)主机名与ip的映射

eksliang

linuxhostname

一、 什么是主机名

无论在局域网还是INTERNET上,每台主机都有一个IP地址,是为了区分此台主机和彼台主机,也就是说IP地址就是主机的门牌号。但IP地址不方便记忆,所以又有了域名。域名只是在公网(INtERNET)中存在,每个域名都对应一个IP地址,但一个IP地址可有对应多个域名。域名类型 linuxsir.org 这样的;

主机名是用于什么的呢?

答:在一个局域网中,每台机器都有一个主

- oracle 常用技巧

18289753290

oracle常用技巧 ①复制表结构和数据 create table temp_clientloginUser as select distinct userid from tbusrtloginlog ②仅复制数据 如果表结构一样 insert into mytable select * &nb

- 使用c3p0数据库连接池时出现com.mchange.v2.resourcepool.TimeoutException

酷的飞上天空

exception

有一个线上环境使用的是c3p0数据库,为外部提供接口服务。最近访问压力增大后台tomcat的日志里面频繁出现

com.mchange.v2.resourcepool.TimeoutException: A client timed out while waiting to acquire a resource from com.mchange.v2.resourcepool.BasicResou

- IT系统分析师如何学习大数据

蓝儿唯美

大数据

我是一名从事大数据项目的IT系统分析师。在深入这个项目前需要了解些什么呢?学习大数据的最佳方法就是先从了解信息系统是如何工作着手,尤其是数据库和基础设施。同样在开始前还需要了解大数据工具,如Cloudera、Hadoop、Spark、Hive、Pig、Flume、Sqoop与Mesos。系 统分析师需要明白如何组织、管理和保护数据。在市面上有几十款数据管理产品可以用于管理数据。你的大数据数据库可能

- spring学习——简介

a-john

spring

Spring是一个开源框架,是为了解决企业应用开发的复杂性而创建的。Spring使用基本的JavaBean来完成以前只能由EJB完成的事情。然而Spring的用途不仅限于服务器端的开发,从简单性,可测试性和松耦合的角度而言,任何Java应用都可以从Spring中受益。其主要特征是依赖注入、AOP、持久化、事务、SpringMVC以及Acegi Security

为了降低Java开发的复杂性,

- 自定义颜色的xml文件

aijuans

xml

<?xml version="1.0" encoding="utf-8"?> <resources> <color name="white">#FFFFFF</color> <color name="black">#000000</color> &

- 运营到底是做什么的?

aoyouzi

运营到底是做什么的?

文章来源:夏叔叔(微信号:woshixiashushu),欢迎大家关注!很久没有动笔写点东西,近些日子,由于爱狗团产品上线,不断面试,经常会被问道一个问题。问:爱狗团的运营主要做什么?答:带着用户一起嗨。为什么是带着用户玩起来呢?究竟什么是运营?运营到底是做什么的?那么,我们先来回答一个更简单的问题——互联网公司对运营考核什么?以爱狗团为例,绝大部分的移动互联网公司,对运营部门的考核分为三块——用

- js面向对象类和对象

百合不是茶

js面向对象函数创建类和对象

接触js已经有几个月了,但是对js的面向对象的一些概念根本就是模糊的,js是一种面向对象的语言 但又不像java一样有class,js不是严格的面向对象语言 ,js在java web开发的地位和java不相上下 ,其中web的数据的反馈现在主流的使用json,json的语法和js的类和属性的创建相似

下面介绍一些js的类和对象的创建的技术

一:类和对

- web.xml之资源管理对象配置 resource-env-ref

bijian1013

javaweb.xmlservlet

resource-env-ref元素来指定对管理对象的servlet引用的声明,该对象与servlet环境中的资源相关联

<resource-env-ref>

<resource-env-ref-name>资源名</resource-env-ref-name>

<resource-env-ref-type>查找资源时返回的资源类

- Create a composite component with a custom namespace

sunjing

https://weblogs.java.net/blog/mriem/archive/2013/11/22/jsf-tip-45-create-composite-component-custom-namespace

When you developed a composite component the namespace you would be seeing would

- 【MongoDB学习笔记十二】Mongo副本集服务器角色之Arbiter

bit1129

mongodb

一、复本集为什么要加入Arbiter这个角色 回答这个问题,要从复本集的存活条件和Aribter服务器的特性两方面来说。 什么是Artiber? An arbiter does

not have a copy of data set and

cannot become a primary. Replica sets may have arbiters to add a

- Javascript开发笔记

白糖_

JavaScript

获取iframe内的元素

通常我们使用window.frames["frameId"].document.getElementById("divId").innerHTML这样的形式来获取iframe内的元素,这种写法在IE、safari、chrome下都是通过的,唯独在fireforx下不通过。其实jquery的contents方法提供了对if

- Web浏览器Chrome打开一段时间后,运行alert无效

bozch

Webchormealert无效

今天在开发的时候,突然间发现alert在chrome浏览器就没法弹出了,很是怪异。

试了试其他浏览器,发现都是没有问题的。

开始想以为是chorme浏览器有啥机制导致的,就开始尝试各种代码让alert出来。尝试结果是仍然没有显示出来。

这样开发的结果,如果客户在使用的时候没有提示,那会带来致命的体验。哎,没啥办法了 就关闭浏览器重启。

结果就好了,这也太怪异了。难道是cho

- 编程之美-高效地安排会议 图着色问题 贪心算法

bylijinnan

编程之美

import java.util.ArrayList;

import java.util.Collections;

import java.util.List;

import java.util.Random;

public class GraphColoringProblem {

/**编程之美 高效地安排会议 图着色问题 贪心算法

* 假设要用很多个教室对一组

- 机器学习相关概念和开发工具

chenbowen00

算法matlab机器学习

基本概念:

机器学习(Machine Learning, ML)是一门多领域交叉学科,涉及概率论、统计学、逼近论、凸分析、算法复杂度理论等多门学科。专门研究计算机怎样模拟或实现人类的学习行为,以获取新的知识或技能,重新组织已有的知识结构使之不断改善自身的性能。

它是人工智能的核心,是使计算机具有智能的根本途径,其应用遍及人工智能的各个领域,它主要使用归纳、综合而不是演绎。

开发工具

M

- [宇宙经济学]关于在太空建立永久定居点的可能性

comsci

经济

大家都知道,地球上的房地产都比较昂贵,而且土地证经常会因为新的政府的意志而变幻文本格式........

所以,在地球议会尚不具有在太空行使法律和权力的力量之前,我们外太阳系统的友好联盟可以考虑在地月系的某些引力平衡点上面,修建规模较大的定居点

- oracle 11g database control 证书错误

daizj

oracle证书错误oracle 11G 安装

oracle 11g database control 证书错误

win7 安装完oracle11后打开 Database control 后,会打开em管理页面,提示证书错误,点“继续浏览此网站”,还是会继续停留在证书错误页面

解决办法:

是 KB2661254 这个更新补丁引起的,它限制了 RSA 密钥位长度少于 1024 位的证书的使用。具体可以看微软官方公告:

- Java I/O之用FilenameFilter实现根据文件扩展名删除文件

游其是你

FilenameFilter

在Java中,你可以通过实现FilenameFilter类并重写accept(File dir, String name) 方法实现文件过滤功能。

在这个例子中,我们向你展示在“c:\\folder”路径下列出所有“.txt”格式的文件并删除。 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16

- C语言数组的简单以及一维数组的简单排序算法示例,二维数组简单示例

dcj3sjt126com

carray

# include <stdio.h>

int main(void)

{

int a[5] = {1, 2, 3, 4, 5};

//a 是数组的名字 5是表示数组元素的个数,并且这五个元素分别用a[0], a[1]...a[4]

int i;

for (i=0; i<5; ++i)

printf("%d\n",

- PRIMARY, INDEX, UNIQUE 这3种是一类 PRIMARY 主键。 就是 唯一 且 不能为空。 INDEX 索引,普通的 UNIQUE 唯一索引

dcj3sjt126com

primary

PRIMARY, INDEX, UNIQUE 这3种是一类PRIMARY 主键。 就是 唯一 且 不能为空。INDEX 索引,普通的UNIQUE 唯一索引。 不允许有重复。FULLTEXT 是全文索引,用于在一篇文章中,检索文本信息的。举个例子来说,比如你在为某商场做一个会员卡的系统。这个系统有一个会员表有下列字段:会员编号 INT会员姓名

- java集合辅助类 Collections、Arrays

shuizhaosi888

CollectionsArraysHashCode

Arrays、Collections

1 )数组集合之间转换

public static <T> List<T> asList(T... a) {

return new ArrayList<>(a);

}

a)Arrays.asL

- Spring Security(10)——退出登录logout

234390216

logoutSpring Security退出登录logout-urlLogoutFilter

要实现退出登录的功能我们需要在http元素下定义logout元素,这样Spring Security将自动为我们添加用于处理退出登录的过滤器LogoutFilter到FilterChain。当我们指定了http元素的auto-config属性为true时logout定义是会自动配置的,此时我们默认退出登录的URL为“/j_spring_secu

- 透过源码学前端 之 Backbone 三 Model

逐行分析JS源代码

backbone源码分析js学习

Backbone 分析第三部分 Model

概述: Model 提供了数据存储,将数据以JSON的形式保存在 Model的 attributes里,

但重点功能在于其提供了一套功能强大,使用简单的存、取、删、改数据方法,并在不同的操作里加了相应的监听事件,

如每次修改添加里都会触发 change,这在据模型变动来修改视图时很常用,并且与collection建立了关联。

- SpringMVC源码总结(七)mvc:annotation-driven中的HttpMessageConverter

乒乓狂魔

springMVC

这一篇文章主要介绍下HttpMessageConverter整个注册过程包含自定义的HttpMessageConverter,然后对一些HttpMessageConverter进行具体介绍。

HttpMessageConverter接口介绍:

public interface HttpMessageConverter<T> {

/**

* Indicate

- 分布式基础知识和算法理论

bluky999

算法zookeeper分布式一致性哈希paxos

分布式基础知识和算法理论

BY

[email protected]

本文永久链接:http://nodex.iteye.com/blog/2103218

在大数据的背景下,不管是做存储,做搜索,做数据分析,或者做产品或服务本身,面向互联网和移动互联网用户,已经不可避免地要面对分布式环境。笔者在此收录一些分布式相关的基础知识和算法理论介绍,在完善自我知识体系的同

- Android Studio的.gitignore以及gitignore无效的解决

bell0901

androidgitignore

github上.gitignore模板合集,里面有各种.gitignore : https://github.com/github/gitignore

自己用的Android Studio下项目的.gitignore文件,对github上的android.gitignore添加了

# OSX files //mac os下 .DS_Store

- 成为高级程序员的10个步骤

tomcat_oracle

编程

What

软件工程师的职业生涯要历经以下几个阶段:初级、中级,最后才是高级。这篇文章主要是讲如何通过 10 个步骤助你成为一名高级软件工程师。

Why

得到更多的报酬!因为你的薪水会随着你水平的提高而增加

提升你的职业生涯。成为了高级软件工程师之后,就可以朝着架构师、团队负责人、CTO 等职位前进

历经更大的挑战。随着你的成长,各种影响力也会提高。

- mongdb在linux下的安装

xtuhcy

mongodblinux

一、查询linux版本号:

lsb_release -a

LSB Version: :base-4.0-amd64:base-4.0-noarch:core-4.0-amd64:core-4.0-noarch:graphics-4.0-amd64:graphics-4.0-noarch:printing-4.0-amd64:printing-4.0-noa