AAAI17最佳论文:Label-Free Supervision of Neural Networks with Physics and Domain Knowledge

本文为翻译AAAI17最佳论文:Label-Free Supervision of Neural Networks with Physics and Domain Knowledge,如有错误,还望指正。转载请说明出处。

用物理和特定领域知识让神经网络进行不带标签的监督学习

摘 要

在许多机器学习应用中,带标签的数据数量稀少,要获得更多的标签造价昂贵。我们引入了一种新的神经网络监督学习方法,不是直接给出输入-输出对的直接示例,而是指定在输出空间上能够成立的约束。这些约束来源于先前的特定领域知识(domain knowledge),如已知物理定律。我们展示了这种方法在真实世界和模拟计算机视觉任务上的有效性。使用这种方法,我们在没有任何带标签的训练样本的情况下,成功训练了一个卷积神经网络来检测和跟踪对象。

介绍

机器学习的应用往往受限于需要大量数据的标签化。即便神经网络对数据有很大的帮助,也需要数据带有标签。尽管如此,我们观察到,人类往往能够没有直接的例子学习,而是通过高层次的指导去完成任务,或者完成后看它是什么样子的。我们在思考一个类似的原理是否可以应用于教学机器,是否可以仅仅通过描述期望产出的结构来监督网络而不用单独的例子?

现在的无标签学习方法通常属于无监督学习的范畴。 例如,自动编码器目的是发现没有标签数据的隐藏结构。 这样的系统能够高度地压缩数据,去代表原始的输入(Kingma and Welling 2013;Le 2013)。 然而,这些表示与我们不同,因为它们没有明确地形成特定的含义或语义。

在本文中,我们明确地提供了我们希望发现的隐藏变量的语义,但是仍然通过学习约束来学习无标签(参见(Shcherbatyi和Andres,2016)对这个想法的介绍)。 直观上,代数和逻辑约束用于对先验知识已知的结构和关系进行编码。 但提供这些必要的过程约束可能仍然需要大量的特定工程。

然而,通过训练,没有我们隐藏的(输出)变量的价值的直接例子,我们比传统的监督学习,包括以下几点的优势

1)减少标签的开销

2)一般性的增加,作为一组约束可以应用于多个数据集而无需重新标记。 这项工作的首要贡献是演示了约束学习是如何监督神经网络的。通过了三个实际的例子进行描述。 我们探索同时期特征学习所面临的挑战,在原始数据上避免琐碎,低熵的解决方案约束空间。

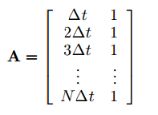

问题设置

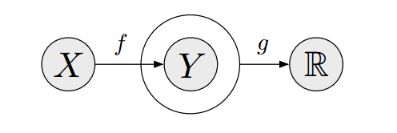

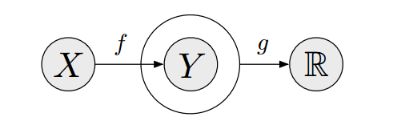

在传统的监督学习设置中,给定一个训练集D = {(x1, y1)... (xn,yn)}n个训练样例。每个(xi,yi)都是由一个实例中的xi![]() X和所对应的标签yi

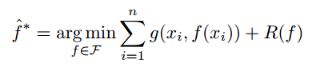

X和所对应的标签yi![]() Y构成的。目的是学习一个函数,从X->Y的输入到输出的映射。为了测试性能,提供了一个损失函数:Y*Y->R,并且通过如下公式来找到映射。(求最小的损失函数)

Y构成的。目的是学习一个函数,从X->Y的输入到输出的映射。为了测试性能,提供了一个损失函数:Y*Y->R,并且通过如下公式来找到映射。(求最小的损失函数)

为了优化,预定义了一个函数F(假设类)。在我们的例子中,F将通过它们的权重进行(卷积)神经网络的调参。损失可能的例子:

我们利用我们总结的经验,限制了假设类F的空间大小。通俗地说,这个叫做没有免费地午餐,每个机器学习算法为了能够工作,都必须做出这样的假设。建模者结合先验知识的另一种常见方式是通过为F中的某些函数指定一个先验偏好,包含一个正则化项R:F→R,

通常,正则化术语R:F→R指定了对“简单”功能(奥卡姆剃刀)的偏好。正则化技术如dropout(Srivastava et al。2014)是在大量参数训练功能时避免过度拟合的关键。

在许多ML设置中,输入空间X是复杂的(图像),而输出空间Y是简单的(例如,其中Y = {0,1}的二元分类问题)。在这里,我们对结构化预测问题感兴趣,其中X和Y都是复杂的。例如,在我们的第一个实验中,X对应着视频中的图像序列,而Y则代表一个物体在空中移动的高度。定义一个函数f*,能够正确地映射到物体所对应的高度。显然,每一帧的高度并不是独立的,而且序列表现出一个明确的(代数)结构。事实上,我们从基本物理学中知道任何正确的输出序列都可以用抛物线来表达。原则上,我们可以利用这个先验知识,仅去考虑有效子集Y抛物线⊂ Y,去限制假设类F。但是,这种方法需要标签,并且很难结合神经网络和非常成熟的正则化方案。

在这篇文章中,我们将先验知识建立在输出结构中,通过提供一个权重约束g : X × Y → R,从而去掉那些不符合先验知识的结构。当Y是一个(多维的)离散空间(例如描述图像的许多潜在的二元属性)时,使用一个图形化的模型方法去指定一个g,这个g作为一个潜在的权重和或约束,仅依赖于一个小的变量子集。

在这篇文章中,我们所探讨地问题是,弱监督是否足够有能力去进行学习。当明确需要标签y,去评估f*时,标签也许并不是必须要获得的。如果先验知识能够告诉我们有关f*独特的属性,我们可以使用这些属性去训练。具体来说,我们考虑一个无监督的方法,其中标签yi不提供给我们,并且要优化一个输出的必要属性,可以用g代替。

这个案例,我们可以使用随机梯度下降来优化方程2,避免使用标签。当优化方程2时,并不足够找到f*,我们将加入正则项去监督机器,已让它能够往正确的方向聚合。

例如,我们的实验,如果g不满足一个常数输出,我们需要加入一个项,使其为一个较高熵的输出。设计这个损失g和正则化项R的过程是一个监督形式,并且需要时间的投入。但是不同与手工标注,它并不能成比例地增加数据地大小,行列式,和在没有修改的情况下,适应一个新的数据集。

实验

我们训练的神经网络,在不需要直接例子的情况下,关注从输入到输出的映射。在我们前两个例子中,我们构建一个图像中物体的位置映射。通过利用随时间变化的图像结构,使学习成为可能。在我们的第三个实验中,我们将图像映射到两个布尔变量,描述图像是否包含两个特殊对象。学习利用这些对象之间存在的独特的因果语义。 在我们的实验中,我们只提供标签用于评估。

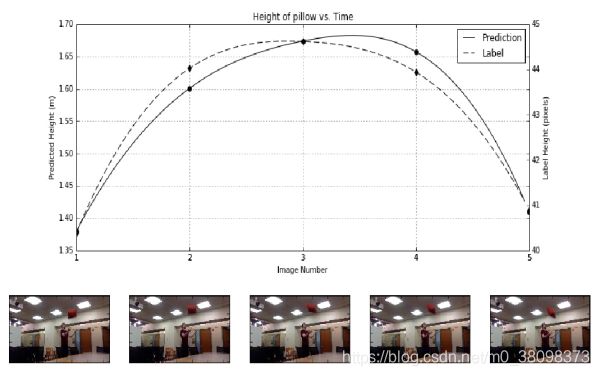

在自由落体中跟踪对象

在第一个实验中,我们记录了视频中一个物体在我们视野中投出去的画面,目标是学习物体每一帧的高度。我们的目标是从Rheight×width×3 → R映射中得到一个回归网络。其中高度和宽度是每帧的垂直和水平像素的数量,并且每个像素具有3个颜色通道。

我们将把这个网络作为一个结构化预测问题进行训练,在一系列N个图像上进行操作,产生一个N个高度的序列,(Rheight×width×3)N→ RN,并且每个数据xi都是图像中的向量。而不是用y∈R N,直接标签监督我们的网络,而是监督网络以找到一个服从自由落体的基本物理的物体。由于引力对所有物体的作用是一样的,我们不需要对物体的质量或体积进行编码。

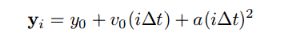

物体在重力作用下的固定加速度为a = -9.8m / s2,随着时间的推移,物体的高度将形成一个抛物线:

这个等式提供了一个必要的约束,正确的映射f *必须满足。 因此,我们通过在更好地满足这个方程的方向上进行渐进式改进来训练f。

给定任意轨迹的N序列高度预测f(x),我们用固定曲率的抛物线去预测,并且最小化残差。形式上,我们设定a = [a∆t2 , a(2∆t)2 , . . . , a(N∆t)2]

并且设置

约束损失定义为:

我们注意到向量方程(三)中y_hat是预测f(x)的函数,而不是真实的标签。因为g处处可微,我们可以用随机梯度下降去优化方程(二)。令人惊讶的是,我们发现,当合并利用神经网络的现有正则化方法,该优化足以将f *恢复到常数C(指定对象高度对应到0)。图2所示,还有我们用神经网络做的结果。

训练细节

我们的数据集是以每秒10帧(Δt= 0.1s)的速度运行的。 我们修复了相机的位置,并记录了飞行中物体的65个不同的轨迹,总计602幅图像。 对于每个轨迹,我们训练N = 5个连续帧的随机选择的区间。 我们的数据将在发布后公布。 在进入一个没有预训练的随机初始化小型神经网络之前,图像调整为56×56像素。 我们使用3个Conv / ReLU / MaxPool块,然后是2个完全连接/ ReLU层,概率为0.5和一个回归输出。 我们将轨迹分成16个大小的批次,每次迭代训练总共80幅图像。 我们在TensorFlow(Abadi et al。2016)中使用Adam优化器(Kingma和Ba 2014),学习率为0.0001,训练4000次迭代。

评估

为了评估,我们手动标记了像素空间中掉落物体的高度。请注意,以米为单位,标记真实高度需要知道对象的高度距离摄像机的距离,所以我们通过测量预测高度与地面真实像素测量的相关性来进行评估。 所有的结果都在测试集上评估。 请注意,一个统一的随机输出预期相关性为12.1%。 我们的网络导致90.1%的相关性。 为了比较,我们还在标签上训练了一个监督网络来直接预测像素的高度。 这个网络达到了94.5%的相关性,尽管这个任务比较容易,因为它不需要网络来补偿物体与相机的距离。

这个实验表明,可以教一个神经网络从真实图像中提取物体信息,只需记下物体服从的物理方程。

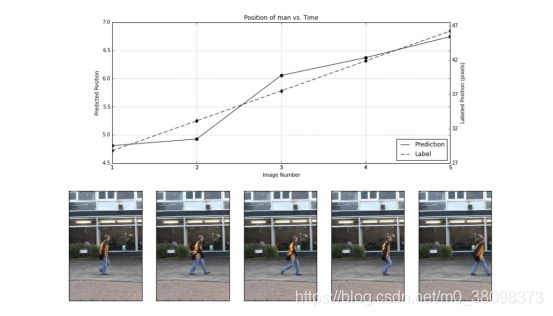

追踪一个行人的位置

在我们的第二个实验中,我们现在试图将自由落体的检测扩展到其他类型的运动。 我们的目标是检测一个人在行走时的水平位移,而不提供直接的标签y∈R。为此,我们利用随时间推移的结构,假设人在短时间内以恒定的速度行走。 因此我们制定了一个结构化的预测问题

![]()

分别处理训练实例xi作为图像的矢量(既有大小又有方向),y为对一系列图像的预测。

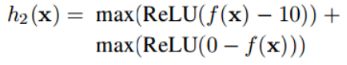

我们使用之前收集的数据集,我们观察到恒定速度假设大致成立。考虑到与对第一个实验自由落体的相似之处,我们希望简单地从方程(3)中删除引力项并重新训练。然而,在这种情况下,这是不可能的,因为约束条件提供了一个必要但不充分的条件。

给定正确输出的序列(y1,...,yN),修改后的序列(λ* y1 + C,...,λ* yN + C)(λ,C∈R)也将满足匀速度的约束。在最坏的情况下,当λ= 0时,f≡C,网络可以满足约束条件,但不依赖于图像。从经验上讲,我们观察到f≡C很容易学习,如果我们没有明确防范这个小问题的解决方案,网络将永远聚合到它。

我们希望通过加入两个损失项,使网络可以输出非平凡解。首先,我们给一个让网络标准差(波动)大的损失项。

然而,这会引入一个新的问题,假设![]() → ∞ ,会让标准差过大,所以,给了一个限制函数,让输出f(x)在0到10 之间。

→ ∞ ,会让标准差过大,所以,给了一个限制函数,让输出f(x)在0到10 之间。

最终约束函数是

我们也可以用尺度不变的方式测量约束损失(例如,在测量惯性损失之前可以优化输出)。 这符合充分条件有多种选择来指导收敛的原则。

训练细节如图(3)所示,我们的网络确实能够发现在相机下人行走的横向位置。 我们的数据集包含11个轨迹,6个不同的场景,总共调整了507张图片,图像为56×56。我们训练我们的网络输出线性一致,每个轨迹为5个步幅的位置,之后进行评估。我们设定了边界违约惩罚,γ2= 0.8,大于标准差,γ1= 0.6,引导网络找到最大λ,同时不违反边界解的约束。我们选择和自由落体实验上完全相同的超参数(丢失率,迭代次数,隐藏单位数量,等等),为了体现出这些参数的一定程度的鲁棒性。

评估

我们的测试标签是用像素来衡量的,而我们的预测却是以任意单位来模仿的。因此,我们找到最好的模仿变换(α,β)将我们的预测,映射到每个轨迹的像素空间上,并测量相关性。请注意,α和β可以在不同的场景,因此这个度量没有完整的证明解决对象检测问题。尽管如此,我们发现我们的预测是95.4%相关的与地面的真相。令人惊讶的是,通过直接监督的网络训练很难泛化,并在测试中得到了80.5%的相关性(99.8%的训练)。我们认为这种下降的表现,是因为训练少量的训练数据(11轨迹),最终导致过拟合,并期望近乎完美一个训练有素的监督分类器的相关性。

这个实验证明了探测一个运动的物体在没有标签的情况下的可能性。重要的是,它也表明,即使主要的结构性约束不足以指导学习,我们可能会增加额外惩罚,鼓励一个正确的,可以得到非平凡解的方案。(注)建模样本选取有误,如样本数量太少,选样方法错误,样本标签错误等,导致选取的样本数据不足以代表预定的分类规则;

用因果关系检测对象

在之前的实验中,我们用的都是物理领域的知识。原则上, 其他领域的知识也可以用于在学习中提供监督处理。例如,已经投入了大量的努力在过去的几十年中建设大型知识库(Lenat 1995; Bollacker等2008)。 这个知识通常是使用基于逻辑和约束的形式化编码。因此,在这第三个实验中,我们探讨了学习单一图像的逻辑约束的可能性。更具体地说,我们问是否可以学习因果现象。

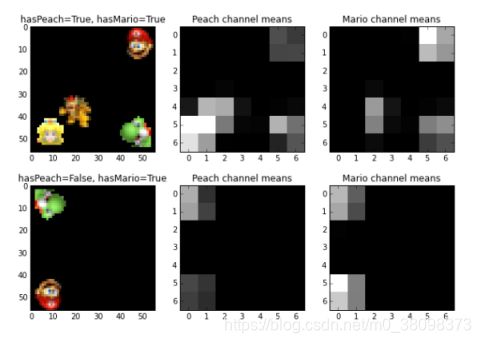

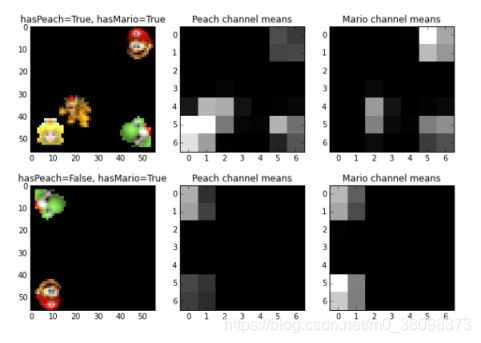

图4:每当桃(金发)出现时,马里奥(红)出现,但不是相反。 Yoshi(绿色)和Bowser(橙色)随机出现。 系统训练这个高级知识,并学习回答每个图像是否包含桃子或马里奥。 第一列包含示例图像。 第二列和第三列分别显示桃和马里奥的位置。

我们提供的图像包含最多四个字符的随机集合:桃子公主,马里奥,耀西和鲍泽,每个角色由于旋转和反射而具有较小的外观变化。 图(4)中可以看到示例图像。 虽然每个框架中的对象的存在是非确定性的,但是生成分布却发现在桃子公主出现时马里奥总是出现的基本现象。 我们的目标是创建一对神经网络f1,f2来分别识别桃子和马里奥。fk:Rheight×wide×3→{0,1},将图像映射到离散的布尔变量y1和y2。我们不通过直接标签来监督,而是通过约束他们的输出来建立逻辑关系y1⇒y2来训练网络。 这个问题是具有挑战性的,因为网络必须同时学习识别字符并根据逻辑关系选择它们。

仅仅满足约束y1⇒y2不足以证明学习。例如,系统可能会错误地输出常量y1≡1,y2≡1。这样的解决方案可以满足约束,但是对图像中字符的存在一无所知。

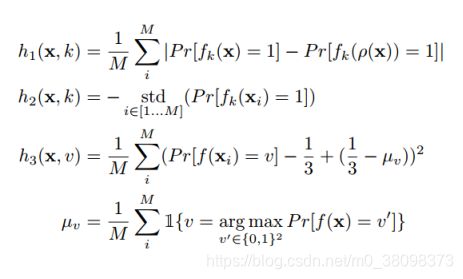

为了避免这种问题,我们增加了三个损失项:h1,h2和h3。h1(x) 中ρ(x) 是对图片进行各种平移选择变换,这个正则项的目的是为了不考虑图片中公主或者马里奥的位置,更关注于是否存在这两个物体, h2(x) 为了使得fx方差尽可能大,避免平凡解(常数)。h3(x)为了增加输出熵,即![]() 每个概率为1/3为输出熵最大。其中M =16。

每个概率为1/3为输出熵最大。其中M =16。

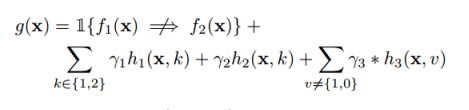

约束函数:

应用这些限制后,仍然存在一个问题。 约束对于逻辑排列是不变的(例如给出正确的解决方案)![]() ,

,

评估

我们的输入图像,如图(4)所示,是56×56像素。 我们设γ1= 0.65,γ2= 0.65,γ3= 0.95,经过4000次迭代训练收敛。 在128个图像的测试集上,网络学习将每个图像映射到图像是否包含桃和马里奥的正确描述。

这个实验表明,网络可以从约束条件中学习,这些约束条件对具有潜在复杂逻辑规则的离散集合进行操作 删除约束h1,h2或h3将导致学习失败。 因此,实验还表明,复杂的充足条件可以成为从约束中学习的关键。

相关工作

在这项工作中,我们提出了将领域知识纳入三个计算机视觉任务的新策略。我们实验中的网络通过利用约束形式的高级指令来学习没有标签。

在等级学习中,标签可以作为输入之间的排序,其目标是找到一个尊重排序关系的输入嵌入(Joachims 2002)。归纳逻辑编程方法依靠逻辑形式和约束来表示背景知识,并从数据中学习假设(Muggleton和De Raedt 1994; De Raedt 2008;De Raedt和Kersting 2003)。 各种类型的约束也被广泛用于指导无监督学习算法,如聚类和降维技术(Lee and Seung 2001; Basu,Davidson,and Wagstaff 2008; Zhi等2013; Ermon et al。2015)。(Kotzias等,2015)使用约束学习在自然语言环境中训练深度网络。评论中的情绪标签被用来分析包括那些评论的单个句子的情绪。