神经网络与深度学习day01-基础知识

今天开始新学期,然后就是每周要在这里发这周的实验报告,CSDN对不起了,你可能不情愿,但是必须要稍微容纳一下我(这个菜比)在这里吹了。

第一周的基础知识训练:

1、导入numpy库

import numpy2、建立一个一维数组a=[4,5,6]。输出:(1)a的类型;(2)a的各维度的大小;(3)a的第一个元素

a = [4,5,6]

print(type(a))

print(numpy.shape(a))

print(a[0])运行结果:

3、建立一个二维数组 b,初始化为 [ [4, 5, 6],[1, 2, 3]] (1)输出各维度的大小(shape)(2)输出 b(0,0),b(0,1),b(1,1) 这三个元素(对应值分别为4,5,2)

b = [ [4,5,6],[1,2,3]]

print(numpy.shape(b))

print(b[0][0],b[0][1],b[1][1])运行结果:

4、(1)建立一个全0矩阵 a, 大小为 3x3; 类型为整型(提示: dtype = int)(2)建立一个全1矩阵b,大小为4x5; (3)建立一个单位矩阵c ,大小为4x4; (4)生成一个随机数矩阵d,大小为 3x2.

a = numpy.zeros((3,3))

a.dtype = 'int'

b = numpy.ones((4,5))

c = numpy.eye(4)

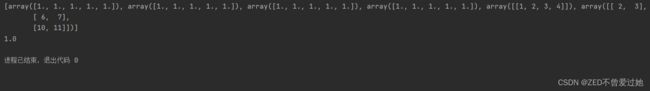

d = numpy.random.rand(3,2)5、 建立一个数组 a,(值为[[1, 2, 3, 4], [5, 6, 7, 8], [9, 10, 11, 12]] ) ,(1)打印a; (2)输出 下标为(2,3),(0,0) 这两个数组元素的值

a = [[1, 2, 3, 4], [5, 6, 7, 8], [9, 10, 11, 12]]

print(a)

print(a[2][3],a[0][0])运行结果:

6、把上一题的 a数组的 0到1行 2到3列,放到b里面去,(此处不需要从新建立a,直接调用即可)(1),输出b;(2) 输出b 的(0,0)这个元素的值

b = list(b)

b.append(numpy.array(a)[:1,:])

b.append(numpy.array(a)[:,1:3])

print(b)

print(b[0][0])运行结果:

7、把第5题中数组a的最后两行所有元素放到 c中,(提示: a[1:2, :])(1)输出 c ; (2) 输出 c 中第一行的最后一个元素(提示,使用 -1 表示最后一个元素)

c = list(c)

c.append(numpy.array(a)[1:2,:])

print(c[0][-1])运行结果:

8、建立数组a,初始化a为[[1, 2], [3, 4], [5, 6]],输出 (0,0)(1,1)(2,0)这三个元素(提示: 使用 print(a[[0, 1, 2], [0, 1, 0]]) )

a = [[1, 2], [3, 4], [5, 6]]

print(numpy.array(a)[[0, 1, 2], [0, 1, 0]])运行结果:

9、建立矩阵a ,初始化为[[1, 2, 3], [4, 5, 6], [7, 8, 9], [10, 11, 12]],输出(0,0),(1,2),(2,0),(3,1) (提示使用 b = np.array([0, 2, 0, 1]) print(a[np.arange(4), b]))

a = [[1, 2, 3], [4, 5, 6], [7, 8, 9], [10, 11, 12]]

b = numpy.array([0, 2, 0, 1])

print(numpy.array(a)[numpy.arange(4), b])运行结果:

10、对9 中输出的那四个元素,每个都加上10,然后重新输出矩阵a.(提示: a[np.arange(4), b] += 10 )

numpy.array(a)[numpy.arange(4),b] +=10array 的数学运算

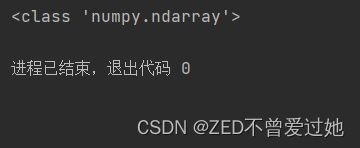

11、执行 x = np.array([1, 2]),然后输出 x 的数据类型

import numpy as np

x = np.array([1,2])

print(type(x))运行结果:

12、执行 x = np.array([1.0, 2.0]) ,然后输出 x 的数据类类型

x = np.array([1.0, 2.0])

print(type(x))运行结果:

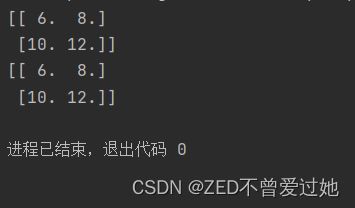

13、执行 x = np.array([[1, 2], [3, 4]], dtype=np.float64) ,y = np.array([[5, 6], [7, 8]], dtype=np.float64),然后输出 x+y ,和 np.add(x,y)

x = np.array([[1, 2], [3, 4]], dtype=np.float64)

y = np.array([[5, 6], [7, 8]], dtype=np.float64)

print(x + y)

print(np.add(x,y))运行结果:

14、利用 13题目中的x,y 输出 x-y 和 np.subtract(x,y)

print(x-y)

print(np.subtract(x,y))运行结果:

15、利用13题目中的x,y 输出 x*y ,和 np.multiply(x, y) 还有 np.dot(x,y),比较差异。然后自己换一个不是方阵的试试。

print(x*y)

print("multiply",np.multiply(x,y))

print("dot",np.dot(x,y))

"""

差异:multipy是对应元素相乘,然后放到对应的位置中去

而dot是按照矩阵相乘的方法求得结果

"""

my_matrix_test1 = np.array([[1,2],[3,4],[5,6]])

my_matrix_test2 = np.array([[1,2],[3,4],[5,6]])

# print("multiply_test111",np.multiply(my_matrix_test1,my_matrix_test2))#对应相乘

# print("dot_test111",np.dot(my_matrix_test1,my_matrix_test2))#不能输出若my_matrix_test2转置则可以运行运行结果:

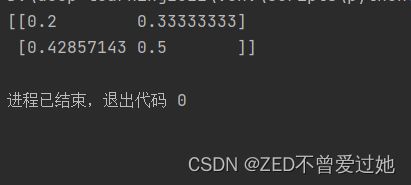

16、利用13题目中的x,y,输出 x / y .(提示 : 使用函数 np.divide())

print(np.divide(x,y))运行结果:

17、利用13题目中的x,输出 x的 开方。(提示: 使用函数 np.sqrt() )

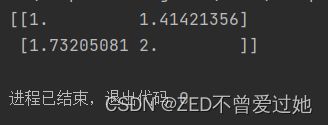

print(np.sqrt(x))运行结果:

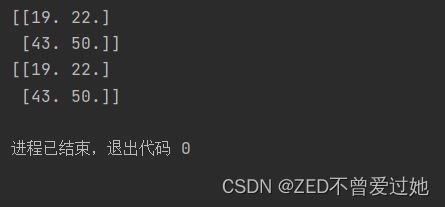

18、利用13题目中的x,y ,执行 print(x.dot(y)) 和 print(np.dot(x,y))

print(x.dot(y))

print(np.dot(x,y))运行结果:

19、利用13题目中的 x,进行求和。提示:输出三种求和 (1)print(np.sum(x)): (2)print(np.sum(x,axis =0 )); (3)print(np.sum(x,axis = 1))

print("19")

print(np.sum(x))

print(np.sum(x,axis=0))#对第一维度求和 sum = arr[0][n1][n2] + arr[1][n1][n2]

print(np.sum(x,axis=1))#对第二维度求和 sum = arr[n0][0][n2] + arr[n0][1][n2] + arr[n0][2][n2]运行结果:

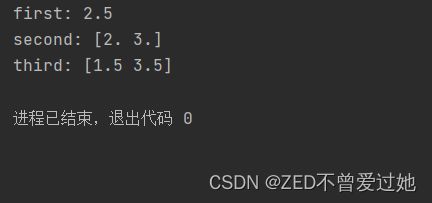

20、利用13题目中的 x,进行求平均数(提示:输出三种平均数(1)print(np.mean(x)) (2)print(np.mean(x,axis = 0))(3) print(np.mean(x,axis =1)))

print("first:",np.mean(x))

print("second:",np.mean(x,axis=0))

print("third:",np.mean(x,axis=1))运行结果:

21、利用13题目中的x,对x 进行矩阵转置,然后输出转置后的结果,(提示: x.T 表示对 x 的转置)

print(np.array(x).T)运行结果:

22、利用13题目中的x,求e的指数(提示: 函数 np.exp())

y = np.exp(x)23、利用13题目中的 x,求值最大的下标(提示(1)print(np.argmax(x)) ,(2) print(np.argmax(x, axis =0))(3)print(np.argmax(x),axis =1))

print(np.argmax(x))

print(np.argmax(x,axis=0))

print(np.argmax(x,axis=1))运行结果:

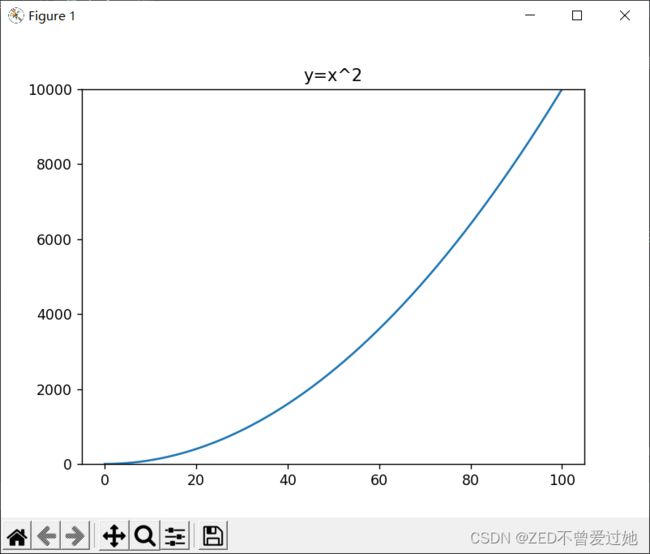

24、画图,y=x*x 其中 x = np.arange(0, 100, 0.1) (提示这里用到 matplotlib.pyplot 库)

import matplotlib.pyplot as plt

x = np.arange(0,100,0.1)

y = x**2

plt.plot(x,y)

plt.title("y=x^2")

plt.ylim(0,10000)#设置y轴范围

plt.show()运行结果:

25、画图。画正弦函数和余弦函数, x = np.arange(0, 3 * np.pi, 0.1)(提示:这里用到 np.sin() np.cos() 函数和 matplotlib.pyplot 库)

x = np.arange(0, 3*np.pi,0.1)

ysin = np.sin(x)

ycos = np.cos(x)

#画sinx

plt.plot(x,ysin)

plt.title("y=sinx")

plt.ylim(-1,1)

plt.show()

#画cosx

plt.plot(x,ycos)

plt.title("y=cosx")

plt.ylim(-1,1)

plt.show()运行结果:

y=sinx

y = cosx

以上就是第一周的作业题,可以看我们老师的博客NNDL 实验一 numpy_HBU_David的博客-CSDN博客自己做一遍喔,这里是老师的标准答案:神经网络与深度学习(邱锡鹏)编程练习 1 实验 - HBU_DAVID - 博客园