SSD+Tensorflow学习

http://blog.csdn.net/liuyan20062010/article/details/78905517

1. 搭建SSD框架,下载解压即可

下载SSD-tensorflow并解压

https://github.com/balancap/SSD-Tensorflow

2. 下载官方数据

下载VOC2007和VOC2012数据集, 放在/imagedata目录下:

cd imagedata

wget http://host.robots.ox.ac.uk/pascal/VOC/voc2012/VOCtrainval_11-May-2012.tar

wget http://host.robots.ox.ac.uk/pascal/VOC/voc2007/VOCtrainval_06-Nov-2007.tar

wget http://host.robots.ox.ac.uk/pascal/VOC/voc2007/VOCtest_06-Nov-2007.tar

tar -xvf VOCtrainval_11-May-2012.tar

tar -xvf VOCtrainval_06-Nov-2007.tar

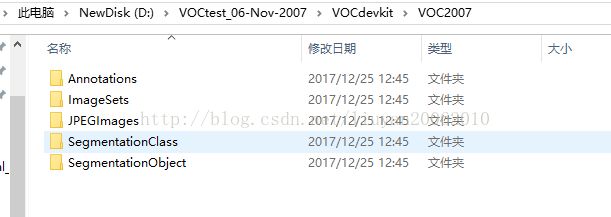

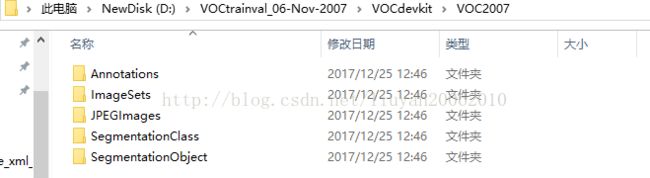

tar -xvf VOCtest_06-Nov-2007.tar下载pascalvoc数据,解压后生成三个文件夹,主要是利用训练集测试的文件夹,VOCtrainval用来训练,VOCtest用来测试。

VOCtrainval 中JPEGImage文件夹中仅是训练和验证的图片,Main文件夹中仅是trainval.txt, train.txt, val.txt

VOCtest中JPEGImage文件夹中仅是测试图片,Main文件夹中仅是test.txt

3. 自己的图片

自己的数据根据voc格式改写(图片的名称,不用拘泥于6位数字,其他命名也可以)

图片数据重命名为6位数字的代码如下:

python代码

import os

class BatchRename():

# '''''

# 批量重命名文件夹中的图片文件

# '''

def __init__(self):

#我的图片文件夹路径horse

self.path = '/home/xxx/imagedata/image_xml'

def rename(self):

filelist = os.listdir(self.path)

total_num = len(filelist)

i = 1

n = 6

for item in filelist:

if item.endswith('.jpg'):

n = 6 - len(str(i))

src = os.path.join(os.path.abspath(self.path), item)

dst = os.path.join(os.path.abspath(self.path), str(0)*n + str(i) + '.jpg')

try:

os.rename(src, dst)

print 'converting %s to %s ...' % (src, dst)

i = i + 1

except:

continue

print 'total %d to rename & converted %d jpgs' % (total_num, i)

if __name__ == '__main__':

demo = BatchRename()

demo.rename() 4.标记数据 标注工具:windows_v1.5.0

5.生成txt文件,train.txt, trainval.txt, test.txt, val.txt

python代码

import os

import random

xmlfilepath=r'/home/xxx/subimage_xml_xiao'

saveBasePath=r"/home/xxx/txt"

trainval_percent=0.7

train_percent=0.7

total_xml = os.listdir(xmlfilepath)

num=len(total_xml)

list=range(num)

tv=int(num*trainval_percent)

tr=int(tv*train_percent)

trainval= random.sample(list,tv)

train=random.sample(trainval,tr)

print("train and val size",tv)

print("traub suze",tr)

ftrainval = open(os.path.join(saveBasePath,'Main/trainval.txt'), 'w')

ftest = open(os.path.join(saveBasePath,'Main/test.txt'), 'w')

ftrain = open(os.path.join(saveBasePath,'Main/train.txt'), 'w')

fval = open(os.path.join(saveBasePath,'Main/val.txt'), 'w')

for i in list:

name=total_xml[i][:-4]+'\n'

if i in trainval:

ftrainval.write(name)

if i in train:

ftrain.write(name)

else:

fval.write(name)

else:

ftest.write(name)

ftrainval.close()

ftrain.close()

fval.close()

ftest .close() 6. 将训练类别修改为和自己一样的

SSD-Tensorflow-master—>datasets—>pascalvoc_common.py

根据实际情况进行修改

VOC_LABELS = {

'none': (0, 'Background'),

'aeroplane': (1, 'Vehicle'),

'bicycle': (2, 'Vehicle'),

'bird': (3, 'Animal'),

'boat': (4, 'Vehicle'),

'bottle': (5, 'Indoor'),

'bus': (6, 'Vehicle'),

'car': (7, 'Vehicle'),

'cat': (8, 'Animal'),

'chair': (9, 'Indoor'),

'cow': (10, 'Animal'),

'diningtable': (11, 'Indoor'),

'dog': (12, 'Animal'),

'horse': (13, 'Animal'),

'motorbike': (14, 'Vehicle'),

'Person': (15, 'Person'),

'pottedplant': (16, 'Indoor'),

'sheep': (17, 'Animal'),

'sofa': (18, 'Indoor'),

'train': (19, 'Vehicle'),

'tvmonitor': (20, 'Indoor'),

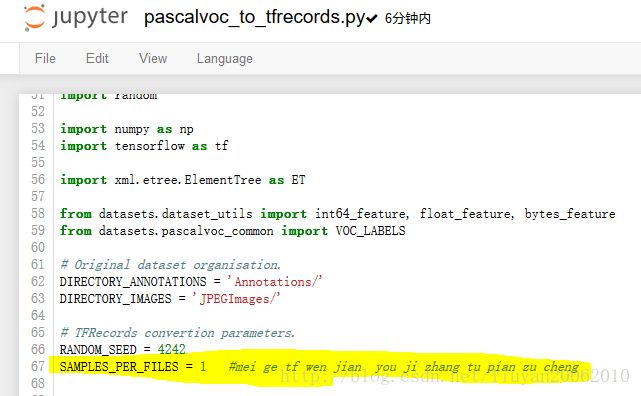

} 7. 将图像数据转换为tfrecods格式

SSD-Tensorflow-master—>datasets—>pascalvoc_to_tfrecords.py 。。。然后更改文件的83行读取方式为’rb’)

修改67行,可以修改几张图片转为一个tfrecords,如下图

在SSD-Tensorflow-master文件夹下创建tf_conver_data.sh (vi tf_conver_data.sh)

注意:tab键和空格键不能混合用。

#!/bin/bash

#this is a shell script to convert pascal VOC datasets into tf-records only

#directory where the original dataset is stored

DATASET_DIR=/home/xxx/imagedata/VOCdevkit/VOC2007/ #VOC数据保存的文件夹(VOC的目录格式未改变)

#output directory where to store TFRecords files

OUTPUT_DIR=/home/xxx/imagedata/tf_records #自己建立的保存tfrecords数据的文件夹

python ./tf_convert_data.py \

--dataset_name=pascalvoc \

--dataset_dir=${DATASET_DIR} \

--output_name=voc_2007_train \

--output_dir=${OUTPUT_DIR}

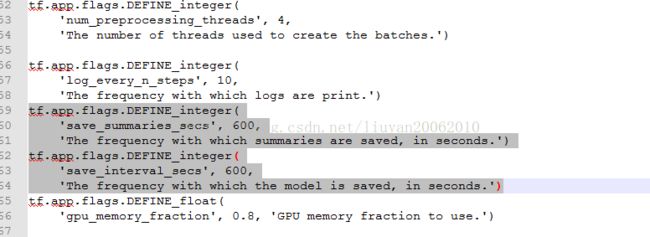

8. 训练模型

train_ssd_network.py修改第154行的最大训练步数,将None改为比如50000。(tf.contrib.slim.learning.training函数中max-step为None时训练会无限进行。)

train_ssd_network.py:

网络参数配置,若需要改,在此文件中进行修改,因为不知道为啥修改后面的sh文件没有效。如果训练时loss为nan,则把该学习率改小0.1倍。网络内存不够训练时,把batch_size(32->16)和最大训练步数(50000->5000)改小。

修改如下图中的数字600,可以改变训练多长时间保存一次模型

需要修改的地方:

a. nets/ssd_vgg_300.py (因为使用此网络结构) ,修改87 和88行的类别

default_params = SSDParams(

img_shape=(300, 300),

num_classes=21, #根据自己的数据修改为类别+1

no_annotation_label=21, #根据自己的数据修改为类别+1

feat_layers=['block4', 'block7', 'block8', 'block9', 'block10', 'block11'],

feat_shapes=[(38, 38), (19, 19), (10, 10), (5, 5), (3, 3), (1, 1)],

anchor_size_bounds=[0.15, 0.90],

# anchor_size_bounds=[0.20, 0.90], b. train_ssd_network.py,修改类别120行,GPU占用量,学习率,batch_size等

tf.app.flags.DEFINE_integer(

'num_classes', 21, 'Number of classes to use in the dataset.')

#根据自己的数据修改为类别+1 c. eval_ssd_network.py 修改类别,66行

# =========================================================================== #

# Main evaluation flags.

# =========================================================================== #

tf.app.flags.DEFINE_integer(

'num_classes', 21, 'Number of classes to use in the dataset.')

#根据自己的数据修改为类别+1 d. datasets/pascalvoc_2007.py 根据自己的训练数据修改整个文件

TRAIN_STATISTICS = {

'none': (0, 0),

'aeroplane': (238, 306), #238图片书, 306目标总数

'bicycle': (243, 353),

'bird': (330, 486),

'boat': (181, 290),

'bottle': (244, 505),

'bus': (186, 229),

'car': (713, 1250),

'cat': (337, 376),

'chair': (445, 798),

'cow': (141, 259),

'diningtable': (200, 215),

'dog': (421, 510),

'horse': (287, 362),

'motorbike': (245, 339),

'person': (2008, 4690),

'pottedplant': (245, 514),

'sheep': (96, 257),

'sofa': (229, 248),

'train': (261, 297),

'tvmonitor': (256, 324),

'total': (5011, 12608), //5011 为训练的图片书,12608为目标总数

}

TEST_STATISTICS = {

'none': (0, 0),

'aeroplane': (1, 1),

'bicycle': (1, 1),

'bird': (1, 1),

'boat': (1, 1),

'bottle': (1, 1),

'bus': (1, 1),

'car': (1, 1),

'cat': (1, 1),

'chair': (1, 1),

'cow': (1, 1),

'diningtable': (1, 1),

'dog': (1, 1),

'horse': (1, 1),

'motorbike': (1, 1),

'person': (1, 1),

'pottedplant': (1, 1),

'sheep': (1, 1),

'sofa': (1, 1),

'train': (1, 1),

'tvmonitor': (1, 1),

'total': (20, 20),

}

SPLITS_TO_SIZES = {

'train': 5011, #训练数据量

'test': 4952, #测试数据量

}

SPLITS_TO_STATISTICS = {

'train': TRAIN_STATISTICS,

'test': TEST_STATISTICS,

}

NUM_CLASSES = 20 #类别,根据自己数据的实际类别修改(不包含背景) 方案1 从vgg开始训练其中某些层的参数:

ssd_300_vgg中的300是指把图片归一化为300*300,所以如果要用ssd_512_vgg来fineturn的话,就只需要重新训练受图片分辨率影响的层即可。

# 通过加载预训练好的vgg16模型,对“voc07trainval+voc2012”进行训练

# 通过checkpoint_exclude_scopes指定哪些层的参数不需要从vgg16模型里面加载进来

# 通过trainable_scopes指定哪些层的参数是需要训练的,未指定的参数保持不变,若注释掉此命令,所有的参数均需要训练

DATASET_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/dataset/VOC0712/

TRAIN_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/voc0712_model/

CHECKPOINT_PATH=../checkpoints/vgg_16.ckpt

python ../train_ssd_network.py \

--train_dir=${TRAIN_DIR} \ #训练生成模型的存放路径

--dataset_dir=${DATASET_DIR} \ #数据存放路径

--dataset_name=pascalvoc_2007 \ #数据名的前缀

--dataset_split_name=train \

--model_name=ssd_300_vgg \ #加载的模型的名字

--checkpoint_path=${CHECKPOINT_PATH} \ #所加载模型的路径

--checkpoint_model_scope=vgg_16 \ #所加载模型里面的作用域名

--checkpoint_exclude_scopes=ssd_300_vgg/conv6,ssd_300_vgg/conv7,ssd_300_vgg/block8,ssd_300_vgg/block9,ssd_300_vgg/block10,ssd_300_vgg/block11,ssd_300_vgg/block4_box,ssd_300_vgg/block7_box,ssd_300_vgg/block8_box,ssd_300_vgg/block9_box,ssd_300_vgg/block10_box,ssd_300_vgg/block11_box \

--trainable_scopes=ssd_300_vgg/conv6,ssd_300_vgg/conv7,ssd_300_vgg/block8,ssd_300_vgg/block9,ssd_300_vgg/block10,ssd_300_vgg/block11,ssd_300_vgg/block4_box,ssd_300_vgg/block7_box,ssd_300_vgg/block8_box,ssd_300_vgg/block9_box,ssd_300_vgg/block10_box,ssd_300_vgg/block11_box \

--save_summaries_secs=60 \ #每60s保存一下日志

--save_interval_secs=600 \ #每600s保存一下模型

--weight_decay=0.0005 \ #正则化的权值衰减的系数

--optimizer=adam \ #选取的最优化函数

--learning_rate=0.001 \ #学习率

--learning_rate_decay_factor=0.94 \ #学习率的衰减因子

--batch_size=24 \

--gpu_memory_fraction=0.9 #指定占用gpu内存的百分比 方案2 : 从自己预训练好的模型开始训练(依然可以指定要训练哪些层)

(当你的模型通过vgg训练的模型收敛到大概o.5mAP的时候,可以进行这一步的fine-tune)

# 通过加载预训练好的vgg16模型,对“voc07trainval+voc2012”进行训练

# 通过checkpoint_exclude_scopes指定哪些层的参数不需要从vgg16模型里面加载进来

# 通过trainable_scopes指定哪些层的参数是需要训练的,未指定的参数保持不变

DATASET_DIR=/home/doctorimage/kindlehe/common/dataset/VOC0712/

TRAIN_DIR=.././log_files/log_finetune/train_voc0712_20170816_1654_VGG16/

CHECKPOINT_PATH=./log_files/log_finetune/train_voc0712_20170712_1741_VGG16/model.ckpt-253287

python3 ../train_ssd_network.py \

--train_dir=${TRAIN_DIR} \ #训练生成模型的存放路径

--dataset_dir=${DATASET_DIR} \ #数据存放路径

--dataset_name=pascalvoc_2007 \ #数据名的前缀

--dataset_split_name=train \

--model_name=ssd_300_vgg \ #加载的模型的名字

--checkpoint_path=${CHECKPOINT_PATH} \ #所加载模型的路径

--checkpoint_model_scope=vgg_16 \ #所加载模型里面的作用域名

--checkpoint_exclude_scopes=ssd_300_vgg/conv6,ssd_300_vgg/conv7,ssd_300_vgg/block8,ssd_300_vgg/block9,ssd_300_vgg/block10,ssd_300_vgg/block11,ssd_300_vgg/block4_box,ssd_300_vgg/block7_box,ssd_300_vgg/block8_box,ssd_300_vgg/block9_box,ssd_300_vgg/block10_box,ssd_300_vgg/block11_box \

--trainable_scopes=ssd_300_vgg/conv6,ssd_300_vgg/conv7,ssd_300_vgg/block8,ssd_300_vgg/block9,ssd_300_vgg/block10,ssd_300_vgg/block11,ssd_300_vgg/block4_box,ssd_300_vgg/block7_box,ssd_300_vgg/block8_box,ssd_300_vgg/block9_box,ssd_300_vgg/block10_box,ssd_300_vgg/block11_box \

--save_summaries_secs=60 \ #每60s保存一下日志

--save_interval_secs=600 \ #每600s保存一下模型

--weight_decay=0.0005 \ #正则化的权值衰减的系数

--optimizer=adam \ #选取的最优化函数

--learning_rate=0.001 \ #学习率

--learning_rate_decay_factor=0.94 \ #学习率的衰减因子

--batch_size=24 \

--gpu_memory_fraction=0.9 #指定占用gpu内存的百分比 从自己训练的ssd_300_vgg模型开始训练ssd_512_vgg的模型

因此ssd_300_vgg中没有block12,又因为block7,block8,block9,block10,block11,中的参数张量两个网络模型中不匹配,因此ssd_512_vgg中这几个模块的参数不从ssd_300_vgg模型中继承,因此使用checkpoint_exclude_scopes命令指出。

因为所有的参数均需要训练,因此不使用命令--trainable_scopes

1 #/bin/bash

2 DATASET_DIR=/home/data/xxx/imagedata/xing_tf/train_tf/

3 TRAIN_DIR=/home/data/xxx/model/xing300512_model/

4 CHECKPOINT_PATH=/home/data/xxx/model/xing300_model/model.ckpt-60000 #加载的ssd_300_vgg模型

5 python3 ./train_ssd_network.py \

6 --train_dir=${TRAIN_DIR} \

7 --dataset_dir=${DATASET_DIR} \

8 --dataset_name=pascalvoc_2007 \

9 --dataset_split_name=train \

10 --model_name=ssd_512_vgg \

11 --checkpoint_path=${CHECKPOINT_PATH} \

12 --checkpoint_model_scope=ssd_300_vgg \

13 --checkpoint_exclude_scopes=ssd_512_vgg/block7,ssd_512_vgg/block7_box,ssd_512_vgg/block8,ssd_512_vgg/block8_box, ssd_512_vgg/block9,ssd_512_vgg/block9_box,ssd_512_vgg/block10,ssd_512_vgg/block10_box,ssd_512_vgg/block11,ssd_512_vgg/b lock11_box,ssd_512_vgg/block12,ssd_512_vgg/block12_box \

14 #--trainable_scopes=ssd_300_vgg/conv6,ssd_300_vgg/conv7,ssd_300_vgg/block8,ssd_300_vgg/block9,ssd_300_vgg/block1 0,ssd_300_vgg/block11,ssd_300_vgg/block4_box,ssd_300_vgg/block7_box,ssd_300_vgg/block8_box,ssd_300_vgg/block9_box,ssd_3 00_vgg/block10_box,ssd_300_vgg/block11_box \

15 --save_summaries_secs=28800 \

16 --save_interval_secs=28800 \

17 --weight_decay=0.0005 \

18 --optimizer=adam \

19 --learning_rate_decay_factor=0.94 \

20 --batch_size=16 \

21 --num_classes=4 \

22 -gpu_memory_fraction=0.8 \

23 方案3:从头开始训练自己的模型

# 注释掉CHECKPOINT_PATH,不提供初始化模型,让模型自己随机初始化权重,从头训练

# 删除checkpoint_exclude_scopes和trainable_scopes,因为是从头开始训练

#/bin/bash

2 DATASET_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/imagedata/VOCtrainval_06-Nov-2007/tfrecords/

3 TRAIN_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/VOC2007_model/

4 #CHECKPOINT_PATH=/home/data/liuyan/model/xingshizheng512_model/model.ckpt-60000

5 CUDA_VISIBLE_DEVICES=0 python ./train_ssd_network.py \

6 --train_dir=${TRAIN_DIR} \

7 --dataset_dir=${DATASET_DIR} \

8 --dataset_name=pascalvoc_2007 \

9 --dataset_split_name=train \

10 --model_name=ssd_300_vgg \

11 #--checkpoint_path=${CHECKPOINT_PATH} \

12 #--checkpoint_model_scope=ssd_512_vgg \

13 #--checkpoint_exclude_scopes=ssd_300_vgg/block10,ssd_300_vgg/block10_box,ssd_300_vgg/block11,ssd_300_vgg/block11_bo x \

14 #--checkpoint_exclude_scopes=ssd_512_vgg/conv6,ssd_512_vgg/conv7,ssd_512_vgg/block8,ssd_512_vgg/block9,ssd_512_vgg/ block10,ssd_512_vgg/block11,ssd_512_vgg/block4_box,ssd_512_vgg/block7_box,ssd_512_vgg/block8_box,ssd_512_vgg/block9_box,ss d_512_vgg/block10_box,ssd_512_vgg/block11_box \

15 #--trainable_scopes=ssd_300_vgg/conv6,ssd_300_vgg/conv7,ssd_300_vgg/block8,ssd_300_vgg/block9,ssd_300_vgg/block10,s sd_300_vgg/block11,ssd_300_vgg/block4_box,ssd_300_vgg/block7_box,ssd_300_vgg/block8_box,ssd_300_vgg/block9_box,ssd_300_vgg /block10_box,ssd_300_vgg/block11_box \

16 --save_summaries_secs=600 \

17 --save_interval_secs=600 \

18 --optimizer=adam \

19 --learning_rate_decay_factor=0.94 \

20 --batch_size=32 \

21 --num_classes=20 \8. 测试或验证

首先将测试数据转换为tfrecords

1 #!/bin/bash

2 #this is a shell script to convert pascal VOC datasets into tf-records only

3 #directory where the original dataset is stored

4 DATASET_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/imagedata/VOCtest_06-Nov-2007/VOCdevkit/VOC2007/

5 #OUTPUT directory where to store TFRecords files

6 OUTPUT_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/imagedata/VOCtest_06-Nov-2007/tfrecords

7 python ./tf_convert_data.py \

8 --dataset_name=pascalvoc \

9 --dataset_dir=${DATASET_DIR} \

10 --output_name=voc_2007_test \

11 --output_dir=${OUTPUT_DIR}在SSD-Tensorflow-master文件夹下建立一个sh文件

1 DATASET_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/imagedata/VOCtest_06-Nov-2007/tfrecords/

2 EVAL_DIR=/home/data/liangxiaoyun/SSD-Tensorflow-master/ssd_eval_log/

3 CHECKPOINT_PATH=/home/data/liangxiaoyun/SSD-Tensorflow-master/VOC2007_model/model.ckpt-5000

4 python ./eval_ssd_network.py \

5 --eval_dir=${EVAL_DIR} \

6 --dataset_dir=${DATASET_DIR} \

7 --dataset_name=pascalvoc_2007 \

8 --dataset_split_name=test \

9 --model_name=ssd_300_vgg \

10 --checkpoint_path=${CHECKPOINT_PATH} \

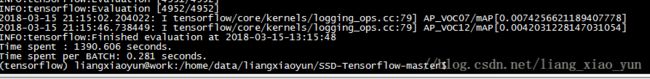

11 --batch_size=1 \测试结果如下:MAP值太低,至少得0.5才能准确检测。增加迭代次数。

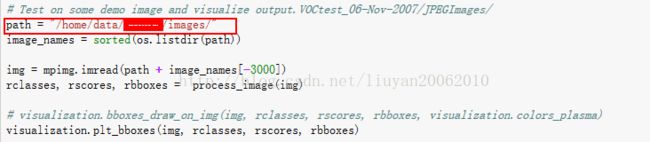

9. 利用在notebooks下的ssd_notebook.ipy来查看模型标注的图片。ssd_notebook.ipynb显示训练测试模型的结果

修改红框标注的位置,一个是修改为自己的模型所在的路径,另一个是修改为自己图片所在的路径

10. 注意

- –dataset_name=pascalvoc_2007 、–dataset_split_name=train、–model_name=ssd_300_vgg这三个参数不要自己随便取,在代码里,这三个参数是if…else…语句,有固定的判断值,所以要根据实际情况取选择

- TypeError: expected bytes, NoneType found

SystemError: returned a result with an error set

这是由于CHECKPOINT_PATH定义的时候不小心多了个#号键,将输入给注释掉了,如果不想使用预训练的模型,需要将

--checkpoint_path=${CHECKPOINT_PATH} \注释掉即可 - SSD有在VOC07+12的训练集上一起训练的,用一个笨一点的办法:

pascalvoc_to_tfrecords.py文件中,改变SAMPLES_PER_FILES,减少输出tfrecord文件的个数,再修改tf_convert_data.py的dataset参数,记得将前后两次的输出名改变一下,前后两次转换的tfrecords放在同一个文件夹下,然后手工重命名。(这里由于只是验证论文的训练方法是否有效,所以没必要写这些自动化代码实现合并,以后要用自己的数据集训练的时候就可以写一些自动化脚本)

- 有时候运行脚本会报错,可能是之前依次运行导致显存占满。

- 从pyCharm运行时,如果模型保存路径里之前的模型未删除,将会报错,必须保证该文件夹为空。

- 在TRAIN_DIR路径下会产生四中文件:

1. checkpoint :文本文件,包含所有model.ckpt-xxxx,相当于是不同时间节点生成的所有ckpt文件的一个索引。

2. model.ckpt-2124.data-000000-of-000001:模型文件,保存模型的权重

3. model.ckpt-2124.meta: 图文件,保存模型的网络图

4. model.ckpt-2124.index : 这个没搞太清楚

5. graph.pbtxt: 用protobuf格式保存的模型的图