图像分类基本流程及 KNN 分类器

本文主要内容为 CS231n 课程的学习笔记,主要参考 学习视频 和对应的 课程笔记翻译 ,感谢各位前辈对于深度学习的辛苦付出。在这里我主要记录下自己觉得重要的内容以及一些相关的想法,希望能与大家多多交流~

1. 图像分类以及基本流程

1.1 什么是图像分类

所谓图像分类问题,就是已有固定的分类标签集合,然后对于输入的图像,从分类标签集合中找出一个分类标签,最后把分类标签分配给该输入图像。虽然看起来挺简单的,但这可是计算机视觉领域的核心问题之一,计算机视觉领域中很多看似不同的问题(比如物体检测和分割),都可以被归结为图像分类问题。

1.2 图像分类的挑战

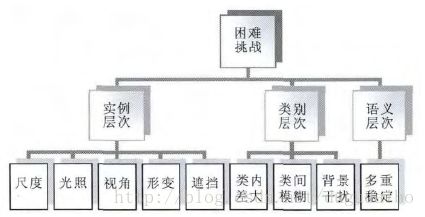

物体分类与检测的难点与挑战在本文中分为3个层次:实例层次、类别 层次和语义层次,如图 1 所示 [1]

图 1 .物体分类与检测研究存在的困难与挑战

(1) 实例层次。针对单个物体实例而言,通常于图像采集过程中、光照条件、拍摄视角、距离的不同而造成的尺寸变化、物体自身的非刚体形变以及其他物体的部分遮挡,使得物体实例的表观特征产生很大的变化,给视觉识别算法带来了极大的困难

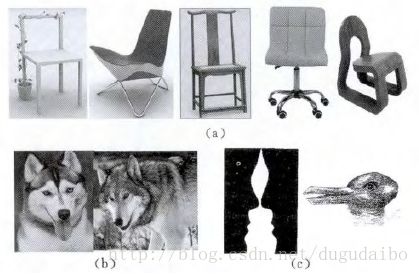

(2) 类别层次。困难与挑战通常来自3个方面,首先是类内差大,也即属于同一类的物体表观特征差别比较大,其原因有前面提到的各种实例层次的变化,但这里更强调的是类内不同实例的差别,例如图2 (a) 所示,同样是椅子,外观却是千差万别,而从语义上来讲,具有“坐”的功能的器具都可以称为椅子;其次是类间模糊性,即不同类的物体实例具有一定的相似性,如图2 (b)所示,左边的是一只狼,右边的是一只哈士奇,但我们从外观上却很难分开二者;再次是背景的干扰,在实际场景下,物体不可能出现在一个非常干净的背景下,往往相反,背景可能是非常复杂的、对我们感兴趣的物体存在干扰的,这使得识别问题的难度大大增加。

(3) 语义层次。困难和挑战与图像的视觉语义相关,这个层次的困难往往非常难处理,特别是对现在的计算机视觉理论水平而言,一个典型的问题称为多重稳定性。如图3所示,图3(c) 左边既可以看成是两个面对面的人,也可以看成是一个燃烧的蜡烛;右边则同时可以解释为兔子或者小鸭。同样的图像,不同的解释,这既与人的观察视角、关注点等物理条件有关,也与人的性格、经历等有关,而这恰恰是视觉识别系统难以处理的部分。

图 2 .分类与检测存在挑战的例子

1.3 图像分类的基本流程

在机器学习中常常采用基于数据驱动的方法进行图像分类。所谓基于数据驱动的方法,就是给计算机很多数据,然后实现学习算法,让计算机学习到每个类的外形的方法。基于这种方法的完整流程如下

(1) 输入:输入是包含 N 个图像的集合,每个图像的标签是 K 种分类标签中的一种。这个集合称为训练集。

(2) 学习:这一步的任务是使用训练集来学习每个类到底长什么样。一般该步骤叫做训练分类器或者学习一个模型。

(3) 评价:让分类器来预测它未曾见过的图像的分类标签,并以此来评价分类器的质量。我们会把分类器预测的标签和图像真正的分类标签对比。毫无疑问,分类器预测的分类标签和图像真正的分类标签如果一致,那就是好事,这样的情况越多越好。

2. K - Nearest Neighbor分类器

2.1 Nearest Neighbor分类器

它的原理是拿着测试图片和训练集中每一张图片去比较,然后将它认为最相似的那个训练集图片的标签赋给这张测试图片。在 CIFAR10 中,就是比较 32x32x3 的像素块。最简单的方法就是逐个像素比较,最后将差异值全部加起来。换句话说,就是将两张图片先转化为两个向量 和 ,然后计算他们的 L1 距离:

作为 评价标准,我们常常使用准确率.。同样也有很多的其他评价标准,我们将在日后的学习笔记中逐渐 补充。

距离选择:计算向量间的距离有很多种方法,另一个常用的方法是 L2 距离,从几何学的角度,可以理解为它在计算两个向量间的欧式距离。L2 距离的公式如下:

换句话说,我们依旧是在计算像素间的差值,只是先求其平方,然后把这些平方全部加起来,最后对这个和开方。注意这里使用了开平方,但是在实际中可能不用。因为求平方根函数是一个单调函数,它对不同距离的绝对值求平方根虽然改变了数值大小,但依然保持了不同距离大小的顺序。所以用不用它,都能够对像素差异的大小进行正确比较。

L1 和 L2 比较。比较这两个度量方式是挺有意思的。在面对两个向量之间的差异时,L2 比 L1 更加不能容忍这些差异。也就是说,相对于1个巨大的差异,L2 距离更倾向于接受多个中等程度的差异。L1 和 L2 都是在 p-norm 常用的特殊形式。更多的衡量距离的标准将在之后的笔记中进行讨论。

2.2 K-Nearest Neighbor分类器

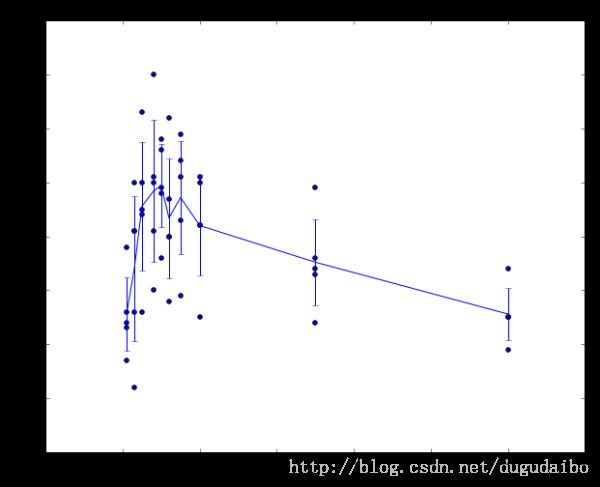

它的思想很简单:与其只找最相近的那 1 个图片的标签,我们找最相似的 k 个图片的标签,然后让他们针对测试图片进行投票,最后把票数最高的标签作为对测试图片的预测。所以当 k=1 的时候,kNearest Neighbor 分类器就是 Nearest Neighbor 分类器。从图 3 直观感受上就可以看到,更高的 k 值可以让分类的效果更平滑,使得分类器对于异常值更有抵抗力。

图 3 .NN与KNN的对比结果

需要注意的是,在 NN 分类器中,异常的数据点(比如:在蓝色区域中的绿点)制造出一个不正确预测的孤岛。5NN 分类器将这些不规则都平滑了,使得它针对测试数据的泛化(generalization)能力更好(例子中未展示)。注意,5NN 中也存在一些灰色区域,这些区域是因为近邻标签的最高票数相同导致的(比如:2个邻居是红色,2 个邻居是蓝色,还有 1 个是绿色)。

3. 模型的超参数选择(以K-NN为例)

在模型的实际使用过程中,K-NN分类器中的 K 选取多少较为合适,计算距离使用 L1 范数还是 L2 范数都是需要我们进行选择的,并且称这些参数为超参数。 在超参数调优的过程中决不能使用测试集来进行调优,因为这样会使模型对测试集过拟合,降低模型的泛化能力。所以测试数据集只使用一次,即在训练完成后评价最终的模型时使用。

把训练集按照50%-90%的比例分成训练集和验证集,使用训练集训练模型,使用验证集调节超参数。如在 K-NN 中选择超参数 k ,取不同的 k 值用训练集进行训练,之后用检验集进行检验,作图分析出哪个 k 值表现最好,然后用这个 k 值来跑真正的测试集,并作出对算法的评价。

交叉验证。有时候,训练集数量较小(因此验证集的数量更小),人们会使用一种被称为交叉验证的方法,这种方法更加复杂些。还是用刚才的例子,如果是交叉验证集,我们就不是取 1000 个图像,而是将训练集平均分成 5 份,其中 4 份用来训练,1 份用来验证。然后我们循环着取其中 4 份来训练,其中 1 份来验证,最后取所有 5 次验证结果的平均值作为算法验证结果。

图 4 .不同的 K 值对应的KNN分类器结果

如图 4 是份交叉验证对 k 值调优的例子。针对每个 k 值,得到 5 个准确率结果,取其平均值,然后对

不同 k 值的平均表现画线连接。本例中,当 k=7 的时算法表现最好(对应图中的准确率峰值)。如果我们将训练集分成更多份数,直线一般会更加平滑(噪音更少)。

实际应用。在实际情况下,人们不是很喜欢用交叉验证,主要是因为它会耗费较多的计算资源。一般直接把训练集按照50%-90%的比例分成训练集和验证集。但这也是根据具体情况来定的:如果超参数数量多,你可能就想用更大的验证集,而验证集的数量不够,那么最好还是用交叉验证吧。至于分成几份比较好,一般都是分成3、5和10份。

4. Nearest Neighbor分类器的优劣

4.1 NN的优点

首先,Nearest Neighbor分类器易于理解,实现简单。

其次,算法的训练不需要花时间,因为其训练过程只是将训练集数据存储起来。

4.2 NN的缺点

首先,因为每个测试图像需要和所有存储的训练图像进行比较,所以占用大量存储空间,耗费大量计算资源,测试要花费大量时间计算。因为在实际应用中,我们关注测试效率远远高于训练效率。其实,我们后续要学习的卷积神经网络在这个权衡上走到了另一个极端:虽然训练花费很多时间,但是一旦训练完成,对新的测试数据进行分类非常快。这样的模式就符合实际使用需求。

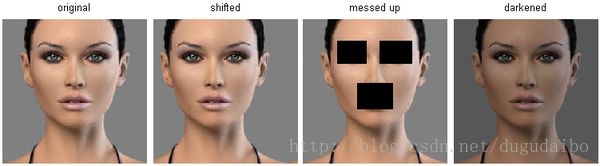

其次,在实际的图像分类工作中,很少使用 NN。因为图像都是高维度数据(他们通常包含很多像素),而高维度向量之间的距离通常是反直觉的。下面的图片展示了基于像素的相似和基于感官的相似是有很大不同的:

图 5 .L2值相同的不同图片

在高维度数据上,基于像素的的距离和感官上的非常不同。上图中,右边 3 张图片和左边第 1 张原始图片的L2距离是一样的。很显然,基于像素比较的相似和感官上以及语义上的相似是不同的。

这里还有个视觉化证据,可以证明使用像素差异来比较图像是不够的。z这是一个叫做t-SNE的可视化技术,它将CIFAR-10中的图片按照二维方式排布,这样能很好展示图片之间的像素差异值。在这张图片中,排列相邻的图片L2距离就小。

图 6 .将图片进行降维显示

上图使用t-SNE的可视化技术将CIFAR-10的图片进行了二维排列。排列相近的图片L2距离小。可以看出,图片的排列是被背景主导而不是图片语义内容本身主导。具体说来,这些图片的排布更像是一种颜色分布函数,或者说是基于背景的,而不是图片的语义主体。比如,狗的图片可能和青蛙的图片非常接近,这是因为两张图片都是白色背景。从理想效果上来说,我们肯定是希望同类的图片能够聚集在一起,而不被背景或其他不相关因素干扰。为了达到这个目的,我们不能止步于原始像素比较,得继续前进。

参考文献

[1]杨金鑫,杨辉华,李灵巧,潘细朋,刘振丙,周洁茜.结合卷积神经网络和超像素聚类的细胞图像分割方法[J/OL].计算机应用研究,2018,(05):1-2(2017-06-14).http://kns.cnki.net/kcms/detail/51.1196.TP.20170614.1318.098.html.