- tensorflow学习笔记(二):机器学习必备API

我愛大泡泡

深度学习机器学习深度学习

前一节介绍了一些最基本的概念和使用方法。因为我个人的最终目的还是在深度学习上,所以一些深度学习和机器学习模块是必须要了解的,这其中包括了tf.train、tf.contrib.learn、还有如训练神经网络必备的tf.nn等API。这里准备把常用的API和使用方法按照使用频次进行一个排列,可以当做一个以后使用参考。这一节介绍的内容可以有选择的看。而且最全的信息都在TensorFlow的API里面了

- TensorFlow学习笔记

SIENTIST

使用“图”(graph)表示计算任务;在被称为“会话”(session)的“上下文”(context)中执行图;使用“张量”(tensor)表示数据,tensor可以任务是一个n维的数组或列表;通过“变量”(varible)维护状态;使用feed和fetch可以为任意的操作赋值或从中获取数据tensorflow.jpggraph中的节点称为op(operation),每个op能把输入的tensor

- tensorflow学习笔记-图像分类模型-AlexNet实现

飞天小小猫

之前一篇文章中总结了CNN中图像分类的经典模型,包括论文解读和分析,但是不写个代码搞一把总觉得虚~啊哈哈这个系列里准备把这些个经典模型用tensorflow实现一下。参考之前引用的blog:深度学习AlexNet模型详细分析上代码吧。参照着模型看更好读一些。'''图像分类模型的tensorflow实现之--AlexNetTensorflowVersion:1.4PythonVersion:3.6R

- Tensorflow学习笔记(六)——卷积神经网络

七月七叶

实现对fashion-minist分类: (1)引包importosos.environ["CUDA_VISIBLE_DEVICES"]="-1"importmatplotlibasmplimportmatplotlib.pyplotasplt%matplotlibinlineimportnumpyasnpimportpandasaspdimportsklearnimportsysimpor

- tensorflow vgg基于cifar-10进行训练

GOGOYAO

最近接触tf,想在cifar-10数据集上训练下vgg网络。最开始想先跑vgg16,搜了一大圈,没有一个可以直接跑的(我参考【深度学习系列】用PaddlePaddle和Tensorflow实现经典CNN网络Vgg跑出来的精度就10%),要么是代码是针对1000种分类的,要么是预训练好的。最后在Tensorflow学习笔记:CNN篇(6)——CIFAR-10数据集VGG19实现找到了一个vgg19的

- 深度学习与Tensorflow学习笔记2 ——回调函数callbacks和Tensorboard

木头里有虫911

上一期我们从Fashion-mnist数据集开始,使用Tensorflow.keras搭建一个简单的神经网络来处理分类问题。通过这个简单例子我们熟悉了tf.keras的调用。本期我们来学习keras下面的回调函数callbacks的用法。这里,简单的再说一句,Tensorflow有非常完善的官方文档,相当于学习手册。(而且还有中文网站:https://tensorflow.google.cn/)在

- TensorFlow学习笔记--(4)神经网络模型-数据集预处理

Postlude

TensorFlowtensorflow学习笔记

神经网络初步以scikit-leran鸢尾花为例通过scikit-learn库自带的鸢尾花数据集来测试数据的读入fromsklearnimportdatasetsfrompandasimportDataFrameimportpandasaspdx_data=datasets.load_iris().data#.data返回iris数据集所有输入特征y_data=datasets.load_iris

- tensorflow学习笔记:识别图中模糊的手写体数字(2)基于多层神经网络以及TensorBoard可视化网络

heart_ace

tensorflow学习笔记tensorflow神经网络可视化python深度学习

tensorflow学习笔记:识别图中模糊的手写体数字(2)基于多层神经网络以及TensorBoard可视化运行环境tensorflow-gpu1.11.0python3.6.9importtensorflowastfimportos读取MINIST数据集fromtensorflow.examples.tutorials.mnistimportinput_datamnist=input_data.

- tensorflow学习笔记(十):GAN生成手写体数字(MNIST)

陈小虾

深度学习框架实战GAN手写体生成GAN实战

文章目录一、GAN原理二、项目实战2.1项目背景2.2网络描述2.3项目实战一、GAN原理生成对抗网络简称GAN,是由两个网络组成的,一个生成器网络和一个判别器网络。这两个网络可以是神经网络(从卷积神经网络、循环神经网络到自编码器)。生成器从给定噪声中(一般是指均匀分布或者正态分布)产生合成数据,判别器分辨生成器的的输出和真实数据。前者试图产生更接近真实的数据,相应地,后者试图更完美地分辨真实数据

- tensorflow学习笔记3

抬头挺胸才算活着

CreateaTensorFlowobjectthatreturnsx+yifx>y,andx-yotherwise.tf.cond相当于其他编程语言的?,比较要用tf.greatertf.cond(tf.greater(x,y),lambda:tf.add(x,y),lambda:tf.subtract(x,y))tf.case第一个参数是字典或者tuples都可以,只要是一对对,然后每一对第一

- 8月10日TensorFlow学习笔记——TensorFlow 数据类型、创建、索引与切片、维度变换、前向传播

Ashen_0nee

tensorflow学习python

文章目录前言一、Numpy回归问题实战1、Step1:computeloss2、Step2:computeGradientandupdate二、手写数字识别1、Step1:XandY2、Step2:networkstructure3、Step3:循环计算Loss、梯度并更新参数三、数据类型1、tf.constant()2、TensorProperty(1)、.device(2)、.numpy()(

- TensorFlow学习笔记--(3)张量的常用运算函数

Postlude

TensorFlowtensorflow学习笔记

损失函数及求偏导通过tf.GradientTape函数来指定损失函数的变量以及表达式最后通过gradient(%损失函数%,%偏导对象%)来获取求偏导的结果独热编码给出一组特征值来对图像进行分类可以用独热编码0的概率是第0种1的概率是第1种0的概率是第二种tf.one_hot(%某标签值%,%分类数%)这里还没太看懂结果的3X3矩阵是怎么来的如果单纯的是因为有几种类型就有几个1那传入的标签值参数就

- tensorflow学习笔记--张量和基本运算

Yohance0_0

tensorflow框架学习深度学习

张量张量的阶和数据类型(1)张量的属性:graph:张量所属的默认图op:张量的操作名name:张量的字符串描述shape:张量形状一维{5}二维{2,3}三维{2,3,4}importtensorflowastfimportosos.environ['TF_CPP_MIN_LOG_LEVEL']='2'a=tf.constant(5.0)graph=tf.get_default_graph()p

- tensorflow学习笔记----2.常用函数1

qq_35821503

tensorflow深度学习

1.强制tensor转换为该数据类型tf.cast(张量名,dtype=数据类型)x1=tf.constant([1,2,3],dtype=tf.float64)print(x1)x2=tf.cast(x1,dtype=tf.int32)print("x2=",x2)运行结果:2.计算张量维度上元素的最小值tf.reduce_min(张量名)print("min=",tf.reduce_min(x

- TensorFlow学习笔记----3.常用函数2

qq_35821503

tensorflow深度学习

一.Gradienttape我们可以在with结构中,使用Gradienttape实现某个函数对指定参数的求导运算配合上一个文件讲的variable函数可以实现损失函数loss对参数w的求导计算with结构记录计算过程,gradient求出张量的梯度withtf.GradientTape()astape:若干个计算过程grad=tape.gradient(函数,对谁求导)withtf.Gradie

- TensorFlow学习笔记--MLP多层感知机识别手写数字1-9

北航_Curry

TensorFlow2.0tensorflow神经网络深度学习1024程序员节

#简单粗暴tensorflow2.0合集视频p7-p9多层感知机(MLP)利用多层感知机MLP实现手写数字0-9的mnist数据集的识别importtensorflowastfimportnumpyasnp#数据的获取和预处理classMNISTLoader():def__init__(self):mnist=tf.keras.datasets.mnist(self.train_data,self

- Tensorflow学习笔记--张量与会话

IT修炼家

tensorflow

张量张量是Tensorflow的核心组件之一,可以理解为Tensorflow就是张量和流组成的,张量可以简单地理解为多维数组,我的理解就是张量是一个数据模板,深度学习所有数据首先转换为张量的格式再进行计算,然后得到学习结果。横向看张量是整形、浮点型的数,另外注意张量计算中,有些计算需要张量数据的类型相同,否则会报错。纵向看张量是不同维度的“数组”,零阶张量是一个数,是计算的最小单元;二阶张量是向量

- tensorflow学习笔记--Variable变量

爱吃小白兔的大萝卜

tensorflow学习python

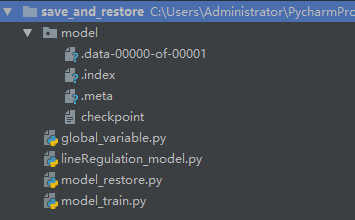

tf.Variable()变量:创建、初始化、保存、加载。1.创建Variable()构造函数需要变量的初始值,即任何形状和类型的张量Tensor。初始值定义其形状和类型,一旦构建,变量的类型和形状即确定。如果想要稍后改变变量的形状,需要带上validate_shape=False的赋值操作。#创建一个变量w=tf.Variable(tensor,name=)#运算y=tf.matmul(w,其他

- tensorflow学习笔记:张量介绍以及张量操作函数

heart_ace

tensorflow学习笔记深度学习tensorflow张量

张量(tensor)tensorflow程序使用tensor数据结构来代表所有的数据,计算图中,操作间传递的数据都是tensor。tensor堪为一个n维的数组或列表,每个tensor中包含类型(type)、阶(rank)和形状(shape)。tensor类型tensor类型python类型描述DF_FLOATtf.float3232位浮点数DF_DOUBLEtf.float6461为浮点数DF_

- [TensorFlow 学习笔记-03]TensorFlow简介

caicaiatnbu

TensorFlow学习笔记深度学习TensorFlow

[版权说明]TensorFlow学习笔记参考:李嘉璇著TensorFlow技术解析与实战黄文坚唐源著TensorFlow实战郑泽宇顾思宇著TensorFlow实战Google深度学习框架乐毅王斌著深度学习-Caffe之经典模型详解与实战TensorFlow中文社区http://www.tensorfly.cn/极客学院著TensorFlow官方文档中文版TensorFlow官方文档英文版以及各位大

- TensorFlow学习笔记--(2)张量的常用运算函数

Postlude

TensorFlowtensorflow学习笔记

张量的取值函数求张量的平均值:tf.reduce.mean(%张量名%)求张量的最小值:tf.reduce_min(%张量名%)求张量的最大值:tf.reduce_max(%张量名%)求张量的和:tf.reduce_sum(%张量名%)其次,对于上述所有操作都可在函数后添加一个新的参数axis=%维度%axis=0代表第一维度axis=1代表第二维度以此类推张量的四则运算加减乘除次方/开方特别注意

- Tensorflow学习笔记:1-tensorflow-gpu部署 & keras简单使用-2023-2-12

Merlin雷

python机器学习笔记tensorflowkeras

tensorflow-gpu学习笔记:部署&keras简单使用-2023-2-12tensorflow2.6.0GPU版本部署及测试0-查看NVIDIA驱动版本1-安装2-测试3-简单使用4-tf.keras概述1、(单层)线性回归1、导包&数据读取和观察2、预测目标与损失函数3、创建模型4、训练5、预测2、多层感知器3、逻辑回归1、sigmoid函数2、交叉熵损失函数3、模型预测4、画图看损失和

- TensorFlow学习笔记--(1)张量的随机生成

Postlude

TensorFlowtensorflow学习笔记

张量的生成如何判断一个张量的维数:看张量的中括号有几层012:零维数列[246]:一维向量[[123][456]]:二维数组两行三列第一行数据为123第二行数据为456以此类推n维张量有n层中括号tf.zeros(%指定一个张量的维数%)生成一个全0的张量tf.ones(%指定一个张量的维数%)生成一个全1的张量tf.fill(%指定一个张量的维数%,%Value%)生成一个全为Value的张量随

- Tensorflow学习笔记:Keras函数式API

凿井而饮

tensorflow2pythontensorflow深度学习

目录一、简介二、使用相同的层计算图定义多个模型三、模型可像层一样被调用四、处理复杂计算图拓扑1.多输入多输出模型2.建立一个小的ResNet五、共享层六、提取和重用层计算图节点七、使用自定义层扩展API八、何时使用函数式API1.函数式API的优势2.函数式API的劣势九、混合搭配的API式样1.将函数式模型用作子类化模型的一部分:2.在函数式API中使用任何子类化层或模型一、简介函数式API创建

- tensorflow学习笔记--机器学习基础知识--(1)基本图像分类

爱玩的阿是

学习笔记pythontensorflow机器学习深度学习

学习教材是tensorflow官网上的新手教程为了让自己有更深的印象和理解,将自己的学习笔记记录基础分类:对于衣服的图片分类本指南训练了一个神经网络模型来对衣服的图像进行分类,例如运动鞋和衬衫。本指南使用tf.keras在TensorFlow中构建和训练模型。from__future__importabsolute_import,division,print_function,unicode_li

- TensorFlow学习笔记(未完待续)

苏钟白

tensorflow学习笔记

文章目录tf.Graph().as_default()sessiontensorflow.placeholder()tf.summarytf.Graph().as_default()withtf.Graph().as_default():withtf.device('/gpu:'+str(GPU_INDEX)):TensorFlow中所有计算都会被转化为计算图上的节点。是一个通过计算图的形式来表述

- TensorFlow学习笔记(四)—— 入门 —— 基本使用

tiankong19999

TensorFlowTensorFlow入门

教程地址:TensorFlow中文社区基本使用使用TensorFlow,你必须明白TensorFlow:使用图(graph)来表示计算任务.在被称之为会话(Session)的上下文(context)中执行图.使用tensor表示数据.通过变量(Variable)维护状态.使用feed和fetch可以为任意的操作(arbitraryoperation)赋值或者从其中获取数据.综述TensorFlow

- TensorFlow学习笔记(四)——tf.data API

七月七叶

tf.data.Datasetcsv文件读取为dataset并用于训练tfrecord1.tf.data.Datasettf.data.Dataset使用流程:(1)以源数据创建一个dataset;(2)对数据进行预处理;(3)遍历整个dataset,进行数据处理1.1SourceDatasets(1)由数组、列表等创建,将其转化为tensor#创建一个datasetdataset=tf.data

- tensorflow学习笔记————分类MNIST数据集

san.hang

人工智能python

在使用tensorflow分类MNIST数据集中,最容易遇到的问题是下载MNIST样本的问题。一般是通过使用tensorflow内置的函数进行下载和加载,fromtensorflow.examples.tutorials.mnistimportinput_datamnist=input_data.read_data_sets("MNIST_data",one_hot=True)但是我使用时遇到了“

- tensorflow学习笔记:运算函数、复数操作函数、规约计算、 序列比较与索引提取以及错误类

heart_ace

tensorflow学习笔记运算函数tensorflow错误类规约计算函数索引提前

运算函数、复数操作函数、规约计算、序列比较与索引提取以及错误类前一章提到了许多关于张量的操作函数,这里接着将一些运算函数、复数操作函数、规约计算、序列比较与索引提取以及错误类记录下来。算数运算函数函数描述tf.asign(x,y,name=None)令x=ytf.add(x,y,name=None)求和tf.subtract(x,y,name=None)减法tf.multiply(x,y,name

- mondb入手

木zi_鸣

mongodb

windows 启动mongodb 编写bat文件,

mongod --dbpath D:\software\MongoDBDATA

mongod --help 查询各种配置

配置在mongob

打开批处理,即可启动,27017原生端口,shell操作监控端口 扩展28017,web端操作端口

启动配置文件配置,

数据更灵活

- 大型高并发高负载网站的系统架构

bijian1013

高并发负载均衡

扩展Web应用程序

一.概念

简单的来说,如果一个系统可扩展,那么你可以通过扩展来提供系统的性能。这代表着系统能够容纳更高的负载、更大的数据集,并且系统是可维护的。扩展和语言、某项具体的技术都是无关的。扩展可以分为两种:

1.

- DISPLAY变量和xhost(原创)

czmmiao

display

DISPLAY

在Linux/Unix类操作系统上, DISPLAY用来设置将图形显示到何处. 直接登陆图形界面或者登陆命令行界面后使用startx启动图形, DISPLAY环境变量将自动设置为:0:0, 此时可以打开终端, 输出图形程序的名称(比如xclock)来启动程序, 图形将显示在本地窗口上, 在终端上输入printenv查看当前环境变量, 输出结果中有如下内容:DISPLAY=:0.0

- 获取B/S客户端IP

周凡杨

java编程jspWeb浏览器

最近想写个B/S架构的聊天系统,因为以前做过C/S架构的QQ聊天系统,所以对于Socket通信编程只是一个巩固。对于C/S架构的聊天系统,由于存在客户端Java应用,所以直接在代码中获取客户端的IP,应用的方法为:

String ip = InetAddress.getLocalHost().getHostAddress();

然而对于WEB

- 浅谈类和对象

朱辉辉33

编程

类是对一类事物的总称,对象是描述一个物体的特征,类是对象的抽象。简单来说,类是抽象的,不占用内存,对象是具体的,

占用存储空间。

类是由属性和方法构成的,基本格式是public class 类名{

//定义属性

private/public 数据类型 属性名;

//定义方法

publ

- android activity与viewpager+fragment的生命周期问题

肆无忌惮_

viewpager

有一个Activity里面是ViewPager,ViewPager里面放了两个Fragment。

第一次进入这个Activity。开启了服务,并在onResume方法中绑定服务后,对Service进行了一定的初始化,其中调用了Fragment中的一个属性。

super.onResume();

bindService(intent, conn, BIND_AUTO_CREATE);

- base64Encode对图片进行编码

843977358

base64图片encoder

/**

* 对图片进行base64encoder编码

*

* @author mrZhang

* @param path

* @return

*/

public static String encodeImage(String path) {

BASE64Encoder encoder = null;

byte[] b = null;

I

- Request Header简介

aigo

servlet

当一个客户端(通常是浏览器)向Web服务器发送一个请求是,它要发送一个请求的命令行,一般是GET或POST命令,当发送POST命令时,它还必须向服务器发送一个叫“Content-Length”的请求头(Request Header) 用以指明请求数据的长度,除了Content-Length之外,它还可以向服务器发送其它一些Headers,如:

- HttpClient4.3 创建SSL协议的HttpClient对象

alleni123

httpclient爬虫ssl

public class HttpClientUtils

{

public static CloseableHttpClient createSSLClientDefault(CookieStore cookies){

SSLContext sslContext=null;

try

{

sslContext=new SSLContextBuilder().l

- java取反 -右移-左移-无符号右移的探讨

百合不是茶

位运算符 位移

取反:

在二进制中第一位,1表示符数,0表示正数

byte a = -1;

原码:10000001

反码:11111110

补码:11111111

//异或: 00000000

byte b = -2;

原码:10000010

反码:11111101

补码:11111110

//异或: 00000001

- java多线程join的作用与用法

bijian1013

java多线程

对于JAVA的join,JDK 是这样说的:join public final void join (long millis )throws InterruptedException Waits at most millis milliseconds for this thread to die. A timeout of 0 means t

- Java发送http请求(get 与post方法请求)

bijian1013

javaspring

PostRequest.java

package com.bijian.study;

import java.io.BufferedReader;

import java.io.DataOutputStream;

import java.io.IOException;

import java.io.InputStreamReader;

import java.net.HttpURL

- 【Struts2二】struts.xml中package下的action配置项默认值

bit1129

struts.xml

在第一部份,定义了struts.xml文件,如下所示:

<!DOCTYPE struts PUBLIC

"-//Apache Software Foundation//DTD Struts Configuration 2.3//EN"

"http://struts.apache.org/dtds/struts

- 【Kafka十三】Kafka Simple Consumer

bit1129

simple

代码中关于Host和Port是割裂开的,这会导致单机环境下的伪分布式Kafka集群环境下,这个例子没法运行。

实际情况是需要将host和port绑定到一起,

package kafka.examples.lowlevel;

import kafka.api.FetchRequest;

import kafka.api.FetchRequestBuilder;

impo

- nodejs学习api

ronin47

nodejs api

NodeJS基础 什么是NodeJS

JS是脚本语言,脚本语言都需要一个解析器才能运行。对于写在HTML页面里的JS,浏览器充当了解析器的角色。而对于需要独立运行的JS,NodeJS就是一个解析器。

每一种解析器都是一个运行环境,不但允许JS定义各种数据结构,进行各种计算,还允许JS使用运行环境提供的内置对象和方法做一些事情。例如运行在浏览器中的JS的用途是操作DOM,浏览器就提供了docum

- java-64.寻找第N个丑数

bylijinnan

java

public class UglyNumber {

/**

* 64.查找第N个丑数

具体思路可参考 [url] http://zhedahht.blog.163.com/blog/static/2541117420094245366965/[/url]

*

题目:我们把只包含因子

2、3和5的数称作丑数(Ugly Number)。例如6、8都是丑数,但14

- 二维数组(矩阵)对角线输出

bylijinnan

二维数组

/**

二维数组 对角线输出 两个方向

例如对于数组:

{ 1, 2, 3, 4 },

{ 5, 6, 7, 8 },

{ 9, 10, 11, 12 },

{ 13, 14, 15, 16 },

slash方向输出:

1

5 2

9 6 3

13 10 7 4

14 11 8

15 12

16

backslash输出:

4

3

- [JWFD开源工作流设计]工作流跳跃模式开发关键点(今日更新)

comsci

工作流

既然是做开源软件的,我们的宗旨就是给大家分享设计和代码,那么现在我就用很简单扼要的语言来透露这个跳跃模式的设计原理

大家如果用过JWFD的ARC-自动运行控制器,或者看过代码,应该知道在ARC算法模块中有一个函数叫做SAN(),这个函数就是ARC的核心控制器,要实现跳跃模式,在SAN函数中一定要对LN链表数据结构进行操作,首先写一段代码,把

- redis常见使用

cuityang

redis常见使用

redis 通常被认为是一个数据结构服务器,主要是因为其有着丰富的数据结构 strings、map、 list、sets、 sorted sets

引入jar包 jedis-2.1.0.jar (本文下方提供下载)

package redistest;

import redis.clients.jedis.Jedis;

public class Listtest

- 配置多个redis

dalan_123

redis

配置多个redis客户端

<?xml version="1.0" encoding="UTF-8"?><beans xmlns="http://www.springframework.org/schema/beans" xmlns:xsi=&quo

- attrib命令

dcj3sjt126com

attr

attrib指令用于修改文件的属性.文件的常见属性有:只读.存档.隐藏和系统.

只读属性是指文件只可以做读的操作.不能对文件进行写的操作.就是文件的写保护.

存档属性是用来标记文件改动的.即在上一次备份后文件有所改动.一些备份软件在备份的时候会只去备份带有存档属性的文件.

- Yii使用公共函数

dcj3sjt126com

yii

在网站项目中,没必要把公用的函数写成一个工具类,有时候面向过程其实更方便。 在入口文件index.php里添加 require_once('protected/function.php'); 即可对其引用,成为公用的函数集合。 function.php如下:

<?php /** * This is the shortcut to D

- linux 系统资源的查看(free、uname、uptime、netstat)

eksliang

netstatlinux unamelinux uptimelinux free

linux 系统资源的查看

转载请出自出处:http://eksliang.iteye.com/blog/2167081

http://eksliang.iteye.com 一、free查看内存的使用情况

语法如下:

free [-b][-k][-m][-g] [-t]

参数含义

-b:直接输入free时,显示的单位是kb我们可以使用b(bytes),m

- JAVA的位操作符

greemranqq

位运算JAVA位移<<>>>

最近几种进制,加上各种位操作符,发现都比较模糊,不能完全掌握,这里就再熟悉熟悉。

1.按位操作符 :

按位操作符是用来操作基本数据类型中的单个bit,即二进制位,会对两个参数执行布尔代数运算,获得结果。

与(&)运算:

1&1 = 1, 1&0 = 0, 0&0 &

- Web前段学习网站

ihuning

Web

Web前段学习网站

菜鸟学习:http://www.w3cschool.cc/

JQuery中文网:http://www.jquerycn.cn/

内存溢出:http://outofmemory.cn/#csdn.blog

http://www.icoolxue.com/

http://www.jikexue

- 强强联合:FluxBB 作者加盟 Flarum

justjavac

r

原文:FluxBB Joins Forces With Flarum作者:Toby Zerner译文:强强联合:FluxBB 作者加盟 Flarum译者:justjavac

FluxBB 是一个快速、轻量级论坛软件,它的开发者是一名德国的 PHP 天才 Franz Liedke。FluxBB 的下一个版本(2.0)将被完全重写,并已经开发了一段时间。FluxBB 看起来非常有前途的,

- java统计在线人数(session存储信息的)

macroli

javaWeb

这篇日志是我写的第三次了 前两次都发布失败!郁闷极了!

由于在web开发中常常用到这一部分所以在此记录一下,呵呵,就到备忘录了!

我对于登录信息时使用session存储的,所以我这里是通过实现HttpSessionAttributeListener这个接口完成的。

1、实现接口类,在web.xml文件中配置监听类,从而可以使该类完成其工作。

public class Ses

- bootstrp carousel初体验 快速构建图片播放

qiaolevip

每天进步一点点学习永无止境bootstrap纵观千象

img{

border: 1px solid white;

box-shadow: 2px 2px 12px #333;

_width: expression(this.width > 600 ? "600px" : this.width + "px");

_height: expression(this.width &

- SparkSQL读取HBase数据,通过自定义外部数据源

superlxw1234

sparksparksqlsparksql读取hbasesparksql外部数据源

关键字:SparkSQL读取HBase、SparkSQL自定义外部数据源

前面文章介绍了SparSQL通过Hive操作HBase表。

SparkSQL从1.2开始支持自定义外部数据源(External DataSource),这样就可以通过API接口来实现自己的外部数据源。这里基于Spark1.4.0,简单介绍SparkSQL自定义外部数据源,访

- Spring Boot 1.3.0.M1发布

wiselyman

spring boot

Spring Boot 1.3.0.M1于6.12日发布,现在可以从Spring milestone repository下载。这个版本是基于Spring Framework 4.2.0.RC1,并在Spring Boot 1.2之上提供了大量的新特性improvements and new features。主要包含以下:

1.提供一个新的sprin

![]()