Transfer Learning 文章解析

transfer learning: 包含所有的source or target, labeled or unlabeled, finetune, multi-task learning的情况。总而言之一句话,训练的过程中用(单个数据集做supervised learning)之外的所有情况都算在transfer learning中。

supervised learning: 训练数据都有标签(单数据集)

unsupervised learning: 训练数据无标签(单数据集)

semi supervised learning: 训练数据一部分有标签,一部分没有标签(单数据集)

doman adaptation: 多数据集,target没有label,source有label(多数据集)

weakly supervised learning: 有标注错误,或者标注不全,或者需要做分割任务只有检测的标签等(单数据集)

更多的解释参见下图:

博文论文中出现的setting总结:

Setting1: universal semi-supervised semantic segmentation。 target和source都一部分有label,一部分没有label。

Setting2: cross-category semi-supervised semantic segmentation, in-category semi-supervised semantic segementation。

Setting3: partial domain adaptation, source和target都有标签,source标签比target多。

Setting4: Beyond domain adaptation, source domain 有image & label,target domain 训练时看不到,只有test可以看到。

以下文章以Segmentation为主

部分文章也有在做classification和detection任务

1. Weakly- and Semi-Supervised Panoptic Segmentation(ECCV, 2018):

Setting: weakly- and semi-supervised semantic and instance segmentation。weakly: 使用检测框和类别标签,训练得到图像分割结果。semi: 加入一部分human-annotations(可以理解为:human class的分割标签)

Method: 单数据集,结合semantic seg和detector的结果加入instance seg的网络中,可以得到instance seg的结果。

根据检测框和物体标签得到结果的方法:训练multi-class网络,不同的分支取conv层的channel,根据检测框框出物体标签所在位置,根据该特定位置的heatmap得到粗略的预测分割结果。

Contribution:第一次提出使用weakly supervised non-overlapping instance segmentation。第一次在weakly supervise任务中同时进行semantic and instance segmentation。第一次在cityscapes执行weakly- and semi- supervised任务。

Backbone: psp+resnet101

Datasets: cityscapes, pascal voc.(coco辅助)

2. Penalizing Top Performers: Conservative Loss for Semantic Segmentation Adaptation(ECCV, 2018):

Setting: unsupervised domain adaptation。

Method: 提出了一种新的loss: conservative loss。防止模型学得太差,判别性不足,也不要学得太好,陷入source domain的over fitting。中间部分尽量小,两端尽量大。概率靠近1的给比较低的loss,防止学得比较好。概率靠近0的,说明这部分需要增加训练,给高loss,让其多修改weight。

Contribution:新的loss

Backbone: FCN(vgg16)

Datasets: cityscapes, gtav, synthia

3. Domain Transfer Through Deep Activation Matching(ECCV, 2018):

Setting: unsupervised domain adaptation。

Method: 在网络中间加很多gan, gan的loss是根据jsd(Jensen-Shannon divergence)计算的。

Contribution:新的loss

Backbone: classification: le-net. segmentation: erf-net

Datasets: classification: mnist, usps, svhn. segmentation: cityscapes, gtav, synthia

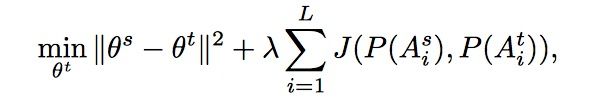

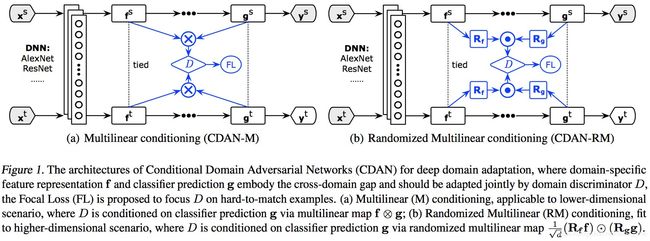

4. Partial Adversarial Domain Adaptation(ECCV, 2018):(这篇工作的后续工作--Partial transfer learning with selective adversarial networks.)

Setting: partial domain adaptation, source和target都有标签,source标签比target多。

Method: 将adversarial learning用到partial domain adaptation中。

Contribution:将adversarial learning用到partial domain adaptation中。

Backbone: --(pada)

Datasets: office-31, office-home, imagenet-caltech, visda2017

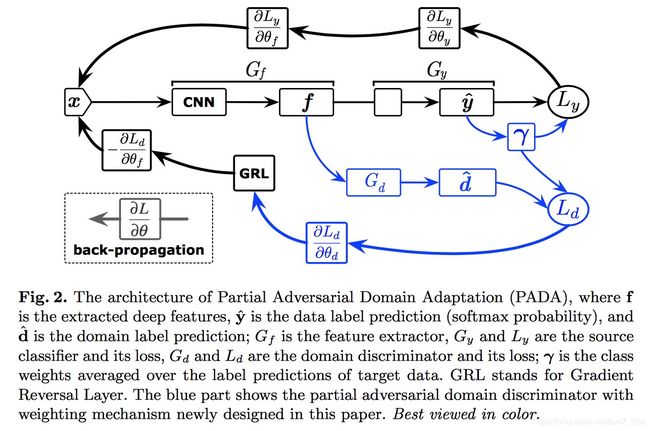

4. Conditional Adversarial Domain Adaptation(NIPS, 2018):

Setting: domain adaptation. 单任务,多数据集。 target没有label,source有label。

Method: 网络中间提取的特征和预测的类别相乘的结果做对抗学习。

Contribution:同method

Backbone: alexnet, resnet-50

Datasets: office-31, imageclef-da, office-home

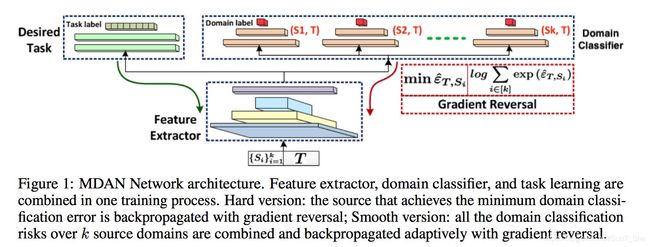

5. Adversarial Multiple Source Domain Adaptation(NIPS, 2018):

Setting: domain adaptation. 单任务,多数据集。 target没有label,source有label。

Method: supervised训练有标签的数据,多个discriminator区分各个source domain和target domain。

Contribution:同method

Backbone: --

Datasets: mnist, mnist-m, svhn, synthdigits

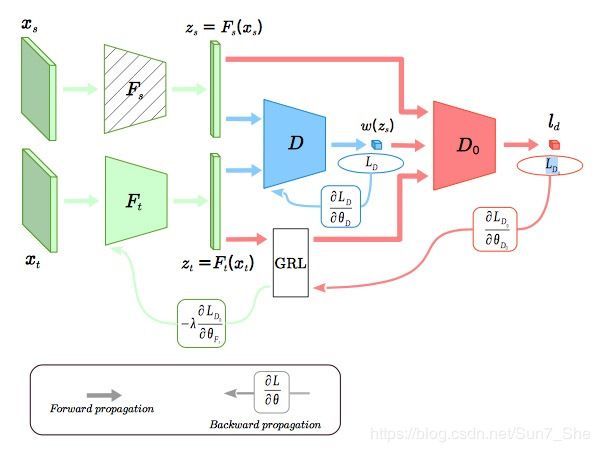

6. Importance Wegihted Adversarial Nets for Partial Domain Adaptation(CVPR, 2018):

Setting: partial domain adaptation, source和target都有标签,source标签比target多。

Method: 加权discriminator(使用第一个d计算权重,第二个d来反传修改系数)。

Contribution:计算权重的discriminator

Backbone: resnet18

Datasets: office+caltech-10 object datasets, office-31 dataset, caltech-256

7. Object Region Mining with Adversarial Erasing: A Simple Classification to Semantic Segmentation Approach(CVPR, 2017):

Setting: unsupervised semantic segmentation。有分类标签,训练得到分割结果。

Method: 对物体分类,物体不同区域对分类的贡献不同,会有热图,去掉响应高的部分(其实是用图片均值代替),继续训练,得到热图,然后如此迭代,得到多个网络,有多个热图,拼起来可以粗略分出物体。

Contribution:classification --> segmentation. psl:擦除方法

Backbone: deeplab(vgg16)

Datasets: pascal voc 2012

8. Universal Semi-Supervised Semantic Segmentation(arxiv, 2018):

Setting: universal semi-supervised semantic segmentation。 target和source都一部分有label,一部分没有label。

Method: 一共两个数据集,每个数据集。每个数据集有label的数据用supervised learning方法训练,没有label的数据用unsupervised learning的方法训练。unsupervised learning根据相似度算loss。

Contribution:新的setting,unsupervised learning根据相似度算loss

Backbone: resnet18

Datasets: cityscapes, camvid, id, sun rgb-d

9. Transferable Semi-supervised Semantic Segmentation(arxiv, 2018):

Setting: cross-category semi-supervised semantic segmentation, in-category semi-supervised semantic segementation。

Method: l-net: 结合分类标签和分割标签训练得到prediction。p-net: adversarial learning

Contribution:l-net and p-net???

Backbone: DeepLab(vgg16) - L-net. CAM(vgg16) - classification net. 6-3*3 conv layer + 3 fully connected layers - P-net.

Datasets: PASCAL VOC 2012.

10. Virtual-to-Real: Leaning to Control in Visual Semantic Segmentation(IJCAI, 2018):

并不能看懂,好像和robot有关?可能和我们关系不大。。先记录一下恩。。

Network: A3C(对比DR-A3C, ResNet-A3C)

Datasets: ADE20K

11. Label Efficient Learning of Transferable Representations across Domains and Tasks(NIPS 2017):

Setting: labeled source data and unlabeled or sparsely labeled data in the target domain.

Method: 1 supervised loss(source domain & target domain labeled data)+2 GAN loss(source domain feature & target domain feature)+3 Entropy Loss(source feature & unlabeled target feature; labeled target feature & unlabeled target feature )

Contribution:loss3

Backbone: fcn8s+vgg16, drn-26

Datasets: SVHN, MNIST; Image net , ucf-101

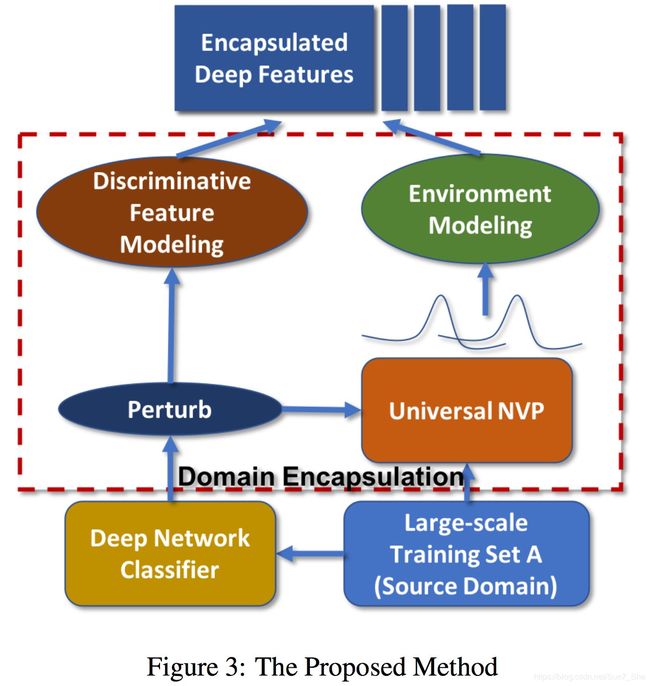

12. Beyond Domain Adaptation: Unseen Domain Encapsulation via Universal Non-volume Preserving Models(arxiv, 2018):

Setting: source domain 有image & label,target domain 训练时看不到,只有test可以看到。

Method: 假设各个domain都是高斯分布,不过它们的均值和方差不同,通过改变均值和方差,生成不同的domain的数据加入训练过程。

Contribution:同method

Backbone: conv-pool-conv-pool-fc-fc-softmax, real nvp

Datasets: mnist, usps, svhn and mnist-m; yale-b, cmu-pie, cmu-mpie

~~~~~~~~~不定期更新~~~~~~~~~

ICLR 2018 100 papers: http://search.iclr2018.smerity.com

CVPR 2018 paper list: http://openaccess.thecvf.com/CVPR2018.py

ECCV 2018 paper list: http://openaccess.thecvf.com/content_ECCV_2018/html/

NIPS 2018 paper list: http://papers.nips.cc