多模人车交互,智能汽车的AI感知进化

2019-10-28 14:32:49

作为物联网的重要组成部分,车联网已经成为是科技、互联网巨头们争相进入的新领域。

2014年,苹果推出了基于iPhone的智能车载系统CarPlay;Google也在同年发布了对标产品Android Auto。智能手机系统的两强格局,再一次被平移到智能车载系统市场。

在底层系统之上,手机时代的应用开发者们,也开始思考驾驶场景中App的交互逻辑。今年8月,腾讯发布了车载微信产品。车载微信仅保留了微信最核心的几项功能:消息查看、发送与语音通话。为了驾驶员的安全,车载微信的交互方式,仅支持语音与方向盘按键。

在车联网时代,汽车不断智能化,而人车之间的交互也将更加多样、频繁。如今,智能汽车的操作系统与上层应用正在蓬勃发展,但在软件层之下,人车之间究竟该如何实现高效、安全、易用的人机交互,仍然是值得所有从业者思考的一大难题。

从传统的机械按键到现代化的触控屏、语音操控、手势操控,人车交互的途径越来越多。而未来,智能汽车的主动感知功能,也许将成为人车互动的终极追求。

多模交互时代来临

从1885年的奔驰一号到如今的纯电动车,汽车的技术架构与产品形态,都经历了翻天覆地的变化。但对于汽车厂商而言,为汽车添加尽可能多的功能,可能是唯一不变的追求。

如果一名19世纪的汽车驾驶员穿越到当下,很可能对现代汽车上无数的按键、旋钮与触控屏感到茫然。座椅调节、空调、电台、音乐播放,现代汽车集成了越来越多的功能模块,这些模块在丰富汽车驾驶体验的同时,也给驾驶员带来了更多的操控负担。

在汽车智能化的背景下,驾驶员的“认知过载”已不可避免。如何改善人车交互体验,让驾驶员专注于驾驶本身,从座椅调节、路线导航、听歌点歌等各种琐事中解放出来,从而提升人车交互体验和驾驶安全,将会成为下一代人车交互产品的首要目标。

以“触摸+语音”为核心的传统人车交互模式亟待新的变化

如今,以“触摸+语音”为核心的传统人车交互模式,几乎已经达到了车内用户的交互体验天花板。若想在保证驾驶安全的前提下实现更复杂的人车交互,“多模交互”势在必行。

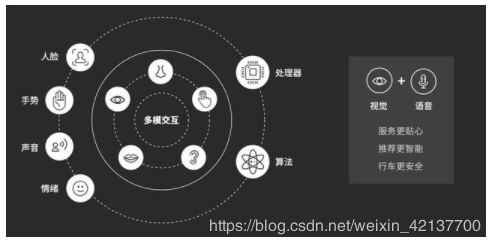

何为多模交互?

这是一种融合了视觉、语音等多感官的AI交互方式。驾驶员、乘客可以通过语音、手势等多种方式为车辆下指令,而车辆也具备智慧感知功能,可以更准确地判断用户意图。以音乐播放为例,传统的车载音乐播放模式,是驾驶员通过按键、旋钮、触屏等介质,选择、控制音乐播放。在单模态下,用户可以使用语音操控音乐播放,而多模态加入后,车辆可以通过人脸、声纹识别的方式,识别发出指令的用户,并根据用户的个人喜好及环境场景提供定制化的歌单。此外,多模交互在很多实际应用场景都将对交互体验产生质的提升,如基于唇语和语音调节不同车窗,基于情绪识别进行智能主动抓拍,基于注意力检测提供语音提醒服务等等。

事实上,多模交互的意义远不止解放车内用户交互操作。通过感知、推荐、交互等环节,多模交互将赋予汽车生命和智慧,让汽车实现主动式的思考,持续优化车内服务和场景迭代。

多模语音交互将实现让车主动服务人的转变

多模交互将使设备能够结合用户行为习惯从而更精准的判断用户意图,实现 AI 时代的立体智能推荐多模交互。这一切,已经不再停留在产品设想层面,一些国内技术提供商已经开始将多模态人机交互产品落地化。

技术落地的前景与挑战

但多模交互人车交互的技术实现,并非易事。

36氪就多模交互趋势与地平线进行了对话,在地平线的多模态人车智能交互解决方案中,摄像头、麦克风阵列、芯片平台与CAN总线构成了最核心的硬件元件。其中,摄像头实现了人脸与手势的识别,麦克风用于获取语音信息,芯片与CAN则负责通信,并将指令下放到输出层。这其中,不仅涉及到不同形态的技术,不同来源的数据融合。

地平线希望通过多模交互融合视觉和语音,从而实现 “1+1>2”效果

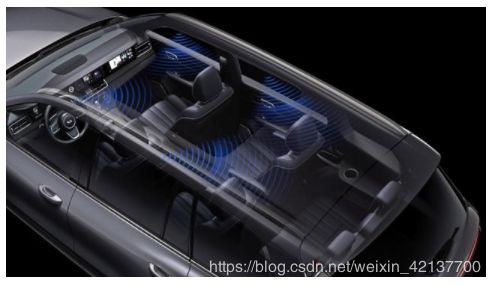

传统的单模交互方式,如语音交互往往会有很大局限性。相较于家居场景中的智能音箱,车内场景噪音大、人员密集,语音识别难度会更大。汽车该如何感知驾驶员与多位乘客提出的不同语音指令,将指令精准定位到人,一直是一个难题。中国新造车品牌理想旗下首款产品——理想ONE,通过搭载的地平线多音区识别方案,采用了声源定位、盲源分离和降噪算法,实现了车载环境下的多音区交互。

但在地平线看来,这远远不够。

在最近与某主机厂的合作中,地平线提供了多模命令词方案。该方案采用了视觉识别与语音识别技术,通过对唇语和语音的融合分析,从底层逻辑上降低了误唤醒率与不发声情况下的误识率。地平线多模产品负责人表示,“多模命令词是业内首创的将唇语特征和语音特征融合进行语音识别算法,联合学习两种模态的数据可以有效提高高噪声环境下的命令词识别率,及降低不发声情况下的误识率。”

理想ONE车内的四麦克风布置

在视觉交互方面,以座椅调节为例,在汽车发展史上,座椅调节功能从无到有,从机械到电动,从手动调节到智能记忆,一直处于不断的演进之中。而基于人脸识别的座椅记忆功能,则可以彻底解放用户双手,汽车监测到用户上车后,便可以根据用户的设定,自动调节好座椅位置,无需用户进行任何操作。

此外,如上文所言,在多模交互时代,智能汽车的核心体验也不止于个性化。主动化,是多模交互的另一个关键词。比如当汽车传感器监测到车内用户开心时可以主动抓拍,当检测到驾驶员出现闭眼、打哈欠、玩手机等危险驾驶迹象时,车辆也可以发出提醒,甚至对疲劳进行分级并提供不同的疲劳降解甚至警报服务。

无人驾驶普及之前,汽车对驾驶员危险驾驶行为的干预行为,将会大大降低事故发生率。

芯片算力和算法的迭代演进是关键驱动力

毫无疑问,汽车行业正经历着深刻且快速的变革。汽车不再仅仅是一个交通工具,更是一种生活方式,同时也是一种时尚的潮流,这里面有无限服务的创新的可能。让出行更安全美好的不仅仅是自动驾驶和辅助驾驶,在商业模式创新方面,有分时租赁和共享出行;在前端的高科技技术集成方面,有车联网和 5G 加持的高速互联,有车路协同带动的基础设施进步;在车内人机交互方面,更智能更先进的交互技术也在不断落地应用,这种变化就如同当年PC时代与移动时代之交苹果带来触屏交互。

不久的未来,我们需要在底层的算力支撑上去构建一个丰富的人工智能软件框架,其中有环境感知,它可以借助多种传感器对周围环境实现三维动态全景的感知建模,并根据周边的所有目标特别是动态目标的行为预测去做决策规划布置;同时这个软件框架下,智能座舱技术如多模人机交互将会得到更为有丰富的体验,比如更清晰的显示屏,更自然的语音、视觉交互,但无论车外环境感知还是车内智能座舱,都同样对芯片算力和算法提出了不断递增的要求标准。

如地平线这样的人工智能企业在汽车产业链中扮演的角色就是以边缘AI芯片为合作伙伴提供底层算力,支撑起上层应用软件。

汽车产业的迅猛发展,带动的是整个信息产业的发展,这其中就包括传感器、AI 芯片,以及最先进的人工智能软件系统。

目前,业界普遍认为,在自动驾驶时代到来前,ADAS(辅助驾驶)、DMS(驾驶行为监测)、多模交互等智能驾驶功能,将成为自动驾驶过渡阶段的智能汽车标配模块。未来,汽车的AI感知能力仍将会不断演化,而如何借助人工智能让汽车更智能、让人机交互更自然,则将是车厂和相关技术企业在当下的重要目标。