- 如何解决Flink CDC同步时间类型字段8小时时间差的问题,以MySQL为例

智海观潮

Flinkflinkflinkcdc大数据实时数据同步

在使用FlinkCDC进行数据同步时,默认情况下经常会遇到时间类型的字段与实际值相差8个小时的问题。本文以MySQL为例提供解决方案,其他数据源也可以参考这类实现。原文链接:https://mp.weixin.qq.com/s/_f41ES8UquM-kj3Ie8JU_g1.设置server时区比如MySQL服务的时区为UTC时间,可以参考以下code设置时区。MySqlSourcemySqlSo

- Paimon对比基于消息队列(如Kafka)的传统实时数仓方案的优势

lifallen

Paimon大数据数据库数据结构java分布式apache数据仓库

弊端:数据重复->优势:Paimon主键表原生去重原方案弊端(Kafka)问题:消息队列(Kafka)是仅支持追加(Append-Only)的日志流。当Flink作业发生故障恢复(Failover)或业务逻辑迭代重跑数据时,同样的数据会被再次写入消息队列,形成重复数据。影响:下游应用(如DWS层、ADS层或直接对接的BI报表)必须自己实现复杂的去重逻辑,这不仅消耗大量计算资源(“资源消耗至少增加一

- Flink 流处理的核心基石【时间语义、水位线、状态、检查点、反压 】

csdn_tom_168

大数据flink核心时间语义水位线状态检查点反压

Flink流处理的核心基石【时间语义、水位线、状态、检查点、反压】,这些概念相互协作,构建了Flink高吞吐、低延迟、高容错的实时计算能力。以下是这些核心技术的深度解析及其内在联系:一、五大基石的内在联系驱动触发计算持久化保护恢复时间语义水位线状态管理检查点反压二、核心组件深度解析1.时间语义(TimeSemantics)核心作用:定义事件的时间维度//设置事件时间语义(关键配置)env.setS

- 用Flink实现的一个实时订单对账功能, Flink的双流实时对账

1.为什么业务订单数据不用Mysql之类的强事务性数据库监控反而用Flink的实时?一般这种涉及到订单的数据流都要用mysql监控实现,但是鉴于减少mysql的数据库压力和提高更实时性,可以考虑用Flink实时的数据流做实时的参考2.如何处理乱序数据?使用watermark水位保证第一层数据延迟.PS:这里的水位不能设置太长延迟使用processfuntion更加灵活的处理迟到数据,设置一个定时器

- Flink 多流转换 (三)CoProcessFunction合流操作案例

Alienware^

#FlinkFlink

文章目录下面是CoProcessFunction的一个具体示例:我们可以实现一个实时对账的需求,也就是app的支付操作和第三方的支付操作的一个双流Join。App的支付事件和第三方的支付事件将会互相等待5秒钟,如果等不来对应的支付事件,那么就输出报警信息。程序如下:Gitee源代码如下publicclassBillCheckExample{publicstaticvoidmain(String[]

- Flink双流处理:实时对账实现1

Flink双流处理:实时对账实现1去发现同类优质开源项目:https://gitcode.com/资源描述本资源文件详细介绍了Flink双流处理的实时对账实现。内容涵盖了基础概念、双流处理的方法以及实战案例,帮助开发者深入理解Flink在实时对账场景中的应用。内容概述基础概念介绍了Flink的基本概念和架构,为后续的双流处理打下基础。双流处理方法详细讲解了Flink中双流处理的核心方法和技巧,帮助

- Flink双流实时对账

在电商、金融、银行、支付等涉及到金钱相关的领域,为了安全起见,一般都有对账的需求。比如,对于订单支付事件,用户通过某宝付款,虽然用户支付成功,但是用户支付完成后并不算成功,我们得确认平台账户上是否到账了。针对上述的场景,我们可以采用批处理,或离线计算等技术手段,通过定时任务,每天结束后,扫描数据库中的数据,核对当天的支付数据和交易数据,进行对账。想要达到实时对账的效果,比如有的用户支付成功但是并没

- [特殊字符] 实时数据洪流突围战:Flink+Paimon实现毫秒级分析的架构革命(附压测报告)——日均百亿级数据处理成本降低60%的工业级方案

Lucas55555555

flink大数据

引言:流批一体的时代拐点据阿里云2025白皮书显示,实时数据处理需求年增速达240%,但传统Lambda架构资源消耗占比超运维成本的70%。某电商平台借助Flink+Paimon重构实时数仓后,端到端延迟从分钟级压缩至800ms,计算资源节省5.6万核/月。技术红利窗口期:2025年ApachePaimon1.0正式发布,支持秒级快照与湖仓一体,成为替代Iceberg的新范式一、痛点深挖:实时数仓

- Flink 2.0 DataStream算子全景

Edingbrugh.南空

大数据flinkflink人工智能

在实时流处理中,ApacheFlink的DataStreamAPI算子是构建流处理pipeline的基础单元。本文基于Flink2.0,聚焦算子的核心概念、分类及高级特性。一、算子核心概念:流处理的"原子操作1.数据流拓扑(StreamTopology)每个Flink应用可抽象为有向无环图(DAG),由源节点(Source)、算子节点(Operator)和汇节点(Sink)构成,算子通过数据流(S

- FlinkSQL 自定义函数详解

Tit先生

基础flinksql大数据java

FlinkSQL函数详解自定义函数除了内置函数之外,FlinkSQL还支持自定义函数,我们可以通过自定义函数来扩展函数的使用FlinkSQL当中自定义函数主要分为四大类:1.ScalarFunction:标量函数特点:每次只接收一行的数据,输出结果也是1行1列典型的标量函数如:upper(str),lower(str),abs(salary)2.TableFunction:表生成函数特点:运行时每

- Flink自定义函数之聚合函数(UDAGG函数)

土豆马铃薯

Flinkflink大数据

1.聚合函数概念聚合函数:将一个表的一个或多个行并且具有一个或多个属性聚合为标量值。聚合函数理解:假设一个关于饮料的表。表里面有三个字段,分别是id、name、price,表里有5行数据。假设你需要找到所有饮料里最贵的饮料的价格,即执行一个max()聚合。你需要遍历所有5行数据,而结果就只有一个数值。2.聚合函数实现聚合函数主要通过扩展AggregateFunction类实现。AggregateF

- Flink时间窗口详解

bxlj_jcj

Flinkflink大数据

一、引言在大数据流处理的领域中,Flink的时间窗口是一项极为关键的技术,想象一下,你要统计一个电商网站每小时的订单数量。由于订单数据是持续不断产生的,这就形成了一个无界数据流。如果没有时间窗口的概念,你就需要处理无穷无尽的数据,难以进行有效的统计分析。而时间窗口的作用,就是将这无界的数据流按照时间维度切割成一个个有限的“数据块”,方便我们对这些数据进行处理和分析。比如,我们可以定义一个1小时的时

- Flink DataStream API详解(一)

bxlj_jcj

Flinkflink大数据

一、引言Flink的DataStreamAPI,在流处理领域大显身手的核心武器。在很多实时数据处理场景中,如电商平台实时分析用户购物行为以实现精准推荐,金融领域实时监控交易数据以防范风险,DataStreamAPI都发挥着关键作用,能够对源源不断的数据流进行高效处理和分析。接下来,就让我们一起深入探索FlinkDataStreamAPI。二、DataStream编程基础搭建在开始使用FlinkDa

- flink自定义函数

逆风飞翔的小叔

flink入门到精通flink大数据bigdata

前言在很多情况下,尽管flink提供了丰富的转换算子API可供开发者对数据进行各自处理,比如map(),filter()等,但在实际使用的时候仍然不能满足所有的场景,这时候,就需要开发人员基于常用的转换算子的基础上,做一些自定义函数的处理1、来看一个常用的操作原始待读取的文件核心代码importorg.apache.flink.api.common.functions.FilterFunction

- Flink自定义函数的常用方式

飞Link

Waterflinkjava大数据

一、实现Flink提供的接口//自定义函数classMyMapFunctionimplementsMapFunction{publicIntegermap(Stringvalue){returnInteger.parseInt(value

- Flink DataStream API详解(二)

一、引言咱两书接上回,上一篇文章主要介绍了DataStreamAPI一些基本的使用,主要是针对单数据流的场景下,但是在实际的流处理场景中,常常需要对多个数据流进行合并、拆分等操作,以满足复杂的业务需求。Flink的DataStreamAPI提供了一系列强大的多流转换算子,如union、connect和split等,下面我们来详细了解一下它们的功能和用法。二、多流转换2.1union算子union算

- 【Kafka】Failed to send data to Kafka: Expiring 30 record(s) for xxx 732453 ms has passed since last

九师兄

kafkabigdatazookeeper

文章目录1.美图2.背景2.尝试方案13.尝试解决24.场景再现25.场景46.场景57.场景78.场景8M.拓展本文为博主九师兄(QQ:541711153欢迎来探讨技术)原创文章,未经允许博主不允许转载。1.美图问题与【Flink】Flink写入kafka报错FailedtosenddatatoKafka:Expiring4record(s)for20001mshaspassed重复了。2.背景

- 【Flink】flink Kafka报错 : Failed to send data to Kafka: This server is not the leader for that topic-pa

九师兄

flinkkafka大数据

1.背景出现这个问题的背景请参考:【Kafka】FailedtosenddatatoKafka:Expiring30record(s)forxxx732453mshaspassedsincelast[2020-09-0513:16:09

- 安全运维的 “五层防护”:构建全方位安全体系

KKKlucifer

安全运维

在数字化运维场景中,异构系统复杂、攻击手段隐蔽等挑战日益突出。保旺达基于“全域纳管-身份认证-行为监测-自动响应-审计溯源”的五层防护架构,融合AI、零信任等技术,构建全链路安全运维体系,以下从技术逻辑与实践落地展开解析:第一层:全域资产纳管——筑牢安全根基挑战云网基础设施包含分布式计算(Hadoop/Spark)、数据流处理(Storm/Flink)等异构组件,通信协议繁杂,传统方案难以全面纳管

- kafka单个生产者向具有多个partition的topic写数据(写入分区策略)

最近碰到生产环境现象一个flink程序单并行度(一个生产者),对应topic为8分区。每个分区都能消费到生产出的数据。整理知识点如下生产者写入消息到topic,kafka将依据不同的策略将数据分配到不同的分区中1.轮询分区策略2.随机分区策略3.按key分区分配策略4.自定义分区策略1.1轮询分区策略默认的策略,也是使用最多的策略,可以最大限度的保证所有消息平均分配到分区里面如果在生产消息时,ke

- 云原生--微服务、CICD、SaaS、PaaS、IaaS

青秋.

云原生docker云原生微服务kubernetesserverlessservice_meshci/cd

往期推荐浅学React和JSX-CSDN博客一文搞懂大数据流式计算引擎Flink【万字详解,史上最全】-CSDN博客一文入门大数据准流式计算引擎Spark【万字详解,全网最新】_大数据spark-CSDN博客目录1.云原生概念和特点2.常见云模式3.云对外提供服务的架构模式3.1IaaS(Infrastructure-as-a-Service)3.2PaaS(Platform-as-a-Servi

- Apache Iceberg数据湖基础

Aurora_NeAr

apache

IntroducingApacheIceberg数据湖的演进与挑战传统数据湖(Hive表格式)的缺陷:分区锁定:查询必须显式指定分区字段(如WHEREdt='2025-07-01')。无原子性:并发写入导致数据覆盖或部分可见。低效元数据:LIST操作扫描全部分区目录(云存储成本高)。Iceberg的革新目标:解耦计算引擎与存储格式(支持Spark/Flink/Trino等);提供ACID事务、模式

- Flink ClickHouse 连接器:实现 Flink 与 ClickHouse 无缝对接

Edingbrugh.南空

大数据flinkflinkclickhouse大数据

引言在大数据处理领域,ApacheFlink是一款强大的流处理和批处理框架,而ClickHouse则是一个高性能的列式数据库,专为在线分析处理(OLAP)场景设计。FlinkClickHouse连接器为这两者之间搭建了一座桥梁,使得用户能够在Flink中方便地与ClickHouse数据库进行交互,实现数据的读写操作。本文将详细介绍FlinkClickHouse连接器的相关内容,包括其特点、使用方法

- 大数据技术之Flink

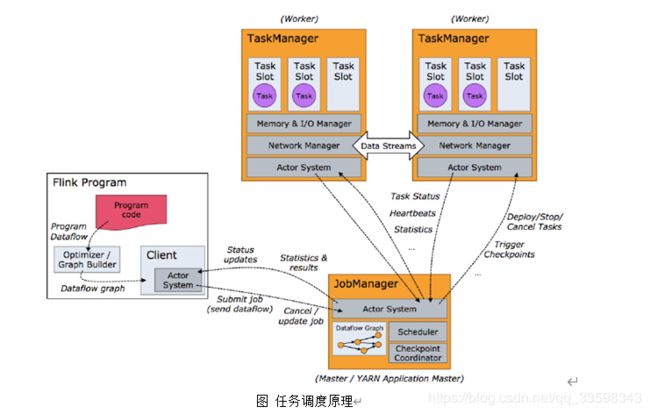

第1章Flink概述1.1Flink是什么1.2Flink特点1.3FlinkvsSparkStreaming表Flink和Streaming对比FlinkStreaming计算模型流计算微批处理时间语义事件时间、处理时间处理时间窗口多、灵活少、不灵活(窗口必须是批次的整数倍)状态有没有流式SQL有没有1.4Flink的应用场景1.5Flink分层API第2章Flink快速上手2.1创建项目在准备

- Hadoop核心组件最全介绍

Cachel wood

大数据开发hadoop大数据分布式spark数据库计算机网络

文章目录一、Hadoop核心组件1.HDFS(HadoopDistributedFileSystem)2.YARN(YetAnotherResourceNegotiator)3.MapReduce二、数据存储与管理1.HBase2.Hive3.HCatalog4.Phoenix三、数据处理与计算1.Spark2.Flink3.Tez4.Storm5.Presto6.Impala四、资源调度与集群管

- flink数据同步mysql到hive_基于Canal与Flink实现数据实时增量同步(二)

背景在数据仓库建模中,未经任何加工处理的原始业务层数据,我们称之为ODS(OperationalDataStore)数据。在互联网企业中,常见的ODS数据有业务日志数据(Log)和业务DB数据(DB)两类。对于业务DB数据来说,从MySQL等关系型数据库的业务数据进行采集,然后导入到Hive中,是进行数据仓库生产的重要环节。如何准确、高效地把MySQL数据同步到Hive中?一般常用的解决方案是批量

- Flink OceanBase CDC 环境配置与验证

Edingbrugh.南空

运维大数据flinkflinkoceanbase大数据

一、OceanBase数据库核心配置1.环境准备与版本要求版本要求:OceanBaseCE4.0+或OceanBaseEE2.2+组件依赖:需部署LogProxy服务(社区版/企业版部署方式不同)兼容模式:支持MySQL模式(默认)和Oracle模式2.创建用户与权限配置在sys租户创建管理用户(社区版示例):--连接sys租户(默认端口2881)mysql-h127.0.0.1-P2881-ur

- Flink MongoDB CDC 环境配置与验证

Edingbrugh.南空

运维大数据flinkflinkmongodb大数据

一、MongoDB数据库核心配置1.环境准备与集群要求MongoDBCDC依赖ChangeStreams特性,需满足以下条件:版本要求:MongoDB≥3.6集群模式:副本集(ReplicaSet)或分片集群(ShardedCluster)存储引擎:WiredTiger(默认自3.2版本起)副本集协议:pv1(MongoDB4.0+默认)验证集群配置:#连接MongoDBshellmongo--h

- Flink将数据流写入Kafka,Redis,ES,Mysql

浅唱战无双

flinkmysqlesrediskafka

Flink写入不同的数据源写入到Mysql写入到ES向Redis写入向kafka写入导入公共依赖org.slf4jslf4j-simple1.7.25compileorg.apache.flinkflink-java1.10.1org.apache.flinkflink-streaming-java_2.121.10.1写入到Mysql导入依赖mysqlmysql-connector-java5.

- Flink TiDB CDC 环境配置与验证

一、TiDB数据库核心配置1.启用TiCDC服务确保TiDB集群已部署TiCDC组件(版本需兼容FlinkCDC3.0.1),并启动同步服务:#示例:启动TiCDC捕获changefeedcdcclichangefeedcreate\--pd="localhost:2379"\--sink-uri="blackhole://"\--changefeed-id="flink-cdc-demo"2.验

- PHP,安卓,UI,java,linux视频教程合集

cocos2d-x小菜

javaUIlinuxPHPandroid

╔-----------------------------------╗┆

- zookeeper admin 笔记

braveCS

zookeeper

Required Software

1) JDK>=1.6

2)推荐使用ensemble的ZooKeeper(至少3台),并run on separate machines

3)在Yahoo!,zk配置在特定的RHEL boxes里,2个cpu,2G内存,80G硬盘

数据和日志目录

1)数据目录里的文件是zk节点的持久化备份,包括快照和事务日

- Spring配置多个连接池

easterfly

spring

项目中需要同时连接多个数据库的时候,如何才能在需要用到哪个数据库就连接哪个数据库呢?

Spring中有关于dataSource的配置:

<bean id="dataSource" class="com.mchange.v2.c3p0.ComboPooledDataSource"

&nb

- Mysql

171815164

mysql

例如,你想myuser使用mypassword从任何主机连接到mysql服务器的话。

GRANT ALL PRIVILEGES ON *.* TO 'myuser'@'%'IDENTIFIED BY 'mypassword' WI

TH GRANT OPTION;

如果你想允许用户myuser从ip为192.168.1.6的主机连接到mysql服务器,并使用mypassword作

- CommonDAO(公共/基础DAO)

g21121

DAO

好久没有更新博客了,最近一段时间工作比较忙,所以请见谅,无论你是爱看呢还是爱看呢还是爱看呢,总之或许对你有些帮助。

DAO(Data Access Object)是一个数据访问(顾名思义就是与数据库打交道)接口,DAO一般在业

- 直言有讳

永夜-极光

感悟随笔

1.转载地址:http://blog.csdn.net/jasonblog/article/details/10813313

精华:

“直言有讳”是阿里巴巴提倡的一种观念,而我在此之前并没有很深刻的认识。为什么呢?就好比是读书时候做阅读理解,我喜欢我自己的解读,并不喜欢老师给的意思。在这里也是。我自己坚持的原则是互相尊重,我觉得阿里巴巴很多价值观其实是基本的做人

- 安装CentOS 7 和Win 7后,Win7 引导丢失

随便小屋

centos

一般安装双系统的顺序是先装Win7,然后在安装CentOS,这样CentOS可以引导WIN 7启动。但安装CentOS7后,却找不到Win7 的引导,稍微修改一点东西即可。

一、首先具有root 的权限。

即进入Terminal后输入命令su,然后输入密码即可

二、利用vim编辑器打开/boot/grub2/grub.cfg文件进行修改

v

- Oracle备份与恢复案例

aijuans

oracle

Oracle备份与恢复案例

一. 理解什么是数据库恢复当我们使用一个数据库时,总希望数据库的内容是可靠的、正确的,但由于计算机系统的故障(硬件故障、软件故障、网络故障、进程故障和系统故障)影响数据库系统的操作,影响数据库中数据的正确性,甚至破坏数据库,使数据库中全部或部分数据丢失。因此当发生上述故障后,希望能重构这个完整的数据库,该处理称为数据库恢复。恢复过程大致可以分为复原(Restore)与

- JavaEE开源快速开发平台G4Studio v5.0发布

無為子

我非常高兴地宣布,今天我们最新的JavaEE开源快速开发平台G4Studio_V5.0版本已经正式发布。

访问G4Studio网站

http://www.g4it.org

2013-04-06 发布G4Studio_V5.0版本

功能新增

(1). 新增了调用Oracle存储过程返回游标,并将游标映射为Java List集合对象的标

- Oracle显示根据高考分数模拟录取

百合不是茶

PL/SQL编程oracle例子模拟高考录取学习交流

题目要求:

1,创建student表和result表

2,pl/sql对学生的成绩数据进行处理

3,处理的逻辑是根据每门专业课的最低分线和总分的最低分数线自动的将录取和落选

1,创建student表,和result表

学生信息表;

create table student(

student_id number primary key,--学生id

- 优秀的领导与差劲的领导

bijian1013

领导管理团队

责任

优秀的领导:优秀的领导总是对他所负责的项目担负起责任。如果项目不幸失败了,那么他知道该受责备的人是他自己,并且敢于承认错误。

差劲的领导:差劲的领导觉得这不是他的问题,因此他会想方设法证明是他的团队不行,或是将责任归咎于团队中他不喜欢的那几个成员身上。

努力工作

优秀的领导:团队领导应该是团队成员的榜样。至少,他应该与团队中的其他成员一样努力工作。这仅仅因为他

- js函数在浏览器下的兼容

Bill_chen

jquery浏览器IEDWRext

做前端开发的工程师,少不了要用FF进行测试,纯js函数在不同浏览器下,名称也可能不同。对于IE6和FF,取得下一结点的函数就不尽相同:

IE6:node.nextSibling,对于FF是不能识别的;

FF:node.nextElementSibling,对于IE是不能识别的;

兼容解决方式:var Div = node.nextSibl

- 【JVM四】老年代垃圾回收:吞吐量垃圾收集器(Throughput GC)

bit1129

垃圾回收

吞吐量与用户线程暂停时间

衡量垃圾回收算法优劣的指标有两个:

吞吐量越高,则算法越好

暂停时间越短,则算法越好

首先说明吞吐量和暂停时间的含义。

垃圾回收时,JVM会启动几个特定的GC线程来完成垃圾回收的任务,这些GC线程与应用的用户线程产生竞争关系,共同竞争处理器资源以及CPU的执行时间。GC线程不会对用户带来的任何价值,因此,好的GC应该占

- J2EE监听器和过滤器基础

白糖_

J2EE

Servlet程序由Servlet,Filter和Listener组成,其中监听器用来监听Servlet容器上下文。

监听器通常分三类:基于Servlet上下文的ServletContex监听,基于会话的HttpSession监听和基于请求的ServletRequest监听。

ServletContex监听器

ServletContex又叫application

- 博弈AngularJS讲义(16) - 提供者

boyitech

jsAngularJSapiAngularProvider

Angular框架提供了强大的依赖注入机制,这一切都是有注入器(injector)完成. 注入器会自动实例化服务组件和符合Angular API规则的特殊对象,例如控制器,指令,过滤器动画等。

那注入器怎么知道如何去创建这些特殊的对象呢? Angular提供了5种方式让注入器创建对象,其中最基础的方式就是提供者(provider), 其余四种方式(Value, Fac

- java-写一函数f(a,b),它带有两个字符串参数并返回一串字符,该字符串只包含在两个串中都有的并按照在a中的顺序。

bylijinnan

java

public class CommonSubSequence {

/**

* 题目:写一函数f(a,b),它带有两个字符串参数并返回一串字符,该字符串只包含在两个串中都有的并按照在a中的顺序。

* 写一个版本算法复杂度O(N^2)和一个O(N) 。

*

* O(N^2):对于a中的每个字符,遍历b中的每个字符,如果相同,则拷贝到新字符串中。

* O(

- sqlserver 2000 无法验证产品密钥

Chen.H

sqlwindowsSQL ServerMicrosoft

在 Service Pack 4 (SP 4), 是运行 Microsoft Windows Server 2003、 Microsoft Windows Storage Server 2003 或 Microsoft Windows 2000 服务器上您尝试安装 Microsoft SQL Server 2000 通过卷许可协议 (VLA) 媒体。 这样做, 收到以下错误信息CD KEY的 SQ

- [新概念武器]气象战争

comsci

气象战争的发动者必须是拥有发射深空航天器能力的国家或者组织....

原因如下:

地球上的气候变化和大气层中的云层涡旋场有密切的关系,而维持一个在大气层某个层次

- oracle 中 rollup、cube、grouping 使用详解

daizj

oraclegroupingrollupcube

oracle 中 rollup、cube、grouping 使用详解 -- 使用oracle 样例表演示 转自namesliu

-- 使用oracle 的样列库,演示 rollup, cube, grouping 的用法与使用场景

--- ROLLUP , 为了理解分组的成员数量,我增加了 分组的计数 COUNT(SAL)

- 技术资料汇总分享

Dead_knight

技术资料汇总 分享

本人汇总的技术资料,分享出来,希望对大家有用。

http://pan.baidu.com/s/1jGr56uE

资料主要包含:

Workflow->工作流相关理论、框架(OSWorkflow、JBPM、Activiti、fireflow...)

Security->java安全相关资料(SSL、SSO、SpringSecurity、Shiro、JAAS...)

Ser

- 初一下学期难记忆单词背诵第一课

dcj3sjt126com

englishword

could 能够

minute 分钟

Tuesday 星期二

February 二月

eighteenth 第十八

listen 听

careful 小心的,仔细的

short 短的

heavy 重的

empty 空的

certainly 当然

carry 携带;搬运

tape 磁带

basket 蓝子

bottle 瓶

juice 汁,果汁

head 头;头部

- 截取视图的图片, 然后分享出去

dcj3sjt126com

OSObjective-C

OS 7 has a new method that allows you to draw a view hierarchy into the current graphics context. This can be used to get an UIImage very fast.

I implemented a category method on UIView to get the vi

- MySql重置密码

fanxiaolong

MySql重置密码

方法一:

在my.ini的[mysqld]字段加入:

skip-grant-tables

重启mysql服务,这时的mysql不需要密码即可登录数据库

然后进入mysql

mysql>use mysql;

mysql>更新 user set password=password('新密码') WHERE User='root';

mysq

- Ehcache(03)——Ehcache中储存缓存的方式

234390216

ehcacheMemoryStoreDiskStore存储驱除策略

Ehcache中储存缓存的方式

目录

1 堆内存(MemoryStore)

1.1 指定可用内存

1.2 驱除策略

1.3 元素过期

2 &nbs

- spring mvc中的@propertysource

jackyrong

spring mvc

在spring mvc中,在配置文件中的东西,可以在java代码中通过注解进行读取了:

@PropertySource 在spring 3.1中开始引入

比如有配置文件

config.properties

mongodb.url=1.2.3.4

mongodb.db=hello

则代码中

@PropertySource(&

- 重学单例模式

lanqiu17

单例Singleton模式

最近在重新学习设计模式,感觉对模式理解更加深刻。觉得有必要记下来。

第一个学的就是单例模式,单例模式估计是最好理解的模式了。它的作用就是防止外部创建实例,保证只有一个实例。

单例模式的常用实现方式有两种,就人们熟知的饱汉式与饥汉式,具体就不多说了。这里说下其他的实现方式

静态内部类方式:

package test.pattern.singleton.statics;

publ

- .NET开源核心运行时,且行且珍惜

netcome

java.net开源

背景

2014年11月12日,ASP.NET之父、微软云计算与企业级产品工程部执行副总裁Scott Guthrie,在Connect全球开发者在线会议上宣布,微软将开源全部.NET核心运行时,并将.NET 扩展为可在 Linux 和 Mac OS 平台上运行。.NET核心运行时将基于MIT开源许可协议发布,其中将包括执行.NET代码所需的一切项目——CLR、JIT编译器、垃圾收集器(GC)和核心

- 使用oscahe缓存技术减少与数据库的频繁交互

Everyday都不同

Web高并发oscahe缓存

此前一直不知道缓存的具体实现,只知道是把数据存储在内存中,以便下次直接从内存中读取。对于缓存的使用也没有概念,觉得缓存技术是一个比较”神秘陌生“的领域。但最近要用到缓存技术,发现还是很有必要一探究竟的。

缓存技术使用背景:一般来说,对于web项目,如果我们要什么数据直接jdbc查库好了,但是在遇到高并发的情形下,不可能每一次都是去查数据库,因为这样在高并发的情形下显得不太合理——

- Spring+Mybatis 手动控制事务

toknowme

mybatis

@Override

public boolean testDelete(String jobCode) throws Exception {

boolean flag = false;

&nbs

- 菜鸟级的android程序员面试时候需要掌握的知识点

xp9802

android

熟悉Android开发架构和API调用

掌握APP适应不同型号手机屏幕开发技巧

熟悉Android下的数据存储

熟练Android Debug Bridge Tool

熟练Eclipse/ADT及相关工具

熟悉Android框架原理及Activity生命周期

熟练进行Android UI布局

熟练使用SQLite数据库;

熟悉Android下网络通信机制,S