- 人工智能学习资源

Hemy08

人工智能学习

无机器学习基础:https://www.coursera.org/learn/machine-learning有机器学习基础:MachineYearning深度学习入门:https://www.coursera.org/learn/neural-networks-deep-learning

- Pytorch深度学习入门基础(二):python 编辑器的选择、 安装及配置( pycharm、 jupyter)

慕奕宸

深度学习深度学习pythonpytorch

目录一、下载pycharm1.下载pycharm2.pycharm配置3.检查pycharm环境是否配置好二、Jupyter安装三、常见问题:1.为什么torch.cuda.isavailable()为False2.无法定位程序输入点现在来开一个专栏,关于学习Pytorch深度学习的入门基础,分为好几期,我会慢慢更新,希望大家可以互相支持一下,相互学习,相互进步!下面是这个专栏的所有内容,大家可以

- pytorch深度学习入门(12)之-神经网络导出onnx模型部署与应用

码农呆呆

深度学习深度学习pytorch神经网络

概述:ONNX(OpenNeuralNetworkExchange)是一种开放神经网络交换格式,它使得不同深度学习框架(如TensorFlow、PyTorch、MXNet等)之间的互操作成为可能。ONNX提供了一种标准化的方式,可以将训练好的模型导出并转换为ONNX格式,然后可以在其他支持ONNX的框架或工具中进行部署和推理。ONNX的主要优势在于它促进了深度学习模型在不同平台之间的互操作性和可移

- AI人工智能深度学习入门指南:从基础到实践_副本

AI大模型应用实战

C人工智能深度学习ai

AI人工智能深度学习入门指南:从基础到实践关键词:人工智能、机器学习、深度学习、神经网络、梯度下降、反向传播、实战案例摘要:本文是为零基础或初级学习者打造的深度学习入门指南。我们将从“人工智能-机器学习-深度学习”的关系讲起,用“教机器人认猫”的故事串联核心概念,结合生活比喻(如“多层蛋糕”解释神经网络)、数学公式(如梯度下降的“下山游戏”)和Python实战代码(用Keras实现手写数字识别),

- 深度学习入门指南:从基础概念到代码实践

软考和人工智能学堂

人工智能#深度学习Python开发经验深度学习人工智能

深度学习入门指南:从基础概念到代码实践1.深度学习概述深度学习是机器学习的一个分支,它通过模拟人脑神经元的工作方式,构建多层次的神经网络模型来处理复杂的数据模式。与传统机器学习方法相比,深度学习能够自动从原始数据中学习特征表示,无需过多的人工特征工程。深度学习已经在计算机视觉、自然语言处理、语音识别等领域取得了突破性进展。例如,ImageNet竞赛中深度学习模型的识别准确率已经超过人类水平,而GP

- 深度学习入门(2):alexnet

qq_776882262

深度学习人工智能

引言主要讲下alexnet里的几个方法,后面深度学习的代码部分应该都是借用别人的,整体安排是从简单到难。本篇借鉴Pytorch之AlexNet花朵分类_基于alexnet的花卉分类识别系统-CSDN博客,如果需要学习直接参考这篇就好了,本文只是作为本人复习记录。正文AlexNet是深度学习时代的开端,它用一场决定性的胜利,证明了深度卷积神经网络在计算机视觉中的巨大潜力。单层alexnet网络架构:

- 深度学习入门(3):vgg16

qq_776882262

深度学习人工智能

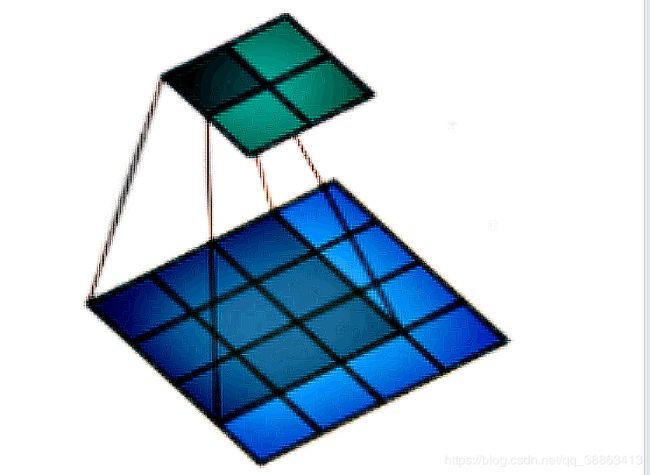

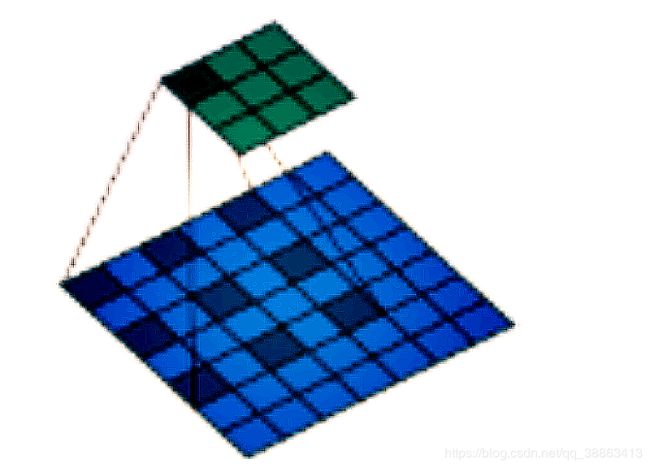

引言相比于alexnet,vgg16进一步优化了这个黑盒模型,用实验的方式证明了哪些模块有效,哪些模块对检测效果提升有限。奠基了卷积神经网络一些基础的模块。本文参考pytorch实战7:手把手教你基于pytorch实现VGG16_vgg16pytorch-CSDN博客,此处只做记录供本人复习记录。正文VGG16创新点:1.使用小卷积核堆叠代替大卷积核VGG16采用多个连续的3×3小卷积核堆叠,而不

- 深度学习入门:Python搭建简单神经网络模型

缑宇澄

python

在人工智能浪潮中,深度学习凭借强大的特征提取与模式识别能力成为核心技术,而神经网络则是深度学习的基石。从图像识别到自然语言处理,神经网络以独特的结构和学习机制,让计算机能够模拟人类大脑处理复杂信息的过程。本文将带领你从基础理论出发,使用Python和Keras库搭建一个简单的神经网络模型,开启深度学习的探索之旅。一、神经网络基础理论1.1神经元与网络结构神经网络的基本单元是人工神经元(又称节点或单

- 【大模型入门指南 10】大模型推理部署:vLLM和llama.cpp

青松ᵃⁱ

LLM入门系列llama

【大模型入门指南】系列文章:【大模型入门指南01】深度学习入门【大模型入门指南02】LLM大模型基础知识【大模型入门指南03】提示词工程【大模型入门指南04】Transformer结构【大模型入门指南05】LLM技术选型【大模型入门指南06】LLM数据预处理【大模型入门指南07】量化技术解析【大模型入门指南08】微调和分布式训练【大模型入门指南09】LLM和多模态模型高效推理实践【大模型入门指南1

- 深度学习入门:从零搭建你的第一个神经网络

layneyao

ai深度学习神经网络人工智能

深度学习入门:从零搭建你的第一个神经网络系统化学习人工智能网站(收藏):https://www.captainbed.cn/flu文章目录深度学习入门:从零搭建你的第一个神经网络摘要引言第一章:神经网络基础原理1.1神经元模型1.2反向传播算法1.3激活函数对比第二章:开发环境搭建指南2.1硬件要求2.2软件环境2.2.1Anaconda配置2.2.2PyTorch安装2.2.3TensorFlo

- 深度学习入门:如何从零开始搭建自己的深度学习模型?

AI天才研究院

Python实战自然语言处理人工智能语言模型编程实践开发语言架构设计

作者:禅与计算机程序设计艺术1.简介深度学习(DeepLearning)近几年已经成为人们关注的热点话题。从2012年的ImageNet竞赛开始,激起了众多研究者的兴趣,也带来了越来越多的应用场景。随着技术的飞速发展,深度学习已经成为了各个领域最具潜力的技术。作为一名AI科研工作者,了解、掌握深度学习相关知识可以帮助你更好地理解并解决实际问题。本文将全面介绍深度学习的基础知识、技术要点及其应用。文

- 第6篇:深度学习入门——神经网络基础

CarlowZJ

AI+Python深度学习神经网络人工智能

目录一、前言二、概念讲解(一)深度学习:人工智能皇冠上的明珠(二)神经网络:深度学习的微观世界三、神经网络的基本组件:构建智能的积木(一)神经元:智能的基本单元(二)权重与偏置:连接的智慧(三)激活函数:非线性的魔法(四)损失函数:衡量差距的标尺(五)优化器:攀登优化高峰的向导四、前向传播与反向传播:神经网络的智慧流转(一)前向传播:信息的逐层传递(二)反向传播:误差的逆向追溯五、代码示例:搭建你

- 【深度学习入门篇 ②】Pytorch完成线性回归!

小森( ﹡ˆoˆ﹡ )

深度学习入门篇线性回归算法回归

嗨,大家好,我是小森(﹡ˆoˆ﹡)!易编橙·终身成长社群创始团队嘉宾,橙似锦计划领衔成员、阿里云专家博主、腾讯云内容共创官、CSDN人工智能领域优质创作者。易编橙:一个帮助编程小伙伴少走弯路的终身成长社群!上一部分我们自己通过torch的方法完成反向传播和参数更新,在Pytorch中预设了一些更加灵活简单的对象,让我们来构造模型、定义损失,优化损失等;那么接下来,我们一起来了解一下其中常用的API

- day33 python深度学习入门

xiaohanbao09

pynotepython深度学习机器学习pandas人工智能学习

目录深度学习入门:PyTorch实现鸢尾花分类一、环境搭建1.创建Python环境2.安装必要的库3.检查CUDA环境二、数据准备1.加载数据集2.数据预处理3.转换为PyTorch张量三、模型构建1.定义模型结构2.定义损失函数和优化器四、模型训练1.训练过程2.训练结果五、结果可视化六、总结在深度学习的旅程中,神经网络是不可或缺的核心工具之一。今天,我将通过一个简单的项目,使用PyTorch框

- 遥感深度学习——基于deeplabv3+和GID数据集(1)

全域智图

深度学习人工智能

博主最近准备进行深度学习入门,因为是做遥感方向的,经过多重考虑,算法最后选择了deeplabv3+。DeepLabV3+是由谷歌提出的一种用于图像语义分割的深度学习模型。它在DeepLabV3的基础上,加入了编码器-解码器结构,以提高分割结果的边缘细节和空间分辨率。以下是DeepLabV3+的主要特点:编码器-解码器结构:编码器部分提取图像的高层次语义特征,解码器部分逐步恢复图像的空间细节,提高分

- 深度学习入门:从理论到实战的详细指南

人工智能教程

深度学习人工智能算法目标跟踪机器学习YOLO线性回归

的高效学习和理解。对于初学者来说,深度学习的学习曲线可能会显得有些陡峭,但只要掌握正确的方法和步骤,就能轻松入门。本文将为你提供一份从理论到实战的详细指南,帮助你快速掌握深度学习的核心要点。一、深度学习是什么?(一)定义深度学习是机器学习的一个子领域,它通过构建多层的神经网络来学习数据中的复杂模式。与传统的机器学习算法相比,深度学习能够自动提取数据的特征,而不需要人工设计复杂的特征工程。这种自动特

- 深度学习入门:基于 Python 的理论与实现笔记

u013244720

深度学习python笔记

深度学习入门:基于Python的理论与实现笔记在VSCode中运行代码替换库搜索路径#sys.path.append(os.pardir)#为了导入父目录而进行的设定sys.path.append(os.getcwd())替换文件路径#withopen("sample_weight.pkl",'rb')asf:withopen(os.getcwd()+"/ch03/sample_weight.pk

- pytorch深度学习入门(15)之-使用onnx模型量化

码农呆呆

深度学习人工智能pytorch深度学习python神经网络

量化ONNX模型内容量化概述ONNX量化表示格式量化ONNX模型基于变压器的模型Transformer基于变压器的模型GPU上的量化常问问题量化概述ONNX运行时中的量化是指ONNX模型的8位线性量化。在量化期间,浮点值被映射到以下形式的8位量化空间:val_fp32=scale*(val_quantized-zero_point)scale是一个正实数,用于将浮点数映射到量化空间。计算方法如下:

- 深度学习入门--基于Python的理论与实现--Python入门

语文天才高斯

python开发语言人工智能深度学习

第一章Python入门1.1Python是什么Python是一种高级编程语言,由GuidovanRossum于1989年创建,并在1991年正式发布。Python具有以下特点:易读易写:Python语法简洁,代码可读性强,使开发者能够更专注于问题本身。跨平台:Python可以在Windows、Linux和macOS上运行,具有良好的可移植性。丰富的库:Python生态系统中包含大量的第三方库,如N

- 【深度学习入门_NLP自然语言处理】序章

沉默的舞台剧

AI深度学习自然语言处理人工智能

本部分开始深度学习第二大部分NLP章节学习,找了好多资料,终于明确NLP的学习目标了,介于工作之余学习综合考量,还是决定以视频学习为主+后期自主实践为主吧。分享一个总图,其实在定位的时候很迷茫,单各章节领域其实都是很大的范畴,每个部分都是需要专精的,所以在做计划的时候很头大…千里之行始于足下吧,话不多数,直接上NLP的学习应用目标:学习教程的话参照B站实战结合的这个教程【2025NLP自然语言处理

- 具身智能零碎知识点(三):深入解析 “1D UNet”:结构、原理与实战

墨绿色的摆渡人

具身智能零碎知识点pytorch人工智能pythontransformer具身智能

深入解析“1DUNet”:结构、原理与实战【深度学习入门】1DUNet详解:结构、原理与实战指南一、1DUNet是什么?二、核心结构与功能1.整体架构2.编码器(Encoder)3.解码器(Decoder)4.跳跃连接(SkipConnection)5.瓶颈层(Bottleneck)三、数学原理与数值示例1.1D卷积运算2.编码-解码流程四、PyTorch代码实现1.完整模型代码2.使用示例五、实

- 使用Python学习AI的学习攻略

liushangzaibeijing

AI学习python学习人工智能

基于python的AI学习一、夯实基础二、数学基础三、机器学习基础四、深度学习入门五、进阶学习六、学习资源推荐七、实践项目一、夯实基础对于已经掌握Python基础语法的学习者来说,进一步利用Python学习AI需要夯实以下基础:变量和数据类型:包括整数、浮点数、字符串、列表、字典、元组等。条件语句和循环:熟练使用if-else语句和for、while循环。函数:理解函数的定义、调用以及参数传递。面

- 深度学习入门(三):神经网络的学习

WhyNot?

深度学习深度学习神经网络学习

文章目录前言人类思考VS机器学习VS深度学习基础术语损失函数常用的损失函数均方误差MSE(MeanSquareError)交叉熵误差(CrossEntropyError)mini-batch学习为何要设定损失函数数值微分神经网络学习算法的实现两层神经网络的类参考资料前言机器学习的过程通常分为学习(从训练数据中自动获取权重参数的过程)和推理(利用学习到的权重参数对新的数据进行预测)两个环节。本文将主

- 深度学习入门:从神经网络基础到简单实现

Evaporator Core

人工智能#深度学习Python开发经验深度学习神经网络人工智能

深度学习作为人工智能领域最令人兴奋的技术之一,已经在图像识别、自然语言处理、语音识别等多个领域取得了突破性进展。本文将深入浅出地介绍深度学习的基本概念,并通过Python代码实现一个简单的神经网络模型,帮助读者建立直观理解并迈出实践第一步。神经网络的基本原理神经网络的核心思想源自对人类大脑工作方式的简化模拟。想象一下,当你第一次学习骑自行车时,大脑会不断接收来自视觉、平衡感等多方面的信号,经过一系

- PyTorch深度学习入门与实战教程

openbiox

本文还有配套的精品资源,点击获取简介:深度学习是AI的核心技术,基于神经网络对数据建模以实现学习和预测。PyTorch是一个灵活易用的开源深度学习框架,适合初学者和研究人员进行实验开发。教程涵盖了从基础概念到模型训练、验证、测试的完整流程,包括张量操作、动态计算图、数据预处理、神经网络构建、优化器使用、训练循环、模型保存加载以及CNN和RNN等关键网络结构的应用实践。通过实例项目如文本分类、图像识

- AI入门书籍推荐

撬动未来的支点

深度学习深度学习人工智能

漫画机械学习入门((日)大关真之戴凤智张鸿涛孟宇(译))深度学习入门:基于Python的理论与实现深度学习的数学:使用Python语言[转换版]([美]罗纳德·T.纽塞尔)

- 手写数字识别(深度学习小实践)

我是来学习的你们要干什么

深度学习人工智能pycharmpython机器学习神经网络

小白学习ing文章目录前言一、神经网络学习与实践1.学习2.推理二、手写数字识别1、读入mnist数据集(学习)2、神经网络的推理改进→批处理前言非常简单的深度学习小实践,没有用框架,仅使用简单的Python。参考书籍《深度学习入门:基于Python的理论与实现》一、神经网络学习与实践1.学习训练数据进行权重参数的学习2.推理使用学习到的参数,对输入数据进行分类二、手写数字识别1、读入mnist数

- 计算机视觉深度学习入门(4)

yyc_audio

计算机视觉人工智能计算机视觉深度学习神经网络

在小型数据集上从头开始训练一个卷积神经网络利用少量数据来训练图像分类模型,这是一种很常见的情况。如果你从事与计算机视觉相关的职业,那么很可能会在实践中遇到这种情况。“少量”样本既可能是几百张图片,也可能是上万张图片。我们来看一个实例——猫狗图片分类,数据集包含5000张猫和狗的图片(2500张猫的图片,2500张狗的图片)。我们将2000张图片用于训练,1000张用于验证,2000张用于测试。将介

- Python第十六课:深度学习入门 | 神经网络解密

程之编

Python全栈通关秘籍python神经网络青少年编程

本节目标理解生物神经元与人工神经网络的映射关系掌握激活函数与损失函数的核心作用使用Keras构建手写数字识别模型可视化神经网络的训练过程掌握防止过拟合的基础策略一、神经网络基础(大脑的数字化仿生)1.神经元对比生物神经元人工神经元树突接收信号输入层接收特征数据细胞体整合信号加权求和(∑(权重×输入)+偏置)轴突传递电信号激活函数处理输出2.核心组件解析激活函数:神经元的"开关"(如ReLU:max

- 大模型学习路线与资源推荐

数字化转型2025

AI投资人工智能

以下是基于多篇参考资料整理的大模型学习路线,涵盖从基础到进阶的完整学习路径,帮助您系统掌握大模型核心技术并应用于实际场景:一、基础阶段:构建核心知识体系编程与数学基础编程语言:优先学习Python,掌握其语法、数据结构及常用库(如NumPy、Pandas、PyTorch)37。数学基础:线性代数、概率论与统计学、微积分是理解模型原理的基石,需重点掌握矩阵运算、概率分布等概念39。深度学习入门神经网

- 集合框架

天子之骄

java数据结构集合框架

集合框架

集合框架可以理解为一个容器,该容器主要指映射(map)、集合(set)、数组(array)和列表(list)等抽象数据结构。

从本质上来说,Java集合框架的主要组成是用来操作对象的接口。不同接口描述不同的数据类型。

简单介绍:

Collection接口是最基本的接口,它定义了List和Set,List又定义了LinkLi

- Table Driven(表驱动)方法实例

bijian1013

javaenumTable Driven表驱动

实例一:

/**

* 驾驶人年龄段

* 保险行业,会对驾驶人的年龄做年龄段的区分判断

* 驾驶人年龄段:01-[18,25);02-[25,30);03-[30-35);04-[35,40);05-[40,45);06-[45,50);07-[50-55);08-[55,+∞)

*/

public class AgePeriodTest {

//if...el

- Jquery 总结

cuishikuan

javajqueryAjaxWebjquery方法

1.$.trim方法用于移除字符串头部和尾部多余的空格。如:$.trim(' Hello ') // Hello2.$.contains方法返回一个布尔值,表示某个DOM元素(第二个参数)是否为另一个DOM元素(第一个参数)的下级元素。如:$.contains(document.documentElement, document.body); 3.$

- 面向对象概念的提出

麦田的设计者

java面向对象面向过程

面向对象中,一切都是由对象展开的,组织代码,封装数据。

在台湾面向对象被翻译为了面向物件编程,这充分说明了,这种编程强调实体。

下面就结合编程语言的发展史,聊一聊面向过程和面向对象。

c语言由贝尔实

- linux网口绑定

被触发

linux

刚在一台IBM Xserver服务器上装了RedHat Linux Enterprise AS 4,为了提高网络的可靠性配置双网卡绑定。

一、环境描述

我的RedHat Linux Enterprise AS 4安装双口的Intel千兆网卡,通过ifconfig -a命令看到eth0和eth1两张网卡。

二、双网卡绑定步骤:

2.1 修改/etc/sysconfig/network

- XML基础语法

肆无忌惮_

xml

一、什么是XML?

XML全称是Extensible Markup Language,可扩展标记语言。很类似HTML。XML的目的是传输数据而非显示数据。XML的标签没有被预定义,你需要自行定义标签。XML被设计为具有自我描述性。是W3C的推荐标准。

二、为什么学习XML?

用来解决程序间数据传输的格式问题

做配置文件

充当小型数据库

三、XML与HTM

- 为网页添加自己喜欢的字体

知了ing

字体 秒表 css

@font-face {

font-family: miaobiao;//定义字体名字

font-style: normal;

font-weight: 400;

src: url('font/DS-DIGI-e.eot');//字体文件

}

使用:

<label style="font-size:18px;font-famil

- redis范围查询应用-查找IP所在城市

矮蛋蛋

redis

原文地址:

http://www.tuicool.com/articles/BrURbqV

需求

根据IP找到对应的城市

原来的解决方案

oracle表(ip_country):

查询IP对应的城市:

1.把a.b.c.d这样格式的IP转为一个数字,例如为把210.21.224.34转为3524648994

2. select city from ip_

- 输入两个整数, 计算百分比

alleni123

java

public static String getPercent(int x, int total){

double result=(x*1.0)/(total*1.0);

System.out.println(result);

DecimalFormat df1=new DecimalFormat("0.0000%");

- 百合——————>怎么学习计算机语言

百合不是茶

java 移动开发

对于一个从没有接触过计算机语言的人来说,一上来就学面向对象,就算是心里上面接受的了,灵魂我觉得也应该是跟不上的,学不好是很正常的现象,计算机语言老师讲的再多,你在课堂上面跟着老师听的再多,我觉得你应该还是学不会的,最主要的原因是你根本没有想过该怎么来学习计算机编程语言,记得大一的时候金山网络公司在湖大招聘我们学校一个才来大学几天的被金山网络录取,一个刚到大学的就能够去和

- linux下tomcat开机自启动

bijian1013

tomcat

方法一:

修改Tomcat/bin/startup.sh 为:

export JAVA_HOME=/home/java1.6.0_27

export CLASSPATH=$CLASSPATH:$JAVA_HOME/lib/tools.jar:$JAVA_HOME/lib/dt.jar:.

export PATH=$JAVA_HOME/bin:$PATH

export CATALINA_H

- spring aop实例

bijian1013

javaspringAOP

1.AdviceMethods.java

package com.bijian.study.spring.aop.schema;

public class AdviceMethods {

public void preGreeting() {

System.out.println("--how are you!--");

}

}

2.beans.x

- [Gson八]GsonBuilder序列化和反序列化选项enableComplexMapKeySerialization

bit1129

serialization

enableComplexMapKeySerialization配置项的含义

Gson在序列化Map时,默认情况下,是调用Key的toString方法得到它的JSON字符串的Key,对于简单类型和字符串类型,这没有问题,但是对于复杂数据对象,如果对象没有覆写toString方法,那么默认的toString方法将得到这个对象的Hash地址。

GsonBuilder用于

- 【Spark九十一】Spark Streaming整合Kafka一些值得关注的问题

bit1129

Stream

包括Spark Streaming在内的实时计算数据可靠性指的是三种级别:

1. At most once,数据最多只能接受一次,有可能接收不到

2. At least once, 数据至少接受一次,有可能重复接收

3. Exactly once 数据保证被处理并且只被处理一次,

具体的多读几遍http://spark.apache.org/docs/lates

- shell脚本批量检测端口是否被占用脚本

ronin47

#!/bin/bash

cat ports |while read line

do#nc -z -w 10 $line

nc -z -w 2 $line 58422>/dev/null2>&1if[ $?-eq 0]then

echo $line:ok

else

echo $line:fail

fi

done

这里的ports 既可以是文件

- java-2.设计包含min函数的栈

bylijinnan

java

具体思路参见:http://zhedahht.blog.163.com/blog/static/25411174200712895228171/

import java.util.ArrayList;

import java.util.List;

public class MinStack {

//maybe we can use origin array rathe

- Netty源码学习-ChannelHandler

bylijinnan

javanetty

一般来说,“有状态”的ChannelHandler不应该是“共享”的,“无状态”的ChannelHandler则可“共享”

例如ObjectEncoder是“共享”的, 但 ObjectDecoder 不是

因为每一次调用decode方法时,可能数据未接收完全(incomplete),

它与上一次decode时接收到的数据“累计”起来才有可能是完整的数据,是“有状态”的

p

- java生成随机数

cngolon

java

方法一:

/**

* 生成随机数

* @author

[email protected]

* @return

*/

public synchronized static String getChargeSequenceNum(String pre){

StringBuffer sequenceNum = new StringBuffer();

Date dateTime = new D

- POI读写海量数据

ctrain

海量数据

import java.io.FileOutputStream;

import java.io.OutputStream;

import org.apache.poi.xssf.streaming.SXSSFRow;

import org.apache.poi.xssf.streaming.SXSSFSheet;

import org.apache.poi.xssf.streaming

- mysql 日期格式化date_format详细使用

daizj

mysqldate_format日期格式转换日期格式化

日期转换函数的详细使用说明

DATE_FORMAT(date,format) Formats the date value according to the format string. The following specifiers may be used in the format string. The&n

- 一个程序员分享8年的开发经验

dcj3sjt126com

程序员

在中国有很多人都认为IT行为是吃青春饭的,如果过了30岁就很难有机会再发展下去!其实现实并不是这样子的,在下从事.NET及JAVA方面的开发的也有8年的时间了,在这里在下想凭借自己的亲身经历,与大家一起探讨一下。

明确入行的目的

很多人干IT这一行都冲着“收入高”这一点的,因为只要学会一点HTML, DIV+CSS,要做一个页面开发人员并不是一件难事,而且做一个页面开发人员更容

- android欢迎界面淡入淡出效果

dcj3sjt126com

android

很多Android应用一开始都会有一个欢迎界面,淡入淡出效果也是用得非常多的,下面来实现一下。

主要代码如下:

package com.myaibang.activity;

import android.app.Activity;import android.content.Intent;import android.os.Bundle;import android.os.CountDown

- linux 复习笔记之常见压缩命令

eksliang

tar解压linux系统常见压缩命令linux压缩命令tar压缩

转载请出自出处:http://eksliang.iteye.com/blog/2109693

linux中常见压缩文件的拓展名

*.gz gzip程序压缩的文件

*.bz2 bzip程序压缩的文件

*.tar tar程序打包的数据,没有经过压缩

*.tar.gz tar程序打包后,并经过gzip程序压缩

*.tar.bz2 tar程序打包后,并经过bzip程序压缩

*.zi

- Android 应用程序发送shell命令

gqdy365

android

项目中需要直接在APP中通过发送shell指令来控制lcd灯,其实按理说应该是方案公司在调好lcd灯驱动之后直接通过service送接口上来给APP,APP调用就可以控制了,这是正规流程,但我们项目的方案商用的mtk方案,方案公司又没人会改,只调好了驱动,让应用程序自己实现灯的控制,这不蛋疼嘛!!!!

发就发吧!

一、关于shell指令:

我们知道,shell指令是Linux里面带的

- java 无损读取文本文件

hw1287789687

读取文件无损读取读取文本文件charset

java 如何无损读取文本文件呢?

以下是有损的

@Deprecated

public static String getFullContent(File file, String charset) {

BufferedReader reader = null;

if (!file.exists()) {

System.out.println("getFull

- Firebase 相关文章索引

justjavac

firebase

Awesome Firebase

最近谷歌收购Firebase的新闻又将Firebase拉入了人们的视野,于是我做了这个 github 项目。

Firebase 是一个数据同步的云服务,不同于 Dropbox 的「文件」,Firebase 同步的是「数据」,服务对象是网站开发者,帮助他们开发具有「实时」(Real-Time)特性的应用。

开发者只需引用一个 API 库文件就可以使用标准 RE

- C++学习重点

lx.asymmetric

C++笔记

1.c++面向对象的三个特性:封装性,继承性以及多态性。

2.标识符的命名规则:由字母和下划线开头,同时由字母、数字或下划线组成;不能与系统关键字重名。

3.c++语言常量包括整型常量、浮点型常量、布尔常量、字符型常量和字符串性常量。

4.运算符按其功能开以分为六类:算术运算符、位运算符、关系运算符、逻辑运算符、赋值运算符和条件运算符。

&n

- java bean和xml相互转换

q821424508

javabeanxmlxml和bean转换java bean和xml转换

这几天在做微信公众号

做的过程中想找个java bean转xml的工具,找了几个用着不知道是配置不好还是怎么回事,都会有一些问题,

然后脑子一热谢了一个javabean和xml的转换的工具里,自己用着还行,虽然有一些约束吧 ,

还是贴出来记录一下

顺便你提一下下,这个转换工具支持属性为集合、数组和非基本属性的对象。

packag

- C 语言初级 位运算

1140566087

位运算c

第十章 位运算 1、位运算对象只能是整形或字符型数据,在VC6.0中int型数据占4个字节 2、位运算符: 运算符 作用 ~ 按位求反 << 左移 >> 右移 & 按位与 ^ 按位异或 | 按位或 他们的优先级从高到低; 3、位运算符的运算功能: a、按位取反: ~01001101 = 101

- 14点睛Spring4.1-脚本编程

wiselyman

spring4

14.1 Scripting脚本编程

脚本语言和java这类静态的语言的主要区别是:脚本语言无需编译,源码直接可运行;

如果我们经常需要修改的某些代码,每一次我们至少要进行编译,打包,重新部署的操作,步骤相当麻烦;

如果我们的应用不允许重启,这在现实的情况中也是很常见的;

在spring中使用脚本编程给上述的应用场景提供了解决方案,即动态加载bean;

spring支持脚本