- 推荐算法_隐语义-梯度下降

_feivirus_

算法机器学习和数学推荐算法机器学习隐语义

importnumpyasnp1.模型实现"""inputrate_matrix:M行N列的评分矩阵,值为P*Q.P:初始化用户特征矩阵M*K.Q:初始化物品特征矩阵K*N.latent_feature_cnt:隐特征的向量个数max_iteration:最大迭代次数alpha:步长lamda:正则化系数output分解之后的P和Q"""defLFM_grad_desc(rate_matrix,l

- 吴恩达深度学习笔记(30)-正则化的解释

极客Array

正则化(Regularization)深度学习可能存在过拟合问题——高方差,有两个解决方法,一个是正则化,另一个是准备更多的数据,这是非常可靠的方法,但你可能无法时时刻刻准备足够多的训练数据或者获取更多数据的成本很高,但正则化通常有助于避免过拟合或减少你的网络误差。如果你怀疑神经网络过度拟合了数据,即存在高方差问题,那么最先想到的方法可能是正则化,另一个解决高方差的方法就是准备更多数据,这也是非常

- 七.正则化

愿风去了

吴恩达机器学习之正则化(Regularization)http://www.cnblogs.com/jianxinzhou/p/4083921.html从数学公式上理解L1和L2https://blog.csdn.net/b876144622/article/details/81276818虽然在线性回归中加入基函数会使模型更加灵活,但是很容易引起数据的过拟合。例如将数据投影到30维的基函数上,模

- 【04】深度学习——训练的常见问题 | 过拟合欠拟合应对策略 | 过拟合欠拟合示例 | 正则化 | Dropout方法 | Dropout的代码实现 | 梯度消失和爆炸 | 模型文件的读写

花落指尖❀

#深度学习深度学习人工智能目标检测神经网络cnn

深度学习1.常见的分类问题1.1模型架构设计1.2万能近似定理1.3宽度or深度1.4过拟合问题1.5欠拟合问题1.6相互关系2.过拟合欠拟合应对策略2.1问题的本源2.2数据集大小的选择2.3数据增广2.4使用验证集2.5模型选择2.6K折交叉验证2.7提前终止3.过拟合欠拟合示例3.1导入库3.2数据生成3.3数据划分3.4模型定义3.5辅助函数3.6可视化4.正则化4.1深度学习中的正则化4

- 深度学习算法,该如何深入,举例说明

liyy614

深度学习

深度学习算法的深入学习可以从理论和实践两个方面进行。理论上,深入理解深度学习需要掌握数学基础(如线性代数、概率论、微积分)、机器学习基础和深度学习框架原理。实践上,可以通过实现和优化深度学习模型来提升技能。理论深入数学基础线性代数:理解向量、矩阵、特征值和特征向量等,对于理解神经网络的权重和偏置矩阵至关重要。概率论:用于理解模型的不确定性,如Dropout等正则化技术。微积分:理解梯度下降等优化算

- 6. 深度学习中的正则化技术:防止过拟合

Network_Engineer

机器学习深度学习人工智能

引言过拟合是深度学习模型在训练过程中常遇到的挑战。过拟合会导致模型在训练数据上表现良好,但在新数据上表现不佳。为了防止过拟合,研究者们提出了多种正则化技术,如L1/L2正则化、Dropout、数据增强等。这些技术通过约束模型的复杂度或增加数据的多样性,有效提高了模型的泛化能力。本篇博文将深入探讨这些正则化技术的原理、应用及其在实际深度学习任务中的效果。1.过拟合的原因与影响过拟合通常发生在模型的复

- 3.关于Detr

安逸sgr

Transformer计算机视觉目标检测transformer

关于Detr模型架构总体架构classTransformer(nn.Module):def__init__(self,d_model=512,nhead=8,num_encoder_layers=6,num_decoder_layers=6,dim_feedforward=2048,dropout=0.1,activation="relu",normalize_before=False,retur

- python奇数平方和_平方和

weixin_39807352

python奇数平方和

平方和误差和最大后验2020-12-2119:32:19多项式曲线拟合问题中的最大后验与最小化正则和平方和误差之间的关系简单证明多项式回归的最大后验等价于最小正则化和平方和误差;主要内容:多项式回归高斯分布贝叶斯定理对数函数计算1.简单回顾一下多项式回归y组合模型方法2020-12-0813:01:57不同的定性预测模型方法或定量预测模型方法各有其优点和缺点,它们之间并不是相互排斥的,而是相互联系

- 2-83 基于matlab的自适应正则化核的模糊均值聚类框架(ARKFCM)

'Matlab学习与应用

matlab工程应用算法matlab均值算法自适应正则化核模糊均值聚类框架脑磁共振图像的分割

基于matlab的自适应正则化核的模糊均值聚类框架(ARKFCM),用于脑磁共振图像的分割。该框架采用三种算法,分别平均滤波器、中值滤波器和设计的加权图像的灰度来代替局部平均灰度。利用邻域中灰度的异质性获取局部信息,并用高斯径向基核函数替换标准欧几里德距离。程序已调通,可直接运行。2-83脑磁共振图像的分割-小红书(xiaohongshu.com)

- 机器学习算法深度总结(5)-逻辑回归

婉妃

1.模型定义逻辑回归属于基于概率分类的学习法.基于概率的模式识别是指对模式x所对应的类别y的后验概率禁行学习.其所属类别为后验概率最大时的类别:预测类别的后验概率,可理解为模式x所属类别y的可信度.逻辑回归(logistic),使用线性对数函数对分类后验概率进行模型化:上式,分母是满足概率总和为1的约束条件的正则化项,参数向量维数为:考虑二分类问题:使用上述关系式,logistic模型的参数个数从

- 回归预测|基于北方苍鹰优化正则化极限学习机的数据预测Matlab程序NGO-RELM 多特征输入单输出

机器不会学习CL

智能优化算法回归预测回归matlab数据挖掘

回归预测|基于北方苍鹰优化正则化极限学习机的数据预测Matlab程序NGO-RELM多特征输入单输出文章目录一、基本原理1.北方苍鹰优化算法(NGO)2.正则化极限学习机(RELM)3.NGO-RELM回归预测流程二、实验结果三、核心代码四、代码获取五、总结回归预测|基于北方苍鹰优化正则化极限学习机的数据预测Matlab程序NGO-RELM多特征输入单输出一、基本原理NGO-RELM回归预测结合了

- 24.8.26学习心得

kkkkk021106

人工智能

验证数据集(ValidationSet)和测试数据集(TestSet)在机器学习和深度学习中都是非常重要的概念。它们各自有不同的用途和目的。下面详细解释两者之间的区别:1.验证数据集(ValidationSet)目的:超参数调整:验证数据集主要用于调整模型的超参数,如学习率、正则化系数、网络层数等。模型选择:用于选择最佳模型。例如,在交叉验证中,通过在验证数据集上的表现来选择性能最好的模型。防止过

- 【机器学习】特征工程的基本概念以及LASSO回归和主成分分析优化方法

Lossya

机器学习回归人工智能算法特征工程

引言特征工程是机器学习中的一个关键步骤,它涉及到从原始数据中提取和构造新的特征,以提高模型的性能和预测能力LASSO(LeastAbsoluteShrinkageandSelectionOperator)回归是一种用于回归分析的线性模型,它通过引入L1正则化(Lasso正则化)来简化模型并减少过拟合的风险主成分分析(PrincipalComponentAnalysis,PCA)是一种常用的降维技术

- Logistic 回归

零 度°

机器学习回归数据挖掘人工智能

文章目录1.引言2.Logistic回归概述2.1定义与应用场景2.2与线性回归的区别3.原理与数学基础3.1Sigmoid函数3.2概率解释3.3极大似然估计4.模型建立4.1假设函数4.2成本函数4.3梯度下降法5.正则化5.1正则化的目的与类型5.1.1正则化的目的5.1.2正则化的类型5.2L1和L2正则化5.2.1L1正则化5.2.2L2正则化6.多分类问题6.1一对多(OvA)6.2一

- PyTorch踩坑记录1

普通攻击往后拉

troch陶器神经网络基础模型关键点pytorch人工智能python

1model.eval()无法关闭dropout因为model.eval()控制self.training参数,只有用nn.Dropout(0.5)声明才能在调用model.eval()后关闭,用F.dropout(x,p=0.5)是没办法自动关闭的,需要手动把self.training的参数传入到F.dropout()里才行。网上查到是因为model.eval()会影响继承nn.module类的

- Python中的惩罚分析:理论与实践指南

theskylife

数据分析python开发语言数据分析数据挖掘机器学习

目录写在开头1.理论基础1.1优化问题与约束条件简介1.2什么是惩罚分析1.3惩罚分析的应用场景1.4惩罚方法的类型2.惩罚分析在Python中的实现2.1实现代码示例2.2未加惩罚的模型2.3加惩罚的模型(L1和L2正则化)2.4选择合适的惩罚方法与调整强度2.5惩罚过程改善过拟合问题2.6性能评估3.高级应用:自定义惩罚分析3.1设计自定义惩罚项的依据3.2实现自定义惩罚项的代码示例3.3如何

- 岭回归算法

码银

回归数据挖掘人工智能

回归分析方法是利用数理统计方法分析数据,建立自变量和因变量间的回归模型,用于预测因变量变化的分析方法。其中比较经典的是HoerI和Kennard提出的岭回归算法。岭回归算法是在最小二乘法的基础上引|入正则项,使回归模型具有较好泛化能力和稳定性,但岭回归算法并不能处理自变量间非线性相关的情况。岭回归,又称脊回归,是对不适定问题进行回归分析时经常使用的一种正则化方法,是对最小二乘回归的一种补充,岭回归

- 挑战杯 基于机器学习与大数据的糖尿病预测

laafeer

python

文章目录1前言1课题背景2数据导入处理3数据可视化分析4特征选择4.1通过相关性进行筛选4.2多重共线性4.3RFE(递归特征消除法)4.4正则化5机器学习模型建立与评价5.1评价方式的选择5.2模型的建立与评价5.3模型参数调优5.4将调参过后的模型重新进行训练并与原模型比较6总结1前言优质竞赛项目系列,今天要分享的是基于机器学习与大数据的糖尿病预测该项目较为新颖,适合作为竞赛课题方向,学长非常

- 【机器学习基础】正则化

为梦而生~

机器学习机器学习人工智能

个人主页:为梦而生~关注我一起学习吧!专栏:机器学习欢迎订阅!后面的内容会越来越有意思~⭐特别提醒:针对机器学习,特别开始专栏:机器学习python实战欢迎订阅!本专栏针对机器学习基础专栏的理论知识,利用python代码进行实际展示,真正做到从基础到实战!往期推荐:【机器学习基础】机器学习入门(1)【机器学习基础】机器学习入门(2)【机器学习基础】机器学习的基本术语【机器学习基础】机器学习的模型评

- 【机器学习】多元线性回归

Mount256

#机器学习机器学习线性回归人工智能

文章目录多元线性回归模型(multipleregressionmodel)损失/代价函数(costfunction)——均方误差(meansquarederror)批量梯度下降算法(batchgradientdescentalgorithm)特征工程(featureengineering)特征缩放(featurescaling)正则化线性回归(regularizationlinearregress

- 吴恩达机器学习全课程笔记第二篇

亿维数组

MachineLearning机器学习笔记人工智能学习

目录前言P31-P33logistics(逻辑)回归决策边界P34-P36逻辑回归的代价函数梯度下降的实现P37-P41过拟合问题正则化代价函数正则化线性回归正则化logistics回归前言这是吴恩达机器学习笔记的第二篇,第一篇笔记请见:吴恩达机器学习全课程笔记第一篇完整的课程链接如下:吴恩达机器学习教程(bilibili)推荐网站:scikit-learn中文社区吴恩达机器学习学习资料(gith

- 无法收敛问题

yizone

1、权重的初始化方案有问题2、正则化过度3、选择不合适的激活函数、损失函数4、选择了不合适的优化器和学习速率5、训练epoch不足

- 论文阅读 - Non-Local Spatial Propagation Network for Depth Completion

七元权

论文阅读论文阅读深度图补全NLSPNSPN深度学习

文章目录1概述2模型说明2.1局部SPN2.2非局部SPN2.3结合置信度的亲和力学习2.3.1传统正则化2.3.2置信度引导的affinity正则化3效果3.1NYUDepthV23.2KITTIDepthCompletion参考资料1概述本文提出了一种非局部的空间传播网络用于深度图补全,简称为NLSPN。(1)为什么需要深度图补全?在AR、无人机控制、自动驾驶和运动规划等应用当中,需要知道物体

- 【天幕系列 03】深度学习领域的最新前沿:2024年的关键突破与趋势

浅夏的猫

随笔热门话题java大数据人工智能深度学习ai

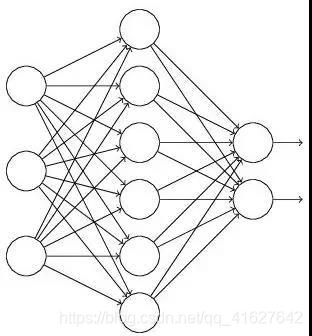

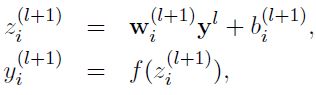

文章目录导言01深度学习的基本原理和算法1.1神经网络(NeuralNetworks)1.2前馈神经网络(FeedforwardNeuralNetwork)1.3反向传播算法(Backpropagation)1.4激活函数(ActivationFunction)1.5深度神经网络(DeepNeuralNetworks)1.7优化算法1.8正则化1.9批量训练(BatchTraining)02深度学

- PyTorch使用Tricks:Dropout,R-Dropout和Multi-Sample Dropout等 !!

JOYCE_Leo16

计算机视觉pytorch人工智能python深度学习神经网络

文章目录1、为什么使用Dropout?2、Dropout的拓展1:R-Dropout3、Dropout的拓展2:Multi-SampleDropout4、Dropout的拓展3:DropConnect5、Dropout的拓展4:Standout6、Dropout的拓展5:GaussianDropout1、为什么使用Dropout?Dropout是一种在神经网络训练过程中用于防止过拟合的技术。在训练

- 一文带你了解单细胞数据基因集打分的所有算法

生信宝库

上一周Immugent写了一篇一文解决单细胞亚群注释的所有问题,引出了单细胞测序技术的面临的几大未解决的技术难题,其中最主要的一个问题就是由于测序深度不足产生的"dropout"现象。这使得很多情况下所见非所得,傻傻分不清有些基因表达量很低,是因为没有测到还是本身没有表达。对于这种现象很多研究者给出了自己的解决方法,其中最主要的一大类就是通过对包含多个基因的基因集综合打分来评估细胞的某一项功能,比

- (2024|ICLR,SVD,软加权正则化,推理时文本嵌入优化)文本到图像扩散模型的图像内容抑制

EDPJ

论文笔记人工智能

GetWhatYouWant,NotWhatYouDon't-ImageContentSuppressionforText-to-ImageDiffusionModels公和众和号:EDPJ(进Q交流群:922230617或加VX:CV_EDPJ进V交流群)目录0.摘要2.相关工作3.方法3.1扩散模型3.2[EOT]嵌入的分析3.3基于文本嵌入的语义抑制3.4推理时文本嵌入优化4.实验5.局限性

- Matlab|基于支持向量机的电力短期负荷预测【最小二乘、标准粒子群、改进粒子群】

电力程序小学童

机器预测matlab支持向量机leetcode

目录主要内容部分代码结果一览下载链接主要内容该程序主要是对电力短期负荷进行预测,采用三种方法,分别是最小二乘支持向量机(LSSVM)、标准粒子群算法支持向量机和改进粒子群算法支持向量机三种方法对负荷进行预测,有详实的文档资料,程序注释清楚,方便学习!部分代码%C为最小二乘支持向量机的正则化参数,theta为高斯径向基的核函数参数,两个需要进行优化选择调试NumOfPre=1;%预测天数,在此预测本

- scIMC:scRNA-seq插补方法基准

tzc_fly

单细胞多组学分析人工智能

在scRNA-seq中一个主要的挑战即为“dropout”事件,它扭曲了基因表达,显著影响了单细胞转录组的下游分析。为了解决这个问题,已经做了很多努力,并开发了几种基于模型和基于深度学习的scRNA-seq插补方法。但是,目前还缺乏对现有方法进行全面、系统的比较。在这项工作中,作者使用6个模拟和2个真实的scRNA-seq数据集,从以下四个方面全面评估和比较了总共12种可用的插补方法:1.基因表达

- R语言群组变量选择、组惩罚group lasso套索模型预测分析新生儿出生体重风险因素数据和交叉验证、可视化

数据挖掘深度学习人工智能算法

原文链接:http://tecdat.cn/?p=25158原文出处:拓端数据部落公众号本文拟合具有分组惩罚的线性回归、GLM和Cox回归模型的正则化路径。这包括组选择方法,如组lasso套索、组MCP和组SCAD,以及双级选择方法,如组指数lasso、组MCP。还提供了进行交叉验证以及拟合后可视化、总结和预测的实用程序。本文提供了一些数据集的例子;涉及识别与低出生体重有关的风险因素。结果是连续测

- Java常用排序算法/程序员必须掌握的8大排序算法

cugfy

java

分类:

1)插入排序(直接插入排序、希尔排序)

2)交换排序(冒泡排序、快速排序)

3)选择排序(直接选择排序、堆排序)

4)归并排序

5)分配排序(基数排序)

所需辅助空间最多:归并排序

所需辅助空间最少:堆排序

平均速度最快:快速排序

不稳定:快速排序,希尔排序,堆排序。

先来看看8种排序之间的关系:

1.直接插入排序

(1

- 【Spark102】Spark存储模块BlockManager剖析

bit1129

manager

Spark围绕着BlockManager构建了存储模块,包括RDD,Shuffle,Broadcast的存储都使用了BlockManager。而BlockManager在实现上是一个针对每个应用的Master/Executor结构,即Driver上BlockManager充当了Master角色,而各个Slave上(具体到应用范围,就是Executor)的BlockManager充当了Slave角色

- linux 查看端口被占用情况详解

daizj

linux端口占用netstatlsof

经常在启动一个程序会碰到端口被占用,这里讲一下怎么查看端口是否被占用,及哪个程序占用,怎么Kill掉已占用端口的程序

1、lsof -i:port

port为端口号

[root@slave /data/spark-1.4.0-bin-cdh4]# lsof -i:8080

COMMAND PID USER FD TY

- Hosts文件使用

周凡杨

hostslocahost

一切都要从localhost说起,经常在tomcat容器起动后,访问页面时输入http://localhost:8088/index.jsp,大家都知道localhost代表本机地址,如果本机IP是10.10.134.21,那就相当于http://10.10.134.21:8088/index.jsp,有时候也会看到http: 127.0.0.1:

- java excel工具

g21121

Java excel

直接上代码,一看就懂,利用的是jxl:

import java.io.File;

import java.io.IOException;

import jxl.Cell;

import jxl.Sheet;

import jxl.Workbook;

import jxl.read.biff.BiffException;

import jxl.write.Label;

import

- web报表工具finereport常用函数的用法总结(数组函数)

老A不折腾

finereportweb报表函数总结

ADD2ARRAY

ADDARRAY(array,insertArray, start):在数组第start个位置插入insertArray中的所有元素,再返回该数组。

示例:

ADDARRAY([3,4, 1, 5, 7], [23, 43, 22], 3)返回[3, 4, 23, 43, 22, 1, 5, 7].

ADDARRAY([3,4, 1, 5, 7], "测试&q

- 游戏服务器网络带宽负载计算

墙头上一根草

服务器

家庭所安装的4M,8M宽带。其中M是指,Mbits/S

其中要提前说明的是:

8bits = 1Byte

即8位等于1字节。我们硬盘大小50G。意思是50*1024M字节,约为 50000多字节。但是网宽是以“位”为单位的,所以,8Mbits就是1M字节。是容积体积的单位。

8Mbits/s后面的S是秒。8Mbits/s意思是 每秒8M位,即每秒1M字节。

我是在计算我们网络流量时想到的

- 我的spring学习笔记2-IoC(反向控制 依赖注入)

aijuans

Spring 3 系列

IoC(反向控制 依赖注入)这是Spring提出来了,这也是Spring一大特色。这里我不用多说,我们看Spring教程就可以了解。当然我们不用Spring也可以用IoC,下面我将介绍不用Spring的IoC。

IoC不是框架,她是java的技术,如今大多数轻量级的容器都会用到IoC技术。这里我就用一个例子来说明:

如:程序中有 Mysql.calss 、Oracle.class 、SqlSe

- 高性能mysql 之 选择存储引擎(一)

annan211

mysqlInnoDBMySQL引擎存储引擎

1 没有特殊情况,应尽可能使用InnoDB存储引擎。 原因:InnoDB 和 MYIsAM 是mysql 最常用、使用最普遍的存储引擎。其中InnoDB是最重要、最广泛的存储引擎。她 被设计用来处理大量的短期事务。短期事务大部分情况下是正常提交的,很少有回滚的情况。InnoDB的性能和自动崩溃 恢复特性使得她在非事务型存储的需求中也非常流行,除非有非常

- UDP网络编程

百合不是茶

UDP编程局域网组播

UDP是基于无连接的,不可靠的传输 与TCP/IP相反

UDP实现私聊,发送方式客户端,接受方式服务器

package netUDP_sc;

import java.net.DatagramPacket;

import java.net.DatagramSocket;

import java.net.Ine

- JQuery对象的val()方法执行结果分析

bijian1013

JavaScriptjsjquery

JavaScript中,如果id对应的标签不存在(同理JAVA中,如果对象不存在),则调用它的方法会报错或抛异常。在实际开发中,发现JQuery在id对应的标签不存在时,调其val()方法不会报错,结果是undefined。

- http请求测试实例(采用json-lib解析)

bijian1013

jsonhttp

由于fastjson只支持JDK1.5版本,因些对于JDK1.4的项目,可以采用json-lib来解析JSON数据。如下是http请求的另外一种写法,仅供参考。

package com;

import java.util.HashMap;

import java.util.Map;

import

- 【RPC框架Hessian四】Hessian与Spring集成

bit1129

hessian

在【RPC框架Hessian二】Hessian 对象序列化和反序列化一文中介绍了基于Hessian的RPC服务的实现步骤,在那里使用Hessian提供的API完成基于Hessian的RPC服务开发和客户端调用,本文使用Spring对Hessian的集成来实现Hessian的RPC调用。

定义模型、接口和服务器端代码

|---Model

&nb

- 【Mahout三】基于Mahout CBayes算法的20newsgroup流程分析

bit1129

Mahout

1.Mahout环境搭建

1.下载Mahout

http://mirror.bit.edu.cn/apache/mahout/0.10.0/mahout-distribution-0.10.0.tar.gz

2.解压Mahout

3. 配置环境变量

vim /etc/profile

export HADOOP_HOME=/home

- nginx负载tomcat遇非80时的转发问题

ronin47

nginx负载后端容器是tomcat(其它容器如WAS,JBOSS暂没发现这个问题)非80端口,遇到跳转异常问题。解决的思路是:$host:port

详细如下:

该问题是最先发现的,由于之前对nginx不是特别的熟悉所以该问题是个入门级别的:

? 1 2 3 4 5

- java-17-在一个字符串中找到第一个只出现一次的字符

bylijinnan

java

public class FirstShowOnlyOnceElement {

/**Q17.在一个字符串中找到第一个只出现一次的字符。如输入abaccdeff,则输出b

* 1.int[] count:count[i]表示i对应字符出现的次数

* 2.将26个英文字母映射:a-z <--> 0-25

* 3.假设全部字母都是小写

*/

pu

- mongoDB 复制集

开窍的石头

mongodb

mongo的复制集就像mysql的主从数据库,当你往其中的主复制集(primary)写数据的时候,副复制集(secondary)会自动同步主复制集(Primary)的数据,当主复制集挂掉以后其中的一个副复制集会自动成为主复制集。提供服务器的可用性。和防止当机问题

mo

- [宇宙与天文]宇宙时代的经济学

comsci

经济

宇宙尺度的交通工具一般都体型巨大,造价高昂。。。。。

在宇宙中进行航行,近程采用反作用力类型的发动机,需要消耗少量矿石燃料,中远程航行要采用量子或者聚变反应堆发动机,进行超空间跳跃,要消耗大量高纯度水晶体能源

以目前地球上国家的经济发展水平来讲,

- Git忽略文件

Cwind

git

有很多文件不必使用git管理。例如Eclipse或其他IDE生成的项目文件,编译生成的各种目标或临时文件等。使用git status时,会在Untracked files里面看到这些文件列表,在一次需要添加的文件比较多时(使用git add . / git add -u),会把这些所有的未跟踪文件添加进索引。

==== ==== ==== 一些牢骚

- MySQL连接数据库的必须配置

dashuaifu

mysql连接数据库配置

MySQL连接数据库的必须配置

1.driverClass:com.mysql.jdbc.Driver

2.jdbcUrl:jdbc:mysql://localhost:3306/dbname

3.user:username

4.password:password

其中1是驱动名;2是url,这里的‘dbna

- 一生要养成的60个习惯

dcj3sjt126com

习惯

一生要养成的60个习惯

第1篇 让你更受大家欢迎的习惯

1 守时,不准时赴约,让别人等,会失去很多机会。

如何做到:

①该起床时就起床,

②养成任何事情都提前15分钟的习惯。

③带本可以随时阅读的书,如果早了就拿出来读读。

④有条理,生活没条理最容易耽误时间。

⑤提前计划:将重要和不重要的事情岔开。

⑥今天就准备好明天要穿的衣服。

⑦按时睡觉,这会让按时起床更容易。

2 注重

- [介绍]Yii 是什么

dcj3sjt126com

PHPyii2

Yii 是一个高性能,基于组件的 PHP 框架,用于快速开发现代 Web 应用程序。名字 Yii (读作 易)在中文里有“极致简单与不断演变”两重含义,也可看作 Yes It Is! 的缩写。

Yii 最适合做什么?

Yii 是一个通用的 Web 编程框架,即可以用于开发各种用 PHP 构建的 Web 应用。因为基于组件的框架结构和设计精巧的缓存支持,它特别适合开发大型应

- Linux SSH常用总结

eksliang

linux sshSSHD

转载请出自出处:http://eksliang.iteye.com/blog/2186931 一、连接到远程主机

格式:

ssh name@remoteserver

例如:

ssh

[email protected]

二、连接到远程主机指定的端口

格式:

ssh name@remoteserver -p 22

例如:

ssh i

- 快速上传头像到服务端工具类FaceUtil

gundumw100

android

快速迭代用

import java.io.DataOutputStream;

import java.io.File;

import java.io.FileInputStream;

import java.io.FileNotFoundException;

import java.io.FileOutputStream;

import java.io.IOExceptio

- jQuery入门之怎么使用

ini

JavaScripthtmljqueryWebcss

jQuery的强大我何问起(个人主页:hovertree.com)就不用多说了,那么怎么使用jQuery呢?

首先,下载jquery。下载地址:http://hovertree.com/hvtart/bjae/b8627323101a4994.htm,一个是压缩版本,一个是未压缩版本,如果在开发测试阶段,可以使用未压缩版本,实际应用一般使用压缩版本(min)。然后就在页面上引用。

- 带filter的hbase查询优化

kane_xie

查询优化hbaseRandomRowFilter

问题描述

hbase scan数据缓慢,server端出现LeaseException。hbase写入缓慢。

问题原因

直接原因是: hbase client端每次和regionserver交互的时候,都会在服务器端生成一个Lease,Lease的有效期由参数hbase.regionserver.lease.period确定。如果hbase scan需

- java设计模式-单例模式

men4661273

java单例枚举反射IOC

单例模式1,饿汉模式

//饿汉式单例类.在类初始化时,已经自行实例化

public class Singleton1 {

//私有的默认构造函数

private Singleton1() {}

//已经自行实例化

private static final Singleton1 singl

- mongodb 查询某一天所有信息的3种方法,根据日期查询

qiaolevip

每天进步一点点学习永无止境mongodb纵观千象

// mongodb的查询真让人难以琢磨,就查询单天信息,都需要花费一番功夫才行。

// 第一种方式:

coll.aggregate([

{$project:{sendDate: {$substr: ['$sendTime', 0, 10]}, sendTime: 1, content:1}},

{$match:{sendDate: '2015-

- 二维数组转换成JSON

tangqi609567707

java二维数组json

原文出处:http://blog.csdn.net/springsen/article/details/7833596

public class Demo {

public static void main(String[] args) { String[][] blogL

- erlang supervisor

wudixiaotie

erlang

定义supervisor时,如果是监控celuesimple_one_for_one则删除children的时候就用supervisor:terminate_child (SupModuleName, ChildPid),如果shutdown策略选择的是brutal_kill,那么supervisor会调用exit(ChildPid, kill),这样的话如果Child的behavior是gen_