Quaternion Knowledge Graph Embeddings

Quaternion Knowledge Graph Embeddings. NeurIPS 2019.

https://github.com/cheungdaven/QuatE

摘要

在这篇文章中,我们越过传统的复数表示方法,介绍了超复杂表示方法以对知识图嵌入式的实体和关系进行建模表征。更具体地,我们使用一种超参数值表征的嵌入式方法,具有三个虚部的四元数嵌入式,对实体进行表征。所提出方法的优越性在于:(1)潜在的内部依赖关系可以通过哈密尔顿乘积捕捉到,进行更简洁的实体和关系的关系建模。(2)四元数空间中的旋转表示比在普通复平面中旋转更加自由。(3)所提出框架在超复杂空间中提供了更几何意义的表征,满足了关系表征学习中的主要需求。通过实验结果证实了我们的模型在四个知识图谱benchmark上可以达到sota的结果。

Task

知识图谱embedding表征方法。目前知识图谱不仅能够进行有效的关系推理,还可以学习结构化表征。但是复杂的知识图谱预测实体间的缺失边时,多使用低维表征学习方法。

Benchmarks

WN18,FB15K,WN18RR,FB15K-237.

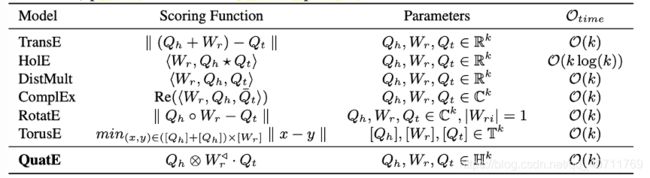

之前的方法

使用一个正方形矩阵表征每个关系,使用对角阵表征以减少复杂芏,使用双线性方法对嵌入式进行表征,使用循环相关性捕捉联系等。有了深度学习后,主要是用CNN,图卷积网络GCN,深度记忆网络memory networks 等解决。但现在进步后:四元数表征能够使能头实体和尾实体之间的丰富语义关系,能够完成集合旋转,而不仅仅是一个平面的旋转,能够完成语义匹配,而不仅仅是一个翻译模型。

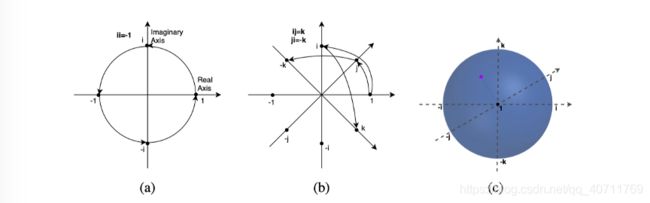

Hamilton四元组:

Q = a + b i + c j + d k Q=a+b\textbf i+c\textbf j+d\textbf k Q=a+bi+cj+dk

i 2 = j 2 = k 2 = ijk = − 1 \textbf i^2= \textbf j^2=\textbf k^2=\textbf{ijk}=-1 i2=j2=k2=ijk=−1

ij=k, ji=-k, jk=i, kj=-i, ki=j, ik=-j \textbf{ij=k, ji=-k, jk=i, kj=-i, ki=j, ik=-j} ij=k, ji=-k, jk=i, kj=-i, ki=j, ik=-j

Q ˉ = a − b i − c j − d k \bar Q=a-b\textbf i-c\textbf j-d\textbf k Qˉ=a−bi−cj−dk

∣ Q ∣ = a 2 + b 2 + c 2 + d 2 |Q|=\sqrt{a^2+b^2+c^2+d^2} ∣Q∣=a2+b2+c2+d2

Q 1 Q 2 = < a 1 , a 2 > + < b 1 , b 2 > + < c 1 , c 2 > + < d 1 , d 2 > Q_{1}Q_{2}=

Method

QuatE将关系建模为4维空间(hypercomplex space)上的旋转,从而将complEx 和 RotatE统一起来。在RotatE中,你有一个旋转平面;而在QuatE中,你会有两个。此外,对称、反对称和逆的功能都保留了下来。与RotatE相比,QuatE在 FB15k-237上训练所需的自由参数减少了 80%。

PS: 不是自己方向 读起来有点困难。