【论文笔记16】An Efficient Differential Privacy Logistic Classification Mechanism, 2019 IEEE IoT-J

目录导引

-

- Abstract

- Related Work

- Algorithm

- Question

- Reference

原文链接

我的论文笔记频道

Abstract

这篇文章做了一个 efficient differentially private logistic regression,说明了他们的方法比进行 object function perturbation 的方法在 running time and accuracy 上都表现得更好。同时,accuracy 接近 non-differential privacy 的情况。

Related Work

这篇文章归纳了五类 achieve differential privacy 的方法。

- Objective Perturbation, e.g., add noise to the coefficient of the obj function.

- Output Perturbation, e.g., add noise to parameters of the model.

- Calculation Process Perturbation, e.g., apply the Laplace mechanism to calculate the param of each step.

- Sample and Aggregation Framework, e.g., add noise in the combination step.

- Input Perturbation, i.e., perturb the input data. [This paper]

Algorithm

非常简单,就是对 Input raw data 加上 大小为 Lap ( Δ D ϵ ) \text{Lap}(\frac{\Delta D}{\epsilon}) Lap(ϵΔD) 的noise. 将数据集记作 D = ( x ( 1 ) , x ( 2 ) , . . . , x ( n ) ) D=(x^{(1)}, x^{(2)}, ..., x^{(n)}) D=(x(1),x(2),...,x(n)), x ( i ) = ( x 1 ( i ) , x 2 ( i ) , . . . , x d ( i ) ) x^{(i)}=(x_1^{(i)}, x_2^{(i)}, ..., x_d^{(i)}) x(i)=(x1(i),x2(i),...,xd(i)). The record sensitivity of D D D is Δ D \Delta D ΔD 也就是两个neighboring databases之间的最大差距 r i = ∣ A ( x ) − A ( y ) ∣ r_i = |A(x)-A(y)| ri=∣A(x)−A(y)∣。

这里有一个非常简单基础的 ϵ -DP \epsilon \text{-DP} ϵ-DP 的证明: Random mechanism A f ( ⋅ ) A_f(·) Af(⋅) satisfies ϵ -DP \epsilon\text{-DP} ϵ-DP.

f ( ⋅ ) f(·) f(⋅)可以理解为不加处理的普通mechanism (e.g., querying the majority), A f ( ⋅ ) A_f(·) Af(⋅) 就是在 f f f 的基础上修改了 input data 的 DP 版本。 如果是用 objective function perturbation 或者 output perturbation, 那么 A f ( x ) ≠ f ( x + n o i s e ) A_f(x) \neq f(x+noise) Af(x)=f(x+noise), 而是比如 A f ( x ) = f ( x ) + n o i s e A_f(x)=f(x)+noise Af(x)=f(x)+noise, A f ( x ) = f ′ ( x ) A_f(x)=f'(x) Af(x)=f′(x).

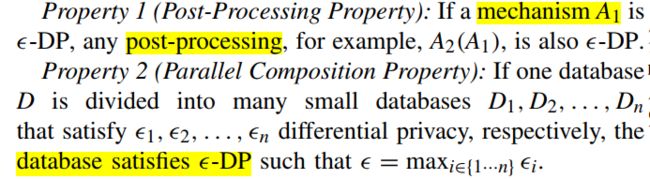

有了这个单个数据点上 A f ( ⋅ ) A_f(·) Af(⋅)的差分隐私之后,通过 parallel composition property 得到 A f ( ⋅ ) A_f(·) Af(⋅) 作用在整个数据集 D D D 上也有 ϵ DP \epsilon \text{DP} ϵDP。【注意,这里用的parallel composition property 不是 k-adaptive composition theorem, 那个是把每一个的 ϵ \epsilon ϵ 加起来,这里是取各个部分 ϵ \epsilon ϵ 的最大值作为合成后的 privacy budget】

之后,文章还证明了这种处理下参数估计的 correctness 以及 running time analysis. 最后做了实验,在synthetic data以及iris data上。

Question

文中证明了对数据加Laplace noise对于 A f ( ) A_f() Af()是满足 ϵ -DP \epsilon\text{-DP} ϵ-DP的。建立在 A f ( ) A_f() Af()之后的mechanism根据post-processing property保留这个性质。文章中有一处提到 database 是满足differential privacy的。这个表述对吗?不应该是针对某一个mechanism而言吗?

Reference

[1] Huang, Wen, et al. “An efficient differential privacy logistic classification mechanism.” IEEE Internet of Things Journal 6.6 (2019): 10620-10626.