PraNet: Parallel Reverse Attention Network for Polyp Segmentation

2020 MICCAI

语义分割、医学图像分割论文

目录

语义分割论文

前言

1.摘要

2.介绍

一、主要亮点

二、网络结构

1.整体框架

2.PD模块

3.反向注意力模块Reverse Attention Module

4.损失函数

三、实验部分

1.对比实验

2.消融实验

总结

前言

1.摘要

同一类型的息肉具有大小、颜色和纹理的多样性;且息肉与周围粘膜的边界不清晰。为了解决这些挑战,作者提出了一个平行的反向注意网络(PraNet),以准确分割结肠镜图像中的息肉。具体来说,首先使用并行部分解码器(PPD)聚合高级层中的特征。然后,根据组合的特征,生成一个全局地图,作为以下组件的初始指导区域。此外,利用反向注意(RA)模块挖掘边界线索,该模块能够建立区域与边界线索之间的关系。

2.介绍

作者主要提出了一种对分割息肉中区域和边界的一种有效的方法。动机源于这样一个事实:在息肉注释过程中,临床医生首先大致定位息肉,然后根据局部特征准确提取其轮廓mask。因此,我们认为区域和边界是区分正常组织和息肉的两个关键特征。与[10]不同的是,我们首先预测粗区域,然后通过反向注意隐式描绘出边界。该策略有三个优势,即学习能力更好,泛化能力更好,训练效率更高。

一、主要亮点

- 并行部分解码器(PPD)聚合高级层中的特征Feature Aggregating via Parallel Partial Decoder

- 反向注意力模块(RA)间接提取轮廓线索Reverse Attention Module

二、网络结构

1.整体框架

接下来分别讨论PD模块和RA模块

2.PD模块

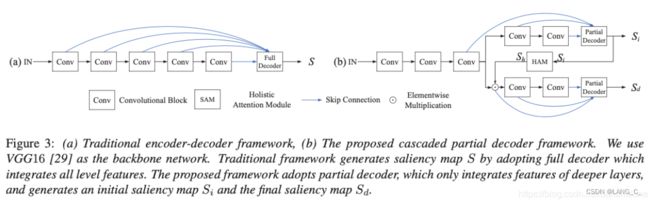

目前流行的医学图像分割网络通常依赖于UNet[22]或类似U-Net的网络(如U-Net++[39]、ResUNet[35]等)。这些模型本质上是编码器-解码器框架,通常聚合从编码器提取的所有多层次特征。Wu et al.[29]证明,与高级特征相比,低级特征由于空间分辨率较大,需要更多的计算资源,但对性能的贡献较小。基于这种观察,我们建议用并行部分解码器组件聚合高级特征。更具体地说,对于一个大小为h × w的输入图像I, 5层特征{![]() ,i=1,2..,5}可以从基于res2net的[12]骨干网中提取分辨率为[

,i=1,2..,5}可以从基于res2net的[12]骨干网中提取分辨率为[![]() ,

,![]() ]的特征图。然后,我们将

]的特征图。然后,我们将![]() 特征分为低级特征{

特征分为低级特征{![]() ,i=1,2}和高级特征{

,i=1,2}和高级特征{![]() ,i=3,4,5}。我们引入了部分解码器pd(·)[29],这是一种新的SOTA解码器组件,通过并行连接聚合高级特征。部分解码器特征由PD = PD (f3, f4, f5)计算得到全局映射

,i=3,4,5}。我们引入了部分解码器pd(·)[29],这是一种新的SOTA解码器组件,通过并行连接聚合高级特征。部分解码器特征由PD = PD (f3, f4, f5)计算得到全局映射![]() 。

。

这个部分解码器是在论文《Cascaded partial decoder for fast and accurate salient object detection》中提出的,具体可以看一下下面博主的回答。

[CVPR2019]Cascaded Partial Decoder for Fast and Accurate Salient Object Detection![]() https://blog.csdn.net/bananalone/article/details/106881181?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522165413634116780357288483%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=165413634116780357288483&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduend~default-2-106881181-null-null.142%5Ev11%5Econtrol,157%5Ev12%5Enew_style2&utm_term=Cascaded+partial+decoder+for+fast+and+accurate+salient+object+detection&spm=1018.2226.3001.4187

https://blog.csdn.net/bananalone/article/details/106881181?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522165413634116780357288483%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=165413634116780357288483&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduend~default-2-106881181-null-null.142%5Ev11%5Econtrol,157%5Ev12%5Enew_style2&utm_term=Cascaded+partial+decoder+for+fast+and+accurate+salient+object+detection&spm=1018.2226.3001.4187

显著目标检测之Cascaded Partial Decoder for Fast and Accurate Salient Object Detection(CPD)![]() https://blog.csdn.net/spellindover/article/details/107443980?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522165413634116780357288483%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=165413634116780357288483&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduend~default-1-107443980-null-null.142%5Ev11%5Econtrol,157%5Ev12%5Enew_style2&utm_term=Cascaded+partial+decoder+for+fast+and+accurate+salient+object+detection&spm=1018.2226.3001.4187

https://blog.csdn.net/spellindover/article/details/107443980?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522165413634116780357288483%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=165413634116780357288483&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduend~default-1-107443980-null-null.142%5Ev11%5Econtrol,157%5Ev12%5Enew_style2&utm_term=Cascaded+partial+decoder+for+fast+and+accurate+salient+object+detection&spm=1018.2226.3001.4187

编码器-解码器结构的网络被大量应用于显著性目标检测,并获得了惊人的表现,编码器是预先训练好的图像分类模型(如VGG和ResNet),它提供了多层次的深层特征:低分辨率的高级特征表示语义信息,高分辨率的低级特征表示空间细节,在解码器中,这些特征被组合起来以生成精确的显著性映射。

- 对于高级特征和低级特征的理解如下

- 如Unet中编码器部分,低级特征指的就是高分辨率,空间信息丰富(可以理解为那些点线面轮廓之类的,或者是编码相对明确的语义框),但是缺乏语义信息的feature,高级特征指的是低分辨率,语义信息丰富,但是缺乏空间信息的feature。 良好的分割结果可通过对齐高级特征图和语义框而获得。上述概念参考下图。

- Unet的核心思想是逐渐融合顶层的高级、低分辨率特征和底层的低级、高分辨率特征,这被认为有助于解码器生成高分辨率语义特征。

更多关于高级特征和低级特征可以参考其他博客

ExFuse: Enhancing Feature Fusion for Semantic Segmentation

3.反向注意力模块Reverse Attention Module

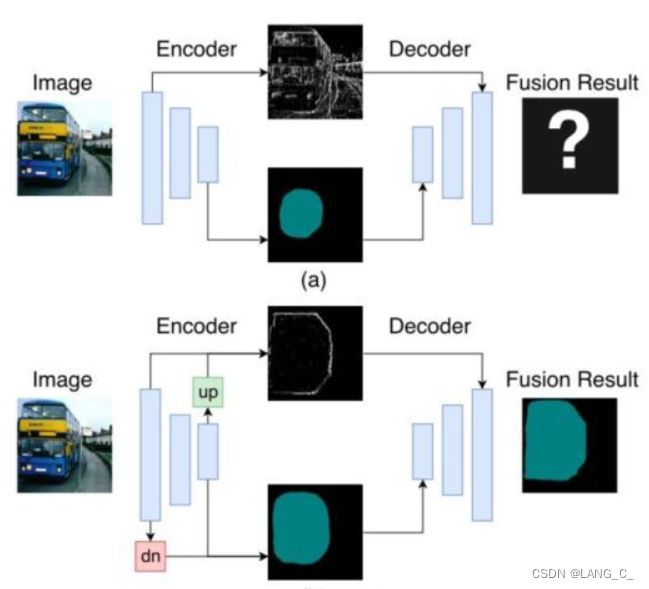

我们的global map ![]() 来自于最深处的CNN层,它只能捕获息肉组织相对粗略的位置,没有结构细节。为了解决这个问题,我们提出了一种主要策略,通过消除前景对象的方式逐步挖掘鉴别性息肉区域[27,4]。与[4,13,36,33]中聚合来自所有层次的特征不同,我们建议在三个并行的高级特征中自适应学习反向注意。换句话说,我们的架构可以通过从高级侧输出特征中擦除现有的估计息肉区域,从而依次挖掘互补区域和细节,其中现有的估计是从更深层的上采样。

来自于最深处的CNN层,它只能捕获息肉组织相对粗略的位置,没有结构细节。为了解决这个问题,我们提出了一种主要策略,通过消除前景对象的方式逐步挖掘鉴别性息肉区域[27,4]。与[4,13,36,33]中聚合来自所有层次的特征不同,我们建议在三个并行的高级特征中自适应学习反向注意。换句话说,我们的架构可以通过从高级侧输出特征中擦除现有的估计息肉区域,从而依次挖掘互补区域和细节,其中现有的估计是从更深层的上采样。

我的理解是:RA模块的目的是为了能更好的预测边界部分。假设病变部分是白色前景,其余黑色背景,由于边界模糊,前景部分可能会比真实的病变区域小一些,而反向后背景白色相对就会多一些,再与高级特征相乘,特征中背景区域会更突出一些,而且会比正常病变多一些边界部分,再卷积后与![]() 相加,得到的特征图自然会在边界上更加突出,这有助于分割。

相加,得到的特征图自然会在边界上更加突出,这有助于分割。

深监督部分(紫色箭虚头)在这里也起着重要的作用,在不同尺度下约束网络,使其在边界得到更多的注意力。

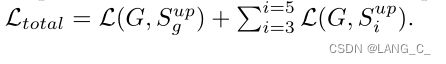

4.损失函数

三、实验部分

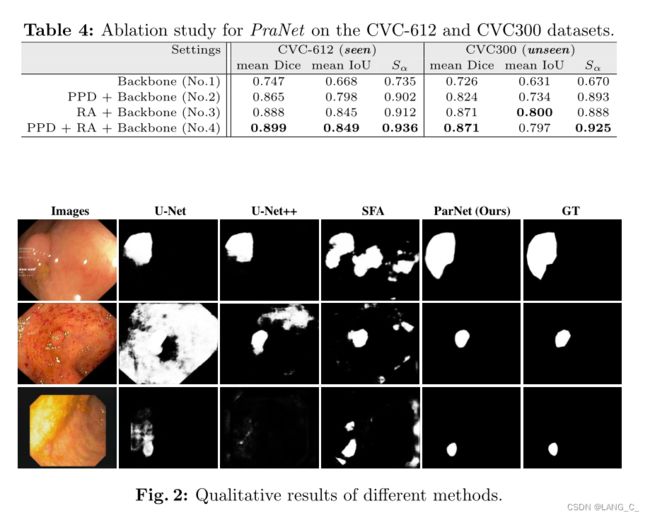

1.对比实验

利用weighted Dice metric ![]() 修正了Dice的“Equal-importance flaw”。利用MAE指标评估像素级精度。为了评估像素级和全局级的相似性,我们采用了最近发布的增强对齐度量

修正了Dice的“Equal-importance flaw”。利用MAE指标评估像素级精度。为了评估像素级和全局级的相似性,我们采用了最近发布的增强对齐度量![]() [6]。由于

[6]。由于![]() 和MAE基于像素级评价系统,而忽略了结构相似性,因此采用

和MAE基于像素级评价系统,而忽略了结构相似性,因此采用![]() [5]来评估预测结果与真实数据之间的相似性。

[5]来评估预测结果与真实数据之间的相似性。

2.消融实验

总结

我们提出了一种新颖的架构,PraNet,用于从结肠镜图像中自动分割息肉。大量的实验表明,在五个具有挑战性的数据集上,PraNet的性能始终比所有最先进的方法都好很多(>5%)。此外,没有任何预处理/后处理,PraNet实现了非常高的精度(平均Dice = 0.898在Kvasir数据集)。另一个优点是PraNet具有通用性和灵活性,这意味着可以添加更有效的模块来进一步提高准确性。与目前排名前列的SFA模型相比,PraNet具有较强的学习能力、泛化能力和实时分割效率。我们希望本研究能够为社会提供一个机会,在相关的主题上,如肺部感染分割[9]/分类[28],甚至在上游任务上,探索更大的模型。加深了高级特征低级特征处理的理解