什么是深度神经网络架构,五种神经网络架构形式

人工神经元网络的拓扑结构主要有哪几种?

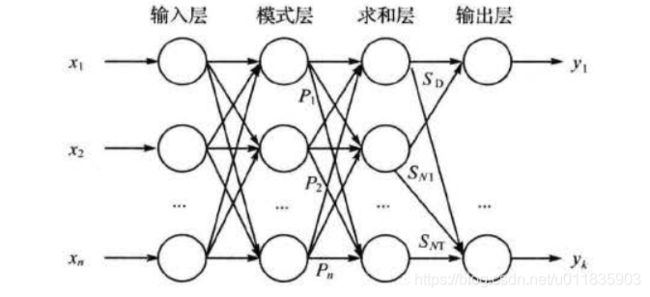

神经网络的拓扑结构包括网络层数、各层神经元数量以及各神经元之间相互连接的方式。人工神经网络的模型从其拓扑结构角度去看,可分为层次型和互连型。

层次型模型是将神经网络分为输入层(InputLayer)、隐层(HiddenLayer)和输出层(OutputLayer),各层顺序连接。

其中,输入层神经元负责接收来自外界的输入信息,并将其传递给隐层神经元。隐层负责神经网络内部的信息处理、信息变换。通常会根据变换的需要,将隐层设计为一层或多层。

扩展资料:人工神经网络模型主要考虑网络连接的拓扑结构、神经元的特征、学习规则等。目前,已有近40种神经网络模型,其中有反传网络、感知器、自组织映射、Hopfield网络、波耳兹曼机、适应谐振理论等。

人工神经网络采用了与传统人工智能和信息处理技术完全不同的机理,克服了传统的基于逻辑符号的人工智能在处理直觉、非结构化信息方面的缺陷,具有自适应、自组织和实时学习的特点。

参考资料来源:百度百科-人工神经网络。

简述人工神经网络的结构形式

神经网络有多种分类方式,例如,按网络性能可分为连续型与离散型网络,确定型与随机型网络:按网络拓扑结构可分为前向神经网络与反馈神经网络AI爱发猫 www.aifamao.com。本章土要简介前向神经网络、反馈神经网络和自组织特征映射神经网络。

前向神经网络是数据挖掘中广为应用的一种网络,其原理或算法也是很多神经网络模型的基础。径向基函数神经网络就是一种前向型神经网络。Hopfield神经网络是反馈网络的代表。

Hvpfi}ld网络的原型是一个非线性动力学系统,目前,已经在联想记忆和优化计算中得到成功应用。模拟退火算法是为解决优化计算中局部极小问题提出的。

Baltzmann机是具有随机输出值单元的随机神经网络,串行的Baltzmann机可以看作是对二次组合优化问题的模拟退火算法的具体实现,同时它还可以模拟外界的概率分布,实现概率意义上的联想记忆。

自组织竞争型神经网络的特点是能识别环境的特征并自动聚类。自组织竟争型神经网络已成功应用于特征抽取和大规模数据处理。

CNN(卷积神经网络)、RNN(循环神经网络)、DNN(深度神经网络)的内部网络结构有什么区别?

如下:1、DNN:存在着一个问题——无法对时间序列上的变化进行建模。然而,样本出现的时间顺序对于自然语言处理、语音识别、手写体识别等应用非常重要。

对了适应这种需求,就出现了另一种神经网络结构——循环神经网络RNN。2、CNN:每层神经元的信号只能向上一层传播,样本的处理在各个时刻独立,因此又被称为前向神经网络。

3、RNN:神经元的输出可以在下一个时间戳直接作用到自身,即第i层神经元在m时刻的输入,除了(i-1)层神经元在该时刻的输出外,还包括其自身在(m-1)时刻的输出!

介绍神经网络技术起源于上世纪五、六十年代,当时叫感知机(perceptron),拥有输入层、输出层和一个隐含层。输入的特征向量通过隐含层变换达到输出层,在输出层得到分类结果。

早期感知机的推动者是Rosenblatt。在实际应用中,所谓的深度神经网络DNN,往往融合了多种已知的结构,包括卷积层或是LSTM单元。

一个完整的人工神经网络包括

人工神经网络主要架构是由神经元、层和网络三个部分组成。整个人工神经网络包含一系列基本的神经元、通过权重相互连接。神经元是人工神经网络最基本的单元。

单元以层的方式组,每一层的每个神经元和前一层、后-层的神经元连接,共分为输入层、输出层和隐藏层,三层连接形成一-个神经网络。

输入层只从外部环境接收信息,是由输入单元组成,而这些输入单元可接收样本中各种不同的特征信息。

该层的每个神经元相当于自变量,不完成任何计算,只为下一层传递信息;隐藏层介于输入层和输出层之间,这些层完全用于分析,其函数联系输入层变量和输出层变量,使其更配适数据。

而最后,输出层生成最终结果,每个输出单元会对应到某一种特定的分类,为网络送给外部系统的结果值,,整个网络由调整链接强度的程序来达成学习的目的。

人工神经网络的基本组成是什么啊

CNN、RNN、DNN的内部网络结构有什么区别?

从广义上来说,NN(或是更美的DNN)确实可以认为包含了CNN、RNN这些具体的变种形式。在实际应用中,所谓的深度神经网络DNN,往往融合了多种已知的结构,包括卷积层或是LSTM单元。

但是就题主的意思来看,这里的DNN应该特指全连接的神经元结构,并不包含卷积单元或是时间上的关联。因此,题主一定要将DNN、CNN、RNN等进行对比,也未尝不可。

其实,如果我们顺着神经网络技术发展的脉络,就很容易弄清这几种网络结构发明的初衷,和他们之间本质的区别。

神经网络技术起源于上世纪五、六十年代,当时叫感知机(perceptron),拥有输入层、输出层和一个隐含层。输入的特征向量通过隐含层变换达到输出层,在输出层得到分类结果。

早期感知机的推动者是Rosenblatt。

(扯一个不相关的:由于计算技术的落后,当时感知器传输函数是用线拉动变阻器改变电阻的方法机械实现的,脑补一下科学家们扯着密密麻麻的导线的样子…)但是,Rosenblatt的单层感知机有一个严重得不能再严重的问题,即它对稍复杂一些的函数都无能为力(比如最为典型的“异或”操作)。

连异或都不能拟合,你还能指望这货有什么实际用途么。

随着数学的发展,这个缺点直到上世纪八十年代才被Rumelhart、Williams、Hinton、LeCun等人(反正就是一票大牛)发明的多层感知机(multilayerperceptron)克服。

多层感知机,顾名思义,就是有多个隐含层的感知机。