DPANet: Depth Potentiality-Aware Gated Attention Network for RGB-D Salient Object Detection

DPANet:用于 RGB-D 显著性目标检测的深度潜能感知门控注意网络

IEEE TRANSACTIONS ON IMAGE PROCESSING 2020

存在的问题

1)如何防止不可靠的深度信息造成的污染;

2)如何有效地整合来自RGB图像的多模态信息和对应的深度图。

解决问题的方法

提出计算深度图潜力的概念

设计一个门机制权重 ^g 去控制引入深度图的比率,从而去过滤深度图所带来的冗余信息

设计一个权重 α 去判断跨模态特征中的每通道所对应的重要程度

注意,^g和α 都是通过监督学习过程计算得到。

网络架构DPANet

整个网络是一个对称的编码器-解码器架构

在解码器阶段,RGB分支的输出特征表示为rbi (i = 1, 2, 3, 4, 5),深度分支的输出特征表示为dbi (i = 1, 2, 3, 4, 5),特征rbi(i=2,3,4,5)和特征dbi(i=2,3,4,5)被送入 GMA 模块,分别获得相应的增强特征 rfi 和 dfi 。在 GAM 模块中,门的权重由网络以监督的方式学习。 具体来说,顶层的特征 rb5 和 db5 通过一个全局平均池化 (GAP) 层和两个全连接层,在伪标签 g 的帮助下通过 回归损失 来学习深度潜力的预测分数。 然后,两个分支的解码器逐步集成多尺度特征。 最后,我们使用多尺度和多模态特征融合模块 MF 聚合两个解码器的输出并生成显着性图。 为了便于优化,我们在每个子阶段添加了辅助损失分支,即 rdi 和 ddi (i = 5, 4, 3, 2)。

Depth Potentiality Perception

当深度图不可靠时存在一些污染,不是直接丢弃低质量的深度图,而是以软方式控制融合过程,显式地对深度图的置信度响应进行建模(建模通过观察得到)。

深度图质量评估的没有标签, 将深度图 I 转化为二进制深度图~I,如果通过阈值分割的二进制深度图~I接近于 真值 ,则深度图是可靠的,分配更高的置信度响应。

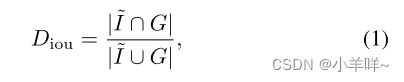

二进制深度图和真值 之间的相关程度。采用 IoU(intersection over union)来衡量二进制深度图~I 和 真值 之间的准确度:

粗糙的二进制深度图~I将包含背景,这导致即使最终的显著图与真值非常接近,Diou也会趋于很小。因此,定义另一个度量来放松IoU的强约束:

该度量 Dcov 反映了交叉区域与真值的比率,这表明二进制深度图~I有望更完整地覆盖显著对象。

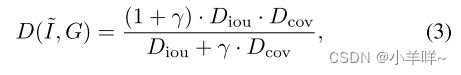

受 F-measure 的启发,我们结合这两个指标来衡量 SOD 任务的深度图的潜力,即

γ是加权系数。 考虑到阈值分割可能带来的噪声和不准确性,我们在结合 IoU 度量和 COV 度量时更加强调覆盖区域的完整性,因此我们将 γ 设置为 0.3 以强调 Dcov 而不是 Diou 中的设置。

最后, D(~I, G) 只在训练阶段用,作为上图中的 伪标签 g 用于训练出 门权重 ^g。门权重 ^g反应深度图的潜在置信度,控制深度信息的引用率。

Gated Multi-modality Attention Module

该模块利用 注意力机制自动选择和加强显着性检测的重要特征,并将门控制器合并到 GAM 模块中,以防止不可靠深度图的污染。

为了减少单模态特征的冗余并突出显着区域的特征响应,我们将 空间注意力S 分别应用于输入特征 rbi 和 dbi。该过程可以描述为:

其中 fin 表示 RGB 分支或深度分支的输入特征(即 rbi 或 dbi),convi (i = 1, 2) 指卷积层, 表示逐元素乘法,δ 是 ReLU 激活函数,以及fout 表示修改后的 RGB/深度特征(即 rb~i 或 db~i)。修改后的特征 rb~i、db~i 的通道在每个阶段统一为 256 维。请注意,我们模型中的 RGB 和深度分支的权重不共享。

受自我注意启发,设计了两个对称的注意子模块(Adr ,Ard),Adr 利用深度信息为 RGB 特征rb~i 生成空间权重,而 Ard 使用从 RGB 生成的空间权重来细化深度特征特征。从技术上讲,我们首先应用 1×1 卷积运算将 db~i 投影到 Wq ,Wk ,并将 rb~i 投影到 Wv ,其中C1 设置为 C 的 1/8 以提高计算效率,计算过程如下。

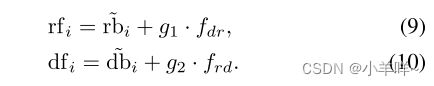

最后,我们引入门 g1 和 g2 (g1 + g2 = 1 )来控制增强特征 rfi 和 修改特征 fdr和 frd的相互作用,可以表示为

对于增强特征,权重 g1 = ^g,其中 ^g 是在伪标签 g 的监督下学习的。当 ^g 接近 1 时,表示深度图可靠性高,RGB 分支会引入更多的深度信息,以减少背景干扰; 当 ^g 接近 0 时,RGB 分支将是主导分支,采用较少的深度信息,RGB 信息将起到更重要的防止污染的作用。

Multi-level Feature Fusion

使用多尺度渐进融合策略,将单模态特征从粗到细进行融合。 其次,对于多模态特征,利用设计的 GAM 模块单独增强特征,而不是早期融合 RGB 和深度特征,这样可以减少不同模态的干扰。 最后,我们通过使用多模态特征融合来聚合两个模态特征以获得显着图。

Multi-scale Feature Fusion.

采用了乘法。 乘法运算可以增强显着对象的响应,同时抑制背景噪声。 具体来说,以高阶特征rd5和低阶特征rf4的融合为例,多尺度特征融合可以描述为

Multi-modality Feature Fusion.

在多模态特征融合过程中,考虑两个问题:

(1)如何从RGB和深度特征中选择最有用和互补的信息。

学习权重 α 以平衡互补性。 权重 α 是从两个分支主干的顶层特征中学习的权重向量,这证明了多模态特征的通道重要性。

(2)如何防止融合过程中深度图不可靠造成的污染。

门的学习权重 ^g 用于控制深度信息的引入比例。 权重 ^g 是在伪标签 g 的监督下学习的,反映了深度图的潜在置信度。

为了融合跨模态特征 rd2 和 dd2,我们设计了一个加权通道注意机制来自动选择有用的通道,可以表示为

等式 (15) 反映了显著对象的共同响应,而等式 (14) 通过通道选择 (α) 和门机制 (^g) 结合了两个模态特征,以考虑互补性和不一致性。