变分推断(variational inference,VI)以及一篇论文阅读

一、变分推断(variational inference,VI)

原始文献参考:V ariational Inference: A Review for Statisticians

专栏参考1、MCMC算法详解 - 知乎 (zhihu.com)

专栏参考2、基于近似计算解决推断问题——变分推断(一) - 知乎 (zhihu.com)

利用近似计算来解决难计算的概率密度估计,是现代统计学中的一个惯用手段。这一方法在贝叶斯推断统计中尤为重要,以为贝叶斯统计将所有关于未知量的推断都构建为涉及后验概率的计算。而一个经典的近似推断方法,就是变分推断(variational inference,VI)

为了对概率密度近似计算,常用的方法就是mcmc(蒙特卡洛算法,马尔可夫链)以及后来的变分推断。

对于mcmc算法:核心思想是某一时刻状态转移的概率只依赖于它的前一个状态。

我们用数学定义来描述,则假设我们的序列状态是...Xt−2, Xt−1, Xt, Xt+1,...,那么我们的在时刻Xt+1的状态的条件概率仅仅依赖于时刻Xt。

马尔科夫链的平稳分布收敛主要依赖于状态转移矩阵,所以关键是如何构建状态转移矩阵,使得最终的平稳分布是我们所要的分布。

而为了加快马尔科夫链的收敛,传统方式引入了MH算法以及gibbs采样。具体算法可以参考:

机器学习之MCMC算法 - 微笑sun - 博客园 (cnblogs.com)

VI 与 MCMC 基于不同的思想解决推断问题。 MCMC 基于马尔科夫链采样来近似后验,而 VI 则是基于 KL 散度将问题转化为优化问题来近似后验。这两种方法各有优劣:

- MCMC 相比于 VI 需要更多的计算,但随着采样次数增加, MCMC 能为精度提供保证。

- VI 无法提供精度的保证,但速度快于 MCMC ,且 VI 解决的是优化问题,所以能够发挥随即优化算法和分布式优化的优势

所以, VI 更使用于大规模数据、需要快速训练模型的场景, MCMC 使用于小规模数据、但我们需要用计算代价换取精度的情况。

除了数据集规模,另一个值得思考的因素是后验分布的几何特性。如,当后验为多种模式的混合模型,每个对应的标签排列的组件。对于 Gibbs sampling 来说,它能专注于目标的一个模型,但在应对混合模型时,就显得力不从心了,而 VI 在混合模型的表现明显比 MCMC 好得多。

那么什么是变分推断

变分推断使用了我们之前多次提到的KL散度,利用KL散度去寻找隐变量的近似分布。在之前的文章中,KL散度多被利用来判断训练模型与测试模型之间的差异程度,不同于mcmc利用转移矩阵不断的寻找下一个状态直至收敛最后在一定范围内求平均值的做法,利用KL散度所须得算力较少,因此更适合在较大的数据集上使用。

关于KL在证据下界(ELBO)的推导过程可以查看专栏2,但专栏2其实是对参考论文进行中文翻译。

二、LARGE SCALE GAN TRAINING FOR HIGH FIDELITY NATURAL IMAGE SYNTHESIS(bigGan 用于高保真自然图像合成的大规模 GAN 训练.2018)

本论文主要目的是解决三个问题:

1、证明了 GAN 从缩放中受益匪浅,并且与现有技术相比,训练模型的参数数量是现有技术的 2 到 4 倍,batch 大小是 8 倍。引入了两个简单的通用架构更改,以提高可扩展性,并修改正则化方案以改善条件,明显提高性能。

2、“截断技巧”的应用

3、发现了big GAN 特有的不稳定性,并根据经验对其进行了表征。利用该分析的见解,证明了新的和现有技术的结合可以减少这些不稳定性,但是只有以极大的性能成本才能实现完全的训练稳定性。

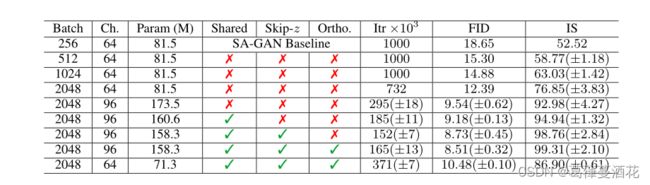

(1)大规模(big):仅单纯的扩大规模就能很好的提升Gan的性能(bigGan主要特点):

仅需将batch size扩大8倍就可以将效果增幅46%。而如果将每层通道增加50%,实验效果增幅了21%

(2)“截断技巧”:利用截断权衡多样性和保真度

从直观上来看:

(a)部分为阈值取2,1,0.5,0.04后“截断”后的效果图,(b)为将截断应用于条件不佳的模型时产生的饱和伪影。

截断技巧:采用一个用 z ∼ N (0, I) 训练的模型并从截断的法线中采样 z(其中超出范围的值被重新采样以落在该范围内。其中z表示先验分布或者噪声向量,具体表示什么在于它所处的训练阶段),截断技巧通过控制采样的范围达到生成质量上的提高。

同时从(a)中也可以得出这样的结论:对幅度高于所选阈值的值进行重新采样来截断 z 向量,可以使单个样本质量的提高,但减少了整体样本多样性。

为了抵消类似于(b)情况,文章通过将 G 调节为平滑来强制执行截断的适应性,以便 z 的整个空间将映射到良好的输出样本。为此,文章采用正交正则化,它直接强制执行正交性条件:

其中 W 是权重矩阵,β 是超参数。这种正则化通常过于局限,文章为了放松约束,同时实现模型所需的平滑度,发现最好的版本是从正则化中删除对角项,并且旨在最小化滤波器之间的成对余弦相似性,但不限制它们的范数:

其中 1 表示一个矩阵,它所有元素都设置为 1。

(3)追求稳定的后续:

主要包括两个一个是最G的限制,一个是对D的限制。

对G:

为了解决 G 上的训练崩溃,通过适当调整奇异值 σ0 以抵消光谱爆炸的影响。

对D:

文章假设这些噪声是由于对抗训练优化导致的,如果这种频谱噪声与不稳定性有因果关系,那么相对采用的反制是使用梯度惩罚,通过采用 R1 零中心梯度惩罚.

在追求稳定性的过程中,文章作者发现。稳定性不知来源于生成器G、鉴别器D,同时也来源于生成对抗的过程中。在前人的工作中为了追求较好的稳定性,防止模型在训练的过程中崩溃,大多采用牺牲性能或者消耗巨大算力的方法。

文章作者最后采用,放松这种限制性能条件并允许在训练的后期阶段发生崩溃来获得更好的最终性能。

其实bigGan就是在普通的Gan上使用更大的batch,更大的参数,相应的为了调节训练奔溃与性能需求之间的平衡引入了不同的惩罚损失,同时本文提出了”截断技巧“(2018)的概念在后续研究的过程中产生了极其重要的影响。是后续一些Gan网络改进的鼻祖。