【完整】分类模型中类别不均衡问题解决

目录

1. 数据类别不均衡问题

2. 解决办法

过采样:

欠采样:

ensemble 方法:

修改损失函数:

梯度调和机制:

Dice Loss:

标签平滑:

3. 类别不均衡问题loss设计

4. 梯度调和机制GHM Gradient Harmonizing Mechanism

(1)简介

(2) 理论

(3) 计算优化

5. Dice Loss

(1)Dice Coeffificient

(2)自调节

6. 标签平滑Label Smoothing

(1)cross-entropy

(2)存在问题

(3)正则化

7. 总结

8. 代码

1. 数据类别不均衡问题

常见的分类任务大部分数据的标签都是某几类,而很少的类别的数据有时也很重要,因而需要模型去预测。

2. 解决办法

过采样:

对于某些类别数据比较少,对它们进行重复采样,以达到相对平衡,重复采样的时候,有时也会对数据加上一点噪声;

缺点:过采样可能导致这些类别产生过拟合的现象

欠采样:

对于某些类别数据特别多,只使用部分数据,抛弃一些数据;

缺点:欠采样则容易导致模型的泛化性变差

ensemble 方法:

结合 ensemble 方法,则将数据切分为 N 部分,每部分都包含数据少的类别的所有样本和数据多的类别的部分样本,训练 N 个模型,最后进行集成。

缺点:使用 ensemble 则会提高部署成本和带来性能问题。

修改损失函数:

详情见后文第3部分

梯度调和机制:

详情见后文第4部分

Dice Loss:

详情见后文第5部分

标签平滑:

详情见后文第6部分

3. 类别不均衡问题loss设计

Focal Loss 是一种专门为类别不均衡设计的loss,在《Focal Loss for Dense Object Detection》这篇论文中被提出来,应用到了目标检测任务的训练中,但其实这是一种无关特定领域的思想,可以应用到任何类别不均衡的数据中。

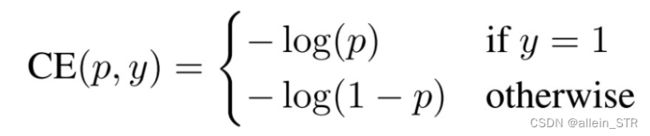

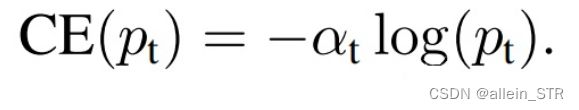

首先,还是从二分类的cross entropy(CE)loss入手:

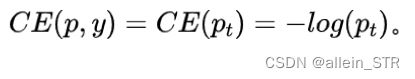

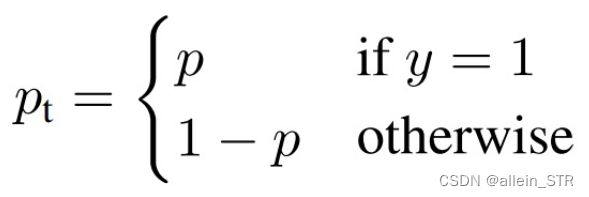

为了符号的方便,

![]() 为模型对于 label=1(ground-truth)的类别的预测概率。

为模型对于 label=1(ground-truth)的类别的预测概率。

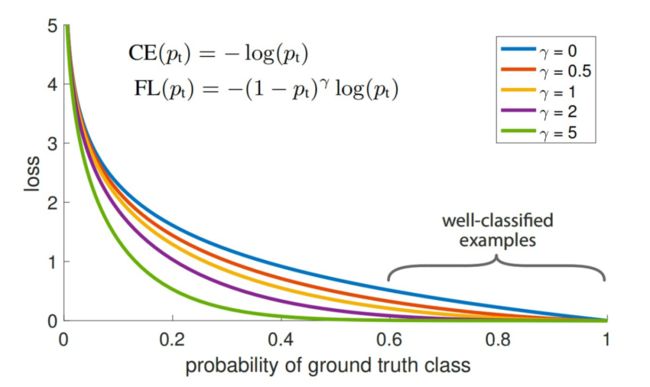

下图的蓝色曲线为原生的 CE loss,容易看出来,那些容易分类(![]() )的样本也会产生不小的 loss,但这些大量的容易样本的 loss 加起来,会压过那些稀少类别的样本的 loss。

)的样本也会产生不小的 loss,但这些大量的容易样本的 loss 加起来,会压过那些稀少类别的样本的 loss。

改进方法为:给 CE loss 增加一个权重因子![]() ,正样本权重因子为

,正样本权重因子为 ![]() ,负样本为

,负样本为 ![]() 。

。

实际使用中,一般设置为类别的逆反频率,即频率低的类别权重应该更大,比如稀少的正样本的 ![]() 为负样本的频率。或者当作一个超参数。

为负样本的频率。或者当作一个超参数。

但是,这种做法只是平衡了正负样本的重要性,无法区分容易(easy)样本和困难(hard)样本,这也是类别不均衡的数据集很容易出现的问题:容易分类的样本贡献了大部分的 loss,并且主导了梯度。

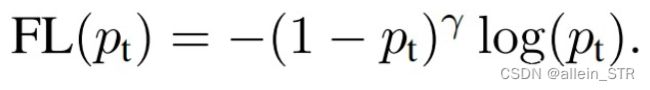

因此,Focal Loss 的主要思想就是让 loss 关注那些困难样本,而降低容易样本的重要性。

如上式,在 CE 的基础增加一个调节因子 ![]() 。上图 1 可以看出,

。上图 1 可以看出,![]() 越大,容易样本的 loss 贡献越小。

越大,容易样本的 loss 贡献越小。

Focal Loss 具有以下两个属性:

1. 当一个样本被错误分类时,且![]() 很小时(即为困难样本),那么调节因子是接近 1 的,loss 则基本不受影响。而相反的,当

很小时(即为困难样本),那么调节因子是接近 1 的,loss 则基本不受影响。而相反的,当 ![]() ->1,分类很好的样本(容易样本),调节因子则会偏于 0,loss 贡献变得很小;

->1,分类很好的样本(容易样本),调节因子则会偏于 0,loss 贡献变得很小;

2. 不同的 ![]() 参数可以平滑地调整容易样本的重要性降低的比率。当

参数可以平滑地调整容易样本的重要性降低的比率。当![]() 时,则等同于普通的 CE。而当

时,则等同于普通的 CE。而当 ![]() 变大时,那么调节因子的影响也会同样变大,即容易样本的重要性会降低。

变大时,那么调节因子的影响也会同样变大,即容易样本的重要性会降低。

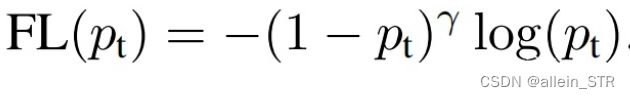

论文在实验中,Focal Loss 还保留上述的权重因子![]() :

:

通常来说,当增加![]() 时,

时,![]() 应该稍微降低。

应该稍微降低。

在作者的实验中, ![]() 取得了最佳性能。

取得了最佳性能。

缺点:

1. Focal Loss 存在两个超参数,并且是互相影响,构成许多参数组合,会导致调参需要很多尝试成本

2. Focal Loss 是一种静态的 loss,那么同一种超参数无法适用于不同的数据分布;

4. 梯度调和机制GHM Gradient Harmonizing Mechanism

出自《Gradient Harmonized Single-stage Detector》论文

(1)简介

GHM 有两大观点:

观点 A:与focal loss类似

模型从容易分类的样本的到收益很少,模型应该关注那些困难分类的样本,不管它属于哪一种类别,但大量的容易样本加起来的贡献会盖过困难样本,使得训练效益很低;

观点 B:

1. Focal Loss 存在两个超参数,并且是互相影响,构成许多参数组合,会导致调参需要很多尝试成本;并且,Focal Loss 是一种静态的 loss,那么同一种超参数无法适用于不同的数据分布;

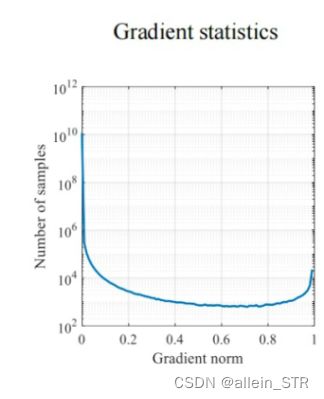

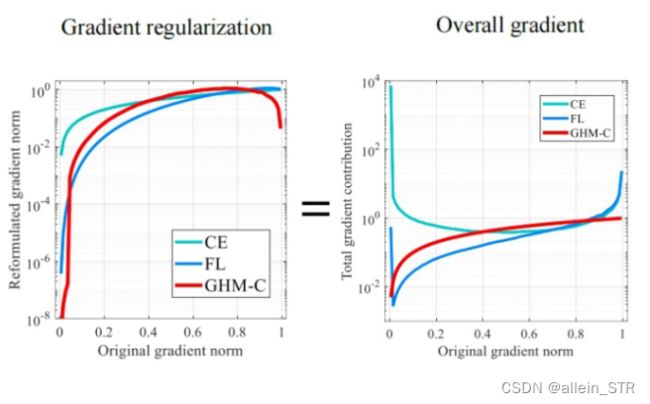

下图展示了上述观点 ,梯度范数 gradient norm 的大小则代表样本的分类难易程度,收益实际即对应为梯度;

2. 有一些特别困难分类的样本,它们很可能是离群点,加入这些样本的训练,会影响模型的稳定性;

3. 提出了 gradient density(梯度密度)的梯度调和机制,来缓解这种类别不均衡的问题。

通过 GHM 的梯度调和之后,容易样本的 gradient norm 会被削弱许多,并且特别困难的样本也会被轻微削弱,分别对应观点 A 和观点 B-2 的解决方案。

(2) 理论

其主要思想是:首先仍然是降权大量容易样本贡献的梯度总和,其次是对于那些特别困难样本即离群点,也应当相对地降权。

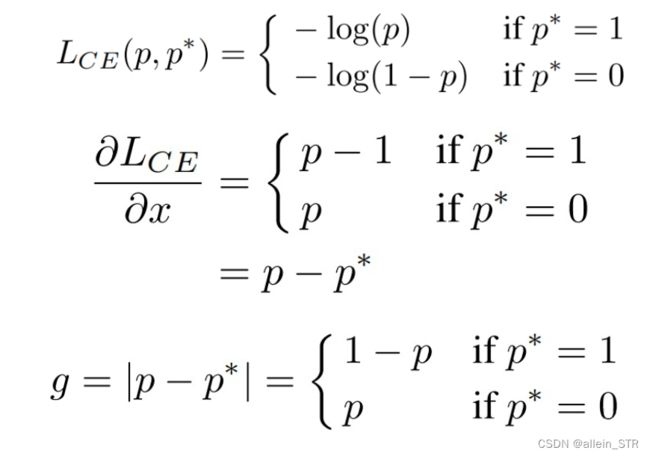

对于二分类问题,同样的交叉熵 loss 如下:

其中, ![]() 为模型的预测概率,

为模型的预测概率, ![]() 为真实的标签 ground-truth label;

为真实的标签 ground-truth label;

x 为模型 unnormalized 的直接输出![]() ,.

,.

这里的 g 为 gradient norm,可以用来表示一个样本的分类难易程度以及对在全局梯度中的影响程度,g 越大则分类难度越高。

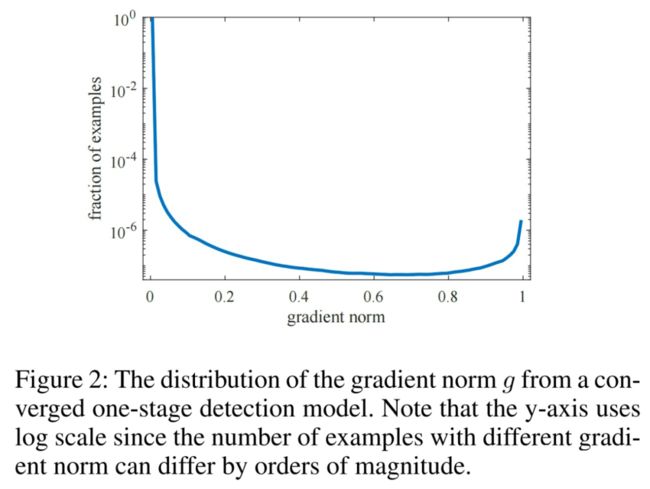

下图 2 展示了在目标检测模型中 gradient norm 的分布情况,表明了容易样本在梯度中会占主导地位,以及模型无法处理一些特别困难的样本,这些样本的数量甚至超过了中等困难的样本,但模型不应过于关注这些样本,因为它们可以认为是离群点。(对应上述观点 A 和观点 B-2)

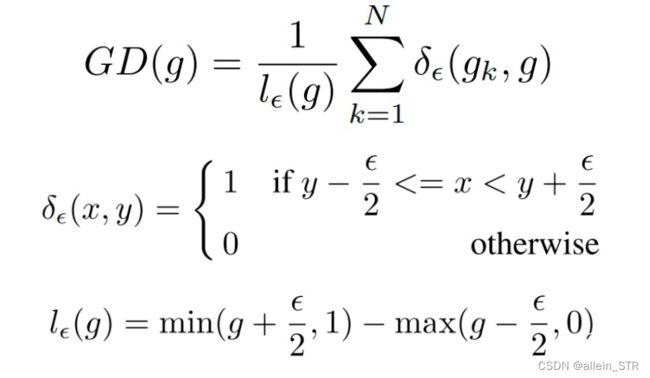

为了解决这种 gradient norm 的分布问题,论文提出了一种调和手段:Gradient Density

其中,![]() 为第 k 个样本的 gradient norm。

为第 k 个样本的 gradient norm。

g 的梯度密度即 GD(g) 表示落于以 g 为中心,长度为![]() 的中心区域的样本数量,然后除以有效长度进行标准化。

的中心区域的样本数量,然后除以有效长度进行标准化。

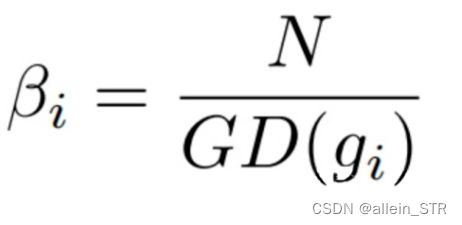

那么,梯度密度调和参数为:

N 为样本数量。

![]() 可以看作是梯度上在第 i 个样本周边样本频率的一种正则化:

可以看作是梯度上在第 i 个样本周边样本频率的一种正则化:

1. 如果所有样本的梯度是均匀分布的,那么对于每个样本 i:![]() ,意味着每个样本都没起到任何改变;

,意味着每个样本都没起到任何改变;

2. 容易样本的频率很高,那么![]() 就会变得很小,起到降低这些样本的权重的效果;并且特别困难样本即离群点的频率会比中等困难的样本频率多,意味着这些离群点的

就会变得很小,起到降低这些样本的权重的效果;并且特别困难样本即离群点的频率会比中等困难的样本频率多,意味着这些离群点的![]() 会相对较小,那么也会相对地轻微降低这些样本的权重;

会相对较小,那么也会相对地轻微降低这些样本的权重;

3. 从第 2 点可以看出,GHM 其实只适用于那些容易样本和特别困难样本的数量比中等困难样本多的场景。

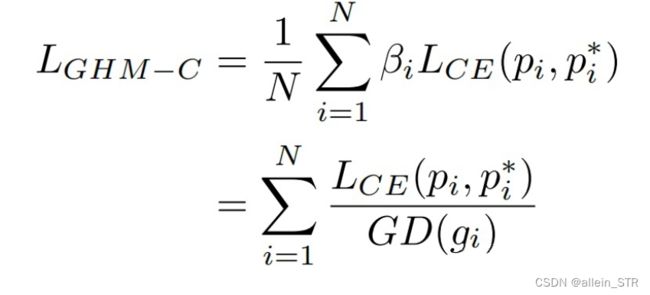

因此,经过 GHM 调和之后的 loss 为:

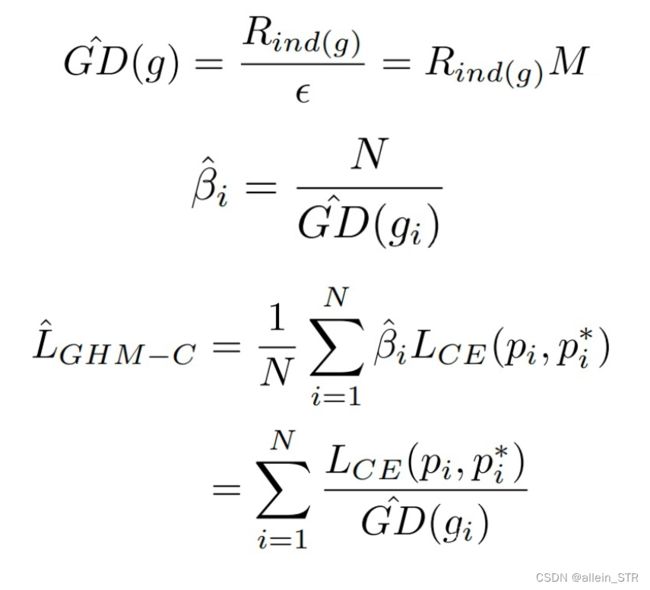

(3) 计算优化

GHM 的计算复杂度是 ![]() ,论文通过 Unit Region 的方法来逼近原生的梯度密度,大大降低了计算复杂度 .

,论文通过 Unit Region 的方法来逼近原生的梯度密度,大大降低了计算复杂度 .

首先,将 gradient norm 的值域空间 [0,1] 划分为 M 个长度为![]() 的 Unit Region。对于第 j 个 Unit Region:

的 Unit Region。对于第 j 个 Unit Region:![]() 。

。

接着,让![]() 等于落在

等于落在![]() 的样本数量;并且定义

的样本数量;并且定义 ![]() ,即计算 g 所在的 Unit Region 的索引的函数

,即计算 g 所在的 Unit Region 的索引的函数

则,梯度密度的近似函数如下,得到计算复杂度优化的 GHM Loss:

怎么理解这种近似思想呢:

1. 先回忆原生 GHM 的梯度密度计算:g 的梯度密度即 GD(g) 表示落于以 g 为中心,长度为![]() 的中心区域的样本数量,然后除以有效长度进行标准化;

的中心区域的样本数量,然后除以有效长度进行标准化;

2. 将 gradient norm 划分了 M 个 Unit Region 之后,假如第 i 个样本的 ![]() 落入第 j 个 Unit Region,那么同样落入该 Unit Region 的样本可以认为是落于以

落入第 j 个 Unit Region,那么同样落入该 Unit Region 的样本可以认为是落于以 ![]() 为中心的中心区域,并且有效长度为

为中心的中心区域,并且有效长度为![]() ,即得到上述的近似梯度密度函数

,即得到上述的近似梯度密度函数

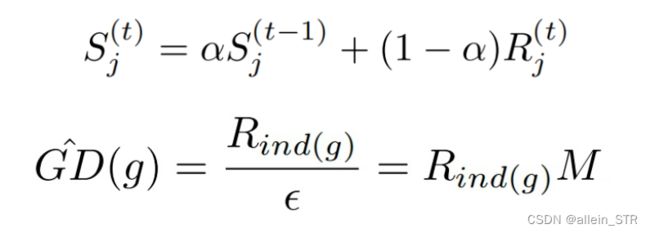

最后,在使用 Unit Region 优化之后,还结合 Exponential moving average(EMA)的思想,让梯度密度更加平滑,减少对极端数据的敏感度:

![]() 为在 t 次遍历中,落入第 j 个 Unit Region 的数量;

为在 t 次遍历中,落入第 j 个 Unit Region 的数量; ![]() 即为 EMA 中的 momentum 参数。

即为 EMA 中的 momentum 参数。

5. Dice Loss

Dice Loss 来自《Dice Loss for Data-imbalanced NLP Tasks》这篇论文

该论文观点有2:

1)负样本数量远超过正样本,导致容易的负样本会主导了模型的训练;

2)交叉熵其实是准确率(accuracy)导向的,导致了训练和测试的不一致。在训练过程中,每一个样本对目标函数的贡献是相同,但是在测试的时候,像分类任务很重要的指标 F1 score,由于正样本数量很少,每一个正样本就对于 F1 score 的贡献则更多了。

(1)Dice Coeffificient

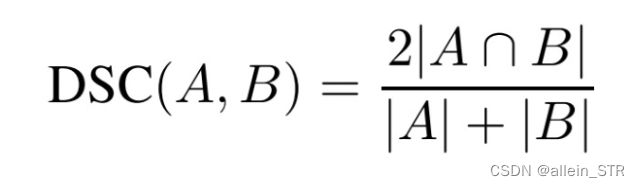

dice coeffificient 是一种 F1 导向的统计,用于计算两个集合的相似度:

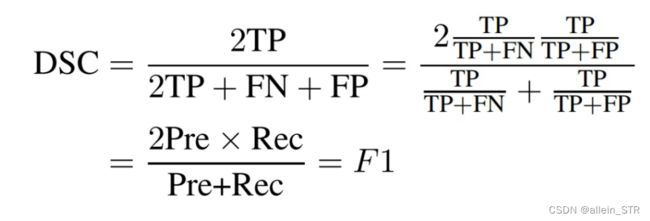

对应到二分类场景中,A 是模型预测为正样本的样本集合,B 是真实的正样本集合。此时,dice coefficient 其实等同于 F1:

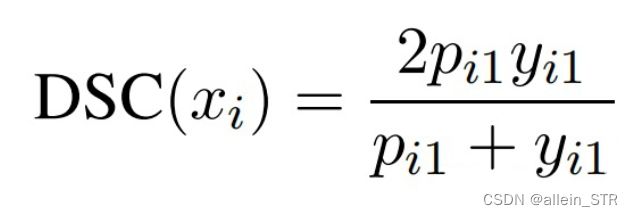

对于每一个样本![]() ,它对应 dice coefficient 的为:

,它对应 dice coefficient 的为:

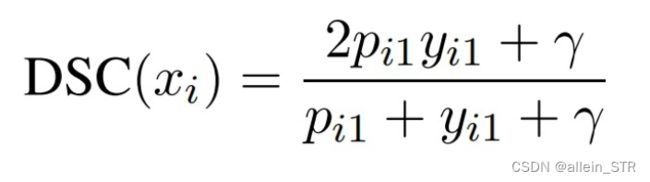

但是,显而易见,这样会导致负样本(![]() )对目标的贡献为 0。因此,为了避免负样本的作用为 0,让训练更加平滑,在分子和分母中同时加入一个因子

)对目标的贡献为 0。因此,为了避免负样本的作用为 0,让训练更加平滑,在分子和分母中同时加入一个因子![]() :

:

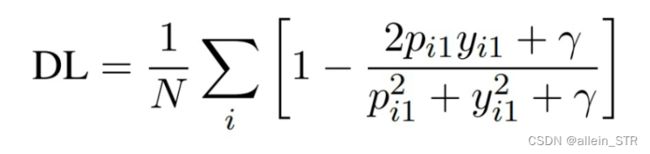

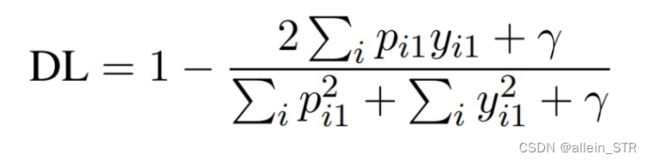

为了更快地收敛,分母可以为平方的形式,那么 Dice Loss(DL)则变为:

(修改为 1-DSC,目的是让 DSC 最大化变成目标函数最小化,这是 loss 函数常用的转换套路了,并且让 loss 为正数)

另外,以计算 set-level 的 dice coefficient,而不是独立样本的 dice coefficient 加起来,这样可以让模型更加容易学习:

(2)自调节

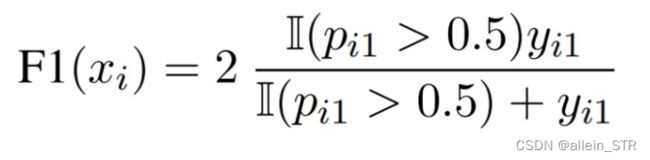

上述未经过平滑的 DSC 公式其实是 F1 的 soft 版本,因为对于 F1 score,只存在正判或误判。模型预估通常以 0.5 为边界来判断是否为正样本:

DSC 使用连续的概率 p,而不是使用二分![]() ,这种 gap 对于均衡的数据集不是什么大问题。

,这种 gap 对于均衡的数据集不是什么大问题。

但是对于大部分为容易的负样本的数据集来说,是存在极端的害处:

-

容易分类的负样本很容易主导整个训练过程,因为它们的预测概率相对来说更容易接近 0;

-

同时,模型会变得难以区分困难分类的负样本和正样本,这对于 F1 score 的表现有着很大的负向影响。

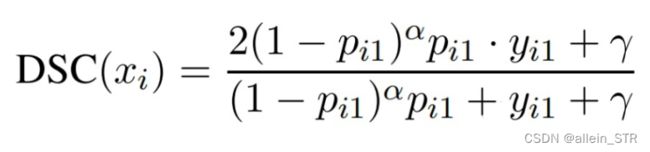

为了解决这种问题,DSC 在原来的基础上,给 soft 概率 p 乘上一个衰减因子(1-p) :

![]() 是一个与每一个样本关联的权重,并且在训练过程会动态改变,根据样本的分类难易程度,实现对样本权重的自调节:

是一个与每一个样本关联的权重,并且在训练过程会动态改变,根据样本的分类难易程度,实现对样本权重的自调节:

![]() 对于预测概率接近 0 和 1 的容易样本,该值明显小很多,可以减少模型对这些样本的关注。

对于预测概率接近 0 和 1 的容易样本,该值明显小很多,可以减少模型对这些样本的关注。

6. 标签平滑Label Smoothing

标签平滑不是针对不均衡类别设计的 loss 优化,但不失为一种提升分类模型泛化能力的有效措施。出自这篇论文《Rethinking the Inception Architecture for Computer Vision》

(1)cross-entropy

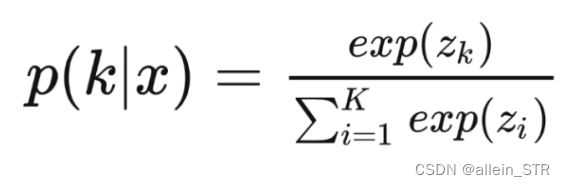

在 K 分类模型中,第 k 个 label 的预估概率为:

![]() ,

, ![]() 为 logits

为 logits

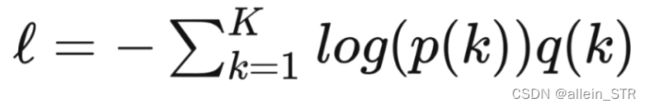

那么,对应的交叉熵 loss 则为:

(2)存在问题

对于我们的交叉熵 loss,最小化则等同于真实标签的最大似然,而仅当![]() 时才能达到最大似然,

时才能达到最大似然, ![]() 当 k=y 时为 1,其他则为 0。

当 k=y 时为 1,其他则为 0。

而对于有限值的![]() 是无法达到这种最大似然的情况,但可以接近这种情况,当所有的

是无法达到这种最大似然的情况,但可以接近这种情况,当所有的![]() for

for ![]() ,即当对应 ground-truth 的 logits 远远大于其他的 logits,直观上来看,这是由于模型对自己的预测结果太过于自信了,这会产生以下两个问题:

,即当对应 ground-truth 的 logits 远远大于其他的 logits,直观上来看,这是由于模型对自己的预测结果太过于自信了,这会产生以下两个问题:

-

它可能会造成过拟合。如果模型学习到了为每个样本的 ground-truth label 赋予完全的概率,那这无法保证泛化性;

-

它鼓励最大的 logit 和其他的 logits 差别尽可能大,再加上梯度的边界仅在 -1 到 1,这会降低模型的适应(adapt)能力。

(3)正则化

基于上述分析,作者提出了一种优化的交叉熵,增加了正则化:label-smoothing regularization

![]()

其中, ![]() 为 [0,1] 的超参数,K 为标签类别数量。

为 [0,1] 的超参数,K 为标签类别数量。

-

这种方法避免了最大的 logit 比其他 logits 太过于大,给模型增加了正则化,提升了模型的泛化能力;

-

即使发生这种情况,交叉熵 loss 会变得更大,因为不同于

,每个

,每个 都会贡献 loss。

都会贡献 loss。

7. 总结

(1)FocalLoss和DiceLoss思想比较接近,都是为了减少模型对容易样本的关注而进行的loss优化,而GHMLoss除了对容易样本降权,还实现了对特别困难样本的轻微降权,因为特别困难的样本可以认为是离群点。

(2)GHM Loss 仅适用于二分类,而 Focal Loss 和 Dice Loss 很容易扩展到多分类,但实际使用中 Focal Loss对于多分类调参比较困难(每种类别对应的 -balanced,加上 ,参数组合过于多)。

(3) Label Smoothing 虽然不是针对类别不均衡的问题,但在分类模型中,其效果往往比原生的交叉熵有些小提升。

8. 代码

https://github.com/QunBB/DeepLearning/tree/main/Trick/unbalance

参考:

分类模型:类别不均衡问题之loss设计 (qq.com)

论文:

[1]Lin, T. Y., Goyal, P., Girshick, R., He, K., & Dollár, P. (2017). Focal loss for dense object detection. In Proceedings of the IEEE international conference on computer vision (pp. 2980-2988).

[2] Li, B., Liu, Y., & Wang, X. (2019, July). Gradient harmonized single-stage detector. In Proceedings of the AAAI conference on artificial intelligence (Vol. 33, No. 01, pp. 8577-8584).

[3]Li, X., Sun, X., Meng, Y., Liang, J., Wu, F., & Li, J. (2019). Dice loss for data-imbalanced NLP tasks. arXiv preprint arXiv:1911.02855.

[4]Szegedy, C., Vanhoucke, V., Ioffe, S., Shlens, J., & Wojna, Z. (2016). Rethinking the inception architecture for computer vision. In Proceedings of the IEEE conference on computer vision and pattern recognition (pp. 2818-2826).