【论文阅读笔记】A brief introduction to weakly supervised learning

部分参考:https://blog.csdn.net/tszupup/article/details/106611822

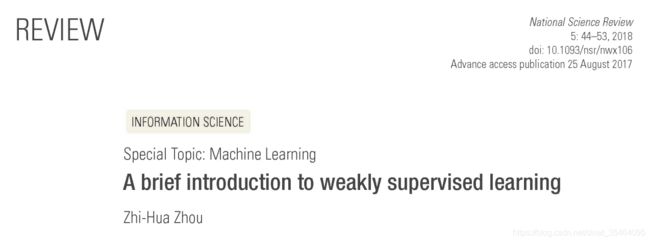

提出弱监督学习的概念。主要有这三类

-

不完全监督(incomplete supervision)——只有一部分训练数据有标签

人工标注标签代价大,通常只有一部分训练数据有标签。

解决不完全监督学习问题的两种主要技术分别是主动学习和半监督学习。

- 主动学习

利用机器学习的方法,将那些判断为“难”判断的样本交给人工专家进行标注,再将标注后的样本数据使用强监督学习或半监督学习的方式进行特征学习。

- 机器学习模型:包括机器学习模型的训练和预测

- 待标注的数据候选集提取:依赖主动学习中的查询函数(核心)

- 人工标注:经验的提炼

- 获得候选集的标注数据

- 机器学习模型的更新:通过增量学习或重新学习的方式更新模型,将人工标注数据融入到机器学习模型中,提升模型效果。

增量学习:学习系统从新样本中学习新知识,同时保存大部分已经学习到的知识

对未标注样本数据的利用主要从两个维度出发:信息量性(informativeness)和代表性(representativeness)

从信息量角度出发的代表查询策略有:

- 不确定性采样的查询(Uncertainty Sampling),将不确定的难以区分的样本分离出来,提供给人工标注,问题的关键在于如何描述样本的不确定性,通常思路有置信度最低(Least Confident)(打分,考虑最大概率)、边缘采样(Margin Sampling)(分类时处于两类之间,考虑最大和第二大的概率)、熵方法(Entropy)(以描述不确定性的熵来描述待定数据);

- 基于委员会的查询(Query-By-Committee),利用类似于委员会投票的形式,让多个模型采用投票的方式,选出难以区分的样本数据。通常使用方法有投票熵(Vote Entropy)(选择多个系统都分辨不出的样本数据,即综合多个系统对一个样本数据的分类结果,计算其熵)、平均KL散度(Average Kullback-Leibler Divergence)(利用KL散度对概率距离的描述,计算偏差较大即不确定的样本数据)

从代表性角度出发的主要是:

- 聚类方法(clustering method),主要利用未标注标签的聚类数据结构。

论文中指出:基于信息量性标准的样本选择方法的主要缺点是它们严重依赖于有标签样本构建初始的无标签样本选择模型,且该方法在只有少量有标签样本可用时性能通常不稳定;基于代表性标准的样本选择方法的主要缺点是其性能严重依赖于以无标签样本为主的数据的聚类结果。因此,最近关于主动学习的研究尝试同时利用样本的信息性和代表性。

主动学习:https://www.zhihu.com/question/352299820

- 半监督学习

半监督学习只需要少量带标签的样本和大量无标签的样本即可学习。将标签推广至无标签样本时需要基于以下三个基本假设:

- The Smoothness Assumption:相似的数据有着相似的输出(标签)

- The Cluster Assumption:处于同一个簇的数据具有相同的输出(标签)。假设输入数据点形成簇,每个簇对应于一个输出类,那么如果点在同一个簇中,则它们可以认为属于同一类。聚类假设也可以被视为低密度分离假设,即:给定的决策边界位于低密度地区。两个假设之间的关系很容易看出。一个高密度区域,可能会将一个簇分为两个不同的类别,从而产生属于同一聚类的不同类,这违反了聚类假设。在这种情况下,我们可以限制我们的模型在一些小扰动的未标记数据上具有一致的预测,以将其判定边界推到低密度区域。

- The Manifold Assumption:处于同一流型结构的数据具有相同的输出(标签),即,输入空间由多个低维流形组成,所有数据点均位于其上;位于同一流形上的数据点具有相同标签。

目前主流的半监督学习方法有四种:

- 基于生成的方法(generative methods):假设所有的有标签、无标签样本都是从同一个分布生成的。对于无标签的样本可以认为缺失了部分模型参数,可以用EM算法估计;为了获得良好的性能,通常需要领域知识来确定合适的生成模型,这也是将生成方法和区分方法的优点结合起来的尝试。

- 基于图的方法(graph-based methods):将样本作为点、样本之间的关系作为边(相似性或距离),标签根据某种规则在图上传播;这种方法的效果依赖于构建图的方式。缺陷在于图的方法对存储空间和算力的要求高,且遇到新的样本数据时很难结合进来。

- 基于低密度隔离的方法(low-density separation methods):分类边界位于样本空间中较为稀疏的区域;其中较为著名的为S3VM方法(semi-supervised support vector machine),试图寻找既能将不同标签样本区分开,同时也穿过数据低密度区的超平面。图示传统SVM和S3VM划分数据的区别。

- 基于不一致性的方法(disagreement-based methods):多个学习器合作利用未标注数据。其中较为著名的方法是协同训练(co-training),利用不同数据、不同特征、不同的算法、不同的参数,训练不同的模型,利用它们之间的相容性(不同模型的最终输出空间是一致的)与互补性(不同模型从不同的视角看待问题,互相补充),提高弱分类器的泛化能力。这种类型的方法其实提供了一个将主动学习和半监督学习结合在一起的一个思路:让两个学习器互相学习,对于某些为标注样本,当出现多个学习器都不确定或非常确定但结论矛盾的情况,可以作为主动学习的查询条件。

半监督学习:

https://zhuanlan.zhihu.com/p/55701854(包含一些半监督学习方法的介绍和归纳)

https://zhuanlan.zhihu.com/p/252343352(包含相关论文和开源代码)

- 不确切监督(inextra supervision)——训练数据只有粗粒度的标签

例如在图像识别任务中,仅有图像级别的标签,而没有我们需要的对象级别标签。论文中举例了一个典型的应用场景:药物活性预测,目标是建立模型,从目前已经掌握的一系列分子学习,预测一个新分子是否适合制作特殊的药物。一个分子可以有多个低能量形态,一个分子是否适合制作药物取决于分子是否有特殊的分子结构。药学专家仅能了解分子是否适合,并不了解是哪一个特殊分子结构起到了决定性作用。

多示例学习(multi-instance learning)的场景是数据是一个包含多个示例(instance)的包(bag),在二分类问题中,当包内所有示例为负示例,那么这个包被标记为(negative)。

已经有许多有效的算法应用在多示例学习上。大部分算法将使用与单一示例监督的学习算法推广到多示例表示中,主要是将关注点从对示例的差异转移到对包的差异上。或寻找单一示例到多示例的表示转换,将包、示例、两者之间的embedding分别投射在对应的空间里。注意,在算法中经常讲示例认为是独立同分布的样本(i.i.d sample)(在概率统计理论中,如果变量序列或者其他随机变量有相同的概率分布,并且互相独立,那么这些随机变量是独立同分布),但实际上在MIL中,示例不可以被假设为相互独立无关的样本。

目前多示例学习已经成功应用在多种任务中,例如图像分类\检索\标注、文本分类、垃圾邮件检测、医学诊断、人脸\目标检测、目标类发现、目标跟踪等。在具体任务中其实多示例的包和示例的概念有着具体且自然的对应,但在有些任务中并没有这些清晰的对应,有些时候也需要包生成器(bag generator)来生成包。

MIL的最初目标是对于不可见的包进行标签预测。有一些研究试图用关键示例(key instance)对包的标签进行判断。值得注意的是,标准的MIL假设每一个positive的包必定包含一个key instance,但是还有一些研究中认为包中的每一个示例都对包的标签的判定有贡献。甚至还有假说认为存在有多个概念,只有当bag包含满足每个概念的实例时,包才是positive的。

早期的理论研究中认为,MIL不适用于包中每个实例按照不同的规则进行分类的异构情况(heterogeneous),适用于包中每个实例按照相同的规则进行分类的同构情况(homogeneous)与算法和应用研究的蓬勃发展相比,MIL的理论成果却非常稀少,因为相关的分析比较困难。

多示例学习:https://zhuanlan.zhihu.com/p/299819082

- 不准确监督(inaccurate supervision)——给定的训练样本标签不一定正确

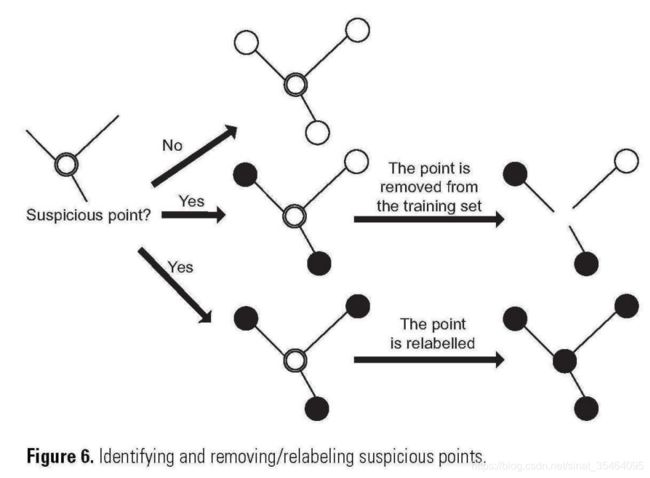

不准确监督的典型场景即在有标签噪声的情况下学习(标签受随机噪声的影响)。在实际中,一般是先鉴别出错误标签的样本,再将其修正。论文中举例了data editing为例子。data-editing在训练样例中构建相对邻域图,若一条边连接的两个数据标签为不同时,称它为cut edge。若某个示例周围多条cut edge,可以认为该示例的标签是可疑的,可以通过移除(remove)或重新标注(relabel)的方法修改。值得注意的是,该方法仅依赖邻近的数据信息,在高维特征空间时可信度不高,因为高维特征空间中数据稀疏,稀疏的邻近节点的信息不够有信服力。

不准确监督有一个有趣的应用场景,“众包”(crowdsourcing)。将标注任务发布给众多用户,用户通过标注获取微小的收益,数据收集方可为训练数据廉价地获取标注。但在这个过程中可能存在标注的用户经验不足、有作弊工具完成、故意标注错误等可能性造成标注的不准确。许多研究试图从人群中推断出ground-truth。多数投票策略在实际中被广泛应用,常被作为基线。为了让crowdsourcing获得更好的效果,可以对标注工人和任务难度进行建模,对不同的标注工人和不同任务赋予权重。为了达到这个目的可以采用一些概率模型,应用EM算法或minimax entropy对其进行评估。针对作弊者和低质量工作者的淘汰也提出了一些理论条件。(从提高标签的质量入手)。

一方面可以考虑提高标签质量,另一方面也可以考虑如何从带噪的标签中进行学习。(之前提及的方法)对于众包来说,应当最小化代价且获取有效的众包学习。有些研究从任务发布和预算分配入手,尝试平衡正确率和花销。有些研究基于Dawid-Skene模型进行研究。

设计一个有效的众包策略也是重要的,例如“不确定”选项的加入,提高标签的可信度。"double or nothing"策略的加入,确保标注数据的工人诚实,防止作弊者加入其中。

(众包领域部分其实看得不是很懂……)