Sklearn GridSearchCV跑SVM很慢或卡死解决办法,SVM线性核函数卡死

今天跑人工智能SVM实验,想试一下线性核函数,结果卡死了,很久也不出结果,但之前使用高斯核函数是没问题的。历经千辛万苦终于找到了原因,记录一下,希望对后人有帮助。本人只是个做作业的小菜菜,如有不对欢迎指正!

参考了以下文章:

关于Python Sklearn SVM 为什么运行很慢得到结果的原因

https://blog.csdn.net/zhike5110/article/details/88878812

大致原因

SVM需要不断寻找最能区分数据的超平面,直至收敛。我们以线性(Linear)核函数为例,如果数据间有明显的线性关系时,SVM就能很快找到这个超平面,达到收敛。但如果数据间无明显的线性关系,即使数据量很小,也很难找到这个超平面,导致迟迟不收敛。具体解释请看上面附的原文章。

解决方法

原代码

我原来的代码如下。使用的是线性核函数。

import time

from sklearn.metrics import accuracy_score

from sklearn.metrics import f1_score

from sklearn.model_selection import train_test_split

from sklearn.model_selection import GridSearchCV

from sklearn.svm import SVC

# 读取训练集并切分

X, Y = load_data()

X_train, X_test, y_train, y_test = train_test_split(X, Y, test_size=0.2, random_state=0)

# 参数

parameters = [

{

'kernel': ['linear'], # 线性核函数

'C': [1 * 10**i for i in range(-3, 11)],

'class_weight': ['balanced'] #样本均衡度

}

]

# 参数调优

clf = GridSearchCV(estimator=SVC(), param_grid=parameters, cv=8, n_jobs=5, scoring='f1_macro')

start = time.time()

clf.fit(X_train, y_train)

elapsed = time.time() - start

print("Fitting finished in %d min %d s" % (elapsed / 60, elapsed % 60))

print("Best set score:{:.2f}".format(clf.best_score_))

print("Best parameters:{}".format(clf.best_params_))

print("Test set score:{:.2f}".format(clf.score(X_test, y_test)))

使用上面的参数跑了很久也不出结果,把参数组合数量调少也不行。

方法一:限制最大迭代次数

设置最大迭代次数参数max_iter。max_iter默认为-1,表示直至计算出收敛的超平面才停止。将其设为一个合适的正整数即可。

设置max_iter参数:

parameters = [

{

'kernel': ['linear'], # 线性核函数

'C': [1 * 10**i for i in range(-3, 11)],

'class_weight': ['balanced'], # 样本均衡度

'max_iter': [1000000] # 限制最多迭代1000000次

},

]

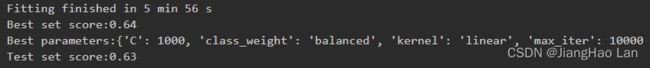

跑了有5分多钟,得到结果:

方法二:改用其他的核函数

改用非线性的核函数,比如常用的高斯核函数(也叫径向基核函数)、多项式核函数,可能能够正常收敛。

采用高斯核函数(Radial Basis Function,RBF)

采用高斯核函数,参数如下:

parameters = [

{

'kernel': ['rbf'], # 高斯核函数

'C': [1 * 10**i for i in range(-3, 11)],

'gamma': [1 * 10**i for i in range(-10, 4)],

'class_weight': ['balanced'] # 样本均衡度

}

]

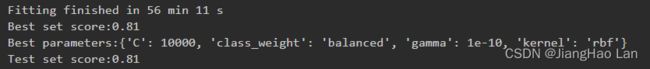

参数组合数量翻倍了,需要耐心等待。训练时间56分钟,结果:

采用多项式核函数(Polynomial Kernel)

我又尝试了多项式核函数,但对于我的数据仍然不好收敛,因此,只好也加上max_iter参数:

parameters = [

{

'kernel': ['poly'], # 多项式核函数

'C': [1 * 10**i for i in range(-3, 11)],

'degree': range(2, 10),

'class_weight': ['balanced'], #样本均衡度

'max_iter': [1000000] # 限制最多迭代1000000次

}

]

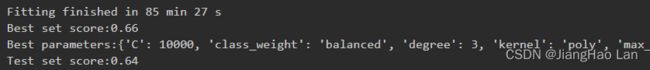

参数组合数量仍然比较多。训练时间85分钟。结果如下:

换核函数还是不行?

原因是不同的参数组合也会影响收敛的速度。比如在我的实验中,采用高斯核函数,如果gamma设置过小也迟迟不出结果。建议解决方法如下:

- 先使用少的参数组合数量,降低试错成本。先不要刚上来就设置过多的参数组合数量,要不然跑的太慢,你无法知道是正常在跑还是收敛慢了,最后跑了几个小时跑不出来才发现不对劲。如果用少量的参数组合很快跑出来了,就尝试加多参数组合数量,看还能不能跑出来;

- 也可以设置一个较大的

max_iter参数。这样的话能防止收敛慢的参数组合无限制地跑下去,正常收敛的参数组合也不会受影响。

SVM教程推荐

推荐浙江大学胡浩基老师的SVM课程,讲的非常清楚:

浙大胡浩基老师SVM:

https://www.bilibili.com/video/BV1jt4y1E7BQ/?spm_id_from=333.337.search-card.all.click&vd_source=44f1ad5d101e28cd116fe2918182d1b6

B站也有胡老师完整的机器学习课程视频,感兴趣的同学可以去找找。