- 【论文阅读】PERSONALIZE SEGMENT ANYTHING MODEL WITH ONE SHOT

s1ckrain

计算机视觉论文阅读计算机视觉人工智能

PERSONALIZESEGMENTANYTHINGMODELWITHONESHOT原文摘要研究背景与问题:SAM是一个基于大规模数据预训练的强大提示框架,推动了分割领域的发展。尽管SAM具有通用性,但在无需人工提示的情况下,针对特定视觉概念(如自动分割用户宠物狗)的定制化研究尚不充分。方法提出:提出了一种无需训练的SAM个性化方法,称为PerSAM。仅需单次数据(一张带参考掩码的图像),即可在新

- GS-SLAM论文阅读笔记-MGSO

zenpluck

GS论文阅读论文阅读笔记

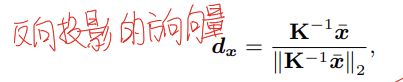

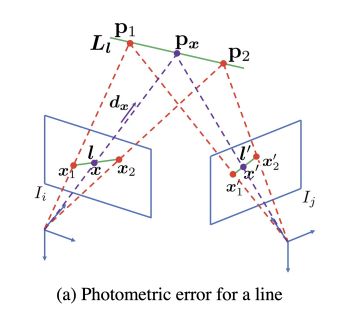

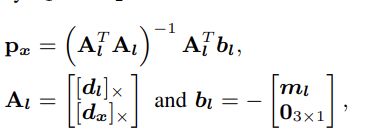

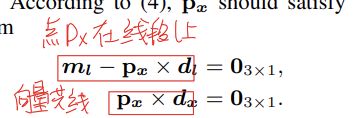

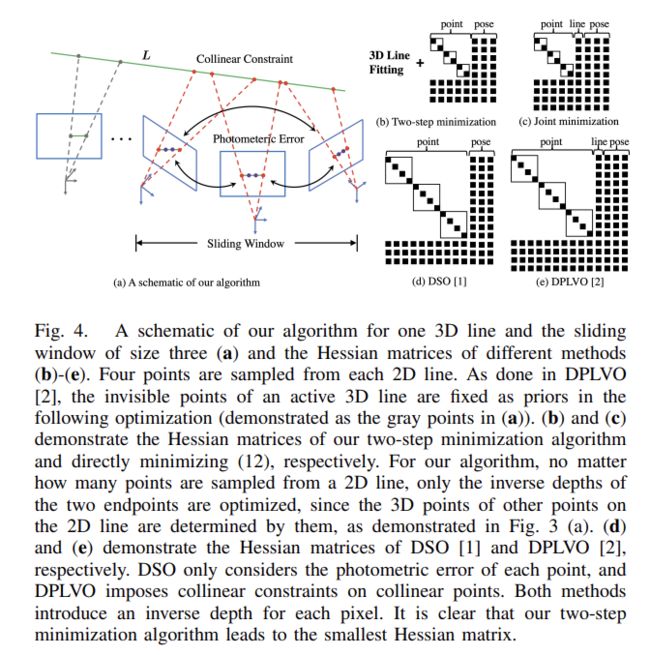

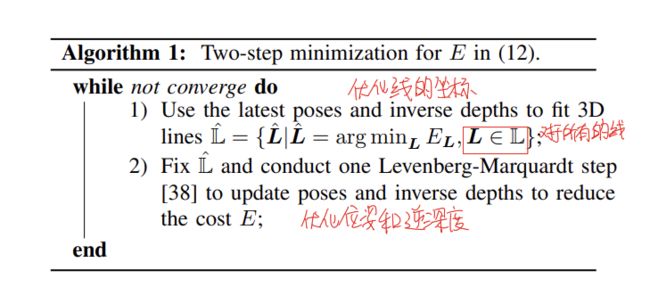

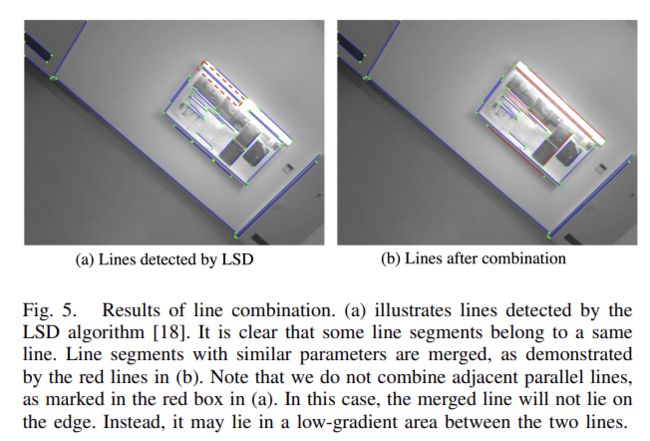

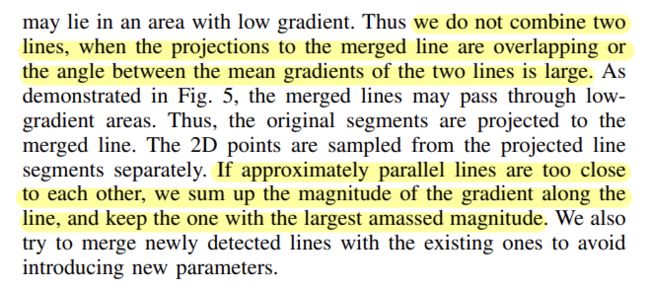

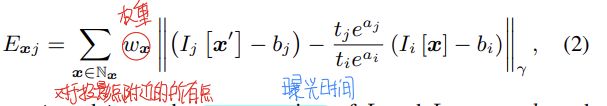

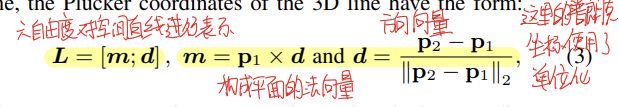

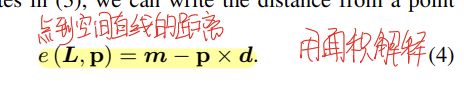

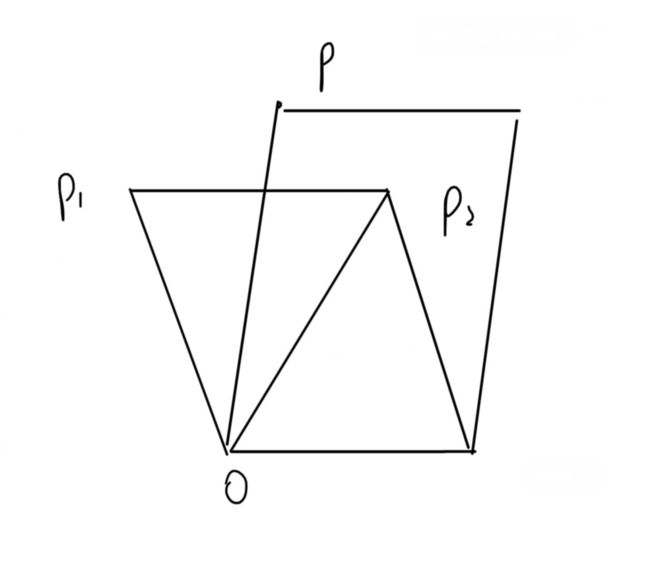

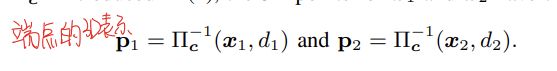

前言MGSO首字母缩略词是直接稀疏里程计(DSO),我们建立的光度SLAM系统和高斯飞溅(GS)的混合。这应该是第一个前端用DSO的高斯SLAM,不知道这个系统的组合能不能打得过ORB-SLAM3,以及对DSO会做出怎么样的改进以适应高斯地图,接下来就看一下吧!GishelloG^s_ihelloGishello我是红色文章目录前言1.背景介绍2.关键内容2.1SLAMmodule2.2Dense

- 【论文阅读】MMedPO: 用临床感知多模态偏好优化调整医学视觉语言模型

勤奋的小笼包

论文阅读语言模型人工智能自然语言处理chatgpt

MMedPO:用临床感知多模态偏好优化调整医学视觉语言模型1.背景2.核心问题:3.方法:3.实验结果与优势4.技术贡献与意义5.结论MMedPO:AligningMedicalVision-LanguageModelswithClinical-AwareMultimodalPreferenceOptimizationMMedPO:用临床感知多模态偏好优化调整医学视觉语言模型gitgub:地址1.

- 论文阅读:Deep Stacked Hierarchical Multi-patch Network for Image Deblurring

行走的歌

文献阅读图像处理计算机视觉机器学习深度学习图像去雨图像处理

这是一篇去模糊的文章,后来发现直接套用不合适,无法获取到相应的特征,遂作罢,简单记录一下。2019CVPR:DMPHN这篇文章是2019CVPR的一篇去模糊方向的文章,师兄分享的时候看了一下,后来也发现这个网络结构在很多workshop以及文章中都见过。文章:ArXiv代码:Github在去模糊领域,目前的多尺度和尺度循环模型存在一些问题:1)由粗到细方案中的去卷积/上采样操作导致运行时间昂贵;2

- 【论文阅读方法】沐神课程:如何读论文

晴空对晚照

论文阅读论文阅读

一篇论文的一般结构titleabstractintroductionmethodexperienceconclusion三明治论文阅读法第一遍:海选title+abstract+conclusion——确定要不要读第二遍:精读对整个文章过一遍,知道每一块在做什么可以从标题开始读到最后,注意不用咬文嚼字,不要太细节,公式、证明等很细节的部分可以忽略掉重点弄清楚每一个图表,算法在做什么,x轴y轴每一个

- 论文阅读笔记——QLORA: Efficient Finetuning of Quantized LLMs

寻丶幽风

论文阅读笔记论文阅读笔记人工智能深度学习语言模型

QLoRA论文4-bit标准浮点数量化常见的量化技术是最大绝对值量化:XInt8=round(127absmax(XFP32)XFP32)=round(cFP32,XFP32)式(1)X^{Int8}=round(\frac{127}{absmax(X^{FP32})}X^{FP32})=round(c^{FP32},X^{FP32})\qquad\qquad\text{式(1)}XInt8=ro

- 论文阅读:Personalized Purchase Prediction of Market with Wasserstein-Based Sequence Matching

Narcissus`小暮

一步步来学大数据推荐系统

PersonalizedPurchasePredictionofMarketwithWasserstein-BasedSequenceMatching概述问题背景及陈述预测算法步骤一:itemembeddings步骤二:计算wassersteinDistance步骤三:Wasserstein-BasedDynamicTimeWarping预测实验评价标准数据集对比的baseline结论市场篮子的应

- 论文阅读笔记:Graph Matching Networks for Learning the Similarity of Graph Structured Objects

游离态GLZ不可能是金融技术宅

知识图谱机器学习深度学习人工智能

论文做的是用于图匹配的神经网络研究,作者做出了两点贡献:证明GNN可以经过训练,产生嵌入graph-leve的向量可以用于相似性计算。作者提出了一种新的基于注意力的跨图匹配机制GMN(cross-graphattention-basedmatchingmechanism),来计算出一对图之间的相似度评分。(核心创新点)论文证明了该模型在不同领域的有效性,包括具有挑战性的基于控制流图(control

- 论文阅读 EEG-TCNet

Plan-C-

论文阅读

EEG-TCNet:AnAccurateTemporalConvolutionalNetworkforEmbeddedMotor-ImageryBrain–MachineInterfaces1.Intrduction本文提出了一种新颖的时间卷积网络(TCN),在需要很少的可训练参数的情况下实现了出色的精度。EG-TCNET成功地推广了单个数据集,通过0.25的元效应优于MOABB的当前最新技术水平

- 论文阅读《Semantic Stereo Matching with Pyramid Cost Volumes》

cunese0088

深度学习

SSPCV-Net(语义立体匹配网络)目的:进一步捕捉视差的细节主要模块:数据集:SceneFlow,KITTI2012,KITTI2015,Cityscape(比较泛化能力)-------------------------------------------------------------------------------------------------------Concatevo

- 论文阅读笔记——π0: A Vision-Language-Action Flow Model for General Robot Control

寻丶幽风

论文阅读笔记论文阅读笔记人工智能机器人语言模型

π0论文π0π_0π0是基于预训练的VLM模型增加了actionexpert,并结合了flowmatching方法训练的自回归模型,能够直接输出模型的actionchunk(50)。π0采用FlowMatching技术来建模连续动作的分布,这一创新使模型能够精确控制高频率的灵巧操作任务,同时具备处理多模态数据的能力。架构受到Transfusion的启发:通过单一Transformer处理多目标任务

- 【论文阅读】Learning Transferable Visual Models From Natural Language Supervision(2021)

Bosenya12

论文阅读

摘要State-of-the-art(最先进的)computervisionsystems(计算机视觉系统)aretrainedtopredictafixedsetofpredeterminedobjectcategories(被训练来预测一组固定的预定对象类别).Thisrestrictedformofsupervision(受限制的监督形式)limitstheirgenerality(通用性)

- InternVL:论文阅读 -- 多模态大模型(视觉语言模型)

XiaoJ1234567

LLM论文阅读语言模型人工智能多模态大模型internVL

更多内容:XiaoJ的知识星球文章目录InternVL:扩展视觉基础模型与通用视觉语言任务对齐1.概述2.InternVL整体架构1)大型视觉编码器:InternViT-6B2)语言中间件:QLLaMA。3)训练策略(1)第一阶段:视觉-语言对比训练(2)第二阶段:视觉语言生成训练(3)第三阶段:监督微调(SFT)3.InternVL应用1)对于视觉感知任务2)对于对比任务3)对于生成任务4)对于

- 论文阅读-秦汉时期北方边疆组织的空间互动模式与直道的定位(中国)

MilkLeong

论文阅读空间计算

论文英文题目:AspatialinteractionmodelofQin-HanDynastyorganisationonthenorthernfrontierandthelocationoftheZhidaohighway(China)发表于:journalofarchaeologicalscience,影响因子:3.030论文主要是使用空间互动模型来对秦汉时期的北方边疆直道进行定位和重建。分析

- 论文阅读笔记——Learning Fine-Grained Bimanual Manipulation with Low-Cost Hardware

寻丶幽风

论文阅读笔记论文阅读笔记人工智能深度学习机器人

ALOHA论文ALOHA解决了策略中的错误可能随时间累积,且人类演示可能是非平稳的,提出了ACT(ActionChunkingwithTransformers)方法。ActionChunking模仿学习中,compoundingerror是致使任务失败的主要原因。具体来说,当智能体(agent)在测试时遇到训练集中未见过的情况时,可能会产生预测误差。这些误差会逐步累积,导致智能体进入未知状态,最终

- 【论文阅读】LayoutPrompter: Awaken the Design Ability of Large Language Models

进击的乔洋

论文阅读语言模型人工智能

LayoutPrompter:AwakentheDesignAbilityofLargeLanguageModelsabstract条件图形布局生成是一种自动将用户约束映射为高质量布局的技术,目前受到了广泛关注。尽管最近的工作取得了很好的性能,但缺乏通用性和数据效率阻碍了它们的实际应用。本文提出Layout-Prompter,利用大型语言模型(llm)通过上下文学习来解决上述问题。LayoutPr

- 论文阅读方法

某风吾起

work哲学与人生论文阅读

文章目录步骤一:对论文进行自我判断阅读题目和关键词。阅读摘要阅读总结要点步骤二:阅读文章阅读图表和图表的注释阅读引言阅读实验部分阅读结果和作者对结果的讨论(创新点)要点步骤三:精度论文回答问题1回答问题2回答问题3要点步骤一:对论文进行自我判断阅读题目和关键词。观察这些关键词是否与你的研究的内容有关。如果不相干,可以随时停止,换篇文章看。阅读摘要摘要一般包含了整篇文章的主要内容,是非常非常重要的部

- 论文阅读:Recipe for a General, Powerful, Scalable Graph Transformer

不会&编程

图神经网络论文阅读论文阅读transformer深度学习图神经网络人工智能

RecipeforaGeneral,Powerful,ScalableGraphTransformer论文和代码地址1介绍与贡献2GPS模型2.1模型框架图2.2PE和SE2.3GPSlayer:一种MPNN+Transformer的混合模型GraphTransformer)论文和代码地址论文地址:https://arxiv.org/pdf/2205.12454v4代码地址:https://git

- Self-Attentive Sequential Recommendation论文阅读笔记

调包调参侠

推荐系统学习深度学习机器学习神经网络算法

SASRec论文阅读笔记论文标题:Self-AttentiveSequentialRecommendation发表于:2018ICDM作者:Wang-ChengKang,JulianMcAuley论文代码:https://github.com/pmixer/SASRec.pytorch论文地址:https://arxiv.org/pdf/1808.09781v1.pdf摘要顺序动态是许多现代推荐系

- Angular Superresolution of Real Aperture Radar for Target Scale Measurement 论文阅读

青铜锁00

论文阅读Radar论文阅读

AngularSuperresolutionofRealApertureRadarforTargetScaleMeasurement1.研究目标与实际意义1.1研究目标1.2实际意义2.创新方法与模型设计2.1广义混合正则化(GHR)框架核心公式与传统方法对比2.2自适应迭代重加权(AIR)求解器算法设计复杂度分析3.实验设计与结果验证3.1仿真实验实验设置关键结果3.2实际数据验证4.未来研究方

- Angular Superresolution of Real Aperture Radar Using Online Detect-Before-Reconstruct Framework 论文阅读

青铜锁00

论文阅读Radar论文阅读

AngularSuperresolutionofRealApertureRadarUsingOnlineDetect-Before-ReconstructFramework1.论文的研究目标与实际问题意义1.1研究目标1.2实际问题与产业意义2.论文的创新方法、模型与公式分析(重点)2.1核心创新点2.2关键公式与模型2.2.1信号模型2.2.2稀疏正则化优化问题2.2.3坐标循环最小化2.2.4

- 论文阅读笔记2

sixfrogs

论文阅读笔记论文阅读cnn

OptimizingMemoryEfficiencyforDeepConvolutionalNeuralNetworksonGPUs1论文简介作者研究了CNN各层的访存效率,并揭示了数据结构和访存模式对CNN的性能影响。并提出了优化方法。2方法介绍2.1Benchmarks数据集:MNIST,CIFAR,ImageNetCNN:AlexNet,ZFNet,VGG2.2实验设置CPU:IntelXe

- [论文阅读]DAMO-YOLO——实时目标检测设计报告

一朵小红花HH

知识蒸馏目标检测YOLO目标检测目标跟踪论文阅读人工智能

DAMO-YOLODAMO-YOLO:AReportonReal-TimeObjectDetectionDesign实时目标检测设计报告论文网址:DAMO-YOLO简读论文这篇论文介绍了一个名为DAMO-YOLO的新型目标检测方法,相比YOLO系列的其他方法有着更好的性能。该方法的优势来自于几项新技术:使用了MAE-NAS作为骨干网络,可以自动搜索出不同延迟预算下的优化网络结构。MAE-NAS被称

- 大模型隐空间推理论文阅读笔记

猴猴猪猪

AIGCpython实验记录人工智能深度学习

文章目录TrainingLargeLanguageModelstoReasoninaContinuousLatentSpace一.简介1.1摘要1.2引言TrainingLargeLanguageModelstoReasoninaContinuousLatentSpace一.简介机构:Meta代码:任务:特点:方法:1.1摘要现状:大语言模型往往局限在“languagespace"进行推理,在解决

- 【网安AIGC专题】46篇前沿代码大模型论文、24篇论文阅读笔记汇总_大模型在代码缺陷检测领域的应用实践(1)

2401_84972910

程序员AIGC论文阅读笔记

欢迎一起踏上探险之旅,挖掘无限可能,共同成长!写在最前面本文为邹德清教授的《网络安全专题》课堂笔记系列的文章,本次专题主题为大模型。本系列文章不仅涵盖了46篇关于前沿代码大模型的论文,还包含了24篇深度论文阅读笔记,全面覆盖了代码生成、漏洞检测、程序修复、生成测试等多个应用方向,深刻展示了这些技术如何在网络安全领域中起到革命性作用。同时,本系列还细致地介绍了大模型技术的基础架构、增强策略、关键数据

- OAK相机:纯视觉SLAM在夜晚的应用

OAK中国_官方

人工智能机器学习SLAM

哈喽,OAK的朋友们,大家好啊,今天这个视频主要想分享一下袁博士团队用我们的OAK相机产出的新成果在去年过山车SLAM的演示中,袁博士团队就展示了纯视觉SLAM在完全黑暗的环境中的极高鲁棒性。现在袁博士团队进一步挖掘了纯视觉的潜力,于是又专门录了一段夜间的演示给我们展示了在完全黑暗及光线变化的环境中可靠工作的VIO、回环检测及适用于大场景的内存管理技术。他们现在已将整套VSLAM方案包含在Fact

- An Iterative Technique for the Rectification of Observed Distributions 论文阅读

青铜锁00

论文阅读论文阅读

AnIterativeTechniquefortheRectificationofObservedDistributions-L.B.Lucy1.研究目标与实际意义1.1研究目标1.2实际意义2.新方法与公式分析2.1核心思路:基于贝叶斯定理的迭代框架2.1.1贝叶斯逆概率公式2.1.2迭代更新规则2.1.3多维推广2.2方法优势2.3对比传统方法3.实验验证3.1数值实验设计3.2关键结果4.雷

- Azimuth Superresolution of Forward-Looking Radar Imaging Which Relies on Linearized Bregman论文阅读

青铜锁00

论文阅读Radar论文阅读

AzimuthSuperresolutionofForward-LookingRadarImagingWhichReliesonLinearizedBregman1.论文的研究目标与意义1.1研究目标1.2实际应用意义2.论文提出的新方法、公式与优势(重点)2.1方法框架2.1.1贝叶斯建模2.1.2线性化Bregman算法2.2与传统方法的对比2.3公式总结3.实验设计与结果3.1点目标仿真3.

- A Bayesian Angular Superresolution Method With Lognormal Constraint for Sea-Surface Target 论文阅读

青铜锁00

论文阅读Radar论文阅读

目录1.研究背景与问题2.方法创新3.关键优势4.实验验证5.与传统方法对比6.结论与意义1.研究背景与问题核心挑战:实孔径雷达受限于天线孔径尺寸,导致角分辨率不足,影响海面目标(如船舶)的精细化探测。传统方法局限性:谱估计方法(如MUSIC、IAA):依赖多快拍数据,机械扫描雷达难以满足。正则化方法(如TSVD、l1/l2约束):假设噪声服从高斯分布,未考虑海杂波的非高斯特性(如Rayleigh

- 论文阅读笔记——Prediction with Action: Visual Policy Learning via Joint Denoising Process

寻丶幽风

论文阅读笔记论文阅读笔记人工智能

以前的method是输入视频输出视频或者输入视频和action学习action,该方法认为action,video和othercondition具有一定联系,所以一次性对所有的进行jointdenoise。网络结构采用MaskedMulti-headAttention关联不同模态,使用DiT的backbone。

- [星球大战]阿纳金的背叛

comsci

本来杰迪圣殿的长老是不同意让阿纳金接受训练的.........

但是由于政治原因,长老会妥协了...这给邪恶的力量带来了机会

所以......现代的地球联邦接受了这个教训...绝对不让某些年轻人进入学院

- 看懂它,你就可以任性的玩耍了!

aijuans

JavaScript

javascript作为前端开发的标配技能,如果不掌握好它的三大特点:1.原型 2.作用域 3. 闭包 ,又怎么可以说你学好了这门语言呢?如果标配的技能都没有撑握好,怎么可以任性的玩耍呢?怎么验证自己学好了以上三个基本点呢,我找到一段不错的代码,稍加改动,如果能够读懂它,那么你就可以任性了。

function jClass(b

- Java常用工具包 Jodd

Kai_Ge

javajodd

Jodd 是一个开源的 Java 工具集, 包含一些实用的工具类和小型框架。简单,却很强大! 写道 Jodd = Tools + IoC + MVC + DB + AOP + TX + JSON + HTML < 1.5 Mb

Jodd 被分成众多模块,按需选择,其中

工具类模块有:

jodd-core &nb

- SpringMvc下载

120153216

springMVC

@RequestMapping(value = WebUrlConstant.DOWNLOAD)

public void download(HttpServletRequest request,HttpServletResponse response,String fileName) {

OutputStream os = null;

InputStream is = null;

- Python 标准异常总结

2002wmj

python

Python标准异常总结

AssertionError 断言语句(assert)失败 AttributeError 尝试访问未知的对象属性 EOFError 用户输入文件末尾标志EOF(Ctrl+d) FloatingPointError 浮点计算错误 GeneratorExit generator.close()方法被调用的时候 ImportError 导入模块失

- SQL函数返回临时表结构的数据用于查询

357029540

SQL Server

这两天在做一个查询的SQL,这个SQL的一个条件是通过游标实现另外两张表查询出一个多条数据,这些数据都是INT类型,然后用IN条件进行查询,并且查询这两张表需要通过外部传入参数才能查询出所需数据,于是想到了用SQL函数返回值,并且也这样做了,由于是返回多条数据,所以把查询出来的INT类型值都拼接为了字符串,这时就遇到问题了,在查询SQL中因为条件是INT值,SQL函数的CAST和CONVERST都

- java 时间格式化 | 比较大小| 时区 个人笔记

7454103

javaeclipsetomcatcMyEclipse

个人总结! 不当之处多多包含!

引用 1.0 如何设置 tomcat 的时区:

位置:(catalina.bat---JAVA_OPTS 下面加上)

set JAVA_OPT

- 时间获取Clander的用法

adminjun

Clander时间

/**

* 得到几天前的时间

* @param d

* @param day

* @return

*/

public static Date getDateBefore(Date d,int day){

Calend

- JVM初探与设置

aijuans

java

JVM是Java Virtual Machine(Java虚拟机)的缩写,JVM是一种用于计算设备的规范,它是一个虚构出来的计算机,是通过在实际的计算机上仿真模拟各种计算机功能来实现的。Java虚拟机包括一套字节码指令集、一组寄存器、一个栈、一个垃圾回收堆和一个存储方法域。 JVM屏蔽了与具体操作系统平台相关的信息,使Java程序只需生成在Java虚拟机上运行的目标代码(字节码),就可以在多种平台

- SQL中ON和WHERE的区别

avords

SQL中ON和WHERE的区别

数据库在通过连接两张或多张表来返回记录时,都会生成一张中间的临时表,然后再将这张临时表返回给用户。 www.2cto.com 在使用left jion时,on和where条件的区别如下: 1、 on条件是在生成临时表时使用的条件,它不管on中的条件是否为真,都会返回左边表中的记录。

- 说说自信

houxinyou

工作生活

自信的来源分为两种,一种是源于实力,一种源于头脑.实力是一个综合的评定,有自身的能力,能利用的资源等.比如我想去月亮上,要身体素质过硬,还要有飞船等等一系列的东西.这些都属于实力的一部分.而头脑不同,只要你头脑够简单就可以了!同样要上月亮上,你想,我一跳,1米,我多跳几下,跳个几年,应该就到了!什么?你说我会往下掉?你笨呀你!找个东西踩一下不就行了吗?

无论工作还

- WEBLOGIC事务超时设置

bijian1013

weblogicjta事务超时

系统中统计数据,由于调用统计过程,执行时间超过了weblogic设置的时间,提示如下错误:

统计数据出错!

原因:The transaction is no longer active - status: 'Rolling Back. [Reason=weblogic.transaction.internal

- 两年已过去,再看该如何快速融入新团队

bingyingao

java互联网融入架构新团队

偶得的空闲,翻到了两年前的帖子

该如何快速融入一个新团队,有所感触,就记下来,为下一个两年后的今天做参考。

时隔两年半之后的今天,再来看当初的这个博客,别有一番滋味。而我已经于今年三月份离开了当初所在的团队,加入另外的一个项目组,2011年的这篇博客之后的时光,我很好的融入了那个团队,而直到现在和同事们关系都特别好。大家在短短一年半的时间离一起经历了一

- 【Spark七十七】Spark分析Nginx和Apache的access.log

bit1129

apache

Spark分析Nginx和Apache的access.log,第一个问题是要对Nginx和Apache的access.log文件进行按行解析,按行解析就的方法是正则表达式:

Nginx的access.log解析正则表达式

val PATTERN = """([^ ]*) ([^ ]*) ([^ ]*) (\\[.*\\]) (\&q

- Erlang patch

bookjovi

erlang

Totally five patchs committed to erlang otp, just small patchs.

IMO, erlang really is a interesting programming language, I really like its concurrency feature.

but the functional programming style

- log4j日志路径中加入日期

bro_feng

javalog4j

要用log4j使用记录日志,日志路径有每日的日期,文件大小5M新增文件。

实现方式

log4j:

<appender name="serviceLog"

class="org.apache.log4j.RollingFileAppender">

<param name="Encoding" v

- 读《研磨设计模式》-代码笔记-桥接模式

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

/**

* 个人觉得关于桥接模式的例子,蜡笔和毛笔这个例子是最贴切的:http://www.cnblogs.com/zhenyulu/articles/67016.html

* 笔和颜色是可分离的,蜡笔把两者耦合在一起了:一支蜡笔只有一种

- windows7下SVN和Eclipse插件安装

chenyu19891124

eclipse插件

今天花了一天时间弄SVN和Eclipse插件的安装,今天弄好了。svn插件和Eclipse整合有两种方式,一种是直接下载插件包,二种是通过Eclipse在线更新。由于之前Eclipse版本和svn插件版本有差别,始终是没装上。最后在网上找到了适合的版本。所用的环境系统:windows7JDK:1.7svn插件包版本:1.8.16Eclipse:3.7.2工具下载地址:Eclipse下在地址:htt

- [转帖]工作流引擎设计思路

comsci

设计模式工作应用服务器workflow企业应用

作为国内的同行,我非常希望在流程设计方面和大家交流,刚发现篇好文(那么好的文章,现在才发现,可惜),关于流程设计的一些原理,个人觉得本文站得高,看得远,比俺的文章有深度,转载如下

=================================================================================

自开博以来不断有朋友来探讨工作流引擎该如何

- Linux 查看内存,CPU及硬盘大小的方法

daizj

linuxcpu内存硬盘大小

一、查看CPU信息的命令

[root@R4 ~]# cat /proc/cpuinfo |grep "model name" && cat /proc/cpuinfo |grep "physical id"

model name : Intel(R) Xeon(R) CPU X5450 @ 3.00GHz

model name :

- linux 踢出在线用户

dongwei_6688

linux

两个步骤:

1.用w命令找到要踢出的用户,比如下面:

[root@localhost ~]# w

18:16:55 up 39 days, 8:27, 3 users, load average: 0.03, 0.03, 0.00

USER TTY FROM LOGIN@ IDLE JCPU PCPU WHAT

- 放手吧,就像不曾拥有过一样

dcj3sjt126com

内容提要:

静悠悠编著的《放手吧就像不曾拥有过一样》集结“全球华语世界最舒缓心灵”的精华故事,触碰生命最深层次的感动,献给全世界亿万读者。《放手吧就像不曾拥有过一样》的作者衷心地祝愿每一位读者都给自己一个重新出发的理由,将那些令你痛苦的、扛起的、背负的,一并都放下吧!把憔悴的面容换做一种清淡的微笑,把沉重的步伐调节成春天五线谱上的音符,让自己踏着轻快的节奏,在人生的海面上悠然漂荡,享受宁静与

- php二进制安全的含义

dcj3sjt126com

PHP

PHP里,有string的概念。

string里,每个字符的大小为byte(与PHP相比,Java的每个字符为Character,是UTF8字符,C语言的每个字符可以在编译时选择)。

byte里,有ASCII代码的字符,例如ABC,123,abc,也有一些特殊字符,例如回车,退格之类的。

特殊字符很多是不能显示的。或者说,他们的显示方式没有标准,例如编码65到哪儿都是字母A,编码97到哪儿都是字符

- Linux下禁用T440s,X240的一体化触摸板(touchpad)

gashero

linuxThinkPad触摸板

自打1月买了Thinkpad T440s就一直很火大,其中最让人恼火的莫过于触摸板。

Thinkpad的经典就包括用了小红点(TrackPoint)。但是小红点只能定位,还是需要鼠标的左右键的。但是自打T440s等开始启用了一体化触摸板,不再有实体的按键了。问题是要是好用也行。

实际使用中,触摸板一堆问题,比如定位有抖动,以及按键时会有飘逸。这就导致了单击经常就

- graph_dfs

hcx2013

Graph

package edu.xidian.graph;

class MyStack {

private final int SIZE = 20;

private int[] st;

private int top;

public MyStack() {

st = new int[SIZE];

top = -1;

}

public void push(i

- Spring4.1新特性——Spring核心部分及其他

jinnianshilongnian

spring 4.1

目录

Spring4.1新特性——综述

Spring4.1新特性——Spring核心部分及其他

Spring4.1新特性——Spring缓存框架增强

Spring4.1新特性——异步调用和事件机制的异常处理

Spring4.1新特性——数据库集成测试脚本初始化

Spring4.1新特性——Spring MVC增强

Spring4.1新特性——页面自动化测试框架Spring MVC T

- 配置HiveServer2的安全策略之自定义用户名密码验证

liyonghui160com

具体从网上看

http://doc.mapr.com/display/MapR/Using+HiveServer2#UsingHiveServer2-ConfiguringCustomAuthentication

LDAP Authentication using OpenLDAP

Setting

- 一位30多的程序员生涯经验总结

pda158

编程工作生活咨询

1.客户在接触到产品之后,才会真正明白自己的需求。

这是我在我的第一份工作上面学来的。只有当我们给客户展示产品的时候,他们才会意识到哪些是必须的。给出一个功能性原型设计远远比一张长长的文字表格要好。 2.只要有充足的时间,所有安全防御系统都将失败。

安全防御现如今是全世界都在关注的大课题、大挑战。我们必须时时刻刻积极完善它,因为黑客只要有一次成功,就可以彻底打败你。 3.

- 分布式web服务架构的演变

自由的奴隶

linuxWeb应用服务器互联网

最开始,由于某些想法,于是在互联网上搭建了一个网站,这个时候甚至有可能主机都是租借的,但由于这篇文章我们只关注架构的演变历程,因此就假设这个时候已经是托管了一台主机,并且有一定的带宽了,这个时候由于网站具备了一定的特色,吸引了部分人访问,逐渐你发现系统的压力越来越高,响应速度越来越慢,而这个时候比较明显的是数据库和应用互相影响,应用出问题了,数据库也很容易出现问题,而数据库出问题的时候,应用也容易

- 初探Druid连接池之二——慢SQL日志记录

xingsan_zhang

日志连接池druid慢SQL

由于工作原因,这里先不说连接数据库部分的配置,后面会补上,直接进入慢SQL日志记录。

1.applicationContext.xml中增加如下配置:

<bean abstract="true" id="mysql_database" class="com.alibaba.druid.pool.DruidDataSourc

![]()