机器学习&&深度学习——文本预处理

作者简介:一位即将上大四,正专攻机器学习的保研er

上期文章:机器学习&&深度学习——序列模型(NLP启动!)

订阅专栏:机器学习&&深度学习

希望文章对你们有所帮助

里面的算法写起来也不难,但是对于算法小白来说还是要点时间,不过花点时间也能搞明白。

文本预处理

- 步骤

- 读取数据集

- 词元化

- 词表

- 整合所有功能

- 小结

步骤

一篇文章可以被简单地看作一串单词序列,甚至是一串字符序列,我们将进行解析文本的预处理操作,步骤包括:

1、将文本作为字符串加载到内存中。

2、将字符串拆分为词元(如单词和字符)。

3、建立一个词表,将拆分的词元映射到数字索引。

4、将文本转换为数字索引序列,方便模型操作。

import collections

import re

from d2l import torch as d2l

读取数据集

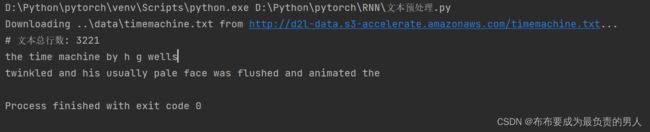

我们从《时光机器》这篇外国书中加载文本,只有几万多的单词。

下面的函数将数据集读取到由多条文本行组成的列表中,其中每条文本行都是一个字符串。(这边省略了标点符号和字母大写)

#@save

d2l.DATA_HUB['time_machine'] = (d2l.DATA_URL + 'timemachine.txt',

'090b5e7e70c295757f55df93cb0a180b9691891a')

def read_time_machine(): #@save

"""将时间机器的数据集加载到文本行的列表中"""

with open(d2l.download('time_machine'), 'r') as f:

lines = f.readlines()

return [re.sub('[^A-Za-z]+', ' ', line).strip().lower() for line in lines]

lines = read_time_machine()

print(f'# 文本总行数: {len(lines)}')

print(lines[0])

print(lines[10])

词元化

下面的tokenize函数将文本行列表(lines)作为输入。每个文本序列又被拆分成一个词元列表,词元(token)是文本的基本单位(可以分解为单词或字符)。

最后返回一个由词元列表组成的列表,其中的每个词元都是一个字符串(string)。

def tokenize(lines, token='word'): #@save

"""将文本拆分为单词词元或字符词元"""

if token == 'word':

return [line.split() for line in lines]

elif token == 'char':

return [list(line) for line in lines]

else:

print('错误:未知词元类型:' + token)

tokens = tokenize(lines)

for i in range(11):

print(tokens[i])

运行结果:

[‘the’, ‘time’, ‘machine’, ‘by’, ‘h’, ‘g’, ‘wells’]

[]

[]

[]

[]

[‘i’]

[]

[]

[‘the’, ‘time’, ‘traveller’, ‘for’, ‘so’, ‘it’, ‘will’, ‘be’, ‘convenient’, ‘to’, ‘speak’, ‘of’, ‘him’]

[‘was’, ‘expounding’, ‘a’, ‘recondite’, ‘matter’, ‘to’, ‘us’, ‘his’, ‘grey’, ‘eyes’, ‘shone’, ‘and’]

[‘twinkled’, ‘and’, ‘his’, ‘usually’, ‘pale’, ‘face’, ‘was’, ‘flushed’, ‘and’, ‘animated’, ‘the’]

词表

模型更喜欢使用的输入不是字符串而是数字,因此我们构造一个字典就好了,这个字典就叫词表。

步骤如下:

1、将训练集中的文档合并在一起,对它们的唯一词元进行统计,得到的统计结果称为语料(corpus)

2、根据每个唯一词元的出现频率,为其分配数字索引(很少出现的词元可以被移除来降低复杂度)

3、不存在或者已删除的词元将映射到特定的位置词元

< u n k >

4、我们就可以增加一个列表来保存那些被保留的词元,如:

< p a d > :填充词元 < b o s > :序列开始词元 < e o s > :序列结束词元

具体代码如下:

class Vocab: #@save

"""文本词表"""

def __init__(self, tokens=None, min_freq=0, reserved_tokens=None):

if tokens is None:

tokens = []

if reserved_tokens is None:

reserved_tokens = []

# 按出现频率排序

counter = count_corpus(tokens)

self._token_freqs = sorted(counter.items(), key=lambda x: x[1],

reverse=True)

# 未知词元的索引为0

self.idx_to_token = ['' ] + reserved_tokens

self.token_to_idx = {token: idx

for idx, token in enumerate(self.idx_to_token)}

for token, freq in self._token_freqs:

if freq < min_freq:

break

if token not in self.token_to_idx:

self.idx_to_token.append(token)

self.token_to_idx[token] = len(self.idx_to_token) - 1

def __len__(self):

return len(self.idx_to_token)

def __getitem__(self, tokens):

if not isinstance(tokens, (list, tuple)):

return self.token_to_idx.get(tokens, self.unk)

return [self.__getitem__(token) for token in tokens]

def to_tokens(self, indices):

if not isinstance(indices, (list, tuple)):

return self.idx_to_token[indices]

return [self.idx_to_token[index] for index in indices]

@property

def unk(self): # 未知词元的索引为0

return 0

@property

def token_freqs(self):

return self._token_freqs

def count_corpus(tokens): #@save

"""统计词元的频率"""

# 这里的tokens是1D列表或2D列表

if len(tokens) == 0 or isinstance(tokens[0], list):

# 将词元列表展平成一个列表

tokens = [token for line in tokens for token in line] # 提取每一行的每个词元,其实也就是一个双层循环

# 返回一个可以用来计数的API

return collections.Counter(tokens)

我们首先使用数据集作为语料库来构建词表,然后打印一下前几个高频词元以及他们的索引:

vocab = Vocab(tokens)

print(list(vocab.token_to_idx.items())[:10])

输出结果:

![]()

现在,我们可以将每一条文本行转换成一个数字索引列表:

for i in [0, 10]:

print('文本:', tokens[i])

print('索引:', vocab.__getitem__(tokens[i]))

结果如下:

文本: [‘the’, ‘time’, ‘machine’, ‘by’, ‘h’, ‘g’, ‘wells’]

索引: [1, 19, 50, 40, 2183, 2184, 400]

文本: [‘twinkled’, ‘and’, ‘his’, ‘usually’, ‘pale’, ‘face’, ‘was’, ‘flushed’, ‘and’, ‘animated’, ‘the’]

索引: [2186, 3, 25, 1044, 362, 113, 7, 1421, 3, 1045, 1]

整合所有功能

在使用上述函数时,我们将所有功能打包到load_corpus_time_machine函数中,该函数返回corpus词元索引列表和vocab词表,我们在这边做出改变:

1、为了简化以后的村联,这里使用字符来实现词元化

2、数据集中的每个文本行不一定是一个句子或一个段落,还可能是一个单词,因此返回的corpus仅处理为单个列表,而不是使用多词元列表构成的一个列表。

from d2l import torch as d2l

def load_corpus_time_machine(max_tokens=-1): #@save

"""返回《时光机器》数据集的词元索引列表和词表"""

lines = d2l.read_time_machine()

tokens = d2l.tokenize(lines, 'char')

vocab = d2l.Vocab(tokens)

# 数据集中的每个文本行不一定是一个句子或一个段落

# 所以将所有文本行展平到一个列表中

corpus = [vocab[token] for line in tokens for token in line]

if max_tokens > 0:

corpus = corpus[:max_tokens]

return corpus, vocab

corpus, vocab = load_corpus_time_machine()

print(len(corpus), len(vocab))

运行结果:

170580 28

小结

1、文本是序列数据的一种最常见形式之一。

2、为了对文本进行预处理,我们通常将文本拆分为词元,构建词表将词元字符串映射为数字索引,并将文本数据转换为词元索引以供模型操作。