- 景联文科技:以高质量数据标注推动人工智能领域创新与发展

景联文科技

科技人工智能数据标注

在当今这个由数据驱动的时代,高质量的数据标注对于推动机器学习、自然语言处理(NLP)、计算机视觉等领域的发展具有不可替代的重要性。数据标注过程涉及对原始数据进行加工,通过标注特定对象的特征来生成能够被机器学习模型识别和使用的编码格式,从而使数据更具有意义和可解读性。数据标注的主要类型包括:图像标注:指在图片中标识出目标物体的位置、形状或类别等信息,如自动驾驶技术中的行人、车辆及交通标志的识别。文本

- 客服机器人怎么才能精准的回答用户问题?

玩人工智能的辣条哥

AI面试机器人客服机器人

环境:客服机器人问题描述:客服机器人怎么才能精准的回答用户问题?解决方案:客服机器人要精准回答用户问题,需综合技术、数据和用户体验等多方面因素。以下是关键策略和步骤:1.精准理解用户意图自然语言处理(NLP)技术分词与实体识别:提取关键词(如“订单号”“退货”)和实体(如时间、地点)。意图分类:通过机器学习模型(如BERT、Transformer)将问题归类(如“售后”“支付”)。上下文理解记录对

- OpenCV 4.2.0与扩展模块安装与应用指南

土城三富

本文还有配套的精品资源,点击获取简介:OpenCV4.2.0是一个先进的计算机视觉库,包含了图像处理、计算机视觉和机器学习算法。本压缩包包含OpenCV核心库和扩展模块(opencv_contrib),版本均为4.2.0。该版本引入了性能增强、API优化以及对深度学习框架和硬件加速技术的更新支持。扩展模块提供了额外的实验性算法和功能,有助于研究和开发新算法。指南详细介绍了如何安装和配置这些库,并提

- OpenCV ML 模块使用指南

ice_junjun

OpenCVopencv人工智能计算机视觉

一、模块概述OpenCV的ML模块提供了丰富的机器学习算法,可用于解决各种计算机视觉和数据分析问题。本指南将详细介绍该模块中主要的机器学习算法,包括支持向量机(SVM)、K均值聚类(K-Means)和神经网络(ANN),并结合图像分类和聚类分析这两个典型应用场景进行代码实现与解释。二、主要函数及类详解(一)支持向量机(SVM):cv.ml.SVM_create()功能支持向量机(SVM)是一种强大

- 强化学习中策略网络模型设计与优化技巧

数字扫地僧

计算机视觉深度学习

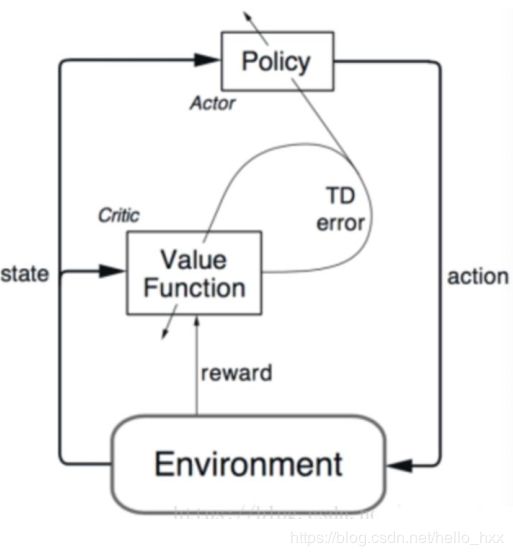

I.引言强化学习(ReinforcementLearning,RL)是一种通过与环境交互,学习如何采取行动以最大化累积奖励的机器学习方法。策略网络(PolicyNetwork)是强化学习中一种重要的模型,它直接输出动作的概率分布或具体的动作。本篇博客将深入探讨策略网络的设计原则、优化技巧,并结合具体实例展示其应用。II.策略网络的基本概念A.策略网络的定义策略网络是一种神经网络,它接受当前状态作为

- 基于Python编程语言实现“机器学习”,用于车牌识别项目

我的sun&shine

Pythonpython机器学习计算机视觉

基于Python的验证码识别研究与实现1.摘要验证码的主要目的是区分人类和计算机,用来防止自动化脚本程序对网站的一些恶意行为,目前绝大部分网站都利用验证码来阻止恶意脚本程序的入侵。验证码的自动识别对于减少自动登录时长,识别难以识别的验证码图片有着重要的作用。对验证码图像进行灰度化、二值化、去离散噪声、字符分割、归一化、特征提取、训练和字符识别等过程可以实现验证码自动识别。首先将原图片进行灰度化处理

- DS/ML:数据科学技术之数据科学生命周期(四大层次+机器学习六大阶段+数据挖掘【5+6+6+4+4+1】步骤)的全流程最强学习路线讲解之详细攻略

一个处女座的程序猿

资深文章(前沿/经验/创新)DataScienceML数据科学数据科学的生命周期机器学习

DS/ML:数据科学技术之数据科学生命周期(四大层次+机器学习六大阶段+数据挖掘【5+6+6+4+4+1】步骤)的全流程最强学习路线讲解之详细攻略导读:本文章是博主在数据科学和机器学习领域,先后实战过几百个应用案例之后的精心总结,应该是完全覆盖了数据科学的整个生命周期及其各个阶段的要点。其中机器学习领域六大阶段更是在整个数据科学生命周期中扮演着极其重要的角色。同时,因为涉及到博主出书中出版社要求在

- 给普通人看的深度学习说明书:用快递系统理解AI如何思考

嵌入式Jerry

PythonAI人工智能深度学习

第一章:理解AI的思维方式(快递版)1.1快递分拣站的故事假设你管理一个快递分拣站:传统方法:手动制定规则(比如根据邮编分拣)机器学习:观察老员工的分拣记录,总结规律深度学习:搭建自动分拣流水线,自主发现隐藏规则1.2神经网络就像智能分拣机传送带(输入层):接收包裹信息(图片像素/文字等)#就像扫描快递单input_data=[0.2,0.7,0.1]#归一化后的特征数据分拣工人(隐藏层):每个工

- 简单理解机器学习中top_k、top_p、temperature三个参数的作用

无级程序员

机器学习人工智能

在机器学习中,top_k、top_p和temperature是用于控制生成模型(如语言模型)输出质量的参数,尤其在文本生成任务中常见。然而,网上文章很多很全,但大多晦涩难懂,今天我们来用最简单的语言谈谈它们的具体作用:1.点菜式筛选法:top_k参数英文全称:top-k中文名称:前k个具体意义:top_k参数就像是你在餐厅点菜时,服务员只给你推荐菜单上前k名的招牌菜。在AI文本生成中,top_k参

- 小白零基础学数学建模系列-引言与课程目录

川川菜鸟

数学建模小白到精通系列数学建模

目录引言一、我们的专辑包含哪些内容?第一周:数学建模基础与工具第二周:高级数学建模技巧与应用第三周:机器学习基础与数据处理第四周:监督学习与无监督学习算法第五周:神经网络二、学完本专辑能收获到什么?三、适合什么样的人群学习?四、如何学习本专辑?课程目录第1周:数学建模基础与工具第1天:数学建模入门介绍第2天:数学建模工具介绍第3天:线性回归与曲线拟合第4天:线性规划第5天:动态规划第2周:高级数学

- 初始OpenCV

指尖下的技术

OpenCVopencv人工智能计算机视觉

OpenCV是一个功能强大、应用广泛的计算机视觉库,它为开发人员提供了丰富的工具和算法,可以帮助他们快速构建各种视觉应用。随着计算机视觉技术的不断发展,OpenCV也将会继续发挥重要的作用。OpenCV提供了大量的计算机视觉算法和图像处理工具,广泛应用于图像和视频的处理、分析以及机器学习领域。所以学习人计算机视觉或者图像处理方面的知识,OpenCV是一个要重点学习的工具库。首先介绍一下OpenCV

- 机器学习结合伏羲模型高精度多尺度气象分析与降尺度实现

Hardess-god

WRF算法人工智能

随着人工智能的发展,机器学习技术在气象预报领域展现出巨大潜力。本文详细探讨如何结合机器学习(ML)和伏羲模型进行高精度多尺度气象模拟分析,并提供详细的实现步骤和相关代码。1.研究目标与技术路线目标:结合机器学习模型与伏羲气象模式,实现区域和局地高精度降尺度。技术路线:伏羲模型提供大尺度气象数据和预报使用机器学习模型(如CNN、LSTM、XGBoost)进行降尺度2.数据准备与处理2.1气象数据获取

- 基于ChatGPT、GIS与Python机器学习的地质灾害风险评估、易发性分析、信息化建库及灾后重建高级实践

weixin_贾

防洪评价风险评估滑坡泥石流地质灾害

第一章、ChatGPT、DeepSeek大语言模型提示词与地质灾害基础及平台介绍【基础实践篇】1、什么是大模型?大模型(LargeLanguageModel,LLM)是一种基于深度学习技术的大规模自然语言处理模型。代表性大模型:GPT-4、BERT、T5、ChatGPT等。特点:多任务能力:可以完成文本生成、分类、翻译、问答等任务。上下文理解:能理解复杂的上下文信息。广泛适配性:适合科研、教育、行

- 人脸识别的一些代码

饿了就干饭

CV相关人脸识别

1、cv2入门函数imread及其相关操作2、(详解)opencv里的cv2.resize改变图片大小Python3、机器学习之人脸识别face_recognition使用4、使用face_recognition进行人脸校准5、简单的人脸识别通用流程示意图(这个看着写的挺好的)6、face_recognition和图像处理中left、top、right、bottom解释7、使用pillow库对图片

- LLM-Agent方法评估与效果分析

agent人工智能ai开发

1.引言近年来,随着大型语言模型(LLM)的快速发展,基于强化学习(RL)对LLM进行微调以使其具备代理(Agent)能力成为研究热点。从基础的单智能体强化学习算法(如PPO)到多智能体协作、语料重组以及在线自学习等新技术不断涌现,研究人员致力于探索如何提高LLM在实际应用中的决策能力、推理能力和任务执行效率。本文主要聚焦于当前LLM-Agent方法的检索与评估,旨在全面探讨各类方法的技术实现、实

- 探索Python中的集成方法:Stacking

Echo_Wish

Python笔记Python算法python开发语言

在机器学习领域,Stacking是一种高级的集成学习方法,它通过将多个基本模型的预测结果作为新的特征输入到一个元模型中,从而提高整体模型的性能和鲁棒性。本文将深入介绍Stacking的原理、实现方式以及如何在Python中应用。什么是Stacking?Stacking,又称为堆叠泛化(StackedGeneralization),是一种模型集成方法,与Bagging和Boosting不同,它并不直

- 【Python】 Stacking: 强大的集成学习方法

音乐学家方大刚

Pythonpython集成学习开发语言

我们都找到天使了说好了心事不能偷藏着什么都一起做幸福得没话说把坏脾气变成了好沟通我们都找到天使了约好了负责对方的快乐阳光下的山坡你素描的以后怎么抄袭我脑袋想的薛凯琪《找到天使了》在机器学习中,单一模型的性能可能会受到其局限性和数据的影响。为了解决这个问题,我们可以使用集成学习(EnsembleLearning)方法。集成学习通过结合多个基模型的预测结果,来提高整体模型的准确性和稳健性。Stacki

- Stacking算法:集成学习的终极武器

civilpy

算法集成学习机器学习

Stacking算法:集成学习的终极武器在机器学习的竞技场中,集成学习方法以其卓越的性能而闻名。其中,Stacking(堆叠泛化)作为一种高级集成技术,更是被誉为“集成学习的终极武器”。本文将带你深入了解Stacking算法的原理和实现,并提供一些实战技巧和最佳实践。1.Stacking算法原理探秘Stacking算法的核心思想是训练多个不同的基模型,并将它们的预测结果作为新模型的输入特征,以此来

- 集成学习(上):Bagging集成方法

万事可爱^

机器学习修仙之旅#监督学习集成学习机器学习人工智能Bagging随机森林

一、什么是集成学习?在机器学习的世界里,没有哪个模型是完美无缺的。就像古希腊神话中的"盲人摸象",单个模型往往只能捕捉到数据特征的某个侧面。但当我们把多个模型的智慧集合起来,就能像拼图一样还原出完整的真相,接下来我们就来介绍一种“拼图”算法——集成学习。集成学习是一种机器学习技术,它通过组合多个模型(通常称为“弱学习器”或“基础模型”)的预测结果,构建出更强、更准确的学习算法。这种方法的主要思想是

- 【集成学习】:Stacking原理以及Python代码实现

Geeksongs

机器学习python机器学习深度学习人工智能算法

Stacking集成学习在各类机器学习竞赛当中得到了广泛的应用,尤其是在结构化的机器学习竞赛当中表现非常好。今天我们就来介绍下stacking这个在机器学习模型融合当中的大杀器的原理。并在博文的后面附有相关代码实现。总体来说,stacking集成算法主要是一种基于“标签”的学习,有以下的特点:用法:模型利用交叉验证,对训练集进行预测,从而实现二次学习优点:可以结合不同的模型缺点:增加了时间开销,容

- windows使用ssh-copy-id命令的解决方案

爱编程的喵喵

Windows实用技巧windowssshssh-copy-id解决方案

大家好,我是爱编程的喵喵。双985硕士毕业,现担任全栈工程师一职,热衷于将数据思维应用到工作与生活中。从事机器学习以及相关的前后端开发工作。曾在阿里云、科大讯飞、CCF等比赛获得多次Top名次。现为CSDN博客专家、人工智能领域优质创作者。喜欢通过博客创作的方式对所学的知识进行总结与归纳,不仅形成深入且独到的理解,而且能够帮助新手快速入门。 本文主要介绍了windows使用ssh-copy-

- 强化学习 Reward

百态老人

算法

在强化学习中,奖励(Reward)是智能体(Agent)与环境(Environment)交互过程中获得的重要反馈信号。奖励机制在强化学习中扮演着至关重要的角色,因为它不仅指导智能体如何在环境中行动,还影响其策略的优化和最终的学习效果。奖励是智能体在执行某个动作后从环境中获得的即时反馈,用于评估该动作的好坏。这种反馈帮助智能体调整其行为策略,以期在未来获得更多的奖励。奖励可以是正数、负数或零,其或负

- PyTorch基础知识讲解(一)完整训练流程示例

苏雨流丰

机器学习pytorch人工智能python机器学习深度学习

文章目录Tutorial1.数据处理2.网络模型定义3.损失函数、模型优化、模型训练、模型评价4.模型保存、模型加载、模型推理Tutorial大多数机器学习工作流程涉及处理数据、创建模型、优化模型参数和保存训练好的模型。本教程向你介绍一个用PyTorch实现的完整的ML工作流程,并提供链接来了解这些概念中的每一个。我们将使用FashionMNIST数据集来训练一个神经网络,预测输入图像是否属于以下

- 机器学习中的贝叶斯网络:如何构建高效的风险预测模型

AI天才研究院

DeepSeekR1&大数据AI人工智能大模型自然语言处理人工智能语言模型编程实践开发语言架构设计

作者:禅与计算机程序设计艺术文章目录机器学习中的贝叶斯网络:如何构建高效的风险预测模型1.背景介绍2.基本概念术语说明2.1马尔科夫随机场(MarkovRandomField)2.2条件随机场(ConditionalRandomField,CRF)2.3变量elimination算法2.4贝叶斯网络3.核心算法原理和具体操作步骤以及数学公式讲解3.1原理介绍1.贝叶斯网络基础2.贝叶斯网络构建风险

- 使用 Milvus 进行向量数据库管理与实践

qahaj

milvus数据库python

技术背景介绍在当今的AI与机器学习应用中,处理和管理大量的嵌入向量是一个常见的需求。Milvus是一个开源向量数据库,专门用于存储、索引和管理深度神经网络以及其他机器学习模型生成的大规模嵌入向量。它的高性能和易用性使其成为处理向量数据的理想选择。核心原理解析Milvus的核心功能体现在其强大的向量索引和搜索能力。它支持多种索引算法,包括IVF、HNSW等,使其能够高效地进行大规模向量的相似性搜索操

- 物理学不存在了?诺贝尔物理学奖颁给了人工智能

资讯新鲜事

人工智能

2024年10月8日,瑞典皇家科学院宣布,将2024年诺贝尔物理学奖授予美国普林斯顿大学教授约翰·J·霍普菲尔德(JohnJ.Hopfield)和加拿大多伦多大学教授杰弗里·E·辛顿(GeoffreyE.Hinton),以表彰他们“在人工神经网络机器学习方面的基础性发现和发明”。辛顿在接受电话采访时表示:“完全没想到”。实话实说,在结果出来前,大家也都没想到。因为在外界预测里,今年的诺贝尔物理学奖

- PHP 爬虫实战:爬取淘宝商品详情数据

EcomDataMiner

php爬虫开发语言

随着互联网技术的发展,数据爬取越来越成为了数据分析、机器学习等领域的重要前置技能。而在这其中,爬虫技术更是不可或缺。php作为一门广泛使用的后端编程语言,其在爬虫领域同样也有着广泛应用和优势。本文将以爬取斗鱼直播数据为例,介绍php爬虫的实战应用。准备工作在开始爬虫之前,我们需要做一些准备工作。首先,需要搭建一个本地服务器环境,推荐使用WAMP、XAMPP等集成化工具,方便部署PHP环境。其次,我

- 强化学习中的深度卷积神经网络设计与应用实例

数字扫地僧

计算机视觉cnn人工智能神经网络

I.引言强化学习(ReinforcementLearning,RL)是机器学习的一个重要分支,通过与环境的交互来学习最优策略。深度学习,特别是深度卷积神经网络(DeepConvolutionalNeuralNetworks,DCNNs)的引入,为强化学习在处理高维度数据方面提供了强大工具。本文将探讨强化学习中深度卷积神经网络的设计原则及其在不同应用场景中的实例。II.深度卷积神经网络在强化学习中的

- 模拟退火算法:原理、应用与优化策略

尹清雅

算法

摘要模拟退火算法是一种基于物理退火过程的随机搜索算法,在解决复杂优化问题上表现出独特优势。本文详细阐述模拟退火算法的原理,深入分析其核心要素,通过案例展示在函数优化、旅行商问题中的应用,并探讨算法的优化策略与拓展方向,为解决复杂优化问题提供全面的理论与实践指导,助力该算法在多领域的高效应用与创新发展。一、引言在现代科学与工程领域,复杂优化问题无处不在,如资源分配、路径规划、机器学习模型参数调优等。

- TensorFlow深度学习实战项目:从入门到精通

点我头像干啥

Ai深度学习tensorflow人工智能

引言深度学习作为人工智能领域的一个重要分支,近年来取得了显著的进展。TensorFlow作为Google开源的深度学习框架,因其强大的功能和灵活的架构,成为了众多开发者和研究者的首选工具。本文将带领大家通过一个实战项目,深入理解TensorFlow的使用方法,并掌握深度学习的基本流程。1.TensorFlow简介1.1TensorFlow是什么?TensorFlow是一个开源的机器学习框架,由Go

- jvm调优总结(从基本概念 到 深度优化)

oloz

javajvmjdk虚拟机应用服务器

JVM参数详解:http://www.cnblogs.com/redcreen/archive/2011/05/04/2037057.html

Java虚拟机中,数据类型可以分为两类:基本类型和引用类型。基本类型的变量保存原始值,即:他代表的值就是数值本身;而引用类型的变量保存引用值。“引用值”代表了某个对象的引用,而不是对象本身,对象本身存放在这个引用值所表示的地址的位置。

- 【Scala十六】Scala核心十:柯里化函数

bit1129

scala

本篇文章重点说明什么是函数柯里化,这个语法现象的背后动机是什么,有什么样的应用场景,以及与部分应用函数(Partial Applied Function)之间的联系 1. 什么是柯里化函数

A way to write functions with multiple parameter lists. For instance

def f(x: Int)(y: Int) is a

- HashMap

dalan_123

java

HashMap在java中对很多人来说都是熟的;基于hash表的map接口的非同步实现。允许使用null和null键;同时不能保证元素的顺序;也就是从来都不保证其中的元素的顺序恒久不变。

1、数据结构

在java中,最基本的数据结构无外乎:数组 和 引用(指针),所有的数据结构都可以用这两个来构造,HashMap也不例外,归根到底HashMap就是一个链表散列的数据

- Java Swing如何实时刷新JTextArea,以显示刚才加append的内容

周凡杨

java更新swingJTextArea

在代码中执行完textArea.append("message")后,如果你想让这个更新立刻显示在界面上而不是等swing的主线程返回后刷新,我们一般会在该语句后调用textArea.invalidate()和textArea.repaint()。

问题是这个方法并不能有任何效果,textArea的内容没有任何变化,这或许是swing的一个bug,有一个笨拙的办法可以实现

- servlet或struts的Action处理ajax请求

g21121

servlet

其实处理ajax的请求非常简单,直接看代码就行了:

//如果用的是struts

//HttpServletResponse response = ServletActionContext.getResponse();

// 设置输出为文字流

response.setContentType("text/plain");

// 设置字符集

res

- FineReport的公式编辑框的语法简介

老A不折腾

finereport公式总结

FINEREPORT用到公式的地方非常多,单元格(以=开头的便被解析为公式),条件显示,数据字典,报表填报属性值定义,图表标题,轴定义,页眉页脚,甚至单元格的其他属性中的鼠标悬浮提示内容都可以写公式。

简单的说下自己感觉的公式要注意的几个地方:

1.if语句语法刚接触感觉比较奇怪,if(条件式子,值1,值2),if可以嵌套,if(条件式子1,值1,if(条件式子2,值2,值3)

- linux mysql 数据库乱码的解决办法

墙头上一根草

linuxmysql数据库乱码

linux 上mysql数据库区分大小写的配置

lower_case_table_names=1 1-不区分大小写 0-区分大小写

修改/etc/my.cnf 具体的修改内容如下:

[client]

default-character-set=utf8

[mysqld]

datadir=/var/lib/mysql

socket=/va

- 我的spring学习笔记6-ApplicationContext实例化的参数兼容思想

aijuans

Spring 3

ApplicationContext能读取多个Bean定义文件,方法是:

ApplicationContext appContext = new ClassPathXmlApplicationContext(

new String[]{“bean-config1.xml”,“bean-config2.xml”,“bean-config3.xml”,“bean-config4.xml

- mysql 基准测试之sysbench

annan211

基准测试mysql基准测试MySQL测试sysbench

1 执行如下命令,安装sysbench-0.5:

tar xzvf sysbench-0.5.tar.gz

cd sysbench-0.5

chmod +x autogen.sh

./autogen.sh

./configure --with-mysql --with-mysql-includes=/usr/local/mysql

- sql的复杂查询使用案列与技巧

百合不是茶

oraclesql函数数据分页合并查询

本片博客使用的数据库表是oracle中的scott用户表;

------------------- 自然连接查询

查询 smith 的上司(两种方法)

&

- 深入学习Thread类

bijian1013

javathread多线程java多线程

一. 线程的名字

下面来看一下Thread类的name属性,它的类型是String。它其实就是线程的名字。在Thread类中,有String getName()和void setName(String)两个方法用来设置和获取这个属性的值。

同时,Thr

- JSON串转换成Map以及如何转换到对应的数据类型

bijian1013

javafastjsonnet.sf.json

在实际开发中,难免会碰到JSON串转换成Map的情况,下面来看看这方面的实例。另外,由于fastjson只支持JDK1.5及以上版本,因此在JDK1.4的项目中可以采用net.sf.json来处理。

一.fastjson实例

JsonUtil.java

package com.study;

impor

- 【RPC框架HttpInvoker一】HttpInvoker:Spring自带RPC框架

bit1129

spring

HttpInvoker是Spring原生的RPC调用框架,HttpInvoker同Burlap和Hessian一样,提供了一致的服务Exporter以及客户端的服务代理工厂Bean,这篇文章主要是复制粘贴了Hessian与Spring集成一文,【RPC框架Hessian四】Hessian与Spring集成

在

【RPC框架Hessian二】Hessian 对象序列化和反序列化一文中

- 【Mahout二】基于Mahout CBayes算法的20newsgroup的脚本分析

bit1129

Mahout

#!/bin/bash

#

# Licensed to the Apache Software Foundation (ASF) under one or more

# contributor license agreements. See the NOTICE file distributed with

# this work for additional information re

- nginx三种获取用户真实ip的方法

ronin47

随着nginx的迅速崛起,越来越多公司将apache更换成nginx. 同时也越来越多人使用nginx作为负载均衡, 并且代理前面可能还加上了CDN加速,但是随之也遇到一个问题:nginx如何获取用户的真实IP地址,如果后端是apache,请跳转到<apache获取用户真实IP地址>,如果是后端真实服务器是nginx,那么继续往下看。

实例环境: 用户IP 120.22.11.11

- java-判断二叉树是不是平衡

bylijinnan

java

参考了

http://zhedahht.blog.163.com/blog/static/25411174201142733927831/

但是用java来实现有一个问题。

由于Java无法像C那样“传递参数的地址,函数返回时能得到参数的值”,唯有新建一个辅助类:AuxClass

import ljn.help.*;

public class BalancedBTree {

- BeanUtils.copyProperties VS PropertyUtils.copyProperties

诸葛不亮

PropertyUtilsBeanUtils

BeanUtils.copyProperties VS PropertyUtils.copyProperties

作为两个bean属性copy的工具类,他们被广泛使用,同时也很容易误用,给人造成困然;比如:昨天发现同事在使用BeanUtils.copyProperties copy有integer类型属性的bean时,没有考虑到会将null转换为0,而后面的业

- [金融与信息安全]最简单的数据结构最安全

comsci

数据结构

现在最流行的数据库的数据存储文件都具有复杂的文件头格式,用操作系统的记事本软件是无法正常浏览的,这样的情况会有什么问题呢?

从信息安全的角度来看,如果我们数据库系统仅仅把这种格式的数据文件做异地备份,如果相同版本的所有数据库管理系统都同时被攻击,那么

- vi区段删除

Cwind

linuxvi区段删除

区段删除是编辑和分析一些冗长的配置文件或日志文件时比较常用的操作。简记下vi区段删除要点备忘。

vi概述

引文中并未将末行模式单独列为一种模式。单不单列并不重要,能区分命令模式与末行模式即可。

vi区段删除步骤:

1. 在末行模式下使用:set nu显示行号

非必须,随光标移动vi右下角也会显示行号,能够正确找到并记录删除开始行

- 清除tomcat缓存的方法总结

dashuaifu

tomcat缓存

用tomcat容器,大家可能会发现这样的问题,修改jsp文件后,但用IE打开 依然是以前的Jsp的页面。

出现这种现象的原因主要是tomcat缓存的原因。

解决办法如下:

在jsp文件头加上

<meta http-equiv="Expires" content="0"> <meta http-equiv="kiben&qu

- 不要盲目的在项目中使用LESS CSS

dcj3sjt126com

Webless

如果你还不知道LESS CSS是什么东西,可以看一下这篇文章,是我一朋友写给新人看的《CSS——LESS》

不可否认,LESS CSS是个强大的工具,它弥补了css没有变量、无法运算等一些“先天缺陷”,但它似乎给我一种错觉,就是为了功能而实现功能。

比如它的引用功能

?

.rounded_corners{

- [入门]更上一层楼

dcj3sjt126com

PHPyii2

更上一层楼

通篇阅读完整个“入门”部分,你就完成了一个完整 Yii 应用的创建。在此过程中你学到了如何实现一些常用功能,例如通过 HTML 表单从用户那获取数据,从数据库中获取数据并以分页形式显示。你还学到了如何通过 Gii 去自动生成代码。使用 Gii 生成代码把 Web 开发中多数繁杂的过程转化为仅仅填写几个表单就行。

本章将介绍一些有助于更好使用 Yii 的资源:

- Apache HttpClient使用详解

eksliang

httpclienthttp协议

Http协议的重要性相信不用我多说了,HttpClient相比传统JDK自带的URLConnection,增加了易用性和灵活性(具体区别,日后我们再讨论),它不仅是客户端发送Http请求变得容易,而且也方便了开发人员测试接口(基于Http协议的),即提高了开发的效率,也方便提高代码的健壮性。因此熟练掌握HttpClient是很重要的必修内容,掌握HttpClient后,相信对于Http协议的了解会

- zxing二维码扫描功能

gundumw100

androidzxing

经常要用到二维码扫描功能

现给出示例代码

import com.google.zxing.WriterException;

import com.zxing.activity.CaptureActivity;

import com.zxing.encoding.EncodingHandler;

import android.app.Activity;

import an

- 纯HTML+CSS带说明的黄色导航菜单

ini

htmlWebhtml5csshovertree

HoverTree带说明的CSS菜单:纯HTML+CSS结构链接带说明的黄色导航

在线体验效果:http://hovertree.com/texiao/css/1.htm代码如下,保存到HTML文件可以看到效果:

<!DOCTYPE html >

<html >

<head>

<title>HoverTree

- fastjson初始化对性能的影响

kane_xie

fastjson序列化

之前在项目中序列化是用thrift,性能一般,而且需要用编译器生成新的类,在序列化和反序列化的时候感觉很繁琐,因此想转到json阵营。对比了jackson,gson等框架之后,决定用fastjson,为什么呢,因为看名字感觉很快。。。

网上的说法:

fastjson 是一个性能很好的 Java 语言实现的 JSON 解析器和生成器,来自阿里巴巴的工程师开发。

- 基于Mybatis封装的增删改查实现通用自动化sql

mengqingyu

DAO

1.基于map或javaBean的增删改查可实现不写dao接口和实现类以及xml,有效的提高开发速度。

2.支持自定义注解包括主键生成、列重复验证、列名、表名等

3.支持批量插入、批量更新、批量删除

<bean id="dynamicSqlSessionTemplate" class="com.mqy.mybatis.support.Dynamic

- js控制input输入框的方法封装(数字,中文,字母,浮点数等)

qifeifei

javascript js

在项目开发的时候,经常有一些输入框,控制输入的格式,而不是等输入好了再去检查格式,格式错了就报错,体验不好。 /** 数字,中文,字母,浮点数(+/-/.) 类型输入限制,只要在input标签上加上 jInput="number,chinese,alphabet,floating" 备注:floating属性只能单独用*/

funct

- java 计时器应用

tangqi609567707

javatimer

mport java.util.TimerTask; import java.util.Calendar; public class MyTask extends TimerTask { private static final int

- erlang输出调用栈信息

wudixiaotie

erlang

在erlang otp的开发中,如果调用第三方的应用,会有有些错误会不打印栈信息,因为有可能第三方应用会catch然后输出自己的错误信息,所以对排查bug有很大的阻碍,这样就要求我们自己打印调用的栈信息。用这个函数:erlang:process_display (self (), backtrace).需要注意这个函数只会输出到标准错误输出。

也可以用这个函数:erlang:get_s

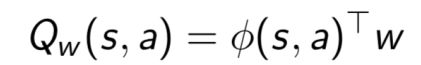

![]() 为TD error

为TD error![]()

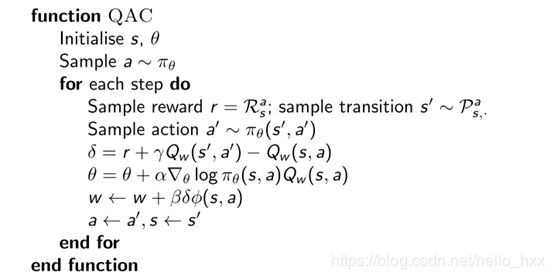

![]() ,根据策略梯度公式

,根据策略梯度公式![]() 时,需要用到critic值函数近似的参数w,所以先更新actor的参数,再更新w

时,需要用到critic值函数近似的参数w,所以先更新actor的参数,再更新w