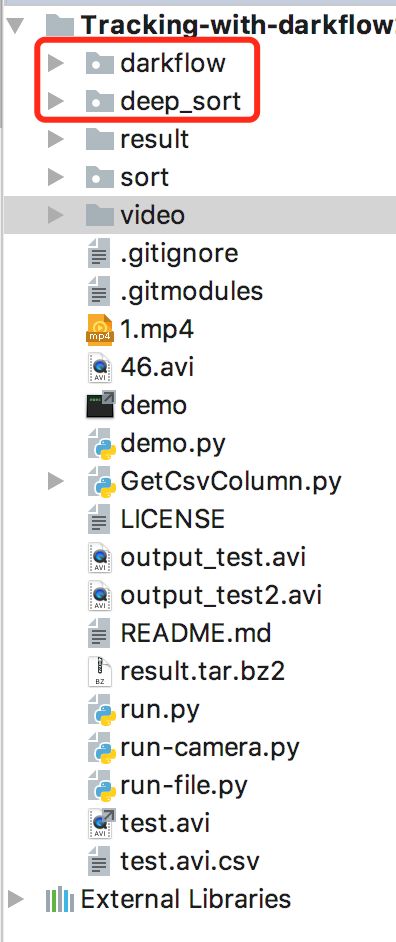

1: 工程模块: 识别和计数

识别模块是用darkflow(darkflow = darknet + tensorflow)

darknet主要是YOLO模块

YOLO官网 用于做侦测和识别人物,darknet是c语言,darkflow是python。

计数主要是deep_sort/sort模块:

其实这两个模块的区别,作者写的很清楚了

deep_sort is build upon sort , it uses deep encoders to build features for each detected box and match it with it's corresponding box in next frame.

意思是说:deep_sort使用deep encoders去创建特征,将每个侦测的box做帧间对比。

2:代码分析

run.py

FLAGS = argHandler()

FLAGS.setDefaults()

# 输入文件,如果是摄像头就用camera

FLAGS.demo = "test.avi" # video file to use, or if camera just put "camera"

# yolo的配置文件,里面包含网络模型,如果要识别快,可以选择tiny-yolo.cfg

FLAGS.model = "darkflow/cfg/yolo.cfg" # tensorflow model

# yolo训练后的权重文件

FLAGS.load = "darkflow/bin/yolo.weights" # tensorflow weights

# 顾名思义,识别物体的阀值,YOLO中定义的

FLAGS.threshold = 0.25 # threshold of decetion confidance (detection if confidance > threshold )

# 是否选用gpu

FLAGS.gpu = 0 #how much of the GPU to use (between 0 and 1) 0 means use cpu

# 侦测识别

FLAGS.track = True # wheither to activate tracking or not

# 侦测识别的对象

FLAGS.trackObj = "person" # the object to be tracked

# 是否保存成视频

FLAGS.saveVideo = True #whether to save the video or not

# 是否启用MOG算法,启用的话,可以根据背景的差异做判断,一般情况在像素低的情况开启

FLAGS.BK_MOG = False # activate background substraction using cv2 MOG substraction,

#to help in worst case scenarion when YOLO cannor predict(able to detect mouvement, it's not ideal but well)

# helps only when number of detection < 5, as it is still better than no detection.

# 深度计数模式

FLAGS.tracker = "deep_sort" # wich algorithm to use for tracking deep_sort/sort (NOTE : deep_sort only trained for people detection )

# 丢帧数

FLAGS.skip = 3 # how many frames to skipp between each detection to speed up the network

# 保存csv文件

FLAGS.csv = True # whether to write csv file or not(only when tracking is set to True)

# 可视化显示box

FLAGS.display = True # display the tracking or not

tfnet = TFNet(FLAGS)

# 开始识别分析计数

tfnet.camera()

exit('Demo stopped, exit.')

运行这个文件,就可以开始工作了。

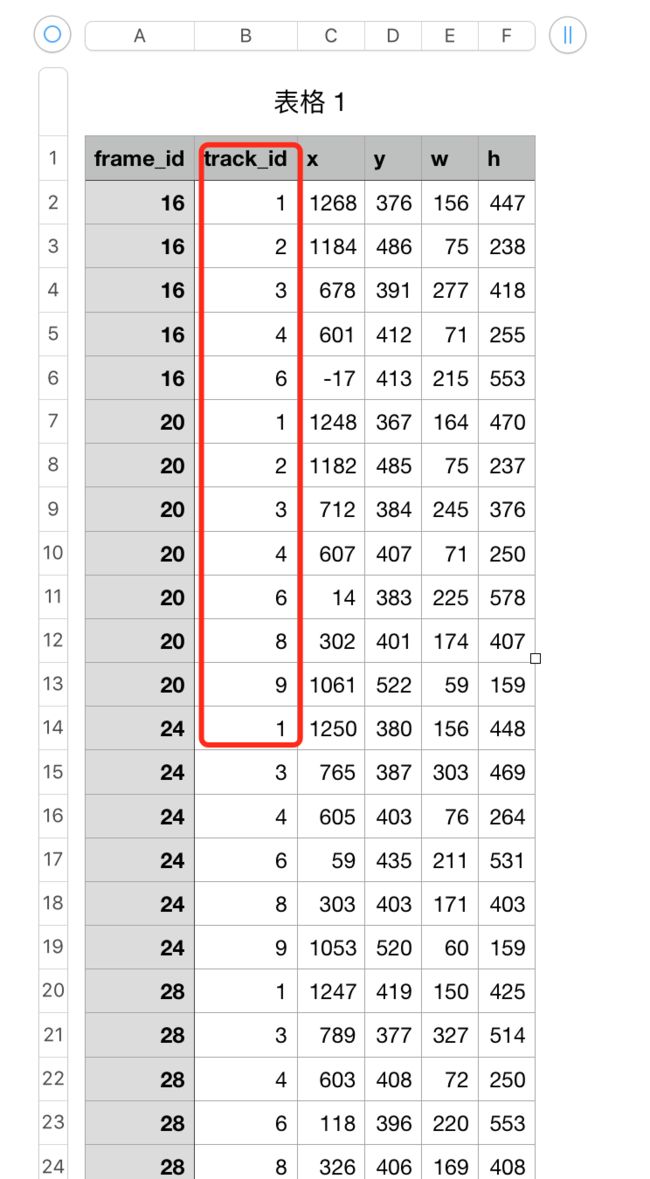

如果视频处理完毕,会生成一个csv文件,如图:

其中,第一列是帧的序号,

第二列,也就是红色框,是对应出现的person的ID编号;

基于源码基础上,我另外写了个GetCsvColumn.py,用于提取这里的值并去重,并显示在左上角:gong count:

后四列是x y w h

如何将统计的数量显示在UI上

本人python用的不熟,各位凑合着看;

修改predict.py

if self.FLAGS.display:

cv2.rectangle(imgcv, (int(bbox[0]), int(bbox[1])), (int(bbox[2]), int(bbox[3])),

(0,255,0), thick//3)

#cv2.putText(imgcv, id_num,(int(bbox[0]), int(bbox[1]) - 12),0, 1e-3 * h, (255,0,255),thick//6)

# show person id

cv2.putText(imgcv, str(update_csv(int(id_num))), (int(bbox[0]), int(bbox[1]) - 12), 0, 1e-3 * h, (255, 0, 255), thick // 6)

# set font

font = cv2.FONT_HERSHEY_TRIPLEX

# count the person

mycount = update_csv(0)

# show to UI, 0,0,255 is red

cv2.putText(imgcv, 'gong count: '+str(mycount), (10,70),0, 1e-3 * h, (0,0,255),thick//6)

定义一个update_csv方法,得到当前此人的ID和总的人数

def update_csv(count):

with open(csvfilename, 'rb') as csvfile:

reader = csv.DictReader(csvfile)

column = [row['track_id'] for row in reader]

blist = list(set(column))

clist = sorted([int(i) for i in blist])

if count == 0:

return len(clist)

else:

return clist.index(count) + 1

这样,工程就可以跑起来并将结果显示出来了;

个人认为,darkflow主要是将YOLO的C代码改成了python代码

darkflow模块,可以重点看下

这里面可以优化的地方不多,因为模型已经训练好,不太可能再重新训练模型,而从生成的视频效果看,行人的识别度其实还不错,其准确率不高是由于别的因素(比如 像素,重叠)

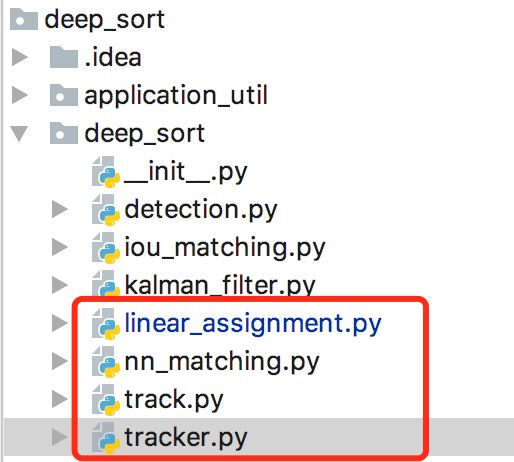

deep_sort模块

里面有个resources文件夹,是训练好的网络权重文件

这个可以下载,第三方已经训练好了的

里面一些地方我没细看,希望大家看完分享下。

前面几个不用看,其中kalman_filter用的是opencv的Kalman filter

参考1

参考2

后面几个可以看下有没有优化的空间

比如:nn_matching.py用到的distance方法

def distance(self, features, targets):

"""Compute distance between features and targets.

Parameters

----------

features : ndarray

An NxM matrix of N features of dimensionality M.

targets : List[int]

A list of targets to match the given `features` against.

Returns

-------

ndarray

Returns a cost matrix of shape len(targets), len(features), where

element (i, j) contains the closest squared distance between

`targets[i]` and `features[j]`.

"""

cost_matrix = np.zeros((len(targets), len(features)))

for i, target in enumerate(targets):

cost_matrix[i, :] = self._metric(self.samples[target], features)

return cost_matrix

deep sort 论文分析

3: 一些优化的思路

目前存在的问题主要是:准确率的问题

- 两个人并行走的时候,容易只识别成一个人

这个是yolo的缺点,暂时无解 - 一个人在视频里的角度如果发生变化,比如转身或者侧面

会识别成多个人(id会增长)

附录:MAC上安装OBS:

在MAC OS上,目前无法安装官网下载的OBS的dmg的版本,需要手动编译安装;

官方wiki

git clone完obs-studio后,需要先执行:

git submodule update --init --recursive

xcode运行