Win10下通过Anaconda5.0.1安装Tenserflow-gpu 1.1.0

1 下载Anaconda5.01

没啥好说的,官网直接下载(点这里),找好自己的对应版本就行,本人用的是Python3.6版本的

按照流程安装,不想装再在C盘也无所谓,换个盘就行,其他的按照推荐选项安装即可,安装完成后,需要将Anaconda的Scripts文件夹的路径以及C:\Windows\System32添加到环境变量PATH中,否则Anaconda prompt将不能正常工作。

2 安装好之后通过Anaconda Navigator配置新的Python环境

先说明一下为什么要配置环境,我自己测试下来1.2.1的CPU版本Tenserflow是可以使用Python3.6的,但是Tenserflow-gpu 1.1.0使用的是Python3.5。配置一个3.5版本环境的方法如下:

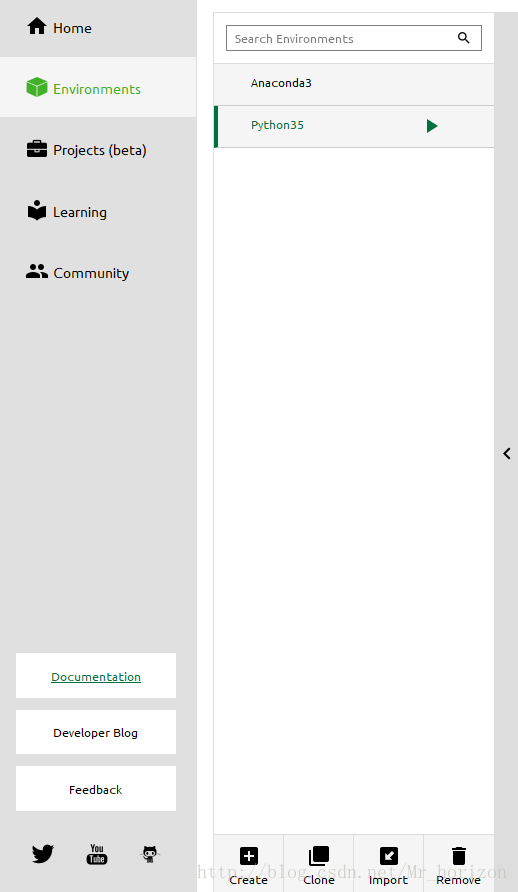

- 在Anaconda Navigator界面点击左侧栏的Environment按钮,在中间栏的底端单击create。

之后会出现对话框,填写环境名字以及选择python版本,这里名字我填的是Tensorflow-gpu,python版本选择3.5。

环境建好后,在右侧搜索关键字tensorflow,勾选gpu版本

点击apply,系统会自动关联其他的依赖项

再次点击apply即可进行安装,安装完成之后,就可以通过开始菜单里的Anaconda prompt或者spyder运行

import tensorflow as tf如果没有报错,基本可以就可以起飞了

但是,初次运行的时候可能会报如下错误:

ImportError: DLL load failed: 找不到指定的模块。(这只是关键的一句,当然报错的时候是一长串的)

我参考了这个两个博客,并下载了里面的DXSDK_Jun10和Microsoft Visual C++ 2015 Redistributable Update 3两个依赖项(如需要安装请先安装DXSDK_Jun10,否则会出错):

http://blog.csdn.net/pjl6523853/article/details/72836214

http://blog.csdn.net/Kexiii/article/details/77990459

但是博客的内容依旧没有解决我的问题,后来终于自己摸索出了结果,一般博客中都有一条将CUDA所在的目录添加到环境变量中,但是通过Anaconda Navigator下载的cuda是安装在当前环境文件夹的DLL文件夹内的,于是将该路径添加到环境变量PATH中即可。

路径添加完毕后即可运行通过程序测试Tenserflow-gpu。

附MINST代码,来源于博客并稍作修改:

http://blog.csdn.net/toormi/article/details/53789562

# -*- coding: utf-8 -*-

"""

Spyder Editor

This is a temporary script file.

"""

import tensorflow as tf

import numpy as np

from tensorflow.examples.tutorials.mnist import input_data

mnist = input_data.read_data_sets('MNIST_data', one_hot=True)

def weight_variable(shape):

initial = tf.truncated_normal(shape,stddev=0.1) #截断正态分布,此函数原型为尺寸、均值、标准差

return tf.Variable(initial)

def bias_variable(shape):

initial = tf.constant(0.1,shape=shape)

return tf.Variable(initial)

def conv2d(x,W):

return tf.nn.conv2d(x,W,strides=[1,1,1,1],padding='SAME') # strides第0位和第3为一定为1,剩下的是卷积的横向和纵向步长

def max_pool_2x2(x):

return tf.nn.max_pool(x,ksize = [1,2,2,1],strides=[1,2,2,1],padding='SAME')# 参数同上,ksize是池化块的大小

x = tf.placeholder("float", shape=[None, 784])

y_ = tf.placeholder("float", shape=[None, 10])

# 图像转化为一个四维张量,第一个参数代表样本数量,-1表示不定,第二三参数代表图像尺寸,最后一个参数代表图像通道数

x_image = tf.reshape(x,[-1,28,28,1])

# 第一层卷积加池化

w_conv1 = weight_variable([5,5,1,32]) # 第一二参数值得卷积核尺寸大小,即patch,第三个参数是图像通道数,第四个参数是卷积核的数目,代表会出现多少个卷积特征

b_conv1 = bias_variable([32])

h_conv1 = tf.nn.relu(conv2d(x_image,w_conv1)+b_conv1)

h_pool1 = max_pool_2x2(h_conv1)

# 第二层卷积加池化

w_conv2 = weight_variable([5,5,32,64]) # 多通道卷积,卷积出64个特征

b_conv2 = bias_variable([64])

h_conv2 = tf.nn.relu(conv2d(h_pool1,w_conv2)+b_conv2)

h_pool2 = max_pool_2x2(h_conv2)

# 原图像尺寸28*28,第一轮图像缩小为14*14,共有32张,第二轮后图像缩小为7*7,共有64张

w_fc1 = weight_variable([7*7*64,1024])

b_fc1 = bias_variable([1024])

h_pool2_flat = tf.reshape(h_pool2,[-1,7*7*64]) # 展开,第一个参数为样本数量,-1未知

f_fc1 = tf.nn.relu(tf.matmul(h_pool2_flat,w_fc1)+b_fc1)

# dropout操作,减少过拟合

keep_prob = tf.placeholder(tf.float32)

h_fc1_drop = tf.nn.dropout(f_fc1,keep_prob)

w_fc2 = weight_variable([1024,10])

b_fc2 = bias_variable([10])

y_conv = tf.nn.softmax(tf.matmul(h_fc1_drop,w_fc2)+b_fc2)

cross_entropy = -tf.reduce_sum(y_*tf.log(y_conv)) # 定义交叉熵为loss函数

train_step = tf.train.AdamOptimizer(1e-4).minimize(cross_entropy) # 调用优化器优化

correct_prediction = tf.equal(tf.argmax(y_conv,1), tf.argmax(y_,1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, "float"))

sess = tf.InteractiveSession()

sess.run(tf.initialize_all_variables())

for i in range(20000):

batch = mnist.train.next_batch(50)

if i%100 == 0:

train_accuracy = accuracy.eval(feed_dict={x:batch[0], y_: batch[1], keep_prob: 1.0})

print("step %d, training accuracy %g"%(i, train_accuracy))

train_step.run(feed_dict={x: batch[0], y_: batch[1], keep_prob: 0.5})

print("test accuracy %g"%accuracy.eval(feed_dict={x: mnist.test.images[0:500], y_: mnist.test.labels[0:500], keep_prob: 1.0}))