字符编码表

一、了解字符编码表

一:计算机基础知识

1、程序运行与三大核心硬件(cpu,内存,硬盘)的关系:

任何一个程序都是先存放于硬盘上的,必须先由硬盘读取到内存,之后cpu去内存中取值然后执行

2、程序运行过程中产生的数据最先放在内存中,计算机内部存取的数据用的都是010101010101的二进制

二、文本编辑器和python解释器运行原理

python程序运行的三个步骤

python3 D:\a.py

1、先启动python解释器

2、解释器会将a.py的内容当成普通内存从硬盘读入内存,此时没有语法意义

3、解释器会解释执行刚刚读入内存的内存,开始识别python语法

任何一个程序都是先存放于硬盘上的,必须先由硬盘读取到内存,之后cpu去内存中取值然后执行

文本编辑器

1、打开编辑器就打开了启动了一个进程,是在内存中的,所以,用编辑器编写的内容也都是存放与内存中的,断电后数据丢失

2、要想永久保存,需要点击保存按钮:编辑器把内存的数据刷到了硬盘上。

3、在我们编写一个py文件(没有执行),跟编写其他文件没有任何区别,都只是在编写一堆字符而已。

总结

相同:1、任何的程序要想运行都是先从硬盘读取到内存

2、文本编辑器和python解释器都会去硬盘中读取你想要读取的内容

不同:1、文本编辑器将文件内容读取之后仅仅是展示给用户看

python解释器会识别语法并解释执行python代码

三、什么是字符编码

计算机所能识别的都是二进制01010101的数字,所以总结计算机只能认识数字

经历的过程:

字符-----(翻译过程)-----数字

这个过程实际就是一个字符如何对应一个特定数字的标准,这个标准称之为字符编码

四、字符编码表发展史

python 2.x默认的字符编码是ASCII,默认的文件编码也是ASCII。

python 3.x默认的字符编码是unicode,默认的文件编码是utf-8。

1、ASCII:美国人发明的最早的只能识别英文字符

1、ASCII:美国人发明的最早的只能识别英文字符

特点:采用8bit对应一个英文字符

8bit=》1Bytes

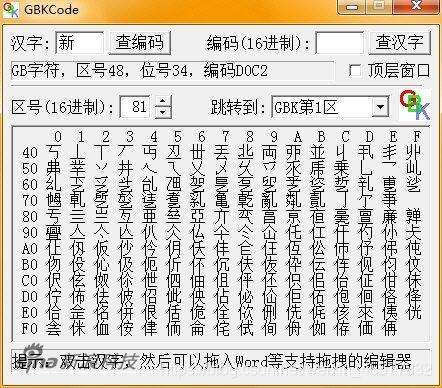

2、GBK:中国人发明的可以识别中文字符串与英文字符

特点:采用16bit对应字符,该字符可以是英文字符、也可以是中文字符

16bit = 》2Bytes

3、shift-JIS日本人发明的可以识别日文和英文字符

Euc-kr韩国人发明的可以识别韩文和英文字符

4、unicode:可以识别万国字符

特点:2Bytes对应一个字符

在unicode中对于是英文的文本来说,unicode无疑是多了一倍的存储空间(二进制最终都是以电或者磁的方式存储到存储介质中的)

于是产生了UTF-8(可变长,全称Unicode Transformation Format),对英文字符只用1Bytes表示,对中文字符用3Bytes,对其他生僻字用更多的Bytes去存

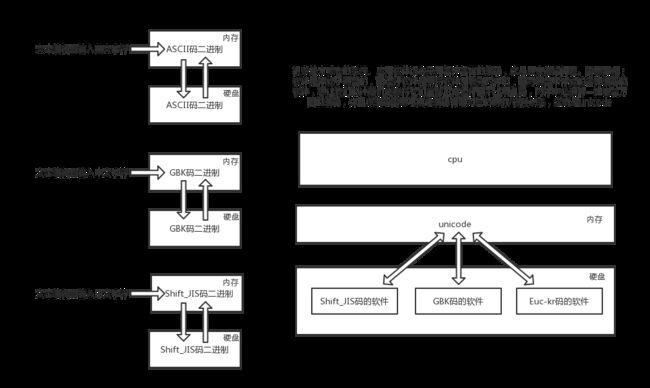

总结:内存中统一采用unicode,浪费空间来换取可以转换成任意编码(不乱码),硬盘可以采用各种编码,如utf-8,保证存放于硬盘或者基于网络传输的数据量很小,提高传输效率与稳定性。

字符-----》unicode格式的数字

GBK shiftJIS**

基于目前的现状,内存中的编码固定就是unicode,我们唯一可变的就是硬盘的上对应的字符编码。

1、

英文字符--------------内存:ASCII二进制数--------------->硬盘:ASCII二进制数

中文英文字符--------------内存:GBK二进制数--------------->硬盘:GBK二进制数

日文英文字符--------------内存:shiftJIS二进制数--------------->硬盘:shiftJIS二进制数

韩文英文字符--------------内存:Euc-Kr二进制数--------------->硬盘:Euc-Kr二进制数

2、

中文英文字符------------内存:unicode=gbk====>硬盘:GBK二进制数

日文英文字符------------内存:unicode=shifJIS>硬盘:shiftJIS二进制数

韩文英文字符------------内存:unicode=Euc-Kr=>硬盘:Euc-Kr二进制数

万国字符----------------内存:unicode=utf-8==>硬盘:utf-8二进制数

3、

万国字符----------------内存:unicode=utf-8==>硬盘:utf-8二进制数

万国字符----------------内存:utf-8==========================>硬盘:utf-8二进制数

在读入内存时,需要将utf-8转成unicode

所以我们需要明确:内存中用unicode是为了兼容万国软件,即便是硬盘中有各国编码编写的软件,unicode也有相对应的映射关系,但在现在的开发中,程序员普遍使用utf-8编码了。

乱码问题

无论以什么编码在内存里显示字符,存到硬盘上都是二进制,所以编码不对,程序就会出错。

1、存的时候乱了:采用的字符编码表无法识别输入的字符

存的时候就已经乱了,是无法补救的,取的时候一定也乱了

解决方法:存入硬盘的编码格式应该用utf-8格式

2、存的时候没有乱码:采用的字符编码表可以识别输入的字符

但是取的时候乱码了:采用的字符编码表与当初存的时候用的不是同一张表

解决方法:存的时候用什么编码,取的时候一定要用同样的编码格式

与运行python程序有关的乱码问题:

1、保证运行python程序的前两个阶段不乱码

在python文件的开头加一行:

#coding:文件存的时候用的编码格式

#coding:gbk

python2.x的bytes与python3.x的bytes的区别

Python2将string处理为原生的bytes类型,而不是 unicode。而Python3所有的 string均是unicode类型。

在python2.x中,写字符串,比如

s = ”学习“

print s

学习s # 字节类型

‘\xd1\xa7\xcf\xb0’

虽然说打印的是中文学习,但是直接调用变量s时,显示的却是一个个16进制表示的二进制字节,我们称这个为byte类型,即字节类型,它把8个二进制组成一个byte,用16进制表示。

所以说python2.x的字符串其实更应该称为字符串,通过存储的方式就能看出来,但是在python2.x中还有一个bytes类型,两个是否相同呢,回答是肯定的,在python2.x中,bytes==str。

python3.x中,把字符串变成了unicode,文件默认编码为utf-8。这意味着,只要用python3.x,无论我们的程序以那种语言开发,都可以在全球各国电脑上正常显示。

python3.x除了把字符串的编码改成了unicode,还把str和bytes做了明确区分,str就是unicode格式的字符串,而bytes就是单纯的二进制。(补充一个问题,在python3.x中,只要把unicode编码,字符串就会变成了bytes格式,也不直接打印成gbk的字符,我觉得就是想通过这样的方式明确的告诉你,想在python3.x中看字符串,必须是unicode,其他编码一律是bytes格式)。

深入中文编码问题

python3内部使用的是unicode编码,而外部却要面对千奇百怪的各种编码,比如作为中国程序经常要面对的gbk,gb2312,utf8等,那这些编码是怎么转换成内部的unicode呢?

首先看一下源代码文件中使用字符串的情况。源代码文件作为文本文件就必然是以某种编码形式存储代码的,python2默认源代码文件是asci编码,python3默认源代码文件是utf-8编码。比如给python2代码文件中的一个变量赋值:

s1 = ‘a’

print s1

python2认为这个字符’a’就是一个asci编码的字符,这个文件可以正常执行,并打印出’a’字符。在仅仅使用英文字符的情况下一切正常,但是如果用了中文,比如:

s1 = ‘哈哈’

print s1

这个代码文件被执行时就会出错,就是编码出了问题。python2默认将代码文件内容当作asci编码处理,但asci编码中不存在中文,因此抛出异常。

解决问题之道就是要让python2解释器知道文件中使用的是什么编码形式,对于中文,可以用的常见编码有utf-8,gbk和gb2312等。只需在代码文件的最前端添加如下:

# -- coding: utf-8 --

这就是告知python2解释器,这个文件里的文本是用utf-8编码的。这样,python就会依照utf-8的编码形式解读其中的字符,然后转换成unicode编码内部处理使用。

不过,如果你在Windows控制台下运行此代码的话,虽然程序是执行了,但屏幕上打印出的却不是哈哈字。这是由于python2编码与控制台编码的不一致造成的。Windows下控制台中的编码使用的是gbk,而在代码中使用的utf-8,python2按照utf-8编码打印到gbk编码的控制台下自然就会不一致而不能打印出正确的汉字。

解决办法一个是将源代码的编码也改成gbk,也就是代码第一行改成:

# -- coding: gbk --

另一种方法是保持源码文件的utf-8不变,而是在’哈哈’前面加个u字,也就是:

s1=u’哈哈’

print s1

这样就可以正确打印出’哈哈’字了。这里的这个u表示将后面跟的字符串以unicode格式存储。python2会根据代码第一行标称的utf-8编码,识别代码中的汉字’哈哈’,然后转换成unicode对象。如果我们用type查看一下’哈哈’的数据类型type(‘哈哈’),会得到

type(‘哈哈’)

type(u’哈哈’)

也就是在字符前面加u就表明这是一个unicode对象,这个字会以unicode格式存在于内存中,而如果不加u,表明这仅仅是一个使用某种编码的字符串,编码格式取决于python2对源码文件编码的识别,这里就是utf-8。

Python2在向控制台输出unicode对象的时候会自动根据输出环境的编码进行转换,但如果输出的不是unicode对象而是普通字符串,则会直接按照字符串的编码输出字符串,从而出现上面的现象。

使用unicode对象的话,除了这样使用u标记,还可以使用unicode类以及字符串的encode和decode方法。

unicode类的构造函数接受一个字符串参数和一个编码参数,将字符串封装为一个unicode,比如在这里,由于我们用的是utf-8编码,所以unicode中的编码参数使用’utf-8’,将字符封装为unicode对象,然后正确输出到控制台:

s1=unicode(‘哈’, ‘utf-8′)

print s1

另外,用decode函数也可以将一个普通字符串转换为unicode对象。很多人都搞不明白python2字符串的decode和encode函数都是什么意思。这里简要说明一下。

decode函数是将普通字符串按照参数中的编码格式进行解析,然后生成对应的unicode对象,比如在这里我们代码用的是utf-8,那么把一个字符串转换为unicode对象就是如下形式:

s2 = ‘哈哈’.decode(‘utf-8’)

type(s2)

这时,s2就是一个存储了’哈哈’字符串的unicode对象,其实就和unicode(‘哈哈’, ‘utf-8′)以及u’哈哈’是相同的。

encode函数正好就是相反的功能,是将一个unicode对象转换为参数中编码格式的普通字符串,比如下面代码:

复制代码

s3 = unicode(‘哈哈’, ‘utf-8’).encode(‘utf-8’)

type(s3)

或者:s3 = ‘哈哈’.decode(‘utf-8’).encode(‘utf-8’)

type(s3)

复制代码

s3现在又变回了utf-8的’哈哈’。同样的,也可指定其它编码格式,但要注意的是,用什么格式编码,就用什么格式解码,否则会出现中文乱码问题。

字符编码

目前使用的编码方式有:ASCII码(一个字节)、Unicode码(两个字节)、UTF-8码(可变长的编码)。我们已经知道了,字符串也是一种数据类型,但是,字符串比较特殊的是还有一个编码问题。

因为计算机只能处理数字,如果要处理文本,就必须先把文本转换为数字才能处理。最早的计算机在设计时采用8个比特(bit)作为一个字节(byte),所以,一个字节能表示的最大的整数就是255(二进制11111111=十进制255),如果要表示更大的整数,就必须用更多的字节。比如两个字节可以表示的最大整数是65535,4个字节可以表示的最大整数是4294967295。

由于计算机是美国人发明的,因此,最早只有127个字符被编码到计算机里,也就是大小写英文字母、数字和一些符号,这个编码表被称为ASCII编码,比如大写字母A的编码是65,小写字母z的编码是122。但是要处理中文显然一个字节是不够的,至少需要两个字节,而且还不能和ASCII编码冲突,所以,中国制定了GB2312编码,用来把中文编进去。可以想得到的是,全世界有上百种语言,日本把日文编到Shift_JIS里,韩国把韩文编到Euc-kr里,各国有各国的标准,就会不可避免地出现冲突,结果就是,在多语言混合的文本中,显示出来会有乱码。因此,Unicode应运而生。Unicode把所有语言都统一到一套编码里,这样就不会再有乱码问题了。Unicode标准也在不断发展,但最常用的是用两个字节表示一个字符(如果要用到非常偏僻的字符,就需要4个字节)。现代操作系统和大多数编程语言都直接支持Unicode。

现在,捋一捋ASCII编码和Unicode编码的区别:ASCII编码是1个字节,而Unicode编码通常是2个字节。

字母A用ASCII编码是十进制的65,二进制的01000001;

字符’0’用ASCII编码是十进制的48,二进制的00110000,注意字符’0’和整数0是不同的;

汉字中已经超出了ASCII编码的范围,用Unicode编码是十进制的20013,二进制的01001110 00101101。

可以猜测,如果把ASCII编码的A用Unicode编码,只需要在前面补0就可以,因此,A的Unicode编码是00000000 01000001。

新的问题又出现了:如果统一成Unicode编码,乱码问题从此消失了。但是,如果你写的文本基本上全部是英文的话,用Unicode编码比ASCII编码需要多一倍的存储空间,在存储和传输上就十分不划算。

所以,本着节约的精神,又出现了把Unicode编码转化为“可变长编码”的UTF-8编码。UTF-8编码把一个Unicode字符根据不同的数字大小编码成1-6个字节,常用的英文字母被编码成1个字节,汉字通常是3个字节,只有很生僻的字符才会被编码成4-6个字节。如果你要传输的文本包含大量英文字符,用UTF-8编码就能节省空间:

字符 ASCII Unicode UTF-8

A 01000001 00000000 01000001 01000001

中 x 01001110 00101101 11100100 10111000 10101101

UTF-8编码有一个额外的好处,就是ASCII编码实际上可以被看成是UTF-8编码的一部分,所以,大量只支持ASCII编码的历史遗留软件可以在UTF-8编码下继续工作。