- AI算力要变天了?一文搞懂ASIC和GPU

asicgpuai芯片

近期,全球股市的动荡中,ASIC和GPU这两个科技股概念突然变得火热,引起了市场的高度关注。博通作为ASIC的代表,股价一路猛涨,而英伟达作为GPU的代表,股价却一路下跌。这是否意味着AI算力市场即将变天?随着人工智能技术的飞速发展,AI算力的重要性日益凸显。从早期的简单模型训练到如今的大规模语言模型如ChatGPT等的出现,对算力的需求呈爆发式增长。01那什么是ASIC和GPU?ASIC:定制化

- 云智慧:拥抱AI算法驱动的智能运维服务创新引擎

随着信息化、数字化、智能化的加码,企业对人工智能、大数据等技术应用呈现出明显兴趣,海笔研究对国内中型规模企业调研表明,在2020年,54.1%的企业选择购买人工智能类应用,41.9%的企业选择购买大数据及BI类应用,各类产品软件的应用大幅提升了企业信息系统复杂度,以及运维管理难度。业务发展催生服务需求从系统管理者角度出发,信息系统从“单机Excel表格”到“集中式单系统”再到“微服务、云架构”等,

- 算力租赁:人工智能时代的“水电煤”革命——以NVIDIA 4090为例解读下一代算力解决方案

算法工程gpu

引言:当AI算力需求遇上“算力饥渴症”2023年,ChatGPT仅用2个月突破1亿用户,StableDiffusion让普通人秒变艺术家,但背后是单次训练消耗超10万GB内存、千亿级参数的恐怖算力需求。当全球AI企业陷入“算力饥渴症”时,一种名为算力租赁的创新模式正以每年37%的增速(MarketsandMarkets数据)重塑行业格局。本文将深度解析这一革命性服务,并聚焦搭载NVIDIARTX4

- 梯度下降法理论理解

伶星37

机器学习人工智能

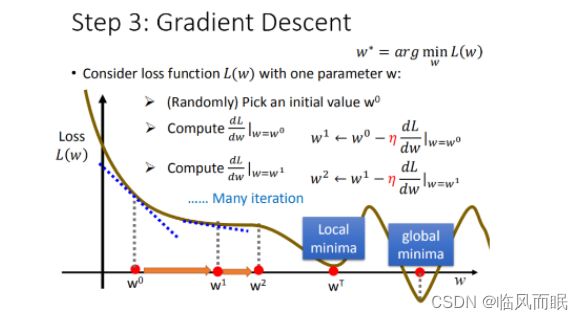

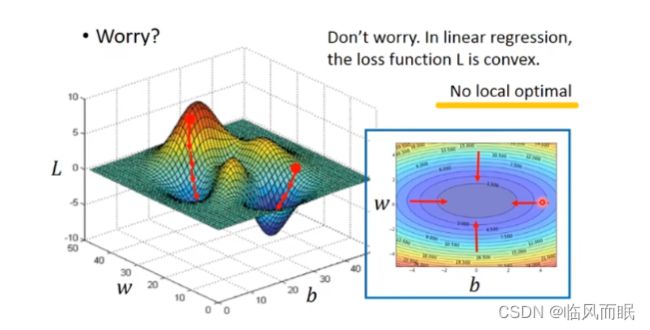

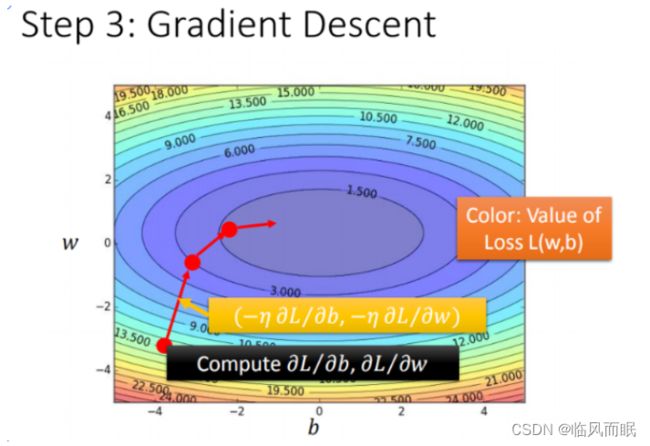

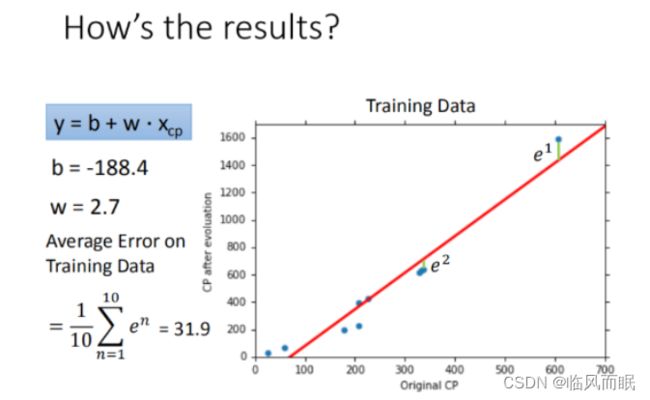

梯度下降法:看似原始却透露着机器学习的本质前提:在研究梯度下降方法之前,你要理解矩阵运算(解析解)的方法矩阵运算目前的缺点只能进行对线性函数经行分析,无法对复杂的函数经行分析什么是梯度,以及梯度向量梯度下降的形象例子以及基本思想有三个兄弟被困在山上,得要死,他们目标是看谁尽快找到山谷中的水源老大比较后选择最陡的方向随便探索一下,就朝较低处走去探测几下就走陡峭的方向梯度下降算法的核心思想就是沿着负梯

- AI大模型产品经理学习路线,2025最新,从AI产品经理零基础入门到精通,非常详细收藏我这一篇够了!

AGI-杠哥

人工智能产品经理学习语言模型agi自然语言处理

随着人工智能技术的发展,尤其是大模型(LargeModel)的兴起,越来越多的企业开始重视这一领域的投入。作为大模型产品经理,你需要具备一系列跨学科的知识和技能,以便有效地推动产品的开发、优化和市场化。以下是一份详细的大模型产品经理学习路线,旨在帮助你构建所需的知识体系,从零基础到精通。一、基础知识阶段1.计算机科学基础数据结构与算法:理解基本的数据结构(如数组、链表、树、图等)和常用算法(如排序

- Java 大视界 -- 基于 Java 的大数据机器学习模型的多模态融合技术与应用(143)

青云交

大数据新视界Java大视界java大数据机器学习多模态融合智能安防智能客服数据处理

亲爱的朋友们,热烈欢迎来到青云交的博客!能与诸位在此相逢,我倍感荣幸。在这飞速更迭的时代,我们都渴望一方心灵净土,而我的博客正是这样温暖的所在。这里为你呈上趣味与实用兼具的知识,也期待你毫无保留地分享独特见解,愿我们于此携手成长,共赴新程!一、欢迎加入【福利社群】点击快速加入:青云交灵犀技韵交响盛汇福利社群点击快速加入2:2024CSDN博客之星创作交流营(NEW)二、本博客的精华专栏:大数据新视

- 2025年第二届机器学习与神经网络国际学术会议(MLNN 2025)

分享学术科研与论文的禁小默

机器学习神经网络人工智能

重要信息官网:www.icmlnn.org时间:2025年4月22-24日地点:中国-重庆简介2025年第二届机器学习与神经网络国际学术会议(MLNN2025)围绕学习系统与神经网络的核心理论、关键技术和应用展开讨论,涵盖深度学习、计算机视觉、自然语言处理、强化学习等多个子领域,通过特邀报告、主题演讲、海报展示等形式,展示相关领域的最新研究成果和技术创新。征稿主题神经网络机器学习深度学习算法及应用

- 别只会用别人的模型了,自学Ai大模型,顺序千万不要搞反了!刚入门的小白必备!

鸡腿爱学习

人工智能学习自然语言处理服务器数据库

大家好,我是JackBytes,一个专注于将人工智能应用于日常生活的半吊子程序猿,平时主要分享AI、NAS、Docker、搞机技巧、开源项目等。在使用诸如DeepSeek、ChatGPT、豆包、文心一言等大模型之余,你是否知道这些大模型背后的技术原理是什么?假如让你从头开始学习大模型,你知道应该遵循什么样的路线嘛?今天给大家介绍一下Ai大模型的学习路线,顺序千万不要搞反了!,大家可以按照这个路线进

- 国内外的网络安全成难题,IPLOOK 2022年用产品筑起“护城墙”

爱浦路 IPLOOK

网络安全安全架构

《爱尔兰时报》和爱尔兰国家广播电台(RTE)于12月31日对2021年爱尔兰科技行业的赢家和弱点进行了年终盘点。双方纷纷表示,2021年爱尔兰科技行业最大的弱点是爱尔兰的网络安全,这一年是一场前所未有的灾难。随着人工智能、大数据、5G等新兴技术的发展,企业面临的威胁日益增加,信息安全的重要性变得越来越突显。现在我们把视线从爱尔兰的网络安全问题拉回到国内的网络安全现状。我国对网络安全问题保持时刻警惕

- Transformer 架构对比:Dense、MoE 与 Hybrid-MoE 的优劣分析

m0_74825656

面试学习路线阿里巴巴transformer架构深度学习

1.LLM基础架构类型DenseTransformerMoE(MixtureofExperts)TransformerHybrid-MoETransformer2.Transformer按照编码方式分类单向自回归模型(如早期GPT系列)双向模型(如BERT)编码器-解码器模型(如BART,T5)DenseTransformerDenseTransformer的优势是什么DenseTransform

- 利用AI与MySQL提升工业物联网健康监测的智慧水平——构建预测性维护的新纪元

墨夶

数据库学习资料1人工智能mysql物联网

在工业4.0和智能制造的大背景下,如何确保生产设备的高效稳定运行成为企业竞争力的核心要素之一。传统的事后维修方式已经难以满足现代制造业的需求,而基于人工智能(AI)的预测性维护系统则为这一挑战提供了全新的解决方案。今天,我们将深入探讨如何结合AI技术和MySQL数据库,打造一个智能、高效的工业物联网(IIoT)健康监测平台,助力企业在激烈的市场竞争中脱颖而出。一、为什么选择AI+MySQL?1.A

- MySQL中基于机器学习的自适应缓存热点识别优化策略——开启数据库性能新纪元

墨夶

数据库学习资料1数据库mysql机器学习

在数据驱动的世界里,数据库的性能直接影响到整个应用系统的响应速度和用户体验。随着业务量的增长和技术的发展,传统的缓存机制逐渐暴露出局限性。如何更智能地识别并利用热点数据进行缓存优化,成为提升数据库性能的关键所在。今天,我们将深入探讨一种创新的方法——基于机器学习的自适应缓存热点识别优化策略,并分享其在MySQL中的具体实现方案。为什么选择机器学习?传统上,开发者们依赖于手动配置或预设规则来决定哪

- “统计视角看世界”专栏阅读引导

赛卡

统计视角看世界信息可视化数据分析

根据文章主题和逻辑关系,我为您设计以下阅读引导方案:1.六西格玛基础2.帕累托图3.直方图4.散点图基础5.散点图高阶6.多变量可视化7.密度图进阶8.回归分析配套文字说明:入门基石(必读)《1.六西格玛遇上Python》→方法论总纲,建议优先精读基础三剑客(可并行)├─《2.帕累托图》→重点数据排序与决策├─《3.直方图》→数据分布核心工具└─《4.散点图》→数据探索第一视角高阶应用链(递进学习

- 密码学,算法在人工智能的实战利用

china—hbaby

人工智能密码学

在人工智能(AI)的快速发展中,数据安全和隐私保护成为了核心议题。密码学,作为保护信息安全的基石,其在AI领域的应用显得尤为重要。本文将探讨密码学在AI中的利用,并提供一些代码示例来展示其实际应用。密码学的概述即常用加密方式密码学(Cryptography)是数学和计算机科学的一个分支,它涉及保护信息的安全性和隐私性。密码学的主要目标是确保信息在传输过程中不被未授权的第三方读取或篡改,以及确保信息

- 【人工智能时代】-人工智能发展史:1900~2023

xiaoli8748_软件开发

人工智能时代人工智能搜索引擎

第一阶段:人工智能发展历史:1900-19591909年西班牙工程师LeonardoTorresyQuevedo发明了“Occultus”,这是一个可以自动执行国际象棋对弈的机器,预示了未来的计算智能。

- AI人工智能软件开发方案:开启智能时代的创新钥匙

广州硅基技术官方

人工智能

一、引言:AI浪潮下的软件开发新机遇近年来,人工智能(AI)技术的迅猛发展如同一股汹涌澎湃的浪潮,席卷了全球各个领域。从最初的概念提出到如今的广泛应用,AI历经了漫长的发展历程,终于迎来了属于它的黄金时代。回首过去,AI的发展并非一帆风顺,早期由于计算能力和算法的限制,经历了多次起伏。但随着大数据、云计算、机器学习、深度学习等技术的不断突破,AI迎来了爆发式增长。如今,AI已经深入到人们生活和工作

- 【机器学习】算法分类

CH3_CH2_CHO

什么?!是机器学习!!机器学习算法有监督学习无监督学习半监督学习强化学习

1、有监督学习1.1定义使用带标签的数据训练模型。有监督学习是机器学习中最常见的一种类型,它利用已知的输入特征和对应的输出标签来训练模型,使模型能够学习到特征与标签之间的映射关系。在训练过程中,模型会不断地调整自身的参数,以最小化预测值与真实标签之间的误差,从而提高预测的准确性。1.2回归问题1.2.1目标预测连续值。回归问题的目标是预测一个连续的数值结果,模型的输出是一个实数值。1.2.2解释回

- 使用 Baseten 部署和运行机器学习模型的指南

shuoac

机器学习人工智能python

随着机器学习模型在各个行业中的广泛应用,如何高效地部署和运行这些模型成为一个关键问题。本文将介绍如何使用Baseten平台来部署和服务机器学习模型。Baseten是LangChain生态系统中的一个重要提供者,它提供了所需的基础设施来高效地运行模型。无论是开源模型如Llama2和Mistral,还是专有或经过微调的模型,Baseten都能在专用GPU上运行。技术背景介绍Baseten提供了一种不同

- 探索Google AI聊天模型的集成和使用

qahaj

人工智能python

随着人工智能的飞速发展,GoogleAI的聊天模型提供了强大的自然语言处理能力,可以应用于多种场景中。本文将为你介绍如何通过GoogleAI和LangChain库来使用这些聊天模型。技术背景介绍GoogleAI提供了一系列强大的聊天模型,这些模型具备不同的功能和参数设置。它们不仅可以通过GoogleAI服务访问,还可以通过GoogleCloudVertexAI以企业级功能使用。在本文中,我们将重点

- “租赁业务ERP+deepseek”模式的应用

软件研究员

汽车DeepSeek汽车租赁系统

汽车租赁业务从上世纪90年代发展至今,从传统的人工管理到软件辅助,随着互联网的发展,业务公司对汽车租赁系统提出了更高的要求,比如自助订单,业务推广、客户资质评估,车辆风控,风险预警等,又随着近期人工智能的出现,业务公司对业务系统的期望更高,期望都节约更多人工成本,让管理变得简单快捷高效和智能。所以就引发人们新的启发:“业务系统ERP+deepseek”,但业务系统ERP+deepseek能否满足业

- 机器学习——分类、回归、聚类、LASSO回归、Ridge回归(自用)

代码的建筑师

模型学习模型训练机器学习机器学习分类回归正则化项LASSORidge朴素

纠正自己的误区:机器学习是一个大范围,并不是一个小的方向,比如:线性回归预测、卷积神经网络和强化学都是机器学习算法在不同场景的应用。机器学习最为关键的是要有数据,也就是数据集名词解释:数据集中的一行叫一条样本或者实例,列名称为特征或者属性。样本的数量称为数据量,特征的数量称为特征维度机器学习常用库:Numpy和sklearn朴素的意思是特征的各条件都是相互独立的机器学习(模型、策略、算法)损失函数

- 量化交易系统中如何处理机器学习模型的训练和部署?

openwin_top

量化交易系统开发机器学习人工智能量化交易

microPythonPython最小内核源码解析NI-motion运动控制c语言示例代码解析python编程示例系列python编程示例系列二python的Web神器Streamlit如何应聘高薪职位量化交易系统中,机器学习模型的训练和部署需要遵循一套严密的流程,以确保模型的可靠性、性能和安全性。以下是详细描述以及相关的示例:1.数据收集和预处理数据收集在量化交易中,数据是最重要的资产。收集的数

- 不懂英语可以学编程吗?,不懂英文可以学编程吗

P5688346

人工智能

大家好,给大家分享一下英语不好能学python编程吗,很多人还不知道这一点。下面详细解释一下。现在让我们来看看!Sourcecodedownload:本文相关源码提到人工智能,就不得不提Python编程语言,大多数人觉得编程语言肯定会涉及到很多代码,满屏的英文字母,想想就头疼,觉得自己不会英语,肯定学不好Python,但是不会英语到底能不能够学习Python呢,下面小编给大家分析分析。其实各位想要

- 【深度学习与大模型基础】第7章-特征分解与奇异值分解

lynn-66

深度学习与大模型基础算法机器学习人工智能

一、特征分解特征分解(EigenDecomposition)是线性代数中的一种重要方法,广泛应用于计算机行业的多个领域,如机器学习、图像处理和数据分析等。特征分解将一个方阵分解为特征值和特征向量的形式,帮助我们理解矩阵的结构和性质。1.特征分解的定义对于一个n×n的方阵A,如果存在一个非零向量v和一个标量λ,使得:则称λ为矩阵A的特征值,v为对应的特征向量。特征分解将矩阵A分解为:其中:Q是由特征

- 《当人工智能遇上广域网:跨越地理距离的通信变革》

程序猿阿伟

人工智能

在数字化时代,广域网作为连接全球信息的纽带,让数据能够在不同地区的网络之间流动。然而,地理距离给广域网数据传输带来诸多挑战,如高延迟、低带宽、信号衰减和不稳定等问题。幸运的是,飞速发展的人工智能技术为解决这些难题提供了新的方向,开启了广域网传输的新篇章。广域网传输面临的地理挑战广域网覆盖范围极为广泛,可连接不同城市、国家甚至跨越洲际,这使得数据传输要跨越漫长的地理距离。以跨国公司的广域网为例,其总

- 【论文阅读】Persistent Homology Captures the Generalization of Neural Networks Without A Validation Set

开心星人

论文阅读论文阅读

将神经网络表征为加权的无环图,直接根据模型的权重矩阵构造PD。计算相邻batch的权重矩阵PD之间的距离。比较同调收敛性与神经网络的验证精度变化趋势摘要机器学习从业者通常通过监控模型的某些指标来估计其泛化误差,并在训练数值收敛之前停止训练,以防止过拟合。通常,这种误差度量或任务相关的指标是通过一个验证集(holdoutset)来计算的。因为这些数据没有直接用于更新模型参数,通常假设模型在验证集上的

- 震惊! “深度学习”都在学习什么

扉间798

深度学习学习人工智能

常见的机器学习分类算法俗话说三个臭皮匠胜过诸葛亮这里面集成学习就是将单一的算法弱弱结合算法融合用投票给特征值加权重AdaBoost集成学习算法通过迭代训练一系列弱分类器,给予分类错误样本更高权重,使得后续弱分类器更关注这些样本,然后将这些弱分类器线性组合成强分类器,提高整体分类性能。(一)投票机制投票是一种直观且常用的算法融合策略。在多分类问题中,假设有多个分类器对同一数据进行分类判断。每个分类器

- 【论文阅读】Availability Attacks Create Shortcuts

开心星人

论文阅读论文阅读

还得重复读这一篇论文,有些地方理解不够透彻可用性攻击通过在训练数据中添加难以察觉的扰动,使数据无法被机器学习算法利用,从而防止数据被未经授权地使用。例如,一家私人公司未经用户同意就收集了超过30亿张人脸图像,用于构建商业人脸识别模型。为解决这些担忧,许多数据投毒攻击被提出,以防止数据被未经授权的深度模型学习。它们通过在训练数据中添加难以察觉的扰动,使模型无法从数据中学习太多信息,从而导致模型在未见

- NLP高频面试题(十)——目前常见的几种大模型架构是啥样的

Chaos_Wang_

NLP常见面试题自然语言处理架构人工智能

深入浅出:目前常见的几种大模型架构解析随着Transformer模型的提出与发展,语言大模型迅速崛起,已经成为人工智能领域最为关注的热点之一。本文将为大家详细解析几种目前常见的大模型架构,帮助读者理解其核心差异及适用场景。1.什么是LLM(大语言模型)?LLM通常指参数量巨大、能够捕捉丰富语义信息的Transformer模型,它们通过海量的文本数据训练而成,能够实现高度逼真的文本生成、复杂的语言理

- 机器学习 Day01人工智能概述

山北雨夜漫步

机器学习人工智能

1.什么样的程序适合在gpu上运行计算密集型的程序:此类程序主要运算集中在寄存器,寄存器读写速度快,而GPU拥有强大的计算能力,能高效处理大量的寄存器运算,因此适合在GPU上运行。像科学计算中的数值模拟、密码破解等场景的程序,都属于计算密集型,在GPU上运行可大幅提升运算速度。易于并行的程序:GPU采用SIMD架构,有众多核心,同一时间每个核心适合做相同的事。易于并行的程序能充分利用GPU这一特性

- ztree设置禁用节点

3213213333332132

JavaScriptztreejsonsetDisabledNodeAjax

ztree设置禁用节点的时候注意,当使用ajax后台请求数据,必须要设置为同步获取数据,否者会获取不到节点对象,导致设置禁用没有效果。

$(function(){

showTree();

setDisabledNode();

});

- JVM patch by Taobao

bookjovi

javaHotSpot

在网上无意中看到淘宝提交的hotspot patch,共四个,有意思,记录一下。

7050685:jsdbproc64.sh has a typo in the package name

7058036:FieldsAllocationStyle=2 does not work in 32-bit VM

7060619:C1 should respect inline and

- 将session存储到数据库中

dcj3sjt126com

sqlPHPsession

CREATE TABLE sessions (

id CHAR(32) NOT NULL,

data TEXT,

last_accessed TIMESTAMP NOT NULL,

PRIMARY KEY (id)

);

<?php

/**

* Created by PhpStorm.

* User: michaeldu

* Date

- Vector

171815164

vector

public Vector<CartProduct> delCart(Vector<CartProduct> cart, String id) {

for (int i = 0; i < cart.size(); i++) {

if (cart.get(i).getId().equals(id)) {

cart.remove(i);

- 各连接池配置参数比较

g21121

连接池

排版真心费劲,大家凑合看下吧,见谅~

Druid

DBCP

C3P0

Proxool

数据库用户名称 Username Username User

数据库密码 Password Password Password

驱动名

- [简单]mybatis insert语句添加动态字段

53873039oycg

mybatis

mysql数据库,id自增,配置如下:

<insert id="saveTestTb" useGeneratedKeys="true" keyProperty="id"

parameterType=&

- struts2拦截器配置

云端月影

struts2拦截器

struts2拦截器interceptor的三种配置方法

方法1. 普通配置法

<struts>

<package name="struts2" extends="struts-default">

&

- IE中页面不居中,火狐谷歌等正常

aijuans

IE中页面不居中

问题是首页在火狐、谷歌、所有IE中正常显示,列表页的页面在火狐谷歌中正常,在IE6、7、8中都不中,觉得可能那个地方设置的让IE系列都不认识,仔细查看后发现,列表页中没写HTML模板部分没有添加DTD定义,就是<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3

- String,int,Integer,char 几个类型常见转换

antonyup_2006

htmlsql.net

如何将字串 String 转换成整数 int?

int i = Integer.valueOf(my_str).intValue();

int i=Integer.parseInt(str);

如何将字串 String 转换成Integer ?

Integer integer=Integer.valueOf(str);

如何将整数 int 转换成字串 String ?

1.

- PL/SQL的游标类型

百合不是茶

显示游标(静态游标)隐式游标游标的更新和删除%rowtyperef游标(动态游标)

游标是oracle中的一个结果集,用于存放查询的结果;

PL/SQL中游标的声明;

1,声明游标

2,打开游标(默认是关闭的);

3,提取数据

4,关闭游标

注意的要点:游标必须声明在declare中,使用open打开游标,fetch取游标中的数据,close关闭游标

隐式游标:主要是对DML数据的操作隐

- JUnit4中@AfterClass @BeforeClass @after @before的区别对比

bijian1013

JUnit4单元测试

一.基础知识

JUnit4使用Java5中的注解(annotation),以下是JUnit4常用的几个annotation: @Before:初始化方法 对于每一个测试方法都要执行一次(注意与BeforeClass区别,后者是对于所有方法执行一次)@After:释放资源 对于每一个测试方法都要执行一次(注意与AfterClass区别,后者是对于所有方法执行一次

- 精通Oracle10编程SQL(12)开发包

bijian1013

oracle数据库plsql

/*

*开发包

*包用于逻辑组合相关的PL/SQL类型(例如TABLE类型和RECORD类型)、PL/SQL项(例如游标和游标变量)和PL/SQL子程序(例如过程和函数)

*/

--包用于逻辑组合相关的PL/SQL类型、项和子程序,它由包规范和包体两部分组成

--建立包规范:包规范实际是包与应用程序之间的接口,它用于定义包的公用组件,包括常量、变量、游标、过程和函数等

--在包规

- 【EhCache二】ehcache.xml配置详解

bit1129

ehcache.xml

在ehcache官网上找了多次,终于找到ehcache.xml配置元素和属性的含义说明文档了,这个文档包含在ehcache.xml的注释中!

ehcache.xml : http://ehcache.org/ehcache.xml

ehcache.xsd : http://ehcache.org/ehcache.xsd

ehcache配置文件的根元素是ehcahe

ehcac

- java.lang.ClassNotFoundException: org.springframework.web.context.ContextLoaderL

白糖_

javaeclipsespringtomcatWeb

今天学习spring+cxf的时候遇到一个问题:在web.xml中配置了spring的上下文监听器:

<listener>

<listener-class>org.springframework.web.context.ContextLoaderListener</listener-class>

</listener>

随后启动

- angular.element

boyitech

AngularJSAngularJS APIangular.element

angular.element

描述: 包裹着一部分DOM element或者是HTML字符串,把它作为一个jQuery元素来处理。(类似于jQuery的选择器啦) 如果jQuery被引入了,则angular.element就可以看作是jQuery选择器,选择的对象可以使用jQuery的函数;如果jQuery不可用,angular.e

- java-给定两个已排序序列,找出共同的元素。

bylijinnan

java

import java.util.ArrayList;

import java.util.Arrays;

import java.util.List;

public class CommonItemInTwoSortedArray {

/**

* 题目:给定两个已排序序列,找出共同的元素。

* 1.定义两个指针分别指向序列的开始。

* 如果指向的两个元素

- sftp 异常,有遇到的吗?求解

Chen.H

javajcraftauthjschjschexception

com.jcraft.jsch.JSchException: Auth cancel

at com.jcraft.jsch.Session.connect(Session.java:460)

at com.jcraft.jsch.Session.connect(Session.java:154)

at cn.vivame.util.ftp.SftpServerAccess.connec

- [生物智能与人工智能]神经元中的电化学结构代表什么?

comsci

人工智能

我这里做一个大胆的猜想,生物神经网络中的神经元中包含着一些化学和类似电路的结构,这些结构通常用来扮演类似我们在拓扑分析系统中的节点嵌入方程一样,使得我们的神经网络产生智能判断的能力,而这些嵌入到节点中的方程同时也扮演着"经验"的角色....

我们可以尝试一下...在某些神经

- 通过LAC和CID获取经纬度信息

dai_lm

laccid

方法1:

用浏览器打开http://www.minigps.net/cellsearch.html,然后输入lac和cid信息(mcc和mnc可以填0),如果数据正确就可以获得相应的经纬度

方法2:

发送HTTP请求到http://www.open-electronics.org/celltrack/cell.php?hex=0&lac=<lac>&cid=&

- JAVA的困难分析

datamachine

java

前段时间转了一篇SQL的文章(http://datamachine.iteye.com/blog/1971896),文章不复杂,但思想深刻,就顺便思考了一下java的不足,当砖头丢出来,希望引点和田玉。

-----------------------------------------------------------------------------------------

- 小学5年级英语单词背诵第二课

dcj3sjt126com

englishword

money 钱

paper 纸

speak 讲,说

tell 告诉

remember 记得,想起

knock 敲,击,打

question 问题

number 数字,号码

learn 学会,学习

street 街道

carry 搬运,携带

send 发送,邮寄,发射

must 必须

light 灯,光线,轻的

front

- linux下面没有tree命令

dcj3sjt126com

linux

centos p安装

yum -y install tree

mac os安装

brew install tree

首先来看tree的用法

tree 中文解释:tree

功能说明:以树状图列出目录的内容。

语 法:tree [-aACdDfFgilnNpqstux][-I <范本样式>][-P <范本样式

- Map迭代方式,Map迭代,Map循环

蕃薯耀

Map循环Map迭代Map迭代方式

Map迭代方式,Map迭代,Map循环

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 2015年

- Spring Cache注解+Redis

hanqunfeng

spring

Spring3.1 Cache注解

依赖jar包:

<!-- redis -->

<dependency>

<groupId>org.springframework.data</groupId>

<artifactId>spring-data-redis</artifactId>

- Guava中针对集合的 filter和过滤功能

jackyrong

filter

在guava库中,自带了过滤器(filter)的功能,可以用来对collection 进行过滤,先看例子:

@Test

public void whenFilterWithIterables_thenFiltered() {

List<String> names = Lists.newArrayList("John"

- 学习编程那点事

lampcy

编程androidPHPhtml5

一年前的夏天,我还在纠结要不要改行,要不要去学php?能学到真本事吗?改行能成功吗?太多的问题,我终于不顾一切,下定决心,辞去了工作,来到传说中的帝都。老师给的乘车方式还算有效,很顺利的就到了学校,赶巧了,正好学校搬到了新校区。先安顿了下来,过了个轻松的周末,第一次到帝都,逛逛吧!

接下来的周一,是我噩梦的开始,学习内容对我这个零基础的人来说,除了勉强完成老师布置的作业外,我已经没有时间和精力去

- 架构师之流处理---------bytebuffer的mark,limit和flip

nannan408

ByteBuffer

1.前言。

如题,limit其实就是可以读取的字节长度的意思,flip是清空的意思,mark是标记的意思 。

2.例子.

例子代码:

String str = "helloWorld";

ByteBuffer buff = ByteBuffer.wrap(str.getBytes());

Sy

- org.apache.el.parser.ParseException: Encountered " ":" ": "" at line 1, column 1

Everyday都不同

$转义el表达式

最近在做Highcharts的过程中,在写js时,出现了以下异常:

严重: Servlet.service() for servlet jsp threw exception

org.apache.el.parser.ParseException: Encountered " ":" ": "" at line 1,

- 用Java实现发送邮件到163

tntxia

java实现

/*

在java版经常看到有人问如何用javamail发送邮件?如何接收邮件?如何访问多个文件夹等。问题零散,而历史的回复早已经淹没在问题的海洋之中。

本人之前所做过一个java项目,其中包含有WebMail功能,当初为用java实现而对javamail摸索了一段时间,总算有点收获。看到论坛中的经常有此方面的问题,因此把我的一些经验帖出来,希望对大家有些帮助。

此篇仅介绍用

- 探索实体类存在的真正意义

java小叶檀

POJO

一. 实体类简述

实体类其实就是俗称的POJO,这种类一般不实现特殊框架下的接口,在程序中仅作为数据容器用来持久化存储数据用的

POJO(Plain Old Java Objects)简单的Java对象

它的一般格式就是

public class A{

private String id;

public Str

![]()

![]()